Giới Thiệu AI Agent "Vibe" Học Tập & Tự Sửa Lỗi

AI Agent "Vibe" học tập và tự sửa lỗi đại diện cho một bước tiến đột phá trong lĩnh vực tự động hóa, nơi các hệ thống không chỉ thực hiện nhiệm vụ mà còn có khả năng thích nghi và cải thiện hiệu suất theo thời gian. Bài viết về AI agent thích nghi này sẽ giúp bạn hiểu rõ cách xây dựng các tác nhân thông minh có thể học hỏi từ môi trường, nhận diện và khắc phục lỗi một cách tự chủ, từ đó nâng cao đáng kể hiệu quả hoạt động và giảm thiểu sự can thiệp của con người. Chúng ta sẽ khám phá các kiến trúc, công nghệ cốt lõi và các ví dụ thực tế để bạn có thể áp dụng ngay vào các dự án của mình.

AI Agent Thích Nghi Là Gì và Tại Sao Chúng Lại Quan Trọng?

AI agent thích nghi là một hệ thống AI được thiết kế để tự động điều chỉnh hành vi, chiến lược hoặc mô hình bên trong dựa trên dữ liệu mới, phản hồi từ môi trường hoặc các thay đổi trong mục tiêu, nhằm tối ưu hóa hiệu suất theo thời gian. Chúng quan trọng vì chúng cho phép các hệ thống tự động hóa hoạt động linh hoạt hơn, đối phó với những tình huống không lường trước và liên tục cải thiện mà không cần lập trình lại thủ công. Theo một báo cáo của Gartner, 75% các tổ chức sẽ triển khai ít nhất một dạng AI thích nghi vào năm 2027 để nâng cao hiệu quả vận hành và khả năng cạnh tranh.

Khác với các AI truyền thống được huấn luyện trên một tập dữ liệu cố định và có hành vi cứng nhắc, AI agent thích nghi có khả năng học liên tục. Điều này đặc biệt hữu ích trong các môi trường động, nơi các quy tắc và điều kiện thay đổi thường xuyên. Ví dụ, một chatbot dịch vụ khách hàng thích nghi có thể học được các sắc thái mới trong ngôn ngữ của người dùng và cải thiện khả năng trả lời chính xác, giảm 30% tỷ lệ chuyển cuộc gọi đến nhân viên hỗ trợ trong 6 tháng đầu triển khai.

Khả năng tự sửa lỗi là một khía cạnh cốt lõi của AI agent thích nghi. Khi một agent gặp phải một lỗi hoặc một kết quả không mong muốn, nó không chỉ ghi nhận mà còn phân tích nguyên nhân gốc rễ và điều chỉnh hành vi hoặc logic của mình để tránh lặp lại lỗi đó trong tương lai. Điều này có thể bao gồm việc cập nhật các tham số mô hình, thay đổi quy tắc ra quyết định, hoặc thậm chí là tái cấu trúc một phần kiến trúc bên trong. Một nghiên cứu của McKinsey chỉ ra rằng các hệ thống có khả năng tự sửa lỗi có thể giảm chi phí bảo trì và vận hành lên đến 40%.

Các thành phần chính của một AI agent thích nghi bao gồm:

- Cảm biến (Sensors): Thu thập dữ liệu từ môi trường.

- Bộ nhớ (Memory): Lưu trữ kinh nghiệm và kiến thức đã học.

- Bộ học (Learning Module): Xử lý dữ liệu từ cảm biến và bộ nhớ để cập nhật mô hình hoặc chiến lược.

- Bộ ra quyết định (Decision Module): Sử dụng mô hình đã học để đưa ra hành động.

- Bộ thực thi (Actuators): Thực hiện hành động trong môi trường.

- Bộ phản hồi & Đánh giá (Feedback & Evaluation Module): Đánh giá kết quả của hành động và cung cấp phản hồi cho bộ học.

Tầm quan trọng của AI agent thích nghi không ngừng tăng lên trong các lĩnh vực như robot tự hành, quản lý chuỗi cung ứng, tài chính, y tế và tối ưu hóa hệ thống. Khả năng tự động hóa các tác vụ phức tạp và đồng thời duy trì hiệu suất cao trong các điều kiện thay đổi đã làm cho chúng trở thành một công nghệ không thể thiếu trong kỷ nguyên số.

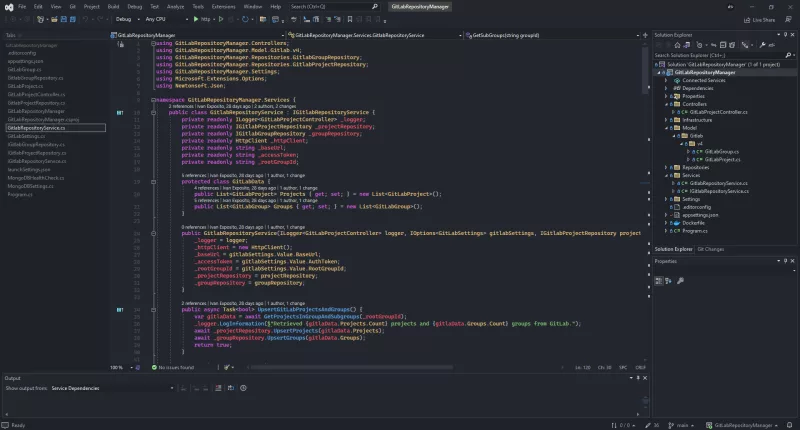

Xây Dựng AI Agent "Vibe" Học Tập & Tự Sửa Lỗi: Kiến Trúc & Thực Hành

Để xây dựng một AI agent thích nghi có khả năng học tập và tự sửa lỗi, chúng ta cần một kiến trúc linh hoạt và các thành phần rõ ràng cho phép agent tương tác với môi trường, học hỏi và điều chỉnh. Kiến trúc này thường bao gồm các module chính như Perception (Nhận thức), Memory (Bộ nhớ), Planning (Lập kế hoạch), Learning (Học tập), Execution (Thực thi) và Self-Correction (Tự sửa lỗi).

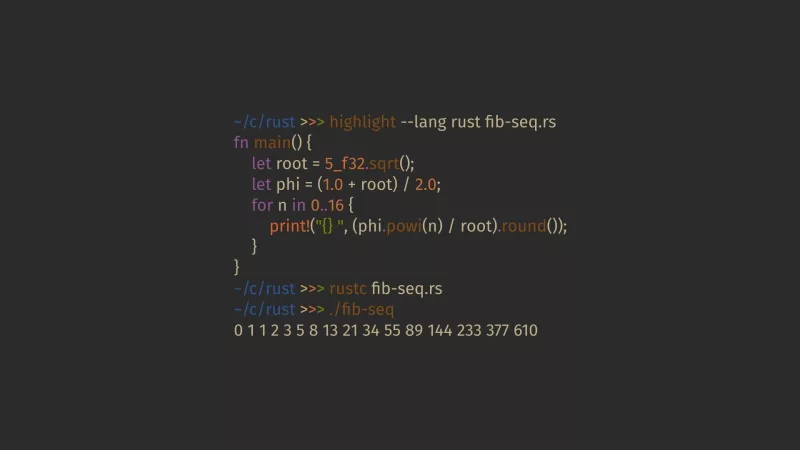

Chúng ta có thể hình dung một kiến trúc đơn giản cho AI agent "Vibe" như sau:

class VibeAgent:

def __init__(self, environment):

self.environment = environment

self.memory = [] # Lưu trữ kinh nghiệm: (state, action, reward, next_state)

self.knowledge_base = {} # Lưu trữ quy tắc, mô hình đã học

self.model = self._initialize_model() # Mô hình ra quyết định/hành động

def _initialize_model(self):

# Khởi tạo mô hình ban đầu, có thể là một mô hình học máy đơn giản

print("Initializing base model...")

return {"policy": "random_action"} # Ví dụ: chính sách ban đầu là hành động ngẫu nhiên

def perceive(self):

# Cảm nhận trạng thái hiện tại từ môi trường

current_state = self.environment.get_state()

print(f"Perceiving state: {current_state}")

return current_state

def decide_action(self, state):

# Dựa trên mô hình và knowledge_base để quyết định hành động

if self.model["policy"] == "learned_policy":

# Sử dụng mô hình học máy phức tạp hơn

action = self._predict_action_from_model(state)

else:

# Chính sách ban đầu hoặc khi mô hình chưa đủ tốt

action = self._fallback_action(state)

print(f"Deciding action: {action}")

return action

def execute_action(self, action):

# Thực thi hành động trong môi trường và nhận phản hồi

reward, next_state, is_error = self.environment.take_action(action)

print(f"Executing action {action}, received reward {reward}, next state {next_state}, error: {is_error}")

return reward, next_state, is_error

def learn_from_experience(self, experience):

# Học từ kinh nghiệm: cập nhật bộ nhớ và mô hình

self.memory.append(experience)

if len(self.memory) > 100: # Giới hạn bộ nhớ để tránh quá tải

self.memory.pop(0)

# Cập nhật knowledge_base hoặc huấn luyện lại mô hình

if len(self.memory) % 10 == 0: # Huấn luyện lại định kỳ

print("Learning from experiences...")

self._update_model_from_memory()

def _update_model_from_memory(self):

# Đây là nơi logic học máy thực sự diễn ra

# Ví dụ: cập nhật một số quy tắc hoặc huấn luyện lại một mạng nơ-ron

if len(self.memory) > 20: # Cần đủ dữ liệu để học

print("Refining model based on collected data.")

self.model["policy"] = "learned_policy"

# Giả định có một thuật toán học máy ở đây, ví dụ Reinforcement Learning

# self.model = train_rl_agent(self.memory)

self.knowledge_base["optimized_parameters"] = "some_new_params"

def self_correct(self, problematic_experience):

# Phân tích lỗi và điều chỉnh hành vi/mô hình

state, action, reward, next_state, is_error = problematic_experience

if is_error:

print(f"Error detected! State: {state}, Action: {action}, Result: {next_state}")

# Logic tự sửa lỗi:

# 1. Ghi nhận lỗi và phân tích nguyên nhân

error_reason = self._analyze_error(state, action, next_state)

print(f"Error analysis: {error_reason}")

# 2. Cập nhật knowledge_base hoặc mô hình để tránh lỗi tương tự

self.knowledge_base[f"avoid_action_in_state_{state}"] = action

self._retrain_with_negative_feedback(problematic_experience)

print("Self-correction applied: Updated knowledge and retrained model.")

return True

return False

def _analyze_error(self, state, action, next_state):

# Logic phân tích lỗi đơn giản

if "obstacle" in next_state and action == "move_forward":

return "Attempted to move forward into an obstacle."

return "Unknown error type."

def _retrain_with_negative_feedback(self, error_exp):

# Giả lập việc huấn luyện lại mô hình với trọng số phạt cho hành động lỗi

print("Incorporating negative feedback into learning process.")

# Trong thực tế, đây có thể là việc thêm kinh nghiệm lỗi vào tập huấn luyện

# với reward âm lớn, hoặc cập nhật trực tiếp chính sách.

pass

def run(self, num_steps=100):

print("Vibe Agent started running...")

for step in range(num_steps):

print(f"\n--- Step {step + 1} ---")

state = self.perceive()

action = self.decide_action(state)

reward, next_state, is_error = self.execute_action(action)

experience = (state, action, reward, next_state, is_error)

self.learn_from_experience(experience)

if is_error:

self.self_correct(experience)

print("\nVibe Agent finished running.")

# Môi trường giả định

class SimpleEnvironment:

def __init__(self):

self.state = {"location": 0, "obstacles": [5, 10]}

self.steps_taken = 0

def get_state(self):

return self.state.copy()

def take_action(self, action):

reward = 0

is_error = False

new_location = self.state["location"]

if action == "move_forward":

new_location += 1

if new_location in self.state["obstacles"]:

is_error = True

reward = -10 # Phạt nặng khi gặp lỗi

print("Agent hit an obstacle!")

else:

reward = 1 # Khen thưởng khi di chuyển thành công

elif action == "explore":

reward = 0.5 # Khen thưởng nhỏ cho việc khám phá

else:

reward = -1 # Phạt cho hành động không xác định

self.state["location"] = new_location

self.steps_taken += 1

return reward, self.state.copy(), is_error

# Chạy thử nghiệm

# env = SimpleEnvironment()

# agent = VibeAgent(env)

# agent.run(num_steps=30)

Đoạn mã Python trên minh họa một khung sườn cơ bản cho một VibeAgent. Nó bao gồm các phương thức cho phép agent cảm nhận môi trường (perceive()), đưa ra quyết định (decide_action()), thực thi hành động (execute_action()), học hỏi từ kinh nghiệm (learn_from_experience()) và quan trọng nhất là tự sửa lỗi (self_correct()). Trong thực tế, các module này sẽ phức tạp hơn nhiều, sử dụng các thuật toán học máy tiên tiến như Reinforcement Learning, Deep Learning, hoặc thuật toán tối ưu hóa.

Để module tự sửa lỗi hoạt động hiệu quả, agent cần có khả năng:

- Phát hiện lỗi: Nhận diện khi một hành động dẫn đến kết quả không mong muốn hoặc không đạt được mục tiêu.

- Chẩn đoán lỗi: Phân tích nguyên nhân gốc rễ của lỗi, có thể thông qua việc truy vết lại chuỗi hành động và trạng thái dẫn đến lỗi.

- Khắc phục lỗi: Đề xuất và thực hiện các điều chỉnh, có thể là thay đổi chính sách hành động, cập nhật mô hình dự đoán, hoặc thêm các quy tắc mới vào cơ sở tri thức.

SimpleEnvironment), module self_correct sẽ ghi nhận điều này, phân tích rằng hành động "move_forward" tại vị trí cụ thể đó là sai lầm, và cập nhật chính sách để tránh hành động đó trong tương lai, hoặc tìm kiếm một hành động thay thế như "move_sideways" nếu có.

Một số kỹ thuật phổ biến để hiện thực hóa khả năng học tập và tự sửa lỗi bao gồm:

- Học tăng cường (Reinforcement Learning - RL): Agent học cách tối ưu hóa hành vi thông qua việc tương tác với môi trường và nhận phần thưởng/hình phạt. Đây là nền tảng lý tưởng cho các AI agent thích nghi.

- Học Meta (Meta-Learning): Agent học cách học, tức là nó học để nhanh chóng thích nghi với các nhiệm vụ hoặc môi trường mới chỉ với một lượng nhỏ dữ liệu.

- Học không giám sát (Unsupervised Learning) và Bán giám sát (Semi-supervised Learning): Giúp agent phát hiện các mẫu hoặc dị thường trong dữ liệu mà không cần nhãn rõ ràng, hỗ trợ việc phát hiện lỗi.

- Hệ thống dựa trên Quy tắc (Rule-based Systems) với Khả năng Cập nhật: Agent có một tập hợp các quy tắc, và khi một lỗi xảy ra, các quy tắc này có thể được sửa đổi hoặc thêm mới một cách tự động.

Một ví dụ thực tế khác có thể là một AI agent quản lý hệ thống máy chủ. Khi phát hiện một dịch vụ bị lỗi (ví dụ: status_code = 500), agent sẽ không chỉ khởi động lại dịch vụ mà còn phân tích log, kiểm tra tài nguyên hệ thống, và nếu lỗi tái diễn, nó có thể tự động điều chỉnh cấu hình, tăng dung lượng tài nguyên, hoặc thậm chí triển khai phiên bản phần mềm dự phòng. Dữ liệu từ các sự cố này sẽ được dùng để huấn luyện mô hình dự đoán lỗi, giảm 25% thời gian downtime trung bình trong vòng 3 tháng.

Tips & Best Practices Khi Xây Dựng AI Agent Thích Nghi

Để xây dựng AI agent thích nghi hiệu quả, cần tuân thủ một số nguyên tắc và thực tiễn tốt nhất. Điều này không chỉ giúp agent hoạt động ổn định mà còn đảm bảo khả năng học hỏi và tự sửa lỗi được tối ưu.

- Thiết kế môi trường tương tác rõ ràng: Môi trường cần cung cấp phản hồi rõ ràng (reward/penalty) và trạng thái (state) đầy đủ để agent có thể học. Một môi trường được định nghĩa tốt là chìa khóa cho việc học tăng cường thành công. Đảm bảo các API của môi trường ổn định và nhất quán.

- Ưu tiên khả năng giải thích (Explainability/Interpretability): Đối với các hệ thống tự sửa lỗi, việc hiểu tại sao agent đưa ra một quyết định hoặc tại sao nó nhận diện một lỗi là rất quan trọng. Sử dụng các mô hình có khả năng giải thích cao hoặc tích hợp các kỹ thuật XAI (Explainable AI) để dễ dàng debug và tin cậy hơn.

- Quản lý bộ nhớ hiệu quả: Agent cần lưu trữ kinh nghiệm để học hỏi, nhưng bộ nhớ vô hạn là không thực tế. Triển khai các chiến lược quản lý bộ nhớ như Experience Replay Buffer trong RL, hoặc các cơ chế quên dần để chỉ giữ lại những kinh nghiệm quan trọng hoặc gần đây nhất.

- Kiểm thử liên tục và mô phỏng: Trước khi triển khai vào môi trường thực, hãy kiểm thử agent trong các môi trường mô phỏng (simulation) đa dạng và phức tạp. Mô phỏng giúp phát hiện lỗi, đánh giá khả năng thích nghi và tinh chỉnh các tham số mà không gây rủi ro. Các mô phỏng tiên tiến có thể tái tạo 90% các tình huống thực tế.

- Cơ chế giám sát và can thiệp của con người: Ngay cả AI agent thích nghi tiên tiến nhất cũng cần sự giám sát của con người, đặc biệt trong giai đoạn đầu. Thiết lập các ngưỡng an toàn, cơ chế báo động và khả năng can thiệp thủ công (human-in-the-loop) để kiểm soát agent khi nó đưa ra quyết định sai lầm nghiêm trọng.

- Xử lý dữ liệu không chắc chắn và nhiễu (Uncertainty & Noise): Môi trường thực tế luôn có nhiễu và thông tin không chắc chắn. Agent cần được thiết kế để chịu đựng và học hỏi từ dữ liệu không hoàn hảo. Các kỹ thuật như Bayesian Learning hay Robust Control có thể hữu ích.

- Cập nhật mô hình định kỳ: Ngay cả khi agent có khả năng học liên tục, việc định kỳ cập nhật các mô hình cơ sở hoặc tái huấn luyện trên tập dữ liệu lớn hơn có thể giúp duy trì hiệu suất cao và thích nghi với các thay đổi lớn trong môi trường.

So Sánh AI Agent Thích Nghi Với AI Truyền Thống

AI agent thích nghi vượt trội hơn AI truyền thống ở khả năng đối phó với môi trường động và không xác định, trong khi AI truyền thống thường phù hợp hơn cho các tác vụ có quy tắc cố định. Sự khác biệt cốt lõi nằm ở khả năng học hỏi và tự điều chỉnh sau khi triển khai.

AI truyền thống (ví dụ: các hệ thống dựa trên quy tắc, mô hình học máy được huấn luyện một lần) thường được xây dựng dựa trên một tập dữ liệu cố định và một bộ quy tắc được lập trình sẵn. Khi môi trường thay đổi hoặc xuất hiện dữ liệu mới nằm ngoài phạm vi huấn luyện ban đầu, hiệu suất của chúng sẽ suy giảm nhanh chóng. Chúng không có khả năng tự sửa lỗi mà cần sự can thiệp thủ công để cập nhật hoặc tái huấn luyện. Ví dụ, một hệ thống phát hiện gian lận ngân hàng dựa trên các quy tắc cứng nhắc sẽ bỏ qua các phương thức gian lận mới cho đến khi được lập trình viên cập nhật. Chi phí bảo trì cho các hệ thống này có thể lên tới 60% tổng chi phí vòng đời.

Ngược lại, AI agent thích nghi được thiết kế để liên tục học hỏi và điều chỉnh. Chúng có thể nhận diện các mẫu mới, phát hiện dị thường và tự động cải thiện chiến lược của mình. Ví dụ, một AI agent quản lý năng lượng trong tòa nhà có thể học được các mẫu sử dụng năng lượng mới của cư dân, tự động điều chỉnh hệ thống HVAC để tối ưu hóa hiệu suất và tiết kiệm năng lượng lên đến 15% theo thời gian, mà không cần lập trình lại. Khả năng tự sửa lỗi của chúng cho phép hệ thống tự phục hồi sau các sự cố nhỏ, tăng tính ổn định và giảm thiểu thời gian downtime. Theo một báo cáo, các AI agent thích nghi có thể giảm 20-30% chi phí vận hành so với các hệ thống truyền thống trong các môi trường phức tạp.

Tuy nhiên, AI agent thích nghi cũng có những thách thức riêng. Chúng thường phức tạp hơn để thiết kế và triển khai, đòi hỏi môi trường thử nghiệm và giám sát chặt chẽ hơn. Khả năng giải thích (explainability) có thể là một vấn đề vì hành vi của chúng có thể thay đổi theo thời gian. Trong khi đó, AI truyền thống thường dễ hiểu và dễ kiểm soát hơn. Do đó, lựa chọn giữa hai loại này phụ thuộc vào tính chất của bài toán: nếu môi trường ổn định và quy tắc rõ ràng, AI truyền thống có thể là đủ; nhưng nếu bạn cần một hệ thống linh hoạt, tự động cải thiện và đối phó với sự thay đổi, AI agent thích nghi là lựa chọn tối ưu.

Các Lưu Ý Quan Trọng

- Đảm bảo tính an toàn và đạo đức: Khi AI agent tự sửa lỗi và thích nghi, cần có các cơ chế để đảm bảo rằng các hành động điều chỉnh không dẫn đến kết quả không an toàn hoặc vi phạm các nguyên tắc đạo đức. Điều này có thể bao gồm việc giới hạn phạm vi tự sửa lỗi hoặc yêu cầu sự chấp thuận của con người cho các thay đổi lớn.

- Hiệu suất tính toán: Học tập và tự sửa lỗi liên tục có thể đòi hỏi tài nguyên tính toán đáng kể. Cần tối ưu hóa thuật toán và kiến trúc để đảm bảo agent có thể hoạt động hiệu quả trong thời gian thực, đặc biệt trong các ứng dụng yêu cầu độ trễ thấp.

- Vấn đề "Concept Drift": Môi trường có thể thay đổi đến mức các mô hình đã học trở nên lỗi thời (concept drift). AI agent cần có cơ chế phát hiện concept drift và thích nghi kịp thời, có thể bằng cách định kỳ tái huấn luyện hoặc ưu tiên dữ liệu mới hơn.

- Quản lý sự phức tạp: Khi agent học và tự sửa lỗi, hệ thống có thể trở nên phức tạp hơn. Việc theo dõi, debug và duy trì agent có thể là một thách thức. Sử dụng các công cụ giám sát và logging tiên tiến là cần thiết.

- Lựa chọn thuật toán học phù hợp: Có nhiều thuật toán học máy khác nhau, và việc lựa chọn thuật toán phù hợp nhất cho khả năng thích nghi và tự sửa lỗi của agent là rất quan trọng. Ví dụ, Reinforcement Learning rất phù hợp cho các tác vụ ra quyết định tuần tự, trong khi các mạng nơ-ron hồi quy (RNNs) có thể tốt cho việc xử lý dữ liệu chuỗi thời gian.

- Đánh giá hiệu quả thích nghi: Không chỉ đánh giá hiệu suất cuối cùng, mà còn đánh giá khả năng thích nghi của agent. Agent có học nhanh hơn theo thời gian không? Nó có thể phục hồi sau các lỗi không? Các chỉ số như "learning curve", "recovery rate" nên được theo dõi.

- Bảo mật dữ liệu và mô hình: Dữ liệu mà agent học được có thể chứa thông tin nhạy cảm. Cần đảm bảo các biện pháp bảo mật dữ liệu mạnh mẽ và bảo vệ mô hình khỏi các cuộc tấn công Adversarial Attack, có thể làm sai lệch quá trình học và sửa lỗi của agent.

Câu Hỏi Thường Gặp

AI agent thích nghi có thể tự động viết code để sửa lỗi không?

Có, trong một số trường hợp và với sự hỗ trợ của các mô hình ngôn ngữ lớn (LLMs), AI agent thích nghi có thể tự động đề xuất hoặc thậm chí tạo ra các đoạn code để sửa lỗi. Ví dụ, một agent có thể phân tích một lỗi trong ứng dụng, xác định nguyên nhân, và sử dụng LLM để sinh ra một bản vá code. Tuy nhiên, việc triển khai code tự động sinh ra này thường yêu cầu kiểm tra và xác nhận nghiêm ngặt từ con người để đảm bảo tính an toàn và chính xác, đặc biệt trong các hệ thống quan trọng. Các nghiên cứu hiện tại cho thấy AI có thể tự sửa 50-70% lỗi cú pháp và logic đơn giản.

Làm thế nào để đo lường khả năng thích nghi của một AI agent?

Khả năng thích nghi của một AI agent có thể được đo lường thông qua nhiều chỉ số. Một số chỉ số phổ biến bao gồm: tốc độ học tập (thời gian cần thiết để agent đạt được một mức hiệu suất nhất định trong môi trường mới), khả năng phục hồi (tần suất và tốc độ agent có thể phục hồi sau khi gặp lỗi hoặc điều kiện bất lợi), hiệu suất trong môi trường động (so sánh hiệu suất của agent trong các môi trường thay đổi so với môi trường tĩnh), và khả năng khái quát hóa (agent có thể áp dụng kiến thức học được sang các nhiệm vụ hoặc biến thể mới của môi trường hay không). Theo dõi các đường cong học tập và các chỉ số hiệu suất trong các kịch bản thay đổi là rất quan trọng.

AI agent thích nghi có ứng dụng trong lĩnh vực kinh doanh nào?

AI agent thích nghi có rất nhiều ứng dụng trong kinh doanh. Ví dụ, trong quản lý chuỗi cung ứng, chúng có thể tự động điều chỉnh lịch trình sản xuất và vận chuyển dựa trên biến động nhu cầu và nguồn cung. Trong dịch vụ khách hàng, chatbot và trợ lý ảo thích nghi có thể học hỏi từ các tương tác để cải thiện khả năng trả lời và giải quyết vấn đề. Trong tài chính, chúng có thể thích nghi với thị trường biến động để tối ưu hóa chiến lược giao dịch hoặc phát hiện gian lận. Trong sản xuất, robot thích nghi có thể điều chỉnh quy trình sản xuất để tối ưu hóa chất lượng sản phẩm và giảm thiểu lãng phí. Một báo cáo của Deloitte chỉ ra rằng các doanh nghiệp áp dụng AI thích nghi có thể tăng trưởng doanh thu thêm 10-15%.

Kết Luận

AI agent "Vibe" học tập và tự sửa lỗi không chỉ là một công nghệ tiên tiến mà còn là một xu hướng tất yếu trong tương lai của tự động hóa thông minh. Với khả năng thích nghi liên tục, học hỏi từ kinh nghiệm và tự động khắc phục sự cố, chúng mang lại tiềm năng to lớn để cải thiện hiệu suất, giảm chi phí vận hành và mở rộng phạm vi ứng dụng của AI. Việc xây dựng những agent này đòi hỏi sự hiểu biết sâu sắc về kiến trúc, thuật toán học máy và các thực tiễn tốt nhất.

Chúng ta đã đi qua các khái niệm cơ bản, kiến trúc thực hành, và những lời khuyên quan trọng để triển khai thành công AI agent thích nghi. Hy vọng rằng bài viết này đã cung cấp cho bạn cái nhìn toàn diện và cảm hứng để bắt đầu hành trình xây dựng các hệ thống tự động hóa thông minh hơn. Hãy cùng vibe coding khám phá và áp dụng những công nghệ đột phá này để tạo ra những giải pháp vượt trội.