Giới Thiệu AI Coding Đạo Đức

Trong kỷ nguyên mà Trí tuệ Nhân tạo (AI) đang định hình lại mọi lĩnh vực, từ y tế đến tài chính, từ giáo dục đến giải trí, vai trò của những người tạo ra nó – các lập trình viên – trở nên quan trọng hơn bao giờ hết. Chúng ta không chỉ đơn thuần viết code, mà còn đang xây dựng nên tương lai. Điều này đặt ra một thách thức lớn nhưng cũng đầy thú vị: làm thế nào để đảm bảo những hệ thống AI mà chúng ta phát triển không chỉ mạnh mẽ, hiệu quả mà còn công bằng, minh bạch và có trách nhiệm? Bài viết này sẽ đi sâu vào khái niệm AI coding đạo đức, khám phá trách nhiệm của lập trình viên trong kỷ nguyên trí tuệ nhân tạo, và cung cấp những góc nhìn thực tế để chúng ta cùng nhau xây dựng một tương lai AI tốt đẹp hơn.

AI không còn là viễn cảnh khoa học viễn tưởng mà đã trở thành một phần không thể thiếu trong cuộc sống hàng ngày. Từ các thuật toán đề xuất nội dung trên mạng xã hội, công cụ tìm kiếm, đến hệ thống chẩn đoán y tế, xe tự lái, AI đang tác động sâu rộng đến xã hội. Tuy nhiên, cùng với những lợi ích to lớn, AI cũng mang theo những rủi ro tiềm ẩn như thiên vị thuật toán, vi phạm quyền riêng tư, mất việc làm, và thậm chí là các quyết định thiếu công bằng ảnh hưởng đến cuộc sống con người. Chính vì vậy, việc hiểu và thực hành AI coding đạo đức là một yêu cầu cấp thiết đối với mỗi lập trình viên.

AI Coding Đạo Đức Là Gì?

AI coding đạo đức (Ethical AI Coding) là tập hợp các nguyên tắc, thực hành và tư duy nhằm đảm bảo rằng quá trình thiết kế, phát triển, triển khai và vận hành các hệ thống AI được thực hiện một cách có trách nhiệm, công bằng, minh bạch, bảo mật và tôn trọng quyền con người. Nó không chỉ là về việc tránh gây hại, mà còn là về việc chủ động xây dựng AI để phục vụ lợi ích chung của xã hội.

Khái niệm này bao gồm nhiều khía cạnh, từ việc lựa chọn dữ liệu huấn luyện, thiết kế thuật toán, đến cách tương tác với người dùng và xử lý các lỗi tiềm ẩn. Một hệ thống AI được coi là "đạo đức" khi nó không tạo ra hoặc khuếch đại sự thiên vị, bảo vệ quyền riêng tư của người dùng, có thể giải thích được các quyết định của mình (explainability), và được xây dựng với sự minh bạch về mục đích và giới hạn.

Ví dụ, một hệ thống AI được dùng để tuyển dụng nhân sự nếu không được huấn luyện cẩn thận có thể vô tình học được và khuếch đại sự thiên vị giới tính hoặc chủng tộc từ dữ liệu lịch sử. Điều này dẫn đến các quyết định tuyển dụng không công bằng. AI coding đạo đức đòi hỏi chúng ta phải nhận diện và chủ động giải quyết những vấn đề như vậy ngay từ giai đoạn đầu của quá trình phát triển.

Trách Nhiệm Của Lập Trình Viên Trong Kỷ Nguyên AI

Lập trình viên không chỉ là những người viết code; họ là những kiến trúc sư của tương lai số. Trong kỷ nguyên AI, trách nhiệm của họ càng trở nên nặng nề hơn. Dưới đây là những trách nhiệm cốt lõi:

- Hiểu và Áp dụng Nguyên tắc Đạo đức: Lập trình viên cần phải hiểu rõ các nguyên tắc đạo đức cơ bản của AI, như công bằng (fairness), minh bạch (transparency), khả năng giải thích (explainability), độ tin cậy (reliability), bảo mật (security) và quyền riêng tư (privacy). Việc này không chỉ dừng lại ở lý thuyết mà phải được đưa vào thực tiễn trong từng dòng code.

- Kiểm soát Dữ liệu Huấn luyện: Dữ liệu là "máu" của AI. Lập trình viên có trách nhiệm đảm bảo dữ liệu được sử dụng là sạch, đại diện, không thiên vị và được thu thập một cách hợp pháp, có sự đồng thuận. Việc kiểm tra và làm sạch dữ liệu để loại bỏ hoặc giảm thiểu sự thiên vị là một bước cực kỳ quan trọng.

- Thiết kế Thuật toán Có Trách nhiệm: Khi thiết kế thuật toán, cần cân nhắc đến các tác động tiềm ẩn đối với người dùng và xã hội. Điều này bao gồm việc xây dựng các mô hình có thể giải thích được, tránh "hộp đen" (black-box models) khi có thể, và tích hợp các cơ chế để phát hiện và giảm thiểu thiên vị.

- Kiểm thử và Đánh giá Liên tục: AI không phải là một sản phẩm tĩnh. Nó cần được kiểm thử liên tục để đảm bảo rằng nó hoạt động đúng như mong đợi trong các kịch bản khác nhau và không tạo ra các kết quả không mong muốn hoặc có hại. Đặc biệt, cần kiểm thử để phát hiện và đo lường sự thiên vị.

- Minh bạch và Giải thích: Khi một hệ thống AI đưa ra quyết định hoặc dự đoán, điều quan trọng là có thể giải thích được tại sao nó lại đưa ra quyết định đó. Lập trình viên nên cố gắng xây dựng các hệ thống AI có khả năng giải thích (interpretable AI) hoặc ít nhất là cung cấp các cơ chế để người dùng hiểu được logic đằng sau các kết quả.

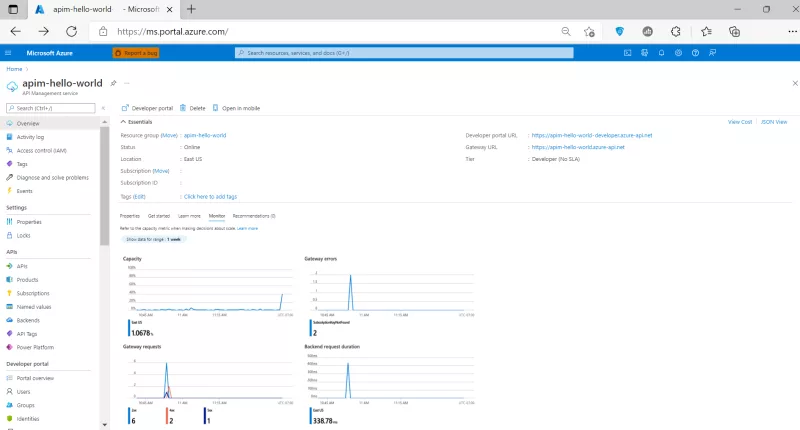

- Bảo vệ Quyền Riêng tư và An ninh: Dữ liệu nhạy cảm cần được bảo vệ nghiêm ngặt. Lập trình viên phải tuân thủ các quy định về bảo vệ dữ liệu như GDPR, CCPA, và áp dụng các kỹ thuật bảo mật tiên tiến như mã hóa, ẩn danh hóa dữ liệu (data anonymization) và học máy bảo mật (federated learning, homomorphic encryption).

- Hợp tác Liên ngành: AI coding đạo đức không chỉ là trách nhiệm của riêng lập trình viên. Nó đòi hỏi sự hợp tác với các chuyên gia đạo đức, luật sư, nhà khoa học xã hội và các bên liên quan khác để có cái nhìn đa chiều về các tác động của AI.

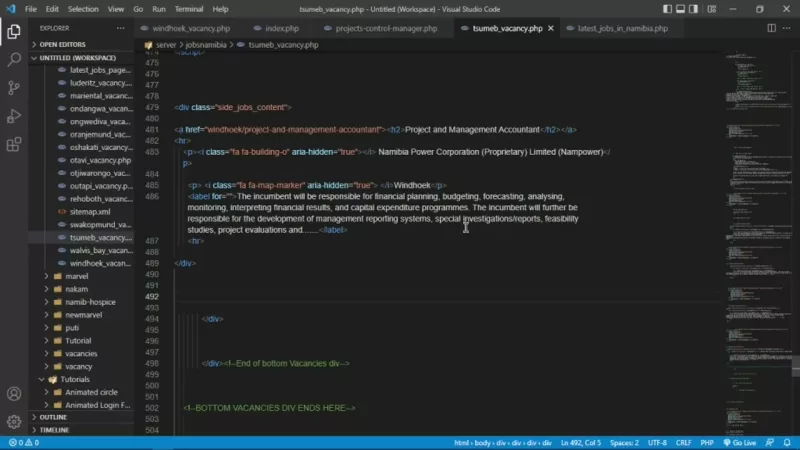

Thực Hành AI Coding Đạo Đức: Các Bước và Ví Dụ Code

Việc áp dụng AI coding đạo đức vào thực tế đòi hỏi một cách tiếp cận có hệ thống. Dưới đây là một số bước và ví dụ cụ thể:

1. Phát hiện và Giảm thiểu Thiên vị (Bias Detection and Mitigation)

Thiên vị có thể xuất hiện từ dữ liệu huấn luyện (historical bias, representation bias) hoặc từ chính thuật toán. Lập trình viên cần chủ động tìm kiếm và giảm thiểu nó.

Ví dụ: Giả sử bạn đang xây dựng một mô hình phân loại tín dụng. Nếu dữ liệu lịch sử cho thấy tỷ lệ phê duyệt thấp hơn đối với một nhóm dân số cụ thể, mô hình có thể học được sự thiên vị này. Bạn có thể sử dụng các thư viện như AIF360 của IBM để phân tích và giảm thiểu thiên vị.

from aif360.datasets import BinaryLabelDataset

from aif360.metrics import BinaryLabelDatasetMetric

from aif360.algorithms.preprocessing import Reweighing

import pandas as pd

# Giả định dataset của bạn đã được tải vào DataFrame

# và có các cột 'age', 'gender', 'credit_score', 'loan_approved'

df = pd.read_csv('credit_data.csv')

# Định nghĩa các thuộc tính nhạy cảm (sensitive attributes)

# và thuộc tính đầu ra (label)

privileged_groups = [{'gender': 1}] # Ví dụ: gender=1 là nhóm ưu tiên

unprivileged_groups = [{'gender': 0}] # Ví dụ: gender=0 là nhóm không ưu tiên

label_names = ['loan_approved']

protected_attribute_names = ['gender']

# Chuyển đổi DataFrame sang định dạng BinaryLabelDataset của AIF360

dataset_orig = BinaryLabelDataset(

df=df,

label_names=label_names,

protected_attribute_names=protected_attribute_names

)

# Đánh giá thiên vị trước khi tiền xử lý

metric_orig = BinaryLabelDatasetMetric(

dataset_orig,

unprivileged_groups=unprivileged_groups,

privileged_groups=privileged_groups

)

print(f"Disparate Impact (original): {metric_orig.disparate_impact()}")

# Áp dụng thuật toán Reweighing để giảm thiểu thiên vị

RW = Reweighing(unprivileged_groups=unprivileged_groups,

privileged_groups=privileged_groups)

dataset_transf = RW.fit_transform(dataset_orig)

# Đánh giá thiên vị sau khi tiền xử lý

metric_transf = BinaryLabelDatasetMetric(

dataset_transf,

unprivileged_groups=unprivileged_groups,

privileged_groups=privileged_groups

)

print(f"Disparate Impact (transformed): {metric_transf.disparate_impact()}")

Đoạn code trên minh họa cách sử dụng AIF360 để đo lường Disparate Impact (một metric phổ biến để đánh giá sự công bằng) và sau đó áp dụng kỹ thuật Reweighing để điều chỉnh trọng số của các mẫu dữ liệu, nhằm giảm thiểu sự thiên vị liên quan đến thuộc tính gender.

2. Minh bạch và Khả năng Giải thích (Transparency and Explainability - XAI)

Khi mô hình AI đưa ra quyết định, chúng ta cần hiểu lý do tại sao. Điều này đặc biệt quan trọng trong các lĩnh vực nhạy cảm như y tế hoặc tài chính.

Ví dụ: Sử dụng thư viện LIME (Local Interpretable Model-agnostic Explanations) hoặc SHAP (SHapley Additive exPlanations) để giải thích dự đoán của mô hình.

import lime

import lime.lime_tabular

import numpy as np

from sklearn.ensemble import RandomForestClassifier

from sklearn.model_selection import train_test_split

import pandas as pd

# Giả định bạn đã có dữ liệu và huấn luyện một mô hình RandomForest

# X_train, X_test, y_train, y_test = ...

# model = RandomForestClassifier().fit(X_train, y_train)

# Tạo dữ liệu giả định

np.random.seed(42)

X = pd.DataFrame(np.random.rand(100, 5), columns=[f'feature_{i}' for i in range(5)])

y = np.random.randint(0, 2, 100)

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

model = RandomForestClassifier(random_state=42)

model.fit(X_train.values, y_train)

# Khởi tạo LIME Explainer

explainer = lime.lime_tabular.LimeTabularExplainer(

training_data=X_train.values,

feature_names=X_train.columns.tolist(),

class_names=['Class 0', 'Class 1'],

mode='classification'

)

# Giải thích một dự đoán cụ thể (ví dụ: dự đoán cho mẫu đầu tiên trong tập test)

i = 0

explanation = explainer.explain_instance(

data_row=X_test.iloc[i].values,

predict_fn=model.predict_proba,

num_features=5

)

print(f"Explanation for instance {i}:")

for feature, weight in explanation.as_list():

print(f" {feature}: {weight:.4f}")

# explanation.show_in_notebook(show_table=True, show_all=False) # Nếu chạy trong Jupyter Notebook

Đoạn code này sử dụng LIME để giải thích tại sao mô hình RandomForestClassifier đưa ra dự đoán cụ thể cho một mẫu dữ liệu. Nó cho thấy những đặc trưng nào đóng góp nhiều nhất vào quyết định của mô hình, giúp lập trình viên và người dùng hiểu rõ hơn về hoạt động bên trong của "hộp đen".

3. Bảo vệ Quyền Riêng tư (Privacy Preservation)

Xử lý dữ liệu nhạy cảm đòi hỏi các biện pháp bảo vệ quyền riêng tư.

Ví dụ: Sử dụng kỹ thuật ẩn danh hóa dữ liệu hoặc học máy bảo mật như Federated Learning, nơi các mô hình được huấn luyện cục bộ trên thiết bị của người dùng và chỉ gửi các cập nhật mô hình đã tổng hợp về máy chủ trung tâm.

# Ví dụ về một hàm ẩn danh hóa dữ liệu đơn giản (không phải giải pháp toàn diện)

def anonymize_data(dataframe, columns_to_anonymize):

"""

Ẩn danh hóa các cột được chỉ định bằng cách thay thế bằng giá trị hash.

Không đảm bảo ẩn danh hoàn toàn, chỉ mang tính minh họa.

"""

import hashlib

df_copy = dataframe.copy()

for col in columns_to_anonymize:

if col in df_copy.columns:

# Hash giá trị để ẩn danh

df_copy[col] = df_copy[col].apply(lambda x: hashlib.sha256(str(x).encode()).hexdigest())

return df_copy

# Giả định df_users chứa thông tin người dùng nhạy cảm

# df_users = pd.DataFrame({'user_id': [1, 2, 3], 'email': ['[email protected]', '[email protected]', '[email protected]'], 'name': ['Alice', 'Bob', 'Charlie']})

# df_anonymized = anonymize_data(df_users, ['email', 'name'])

# print(df_anonymized)

Mặc dù ví dụ trên là một cách ẩn danh hóa rất cơ bản và không đầy đủ, nó minh họa ý tưởng về việc xử lý dữ liệu nhạy cảm. Trong thực tế, các kỹ thuật như Differential Privacy hoặc Homomorphic Encryption sẽ được sử dụng để đạt được mức độ bảo vệ quyền riêng tư cao hơn.

Tips và Best Practices cho AI Coding Đạo Đức

- Suy nghĩ từ góc độ người dùng: Luôn đặt mình vào vị trí của người dùng cuối, đặc biệt là những nhóm có thể bị ảnh hưởng tiêu cực. Hệ thống AI của bạn sẽ tác động đến họ như thế nào?

- Sử dụng dữ liệu đa dạng và đại diện: Đầu tư thời gian và nguồn lực vào việc thu thập, làm sạch và cân bằng dữ liệu huấn luyện. Tránh sử dụng các tập dữ liệu có sẵn mà không kiểm tra kỹ lưỡng về sự thiên vị.

- Thiết kế "Human-in-the-Loop": Trong nhiều trường hợp, đặc biệt là các quyết định quan trọng, nên có sự can thiệp của con người. AI có thể đưa ra đề xuất, nhưng con người sẽ đưa ra quyết định cuối cùng.

- Tài liệu hóa mọi thứ: Ghi lại cẩn thận quá trình thu thập dữ liệu, lựa chọn mô hình, các giả định đã đưa ra, và các bước giảm thiểu thiên vị. Điều này giúp tăng cường minh bạch và trách nhiệm.

- Sử dụng các công cụ và thư viện chuyên dụng: Tận dụng các framework và thư viện như

AIF360,Fairlearn,What-If Tool,LIME,SHAPđể hỗ trợ việc phân tích và giảm thiểu các vấn đề đạo đức. - Kiểm thử định kỳ và cập nhật: Các mô hình AI có thể "drift" theo thời gian khi dữ liệu thực tế thay đổi. Cần có cơ chế giám sát và kiểm thử định kỳ để đảm bảo mô hình vẫn hoạt động công bằng và chính xác.

- Tham gia cộng đồng và học hỏi: Theo dõi các nghiên cứu mới nhất về AI đạo đức, tham gia các diễn đàn và cộng đồng để học hỏi kinh nghiệm từ những người khác.

So Sánh Các Khía Cạnh Đạo Đức Trong AI và Lập Trình Truyền Thống

Mặc dù đạo đức luôn là một phần của lập trình, AI coding đạo đức đưa ra những thách thức mới và phức tạp hơn:

- Phạm vi Tác động: Trong lập trình truyền thống, lỗi code thường có tác động cục bộ hoặc có thể dự đoán được. Với AI, lỗi hoặc sự thiên vị có thể khuếch đại và tác động đến hàng triệu người một cách khó lường, thậm chí gây ra hậu quả xã hội nghiêm trọng (ví dụ: hệ thống nhận diện khuôn mặt thiên vị, mô hình dự đoán tội phạm không công bằng).

- Tính "Hộp đen": Các hệ thống AI phức tạp, đặc biệt là các mạng nơ-ron sâu, thường hoạt động như "hộp đen", khiến việc giải thích lý do đằng sau các quyết định trở nên khó khăn. Điều này khác với lập trình truyền thống, nơi logic thường rõ ràng và có thể kiểm tra từng bước. AI coding đạo đức tập trung vào việc làm cho các hệ thống này minh bạch hơn.

- Sự Tiến hóa của Mô hình: Phần mềm truyền thống thường tuân theo một logic cố định. AI học hỏi và thích nghi, có nghĩa là hành vi của nó có thể thay đổi theo thời gian dựa trên dữ liệu mới. Điều này đòi hỏi một cách tiếp cận đạo đức liên tục, không chỉ tại thời điểm triển khai.

- Sự Thiên vị Tiềm ẩn: Dữ liệu huấn luyện có thể chứa đựng sự thiên vị từ xã hội hoặc lịch sử, và AI có thể học và khuếch đại những thiên vị này. Lập trình truyền thống ít gặp phải vấn đề này trừ khi người lập trình cố tình mã hóa sự thiên vị. AI coding đạo đức đòi hỏi sự nhạy bén đặc biệt với các nguồn thiên vị tiềm ẩn.

- Khả năng Tự quyết định: Khi AI trở nên tự trị hơn (ví dụ: xe tự lái, robot chiến đấu), nó có thể đưa ra các quyết định có hậu quả đạo đức mà không có sự can thiệp trực tiếp của con người. Điều này đặt ra câu hỏi về trách nhiệm pháp lý và đạo đức, một lĩnh vực mới mà lập trình truyền thống không phải đối mặt.

Tóm lại, trong khi cả hai đều yêu cầu sự cẩn trọng và trách nhiệm, AI coding đạo đức đòi hỏi một cấp độ tư duy phức tạp hơn về tác động xã hội, sự công bằng, minh bạch và khả năng giải thích, vượt xa những cân nhắc kỹ thuật thông thường.

Các Lưu Ý Quan Trọng

- Đạo đức không phải là một tính năng phụ: Đạo đức phải được tích hợp vào mọi giai đoạn của vòng đời phát triển AI, từ ý tưởng ban đầu đến triển khai và bảo trì, chứ không phải là một thứ được thêm vào sau cùng.

- Sự phức tạp của định nghĩa "công bằng": "Công bằng" có nhiều định nghĩa khác nhau (ví dụ: equal opportunity, equal outcome, demographic parity). Lập trình viên cần hiểu rõ các định nghĩa này và chọn phương pháp phù hợp nhất với ngữ cảnh cụ thể của ứng dụng AI, thường là thông qua đối thoại với các chuyên gia đạo đức và luật pháp.

- Trách nhiệm tập thể: AI coding đạo đức không chỉ là trách nhiệm cá nhân của lập trình viên mà còn là trách nhiệm của toàn bộ tổ chức, từ lãnh đạo đến các nhóm phát triển. Cần có chính sách, quy trình và văn hóa hỗ trợ việc thực hành đạo đức.

- Giáo dục và Đào tạo liên tục: Lĩnh vực AI phát triển nhanh chóng, và các thách thức đạo đức cũng vậy. Lập trình viên cần không ngừng học hỏi và cập nhật kiến thức về các nguyên tắc, công cụ và kỹ thuật mới nhất trong AI đạo đức.

- Cân bằng giữa hiệu suất và đạo đức: Đôi khi, việc áp dụng các biện pháp đạo đức có thể ảnh hưởng đến hiệu suất của mô hình (ví dụ: mô hình giải thích được có thể kém chính xác hơn mô hình hộp đen). Lập trình viên cần tìm ra sự cân bằng hợp lý, thường là thông qua các cuộc thảo luận đa ngành.

- Quyền được giải thích và quyền được từ chối: Người dùng cần có quyền được biết khi họ đang tương tác với AI và tại sao AI đưa ra các quyết định cụ thể. Trong một số trường hợp, họ cũng nên có quyền từ chối sự can thiệp của AI.

- Luôn hỏi "Tại sao?": Trước khi phát triển bất kỳ hệ thống AI nào, hãy tự hỏi: "Tại sao chúng ta làm điều này? Ai sẽ được hưởng lợi? Ai có thể bị ảnh hưởng tiêu cực? Có cách nào khác tốt hơn không?"

Câu Hỏi Thường Gặp

AI coding đạo đức có làm chậm quá trình phát triển không?

Ban đầu, việc tích hợp các nguyên tắc đạo đức có thể đòi hỏi thêm thời gian và công sức cho việc phân tích dữ liệu, kiểm thử thiên vị và thiết kế khả năng giải thích. Tuy nhiên, về lâu dài, nó giúp tránh được các rủi ro pháp lý, xã hội và danh tiếng, từ đó tiết kiệm chi phí và xây dựng lòng tin của người dùng, làm cho quá trình phát triển trở nên bền vững hơn.

Làm thế nào để đo lường "đạo đức" của một hệ thống AI?

Không có một thước đo "đạo đức" duy nhất. Thay vào đó, chúng ta đo lường các khía cạnh cụ thể như công bằng (sử dụng các metric như Disparate Impact, Equal Opportunity Difference), minh bạch (thông qua các công cụ XAI như LIME, SHAP), và bảo mật (đánh giá mức độ tuân thủ các quy định về quyền riêng tư và các tiêu chuẩn bảo mật). Việc này đòi hỏi sự kết hợp giữa các metric kỹ thuật và đánh giá định tính.

Nếu công ty không có chính sách về AI đạo đức, lập trình viên nên làm gì?

Lập trình viên có trách nhiệm đạo đức cá nhân. Bạn nên chủ động tìm hiểu các nguyên tắc đạo đức AI, áp dụng chúng trong phạm vi ảnh hưởng của mình, và nâng cao nhận thức trong nhóm hoặc tổ chức. Bắt đầu với các biện pháp nhỏ như kiểm tra thiên vị dữ liệu, sử dụng các thư viện XAI, và đề xuất các cuộc thảo luận về đạo đức AI trong nội bộ. Việc này có thể khởi xướng một sự thay đổi văn hóa.

Sự khác biệt giữa AI đạo đức và AI có trách nhiệm (Responsible AI) là gì?

Hai thuật ngữ này thường được sử dụng thay thế cho nhau. Tuy nhiên, "AI đạo đức" thường tập trung vào các nguyên tắc triết học và giá trị cốt lõi (công bằng, minh bạch, quyền riêng tư), trong khi "AI có trách nhiệm" là một thuật ngữ rộng hơn, bao gồm cả các khía cạnh thực tiễn của việc triển khai AI đạo đức, như quản trị, quy trình, chính sách và sự tuân thủ pháp luật. AI đạo đức là nền tảng tư duy, còn AI có trách nhiệm là khung hành động.

Kết Luận

AI coding đạo đức không phải là một lựa chọn mà là một yêu cầu bắt buộc đối với mọi lập trình viên trong kỷ nguyên trí tuệ nhân tạo. Với sức mạnh to lớn của AI, đi kèm là trách nhiệm nặng nề trong việc đảm bảo những hệ thống chúng ta xây dựng không chỉ thông minh mà còn công bằng, minh bạch và phục vụ lợi ích chung của nhân loại. Từ việc lựa chọn dữ liệu, thiết kế thuật toán, đến kiểm thử và triển khai, mỗi bước đều cần được thực hiện với sự cẩn trọng và ý thức đạo đức cao.

Bằng cách nắm vững các nguyên tắc, áp dụng các công cụ và thực hành tốt nhất, lập trình viên có thể chủ động định hình một tương lai AI có trách nhiệm, nơi công nghệ thực sự nâng cao chất lượng cuộc sống mà không gây ra những hậu quả tiêu cực không lường trước. Hãy cùng nhau xây dựng những sản phẩm AI không chỉ đổi mới mà còn mang lại giá trị đạo đức bền vững. Ghé thăm vibe coding để khám phá thêm nhiều nội dung chuyên sâu về lập trình và AI.