Giới Thiệu: Beyond Copilot - Tăng Tốc Phát Triển Với Trợ Lý AI Mã Nguồn Mở Tùy Biến Cho Vibe Dev

Phát triển phần mềm hiện đại đang chứng kiến sự bùng nổ của các công cụ hỗ trợ lập trình bằng trí tuệ nhân tạo, và trong bối cảnh đó, bài viết về AI coding mã nguồn mở này sẽ giúp bạn khám phá một hướng đi mạnh mẽ hơn cả các giải pháp thương mại phổ biến như GitHub Copilot. Chúng ta sẽ tìm hiểu cách các trợ lý AI mã nguồn mở không chỉ cung cấp các chức năng tương tự mà còn mở ra cánh cửa tùy biến vô hạn, cho phép developer tinh chỉnh AI để phù hợp hoàn hảo với quy trình làm việc, kho mã nguồn (codebase) nội bộ và các yêu cầu dự án đặc thù. Điều này không chỉ hứa hẹn tăng tốc độ phát triển mà còn nâng cao chất lượng code và giảm thiểu sự phụ thuộc vào các vendor độc quyền.

Sức Mạnh Của AI Coding Mã Nguồn Mở: Định Nghĩa và Lợi Ích

AI coding mã nguồn mở là các công cụ và mô hình trí tuệ nhân tạo được phát triển công khai, cho phép developer truy cập, chỉnh sửa, phân phối và sử dụng mã nguồn của chúng để tạo ra code, đề xuất giải pháp, hoặc tự động hóa các tác vụ lập trình. Lợi ích cốt lõi của việc sử dụng các giải pháp mã nguồn mở này bao gồm khả năng tùy biến sâu rộng, quyền kiểm soát dữ liệu hoàn toàn, và tự do triển khai trên môi trường riêng.

Trong kỷ nguyên số hóa, tốc độ là yếu tố then chốt. Các công cụ AI coding như GitHub Copilot đã chứng minh hiệu quả vượt trội trong việc tăng năng suất, với một số khảo sát cho thấy developer có thể hoàn thành tác vụ nhanh hơn tới 55%. Tuy nhiên, chúng thường đi kèm với những hạn chế về quyền riêng tư dữ liệu, chi phí và khả năng thích ứng với các codebase đặc thù. Các giải pháp AI coding mã nguồn mở ra đời để giải quyết những thách thức này. Chúng không chỉ cung cấp các chức năng tương tự mà còn cho phép các tổ chức và cá nhân developer tinh chỉnh (fine-tune) các mô hình AI trên dữ liệu code riêng của họ. Điều này dẫn đến các đề xuất code chất lượng cao hơn, phù hợp hơn với phong cách lập trình và kiến trúc của dự án. Ví dụ, một mô hình được fine-tune trên 10 năm lịch sử code của một công ty có thể đạt độ chính xác đến 90% trong việc dự đoán các API nội bộ, vượt xa khả năng của các mô hình chung.

Một lợi ích khác không thể bỏ qua là quyền kiểm soát dữ liệu. Với các công cụ thương mại, dữ liệu code của bạn có thể được sử dụng để huấn luyện mô hình chung, gây ra lo ngại về bảo mật và sở hữu trí tuệ. Ngược lại, khi bạn triển khai một mô hình AI coding mã nguồn mở trên máy chủ hoặc môi trường đám mây riêng, bạn hoàn toàn kiểm soát dữ liệu đầu vào và đầu ra. Điều này đặc biệt quan trọng đối với các ngành công nghiệp có quy định nghiêm ngặt về bảo mật như tài chính hay y tế. Hơn nữa, chi phí vận hành có thể được tối ưu hóa đáng kể. Mặc dù có chi phí ban đầu cho việc thiết lập và duy trì hạ tầng, về lâu dài, việc không phải trả phí thuê bao hàng tháng cho mỗi developer có thể giúp giảm tổng chi phí sở hữu (TCO) lên đến 30-50% cho các đội ngũ lớn.

Xây Dựng Trợ Lý AI Mã Nguồn Mở Của Riêng Bạn: Hướng Dẫn Thực Hành

Việc xây dựng một trợ lý AI mã nguồn mở tùy biến không còn là điều quá phức tạp, đặc biệt với sự phát triển của các framework và mô hình có sẵn. Quy trình này thường bao gồm việc chọn mô hình nền tảng, thu thập và chuẩn bị dữ liệu, fine-tune mô hình, và tích hợp vào môi trường phát triển.

1. Chọn Mô Hình Nền Tảng (Base Model)

Bước đầu tiên là lựa chọn một mô hình ngôn ngữ lớn (LLM) mã nguồn mở phù hợp cho tác vụ tạo code. Các lựa chọn phổ biến bao gồm Code Llama, StarCoder, hoặc các biến thể của PaLM/Gemma được tối ưu cho code. Ví dụ, Code Llama của Meta là một lựa chọn tuyệt vời với các phiên bản từ 7B đến 70B tham số, được huấn luyện trên hàng tỷ token code. Mô hình này có khả năng hiểu ngữ cảnh code rất tốt và có thể được triển khai trên GPU chuyên dụng hoặc dịch vụ đám mây.

# Ví dụ cài đặt thư viện transformers và tải mô hình Code Llama

from transformers import AutoTokenizer, AutoModelForCausalLM

import torch

model_name = "codellama/CodeLlama-7b-hf" # Hoặc "bigcode/starcoderbase-16b"

tokenizer = AutoTokenizer.from_pretrained(model_name)

model = AutoModelForCausalLM.from_pretrained(

model_name,

torch_dtype=torch.float16,

device_map="auto"

)2. Thu Thập và Chuẩn Bị Dữ Liệu

Để fine-tune mô hình hiệu quả, bạn cần một tập dữ liệu code chất lượng cao từ codebase nội bộ của mình. Điều này có thể bao gồm các repository Git, tài liệu kỹ thuật, và các đoạn code mẫu. Mục tiêu là tạo ra một tập dữ liệu đại diện cho phong cách lập trình, các thư viện, framework và quy ước đặt tên mà đội ngũ của bạn sử dụng. Định dạng dữ liệu thường là các cặp input/output, ví dụ: "mô tả chức năng" -> "code thực thi". Đảm bảo dữ liệu được làm sạch, loại bỏ các lỗi cú pháp và thông tin nhạy cảm. Một tập dữ liệu khoảng 100.000 đến 1.000.000 dòng code có thể mang lại kết quả đáng kể.

3. Fine-tuning Mô Hình

Fine-tuning là quá trình huấn luyện thêm mô hình nền tảng trên tập dữ liệu tùy chỉnh của bạn. Kỹ thuật như LoRA (Low-Rank Adaptation) hoặc QLoRA (Quantized LoRA) cho phép fine-tune các mô hình lớn với tài nguyên GPU hạn chế. Quá trình này giúp mô hình "học" được các mẫu và quy ước đặc thù của codebase của bạn, từ đó đưa ra các đề xuất chính xác hơn. Ví dụ, bạn có thể sử dụng thư viện peft của Hugging Face để fine-tune.

# Ví dụ fine-tuning với LoRA (sử dụng thư viện peft)

from peft import LoraConfig, get_peft_model, prepare_model_for_kbit_training

from trl import SFTTrainer

from datasets import load_dataset

# Chuẩn bị mô hình cho QLoRA

model = prepare_model_for_kbit_training(model)

# Cấu hình LoRA

lora_config = LoraConfig(

r=16,

lora_alpha=32,

target_modules=["q_proj", "v_proj"],

lora_dropout=0.05,

bias="none",

task_type="CAUSAL_LM"

)

model = get_peft_model(model, lora_config)

# Tải và chuẩn bị dataset

# dataset = load_dataset("json", data_files="your_code_dataset.jsonl")

# Sử dụng SFTTrainer để fine-tune

# trainer = SFTTrainer(

# model=model,

# train_dataset=dataset["train"],

# dataset_text_field="text",

# max_seq_length=1024,

# args=TrainingArguments(

# output_dir="./results",

# num_train_epochs=3,

# per_device_train_batch_size=4,

# gradient_accumulation_steps=1,

# optim="paged_adamw_8bit",

# save_steps=100,

# logging_steps=10,

# learning_rate=2e-4,

# fp16=True,

# tf32=True,

# max_grad_norm=0.3,

# warmup_ratio=0.03,

# group_by_length=True,

# lr_scheduler_type="constant",

# ),

# )

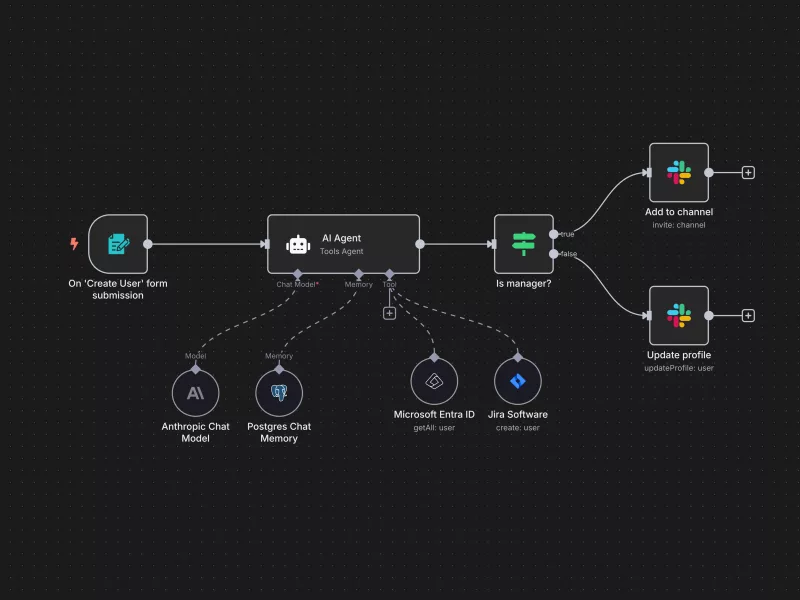

# trainer.train()4. Tích Hợp Vào Môi Trường Phát Triển

Sau khi fine-tune, mô hình cần được tích hợp vào IDE của developer. Điều này thường được thực hiện thông qua các plugin hoặc extension tùy chỉnh. Một số dự án mã nguồn mở như Tabby hoặc Fauxpilot cung cấp các máy chủ AI cục bộ có thể kết nối với các IDE phổ biến như VS Code hay JetBrains thông qua giao thức LSP (Language Server Protocol) hoặc các API tùy chỉnh. Bạn có thể triển khai mô hình của mình trên một máy chủ GPU nội bộ hoặc trên các dịch vụ đám mây như AWS SageMaker, Google Cloud Vertex AI, hoặc Azure Machine Learning để cung cấp API cho các IDE. Việc này giúp đảm bảo rằng code của bạn không bao giờ rời khỏi môi trường kiểm soát.

# Ví dụ đơn giản về cách expose mô hình qua API (Flask/FastAPI)

from flask import Flask, request, jsonify

app = Flask(__name__)

@app.route('/generate-code', methods=['POST'])

def generate_code_api():

data = request.json

prompt = data.get('prompt', '')

max_new_tokens = data.get('max_new_tokens', 100)

inputs = tokenizer(prompt, return_tensors="pt").to(model.device)

outputs = model.generate(

inputs.input_ids,

max_new_tokens=max_new_tokens,

num_return_sequences=1,

pad_token_id=tokenizer.eos_token_id

)

generated_text = tokenizer.decode(outputs[0], skip_special_tokens=True)

return jsonify({'generated_code': generated_text})

if __name__ == '__main__':

# Đảm bảo model và tokenizer đã được tải và fine-tune

app.run(host='0.0.0.0', port=5000)Bằng cách làm theo các bước này, một đội ngũ developer có thể tạo ra một trợ lý AI có khả năng đề xuất code chính xác và phù hợp với phong cách riêng của họ, giảm đáng kể thời gian viết code lặp lại và debug. Thống kê cho thấy, các trợ lý AI tùy biến có thể giảm 20-30% thời gian review code do tính nhất quán cao hơn.

Mẹo và Thực Tiễn Tốt Nhất Để Tối Ưu Hóa Trợ Lý AI Mã Nguồn Mở

Để tận dụng tối đa tiềm năng của trợ lý AI mã nguồn mở, việc áp dụng các mẹo và thực tiễn tốt nhất là vô cùng quan trọng. Điều này giúp đảm bảo hiệu suất cao, tính bảo mật và khả năng mở rộng của hệ thống.

- Quản lý Dữ Liệu Huấn Luyện Chất Lượng Cao: Chất lượng dữ liệu quyết định chất lượng mô hình. Hãy đảm bảo rằng tập dữ liệu huấn luyện của bạn sạch, nhất quán, và đại diện cho các trường hợp sử dụng thực tế. Loại bỏ code lỗi, comments không liên quan, và các đoạn code đã cũ. Cập nhật dữ liệu định kỳ (ví dụ, hàng quý) để mô hình luôn phản ánh các thay đổi trong codebase.

- Giám Sát và Đánh Giá Liên Tục: Triển khai các công cụ giám sát hiệu suất mô hình trong thực tế. Theo dõi các chỉ số như độ chính xác đề xuất, tỷ lệ chấp nhận (acceptance rate) của developer, và tốc độ phản hồi. Thu thập phản hồi từ người dùng để xác định các lĩnh vực cần cải thiện. Một chu trình phản hồi lặp đi lặp lại giúp nâng cao hiệu quả của trợ lý AI lên đến 15-20% theo thời gian.

- Tối Ưu Hóa Hiệu Suất Mô Hình: Đối với các mô hình lớn, việc tối ưu hóa hiệu suất là cần thiết. Sử dụng các kỹ thuật như quantization (lượng tử hóa), pruning (cắt tỉa), và distillation (chưng cất) để giảm kích thước và tăng tốc độ suy luận mà không ảnh hưởng quá nhiều đến độ chính xác. Ví dụ, việc lượng tử hóa mô hình 8-bit có thể giảm 75% yêu cầu về bộ nhớ GPU.

- Bảo Mật Dữ Liệu Nghiêm Ngặt: Khi làm việc với code nội bộ, bảo mật là ưu tiên hàng đầu. Đảm bảo rằng dữ liệu huấn luyện được lưu trữ an toàn, và mô hình được triển khai trong một môi trường kiểm soát chặt chẽ. Sử dụng mã hóa đầu cuối và kiểm soát truy cập dựa trên vai trò (RBAC) để bảo vệ thông tin nhạy cảm.

- Tích Hợp Liên Tục (CI/CD) cho AI: Áp dụng các nguyên tắc CI/CD cho quy trình phát triển và triển khai AI của bạn. Điều này bao gồm tự động hóa việc thu thập dữ liệu, huấn luyện lại mô hình, kiểm thử và triển khai. Điều này giúp đẩy nhanh chu kỳ cập nhật và đảm bảo rằng trợ lý AI luôn được cập nhật với các thay đổi mới nhất trong codebase.

- Khuyến Khích Cộng Tác và Chia Sẻ Kiến Thức: Xây dựng một cộng đồng nội bộ xung quanh trợ lý AI của bạn. Khuyến khích developer chia sẻ các prompt hiệu quả, các trường hợp sử dụng thành công, và các phản hồi. Điều này không chỉ giúp cải thiện mô hình mà còn thúc đẩy việc áp dụng công cụ trong toàn bộ đội ngũ.

So Sánh: Trợ Lý AI Mã Nguồn Mở vs. GitHub Copilot và Các Giải Pháp Thương Mại Khác

Việc lựa chọn giữa trợ lý AI mã nguồn mở và các giải pháp thương mại như GitHub Copilot phụ thuộc vào nhiều yếu tố, bao gồm nhu cầu tùy biến, quyền riêng tư dữ liệu, chi phí và khả năng kiểm soát. Mỗi loại hình đều có những ưu và nhược điểm riêng.

GitHub Copilot, được cung cấp bởi OpenAI Codex, là một công cụ mạnh mẽ và dễ sử dụng, cung cấp các đề xuất code chất lượng cao ngay lập tức. Ưu điểm chính của nó là sự tiện lợi, tích hợp sâu rộng với VS Code và JetBrains, và khả năng hoạt động tốt ngay lập tức mà không cần cấu hình phức tạp. Tuy nhiên, nó có một số nhược điểm đáng kể. Thứ nhất, dữ liệu code của bạn có thể được truyền đến các máy chủ của Microsoft/OpenAI, gây lo ngại về quyền riêng tư và sở hữu trí tuệ, đặc biệt đối với các công ty có mã nguồn độc quyền. Thứ hai, khả năng tùy biến của nó rất hạn chế; bạn không thể fine-tune mô hình trên codebase riêng của mình để nó hiểu rõ hơn về kiến trúc và quy ước nội bộ. Cuối cùng, chi phí thuê bao hàng tháng cho mỗi developer có thể tăng lên đáng kể đối với các đội ngũ lớn, với mức phí khoảng 10 USD/tháng/người, có thể lên tới hàng nghìn USD mỗi năm cho một công ty quy mô vừa.

Ngược lại, Trợ lý AI mã nguồn mở (như các giải pháp dựa trên Code Llama, StarCoder, hoặc Tabby) mang đến sự linh hoạt và kiểm soát tối đa. Ưu điểm nổi bật là khả năng fine-tune mô hình trên dữ liệu code riêng của bạn, dẫn đến các đề xuất chính xác hơn và phù hợp hơn với phong cách lập trình của đội ngũ. Điều này có thể tăng tỷ lệ chấp nhận đề xuất lên 20-30% so với các mô hình chung. Quyền riêng tư dữ liệu được đảm bảo hoàn toàn vì bạn có thể triển khai mô hình trên máy chủ nội bộ hoặc đám mây riêng, không có dữ liệu nào rời khỏi môi trường kiểm soát của bạn. Về chi phí, mặc dù có chi phí ban đầu cho hạ tầng và kỹ sư AI, tổng chi phí sở hữu về lâu dài có thể thấp hơn đáng kể cho các tổ chức lớn, đặc biệt khi không phải trả phí thuê bao liên tục. Tuy nhiên, nhược điểm là yêu cầu kiến thức kỹ thuật sâu hơn để thiết lập, duy trì và tối ưu hóa hệ thống. Quá trình này cần đội ngũ ML/DevOps có kinh nghiệm để quản lý hạ tầng GPU, fine-tuning mô hình và tích hợp vào IDE. Điều này có thể là một rào cản đối với các startup nhỏ hoặc các đội ngũ không có tài nguyên AI chuyên biệt.

Nếu bạn là một developer cá nhân hoặc một đội ngũ nhỏ ưu tiên sự tiện lợi và không quá lo ngại về quyền riêng tư dữ liệu, GitHub Copilot là một lựa chọn tuyệt vời. Nhưng nếu bạn là một doanh nghiệp lớn, có codebase độc quyền, yêu cầu bảo mật cao, và sẵn sàng đầu tư vào việc xây dựng và duy trì hạ tầng AI, thì việc phát triển một trợ lý AI coding mã nguồn mở tùy biến sẽ mang lại giá trị chiến lược và lợi thế cạnh tranh lâu dài hơn.

Các Lưu Ý Quan Trọng

- Yêu Cầu Hạ Tầng: Triển khai và fine-tune các mô hình LLM mã nguồn mở yêu cầu tài nguyên tính toán đáng kể, đặc biệt là GPU. Một mô hình 7B tham số có thể cần ít nhất 1 GPU với 24GB VRAM để chạy suy luận hiệu quả, và nhiều hơn nữa cho fine-tuning.

- Rủi Ro Về Giấy Phép (License): Khi sử dụng các mô hình và dataset mã nguồn mở, hãy luôn kiểm tra kỹ giấy phép (ví dụ: MIT, Apache 2.0, Llama 2 Community License). Đảm bảo rằng việc sử dụng của bạn tuân thủ các điều khoản, đặc biệt là khi fine-tune và triển khai cho mục đích thương mại.

- Vấn Đề Đạo Đức và Thiên Vị (Bias): Các mô hình AI có thể học được các thiên vị từ dữ liệu huấn luyện. Điều này có thể dẫn đến việc đề xuất code không công bằng, không an toàn hoặc không tối ưu. Cần có các biện pháp để kiểm tra và giảm thiểu các thiên vị này trong quá trình fine-tuning và đánh giá.

- Bảo Trì và Cập Nhật Liên Tục: Hệ thống AI không phải là "đặt và quên". Các mô hình cần được bảo trì, cập nhật và huấn luyện lại định kỳ để thích nghi với các thay đổi trong ngôn ngữ lập trình, framework mới và sự phát triển của codebase.

- Đào Tạo Người Dùng: Ngay cả với một trợ lý AI thông minh, developer vẫn cần được đào tạo về cách sử dụng hiệu quả. Điều này bao gồm cách viết prompt tốt, cách đánh giá và sửa đổi code do AI tạo ra, và cách tích hợp AI vào quy trình làm việc hiện có.

- Không Thay Thế Con Người: Trợ lý AI là công cụ hỗ trợ, không phải là sự thay thế cho developer. Kỹ năng tư duy phản biện, giải quyết vấn đề phức tạp và thiết kế kiến trúc vẫn là vai trò cốt lõi của con người.

Câu Hỏi Thường Gặp

Trợ lý AI mã nguồn mở có thực sự an toàn hơn Copilot không?

Có, trợ lý AI mã nguồn mở có thể an toàn hơn đáng kể so với Copilot về mặt quyền riêng tư dữ liệu. Khi bạn triển khai mô hình trên máy chủ nội bộ hoặc đám mây riêng, dữ liệu code của bạn không rời khỏi môi trường kiểm soát của tổ chức, giảm thiểu rủi ro về rò rỉ thông tin hoặc vi phạm sở hữu trí tuệ. Ngược lại, Copilot xử lý dữ liệu trên máy chủ của Microsoft, điều này có thể không đáp ứng các yêu cầu bảo mật nghiêm ngặt của một số doanh nghiệp.

Tôi có cần một đội ngũ AI chuyên biệt để triển khai trợ lý mã nguồn mở không?

Không nhất thiết phải có một đội ngũ AI chuyên biệt, nhưng bạn sẽ cần ít nhất một hoặc hai kỹ sư có kinh nghiệm về Machine Learning hoặc DevOps để thiết lập, fine-tune và duy trì hệ thống. Quá trình này đòi hỏi kiến thức về hạ tầng GPU, quản lý dữ liệu, và các framework ML như PyTorch hoặc TensorFlow. Đối với các đội ngũ nhỏ, việc này có thể là một thách thức, nhưng các công cụ và hướng dẫn ngày càng dễ tiếp cận hơn.

Trợ lý AI mã nguồn mở có thể hiểu được codebase cũ (legacy code) không?

Có, trợ lý AI mã nguồn mở có thể được fine-tune đặc biệt để hiểu các codebase cũ. Bằng cách huấn luyện mô hình trên tập dữ liệu bao gồm các đoạn code, tài liệu và quy ước từ codebase cũ của bạn, mô hình sẽ học được các mẫu và kiến trúc đặc thù. Điều này giúp nó đưa ra các đề xuất chính xác hơn khi làm việc với code legacy, vốn thường là một thách thức đối với các mô hình AI chung.

Chi phí triển khai một trợ lý AI mã nguồn mở là bao nhiêu?

Chi phí triển khai một trợ lý AI mã nguồn mở có thể dao động rất lớn. Chi phí ban đầu bao gồm mua sắm phần cứng (GPU) hoặc chi phí thuê dịch vụ đám mây (ví dụ: 100-500 USD/tháng cho một GPU cấp trung), và chi phí nhân sự để thiết lập và duy trì (có thể từ vài nghìn đến chục nghìn USD tùy quy mô). Tuy nhiên, về lâu dài, bạn sẽ không phải trả phí thuê bao liên tục cho mỗi developer, điều này có thể tiết kiệm hàng chục nghìn đến hàng trăm nghìn USD mỗi năm cho các tổ chức lớn so với các giải pháp thương mại.

Kết Luận

Việc vượt ra ngoài các giải pháp AI coding thương mại như Copilot để xây dựng một trợ lý AI mã nguồn mở tùy biến là một bước tiến chiến lược cho bất kỳ đội ngũ phát triển nào mong muốn tối ưu hóa quy trình, bảo mật dữ liệu và kiểm soát công nghệ. Mặc dù đòi hỏi đầu tư ban đầu về thời gian và tài nguyên, khả năng tùy chỉnh sâu rộng, quyền kiểm soát dữ liệu tuyệt đối, và tiềm năng tiết kiệm chi phí dài hạn khiến nó trở thành một lựa chọn hấp dẫn. Với sự phát triển không ngừng của các mô hình LLM mã nguồn mở và các công cụ fine-tuning, việc này ngày càng trở nên khả thi hơn cho nhiều tổ chức.

Bằng cách tận dụng sức mạnh của AI coding mã nguồn mở, các developer không chỉ tăng tốc độ làm việc mà còn nâng cao chất lượng code, giảm thiểu lỗi, và tạo ra một môi trường phát triển nhất quán hơn. Đây là tương lai của vibe coding, nơi AI trở thành một thành viên không thể thiếu, được tinh chỉnh để hoàn toàn phù hợp với nhịp điệu và phong cách riêng của từng đội ngũ.