Giới Thiệu Vibe Coding: Thử Nghiệm "AI-First" Local Dev Với LlamaIndex & LangChain – Tích Hợp AI Trọn Vẹn

Vibe Coding là phương pháp phát triển phần mềm tiên tiến, nơi AI đóng vai trò trung tâm trong toàn bộ vòng đời phát triển, từ ý tưởng đến triển khai. Bài viết về LlamaIndex LangChain AI này sẽ giúp bạn khám phá cách tích hợp trí tuệ nhân tạo một cách sâu sắc vào quy trình phát triển cục bộ (local development) của mình, biến các công cụ AI thành những người bạn đồng hành không thể thiếu. Chúng ta sẽ đi sâu vào việc sử dụng LlamaIndex và LangChain, hai framework hàng đầu, để xây dựng các ứng dụng AI mạnh mẽ và tối ưu hóa workflow của developer, mở ra kỷ nguyên mới của "AI-First Local Dev".

"AI-First Local Dev" Là Gì và Tại Sao Lại Quan Trọng?

"AI-First Local Dev" là một triết lý phát triển phần mềm đặt trí tuệ nhân tạo làm trọng tâm ngay từ những giai đoạn đầu của quá trình phát triển trên môi trường cục bộ của developer. Nó không chỉ đơn thuần là việc sử dụng các công cụ AI để sinh code hoặc debug, mà là việc thiết kế toàn bộ kiến trúc ứng dụng và quy trình làm việc xoay quanh khả năng của AI, cho phép AI chủ động tham gia vào việc phân tích yêu cầu, thiết kế hệ thống, kiểm thử, và thậm chí là triển khai. Phương pháp này giúp tăng năng suất đáng kể, ước tính có thể giảm tới 30-50% thời gian phát triển và cải thiện chất lượng code.

Trong bối cảnh hiện nay, khi AI ngày càng trở nên mạnh mẽ và dễ tiếp cận, việc tích hợp AI vào quy trình local development trở thành một lợi thế cạnh tranh then chốt. Theo một báo cáo từ GitHub Copilot, các developer sử dụng AI pair programming hoàn thành tác vụ nhanh hơn 55% so với nhóm không sử dụng. "AI-First Local Dev" tận dụng tối đa tiềm năng này bằng cách sử dụng LlamaIndex và LangChain để xây dựng các ứng dụng có khả năng hiểu ngữ cảnh, xử lý dữ liệu phi cấu trúc và tương tác tự nhiên với người dùng. Điều này đặc biệt quan trọng khi phát triển các hệ thống RAG (Retrieval Augmented Generation) hoặc các tác nhân AI phức tạp, nơi việc thử nghiệm và lặp lại nhanh chóng trên môi trường local là cực kỳ cần thiết.

Lợi ích chính của "AI-First Local Dev":

- Tăng tốc độ phát triển: AI có thể tự động hóa nhiều tác vụ lặp đi lặp lại, sinh code, và cung cấp gợi ý thông minh, giúp developer tập trung vào giải quyết vấn đề cốt lõi.

- Cải thiện chất lượng code: AI có thể phát hiện lỗi tiềm ẩn, đề xuất cải tiến và đảm bảo tuân thủ các quy tắc code style, dẫn đến code sạch hơn, ít lỗi hơn.

- Khám phá và thử nghiệm nhanh chóng: Với khả năng tạo ra các phiên bản prototype nhanh chóng, developer có thể thử nghiệm các ý tưởng mới và lặp lại hiệu quả hơn.

- Giảm chi phí: Tối ưu hóa quy trình giúp giảm thời gian và nguồn lực cần thiết cho mỗi dự án. Một nghiên cứu của McKinsey cho thấy AI có thể tăng năng suất lao động lên đến 1.4% mỗi năm trên toàn cầu.

- Mở rộng khả năng: Cho phép developer xây dựng các ứng dụng thông minh hơn, có khả năng xử lý ngôn ngữ tự nhiên, phân tích dữ liệu phức tạp mà trước đây khó thực hiện.

Việc áp dụng phương pháp này đòi hỏi sự hiểu biết sâu sắc về cách các framework như LlamaIndex và LangChain hoạt động, cũng như cách tích hợp chúng một cách hiệu quả vào môi trường phát triển cục bộ. Chúng ta sẽ cùng nhau khám phá những khía cạnh này.

LlamaIndex và LangChain: Hai Trụ Cột của AI-First Local Dev

LlamaIndex và LangChain là hai thư viện Python mã nguồn mở hàng đầu, cung cấp các công cụ mạnh mẽ để xây dựng các ứng dụng dựa trên mô hình ngôn ngữ lớn (LLM). Chúng hoạt động bổ trợ cho nhau, tạo thành một bộ công cụ toàn diện cho việc phát triển AI-First, đặc biệt là trong các ứng dụng RAG (Retrieval Augmented Generation).

LlamaIndex là gì?

LlamaIndex (trước đây là GPT Index) là một khung dữ liệu (data framework) tập trung vào việc kết nối các mô hình ngôn ngữ lớn (LLM) với dữ liệu cá nhân hoặc dữ liệu doanh nghiệp. Nó cung cấp các công cụ để nhập dữ liệu từ nhiều nguồn khác nhau (ví dụ: file PDF, cơ sở dữ liệu, API), lập chỉ mục (index) dữ liệu đó thành các dạng mà LLM có thể dễ dàng truy xuất và hiểu, sau đó cho phép người dùng truy vấn dữ liệu này thông qua LLM. Mục tiêu chính của LlamaIndex là giải quyết vấn đề "hallucination" của LLM bằng cách cung cấp cho chúng thông tin chính xác và cập nhật từ nguồn dữ liệu cụ thể, giúp LLM đưa ra câu trả lời dựa trên bằng chứng.

Các thành phần cốt lõi của LlamaIndex bao gồm:

- Data Connectors: Hỗ trợ tải dữ liệu từ hàng trăm nguồn khác nhau.

- Data Indexes: Cấu trúc dữ liệu được tối ưu hóa để truy vấn LLM hiệu quả, như

VectorStoreIndex,TreeIndex,KeywordTableIndex. - Query Engines: Cung cấp giao diện để gửi truy vấn tới các chỉ mục và nhận phản hồi từ LLM.

- Chat Engines: Cho phép xây dựng các chatbot với khả năng ghi nhớ cuộc trò chuyện.

LlamaIndex đặc biệt xuất sắc trong việc quản lý và truy xuất thông tin từ các tập dữ liệu lớn, giúp LLM có thể "ghi nhớ" và "học" từ kho kiến thức riêng của bạn. Ví dụ, bạn có thể xây dựng một chatbot nội bộ có thể trả lời các câu hỏi về tài liệu công ty hoặc một hệ thống hỗ trợ khách hàng dựa trên FAQ của bạn.

LangChain là gì?

LangChain là một framework toàn diện để phát triển các ứng dụng được hỗ trợ bởi các mô hình ngôn ngữ lớn (LLM). Nó cung cấp một bộ công cụ, thành phần và giao diện để xây dựng các chuỗi (chains) phức tạp của các tác vụ, kết nối LLM với các nguồn dữ liệu và các công cụ khác. Trong khi LlamaIndex tập trung vào việc quản lý dữ liệu cho LLM, LangChain tập trung vào việc điều phối luồng logic và tích hợp các thành phần khác nhau để tạo ra một ứng dụng hoàn chỉnh.

Các module chính của LangChain bao gồm:

- Models: Giao diện cho các LLM, chat models, và embedding models.

- Prompts: Quản lý các template prompt, ví dụ:

ChatPromptTemplate. - Indexes: Tương tự như LlamaIndex, nhưng LangChain cung cấp các công cụ để tích hợp với nhiều loại index khác nhau, bao gồm cả vector stores.

- Chains: Các chuỗi tuần tự của các thành phần, cho phép kết hợp nhiều bước logic (ví dụ: truy vấn dữ liệu, tóm tắt, dịch).

- Agents: Các hệ thống thông minh cho phép LLM đưa ra quyết định về các hành động cần thực hiện dựa trên các công cụ có sẵn, ví dụ: tìm kiếm trên web, gọi API.

- Memory: Khả năng duy trì trạng thái cuộc trò chuyện giữa các lượt tương tác.

LangChain mạnh mẽ trong việc xây dựng các tác nhân (agents) có khả năng suy luận, lập kế hoạch và thực hiện các hành động phức tạp. Ví dụ, bạn có thể tạo ra một agent có thể tìm kiếm thông tin trên internet, phân tích dữ liệu từ một API, và sau đó tổng hợp kết quả để trả lời câu hỏi của người dùng. LangChain đã chứng minh khả năng mở rộng của mình với hơn 100,000 lượt tải xuống hàng tuần vào cuối năm 2023.

Sức mạnh tổng hợp của LlamaIndex và LangChain

Khi kết hợp, LlamaIndex và LangChain tạo thành một combo mạnh mẽ. LlamaIndex có thể được sử dụng để xây dựng một kho kiến thức tùy chỉnh từ dữ liệu của bạn, tạo ra các chỉ mục vector hiệu quả. Sau đó, các chỉ mục này có thể được tích hợp vào LangChain như một công cụ (tool) mà LangChain Agent có thể sử dụng. Điều này cho phép LangChain Agent không chỉ truy cập vào kiến thức chung của LLM mà còn cả kiến thức cụ thể, độc quyền mà bạn đã cung cấp thông qua LlamaIndex, giúp ứng dụng AI của bạn trở nên thông minh và có ngữ cảnh hơn nhiều.

Một ví dụ điển hình là xây dựng một trợ lý AI nội bộ: LlamaIndex sẽ lập chỉ mục tất cả tài liệu kỹ thuật, hướng dẫn sử dụng, và báo cáo nội bộ của công ty. LangChain sau đó sẽ sử dụng LlamaIndex làm nguồn tri thức, kết hợp với các công cụ khác như truy cập email hoặc truy vấn cơ sở dữ liệu, để tạo ra một trợ lý có thể trả lời các câu hỏi phức tạp về hoạt động công ty, tóm tắt các cuộc họp, hoặc thậm chí giúp viết báo cáo. Sự kết hợp này mang lại khả năng xây dựng các ứng dụng AI vượt trội, tận dụng tối đa sức mạnh của cả hai framework.

Thực Hành "AI-First Local Dev" với LlamaIndex và LangChain

Để bắt đầu hành trình "AI-First Local Dev", chúng ta sẽ thiết lập một môi trường cục bộ và xây dựng một ứng dụng RAG đơn giản sử dụng LlamaIndex và LangChain. Đây là một ví dụ thực tế về cách tích hợp AI trọn vẹn vào quy trình phát triển của bạn.

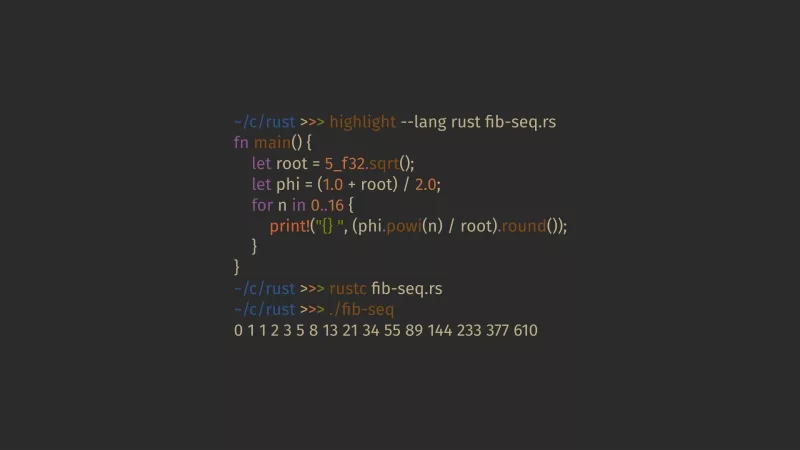

Bước 1: Chuẩn bị môi trường

Đầu tiên, bạn cần cài đặt Python (phiên bản 3.9 trở lên được khuyến nghị) và các thư viện cần thiết. Chúng ta sẽ sử dụng pip để cài đặt.

pip install llama-index langchain openai pydantic unstructured chromadb

# Cài đặt thêm các thư viện cần thiết cho việc xử lý file PDF nếu có

pip install pypdf

Bạn cũng cần có một khóa API OpenAI. Lưu khóa này vào biến môi trường OPENAI_API_KEY.

export OPENAI_API_KEY="YOUR_OPENAI_API_KEY"

# Hoặc tạo file .env và sử dụng thư viện python-dotenv

Bước 2: Chuẩn bị dữ liệu với LlamaIndex

Giả sử chúng ta có một tài liệu PDF về "Lịch sử AI" mà chúng ta muốn LLM có thể truy vấn. Hãy tạo một thư mục data và đặt file history_of_ai.pdf vào đó.

Chúng ta sẽ sử dụng LlamaIndex để tải và lập chỉ mục dữ liệu này.

# file: prepare_data.py

from llama_index.readers.file import PDFReader

from llama_index.core import VectorStoreIndex, SimpleDirectoryReader

import os

# Đảm bảo thư mục "data" tồn tại

if not os.path.exists("data"):

os.makedirs("data")

print("Vui lòng đặt file history_of_ai.pdf vào thư mục 'data'.")

exit()

# Tải tài liệu từ thư mục 'data'

documents = SimpleDirectoryReader(input_dir="data").load_data()

print(f"Đã tải {len(documents)} tài liệu.")

# Tạo chỉ mục VectorStore từ tài liệu

# Đây là bước quan trọng để chuyển đổi văn bản thành vector embeddings

# mà LLM có thể sử dụng để tìm kiếm ngữ nghĩa.

index = VectorStoreIndex.from_documents(documents)

print("Đã tạo chỉ mục thành công.")

# Lưu chỉ mục để sử dụng sau này

index.storage_context.persist(persist_dir="./storage")

print("Đã lưu chỉ mục vào thư mục ./storage")

# Bạn có thể kiểm tra truy vấn cơ bản ngay tại đây

query_engine = index.as_query_engine()

response = query_engine.query("AI được phát minh khi nào và bởi ai?")

print("\n--- Truy vấn LlamaIndex cơ bản ---")

print(response.response)

Chạy script này: python prepare_data.py. Script sẽ tải dữ liệu, tạo chỉ mục vector, và lưu nó vào thư mục ./storage. Đây là nền tảng kiến thức mà chúng ta sẽ cung cấp cho LangChain Agent.

Bước 3: Xây dựng ứng dụng LangChain Agent

Bây giờ, chúng ta sẽ sử dụng LangChain để tạo một agent có thể sử dụng chỉ mục LlamaIndex làm một trong các công cụ của nó. Agent này sẽ có khả năng suy luận và quyết định khi nào nên sử dụng chỉ mục để trả lời câu hỏi.

# file: ai_agent.py

from llama_index.core import StorageContext, load_index_from_storage

from llama_index.core.tools import QueryEngineTool, ToolMetadata

from langchain.agents import initialize_agent, AgentType

from langchain_openai import ChatOpenAI

from langchain.tools import Tool

from langchain.chains import LLMChain

from langchain_core.prompts import PromptTemplate

import os

# Tải chỉ mục đã lưu

print("Đang tải chỉ mục từ ./storage...")

storage_context = StorageContext.from_defaults(persist_dir="./storage")

index = load_index_from_storage(storage_context)

print("Đã tải chỉ mục thành công.")

# Chuyển đổi LlamaIndex Query Engine thành LangChain Tool

llama_query_engine = index.as_query_engine()

query_engine_tool = QueryEngineTool(

query_engine=llama_query_engine,

metadata=ToolMetadata(

name="ai_history_document_qa",

description=(

"Cung cấp thông tin về lịch sử của AI, "

"các cột mốc quan trọng, và những người đóng góp chính. "

"Hữu ích khi trả lời các câu hỏi về AI và lịch sử của nó."

),

),

)

print("Đã tạo LlamaIndex Tool cho LangChain.")

# Định nghĩa một công cụ LangChain khác (ví dụ: công cụ tính toán đơn giản)

# để minh họa khả năng của Agent trong việc chọn công cụ phù hợp.

def simple_calculator(expression: str) -> str:

"""Performs a simple arithmetic calculation."""

try:

return str(eval(expression))

except Exception as e:

return f"Error: {e}"

calculator_tool = Tool(

name="Calculator",

func=simple_calculator,

description="Hữu ích khi bạn cần thực hiện các phép tính số học."

)

# Khởi tạo LLM cho LangChain Agent

llm = ChatOpenAI(temperature=0, model="gpt-4o") # Sử dụng gpt-4o để có hiệu suất tốt nhất

# Khởi tạo LangChain Agent với các công cụ

agent = initialize_agent(

tools=[query_engine_tool, calculator_tool],

llm=llm,

agent=AgentType.OPENAI_FUNCTIONS, # Sử dụng OpenAIFunctionsAgent để tận dụng khả năng gọi hàm của OpenAI

verbose=True # Hiển thị quá trình suy luận của Agent

)

print("Đã khởi tạo LangChain Agent.")

# Bắt đầu tương tác với Agent

print("\n--- Bắt đầu tương tác với LangChain Agent ---")

while True:

try:

user_input = input("Bạn hỏi gì? (gõ 'thoat' để thoát): ")

if user_input.lower() == 'thoat':

break

response = agent.invoke({"input": user_input})

print(f"\nAI: {response['output']}\n")

except Exception as e:

print(f"Đã xảy ra lỗi: {e}")

print("Vui lòng đảm bảo OPENAI_API_KEY đã được thiết lập đúng.")

break

Chạy script này: python ai_agent.py. Bạn sẽ thấy Agent suy luận và chọn công cụ phù hợp để trả lời câu hỏi của bạn. Ví dụ:

- Bạn hỏi gì?: "Ai là người tiên phong trong lĩnh vực AI?" -> Agent sẽ sử dụng

ai_history_document_qa. - Bạn hỏi gì?: "Tính 123 * 456" -> Agent sẽ sử dụng

Calculator. - Bạn hỏi gì?: "Tóm tắt lịch sử của AI trong vài câu" -> Agent sẽ sử dụng

ai_history_document_qavà sau đó tóm tắt kết quả.

Đây là một minh chứng rõ ràng về "AI-First Local Dev". Bạn đã xây dựng một hệ thống thông minh trên máy cục bộ của mình, nơi AI không chỉ là một công cụ sinh code mà còn là một bộ não có khả năng truy vấn kiến thức tùy chỉnh và thực hiện các hành động phức tạp. Quá trình này cho phép developer thử nghiệm, lặp lại và debug các hệ thống AI phức tạp một cách hiệu quả ngay trên môi trường phát triển của họ.

Tips và Best Practices cho "AI-First Local Dev"

Để tối ưu hóa trải nghiệm "AI-First Local Dev" với LlamaIndex và LangChain, dưới đây là một số tips và best practices quan trọng:

- Quản lý và Phiên bản hóa Dữ liệu (Data Versioning): Dữ liệu là trái tim của các ứng dụng AI. Sử dụng các công cụ như DVC (Data Version Control) hoặc Git LFS để quản lý các tập dữ liệu, embeddings và chỉ mục của bạn. Điều này giúp bạn dễ dàng quay lại các phiên bản trước và đảm bảo tính nhất quán trong quá trình phát triển.

- Tối ưu hóa Prompts: Prompt engineering là một kỹ năng quan trọng. Thử nghiệm với các cấu trúc prompt khác nhau, bao gồm các hướng dẫn rõ ràng, ví dụ cụ thể (few-shot examples), và các ràng buộc đầu ra. Sử dụng

PromptTemplatecủa LangChain để quản lý và tái sử dụng các prompt hiệu quả. - Giám sát và Debugging: Các ứng dụng AI có thể khó debug do tính ngẫu nhiên của LLM. Sử dụng các công cụ giám sát như LangSmith (của LangChain) hoặc Weights & Biases để theo dõi các chuỗi, tác nhân, và tương tác của LLM. Điều này giúp bạn hiểu rõ hơn về cách Agent đưa ra quyết định và xác định các điểm yếu.

- Sử dụng Embeddings Phù hợp: Lựa chọn mô hình embedding có ảnh hưởng lớn đến chất lượng truy xuất trong LlamaIndex. Thử nghiệm với các mô hình khác nhau (ví dụ: OpenAI Embeddings, Cohere, hoặc các mô hình mã nguồn mở như

BAAI/bge-small-en-v1.5) để tìm ra mô hình phù hợp nhất với loại dữ liệu và nhiệm vụ của bạn. - Xây dựng Công cụ (Tools) có Mục đích Rõ ràng: Khi thiết kế các công cụ cho LangChain Agent, hãy đảm bảo mỗi công cụ có một mô tả rõ ràng và một chức năng riêng biệt. Điều này giúp Agent dễ dàng quyết định khi nào nên sử dụng công cụ nào. Ví dụ, thay vì một công cụ "search", hãy có "web_search" và "document_qa".

- Kiểm thử Tự động (Automated Testing): Phát triển các test case tự động cho các chuỗi và tác nhân của bạn. Điều này bao gồm kiểm thử đơn vị cho các công cụ, kiểm thử tích hợp cho các chuỗi, và kiểm thử đầu cuối cho toàn bộ ứng dụng. Các thư viện như

pytestcó thể được sử dụng hiệu quả. - Quản lý Context và Memory: Hiểu rõ cách LlamaIndex và LangChain quản lý context và memory. Đối với các cuộc trò chuyện dài, hãy cân nhắc sử dụng các kỹ thuật tóm tắt (summarization) hoặc nén ngữ cảnh (context compression) để tránh vượt quá giới hạn token của LLM và duy trì hiệu suất.

- Bảo mật Dữ liệu Nhạy cảm: Khi làm việc với dữ liệu cục bộ, đặc biệt là dữ liệu nhạy cảm, hãy đảm bảo các biện pháp bảo mật phù hợp được áp dụng. Tránh gửi dữ liệu nhạy cảm trực tiếp đến các API LLM công cộng nếu không được mã hóa hoặc xử lý đúng cách.

- Phối hợp với Cộng đồng: Cộng đồng của LlamaIndex và LangChain rất sôi động. Tham gia các diễn đàn, nhóm chat để học hỏi, chia sẻ kinh nghiệm và cập nhật các tính năng mới. Khoảng 70% các dự án AI mã nguồn mở lớn có cộng đồng đóng góp tích cực.

So Sánh LlamaIndex và LangChain: Khi nào dùng cái nào?

Mặc dù LlamaIndex và LangChain thường được sử dụng cùng nhau, chúng có những điểm mạnh và trọng tâm khác nhau. Hiểu rõ sự khác biệt giúp bạn đưa ra quyết định tối ưu cho từng phần của ứng dụng AI của mình.

LlamaIndex nổi trội trong việc xử lý và quản lý dữ liệu không có cấu trúc hoặc bán cấu trúc để tích hợp với LLM. Nếu bạn cần xây dựng một hệ thống RAG mạnh mẽ, nơi LLM cần truy cập và hiểu một kho kiến thức riêng biệt (ví dụ: tài liệu nội bộ, sách, bài viết nghiên cứu), LlamaIndex là lựa chọn lý tưởng. Nó cung cấp các công cụ chuyên biệt để tải dữ liệu từ nhiều nguồn, chuyển đổi chúng thành các định dạng dễ dàng truy vấn cho LLM (như vector store), và tối ưu hóa quá trình truy xuất. LlamaIndex giúp giải quyết vấn đề "hallucination" bằng cách đảm bảo LLM có nguồn thông tin đáng tin cậy để tham khảo. Nó giống như một thư viện số thông minh cho LLM của bạn.

Ngược lại, LangChain là một framework đa năng hơn, tập trung vào việc orchestration (điều phối) và chaining (chuỗi hóa) các thành phần khác nhau để xây dựng một ứng dụng LLM hoàn chỉnh. Nếu bạn cần xây dựng một "agent" có khả năng suy luận, lập kế hoạch, và thực hiện các hành động phức tạp bằng cách sử dụng nhiều công cụ (ví dụ: tìm kiếm web, gọi API, tương tác với cơ sở dữ liệu, và cả truy vấn LlamaIndex), LangChain là lựa chọn số một. Nó cung cấp các abstraction (trừu tượng hóa) cho LLM, prompts, memory, và đặc biệt là agents và chains, giúp bạn kết nối các mảnh ghép lại với nhau để tạo ra logic ứng dụng phức tạp. LangChain giống như một bộ não điều khiển các công cụ khác nhau để hoàn thành một nhiệm vụ.

Tóm lại:

- Nếu bạn đang đối mặt với thách thức lớn về việc quản lý, lập chỉ mục và truy xuất thông tin từ dữ liệu tùy chỉnh để cung cấp ngữ cảnh cho LLM, hãy ưu tiên sử dụng LlamaIndex. Nó sẽ là xương sống cho kho kiến thức của bạn.

- Nếu bạn cần xây dựng một luồng logic phức tạp, kết hợp nhiều bước, sử dụng các công cụ khác nhau và cho phép LLM đưa ra quyết định hành động, hãy chọn LangChain. Nó sẽ là bộ điều khiển trung tâm cho ứng dụng AI của bạn.

Trong nhiều trường hợp, sự kết hợp của cả hai là phương pháp hiệu quả nhất. LlamaIndex có thể tạo ra các "knowledge base" mạnh mẽ, và LangChain có thể sử dụng các "query engine" của LlamaIndex như một "tool" trong một hệ thống agent lớn hơn. Điều này cho phép bạn tận dụng tối đa sức mạnh của cả hai framework, tạo ra các ứng dụng AI-First thực sự thông minh và linh hoạt.

Các Lưu Ý Quan Trọng khi Triển Khai AI-First Local Dev

- Chi phí API và Quản lý Token: Việc sử dụng các mô hình LLM thương mại như OpenAI có thể phát sinh chi phí đáng kể. Trong quá trình phát triển cục bộ, hãy cẩn thận với số lượng request và token sử dụng. Cân nhắc sử dụng các mô hình nhỏ hơn, local (ví dụ: Llama.cpp) cho các thử nghiệm ban đầu hoặc các tác vụ không yêu cầu độ chính xác cao nhất. Ước tính chi phí có thể tăng tới 20% nếu không quản lý token hiệu quả.

- Hiệu suất và Tài nguyên Phần cứng: Chạy các mô hình embedding hoặc LLM cục bộ (nếu có) có thể yêu cầu tài nguyên CPU/GPU đáng kể. Đảm bảo máy phát triển của bạn có đủ RAM và sức mạnh xử lý. Đối với các tác vụ nặng, việc sử dụng GPU là gần như bắt buộc.

- Độ trễ (Latency) và Trải nghiệm người dùng: Các tương tác với LLM, đặc biệt là thông qua API đám mây, có thể có độ trễ. Khi thiết kế ứng dụng, hãy cân nhắc cách xử lý độ trễ này để không ảnh hưởng đến trải nghiệm người dùng (ví dụ: sử dụng streaming output, hiển thị trạng thái tải).

- Bảo mật và Quyền riêng tư Dữ liệu: Khi làm việc với dữ liệu nhạy cảm trên môi trường cục bộ, hãy đảm bảo bạn tuân thủ các quy định về bảo mật và quyền riêng tư (ví dụ: GDPR, HIPAA). Tránh để lộ khóa API hoặc thông tin cá nhân trong code hoặc log. Luôn mã hóa dữ liệu khi cần thiết.

- Quản lý Dependency: Các framework AI như LlamaIndex và LangChain có thể có nhiều dependency phức tạp. Sử dụng môi trường ảo (

venvhoặcconda) để quản lý các gói thư viện và tránh xung đột. Cập nhật các thư viện thường xuyên để tận dụng các tính năng và bản vá lỗi mới nhất. - Khả năng Mở rộng và Triển khai: Mặc dù bạn đang phát triển cục bộ, hãy luôn nghĩ đến khả năng mở rộng và cách bạn sẽ triển khai ứng dụng của mình lên môi trường sản phẩm. Cân nhắc các dịch vụ đám mây (AWS, Azure, GCP) cho việc lưu trữ vector database, quản lý LLM API key, và scaling.

- Đạo đức và Trách nhiệm của AI: Khi xây dựng các hệ thống AI, đặc biệt là những hệ thống tương tác trực tiếp với người dùng, hãy luôn xem xét các khía cạnh đạo đức và trách nhiệm. Đảm bảo AI của bạn không tạo ra nội dung có hại, thiên vị hoặc sai lệch. Thử nghiệm kỹ lưỡng để giảm thiểu rủi ro này.

Câu Hỏi Thường Gặp

LlamaIndex và LangChain có phải là đối thủ cạnh tranh không?

Không, LlamaIndex và LangChain không phải là đối thủ cạnh tranh mà là các framework bổ trợ cho nhau. LlamaIndex tập trung vào việc quản lý dữ liệu và truy xuất thông tin cho LLM, trong khi LangChain tập trung vào việc điều phối luồng logic và kết nối các thành phần khác nhau để xây dựng ứng dụng LLM hoàn chỉnh. Chúng thường được sử dụng cùng nhau để tạo ra các hệ thống AI mạnh mẽ hơn.

Tôi có cần cả LlamaIndex và LangChain để xây dựng ứng dụng AI không?

Không nhất thiết phải có cả hai. Nếu bạn chỉ cần một hệ thống RAG đơn giản để truy vấn một kho tài liệu, LlamaIndex có thể đủ. Nếu bạn muốn xây dựng một tác nhân phức tạp hơn có khả năng lập kế hoạch và sử dụng nhiều công cụ khác nhau ngoài việc truy vấn dữ liệu, thì LangChain sẽ là lựa chọn phù hợp. Tuy nhiên, việc kết hợp cả hai thường mang lại hiệu quả cao nhất cho các ứng dụng AI phức tạp.

Làm thế nào để quản lý các phiên bản mô hình LLM khác nhau trong "AI-First Local Dev"?

Bạn có thể quản lý các phiên bản mô hình LLM bằng cách sử dụng biến môi trường để chỉ định mô hình (ví dụ: OPENAI_MODEL=gpt-3.5-turbo hoặc OPENAI_MODEL=gpt-4o). Ngoài ra, các framework như LangChain và LlamaIndex cho phép bạn dễ dàng thay đổi mô hình LLM thông qua cấu hình của chúng. Đối với các mô hình local, bạn có thể sử dụng các thư viện như ollama hoặc llama-cpp-python và thay đổi đường dẫn đến file mô hình.

Có thể sử dụng LlamaIndex hoặc LangChain với các mô hình LLM mã nguồn mở không?

Có, cả LlamaIndex và LangChain đều hỗ trợ rộng rãi các mô hình LLM mã nguồn mở (ví dụ: Llama 2, Mixtral, Falcon) thông qua các tích hợp với thư viện như HuggingFace, Ollama, hoặc Llama.cpp. Điều này cho phép bạn phát triển và thử nghiệm các ứng dụng AI mà không cần phụ thuộc hoàn toàn vào các API LLM thương mại, giúp giảm chi phí và tăng cường quyền riêng tư dữ liệu.

Làm thế nào để đảm bảo dữ liệu được cập nhật trong LlamaIndex?

Để đảm bảo dữ liệu luôn được cập nhật, bạn cần thiết lập một quy trình để định kỳ tải lại và lập chỉ mục dữ liệu mới hoặc đã thay đổi. LlamaIndex cung cấp các cơ chế để cập nhật chỉ mục một cách hiệu quả, ví dụ: bằng cách chỉ lập chỉ mục lại các tài liệu đã thay đổi hoặc sử dụng các chiến lược cập nhật tăng dần. Bạn có thể tự động hóa quy trình này bằng cách sử dụng các công cụ lập lịch tác vụ (cron jobs) hoặc các dịch vụ orchestration dữ liệu (ví dụ: Airflow).

Kết Luận

"AI-First Local Dev" với LlamaIndex và LangChain không chỉ là một xu hướng mà là một sự thay đổi cơ bản trong cách chúng ta tiếp cận phát triển phần mềm. Bằng cách tích hợp sâu sắc trí tuệ nhân tạo vào mọi giai đoạn của quy trình phát triển cục bộ, từ quản lý dữ liệu đến điều phối logic, chúng ta có thể tạo ra các ứng dụng thông minh hơn, hiệu quả hơn và có khả năng mở rộng. LlamaIndex cung cấp nền tảng vững chắc cho việc quản lý và truy xuất kiến thức, trong khi LangChain cho phép chúng ta xây dựng các tác nhân AI phức tạp có khả năng suy luận và thực hiện hành động.

Việc nắm vững hai framework này và áp dụng các best practices đã được đề cập sẽ giúp các developer Việt Nam tiên phong trong kỷ nguyên mới của AI. Đây là thời điểm vàng để khám phá và thử nghiệm, biến những ý tưởng AI táo bạo thành hiện thực ngay trên máy tính của bạn. Hãy bắt đầu hành trình "AI-First Local Dev" và cùng vibe coding tạo ra những sản phẩm đột phá!