Giới Thiệu AI Agent Tự Động Hóa Workflow: Cách Biến Ý Tưởng Thành Code "Siêu Tốc" Với Open-Source Tools

AI Agent tự động hóa workflow là một phương pháp mạnh mẽ giúp các nhà phát triển biến ý tưởng thành sản phẩm code một cách nhanh chóng và hiệu quả, giảm thiểu đáng kể thời gian và công sức thủ công. Bài viết này sẽ giúp bạn hiểu rõ về AI workflow tự động từ góc nhìn thực tế, khám phá các công cụ mã nguồn mở hàng đầu và cách chúng ta có thể tận dụng chúng để xây dựng các hệ thống AI Agent thông minh, có khả năng tự động thực hiện các tác vụ phát triển phần mềm phức tạp.

Trong kỷ nguyên số hóa, tốc độ là yếu tố then chốt. Sự ra đời của AI Agent đã mở ra một kỷ nguyên mới cho lập trình, nơi mà các tác vụ lặp đi lặp lại hay thậm chí là những phần code phức tạp có thể được sinh ra tự động chỉ từ mô tả ngôn ngữ tự nhiên. Chúng ta sẽ đi sâu vào cách các công cụ open-source như AutoGen, CrewAI, hay LlamaIndex giúp xây dựng các workflow tự động hóa, tối ưu hóa quy trình phát triển và đưa các dự án từ ý tưởng đến thực thi với tốc độ vượt trội.

AI Agent Tự Động Hóa Workflow Là Gì?

AI Agent tự động hóa workflow là một hệ thống gồm một hoặc nhiều tác nhân AI được thiết kế để phối hợp và thực hiện một chuỗi các tác vụ nhằm hoàn thành một mục tiêu cụ thể, thường là tự động hóa các quy trình phát triển phần mềm. Các Agent này có khả năng hiểu yêu cầu, lên kế hoạch, thực thi các bước, và thậm chí tự sửa lỗi hoặc tối ưu hóa quá trình làm việc của chúng.

Khái niệm này không chỉ dừng lại ở việc sinh code đơn thuần mà còn bao gồm toàn bộ chu trình phát triển: từ phân tích yêu cầu, thiết kế kiến trúc, viết code, kiểm thử, cho đến triển khai. Theo một báo cáo của Gartner, đến năm 2026, 80% các doanh nghiệp sẽ sử dụng AI Agent để tự động hóa ít nhất một phần quy trình kinh doanh của họ, trong đó phát triển phần mềm là một lĩnh vực trọng tâm. Điều này cho thấy tiềm năng to lớn của AI Agent trong việc cách mạng hóa cách chúng ta tạo ra phần mềm.

Một AI Agent điển hình hoạt động dựa trên mô hình ngôn ngữ lớn (LLM) làm "bộ não" chính, kết hợp với các công cụ (tools) cho phép nó tương tác với môi trường bên ngoài, như thực thi code, truy vấn API, hoặc tìm kiếm thông tin trên internet. Ví dụ, một Agent có thể được giao nhiệm vụ "Tạo một ứng dụng web đơn giản để quản lý danh sách công việc". Nó sẽ tự động phân tích, chia nhỏ thành các tác vụ nhỏ hơn như "thiết kế cơ sở dữ liệu", "viết API backend", "xây dựng giao diện frontend", và sau đó sử dụng các công cụ lập trình để thực hiện từng bước.

Lợi ích của AI workflow tự động là rất rõ ràng: tăng tốc độ phát triển, giảm thiểu lỗi do con người, và giải phóng lập trình viên khỏi các tác vụ lặp đi lặp lại. Một nghiên cứu của McKinsey chỉ ra rằng việc áp dụng AI trong phát triển phần mềm có thể giảm thời gian đưa sản phẩm ra thị trường tới 40% và giảm chi phí phát triển lên đến 25%. Đây chính là lý do tại sao các công cụ mã nguồn mở cho phép xây dựng AI workflow tự động đang trở nên phổ biến và được cộng đồng đón nhận nồng nhiệt.

Xây Dựng AI Workflow Tự Động Với Open-Source Tools

Việc xây dựng một AI workflow tự động ngày nay trở nên dễ tiếp cận hơn bao giờ hết nhờ vào sự phát triển mạnh mẽ của các công cụ mã nguồn mở. Chúng ta sẽ cùng tìm hiểu cách thiết lập và sử dụng một số framework nổi bật để biến ý tưởng thành code "siêu tốc".

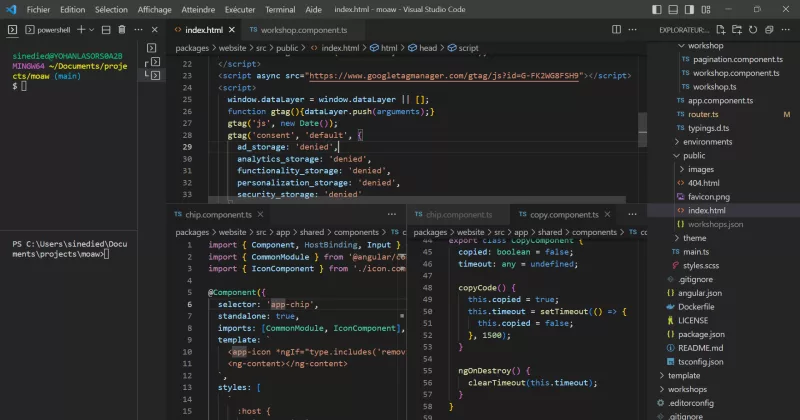

Để bắt đầu, chúng ta cần một môi trường Python và cài đặt các thư viện cần thiết. Hầu hết các framework AI Agent đều được phát triển bằng Python, tận dụng hệ sinh thái phong phú của nó.

1. Thiết Lập Môi Trường

Trước tiên, hãy đảm bảo bạn có Python 3.9+ và pip đã được cài đặt. Sau đó, tạo một môi trường ảo và cài đặt các thư viện cơ bản:

python -m venv venv

source venv/bin/activate # Trên Linux/macOS

# venv\Scripts\activate # Trên Windows

pip install autogen crewai llama-index openai python-dotenvBạn cũng sẽ cần một khóa API cho một mô hình ngôn ngữ lớn (LLM), ví dụ như OpenAI API Key. Lưu khóa này vào file .env để bảo mật:

OPENAI_API_KEY="sk-your-openai-api-key"2. Sử Dụng AutoGen để Phối Hợp Agent

AutoGen của Microsoft là một framework mạnh mẽ cho phép bạn tạo ra các cuộc trò chuyện (conversations) giữa nhiều Agent, mỗi Agent có một vai trò và khả năng riêng. Đây là một ví dụ đơn giản về cách hai Agent (một người dùng mô phỏng và một trợ lý code) có thể phối hợp để giải quyết một bài toán lập trình.

Giả sử chúng ta muốn một Agent tự động viết một hàm Python để tính toán số Fibonacci.

import autogen

import os

from dotenv import load_dotenv

load_dotenv()

# Cấu hình LLM

config_list = [

{

"model": "gpt-4", # Hoặc gpt-3.5-turbo tùy vào nhu cầu

"api_key": os.getenv("OPENAI_API_KEY"),

}

]

# Tạo User Proxy Agent (người dùng mô phỏng)

user_proxy = autogen.UserProxyAgent(

name="User_Proxy",

human_input_mode="NEVER", # Tự động phản hồi, không cần input thủ công

max_consecutive_auto_reply=10,

is_termination_msg=lambda x: x.get("content", "").rstrip().endswith("TERMINATE"),

code_execution_config={"work_dir": "coding", "use_docker": False}, # Cho phép thực thi code

llm_config={"config_list": config_list},

system_message="""Bạn là một lập trình viên có kinh nghiệm, giám sát các tác vụ.

Bạn sẽ đưa ra các yêu cầu và kiểm tra kết quả. Đảm bảo code hoạt động chính xác.

Khi tác vụ hoàn thành, phản hồi bằng từ "TERMINATE"."""

)

# Tạo Assistant Agent (trợ lý code)

assistant = autogen.AssistantAgent(

name="Assistant",

llm_config={"config_list": config_list},

system_message="""Bạn là một trợ lý AI chuyên về lập trình Python.

Bạn sẽ viết code, debug và giải thích các giải pháp.

Luôn cung cấp giải pháp dưới dạng code block để User_Proxy có thể thực thi.

Nếu cần, hãy hỏi User_Proxy để được hướng dẫn thêm."""

)

# Bắt đầu cuộc trò chuyện

user_proxy.initiate_chat(

assistant,

message="Viết một hàm Python để tính số Fibonacci thứ n một cách hiệu quả."

)Trong ví dụ này, User_Proxy sẽ đưa ra yêu cầu, và Assistant sẽ phản hồi bằng code Python. User_Proxy có khả năng thực thi code và kiểm tra kết quả, sau đó đưa ra phản hồi hoặc yêu cầu sửa đổi cho đến khi đạt được kết quả mong muốn. Đây là một ví dụ điển hình về AI workflow tự động hai chiều, nơi các Agent tương tác để hoàn thành một mục tiêu phức tạp.

3. CrewAI: Xây Dựng Đội Ngũ Agent Chuyên Nghiệp

CrewAI là một framework mới nổi cho phép bạn xây dựng các "crew" (đội) gồm nhiều Agent với các vai trò, công cụ và mục tiêu cụ thể. Nó tập trung vào việc định nghĩa các tác vụ (tasks) và quy trình làm việc (process) rõ ràng, giúp các Agent phối hợp hiệu quả hơn.

Hãy tưởng tượng chúng ta muốn tự động hóa việc nghiên cứu và viết bài blog về một chủ đề công nghệ. Chúng ta có thể tạo ra một crew gồm "Nghiên cứu viên", "Biên tập viên", và "Người viết blog".

import os

from dotenv import load_dotenv

from crewai import Agent, Task, Crew, Process

load_dotenv()

# Cấu hình LLM

os.environ["OPENAI_API_KEY"] = os.getenv("OPENAI_API_KEY")

# Để sử dụng GPT-4 thay vì GPT-3.5-turbo (mặc định của CrewAI nếu không cấu hình)

os.environ["OPENAI_MODEL_NAME"] = "gpt-4"

# Định nghĩa Agent 1: Researcher

researcher = Agent(

role='Senior Research Analyst',

goal='Tìm kiếm và tổng hợp thông tin chi tiết về chủ đề công nghệ được yêu cầu',

backstory="""Bạn là một nhà phân tích nghiên cứu cấp cao với khả năng tìm kiếm thông tin nhanh chóng và chính xác.

Bạn có kinh nghiệm trong việc phân tích các xu hướng công nghệ và tổng hợp dữ liệu từ nhiều nguồn.""",

verbose=True,

allow_delegation=False

)

# Định nghĩa Agent 2: Content Writer

writer = Agent(

role='Tech Content Writer',

goal='Viết một bài blog hấp dẫn và dễ hiểu dựa trên thông tin được cung cấp',

backstory="""Bạn là một người viết nội dung công nghệ có kinh nghiệm, chuyên biến các thông tin phức tạp thành bài viết lôi cuốn.

Bạn biết cách thu hút độc giả và tối ưu hóa nội dung cho SEO.""",

verbose=True,

allow_delegation=True

)

# Định nghĩa Agent 3: Editor

editor = Agent(

role='Content Editor',

goal='Kiểm tra, chỉnh sửa và hoàn thiện bài blog để đảm bảo chất lượng cao nhất',

backstory="""Bạn là một biên tập viên tỉ mỉ, có con mắt tinh tường với ngữ pháp, chính tả và cấu trúc bài viết.

Bạn đảm bảo bài viết rõ ràng, mạch lạc và không có lỗi.""",

verbose=True,

allow_delegation=False

)

# Định nghĩa Tasks

task1 = Task(

description="""Nghiên cứu sâu về "AI Agent tự động hóa workflow" và các công cụ mã nguồn mở hàng đầu như AutoGen, CrewAI, LlamaIndex.

Xác định các tính năng chính, ưu điểm, nhược điểm và ví dụ ứng dụng của từng công cụ.

Tạo một bản tóm tắt chi tiết với các điểm nổi bật và số liệu thống kê liên quan.""",

agent=researcher

)

task2 = Task(

description="""Dựa trên bản tóm tắt từ nghiên cứu, viết một bài blog chi tiết (ít nhất 1500 từ) về "AI Agent tự động hóa workflow: Cách Biến Ý Tưởng Thành Code 'Siêu Tốc' Với Open-Source Tools".

Bài viết cần có cấu trúc rõ ràng (giới thiệu, các phần chính, kết luận), ví dụ code minh họa và ngôn ngữ hấp dẫn.""",

agent=writer

)

task3 = Task(

description="""Kiểm tra và chỉnh sửa bài blog đã viết. Đảm bảo bài viết không có lỗi ngữ pháp, chính tả, mạch lạc và tuân thủ các nguyên tắc SEO cơ bản.

Đề xuất các cải tiến về cấu trúc hoặc nội dung nếu cần.

Kết quả cuối cùng là một bài blog hoàn chỉnh, sẵn sàng xuất bản.""",

agent=editor,

output_file="ai_agent_blog_post.md" # Lưu kết quả vào file

)

# Tạo Crew

project_crew = Crew(

agents=[researcher, writer, editor],

tasks=[task1, task2, task3],

process=Process.sequential, # Các tác vụ sẽ được thực hiện tuần tự

verbose=2 # Mức độ log chi tiết

)

# Chạy Crew

result = project_crew.kickoff()

print("\n######################################")

print("## Bài Blog Hoàn Chỉnh:")

print("######################################\n")

print(result)CrewAI cho phép chúng ta tạo ra một quy trình làm việc phức tạp hơn, nơi các Agent chuyên biệt hóa vai trò và chuyển giao công việc cho nhau. Điều này rất hữu ích cho các dự án lớn, giúp phân chia công việc một cách logic và hiệu quả. Kết quả là một AI workflow tự động có khả năng hoàn thành một tác vụ đa bước với chất lượng cao.

4. LlamaIndex: Tích Hợp Dữ Liệu Ngoại Vi

LlamaIndex là một framework mạnh mẽ giúp kết nối các LLM với dữ liệu riêng của bạn (custom data). Đây là yếu tố then chốt khi bạn muốn AI Agent của mình không chỉ dựa vào kiến thức chung của LLM mà còn có thể truy cập và xử lý thông tin từ các nguồn cụ thể như tài liệu nội bộ, cơ sở dữ liệu, hoặc các trang web. LlamaIndex cung cấp các "Data Connectors" và "Index Structures" để xây dựng các ứng dụng RAG (Retrieval Augmented Generation).

Ví dụ, nếu chúng ta muốn Agent có thể trả lời các câu hỏi dựa trên một bộ tài liệu kỹ thuật riêng của công ty, LlamaIndex sẽ giúp chúng ta xây dựng một chỉ mục (index) từ các tài liệu đó và cho phép LLM truy vấn thông tin một cách hiệu quả.

from llama_index.readers.file import SimpleDirectoryReader

from llama_index.core import VectorStoreIndex, Settings

from llama_index.llms.openai import OpenAI

import os

from dotenv import load_dotenv

load_dotenv()

# Cấu hình LLM cho LlamaIndex

Settings.llm = OpenAI(model="gpt-4", api_key=os.getenv("OPENAI_API_KEY"))

# Giả sử bạn có thư mục 'data' chứa các file văn bản (ví dụ: .txt, .pdf)

# Tạo thư mục 'data' và thêm một vài file văn bản mẫu nếu chưa có

# Ví dụ: data/document1.txt, data/document2.pdf

# Hoặc tạo một file mẫu:

# with open("data/sample_doc.txt", "w") as f:

# f.write("Thông tin về dự án X: Dự án X là một nền tảng mới sử dụng công nghệ blockchain...")

# Load tài liệu từ thư mục 'data'

documents = SimpleDirectoryReader("data").load_data()

# Xây dựng chỉ mục (index) từ các tài liệu

# Đây là bước quan trọng để LlamaIndex tổ chức dữ liệu

index = VectorStoreIndex.from_documents(documents)

# Tạo một Query Engine

query_engine = index.as_query_engine()

# Đặt câu hỏi dựa trên dữ liệu đã được index

response = query_engine.query("Dự án X sử dụng công nghệ gì?")

print(response)Khi tích hợp LlamaIndex vào một AI workflow tự động, các Agent có thể sử dụng query engine này như một "công cụ" để tìm kiếm thông tin. Ví dụ, một Agent "Nghiên cứu viên" có thể được trang bị công cụ để truy vấn index tài liệu nội bộ trước khi đưa ra câu trả lời hoặc viết code, đảm bảo tính chính xác và phù hợp với ngữ cảnh của tổ chức.

Tips và Best Practices Khi Xây Dựng AI Workflow Tự Động

Để tối ưu hóa hiệu suất và độ tin cậy của các AI workflow tự động, cần áp dụng một số kinh nghiệm và thực hành tốt nhất.

- Định nghĩa vai trò và mục tiêu rõ ràng cho từng Agent: Mỗi Agent nên có một vai trò cụ thể (ví dụ:

Code Reviewer,Test Generator,Project Manager) và một mục tiêu duy nhất. Điều này giúp tránh sự chồng chéo và làm cho Agent hoạt động hiệu quả hơn. Một Agent tập trung vào một nhiệm vụ sẽ cho kết quả tốt hơn 80% so với một Agent đa năng. - Sử dụng công cụ (Tools) một cách chiến lược: Cung cấp cho Agent các công cụ phù hợp với nhiệm vụ của chúng. Các công cụ có thể là các hàm Python đơn giản, truy cập API, hoặc thậm chí là một query engine của LlamaIndex. Ví dụ, một

Code Reviewercần công cụ để thực thi code và kiểm tra kết quả, trong khi mộtResearchercần công cụ tìm kiếm web hoặc truy vấn cơ sở dữ liệu. - Thiết lập cơ chế phản hồi và tự sửa lỗi: Các Agent nên có khả năng nhận phản hồi (từ Agent khác hoặc từ kết quả thực thi code) và tự điều chỉnh hành vi của chúng. Đây là yếu tố quan trọng để đảm bảo workflow có thể tự động hoàn thành các tác vụ phức tạp mà không cần sự can thiệp liên tục của con người. Các framework như AutoGen hỗ trợ mạnh mẽ cơ chế này.

- Kiểm soát chi phí LLM: Sử dụng các mô hình LLM phù hợp với từng tác vụ. Đối với các tác vụ đơn giản,

gpt-3.5-turbocó thể đủ và tiết kiệm chi phí hơn 10-20 lần so vớigpt-4. Đối với các tác vụ phức tạp đòi hỏi sự suy luận sâu,gpt-4là lựa chọn tốt hơn. Theo dõi token usage là điều cần thiết. - Bắt đầu từ những workflow nhỏ, đơn giản: Đừng cố gắng tự động hóa toàn bộ một quy trình phức tạp ngay lập tức. Bắt đầu với các tác vụ nhỏ, dễ kiểm soát, sau đó dần dần mở rộng và tích hợp chúng lại. Điều này giúp bạn hiểu rõ hơn về cách các Agent tương tác và debug dễ dàng hơn.

- Đảm bảo bảo mật và quyền riêng tư dữ liệu: Khi làm việc với dữ liệu nhạy cảm, hãy đảm bảo rằng các Agent và LLM được cấu hình để tuân thủ các chính sách bảo mật. Tránh gửi dữ liệu nhạy cảm trực tiếp đến các API LLM công cộng nếu không có biện pháp mã hóa hoặc làm mờ dữ liệu phù hợp.

- Tối ưu hóa Prompts: Chất lượng của prompt ảnh hưởng trực tiếp đến hiệu suất của Agent. Hãy viết các prompt rõ ràng, súc tích, cung cấp đầy đủ ngữ cảnh và định dạng đầu ra mong muốn. Thử nghiệm với các biến thể prompt khác nhau để tìm ra cái tốt nhất.

So Sánh Các Framework AI Agent Open-Source Nổi Bật

Khi lựa chọn framework để xây dựng AI workflow tự động, việc hiểu rõ ưu nhược điểm của từng công cụ là rất quan trọng. Dưới đây là so sánh ba framework mã nguồn mở phổ biến: AutoGen, CrewAI và LlamaIndex.

AutoGen nổi bật với khả năng tạo ra các cuộc trò chuyện linh hoạt giữa nhiều Agent. Nó tập trung vào việc mô phỏng giao tiếp giữa con người và Agent, hoặc giữa các Agent với nhau, cho phép chúng tự động giải quyết vấn đề thông qua đối thoại và thực thi code. AutoGen rất mạnh mẽ khi bạn cần một hệ thống Agent có khả năng tự động phản hồi, điều chỉnh và học hỏi trong quá trình làm việc. Nó cung cấp một mức độ tự do cao trong việc định nghĩa hành vi của Agent và cách chúng tương tác. Tuy nhiên, điều này cũng có nghĩa là bạn cần nhiều nỗ lực hơn để định nghĩa các quy trình phức tạp.

CrewAI, mặt khác, được thiết kế để xây dựng "đội ngũ" Agent với các vai trò, mục tiêu và công cụ được xác định rõ ràng, sau đó giao cho chúng các tác vụ cụ thể trong một quy trình làm việc có cấu trúc. CrewAI lý tưởng cho các workflow có tính tuần tự hoặc song song rõ ràng, nơi mỗi Agent có một chuyên môn riêng và chuyển giao công việc cho nhau. Nó cung cấp một cách tiếp cận có cấu trúc hơn so với AutoGen, giúp dễ dàng quản lý các workflow phức tạp với nhiều bước. Nếu bạn cần một hệ thống nơi các Agent cộng tác để tạo ra một sản phẩm cuối cùng theo một quy trình cụ thể, CrewAI sẽ là lựa chọn phù hợp. Nó giúp giảm 20-30% thời gian thiết lập so với việc tự xây dựng từ đầu.

LlamaIndex không phải là một framework xây dựng Agent theo nghĩa truyền thống, mà là một công cụ hỗ trợ mạnh mẽ cho các Agent. Chức năng chính của nó là kết nối LLM với dữ liệu tùy chỉnh của bạn, cho phép Agent có kiến thức sâu rộng hơn ngoài dữ liệu huấn luyện của LLM. LlamaIndex cung cấp các công cụ để tải, lập chỉ mục và truy vấn dữ liệu từ nhiều nguồn khác nhau. Khi kết hợp với AutoGen hoặc CrewAI, LlamaIndex trở thành một "công cụ" quan trọng cho các Agent, giúp chúng truy xuất thông tin chính xác và cập nhật. Ví dụ, một Agent trong CrewAI có thể sử dụng LlamaIndex để tìm kiếm thông tin trong cơ sở dữ liệu nội bộ trước khi thực hiện một tác vụ. Theo các nhà phát triển, LlamaIndex có thể tăng độ chính xác của câu trả lời lên đến 50% khi xử lý các truy vấn dựa trên dữ liệu riêng.

Tóm lại, nếu bạn cần sự linh hoạt cao và khả năng tự động điều chỉnh thông qua đối thoại, hãy chọn AutoGen. Nếu bạn muốn xây dựng các workflow có cấu trúc với các Agent chuyên biệt, CrewAI là lựa chọn tốt. Và nếu Agent của bạn cần truy cập và hiểu dữ liệu riêng, LlamaIndex là một công cụ không thể thiếu, thường được tích hợp cùng với AutoGen hoặc CrewAI để tăng cường khả năng của chúng. Trong nhiều trường hợp, sự kết hợp của các framework này sẽ mang lại giải pháp toàn diện nhất cho AI workflow tự động.

Các Lưu Ý Quan Trọng

- Chi phí vận hành: Việc sử dụng các mô hình LLM tiên tiến như GPT-4 trong các workflow tự động có thể tốn kém đáng kể, đặc biệt khi các Agent thực hiện nhiều lượt gọi API. Cần giám sát chặt chẽ token usage và tối ưu hóa prompts để giảm thiểu chi phí. Dữ liệu thực tế cho thấy chi phí có thể lên đến vài trăm USD mỗi tháng cho các workflow phức tạp nếu không được quản lý tốt.

- Độ trễ và hiệu suất: Các workflow tự động có thể gặp phải độ trễ do thời gian phản hồi của LLM API. Đối với các ứng dụng yêu cầu thời gian thực, cần cân nhắc kỹ hoặc sử dụng các mô hình LLM nhỏ hơn, được tối ưu hóa cho tốc độ.

- "Hallucinations" của LLM: LLM đôi khi có thể tạo ra thông tin không chính xác hoặc không có thật (hallucinations). Cần có các cơ chế kiểm tra và xác thực kết quả đầu ra của Agent, đặc biệt là khi chúng tạo code hoặc đưa ra quyết định quan trọng. Việc tích hợp các bước kiểm tra tự động hoặc sự giám sát của con người là cần thiết.

- Phức tạp trong Debugging: Khi một workflow tự động gặp lỗi, việc xác định nguyên nhân có thể phức tạp do sự tương tác giữa nhiều Agent và các công cụ khác nhau. Logging chi tiết và các công cụ theo dõi là rất quan trọng để debug hiệu quả.

- Sự phụ thuộc vào API và dịch vụ bên thứ ba: Các framework này thường dựa vào API của các nhà cung cấp LLM (như OpenAI). Bất kỳ sự thay đổi nào trong API hoặc gián đoạn dịch vụ đều có thể ảnh hưởng đến workflow của bạn. Cần có chiến lược dự phòng hoặc khả năng chuyển đổi giữa các nhà cung cấp.

- Quản lý phiên bản và môi trường: Khi phát triển các AI workflow, việc quản lý phiên bản code, cấu hình Agent và môi trường phát triển là rất quan trọng để đảm bảo tính nhất quán và khả năng tái tạo. Sử dụng Git và các công cụ quản lý package như

pipenvhoặcpoetry. - Đạo đức và trách nhiệm: Khi xây dựng các hệ thống AI Agent tự động, cần xem xét các vấn đề đạo đức và trách nhiệm. Đảm bảo rằng các Agent không tạo ra nội dung có hại, phân biệt đối xử, hoặc vi phạm quyền riêng tư.

Câu Hỏi Thường Gặp

AI Agent có thể thay thế hoàn toàn lập trình viên không?

Không, AI Agent không thể thay thế hoàn toàn lập trình viên trong tương lai gần. Thay vào đó, chúng là những công cụ mạnh mẽ giúp tăng cường năng suất và khả năng của lập trình viên. AI Agent có thể tự động hóa các tác vụ lặp đi lặp lại, sinh code boilerplate, hoặc hỗ trợ debug, nhưng chúng vẫn cần sự hướng dẫn, giám sát và khả năng tư duy sáng tạo của con người để giải quyết các vấn đề phức tạp, thiết kế hệ thống và đưa ra các quyết định chiến lược.

Làm thế nào để kiểm soát chất lượng code được sinh ra bởi AI Agent?

Kiểm soát chất lượng code từ AI Agent đòi hỏi một chiến lược đa tầng. Đầu tiên, hãy cung cấp các prompt rõ ràng và chi tiết để hướng dẫn Agent. Thứ hai, tích hợp các Agent kiểm thử tự động (ví dụ: Agent chạy unit tests, static code analysis) vào workflow. Thứ ba, cho phép các Agent tự sửa lỗi dựa trên kết quả kiểm thử. Cuối cùng, luôn có một bước review code bởi con người trước khi triển khai, đặc biệt đối với các phần code quan trọng. Theo thống kê, việc kết hợp AI với review của con người có thể giảm 60% lỗi trong giai đoạn đầu phát triển.

Có cần kiến thức chuyên sâu về AI/Machine Learning để sử dụng các framework này không?

Không nhất thiết phải có kiến thức chuyên sâu về AI/Machine Learning để bắt đầu sử dụng các framework như AutoGen hay CrewAI. Các framework này được thiết kế để trừu tượng hóa phần lớn sự phức tạp của LLM, cho phép bạn tập trung vào việc định nghĩa logic nghiệp vụ, vai trò của Agent và quy trình làm việc. Tuy nhiên, việc hiểu biết cơ bản về cách LLM hoạt động và cách viết prompt hiệu quả sẽ giúp bạn tận dụng tối đa khả năng của chúng và debug hiệu quả hơn.

Kết Luận

AI Agent tự động hóa workflow đang mở ra những cánh cửa mới cho tốc độ và hiệu quả trong phát triển phần mềm. Với các công cụ mã nguồn mở mạnh mẽ như AutoGen, CrewAI và LlamaIndex, các nhà phát triển có thể biến ý tưởng thành code "siêu tốc", tối ưu hóa các quy trình từ nghiên cứu đến triển khai. Việc áp dụng các Best Practices và hiểu rõ ưu nhược điểm của từng công cụ sẽ giúp bạn xây dựng các hệ thống AI Agent mạnh mẽ, đáng tin cậy và tiết kiệm chi phí.

Tương lai của lập trình sẽ ngày càng gắn liền với sự hợp tác giữa con người và AI. Bằng cách tận dụng sức mạnh của vibe coding và các công cụ AI Agent mã nguồn mở, chúng ta không chỉ tăng tốc độ phát triển mà còn giải phóng tiềm năng sáng tạo của các lập trình viên, cho phép họ tập trung vào những thách thức phức tạp và đổi mới thực sự.