Giới Thiệu AutoGen Vibe Coding: Từ Zero Đến Hero Xây Dựng Đội Quân AI Agent Tối Ưu Tác Vụ

Chào mừng bạn đến với thế giới của AI Agent, nơi mà những tác vụ phức tạp nhất cũng có thể được tự động hóa và giải quyết một cách thông minh. Trong kỷ nguyên của trí tuệ nhân tạo, việc xây dựng các hệ thống AI không chỉ dừng lại ở việc tạo ra một mô hình duy nhất, mà còn là việc kiến tạo một "đội quân" các tác nhân AI (AI Agents) có khả năng cộng tác, giao tiếp và học hỏi lẫn nhau để đạt được mục tiêu chung. Bài viết về autogen agent này sẽ giúp bạn khám phá AutoGen – một framework mạnh mẽ từ Microsoft, cho phép bạn biến ý tưởng xây dựng đội quân AI Agent từ zero thành hero, tối ưu hóa mọi tác vụ từ đơn giản đến phức tạp.

AutoGen không chỉ là một thư viện, mà là một triết lý thiết kế, mở ra cánh cửa cho việc lập trình AI theo một cách hoàn toàn mới: lập trình đa tác nhân (multi-agent programming). Hãy cùng vibecoding.vin đào sâu vào cách AutoGen hoạt động, các thành phần cốt lõi và làm thế nào để bạn có thể bắt đầu hành trình xây dựng những giải pháp AI đột phá của riêng mình.

AutoGen là gì? Khái Niệm Đằng Sau Đội Quân AI Agent

AutoGen là một framework mã nguồn mở do Microsoft Research phát triển, được thiết kế để đơn giản hóa việc xây dựng các ứng dụng AI bằng cách cho phép nhiều AI Agent tương tác và cộng tác với nhau. Thay vì một AI duy nhất cố gắng giải quyết mọi thứ, AutoGen tạo ra một môi trường nơi các agent khác nhau, mỗi agent có một vai trò và khả năng riêng, có thể giao tiếp, trao đổi thông tin và phân công nhiệm vụ cho nhau. Điều này mô phỏng cách con người làm việc trong một nhóm, dẫn đến các giải pháp mạnh mẽ và linh hoạt hơn.

Cốt lõi của AutoGen là khả năng định nghĩa các agent với các vai trò cụ thể, như UserProxyAgent (đại diện cho người dùng, có thể thực thi code), AssistantAgent (đại diện cho một trợ lý AI, có thể sinh ra code hoặc kịch bản), hoặc các agent tùy chỉnh khác. Các agent này có thể "nói chuyện" với nhau thông qua tin nhắn, chia sẻ kết quả, và thậm chí tự động sửa lỗi hoặc cải thiện giải pháp. Điều này tạo ra một vòng lặp phản hồi liên tục, giúp hệ thống tự động tinh chỉnh và tối ưu hóa kết quả.

Sức mạnh của AutoGen nằm ở khả năng linh hoạt trong việc cấu hình các agent và luồng làm việc (workflow) giữa chúng. Bạn có thể xây dựng các kịch bản phức tạp, từ việc phân tích dữ liệu, tạo báo cáo, đến phát triển phần mềm hoặc thậm chí là thiết kế các giải pháp sáng tạo. Mỗi autogen agent có thể được trang bị các công cụ (tools) hoặc chức năng (functions) cụ thể, cho phép chúng thực hiện các tác vụ chuyên biệt, ví dụ như truy cập API, chạy lệnh terminal, hoặc tương tác với cơ sở dữ liệu. Điều này biến AutoGen thành một nền tảng cực kỳ mạnh mẽ để tự động hóa các quy trình kinh doanh và phát triển phần mềm.

Một điểm đáng chú ý khác là AutoGen hỗ trợ nhiều mô hình ngôn ngữ lớn (LLMs) khác nhau, cho phép bạn lựa chọn mô hình phù hợp nhất với nhu cầu và ngân sách của mình. Từ OpenAI GPT-4, GPT-3.5 đến các mô hình mã nguồn mở như Llama, bạn có thể dễ dàng tích hợp và thử nghiệm. Khả năng tương tác giữa các autogen agent không chỉ là gửi tin nhắn văn bản, mà còn là chia sẻ và thực thi code, điều này mở ra tiềm năng lớn cho các ứng dụng tự động hóa phức tạp, nơi AI không chỉ đưa ra ý tưởng mà còn trực tiếp triển khai chúng.

Hướng Dẫn Thực Hành: Xây Dựng Đội Quân AI Agent Đầu Tiên Với AutoGen

Để bắt đầu với AutoGen, bạn cần cài đặt thư viện và cấu hình môi trường. Hãy cùng vibecoding.vin từng bước xây dựng một đội quân AI Agent đơn giản để giải quyết một bài toán cụ thể.

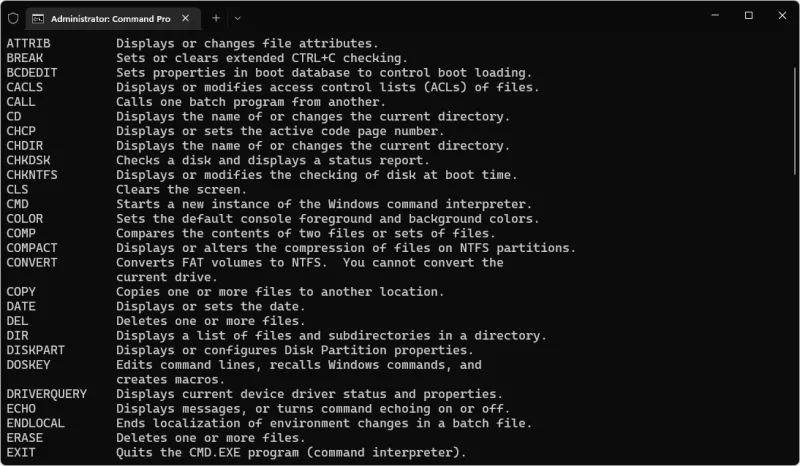

Bước 1: Cài đặt AutoGen và Cấu hình môi trường

Đầu tiên, hãy cài đặt AutoGen bằng pip:

pip install pyautogen~=0.2.0b5Tiếp theo, bạn cần cấu hình khóa API cho các mô hình ngôn ngữ lớn (LLMs). AutoGen hỗ trợ nhiều cách cấu hình, nhưng cách đơn giản nhất là tạo một file OAI_CONFIG_LIST (hoặc config_list_openai_aoai) trong thư mục làm việc của bạn hoặc sử dụng biến môi trường.

Ví dụ file OAI_CONFIG_LIST (dạng JSON):

[

{

"model": "gpt-4",

"api_key": "YOUR_OPENAI_API_KEY"

},

{

"model": "gpt-3.5-turbo",

"api_key": "YOUR_OPENAI_API_KEY"

}

]Hoặc nếu bạn sử dụng Azure OpenAI Service:

[

{

"model": "gpt-4",

"api_key": "YOUR_AZURE_OPENAI_API_KEY",

"api_base": "YOUR_AZURE_OPENAI_ENDPOINT",

"api_type": "azure",

"api_version": "2023-07-01-preview"

}

]Bạn cũng có thể cấu hình thông qua biến môi trường. Ví dụ, để sử dụng OpenAI API:

export OPENAI_API_KEY="YOUR_OPENAI_API_KEY"Bước 2: Xây dựng Đội Quân AI Agent Cơ Bản

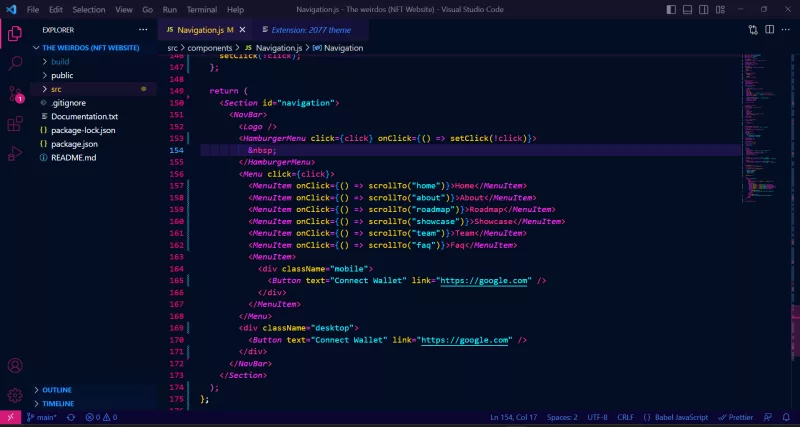

Chúng ta sẽ tạo hai agent: một UserProxyAgent đại diện cho người dùng và một AssistantAgent để hỗ trợ giải quyết vấn đề. Giả sử chúng ta muốn giải quyết bài toán tìm các số nguyên tố trong một khoảng nhất định.

import autogen

# Cấu hình LLM

config_list = autogen.config_list_from_json(

"OAI_CONFIG_LIST",

filter_dict={

"model": ["gpt-4", "gpt-3.5-turbo"], # Chọn các model bạn muốn sử dụng

},

)

# Khởi tạo UserProxyAgent

# human_input_mode="NEVER" để agent tự động phản hồi mà không cần input thủ công

# max_consecutive_auto_reply=10 để giới hạn số lần tự động trả lời liên tiếp

# code_execution_config={"work_dir": "coding", "use_docker": False} cho phép thực thi code

user_proxy = autogen.UserProxyAgent(

name="Admin",

system_message="A human admin. Interact with the Assistant to solve the task. Will execute code suggested by the Assistant.",

llm_config={"config_list": config_list},

code_execution_config={"work_dir": "coding", "use_docker": False}, # Cho phép thực thi code trong thư mục 'coding'

human_input_mode="NEVER",

max_consecutive_auto_reply=10,

)

# Khởi tạo AssistantAgent

assistant = autogen.AssistantAgent(

name="Assistant",

llm_config={"config_list": config_list},

system_message="You are a helpful AI assistant. You can write and execute Python code to solve problems. Be concise and precise.",

)

# Bắt đầu cuộc trò chuyện giữa các agent

user_proxy.initiate_chat(

assistant,

message="Find all prime numbers between 1 and 50. Output them as a Python list."

)Trong ví dụ này, user_proxy sẽ gửi yêu cầu đến assistant. assistant sẽ cố gắng viết code Python để tìm số nguyên tố. Nếu code có lỗi, user_proxy sẽ báo cáo lỗi và assistant sẽ cố gắng sửa lỗi. Quá trình này lặp lại cho đến khi nhiệm vụ hoàn thành.

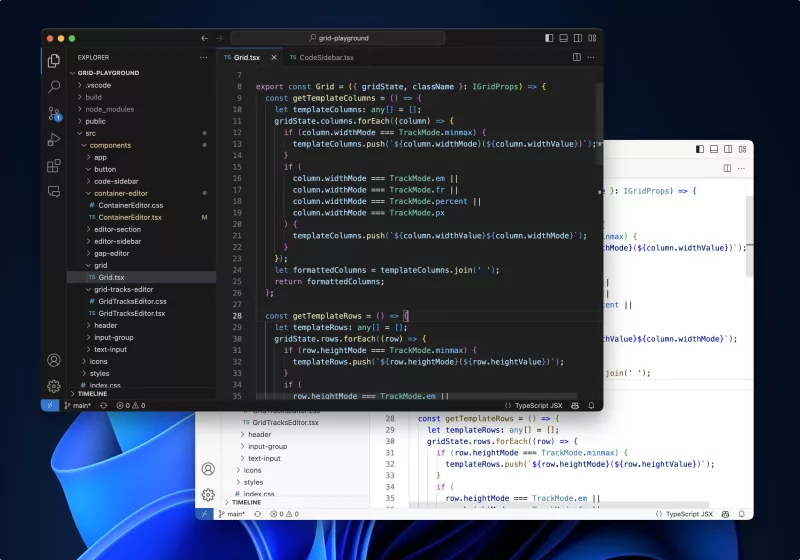

Bước 3: Mở Rộng Với Nhiều Agent Hơn và Các Chức Năng Phức Tạp

AutoGen thực sự tỏa sáng khi bạn có nhiều agent với các vai trò chuyên biệt. Hãy tưởng tượng một kịch bản phức tạp hơn: Phân tích dữ liệu từ một file CSV và tạo biểu đồ.

import autogen

import os

# Đảm bảo thư mục 'coding' tồn tại

if not os.path.exists("coding"):

os.makedirs("coding")

# Cấu hình LLM (giống như trên)

config_list = autogen.config_list_from_json(

"OAI_CONFIG_LIST",

filter_dict={

"model": ["gpt-4", "gpt-3.5-turbo"],

},

)

# Agent phân tích dữ liệu

data_analyst = autogen.AssistantAgent(

name="DataAnalyst",

llm_config={"config_list": config_list},

system_message="You are a data analyst. You can write Python code to analyze data and create visualizations. You will receive data from the DataEngineer and provide insights to the ReportGenerator.",

)

# Agent kỹ sư dữ liệu (có thể giả lập việc đọc file)

data_engineer = autogen.AssistantAgent(

name="DataEngineer",

llm_config={"config_list": config_list},

system_message="You are a data engineer. Your task is to prepare data for the DataAnalyst. If a CSV file is mentioned, you will provide a sample or simulate its content if it doesn't exist.",

)

# Agent tạo báo cáo

report_generator = autogen.AssistantAgent(

name="ReportGenerator",

llm_config={"config_list": config_list},

system_message="You are a report generator. You will take the analysis results from the DataAnalyst and summarize them into a concise report. You may ask the DataAnalyst for specific charts or summaries.",

)

# Agent người dùng để điều phối và thực thi code

user_proxy = autogen.UserProxyAgent(

name="Admin",

system_message="A human admin. Coordinate the DataEngineer, DataAnalyst, and ReportGenerator to analyze the data and create a report. Execute any code suggested by the agents.",

llm_config={"config_list": config_list},

code_execution_config={"work_dir": "coding", "use_docker": False},

human_input_mode="NEVER",

max_consecutive_auto_reply=15,

)

# Định nghĩa nhóm agent và luồng làm việc

group_chat = autogen.GroupChat(

agents=[user_proxy, data_analyst, data_engineer, report_generator],

messages=[],

max_round=20,

speaker_selection_method="auto", # Tự động chọn agent nói tiếp theo

)

manager = autogen.GroupChatManager(group_chat=group_chat, llm_config={"config_list": config_list})

# Bắt đầu cuộc trò chuyện nhóm

user_proxy.initiate_chat(

manager,

message="I need to analyze sales data from a CSV file named 'sales_data.csv'. "

"Please find the total sales per month and generate a bar chart. "

"Then, summarize the key findings in a report. "

"If 'sales_data.csv' doesn't exist, create a dummy one with columns 'Month', 'Product', 'Sales'."

)Trong kịch bản này:

Admin(user_proxy) đưa ra yêu cầu ban đầu.DataEngineercó thể được yêu cầu tạo filesales_data.csvgiả nếu nó không tồn tại.DataAnalystsẽ đọc file, viết code Python để tính toán tổng doanh số theo tháng và tạo biểu đồ.ReportGeneratorsẽ tổng hợp kết quả và tạo báo cáo.

Đây là một ví dụ mạnh mẽ về cách các autogen agent có thể cộng tác để giải quyết các tác vụ phức tạp, phân chia công việc một cách tự động và tận dụng khả năng chuyên môn của từng agent.

Tips và Best Practices Khi Sử Dụng AutoGen

Để tận dụng tối đa AutoGen và xây dựng các đội quân AI Agent hiệu quả, dưới đây là một số tips và best practices từ kinh nghiệm thực tế của vibecoding.vin:

- Định nghĩa rõ ràng vai trò (

system_message) cho từng Agent: Đây là yếu tố quan trọng nhất. Mộtsystem_messagemạch lạc, cụ thể sẽ giúp agent hiểu rõ nhiệm vụ, phạm vi trách nhiệm và cách thức tương tác với các agent khác. Ví dụ: "You are a Python expert. Your job is to write correct and efficient Python code. Do not output anything else but code." - Sử dụng

UserProxyAgentmột cách chiến lược:UserProxyAgentkhông chỉ là cầu nối với người dùng mà còn là agent có khả năng thực thi code. Hãy tận dụng nó để kiểm tra, debug và xác nhận kết quả của các agent khác. Điều này đặc biệt hữu ích khi các agent cần chạy script hoặc tương tác với môi trường bên ngoài. - Kiểm soát số lượng và loại LLM: Không phải mọi agent đều cần LLM mạnh nhất. Đối với các tác vụ đơn giản, bạn có thể sử dụng các mô hình nhỏ hơn, tiết kiệm chi phí hơn. AutoGen cho phép bạn cấu hình

llm_configriêng cho từng agent hoặc dùng chung một danh sách cấu hình. - Sử dụng

GroupChatvàGroupChatManagercho các tác vụ phức tạp: Khi có nhiều hơn hai agent cần phối hợp,GroupChatlà cách hiệu quả để quản lý luồng hội thoại.GroupChatManagersẽ tự động điều phối ai là người nói tiếp theo, dựa trênspeaker_selection_method(ví dụ:"auto"). - Cấu hình

code_execution_configan toàn: Khi cho phép agent thực thi code, hãy luôn cân nhắc yếu tố bảo mật. Sử dụng"work_dir"để giới hạn khu vực làm việc của code và cân nhắc sử dụng Docker ("use_docker": True) để tạo môi trường sandbox, cách ly quá trình thực thi code khỏi hệ thống chính. - Tận dụng

function_calling: AutoGen hỗ trợfunction_calling, cho phép agent gọi các hàm Python đã định nghĩa trước. Điều này rất mạnh mẽ để kết nối các agent với các công cụ bên ngoài, API hoặc các logic nghiệp vụ phức tạp mà không cần agent tự sinh ra toàn bộ code. - Kiểm soát

max_consecutive_auto_replyvàmax_round: Để tránh vòng lặp vô hạn hoặc tiêu tốn quá nhiều token, hãy đặt giới hạn cho số lần phản hồi tự động liên tiếp của một agent (max_consecutive_auto_reply) và tổng số vòng hội thoại trongGroupChat(max_round).

AutoGen So Sánh Với Các Framework AI Agent Khác

Thị trường AI Agent đang bùng nổ với nhiều framework khác nhau, mỗi framework có những ưu và nhược điểm riêng. Vậy AutoGen nổi bật như thế nào?

AutoGen vs. LangChain: LangChain là một framework rất phổ biến, tập trung vào việc xây dựng các ứng dụng LLM phức tạp thông qua việc xâu chuỗi các thành phần (chains), agents và công cụ (tools). Trong khi LangChain mạnh về việc kết nối LLM với các nguồn dữ liệu và công cụ, AutoGen lại tập trung sâu hơn vào mô hình tương tác đa tác nhân (multi-agent conversation). AutoGen coi trọng vai trò của "cuộc trò chuyện" giữa các agent, nơi mỗi agent có thể là một LLM, một công cụ, hoặc một người dùng. Điều này cho phép AutoGen xử lý các tác vụ yêu cầu sự cộng tác, phản hồi và sửa lỗi tự động một cách linh hoạt hơn. LangChain có thể tạo ra các agent hoạt động độc lập hoặc theo một luồng định trước, còn AutoGen thì tạo ra một hệ sinh thái các agent có thể tự động điều phối và thích ứng với tình huống.

AutoGen vs. CrewAI: CrewAI là một framework mới hơn, được xây dựng dựa trên LangChain, tập trung đặc biệt vào việc tạo ra "crews" (đội) các AI Agent với các vai trò, công cụ và nhiệm vụ cụ thể. CrewAI có một cấu trúc rất trực quan cho việc định nghĩa các agent, nhiệm vụ và quá trình (process) để các agent làm việc cùng nhau. So với AutoGen, CrewAI có thể cung cấp một API cấu trúc hơn và dễ tiếp cận hơn cho việc định nghĩa luồng làm việc nhóm. Tuy nhiên, AutoGen lại mang đến một mức độ linh hoạt cao hơn trong việc tùy chỉnh hành vi của từng agent và cách chúng tương tác ở cấp độ thấp hơn, cho phép kiểm soát chi tiết hơn về quá trình hội thoại và ra quyết định. AutoGen cũng có thể được coi là một framework "nguyên thủy" hơn, nơi bạn có thể xây dựng các cơ chế tương tự CrewAI lên trên nó.

Ưu điểm nổi bật của AutoGen:

- Khả năng tương tác đa tác nhân mạnh mẽ: Đây là điểm khác biệt lớn nhất. AutoGen được thiết kế từ đầu để các agent "nói chuyện" với nhau, chia sẻ thông tin, và cùng nhau giải quyết vấn đề.

- Thực thi code tự động:

UserProxyAgentcó khả năng thực thi code Python hoặc shell script mà các agent khác sinh ra, giúp kiểm tra và xác nhận giải pháp một cách tự động. - Linh hoạt trong cấu hình: Dễ dàng cấu hình các LLM khác nhau, vai trò của agent, và luồng làm việc.

- Khả năng tự sửa lỗi và tối ưu hóa: Do tính chất hội thoại và phản hồi, các agent có thể tự động phát hiện lỗi và đề xuất sửa chữa, dẫn đến các giải pháp mạnh mẽ hơn.

Tóm lại, nếu bạn muốn xây dựng các hệ thống AI nơi các tác nhân cần cộng tác chặt chẽ, tranh luận, và tự động thực thi các hành động dựa trên kết quả của nhau, AutoGen là một lựa chọn cực kỳ mạnh mẽ. Các framework khác có thể phù hợp hơn cho các tác vụ đơn luồng hoặc khi bạn cần một cấu trúc định sẵn cho việc xâu chuỗi các công cụ.

Các Lưu Ý Quan Trọng

- Chi phí API: Việc chạy nhiều LLM agent có thể tiêu tốn nhiều token và dẫn đến chi phí API cao, đặc biệt với các mô hình mạnh như GPT-4. Hãy theo dõi việc sử dụng API của bạn và tối ưu hóa cấu hình LLM khi cần.

- Vòng lặp vô hạn: Các cuộc trò chuyện giữa các agent đôi khi có thể rơi vào vòng lặp vô hạn nếu không được cấu hình cẩn thận. Sử dụng

max_consecutive_auto_replyvàmax_roundlà rất quan trọng để ngăn chặn điều này. - Kiểm soát chất lượng đầu ra: Mặc dù các agent có thể tự sửa lỗi, chất lượng đầu ra cuối cùng vẫn phụ thuộc vào chất lượng của các prompt (

system_message) và khả năng của LLM. Luôn kiểm tra và tinh chỉnh các prompt của bạn. - Bảo mật khi thực thi code: Việc cho phép AI tự động thực thi code tiềm ẩn rủi ro bảo mật. Luôn chạy code trong môi trường an toàn (sandbox, Docker) và chỉ cho phép thực thi những loại code đã được kiểm duyệt.

- Độ phức tạp của luồng làm việc: Khi số lượng agent và độ phức tạp của tác vụ tăng lên, việc thiết kế và debug luồng làm việc có thể trở nên khó khăn. Bắt đầu với các kịch bản đơn giản và tăng dần độ phức tạp.

- Tối ưu hóa prompt engineering: Giống như với bất kỳ ứng dụng LLM nào, prompt engineering đóng vai trò then chốt. Hãy thử nghiệm các cách diễn đạt khác nhau trong

system_messageđể đạt được hành vi mong muốn từ cácautogen agent. - Hiểu rõ giới hạn của LLM: Các LLM vẫn có những hạn chế về khả năng suy luận logic, kiến thức cập nhật và khả năng sáng tạo thực sự. Đừng mong đợi các agent giải quyết mọi vấn đề một cách hoàn hảo mà không cần sự giám sát của con người, đặc biệt là trong các tác vụ quan trọng.

Câu Hỏi Thường Gặp

AutoGen có miễn phí không?

Có, AutoGen là một framework mã nguồn mở hoàn toàn miễn phí để sử dụng. Tuy nhiên, việc sử dụng các mô hình ngôn ngữ lớn (LLMs) như GPT-4 thông qua API của OpenAI hoặc Azure OpenAI Service sẽ phát sinh chi phí dựa trên số lượng token bạn sử dụng.

Tôi có cần kiến thức về AI để sử dụng AutoGen không?

Để bắt đầu với AutoGen, bạn không nhất thiết phải là chuyên gia AI sâu rộng. Tuy nhiên, việc có kiến thức cơ bản về lập trình Python, cách hoạt động của LLMs và khái niệm về prompt engineering sẽ giúp bạn xây dựng và tối ưu hóa các agent hiệu quả hơn.

AutoGen có thể hoạt động với các mô hình LLM mã nguồn mở (Open-source LLMs) không?

Tuyệt vời! AutoGen có khả năng tương thích cao và hỗ trợ tích hợp với nhiều mô hình LLM mã nguồn mở khác nhau. Bạn có thể cấu hình AutoGen để sử dụng các mô hình này thông qua các API như Hugging Face Transformers hoặc các server LLM cục bộ như LiteLLM hoặc Ollama, mở rộng khả năng và giảm chi phí.

Làm thế nào để debug một hệ thống AutoGen khi gặp lỗi?

Debugging một hệ thống AutoGen có thể phức tạp do tính chất tương tác giữa nhiều agent. Bạn nên kiểm tra log của cuộc trò chuyện giữa các agent, xem xét các thông báo lỗi từ việc thực thi code, và điều chỉnh system_message hoặc logic của agent để khắc phục vấn đề. Việc cấu hình human_input_mode="ALWAYS" tạm thời cũng có thể giúp bạn theo dõi và can thiệp vào cuộc trò chuyện.

AutoGen có thể được sử dụng cho các ứng dụng thực tế nào?

AutoGen có tiềm năng ứng dụng rộng rãi trong nhiều lĩnh vực. Ví dụ, nó có thể được dùng để tự động hóa phát triển phần mềm (từ yêu cầu đến code, test), phân tích dữ liệu và tạo báo cáo, quản lý dự án, nghiên cứu và phát triển sản phẩm, hoặc thậm chí là tạo ra các chatbot thông minh hơn với khả năng suy luận và thực hiện hành động.

Kết Luận

AutoGen thực sự là một bước tiến mạnh mẽ trong lĩnh vực phát triển AI, mang đến một cách tiếp cận mới để xây dựng các giải pháp thông minh thông qua sự cộng tác của nhiều AI Agent. Từ việc tự động hóa các tác vụ đơn giản đến giải quyết các vấn đề phức tạp đòi hỏi sự phối hợp đa chiều, AutoGen mở ra cánh cửa cho một kỷ nguyên mới của lập trình AI.

Với khả năng định nghĩa vai trò, tương tác linh hoạt, và thực thi code tự động, bạn có thể biến những ý tưởng táo bạo thành hiện thực, xây dựng những "đội quân" AI Agent của riêng mình. Hãy bắt đầu thử nghiệm, khám phá và tạo ra những ứng dụng đột phá. Đừng ngần ngại chia sẻ những trải nghiệm của bạn và cùng cộng đồng vibe coding xây dựng tương lai của AI!