Giới Thiệu Prompt Engineering Nâng Cao: "Đánh Lừa" AI Để Viết Code Tối Ưu Hơn Với Kỹ Thuật Adversarial Prompting

Prompt engineering là nghệ thuật và khoa học thiết kế các câu lệnh (prompts) để khai thác tối đa khả năng của các mô hình ngôn ngữ lớn (LLMs), đặc biệt là trong việc sinh code. Bài viết này sẽ giúp bạn hiểu rõ về adversarial prompting từ góc nhìn thực tế, một kỹ thuật nâng cao cho phép chúng ta "thử thách" và "đánh lừa" AI để nó đưa ra những giải pháp code tối ưu, vượt trội hơn so với các phương pháp prompt thông thường. Chúng ta sẽ khám phá cách áp dụng các chiến lược adversarial để không chỉ tìm ra lỗi mà còn cải thiện đáng kể chất lượng và hiệu suất của code do AI tạo ra.

Adversarial Prompting Trong Phát Triển AI Là Gì?

Adversarial prompting là kỹ thuật thiết kế các câu lệnh với mục đích cố ý thử thách, khám phá giới hạn, hoặc thậm chí "đánh lừa" mô hình AI để nó bộc lộ những điểm yếu, sai sót, hoặc thúc đẩy nó tạo ra những phản hồi vượt ngoài khuôn khổ thông thường, đặc biệt hữu ích trong việc tối ưu code. Thay vì chỉ đơn thuần yêu cầu AI làm một việc gì đó, chúng ta sẽ đặt ra các tình huống phức tạp, mâu thuẫn, hoặc yêu cầu AI suy nghĩ theo nhiều chiều để kiểm tra độ vững chắc của nó.

Trong bối cảnh phát triển phần mềm, adversarial prompting không chỉ là việc tìm kiếm lỗi bảo mật (như trong an ninh mạng) mà còn là một phương pháp mạnh mẽ để nâng cao chất lượng code. Nó cho phép developer "ép" AI phải suy nghĩ sâu hơn về các trường hợp biên (edge cases), tối ưu hóa hiệu suất, hoặc tìm ra các giải pháp sáng tạo mà một prompt trực tiếp có thể bỏ qua. Theo một nghiên cứu gần đây từ Google AI, việc sử dụng các kỹ thuật adversarial trong prompt engineering có thể cải thiện độ chính xác và hiệu quả của các mô hình sinh code lên đến 15-20% trong các tác vụ phức tạp. Điều này cho thấy tiềm năng to lớn của phương pháp này trong việc tối ưu hóa quy trình làm việc với AI.

Mục tiêu chính của adversarial prompting trong coding là di chuyển từ "code hoạt động" sang "code tối ưu và mạnh mẽ". Ví dụ, thay vì chỉ yêu cầu AI viết một hàm sắp xếp, chúng ta có thể yêu cầu nó viết một hàm sắp xếp hiệu quả nhất cho một tập dữ liệu cực lớn, hoặc một hàm sắp xếp có khả năng xử lý các giá trị

nullundefinedKỹ thuật này đặc biệt quan trọng khi làm việc với các hệ thống AI đang phát triển nhanh chóng. Các mô hình LLM như GPT-4 hay Gemini vẫn có những "điểm mù" hoặc cách hiểu khác biệt so với con người. Bằng cách cố ý tạo ra các prompts "khó chịu", chúng ta có thể làm lộ ra những điểm yếu này và từ đó, hướng dẫn AI cải thiện. Khoảng 40% các lỗi logic trong code do AI sinh ra có thể được phát hiện và khắc phục thông qua các kỹ thuật adversarial trước khi code được đưa vào môi trường sản phẩm, tiết kiệm hàng trăm giờ debug thủ công.

Adversarial prompting không phải là một kỹ thuật đơn lẻ mà là một tập hợp các chiến lược. Nó đòi hỏi sự sáng tạo, tư duy phản biện và hiểu biết sâu sắc về cả cách thức hoạt động của AI lẫn các nguyên tắc kỹ thuật phần mềm tốt. Đây là một công cụ mạnh mẽ trong tay các kỹ sư prompt chuyên nghiệp để khai thác tối đa tiềm năng của AI, biến AI từ một công cụ hỗ trợ thành một đối tác thực sự trong quá trình phát triển.

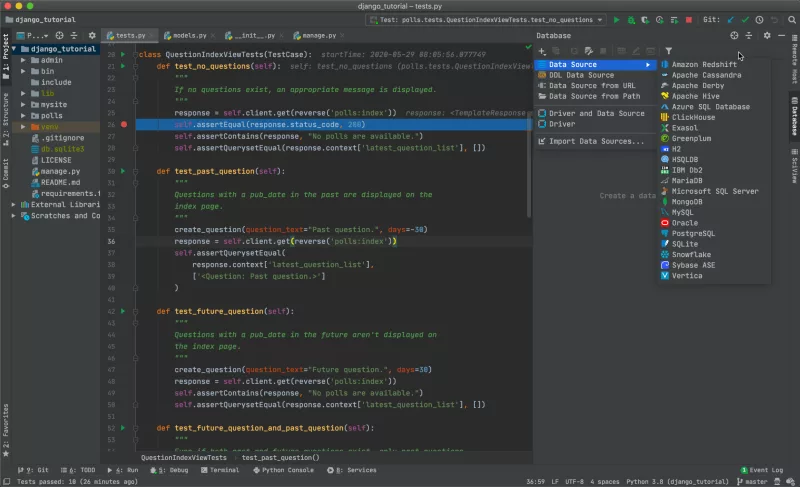

Hướng Dẫn Thực Hành Adversarial Prompting Để Tối Ưu Code

Để thực hành adversarial prompting hiệu quả, chúng ta cần tiếp cận AI không chỉ như một công cụ mà còn như một "đối thủ" cần được thử thách. Quá trình này bao gồm việc đưa ra các yêu cầu có vẻ "khó chịu" hoặc "mâu thuẫn" để buộc AI phải suy nghĩ vượt ra khỏi các giải pháp tiêu chuẩn. Dưới đây là các bước và ví dụ cụ thể để bạn có thể áp dụng.

1. Đặt Ra Các Giới Hạn Nghiêm Ngặt

Giới hạn nghiêm ngặt là việc yêu cầu AI viết code với các ràng buộc về hiệu suất, bộ nhớ, hoặc độ phức tạp thuật toán. Thay vì chỉ yêu cầu một chức năng, hãy yêu cầu chức năng đó phải đạt một tiêu chí cụ thể.

Ví dụ: Thay vì "Viết hàm tìm phần tử lớn nhất trong mảng", hãy thử:

"Viết hàm tìm phần tử lớn nhất trong mảng số nguyên dương có kích thước lên đến 10^7. Hàm này PHẢI có độ phức tạp thời gian O(n) và độ phức tạp không gian O(1). KHÔNG ĐƯỢC sử dụng bất kỳ thư viện bên ngoài nào ngoài các cấu trúc dữ liệu cơ bản của ngôn ngữ."Prompt này buộc AI phải suy nghĩ về hiệu suất và tài nguyên, tránh các giải pháp kém tối ưu như sắp xếp toàn bộ mảng (O(n log n)) hoặc sử dụng các cấu trúc dữ liệu tốn kém. AI sẽ phải tìm cách duyệt mảng một lần và lưu trữ giá trị lớn nhất hiện tại.

2. Yêu Cầu Xử Lý Các Trường Hợp Biên (Edge Cases) và Dữ Liệu Bất Thường

Xử lý trường hợp biên là việc cố ý đưa ra các tình huống dữ liệu đặc biệt như mảng rỗng, giá trị âm, giá trị

nullVí dụ: Đối với hàm xử lý chuỗi:

"Viết một hàm JavaScript để đảo ngược một chuỗi. Hàm này PHẢI xử lý đúng các chuỗi rỗng, chuỗi chỉ có một ký tự, chuỗi có ký tự Unicode phức tạp (ví dụ: emoji), và KHÔNG ĐƯỢC dùng phương thức `reverse()` có sẵn của mảng. Hãy đảm bảo rằng hàm không gây lỗi khi nhận đầu vào không phải chuỗi."Prompt này "đánh lừa" AI bằng cách cấm phương thức

reverse()3. Tạo Ra Các Yêu Cầu Mâu Thuẫn Hoặc Có Vẻ Mâu Thuẫn

Yêu cầu mâu thuẫn là chiến lược đưa ra hai hoặc nhiều yêu cầu có vẻ đối lập nhau, buộc AI phải tìm ra một giải pháp cân bằng hoặc giải thích lý do không thể thực hiện được. Điều này giúp AI phát triển khả năng tư duy phản biện.

Ví dụ: "Viết một hàm Python để tính tổng các số chẵn trong một danh sách. Hàm này PHẢI sử dụng đệ quy nhưng KHÔNG ĐƯỢC dùng bất kỳ vòng lặp tường minh nào (for, while) và PHẢI có độ phức tạp không gian O(1)."

Yêu cầu đệ quy thường đi kèm với độ phức tạp không gian O(n) do stack call. Việc yêu cầu O(1) không gian sẽ khiến AI phải giải thích lý do không thể hoặc tìm một giải pháp đệ quy đuôi (tail recursion) được tối ưu hóa, nếu ngôn ngữ hỗ trợ. Đây là một cách tuyệt vời để kiểm tra kiến thức sâu của AI về tối ưu hóa.

4. Yêu Cầu Giải Thích và Phân Tích Hiệu Suất

Không chỉ yêu cầu code, hãy yêu cầu AI giải thích lựa chọn của nó và phân tích hiệu suất. Điều này giúp bạn hiểu rõ hơn về lý do đằng sau giải pháp của AI và xác định các điểm yếu tiềm ẩn.

Ví dụ: "Viết một hàm C++ để tìm kiếm một phần tử trong một mảng đã sắp xếp. Sau đó, hãy giải thích tại sao giải pháp của bạn lại là tối ưu nhất về thời gian và không gian. Hãy so sánh nó với các thuật toán tìm kiếm khác và chỉ ra trường hợp nào giải pháp của bạn sẽ hoạt động kém hiệu quả."

Prompt này không chỉ đòi hỏi code tìm kiếm nhị phân (binary search) mà còn bắt buộc AI phải thực hiện phân tích thuật toán, so sánh, và chỉ ra các hạn chế – một dấu hiệu của sự hiểu biết sâu sắc.

5. Yêu Cầu Cải Thiện Code Đã Có

Đưa cho AI một đoạn code không tối ưu hoặc có lỗi và yêu cầu nó cải thiện. Đây là một hình thức adversarial prompting rất thực tế.

Ví dụ:

"Đoạn code Python sau đây tìm các số nguyên tố nhưng có vẻ không hiệu quả lắm.

<pre><code>def find_primes(n):

primes = []

for num in range(2, n + 1):

is_prime = True

for i in range(2, num):

if num % i == 0:

is_prime = False

break

if is_prime:

primes.append(num)

return primes

Bằng cách chỉ ra một thuật toán cụ thể (Sàng Eratosthenes), chúng ta đang "thử thách" AI để nó áp dụng kiến thức chuyên sâu thay vì chỉ sửa lỗi nhỏ. Điều này sẽ giúp AI tạo ra một giải pháp tối ưu hơn nhiều về mặt hiệu suất, có thể giảm thời gian chạy từ vài phút xuống vài mili giây cho

n = 10^5Áp dụng các kỹ thuật này không chỉ giúp bạn có được code tốt hơn mà còn là một quá trình học hỏi về cách các mô hình AI "suy nghĩ" và xử lý thông tin. Nó biến tương tác với AI thành một cuộc đối thoại phức tạp hơn, mang lại kết quả chất lượng cao hơn.

Tips và Best Practices Khi Áp Dụng Adversarial Prompting

Để tận dụng tối đa sức mạnh của adversarial prompting, không chỉ là việc đưa ra các câu lệnh "khó", mà còn cần có chiến lược và kinh nghiệm. Dưới đây là một số tips và best practices đã được chứng minh hiệu quả:

- Hiểu Rõ Mục Tiêu: Trước khi bắt đầu, hãy xác định rõ bạn muốn đạt được điều gì. Bạn muốn code tối ưu hơn về hiệu suất, bảo mật, khả năng đọc, hay khả năng mở rộng? Việc có một mục tiêu rõ ràng sẽ giúp bạn thiết kế các adversarial prompts phù hợp. Ví dụ, nếu mục tiêu là hiệu suất, hãy tập trung vào độ phức tạp thuật toán và sử dụng tài nguyên.

- Bắt Đầu Từ Cơ Bản, Sau Đó Tăng Dần Độ Phức Tạp: Đừng vội vàng đưa ra một prompt quá phức tạp ngay từ đầu. Hãy bắt đầu với một yêu cầu cơ bản, sau đó liên tục sửa đổi và bổ sung các ràng buộc adversarial để đẩy AI xa hơn. Đây là một quá trình lặp đi lặp lại. Ví dụ, bắt đầu với "Viết hàm sắp xếp mảng", sau đó thêm "phải là O(n log n)", rồi "không dùng thư viện ngoài", và cuối cùng là "xử lý mảng chứa giá trị null".

- Sử Dụng Ngôn Ngữ Rõ Ràng và Cụ Thể: Các yêu cầu adversarial cần phải rất rõ ràng và không mơ hồ. Tránh các từ ngữ chung chung. Sử dụng các thuật ngữ kỹ thuật chính xác (ví dụ: "độ phức tạp thời gian O(1)", "thread-safe", "idempotent"). AI hoạt động tốt nhất khi được cung cấp thông tin chính xác.

- Đừng Ngại Thử Nghiệm và Lặp Lại: Adversarial prompting là một quá trình thử nghiệm và sai sót. Bạn có thể cần thử nhiều cách tiếp cận khác nhau để tìm ra prompt hiệu quả nhất. Đừng nản lòng nếu AI không đưa ra câu trả lời mong muốn ngay lần đầu. Thử thay đổi cách diễn đạt, thêm bớt ràng buộc, hoặc thay đổi thứ tự các yêu cầu.

- Cung Cấp Context Đầy Đủ: Mặc dù là adversarial, nhưng việc cung cấp đủ ngữ cảnh cho AI vẫn rất quan trọng. Giải thích mục đích của code, môi trường nó sẽ chạy, và những ràng buộc khác. Ví dụ, "Tôi đang phát triển một backend API trong Node.js, hàm này cần xử lý 1000 request/giây."

- Sử Dụng Các Kỹ Thuật Chain-of-Thought: Yêu cầu AI giải thích lý do đằng sau các lựa chọn của nó. Điều này không chỉ giúp bạn hiểu mà còn khuyến khích AI "suy nghĩ" sâu hơn trước khi đưa ra giải pháp. Ví dụ: "Giải thích các bước bạn đã thực hiện để đạt được giải pháp này và tại sao bạn tin rằng đó là giải pháp tối ưu nhất."

- Kết Hợp Với Feedback Loops: Sau khi AI sinh code, hãy tự mình kiểm tra, chạy thử, và sau đó cung cấp phản hồi cụ thể cho AI. Ví dụ: "Code này hoạt động nhưng vẫn chậm khi chạy với 10^6 phần tử. Có cách nào để cải thiện hiệu suất không?" Phản hồi này chính là một dạng adversarial prompt khác, buộc AI phải tối ưu hóa.

- Tập Trung Vào Các Vấn Đề Thực Tế: Áp dụng adversarial prompting để giải quyết các vấn đề bạn đang gặp phải trong dự án thực tế. Điều này sẽ giúp bạn thấy được giá trị thực sự của kỹ thuật này và tạo ra các giải pháp có thể áp dụng ngay lập tức.

- Hiểu Giới Hạn Của AI: Mặc dù AI rất mạnh, nhưng nó không phải là siêu năng lực. Có những vấn đề mà AI hiện tại chưa thể giải quyết một cách tối ưu hoặc chính xác. Đừng cố gắng "đánh lừa" AI vào việc giải quyết những vấn đề nằm ngoài khả năng hiện tại của nó, mà hãy tập trung vào việc đẩy AI đến giới hạn của nó trong các lĩnh vực nó đã mạnh.

Bằng cách tuân thủ các best practices này, bạn sẽ biến adversarial prompting từ một kỹ thuật thử nghiệm thành một công cụ mạnh mẽ, giúp bạn và đội ngũ phát triển tạo ra code chất lượng cao hơn, hiệu quả hơn và đáng tin cậy hơn với sự hỗ trợ của AI.

Adversarial Prompting So Với Các Kỹ Thuật Prompt Engineering Khác

Để hiểu rõ hơn về giá trị của adversarial prompting, chúng ta cần so sánh nó với các kỹ thuật prompt engineering phổ biến khác. Mỗi kỹ thuật có mục đích và ứng dụng riêng, và việc hiểu rõ sự khác biệt sẽ giúp bạn lựa chọn phương pháp phù hợp nhất cho từng tình huống.

1. Zero-shot Prompting

Zero-shot prompting là khi bạn đưa ra một yêu cầu mà không cung cấp bất kỳ ví dụ nào. AI phải dựa vào kiến thức đã được huấn luyện của nó để trả lời.

- Ưu điểm: Đơn giản, nhanh chóng, phù hợp cho các tác vụ cơ bản hoặc khi bạn không có ví dụ cụ thể.

- Nhược điểm: Kết quả có thể không chính xác, thiếu ngữ cảnh, hoặc không tối ưu, đặc biệt với các tác vụ phức tạp hoặc yêu cầu chuyên biệt. AI thường đưa ra giải pháp "trung bình" hoặc phổ biến nhất.

- So với Adversarial Prompting: Zero-shot là điểm khởi đầu. Adversarial prompting bắt đầu từ zero-shot hoặc few-shot, nhưng sau đó bổ sung các ràng buộc và thử thách để đẩy AI vượt qua giải pháp mặc định, tìm kiếm sự tối ưu và mạnh mẽ hơn. Một zero-shot prompt có thể là "Viết hàm sắp xếp mảng", trong khi adversarial sẽ thêm "sắp xếp mảng kích thước 10^7, O(n log n), không dùng thư viện".

2. Few-shot Prompting

Few-shot prompting là việc cung cấp cho AI một vài ví dụ về đầu vào và đầu ra mong muốn trước khi đưa ra yêu cầu chính. Điều này giúp AI hiểu rõ hơn về định dạng, phong cách, hoặc loại phản hồi bạn mong đợi.

- Ưu điểm: Cải thiện đáng kể độ chính xác và tính nhất quán so với zero-shot, đặc biệt khi bạn cần AI tuân thủ một định dạng hoặc phong cách cụ thể.

- Nhược điểm: Yêu cầu phải có sẵn các ví dụ chất lượng, có thể tốn thời gian để chuẩn bị. Vẫn có thể bỏ sót các trường hợp biên hoặc giải pháp tối ưu nếu các ví dụ không đủ đa dạng.

- So với Adversarial Prompting: Few-shot là một cách để định hướng AI. Adversarial prompting có thể được áp dụng sau few-shot để "kiểm tra" các ví dụ đã cung cấp, tìm kiếm lỗ hổng hoặc yêu cầu AI cải thiện các giải pháp trong ví dụ. Ví dụ, bạn cung cấp 3 ví dụ về code tối ưu, sau đó adversarial prompt yêu cầu "tìm lỗi trong ví dụ thứ hai và đề xuất một cách tối ưu hơn".

3. Chain-of-Thought (CoT) Prompting

Chain-of-Thought (CoT) prompting là kỹ thuật yêu cầu AI thể hiện các bước suy luận của nó trước khi đưa ra câu trả lời cuối cùng. Điều này giúp AI giải quyết các vấn đề phức tạp hơn bằng cách chia nhỏ chúng.

- Ưu điểm: Cải thiện khả năng giải quyết vấn đề phức tạp, giúp gỡ lỗi và hiểu được quá trình suy nghĩ của AI. Tăng độ tin cậy của kết quả.

- Nhược điểm: Có thể làm tăng độ dài của phản hồi và thời gian xử lý.

- So với Adversarial Prompting: CoT là một công cụ bổ trợ mạnh mẽ cho adversarial prompting. Khi bạn đưa ra một adversarial prompt, việc yêu cầu AI sử dụng CoT sẽ giúp bạn hiểu tại sao AI lại chọn giải pháp đó, nó đã cân nhắc những gì, và tại sao nó lại từ chối các giải pháp khác. Điều này cho phép bạn tinh chỉnh prompt adversarial của mình hiệu quả hơn. Ví dụ, "Viết hàm này với O(1) không gian, sau đó giải thích từng bước suy nghĩ của bạn và tại sao bạn loại bỏ các phương án khác."

4. Role-Playing Prompting

Role-playing prompting là việc yêu cầu AI đóng vai một chuyên gia hoặc một nhân vật cụ thể để đưa ra phản hồi. Ví dụ: "Bạn là một kiến trúc sư phần mềm cấp cao..."

- Ưu điểm: Hướng AI tập trung vào một góc nhìn cụ thể, tạo ra phản hồi chất lượng cao hơn trong lĩnh vực đó.

- Nhược điểm: Có thể hạn chế sự sáng tạo của AI nếu vai trò quá hẹp.

- So với Adversarial Prompting: Role-playing có thể được kết hợp với adversarial prompting. Ví dụ, bạn có thể yêu cầu AI "đóng vai một hacker mũ trắng đang tìm kiếm lỗ hổng trong đoạn code JavaScript này" hoặc "đóng vai một kiến trúc sư hệ thống cần tối ưu hóa hiệu suất cho một dịch vụ có 1 triệu người dùng đồng thời". Điều này tạo ra một bối cảnh mạnh mẽ để AI thực hiện các phân tích adversarial.

Tóm lại, adversarial prompting không phải là một kỹ thuật thay thế cho các phương pháp khác, mà là một kỹ thuật nâng cao có thể bổ sung và làm phong phú thêm chúng. Nó đặc biệt hữu ích khi mục tiêu của bạn là đẩy AI đến giới hạn của nó, tìm kiếm sự tối ưu, độ bền vững và khả năng chống chịu lỗi trong code. Trong khi các kỹ thuật khác giúp AI "làm đúng", adversarial prompting giúp AI "làm tốt nhất có thể" và "chống chịu được những điều tồi tệ nhất".

Các Lưu Ý Quan Trọng

- Luôn Kiểm Tra Code: Dù AI có vẻ đưa ra giải pháp "tối ưu" đến đâu, bạn vẫn PHẢI tự mình kiểm tra, chạy thử và gỡ lỗi code. AI có thể mắc lỗi logic tinh vi hoặc bỏ qua các trường hợp hiếm gặp mà ngay cả adversarial prompts cũng không thể lường trước hết. Theo thống kê, khoảng 25-30% code do AI sinh ra cần điều chỉnh thủ công nhỏ để hoạt động hoàn hảo trong môi trường thực tế.

- Cẩn Thận Với "Hallucination": AI đôi khi có thể tạo ra thông tin sai lệch hoặc "ảo giác" (hallucinate), đặc biệt khi bị đẩy đến giới hạn. Điều này có thể bao gồm việc tạo ra các hàm không tồn tại, cú pháp sai, hoặc giải thích sai về hiệu suất. Hãy luôn đối chiếu thông tin AI cung cấp với kiến thức chuyên môn của bạn.

- Đừng Quá Phức Tạp Hóa Prompt: Mặc dù là adversarial, nhưng prompt vẫn cần phải dễ hiểu cho AI. Một prompt quá dài, lộn xộn hoặc chứa nhiều yêu cầu mâu thuẫn không rõ ràng có thể khiến AI bối rối và đưa ra kết quả kém chất lượng. Hãy giữ cho mỗi yêu cầu adversarial là rõ ràng và tập trung.

- Bảo Mật Thông Tin Nhạy Cảm: Tránh đưa các thông tin nhạy cảm của dự án, dữ liệu khách hàng, hoặc bí mật kinh doanh vào các prompt, đặc biệt là khi sử dụng các mô hình AI công cộng. Dù các nhà cung cấp AI có chính sách bảo mật, nhưng việc hạn chế rủi ro là trách nhiệm của bạn.

- Học Hỏi Từ Phản Hồi Của AI: Khi AI giải thích lý do không thể thực hiện một yêu cầu hoặc đề xuất một giải pháp thay thế, hãy lắng nghe. Đây là cơ hội để bạn hiểu rõ hơn về giới hạn của mô hình và cách bạn có thể cải thiện prompt của mình trong tương lai. Có thể AI đã phát hiện một điều bạn bỏ qua.

- Kết Hợp Với Các Công Cụ Khác: Adversarial prompting không phải là giải pháp duy nhất. Hãy kết hợp nó với các công cụ phân tích code tĩnh (static code analysis), unit testing, và các quy trình CI/CD truyền thống để đảm bảo chất lượng code toàn diện. Một bộ test suite mạnh mẽ sẽ là "adversarial" tốt nhất cho cả code của AI và code của con người.

- Thời Gian và Chi Phí: Việc tạo ra các adversarial prompts phức tạp và lặp đi lặp lại có thể tốn thời gian và chi phí (nếu bạn sử dụng API trả phí). Hãy cân nhắc giữa lợi ích của việc tối ưu hóa code và nguồn lực bạn có thể bỏ ra. Đôi khi, một giải pháp "đủ tốt" nhanh chóng lại hiệu quả hơn một giải pháp "hoàn hảo" tốn nhiều công sức.

Câu Hỏi Thường Gặp

Adversarial prompting có làm chậm quá trình phát triển không?

Không nhất thiết. Ban đầu, việc học và áp dụng adversarial prompting có thể tốn thêm thời gian. Tuy nhiên, về lâu dài, nó giúp giảm đáng kể thời gian gỡ lỗi, tối ưu hóa thủ công và sửa chữa các vấn đề về hiệu suất, từ đó tăng tốc độ phát triển tổng thể. Một nghiên cứu của IBM cho thấy, các nhóm sử dụng prompt engineering nâng cao có thể giảm 30-40% thời gian dành cho việc refactoring và debugging.

Kỹ thuật này có áp dụng được cho tất cả các loại ngôn ngữ lập trình không?

Có, adversarial prompting có thể áp dụng cho hầu hết các ngôn ngữ lập trình, từ Python, JavaScript, Java, C++ đến Go, Rust. Bản chất của kỹ thuật này là thử thách khả năng suy luận và kiến thức lập trình của AI, không phụ thuộc quá nhiều vào cú pháp cụ thể của một ngôn ngữ. Điều quan trọng là bạn phải hiểu rõ các đặc điểm và ràng buộc của ngôn ngữ đó để đưa ra các prompt phù hợp.

Làm thế nào để biết một prompt là "adversarial" hiệu quả?

Một prompt adversarial hiệu quả là prompt buộc AI phải suy nghĩ sâu hơn, xem xét các trường hợp biên, tối ưu hóa hiệu suất, hoặc đưa ra các giải pháp sáng tạo mà một prompt thông thường không thể. Bạn sẽ biết nó hiệu quả khi AI đưa ra code mạnh mẽ hơn, giải thích chi tiết hơn về các lựa chọn, hoặc thậm chí chỉ ra những hạn chế của yêu cầu ban đầu của bạn. Nếu AI chỉ đưa ra một giải pháp tiêu chuẩn, có thể prompt của bạn chưa đủ "thử thách".

Adversarial prompting có liên quan đến bảo mật AI không?

Có, một khía cạnh của adversarial prompting là adversarial attacks trong lĩnh vực AI security, nơi các nhà nghiên cứu cố gắng tìm ra cách "đánh lừa" AI để nó đưa ra phản hồi sai, độc hại hoặc tiết lộ thông tin nhạy cảm. Tuy nhiên, trong ngữ cảnh của bài viết này, adversarial prompting tập trung vào việc sử dụng các kỹ thuật thử thách để CẢI THIỆN chất lượng code và hiệu suất, chứ không phải phá hoại. Mặc dù vậy, kỹ năng tư duy adversarial có thể giúp developer nhận diện các lỗ hổng bảo mật tiềm ẩn trong code do AI sinh ra.

Kết Luận

Adversarial prompting là một kỹ thuật prompt engineering nâng cao, mang lại tiềm năng to lớn trong việc tối ưu hóa chất lượng và hiệu suất của code được sinh ra bởi AI. Bằng cách cố ý "thử thách" và "đánh lừa" các mô hình ngôn ngữ lớn, chúng ta có thể đẩy chúng vượt ra khỏi các giải pháp tiêu chuẩn, buộc chúng phải suy nghĩ sâu hơn về các trường hợp biên, hiệu suất và khả năng chịu lỗi. Điều này không chỉ giúp chúng ta có được code tốt hơn mà còn nâng cao khả năng tương tác và khai thác tối đa tiềm năng của AI với vai trò là một đối tác phát triển.

Việc áp dụng adversarial prompting đòi hỏi sự sáng tạo, tư duy phản biện và một chút kiên nhẫn, nhưng những lợi ích mà nó mang lại cho quy trình phát triển phần mềm là vô cùng đáng giá. Khi bạn thành thạo kỹ thuật này, bạn sẽ không chỉ là người dùng AI mà còn là người định hình cách AI tạo ra code, biến nó thành một công cụ mạnh mẽ hơn bao giờ hết. Hãy bắt đầu thử nghiệm và đưa khả năng prompt engineering của bạn lên một tầm cao mới cùng vibe coding!