Giới Thiệu AI Agent Tự Động: Thiết Kế Workflow Thông Minh Với LangChain & LangGraph Cho Developer Vibe

Chào mừng các developer có chung vibe coding đến với thế giới đầy mê hoặc của AI Agent! Trong kỷ nguyên công nghệ số hiện đại, việc tự động hóa các tác vụ phức tạp không chỉ là xu hướng mà còn là yếu tố then chốt giúp chúng ta tối ưu hóa năng suất và khai phá những tiềm năng mới. Bài viết này sẽ đưa bạn đi sâu vào việc thiết kế các AI Agent tự động, đặc biệt tập trung vào việc xây dựng LangGraph workflow một cách thông minh và hiệu quả, sử dụng hai thư viện mạnh mẽ là LangChain và LangGraph.

Chúng ta sẽ cùng khám phá cách các AI Agent có thể tương tác với môi trường, ra quyết định và thực hiện các hành động một cách tự chủ, mô phỏng tư duy của con người. Từ việc hiểu rõ kiến trúc cơ bản đến việc áp dụng các kỹ thuật nâng cao, mục tiêu của bài viết là trang bị cho bạn kiến thức và công cụ cần thiết để biến những ý tưởng phức tạp thành hiện thực, tạo ra các hệ thống AI không chỉ thông minh mà còn linh hoạt và đáng tin cậy.

Hãy cùng nhau bắt đầu hành trình kiến tạo những AI Agent đột phá, mở ra kỷ nguyên mới của tự động hóa và sáng tạo trong lập trình!

AI Agent và Sự Trỗi Dậy Của LangChain & LangGraph

AI Agent là một chương trình máy tính có khả năng cảm nhận môi trường của nó, ra quyết định dựa trên các mục tiêu đã định, và thực hiện các hành động để đạt được những mục tiêu đó. Khác với các mô hình AI truyền thống chỉ thực hiện một tác vụ cụ thể (như phân loại hình ảnh hay dịch thuật), AI Agent có khả năng tự chủ, học hỏi và thích nghi. Chúng thường được xây dựng dựa trên các Large Language Models (LLMs) làm "bộ não", kết hợp với các "công cụ" (tools) để tương tác với thế giới bên ngoài.

Sự ra đời của LangChain đã cách mạng hóa cách chúng ta xây dựng các ứng dụng dựa trên LLMs. LangChain cung cấp một framework linh hoạt cho phép các developer dễ dàng kết nối LLMs với các nguồn dữ liệu, API, và các thành phần khác. Nó đơn giản hóa việc tạo ra các chuỗi hành động (chains) và các tác nhân (agents) có khả năng suy luận và thực hiện các tác vụ đa bước. Tuy nhiên, khi các tác vụ trở nên phức tạp hơn, đòi hỏi khả năng quản lý trạng thái, vòng lặp có điều kiện, và việc ra quyết định dựa trên kết quả trung gian, LangChain bắt đầu bộc lộ những hạn chế nhất định.

Đó là lúc LangGraph xuất hiện như một giải pháp hoàn hảo. LangGraph là một thư viện được xây dựng trên LangChain, chuyên biệt hóa cho việc tạo ra các AI Agent có khả năng quản lý trạng thái và thực hiện các luồng công việc phức tạp, có đồ thị. Nó cho phép định nghĩa các bước (nodes) và các chuyển đổi (edges) giữa chúng, tạo thành một đồ thị trạng thái mà agent có thể di chuyển qua. Điều này mở ra khả năng xây dựng các hệ thống AI tự động hóa mạnh mẽ hơn, linh hoạt hơn, có khả năng xử lý các kịch bản thực tế một cách hiệu quả.

Với LangGraph, chúng ta có thể thiết kế các LangGraph workflow không chỉ tuyến tính mà còn phân nhánh, lặp lại, và đưa ra quyết định dựa trên điều kiện. Điều này cực kỳ quan trọng đối với các AI Agent cần thực hiện các tác vụ phức tạp, đòi hỏi nhiều vòng lặp suy luận và điều chỉnh dựa trên phản hồi. LangGraph cung cấp một cách trực quan để mô hình hóa các quá trình này, biến những ý tưởng phức tạp thành các cấu trúc code rõ ràng và dễ quản lý.

Thiết Kế LangGraph Workflow: Từ Ý Tưởng Đến Thực Thi

Để thiết kế một LangGraph workflow hiệu quả, chúng ta cần bắt đầu từ việc hình dung rõ ràng về quy trình mà AI Agent cần thực hiện. Hãy lấy ví dụ về một AI Agent hỗ trợ nghiên cứu thị trường, có khả năng tìm kiếm thông tin, tổng hợp, và phân tích dữ liệu từ nhiều nguồn khác nhau.

Bước 1: Xác định các Trạng thái (Nodes) và Chuyển đổi (Edges)

Mỗi "node" trong LangGraph đại diện cho một bước xử lý hoặc một hành động mà agent có thể thực hiện. Các "edges" định nghĩa cách agent chuyển từ node này sang node khác. Ví dụ, một agent nghiên cứu thị trường có thể có các nodes như:

fetch_web_data: Tìm kiếm và thu thập dữ liệu từ internet.analyze_data: Phân tích dữ liệu thu thập được.generate_report: Tạo báo cáo tổng hợp.ask_user_clarification: Yêu cầu người dùng làm rõ thêm thông tin nếu cần.

Các edges sẽ định hướng luồng xử lý. Ví dụ, sau khi fetch_web_data, agent có thể chuyển đến analyze_data. Nếu phân tích phát hiện thiếu sót, nó có thể quay lại fetch_web_data hoặc chuyển đến ask_user_clarification.

Bước 2: Định nghĩa Agent State

Agent State là nơi LangGraph lưu trữ thông tin xuyên suốt quá trình thực thi workflow. Nó có thể là một dictionary Python hoặc một Pydantic model. Agent State cần chứa tất cả dữ liệu mà các nodes cần để hoạt động và các kết quả trung gian. Ví dụ:

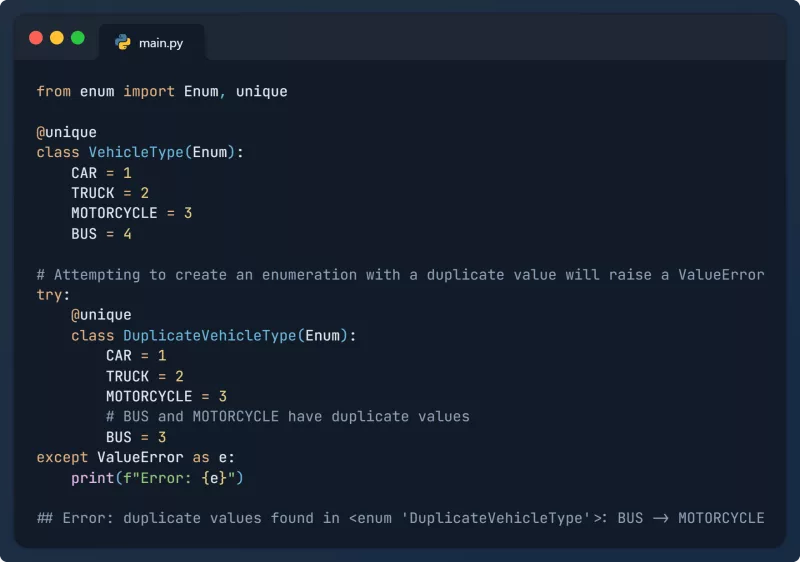

from typing import List, TypedDict, Annotated

from langchain_core.messages import BaseMessage

class AgentState(TypedDict):

messages: Annotated[List[BaseMessage], lambda x, y: x + y]

web_search_results: str

analysis_report: str

user_query: strỞ đây, messages sẽ chứa lịch sử đối thoại, web_search_results lưu kết quả tìm kiếm, analysis_report là báo cáo phân tích, và user_query là câu hỏi ban đầu của người dùng.

Bước 3: Xây dựng các Nodes

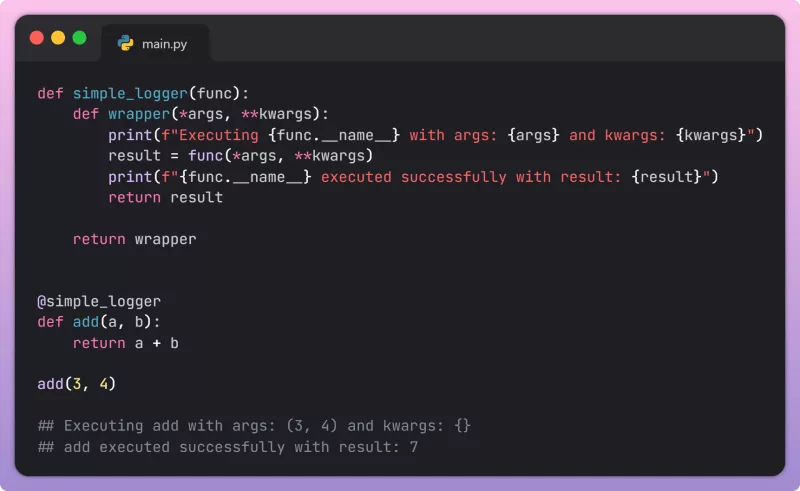

Mỗi node là một hàm Python nhận vào AgentState và trả về một phần của AgentState đã được cập nhật. Bên trong node, chúng ta sẽ sử dụng LLM, tích hợp các công cụ (tools) của LangChain, hoặc thực hiện các logic xử lý khác.

from langchain_core.tools import tool

from langchain_community.tools import DuckDuckGoSearchRun

from langchain_openai import ChatOpenAI

from langchain_core.output_parsers import StrOutputParser

# Khởi tạo LLM và tools

llm = ChatOpenAI(model="gpt-4o", temperature=0)

web_search_tool = DuckDuckGoSearchRun()

@tool

def fetch_web_data_tool(query: str) -> str:

"""Uses a web search tool to find information based on the query."""

return web_search_tool.run(query)

def fetch_web_data_node(state: AgentState) -> AgentState:

print("---Fetching Web Data---")

user_query = state["user_query"]

# Sử dụng LLM để tạo truy vấn tìm kiếm tốt hơn từ user_query

search_query_generation_prompt = f"Generate a concise web search query for: {user_query}. Only output the query."

search_query = llm.invoke(search_query_generation_prompt).content

web_results = fetch_web_data_tool.run(search_query)

return {"web_search_results": web_results, "messages": [BaseMessage(content=f"Web search results: {web_results}")]}

def analyze_data_node(state: AgentState) -> AgentState:

print("---Analyzing Data---")

web_results = state["web_search_results"]

user_query = state["user_query"]

analysis_prompt = f"Based on the following web search results:\n{web_results}\n\nAnd the user's original query: {user_query}\n\nProvide a concise analysis and answer the query. If more information is needed, state it clearly."

analysis = llm.invoke(analysis_prompt).content

return {"analysis_report": analysis, "messages": [BaseMessage(content=f"Analysis: {analysis}")]}

def generate_report_node(state: AgentState) -> AgentState:

print("---Generating Final Report---")

analysis_report = state["analysis_report"]

final_report_prompt = f"Based on the analysis report:\n{analysis_report}\n\nGenerate a professional and comprehensive final report."

final_report = llm.invoke(final_report_prompt).content

return {"messages": [BaseMessage(content=final_report)]}Bước 4: Định nghĩa Conditional Edges

Conditional edges cho phép agent đưa ra quyết định dựa trên trạng thái hiện tại. Đây là trái tim của một LangGraph workflow phức tạp. Chúng ta cần một hàm quyết định (decide_next_step) để xác định node tiếp theo.

def decide_next_step(state: AgentState) -> str:

print("---Deciding Next Step---")

analysis_report = state["analysis_report"]

# Sử dụng LLM để đánh giá liệu phân tích đã đủ chưa

decision_prompt = f"Based on the following analysis report:\n{analysis_report}\n\nIs the analysis sufficient to answer the user's query? Respond with 'FINISH' if yes, or 'RE_SEARCH' if more information is likely needed. If the analysis explicitly states more information is needed, choose 'RE_SEARCH'."

decision = llm.invoke(decision_prompt).content.strip().upper()

if "FINISH" in decision:

print("---DECISION: FINISH---")

return "generate_report"

else: # RE_SEARCH or other cases

print("---DECISION: RE_SEARCH---")

return "fetch_web_data" # Loop back to fetch more data or refine searchBước 5: Xây dựng Graph

Sử dụng StateGraph để kết nối các nodes và edges.

from langgraph.graph import StateGraph, END

workflow = StateGraph(AgentState)

# Add nodes

workflow.add_node("fetch_web_data", fetch_web_data_node)

workflow.add_node("analyze_data", analyze_data_node)

workflow.add_node("generate_report", generate_report_node)

# Set entry point

workflow.set_entry_point("fetch_web_data")

# Add edges

workflow.add_edge("fetch_web_data", "analyze_data")

# Add conditional edge for analysis

workflow.add_conditional_edges(

"analyze_data",

decide_next_step,

{

"generate_report": "generate_report",

"fetch_web_data": "fetch_web_data"

}

)

# End point

workflow.add_edge("generate_report", END)

# Compile the graph

app = workflow.compile()Bước 6: Chạy Workflow

# Example: Running the workflow

initial_state = AgentState(

messages=[],

web_search_results="",

analysis_report="",

user_query="Tìm hiểu về tác động của AI đến thị trường việc làm trong 5 năm tới."

)

for s in app.stream(initial_state):

print(s)

print("---")

# Lấy kết quả cuối cùng

final_output = app.invoke(initial_state)

print("\nFinal Report:")

print(final_output["messages"][-1].content)Qua ví dụ này, bạn có thể thấy cách LangGraph cho phép chúng ta xây dựng một LangGraph workflow động, có khả năng lặp lại và đưa ra quyết định thông minh, mô phỏng hành vi của một người nghiên cứu thực thụ.

Best Practices và Tips cho LangGraph Workflow

Để tối ưu hóa các LangGraph workflow và xây dựng các AI Agent mạnh mẽ, hãy ghi nhớ những best practices sau:

- Thiết kế State rõ ràng và tối giản: Agent State nên chứa đủ thông tin cần thiết mà không quá cồng kềnh. Tránh lưu trữ dữ liệu không liên quan hoặc trùng lặp. Sử dụng

Annotatedvới các hàm hợp nhất (reducer functions) để quản lý việc cập nhật state một cách hiệu quả, đặc biệt cho các danh sách (như lịch sử tin nhắn). - Mỗi Node một trách nhiệm: Tuân thủ nguyên tắc Single Responsibility Principle (SRP). Mỗi node nên có một mục đích rõ ràng và thực hiện một tác vụ cụ thể. Điều này giúp dễ dàng kiểm thử, debug và mở rộng workflow.

- Sử dụng Tools hiệu quả: Tích hợp các công cụ (tools) bên ngoài là chìa khóa để mở rộng khả năng của AI Agent. Hãy chọn lọc và tạo ra các tools có chức năng rõ ràng, dễ sử dụng, và trả về kết quả nhất quán. Đảm bảo LLM hiểu rõ cách sử dụng các tools này thông qua prompt engineering.

- Prompt Engineering cho quyết định thông minh: Các conditional edges phụ thuộc rất nhiều vào khả năng của LLM để đưa ra quyết định đúng đắn. Hãy thiết kế các prompts rõ ràng, yêu cầu LLM trả về các định dạng cụ thể (ví dụ: "FINISH" hoặc "RE_SEARCH") để hàm quyết định có thể parse dễ dàng. Cân nhắc sử dụng Pydantic output parsers để đảm bảo định dạng đầu ra.

- Xử lý lỗi và Fallback: Các hệ thống AI Agent có thể gặp lỗi do API không phản hồi, dữ liệu không mong muốn, hoặc LLM hallucination. Hãy thiết kế các nodes xử lý lỗi hoặc các nhánh fallback trong workflow để agent có thể phục hồi hoặc thông báo cho người dùng khi có sự cố.

- Giám sát và Logging: Trong quá trình phát triển và triển khai, việc giám sát hoạt động của agent là rất quan trọng. Sử dụng logging để theo dõi luồng thực thi qua các nodes, trạng thái của agent, và các quyết định được đưa ra. Điều này giúp bạn hiểu rõ hành vi của agent và debug khi cần thiết.

- Kiểm thử lặp lại: Do tính chất không deterministic của LLMs, việc kiểm thử các AI Agent đòi hỏi một cách tiếp cận khác. Hãy thực hiện kiểm thử lặp lại với nhiều đầu vào khác nhau để đảm bảo agent hoạt động ổn định và đưa ra các quyết định mong muốn trong nhiều kịch bản.

LangGraph so với Các Giải Pháp Khác: Một Góc Nhìn Chuyên Sâu

Khi nói đến việc xây dựng AI Agent, LangGraph không phải là lựa chọn duy nhất. Tuy nhiên, nó mang lại những lợi thế đáng kể so với các phương pháp truyền thống và một số framework khác.

So với LangChain Agent Executor truyền thống: LangChain cung cấp một AgentExecutor cho phép agent sử dụng tools và suy luận. Tuy nhiên, AgentExecutor thường hoạt động theo một vòng lặp suy luận tuyến tính: LLM suy luận -> chọn tool -> chạy tool -> LLM suy luận tiếp. Nó gặp khó khăn trong việc quản lý các luồng phức tạp hơn như vòng lặp có điều kiện, chuyển đổi trạng thái dựa trên nhiều yếu tố, hoặc các nhánh xử lý song song. LangGraph giải quyết vấn đề này bằng cách trừu tượng hóa workflow thành một đồ thị, cho phép định nghĩa rõ ràng các nodes và các điều kiện chuyển đổi, mang lại khả năng kiểm soát và linh hoạt cao hơn nhiều.

So với State Machines (máy trạng thái) truyền thống: LangGraph có thể được xem là một dạng máy trạng thái cấp cao. Tuy nhiên, nó được tối ưu hóa đặc biệt cho các AI Agent, tích hợp sâu với LLMs và các công cụ của LangChain. Các máy trạng thái truyền thống thường yêu cầu developer phải tự xây dựng logic cho từng trạng thái và các chuyển đổi, trong khi LangGraph tận dụng sức mạnh suy luận của LLM để tự động hóa việc ra quyết định chuyển đổi giữa các trạng thái, qua đó giảm đáng kể lượng code phải viết và tăng cường khả năng thích ứng của agent.

So với các framework workflow khác (Apache Airflow, Prefect, etc.): Các framework này rất mạnh mẽ trong việc quản lý các workflow dữ liệu và các tác vụ tính toán lớn. Tuy nhiên, chúng không được thiết kế đặc biệt cho việc tích hợp LLMs và các quyết định động dựa trên suy luận của AI. LangGraph tập trung vào việc tạo ra các workflow mà các quyết định và lộ trình thực thi có thể thay đổi linh hoạt dựa trên đầu ra của LLM hoặc các kết quả trung gian, điều này khó đạt được một cách hiệu quả với các framework workflow truyền thống.

Ưu điểm của LangGraph:

- Quản lý trạng thái dễ dàng: Cung cấp một cơ chế rõ ràng để lưu trữ và cập nhật trạng thái của agent qua các bước.

- Khả năng tạo vòng lặp và điều kiện: Cho phép các luồng công việc phức tạp, không tuyến tính, điều này rất quan trọng cho các tác vụ đòi hỏi sự lặp lại và điều chỉnh.

- Trực quan hóa workflow: Cấu trúc đồ thị giúp developer dễ dàng hình dung và debug luồng xử lý của agent.

- Tích hợp sâu với LangChain: Tận dụng toàn bộ hệ sinh thái của LangChain, bao gồm LLMs, Prompts, Tools, và Parsers.

- Mở rộng linh hoạt: Dễ dàng thêm các nodes mới, thay đổi logic chuyển đổi mà không ảnh hưởng đến toàn bộ cấu trúc.

Tóm lại, LangGraph lấp đầy một khoảng trống quan trọng trong việc phát triển AI Agent, cung cấp một framework mạnh mẽ và linh hoạt để xây dựng các hệ thống tự động hóa thông minh, có khả năng xử lý các kịch bản phức tạp mà các giải pháp khác khó có thể đáp ứng hiệu quả.

Các Lưu Ý Quan Trọng

- Chi phí LLM: Mỗi lần gọi LLM trong một node hoặc hàm quyết định đều tốn token. Khi thiết kế LangGraph workflow, hãy cân nhắc số lượng lời gọi LLM, đặc biệt trong các vòng lặp, để tránh chi phí không mong muốn. Tối ưu hóa prompts và sử dụng caching khi thích hợp.

- Độ trễ (Latency): Việc gọi LLM nhiều lần có thể gây ra độ trễ đáng kể. Đối với các ứng dụng yêu cầu phản hồi nhanh, cần cân nhắc thiết kế workflow tối ưu để giảm thiểu số lượng vòng lặp và các lời gọi LLM không cần thiết.

- Tính Deterministic vs. Non-deterministic: LLMs vốn dĩ là non-deterministic. Điều này có nghĩa là cùng một đầu vào có thể tạo ra các đầu ra khác nhau, ảnh hưởng đến các quyết định của agent. Cần có cơ chế xử lý sự không chắc chắn này, có thể là thông qua việc kiểm tra output, retry logic, hoặc thiết kế workflow đủ mạnh để xử lý các kết quả không mong muốn.

- Bảo mật và Quyền riêng tư: Khi AI Agent tương tác với dữ liệu nhạy cảm hoặc các hệ thống bên ngoài, hãy đảm bảo tuân thủ các quy tắc bảo mật và quyền riêng tư. Hạn chế quyền truy cập của agent chỉ đến những nguồn cần thiết và xử lý dữ liệu một cách an toàn.

- Quản lý phiên (Session Management): Đối với các AI Agent tương tác dài hạn (ví dụ: chatbot), việc quản lý phiên và trạng thái người dùng là rất quan trọng. LangGraph State có thể được sử dụng để lưu trữ trạng thái phiên, nhưng cần có cơ chế bền vững để lưu trữ và tải lại trạng thái này giữa các lần tương tác.

- Khả năng mở rộng (Scalability): Khi ứng dụng AI Agent của bạn phát triển, hãy xem xét khả năng mở rộng của kiến trúc. Việc chạy các agent trên các nền tảng đám mây và quản lý tài nguyên tính toán cho LLM là những yếu tố cần được tính đến.

- Debug và Trực quan hóa: LangGraph cung cấp công cụ để trực quan hóa đồ thị. Hãy tận dụng chúng để hiểu rõ luồng chạy của agent. Logging và in ra trạng thái của agent ở mỗi bước là cực kỳ hữu ích cho việc debug.

Câu Hỏi Thường Gặp

LangGraph có phải là một framework độc lập không?

Không, LangGraph được xây dựng trên LangChain. Nó sử dụng các thành phần cốt lõi của LangChain như LLMs, tools, và parsers, nhưng cung cấp một lớp trừu tượng cao hơn để xây dựng các workflow có trạng thái và đồ thị phức tạp cho AI Agent.

Làm thế nào để xử lý các lỗi trong LangGraph workflow?

Bạn có thể thêm các nodes xử lý lỗi (error handling nodes) vào đồ thị của mình. Khi một node gặp lỗi, thay vì dừng lại, bạn có thể định nghĩa một conditional edge để chuyển sang node xử lý lỗi này, nơi bạn có thể ghi log lỗi, thông báo cho người dùng, hoặc thử lại tác vụ.

LangGraph có hỗ trợ thực thi song song các nodes không?

Hiện tại, LangGraph tập trung vào các workflow tuần tự và có trạng thái. Mặc dù bạn có thể thiết kế các nhánh trong đồ thị, việc thực thi song song thực sự (concurrent execution) giữa các nodes trong cùng một luồng là một tính năng phức tạp hơn và thường được xử lý ở cấp độ ứng dụng hoặc thông qua các worker pool bên ngoài.

Khi nào nên dùng LangGraph thay vì LangChain AgentExecutor?

Bạn nên dùng LangGraph khi workflow của bạn đòi hỏi quản lý trạng thái phức tạp, có các vòng lặp lặp đi lặp lại, các quyết định điều kiện không tuyến tính, hoặc khi bạn cần khả năng hiển thị và kiểm soát rõ ràng hơn đối với luồng thực thi của agent. Đối với các tác vụ đơn giản, tuyến tính, AgentExecutor có thể là đủ.

Có thể sử dụng các LLM khác ngoài OpenAI với LangGraph không?

Hoàn toàn có. LangGraph, thông qua LangChain, hỗ trợ rất nhiều LLM providers khác nhau như Anthropic, Google, Hugging Face models, v.v. Bạn chỉ cần khởi tạo LLM tương ứng và truyền nó vào các nodes của mình.

Kết Luận

Việc thiết kế các AI Agent tự động với LangChain và LangGraph mở ra một chân trời mới cho các developer trong việc xây dựng các ứng dụng thông minh và tự chủ. Với khả năng mô hình hóa các LangGraph workflow phức tạp thành các đồ thị có trạng thái, chúng ta có thể tạo ra những hệ thống AI không chỉ thực hiện các tác vụ một cách hiệu quả mà còn có khả năng thích nghi, suy luận và đưa ra quyết định thông minh trong môi trường động.

Hy vọng rằng bài viết này đã cung cấp cho bạn cái nhìn sâu sắc và những công cụ cần thiết để bắt đầu hành trình xây dựng các AI Agent của riêng mình. Đừng ngần ngại thử nghiệm, sáng tạo và khám phá những khả năng vô tận mà LangGraph mang lại. Cộng đồng vibe coding luôn sẵn lòng chia sẻ và học hỏi cùng bạn. Hãy cùng nhau đưa công nghệ AI lên một tầm cao mới!

Chúc bạn thành công trên con đường trở thành một chuyên gia AI Agent!