Giới Thiệu AI Vĩ Mô Hóa: Tự Động Hóa Tác Vụ Phức Tạp, Nâng Tầm Hiệu Suất Lập Trình Với Meta-Prompting

Trong thế giới phát triển phần mềm ngày càng nhanh chóng, việc tối ưu hóa quy trình làm việc và nâng cao hiệu suất là yếu tố then chốt để duy trì lợi thế cạnh tranh. Trí tuệ nhân tạo (AI) đã và đang mở ra những chân trời mới, đặc biệt trong lĩnh vực lập trình. Tuy nhiên, để AI thực sự trở thành "đồng đội" đắc lực, chúng ta cần học cách giao tiếp với nó một cách hiệu quả. Bài viết này sẽ giúp bạn hiểu rõ về meta-prompting nâng cao, một kỹ thuật mạnh mẽ cho phép chúng ta tự động hóa các tác vụ phức tạp, nâng tầm hiệu suất lập trình và khám phá tiềm năng vĩ mô hóa AI trong quy trình phát triển của mình.

Meta-Prompting Nâng Cao: Khái Niệm và Tiềm Năng

Meta-prompting, hay còn gọi là "prompting prompt", là nghệ thuật và khoa học của việc thiết kế các prompt không chỉ để AI thực hiện một tác vụ cụ thể, mà còn để AI tự tạo ra, điều chỉnh hoặc tối ưu hóa các prompt khác. Thay vì chỉ cung cấp một hướng dẫn duy nhất cho AI, chúng ta cung cấp một "khung hướng dẫn" cho AI để nó tự xây dựng hoặc tinh chỉnh các hướng dẫn chi tiết hơn. Kỹ thuật này đặc biệt hữu ích khi đối mặt với các tác vụ đa bước, phức tạp hoặc cần sự linh hoạt cao.

Hãy tưởng tượng bạn muốn AI không chỉ viết code, mà còn phải hiểu rõ ngữ cảnh của dự án, tự động chọn framework phù hợp, tạo các test case liên quan, và thậm chí là refactor code nếu cần. Với prompting truyền thống, bạn sẽ phải đưa ra hàng loạt prompt riêng lẻ cho từng bước. Nhưng với meta-prompting, bạn chỉ cần một meta-prompt duy nhất, yêu cầu AI tự động hóa toàn bộ quy trình này. Đây chính là sức mạnh của việc vĩ mô hóa AI: biến các chuỗi tác vụ nhỏ thành một luồng công việc tự động, liền mạch.

Tiềm năng của meta-prompting là vô cùng lớn. Nó không chỉ giúp tiết kiệm thời gian mà còn nâng cao chất lượng đầu ra bằng cách cho phép AI thực hiện các phân tích sâu hơn, xem xét nhiều yếu tố hơn trước khi đưa ra kết quả. Nó giống như việc bạn không chỉ yêu cầu một người làm việc, mà còn yêu cầu họ tự đặt câu hỏi, tự nghiên cứu và tự lên kế hoạch để hoàn thành công việc một cách tốt nhất. Đối với AI, điều này có nghĩa là khả năng tự cải thiện, tự thích nghi và tự động hóa ở một cấp độ hoàn toàn mới.

Một trong những lợi ích rõ ràng nhất của meta-prompting là khả năng tạo ra các công cụ tùy chỉnh (custom tools) chỉ với text. Thay vì phải viết code để điều khiển AI qua API, bạn có thể mô tả một "tool" bằng ngôn ngữ tự nhiên, và AI sẽ tự động hiểu và thực thi nó. Điều này mở ra cánh cửa cho các nhà phát triển tạo ra các workflow AI phức tạp mà không cần phải có kiến thức sâu về lập trình AI, giảm bớt rào cản gia nhập và tăng tốc độ phát triển ứng dụng AI.

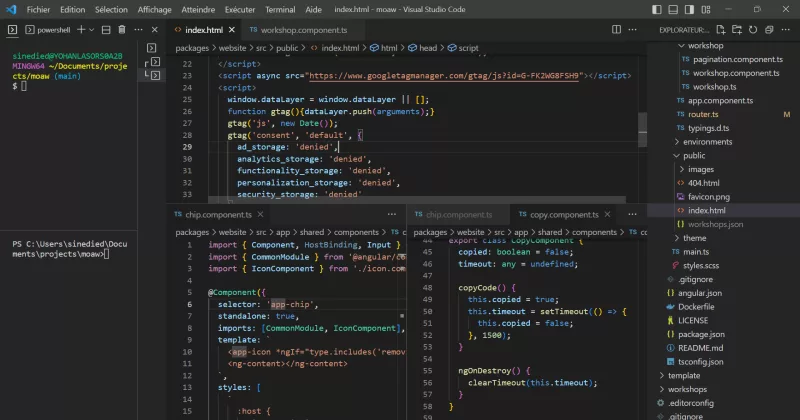

Hướng Dẫn Thực Hành Meta-Prompting Nâng Cao Trong Lập Trình

Để bắt đầu thực hành meta-prompting, chúng ta cần thay đổi tư duy từ việc ra lệnh trực tiếp sang việc cung cấp một "khuôn mẫu" hoặc "quy trình" cho AI. Dưới đây là một ví dụ cụ thể về cách áp dụng meta-prompting để tự động hóa việc tạo API endpoint và các test case liên quan.

Bước 1: Xác định Meta-Prompt Core

Meta-prompt core là hướng dẫn chính cho AI, nơi bạn định nghĩa mục tiêu tổng thể và các bước cần thiết. Nó phải đủ linh hoạt để AI có thể tự điền vào các chi tiết.

Bạn là một AI chuyên gia phát triển phần mềm. Nhiệm vụ của bạn là nhận một yêu cầu tính năng, sau đó tự động thực hiện các bước sau:

1. Phân tích yêu cầu, xác định các thực thể và mối quan hệ.

2. Thiết kế cấu trúc dữ liệu (database schema hoặc interface TypeScript) phù hợp.

3. Tạo ra cấu trúc API endpoint (ví dụ: RESTful, GraphQL) cho yêu cầu đó.

4. Viết các đoạn code triển khai endpoint (ngôn ngữ/framework sẽ được chọn dựa trên ngữ cảnh).

5. Tạo các test case toàn diện cho endpoint vừa tạo, bao gồm test case thành công và thất bại.

6. Đưa ra các gợi ý cải tiến hoặc các vấn đề tiềm ẩn.

Bạn phải trình bày kết quả theo cấu trúc rõ ràng, từng bước một.

Bước 2: Cung cấp Ngữ cảnh và Yêu cầu Cụ thể

Sau khi thiết lập meta-prompt core, bạn cung cấp yêu cầu cụ thể của mình. AI sẽ sử dụng meta-prompt core để "phân tích" yêu cầu này và tạo ra các prompt con để tự thực hiện các bước.

Ngữ cảnh dự án: Chúng ta đang phát triển một ứng dụng quản lý tác vụ (Task Management App) sử dụng Node.js với Express, TypeScript và MongoDB.

Yêu cầu tính năng: "Tạo một API cho phép người dùng tạo, đọc, cập nhật và xóa các tác vụ (tasks). Mỗi tác vụ có tên, mô tả, trạng thái (pending, in_progress, completed), ngày tạo và ngày cập nhật. Người dùng có thể lọc tác vụ theo trạng thái."

Bước 3: AI Thực Hiện và Phản Hồi

AI sẽ tự động diễn giải meta-prompt và yêu cầu của bạn, sau đó tạo ra một chuỗi các prompt nội bộ để thực hiện từng bước. Ví dụ, AI có thể tự hỏi: "Cấu trúc dữ liệu cho Task là gì?", "Làm thế nào để tạo endpoint RESTful cho CRUD?", "Các trường hợp lỗi nào cần được kiểm tra?".

Kết quả từ AI có thể trông như sau (được rút gọn để minh họa):

<strong>Phân Tích Yêu Cầu:</strong>

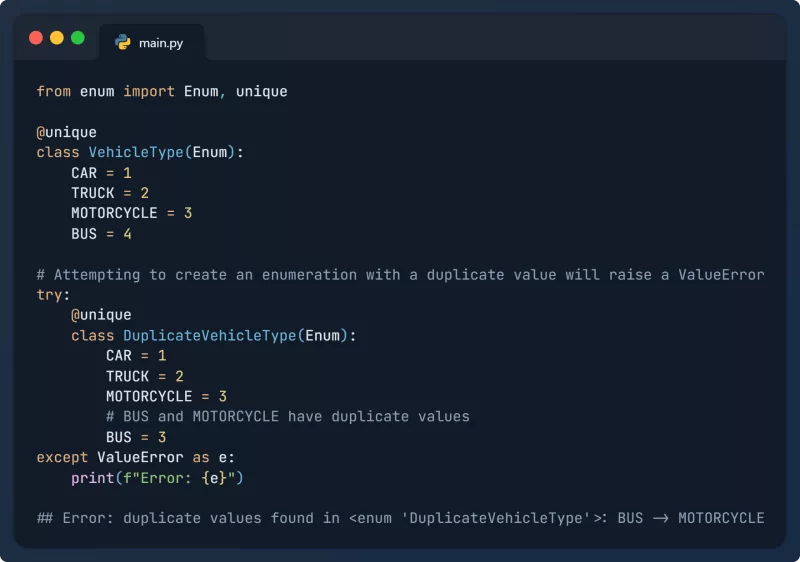

Yêu cầu là tạo API CRUD cho thực thể 'Task'. Các thuộc tính của Task: `name` (string), `description` (string), `status` (enum: 'pending', 'in_progress', 'completed'), `createdAt` (Date), `updatedAt` (Date). Cần hỗ trợ lọc theo `status`.

<strong>Thiết Kế Cấu Trúc Dữ Liệu (TypeScript Interface và MongoDB Schema):</strong>

<pre><code>// interfaces/Task.ts

export type TaskStatus = 'pending' | 'in_progress' | 'completed';

export interface ITask {

_id?: string; // MongoDB ObjectId

name: string;

description: string;

status: TaskStatus;

createdAt: Date;

updatedAt: Date;

}

// models/Task.js (Mongoose Schema)

const mongoose = require('mongoose');

const taskSchema = new mongoose.Schema({

name: { type: String, required: true },

description: { type: String, required: false },

status: { type: String, enum: ['pending', 'in_progress', 'completed'], default: 'pending' },

createdAt: { type: Date, default: Date.now },

updatedAt: { type: Date, default: Date.now }

});

taskSchema.pre('save', function(next) {

this.updatedAt = Date.now();

next();

});

module.exports = mongoose.model('Task', taskSchema);

// routes/taskRoutes.ts

import express from 'express';

import { Request, Response } from 'express';

import Task from '../models/Task'; // Assuming Task model is properly imported

import { ITask, TaskStatus } from '../interfaces/Task';

const router = express.Router();

// Create Task

router.post('/', async (req: Request<{}, {}, ITask>, res: Response) => {

try {

const newTask = new Task(req.body);

await newTask.save();

res.status(201).json(newTask);

} catch (error: any) {

res.status(400).json({ message: error.message });

}

});

// Get All Tasks (with optional filtering by status)

router.get('/', async (req: Request<{}, {}, {}, { status?: TaskStatus }>, res: Response) => {

try {

const { status } = req.query;

const query: { status?: TaskStatus } = {};

if (status) {

query.status = status;

}

const tasks = await Task.find(query);

res.json(tasks);

} catch (error: any) {

res.status(500).json({ message: error.message });

}

});

// ... (code for GET by ID, PUT, DELETE would follow, generated by AI)

// __tests__/task.test.ts

import request from 'supertest';

import app from '../src/app'; // Assuming your Express app is exported from src/app.ts

import mongoose from 'mongoose';

import Task from '../src/models/Task';

beforeAll(async () => {

await mongoose.connect(process.env.MONGO_URI || 'mongodb://localhost:27017/test_task_app');

});

afterEach(async () => {

await Task.deleteMany({}); // Clean up after each test

});

afterAll(async () => {

await mongoose.connection.close();

});

describe('Task API', () => {

it('should create a new task', async () => {

const res = await request(app)

.post('/api/tasks')

.send({

name: 'Test Task',

description: 'This is a test task.',

status: 'pending'

});

expect(res.statusCode).toEqual(201);

expect(res.body).toHaveProperty('_id');

expect(res.body.name).toEqual('Test Task');

});

it('should get all tasks', async () => {

await request(app).post('/api/tasks').send({ name: 'Task 1', description: 'Desc 1', status: 'pending' });

await request(app).post('/api/tasks').send({ name: 'Task 2', description: 'Desc 2', status: 'completed' });

const res = await request(app).get('/api/tasks');

expect(res.statusCode).toEqual(200);

expect(res.body.length).toEqual(2);

});

it('should filter tasks by status', async () => {

await request(app).post('/api/tasks').send({ name: 'Task 1', description: 'Desc 1', status: 'pending' });

await request(app).post('/api/tasks').send({ name: 'Task 2', description: 'Desc 2', status: 'completed' });

const res = await request(app).get('/api/tasks?status=pending');

expect(res.statusCode).toEqual(200);

expect(res.body.length).toEqual(1);

expect(res.body[0].status).toEqual('pending');

});

// ... (more test cases for GET by ID, PUT, DELETE, error handling)

});

Ví dụ trên cho thấy cách AI, với meta-prompting, không chỉ tạo ra code mà còn tự động suy luận các bước cần thiết, từ thiết kế đến kiểm thử, một cách có hệ thống. Đây là một bước tiến lớn so với việc chỉ yêu cầu AI "viết code CRUD cho Task".

Tips và Best Practices Khi Sử Dụng Meta-Prompting

- Rõ ràng và Cụ thể trong Meta-Prompt Core: Mặc dù meta-prompt cho phép AI tự suy luận, nhưng "khuôn mẫu" ban đầu phải đủ rõ ràng về các bước, định dạng đầu ra và các ràng buộc quan trọng. Càng chi tiết về quy trình, kết quả càng chính xác.

- Iteration và Refinement: Meta-prompting không phải là "viết một lần là xong". Bạn sẽ cần lặp lại và tinh chỉnh meta-prompt của mình dựa trên các kết quả đầu ra của AI. Hãy coi nó như việc debug một chương trình: bạn điều chỉnh logic để có được hành vi mong muốn.

- Cung cấp Ngữ cảnh Đầy Đủ: Luôn cung cấp đủ ngữ cảnh về dự án, công nghệ, mục tiêu và bất kỳ ràng buộc nào. Ngữ cảnh càng phong phú, AI càng có thể đưa ra các quyết định thông minh hơn.

- Sử dụng Ví dụ (Few-shot Learning): Nếu có thể, hãy cung cấp một vài ví dụ về đầu ra mong muốn cho các tác vụ tương tự. Điều này giúp AI hiểu rõ hơn về định dạng và phong cách mà bạn mong đợi.

- Chia Nhỏ Các Tác Vụ Phức Tạp: Nếu một meta-prompt quá phức tạp, hãy cân nhắc chia nhỏ nó thành các meta-prompt nhỏ hơn, mỗi prompt giải quyết một phần của vấn đề. Sau đó, bạn có thể "xâu chuỗi" các prompt này lại với nhau.

- Xác định Vai Trò (Role-playing): Gán một vai trò cụ thể cho AI (ví dụ: "Bạn là một kiến trúc sư phần mềm chuyên về microservices", "Bạn là một chuyên gia bảo mật") sẽ định hướng suy nghĩ của nó và giúp nó đưa ra các câu trả lời phù hợp với vai trò đó.

- Kiểm Tra và Xác Thực Đầu Ra: AI không phải lúc nào cũng hoàn hảo. Luôn kiểm tra, xác thực và điều chỉnh đầu ra của AI trước khi tích hợp vào dự án của bạn. Coi AI như một trợ lý thông minh, không phải là người thay thế hoàn toàn.

So Sánh Meta-Prompting Với Các Kỹ Thuật Prompting Khác

Để hiểu rõ hơn về giá trị của meta-prompting nâng cao, chúng ta hãy so sánh nó với các kỹ thuật prompting phổ biến khác:

1. Zero-shot Prompting: Đây là kỹ thuật prompting cơ bản nhất, nơi bạn chỉ cung cấp một prompt duy nhất mà không có bất kỳ ví dụ nào. AI phải dựa vào kiến thức đã được huấn luyện để tạo ra phản hồi. Ưu điểm: Đơn giản, nhanh chóng. Nhược điểm: Kết quả có thể không chính xác hoặc không theo định dạng mong muốn cho các tác vụ phức tạp. AI không có "hướng dẫn" về cách thực hiện các bước. Ví dụ: "Viết một hàm Python để tính giai thừa."

2. Few-shot Prompting: Bạn cung cấp một vài ví dụ về prompt và phản hồi mong muốn trước khi đưa ra prompt thực tế. Điều này giúp AI hiểu rõ hơn về mẫu và định dạng đầu ra. Ưu điểm: Cải thiện đáng kể chất lượng và định dạng đầu ra so với zero-shot. Nhược điểm: Vẫn đòi hỏi bạn phải cung cấp các ví dụ cụ thể cho từng tác vụ. Không linh hoạt khi tác vụ thay đổi hoặc mở rộng. Ví dụ: "Prompt: Tính tổng 1, 2. Output: 3. Prompt: Tính tổng 5, 10. Output: 15. Prompt: Tính tổng 7, 8. Output: ?"

3. Chain-of-Thought (CoT) Prompting: Kỹ thuật này khuyến khích AI suy nghĩ từng bước một trước khi đưa ra câu trả lời cuối cùng. Bạn thường thêm cụm từ như "Hãy suy nghĩ từng bước một" vào prompt. Ưu điểm: Cải thiện khả năng lý luận của AI, đặc biệt với các bài toán logic hoặc toán học. Giúp AI "giải thích" quá trình suy nghĩ của nó. Nhược điểm: Vẫn là một prompt duy nhất cho một tác vụ. Không tự động sinh ra các prompt con hoặc điều chỉnh quy trình. Ví dụ: "Nếu tôi có 5 quả táo và ăn 2, sau đó mua thêm 3 quả, tôi có bao nhiêu quả táo? Hãy suy nghĩ từng bước một."

4. Meta-Prompting Nâng Cao: Thay vì chỉ hướng dẫn AI về một tác vụ cụ thể, meta-prompting hướng dẫn AI về cách thức nó nên thực hiện một loại tác vụ. Nó định nghĩa một "workflow" hoặc "agent" mà AI sẽ tuân theo. Ưu điểm: Tự động hóa các chuỗi tác vụ phức tạp, linh hoạt, khả năng tự thích nghi cao, tạo ra các "công cụ" AI tùy chỉnh. Nâng cao hiệu suất lập trình bằng cách vĩ mô hóa các tác vụ. Nhược điểm: Đòi hỏi kỹ năng thiết kế prompt cao hơn, có thể tốn nhiều lần lặp để đạt được meta-prompt tối ưu. Ví dụ: (Như đã trình bày ở trên) Một meta-prompt yêu cầu AI phân tích tính năng, thiết kế schema, viết code, và tạo test case.

Tóm lại, meta-prompting là một bước tiến đáng kể trong việc tương tác với AI, cho phép chúng ta chuyển từ việc "ra lệnh" sang "thiết kế quy trình" cho AI. Điều này mở ra khả năng vĩ mô hóa AI và tự động hóa ở một cấp độ cao hơn, biến AI từ một công cụ đơn lẻ thành một hệ thống tự động hóa thông minh.

Các Lưu Ý Quan Trọng

- Hiểu rõ Giới Hạn của AI: Mặc dù meta-prompting mạnh mẽ, AI vẫn có giới hạn về kiến thức và khả năng suy luận. Đừng mong đợi AI sẽ giải quyết mọi vấn đề mà không cần sự giám sát của con người.

- Bảo mật Dữ Liệu: Khi sử dụng AI cho các tác vụ lập trình, đặc biệt là với code nhạy cảm, hãy đảm bảo rằng bạn hiểu rõ chính sách bảo mật của nhà cung cấp AI và không đưa thông tin độc quyền vào các prompt công khai.

- Chi phí: Các mô hình AI lớn có thể tốn kém. Việc tối ưu hóa prompt để giảm số lượng token đầu vào và đầu ra là quan trọng để quản lý chi phí. Meta-prompting có thể tăng số lượng token nếu không được thiết kế cẩn thận.

- Tính nhất quán của Kết quả: AI có thể không luôn đưa ra kết quả nhất quán cho cùng một prompt. Hãy chuẩn bị cho việc tinh chỉnh hoặc chạy lại prompt nhiều lần để đạt được kết quả mong muốn.

- Sự phụ thuộc vào Mô hình: Hiệu quả của meta-prompting phụ thuộc rất nhiều vào khả năng của mô hình AI bạn đang sử dụng. Các mô hình tiên tiến hơn như GPT-4 thường cho kết quả tốt hơn.

- Kiểm soát Phiên bản Prompt: Coi prompt như code. Quản lý phiên bản cho các meta-prompt của bạn để bạn có thể theo dõi các thay đổi và quay lại các phiên bản trước đó nếu cần.

- Sự cần thiết của Kiến thức Domain: Ngay cả với meta-prompting, kiến thức về domain (lập trình, kiến trúc phần mềm) vẫn là bắt buộc để đánh giá và tinh chỉnh đầu ra của AI. AI là công cụ hỗ trợ, không phải là người thay thế chuyên gia.

Câu Hỏi Thường Gặp

Meta-prompting có giống với Agent AI không?

Có sự chồng chéo đáng kể. Meta-prompting tập trung vào việc thiết kế prompt để AI tự tạo hoặc điều chỉnh các prompt khác, trong khi Agent AI là một hệ thống tự trị có thể thực hiện một chuỗi hành động, bao gồm việc tự tạo prompt, để đạt được mục tiêu. Meta-prompting có thể được coi là một kỹ thuật cốt lõi để xây dựng các Agent AI phức tạp.

Làm thế nào để đo lường hiệu quả của meta-prompting?

Bạn có thể đo lường hiệu quả bằng cách so sánh thời gian hoàn thành tác vụ, chất lượng code đầu ra (dựa trên các tiêu chuẩn như số lỗi, tuân thủ best practices), số lượng manual effort cần thiết để tinh chỉnh, và mức độ tự động hóa đạt được so với phương pháp prompting truyền thống.

Meta-prompting có áp dụng được cho tất cả các ngôn ngữ lập trình không?

Hoàn toàn có. Meta-prompting là một kỹ thuật giao tiếp với AI, không phụ thuộc vào ngôn ngữ lập trình cụ thể. Miễn là AI đã được huấn luyện trên một lượng lớn dữ liệu code của ngôn ngữ đó, nó có thể áp dụng meta-prompting để tạo code hoặc các tài nguyên liên quan cho bất kỳ ngôn ngữ nào.

Kết Luận

Meta-prompting nâng cao không chỉ là một kỹ thuật prompt engineering mới; nó là một triết lý mới trong việc tương tác với Trí tuệ Nhân tạo. Bằng cách vĩ mô hóa AI, chúng ta chuyển từ việc ra lệnh từng bước nhỏ sang việc thiết kế các quy trình tự động, cho phép AI tự suy luận, tự thích nghi và tự động hóa các tác vụ phức tạp một cách hiệu quả hơn. Điều này không chỉ giúp nâng cao hiệu suất lập trình mà còn giải phóng các nhà phát triển khỏi những công việc lặp đi lặp lại, cho phép họ tập trung vào những thách thức sáng tạo và kiến trúc cao cấp hơn.

Hành trình khám phá meta-prompting đòi hỏi sự kiên nhẫn, thử nghiệm và tinh chỉnh liên tục. Nhưng với tiềm năng to lớn mà nó mang lại, đây chắc chắn là một kỹ năng mà mọi nhà phát triển và kỹ sư AI nên trang bị. Hãy bắt đầu thử nghiệm, xây dựng các meta-prompt của riêng bạn và chứng kiến cách AI của bạn trở thành một hệ thống tự động hóa mạnh mẽ hơn. Ghé thăm vibe coding để cập nhật thêm các bài viết chuyên sâu về AI và lập trình.