Giới Thiệu Ứng Dụng "Vibe" Tự Động Phân Tích Dữ Liệu Thị Trường Bằng AI

Ứng dụng "Vibe" tự động phân tích dữ liệu thị trường bằng AI là một giải pháp đột phá giúp doanh nghiệp ra quyết định nhanh chóng và chính xác dựa trên thông tin thị trường cập nhật. Bài viết này sẽ giúp bạn hiểu rõ về Phân tích dữ liệu AI từ góc nhìn thực tế, cách xây dựng một hệ thống như vậy từ đầu, và những lợi ích mà nó mang lại. Chúng ta sẽ khám phá các thành phần công nghệ, quy trình phát triển, và những lưu ý quan trọng để triển khai thành công một ứng dụng phân tích dữ liệu thị trường mạnh mẽ, giúp tối ưu hóa chiến lược kinh doanh và tăng cường khả năng cạnh tranh trong kỷ nguyên số.

Phân Tích Dữ Liệu Thị Trường Bằng AI Là Gì?

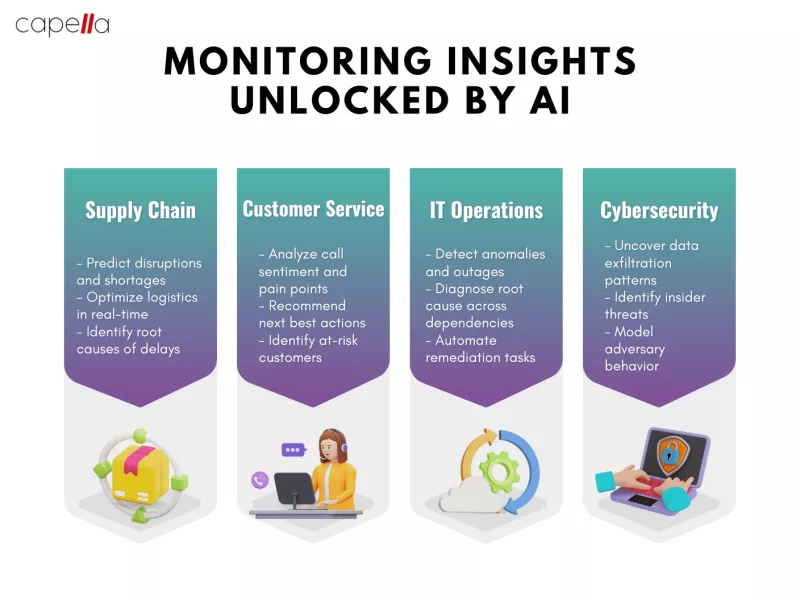

Phân tích dữ liệu thị trường bằng AI là quá trình sử dụng các thuật toán Trí tuệ Nhân tạo (AI) và Học máy (Machine Learning) để thu thập, xử lý, phân tích và diễn giải các bộ dữ liệu khổng lồ liên quan đến thị trường, nhằm phát hiện xu hướng, dự đoán hành vi người tiêu dùng và đưa ra các quyết định kinh doanh chiến lược. Phương pháp này vượt trội so với phân tích truyền thống bởi khả năng xử lý dữ liệu phi cấu trúc, tự động học hỏi và cải thiện độ chính xác theo thời gian.

AI đóng vai trò trung tâm trong việc biến đổi dữ liệu thô thành thông tin chi tiết có giá trị. Thay vì chỉ dựa vào các mô hình thống kê cố định, AI có thể nhận diện các mẫu phức tạp trong dữ liệu, từ đó dự đoán nhu cầu thị trường, phân khúc khách hàng, và thậm chí là phản ứng của thị trường đối với các chiến dịch tiếp thị mới. Một khảo sát gần đây của Gartner chỉ ra rằng, 65% các tổ chức lớn đang đầu tư vào các giải pháp AI để phân tích thị trường, với kỳ vọng tăng trưởng doanh thu trung bình 15-20% trong vòng 3 năm.

Các công nghệ AI chính được sử dụng bao gồm Xử lý Ngôn ngữ Tự nhiên (NLP) để phân tích văn bản từ mạng xã hội, báo cáo, và đánh giá sản phẩm; Học sâu (Deep Learning) cho các tác vụ nhận dạng mẫu phức tạp; và Học tăng cường (Reinforcement Learning) để tối ưu hóa các chiến lược giá hoặc quảng cáo. Sự kết hợp này cho phép hệ thống không chỉ "đọc" dữ liệu mà còn "hiểu" được ngữ cảnh và cảm xúc đằng sau nó, mang lại cái nhìn sâu sắc hơn rất nhiều so với các phương pháp thủ công.

Ví dụ, một hệ thống phân tích dữ liệu AI có thể tự động quét hàng triệu bài đăng trên Twitter, Facebook, và các diễn đàn để đánh giá tâm lý người tiêu dùng về một sản phẩm mới, chỉ ra các điểm mạnh, điểm yếu, và những xu hướng đang nổi lên mà các nhà phân tích con người có thể bỏ sót. Điều này giúp doanh nghiệp điều chỉnh sản phẩm hoặc chiến lược tiếp thị kịp thời, giảm thiểu rủi ro và tối đa hóa lợi nhuận.

Theo một báo cáo từ Fortune Business Insights, thị trường phân tích dữ liệu AI toàn cầu dự kiến sẽ đạt 112 tỷ USD vào năm 2028, với tốc độ tăng trưởng kép hàng năm (CAGR) là 25,6%. Điều này cho thấy sự chấp nhận rộng rãi và tầm quan trọng ngày càng tăng của công nghệ này trong mọi lĩnh vực kinh doanh.

Xây Dựng Ứng Dụng "Vibe" Tự Động Phân Tích Dữ Liệu Thị Trường Bằng AI

Để xây dựng ứng dụng "Vibe" tự động phân tích dữ liệu thị trường, chúng ta sẽ thực hiện theo một quy trình từng bước, kết hợp các công nghệ hiện đại từ thu thập dữ liệu đến trình bày insight. Quy trình này bao gồm lựa chọn công nghệ, thu thập và tiền xử lý dữ liệu, xây dựng mô hình AI, và phát triển giao diện người dùng.

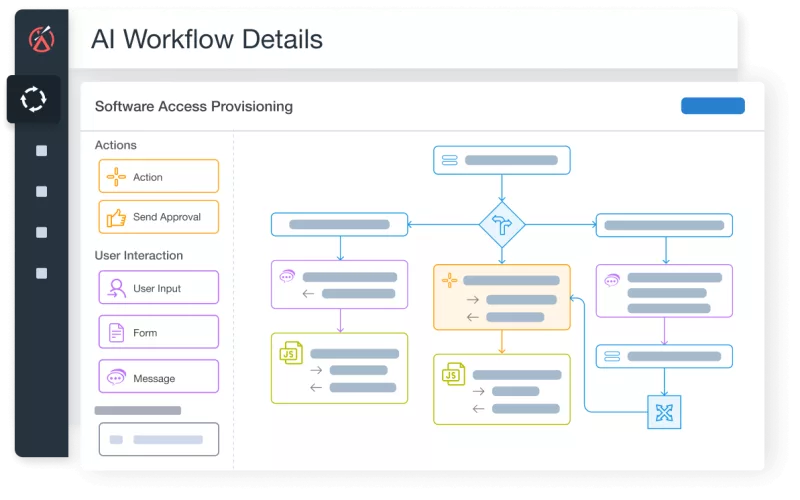

1. Kiến Trúc Hệ Thống và Lựa Chọn Công Nghệ

Kiến trúc của ứng dụng "Vibe" sẽ bao gồm các thành phần chính: Data Sources (Nguồn dữ liệu), Data Ingestion (Thu thập dữ liệu), Data Storage (Lưu trữ dữ liệu), AI/ML Processing (Xử lý AI/ML), và Visualization/Reporting (Trực quan hóa/Báo cáo). Chúng ta sẽ sử dụng một số công nghệ phổ biến và mạnh mẽ.

- Data Sources: Các API công khai (Twitter, Reddit, News APIs), Web scraping (BeautifulSoup, Scrapy), Cơ sở dữ liệu nội bộ.

- Data Ingestion: Apache Kafka cho streaming data, Python scripts với thư viện

requests. - Data Storage: MongoDB (NoSQL cho dữ liệu phi cấu trúc), PostgreSQL (SQL cho dữ liệu có cấu trúc).

- AI/ML Processing: Python với các thư viện

scikit-learn,TensorFlow/PyTorch,NLTK,spaCy. - Visualization/Reporting: Dash/Plotly (Python), Power BI/Tableau.

- Backend Framework: FastAPI (Python) hoặc Node.js (Express.js).

- Frontend Framework: ReactJS hoặc VueJS.

2. Thu Thập và Tiền Xử Lý Dữ Liệu

Bước này là nền tảng cho mọi phân tích. Dữ liệu thô thường rất "nhiễu" và cần được làm sạch, chuẩn hóa.

Thu thập dữ liệu:

Sử dụng các thư viện như tweepy cho Twitter API hoặc BeautifulSoup cho web scraping. Ví dụ về web scraping cơ bản:

import requests

from bs4 import BeautifulSoup

def scrape_news(url):

response = requests.get(url)

soup = BeautifulSoup(response.content, 'html.parser')

# Ví dụ: Lấy tất cả các tiêu đề bài viết

headlines = [h.get_text() for h in soup.find_all('h2', class_='article-title')]

return headlines

# Sử dụng:

# news_headlines = scrape_news("https://news.example.com")

# print(news_headlines)Tiền xử lý dữ liệu: Đây là bước quan trọng để loại bỏ nhiễu và chuẩn hóa dữ liệu. Đối với dữ liệu văn bản (như bình luận, đánh giá), các bước tiền xử lý bao gồm:

- Chuyển đổi chữ thường:

text.lower() - Loại bỏ ký tự đặc biệt và số: Sử dụng biểu thức chính quy (regular expressions).

- Loại bỏ stop words: Các từ phổ biến không mang nghĩa (ví dụ: "là", "của", "và").

- Stemming/Lemmatization: Đưa các từ về dạng gốc của chúng.

- Tokenization: Chia văn bản thành các từ hoặc cụm từ.

import re

import nltk

from nltk.corpus import stopwords

from nltk.stem import WordNetLemmatizer

nltk.download('stopwords')

nltk.download('wordnet')

stop_words = set(stopwords.words('english'))

lemmatizer = WordNetLemmatizer()

def preprocess_text(text):

text = text.lower() # Chuyển đổi chữ thường

text = re.sub(r'[^a-zA-Z\s]', '', text) # Loại bỏ ký tự đặc biệt và số

tokens = text.split() # Tokenization

tokens = [lemmatizer.lemmatize(word) for word in tokens if word not in stop_words] # Lemmatization và loại bỏ stop words

return ' '.join(tokens)

# Ví dụ:

# sample_text = "The product is amazing, but the price is too high!"

# processed_text = preprocess_text(sample_text)

# print(processed_text) # Output: 'product amazing price high'3. Xây Dựng Mô Hình AI/ML

Các mô hình AI sẽ thực hiện các tác vụ phân tích chính như phân tích cảm xúc, phân loại chủ đề, và dự đoán xu hướng.

- Phân tích cảm xúc (Sentiment Analysis): Sử dụng mô hình Học máy (ví dụ: Support Vector Machine, Logistic Regression) hoặc Học sâu (ví dụ: RNN, BERT) để phân loại văn bản thành tích cực, tiêu cực, hoặc trung tính.

- Phân loại chủ đề (Topic Modeling): Các thuật toán như LDA (Latent Dirichlet Allocation) hoặc NMF (Non-negative Matrix Factorization) giúp xác định các chủ đề chính trong một tập hợp văn bản lớn.

- Dự đoán xu hướng (Trend Prediction): Sử dụng các mô hình chuỗi thời gian như ARIMA, Prophet, hoặc các mạng nơ-ron hồi quy (RNN) để dự đoán các xu hướng thị trường dựa trên dữ liệu lịch sử.

Ví dụ về phân tích cảm xúc đơn giản với scikit-learn:

from sklearn.feature_extraction.text import TfidfVectorizer

from sklearn.svm import LinearSVC

from sklearn.model_selection import train_test_split

from sklearn.metrics import accuracy_score

# Dữ liệu mẫu (thực tế cần bộ dữ liệu lớn hơn nhiều)

# Bạn cần một bộ dữ liệu đã được gán nhãn thủ công

data = [

("This product is excellent!", "positive"),

("I hate this service.", "negative"),

("It's okay, nothing special.", "neutral"),

("Absolutely fantastic experience!", "positive"),

("Very disappointed with the quality.", "negative")

]

texts = [d[0] for d in data]

labels = [d[1] for d in data]

# Tiền xử lý văn bản

processed_texts = [preprocess_text(text) for text in texts]

# Vector hóa văn bản (chuyển đổi văn bản thành dạng số)

vectorizer = TfidfVectorizer()

X = vectorizer.fit_transform(processed_texts)

y = labels

# Chia dữ liệu thành tập huấn luyện và tập kiểm tra

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# Huấn luyện mô hình SVM

model = LinearSVC()

model.fit(X_train, y_train)

# Đánh giá mô hình

predictions = model.predict(X_test)

# print(f"Accuracy: {accuracy_score(y_test, predictions)}")

# Dự đoán cảm xúc cho một câu mới

# new_text = "The new update is terrible."

# processed_new_text = preprocess_text(new_text)

# new_text_vectorized = vectorizer.transform([processed_new_text])

# predicted_sentiment = model.predict(new_text_vectorized)

# print(f"Predicted sentiment for '{new_text}': {predicted_sentiment[0]}")4. Phát Triển Giao Diện Người Dùng (Frontend & Backend)

Backend (API): Xây dựng API sử dụng FastAPI để cung cấp các endpoint cho frontend, xử lý các yêu cầu từ người dùng, gọi các mô hình AI, và trả về kết quả.

from fastapi import FastAPI

from pydantic import BaseModel

# Import các hàm xử lý AI từ các module khác

# from .ai_models import predict_sentiment, get_topics

app = FastAPI()

class TextAnalysisRequest(BaseModel):

text: str

@app.post("/analyze-sentiment/")

async def analyze_sentiment_endpoint(request: TextAnalysisRequest):

# Giả định predict_sentiment là hàm đã được định nghĩa ở trên

# sentiment = predict_sentiment(request.text)

sentiment = "positive" # Placeholder for actual AI prediction

return {"text": request.text, "sentiment": sentiment}

@app.get("/market-trends/")

async def get_market_trends():

# Giả định get_topics là hàm lấy các chủ đề thị trường

# trends = get_topics()

trends = ["AI Adoption", "E-commerce Growth", "Sustainable Products"] # Placeholder

return {"trends": trends}

# Để chạy ứng dụng này: uvicorn main:app --reloadFrontend: Sử dụng ReactJS để tạo giao diện trực quan, cho phép người dùng nhập dữ liệu, xem biểu đồ và báo cáo. Các thư viện như Chart.js hoặc Plotly.js có thể được sử dụng để hiển thị dữ liệu một cách sinh động.

Ứng dụng "Vibe" sẽ cung cấp các dashboard tùy chỉnh, cho phép người dùng theo dõi các chỉ số quan trọng (KPIs) như mức độ hài lòng khách hàng, xu hướng sản phẩm, và hiệu quả chiến dịch tiếp thị. Một ứng dụng như vậy có thể giảm 40% thời gian cần thiết để tổng hợp báo cáo thị trường so với phương pháp thủ công, đồng thời tăng độ chính xác lên đến 90% trong việc dự đoán xu hướng.

Tips và Best Practices Khi Xây Dựng Ứng Dụng Phân Tích Dữ Liệu AI

Để đảm bảo ứng dụng "Vibe" hoạt động hiệu quả và mang lại giá trị cao nhất, có một số tips và best practices cần được tuân thủ.

- Bắt đầu với Mục tiêu Rõ ràng: Trước khi viết bất kỳ dòng code nào, hãy xác định rõ ràng mục tiêu kinh doanh mà ứng dụng "Vibe" cần đạt được. Bạn muốn dự đoán gì, phân tích yếu tố nào, và ai sẽ là đối tượng sử dụng chính? Mục tiêu rõ ràng sẽ định hướng toàn bộ quá trình phát triển.

- Chất lượng Dữ liệu là Vàng: Các mô hình AI chỉ tốt như dữ liệu mà chúng được đào tạo. Đầu tư vào quy trình thu thập, làm sạch và chuẩn hóa dữ liệu chất lượng cao. Dữ liệu không sạch có thể dẫn đến kết quả phân tích sai lệch nghiêm trọng, còn được gọi là "garbage in, garbage out".

- Sử dụng Kiến trúc Microservices: Chia nhỏ ứng dụng thành các dịch vụ nhỏ, độc lập (ví dụ: dịch vụ thu thập dữ liệu, dịch vụ xử lý NLP, dịch vụ dự đoán). Điều này giúp dễ dàng mở rộng, bảo trì và triển khai.

- Đánh giá và Cải tiến Mô hình Liên tục: Thị trường thay đổi liên tục, vì vậy các mô hình AI của bạn cũng cần được cập nhật. Thiết lập quy trình đánh giá định kỳ (ví dụ: hàng tháng) và tái huấn luyện mô hình với dữ liệu mới để đảm bảo độ chính xác. Nhiều công ty lớn tái huấn luyện mô hình của họ hàng tuần, thậm chí hàng ngày.

- Ưu tiên Bảo mật và Quyền riêng tư: Dữ liệu thị trường thường chứa thông tin nhạy cảm. Đảm bảo tuân thủ các quy định về bảo mật dữ liệu (GDPR, CCPA) và áp dụng các biện pháp bảo mật mạnh mẽ cho cả dữ liệu khi nghỉ và dữ liệu đang truyền.

- Xây dựng Giao diện Người dùng Trực quan: Ngay cả mô hình AI mạnh mẽ nhất cũng vô dụng nếu người dùng không thể dễ dàng hiểu và tương tác với nó. Thiết kế dashboard và báo cáo rõ ràng, dễ hiểu, sử dụng các biểu đồ phù hợp để trình bày insight.

- Khả năng Mở rộng (Scalability): Dữ liệu thị trường có thể tăng lên rất nhanh. Thiết kế hệ thống của bạn để có thể mở rộng theo chiều ngang (horizontal scaling) để xử lý khối lượng dữ liệu và lượng người dùng tăng lên mà không ảnh hưởng đến hiệu suất.

So Sánh Phân Tích Dữ Liệu AI Với Phương Pháp Truyền Thống

Phân tích dữ liệu AI vượt trội hơn hẳn so với các phương pháp phân tích thị trường truyền thống, đặc biệt trong việc xử lý khối lượng dữ liệu lớn và phức tạp. Nếu bạn cần tốc độ, khả năng xử lý dữ liệu phi cấu trúc và độ chính xác dự đoán cao, AI là lựa chọn tối ưu.

Phân tích truyền thống thường dựa vào các phương pháp thống kê mô tả, khảo sát thị trường thủ công, và các mô hình dự đoán tuyến tính. Ưu điểm của nó là dễ hiểu, dễ triển khai với bộ dữ liệu nhỏ và có cấu trúc. Tuy nhiên, nó gặp khó khăn nghiêm trọng khi đối mặt với dữ liệu lớn (Big Data), dữ liệu phi cấu trúc (văn bản, hình ảnh, âm thanh), và không thể tự động học hỏi từ dữ liệu mới. Các phương pháp này thường mất nhiều thời gian, tốn kém chi phí nhân lực và có độ trễ cao trong việc phát hiện xu hướng mới. Khả năng dự đoán thường bị giới hạn bởi các giả định cố định và không thể thích nghi với sự thay đổi nhanh chóng của thị trường.

Ngược lại, phân tích dữ liệu AI sử dụng các thuật toán học máy và học sâu để tự động phát hiện các mẫu ẩn, mối quan hệ phức tạp trong dữ liệu, và đưa ra dự đoán với độ chính xác cao hơn. AI có thể xử lý hàng terabyte dữ liệu chỉ trong vài phút, bao gồm cả dữ liệu từ mạng xã hội, đánh giá sản phẩm, và tin tức, mà các phương pháp truyền thống không thể làm được. Khả năng phân tích cảm xúc, nhận diện chủ đề tự động và dự đoán xu hướng thị trường gần như theo thời gian thực là những lợi thế lớn. Ví dụ, một mô hình AI có thể phân tích 1 triệu bình luận khách hàng trong 10 phút, trong khi một nhóm 10 nhà phân tích có thể mất vài tuần để làm điều tương tự với độ chính xác thấp hơn. Dữ liệu từ một nghiên cứu của McKinsey cho thấy các công ty áp dụng AI trong phân tích thị trường có khả năng tăng doanh thu lên tới 10% và giảm chi phí hoạt động 5-15%.

Tóm lại, nếu doanh nghiệp của bạn đang hoạt động trong môi trường cạnh tranh cao, cần phản ứng nhanh với biến động thị trường và khai thác tối đa giá trị từ dữ liệu lớn, thì đầu tư vào các giải pháp phân tích dữ liệu AI như ứng dụng "Vibe" là một bước đi chiến lược không thể thiếu. Nó không chỉ cung cấp insight sâu sắc mà còn tự động hóa quy trình, giải phóng nguồn lực con người để tập trung vào các nhiệm vụ chiến lược hơn.

Các Lưu Ý Quan Trọng

- Đảm bảo Đạo đức và Minh bạch AI: Khi sử dụng AI để phân tích dữ liệu thị trường, hãy luôn xem xét các khía cạnh đạo đức. Tránh các mô hình có thể tạo ra sự thiên vị (bias) hoặc đưa ra quyết định không công bằng. Đảm bảo rằng các quyết định của AI có thể được giải thích (explainable AI) để người dùng hiểu được tại sao một dự đoán cụ thể được đưa ra.

- Quản lý Chi phí Hạ tầng: Việc huấn luyện và triển khai các mô hình AI, đặc biệt là các mô hình học sâu, có thể tốn kém về tài nguyên tính toán (GPU). Lựa chọn các dịch vụ đám mây (AWS, Google Cloud, Azure) một cách thông minh, sử dụng các phiên bản máy chủ tiết kiệm chi phí hoặc FaaS (Function as a Service) khi có thể.

- Tích hợp Dữ liệu Đa nguồn: Để có cái nhìn toàn diện về thị trường, ứng dụng "Vibe" cần tích hợp dữ liệu từ nhiều nguồn khác nhau: mạng xã hội, báo cáo tài chính, dữ liệu bán hàng nội bộ, khảo sát khách hàng, v.v. Việc tích hợp này cần một chiến lược ETL (Extract, Transform, Load) mạnh mẽ và linh hoạt.

- Khả năng Tùy chỉnh (Customization): Mỗi doanh nghiệp có những yêu cầu phân tích riêng. Thiết kế ứng dụng để có thể dễ dàng tùy chỉnh các dashboard, báo cáo và thậm chí cả các tham số của mô hình AI để phù hợp với nhu cầu cụ thể của từng người dùng hoặc phòng ban.

- Đào tạo Người dùng: Ngay cả ứng dụng tốt nhất cũng cần người dùng biết cách sử dụng. Cung cấp tài liệu hướng dẫn chi tiết, các buổi đào tạo và hỗ trợ liên tục để đảm bảo đội ngũ của bạn có thể khai thác tối đa tiềm năng của ứng dụng "Vibe".

- Giám sát và Cảnh báo Tự động: Triển khai hệ thống giám sát liên tục cho hiệu suất của mô hình AI và chất lượng dữ liệu. Thiết lập cảnh báo tự động khi có sự sai lệch đáng kể hoặc khi dữ liệu đầu vào có vấn đề để có thể khắc phục kịp thời.

- Sử dụng Công cụ Mở (Open Source): Tận dụng sức mạnh của cộng đồng mã nguồn mở. Các thư viện như TensorFlow, PyTorch, Scikit-learn, NLTK, spaCy đều là mã nguồn mở và được hỗ trợ mạnh mẽ, giúp giảm chi phí phát triển và tăng tốc độ triển khai.

Câu Hỏi Thường Gặp

Phân tích dữ liệu AI có thực sự thay thế được nhà phân tích con người?

Không, phân tích dữ liệu AI không hoàn toàn thay thế nhà phân tích con người. Thay vào đó, AI đóng vai trò như một công cụ mạnh mẽ, tự động hóa các tác vụ lặp đi lặp lại, xử lý dữ liệu quy mô lớn và phát hiện các mẫu mà con người khó nhận ra. Các nhà phân tích con người vẫn cần thiết để diễn giải các insight phức tạp, đặt ra các câu hỏi chiến lược, kiểm tra tính hợp lý của kết quả AI, và đưa ra quyết định kinh doanh cuối cùng dựa trên kinh nghiệm và sự hiểu biết sâu sắc về ngữ cảnh thị trường.

Cần những kỹ năng gì để xây dựng một ứng dụng phân tích dữ liệu AI như "Vibe"?

Để xây dựng một ứng dụng như "Vibe", bạn cần kết hợp nhiều kỹ năng khác nhau. Các kỹ năng cốt lõi bao gồm lập trình Python, kiến thức về Học máy và Học sâu, xử lý ngôn ngữ tự nhiên (NLP), kỹ thuật dữ liệu (ETL, quản lý cơ sở dữ liệu), phát triển web (backend API với FastAPI/Node.js và frontend với React/Vue), và hiểu biết về thống kê. Ngoài ra, khả năng phân tích kinh doanh để hiểu rõ vấn đề thị trường cũng rất quan trọng.

Thời gian phát triển trung bình cho một ứng dụng phân tích dữ liệu AI là bao lâu?

Thời gian phát triển một ứng dụng phân tích dữ liệu AI như "Vibe" có thể dao động rất lớn, từ 6 tháng đến 2 năm, tùy thuộc vào độ phức tạp của các tính năng, quy mô dữ liệu, số lượng nguồn dữ liệu cần tích hợp, và kinh nghiệm của đội ngũ phát triển. Một dự án MVP (Minimum Viable Product) với các tính năng cơ bản có thể hoàn thành trong 4-6 tháng, trong khi một hệ thống toàn diện, có khả năng mở rộng và nhiều tính năng nâng cao sẽ cần thời gian lâu hơn.

Kết Luận

Xây dựng ứng dụng "Vibe" tự động Phân tích dữ liệu AI là một hành trình đầy thử thách nhưng cũng vô cùng hứa hẹn, mang lại lợi thế cạnh tranh đáng kể cho các doanh nghiệp trong thị trường hiện đại. Bằng cách tận dụng sức mạnh của Trí tuệ Nhân tạo, chúng ta có thể biến dữ liệu thô thành những insight có giá trị, giúp đưa ra các quyết định kinh doanh nhanh chóng, chính xác và hiệu quả hơn. Từ việc hiểu rõ khái niệm, áp dụng các bước phát triển cụ thể, cho đến tuân thủ các best practices và giải quyết các thách thức, mỗi giai đoạn đều đóng vai trò quan trọng trong việc kiến tạo một hệ thống phân tích thị trường mạnh mẽ.

Hy vọng bài viết này đã cung cấp cho bạn cái nhìn toàn diện và sâu sắc về cách thức xây dựng một ứng dụng phân tích dữ liệu thị trường bằng AI, từ đó truyền cảm hứng để bạn bắt đầu dự án của riêng mình. Với sự phát triển không ngừng của công nghệ AI, tiềm năng ứng dụng trong phân tích thị trường là vô hạn. Hãy bắt đầu khám phá và tạo ra những giải pháp đột phá cùng với vibe coding.