Giới Thiệu "Prompt Chaining": Nâng Tầm AI Coding Thành Quy Trình Chuyên Nghiệp Cùng Vibe Coding

Trong thế giới phát triển AI đang bùng nổ, việc tương tác hiệu quả với các mô hình ngôn ngữ lớn (LLM) như GPT-4, Claude hay Gemini đã trở thành một kỹ năng thiết yếu. Tuy nhiên, việc đưa ra một prompt duy nhất để giải quyết các tác vụ phức tạp thường gặp nhiều hạn chế. Đây chính là lúc kỹ thuật prompt chaining tỏa sáng, biến quá trình "nói chuyện" với AI từ một cuộc đối thoại ngẫu hứng thành một quy trình làm việc có cấu trúc, mạnh mẽ và chuyên nghiệp. Bài viết này sẽ đi sâu vào cách prompt chaining giúp bạn tối ưu hóa việc sử dụng AI trong coding, nâng cao chất lượng và hiệu quả công việc, đặc biệt trong lĩnh vực AI Development.

Kỹ thuật prompt chaining không chỉ đơn thuần là việc nối tiếp các prompt lại với nhau; nó là một phương pháp tư duy có hệ thống, phân rã một vấn đề lớn thành nhiều bước nhỏ hơn, mỗi bước được xử lý bởi một prompt riêng biệt và kết quả của bước trước sẽ là đầu vào cho bước tiếp theo. Điều này mở ra cánh cửa cho việc xây dựng các ứng dụng AI phức tạp, đáng tin cậy và dễ bảo trì hơn, vượt xa khả năng của những prompt đơn lẻ.

Prompt Chaining: Khái Niệm, Lợi Ích và Cơ Chế Hoạt Động

Prompt chaining, hay còn gọi là chuỗi prompt, là một kỹ thuật tiên tiến trong kỹ thuật prompt (prompt engineering) mà ở đó, bạn không chỉ đưa ra một prompt duy nhất cho mô hình AI. Thay vào đó, bạn xây dựng một chuỗi các prompt liên tiếp, mỗi prompt được thiết kế để thực hiện một tác vụ cụ thể và kết quả đầu ra từ một prompt sẽ được sử dụng làm đầu vào cho prompt tiếp theo trong chuỗi. Điều này tạo ra một "dòng chảy" thông tin có cấu trúc, cho phép AI xử lý các vấn đề phức tạp theo từng bước logic rõ ràng.

Lợi ích chính của prompt chaining là khả năng giải quyết các tác vụ đa bước mà một prompt đơn lẻ khó có thể thực hiện hiệu quả. Khi một vấn vụ quá lớn hoặc quá mơ hồ, AI dễ bị "lạc lối" hoặc đưa ra kết quả không chính xác. Prompt chaining giúp chia nhỏ vấn đề, giảm tải nhận thức cho AI ở mỗi bước, từ đó tăng độ chính xác và độ tin cậy của kết quả cuối cùng. Nó cũng giúp quản lý và debug quá trình tương tác với AI dễ dàng hơn, vì bạn có thể kiểm tra và điều chỉnh từng bước trong chuỗi.

Về cơ chế hoạt động, hãy hình dung bạn muốn AI viết một ứng dụng web đơn giản. Thay vì yêu cầu "viết ứng dụng web", bạn có thể chia thành các bước: 1) "Thiết kế cấu trúc file và thư mục cho một ứng dụng web React với Node.js backend", 2) "Dựa trên cấu trúc đó, tạo mã nguồn cho file package.json và server.js", 3) "Tiếp theo, tạo một component React cơ bản cho trang chủ", v.v. Mỗi bước này là một prompt, và output của prompt trước (ví dụ, cấu trúc thư mục) trở thành ngữ cảnh hoặc yêu cầu cho prompt sau. Kỹ thuật prompt chaining cho phép chúng ta xây dựng các quy trình tự động hóa phức tạp và linh hoạt, nâng cao năng suất đáng kể trong AI development.

Một khía cạnh quan trọng khác của prompt chaining là khả năng tích hợp các công cụ bên ngoài (tool use) hoặc các API. Một bước trong chuỗi có thể là yêu cầu AI sinh ra một đoạn code để gọi một API, sau đó prompt tiếp theo sẽ sử dụng kết quả từ API đó để tiếp tục xử lý. Điều này biến LLM không chỉ thành một công cụ sinh văn bản mà còn là một bộ não điều phối các tác vụ phức tạp, kết nối với thế giới bên ngoài thông qua các công cụ.

Cuối cùng, prompt chaining khuyến khích một tư duy thiết kế hệ thống. Thay vì coi AI như một "hộp đen" ma thuật, chúng ta bắt đầu xem xét nó như một thành phần trong một quy trình lớn hơn. Điều này đặc biệt hữu ích trong các dự án AI development quy mô, nơi sự rõ ràng, khả năng mở rộng và bảo trì là cực kỳ quan trọng. Việc áp dụng prompt chaining một cách chiến lược sẽ giúp bạn khai thác tối đa sức mạnh của AI, biến những ý tưởng phức tạp thành hiện thực một cách hiệu quả.

Hướng Dẫn Thực Hành Prompt Chaining Trong AI Coding

Để minh họa prompt chaining, chúng ta sẽ xây dựng một ví dụ thực tế: tạo một RESTful API đơn giản với Node.js và Express, sau đó viết một client React để tương tác với API đó. Chúng ta sẽ chia quá trình này thành nhiều bước, mỗi bước là một prompt độc lập.

Bước 1: Thiết Kế API Endpoint

Prompt đầu tiên sẽ tập trung vào việc định nghĩa các endpoint cần thiết cho API.

Prompt 1:

"Tôi muốn xây dựng một RESTful API cho một ứng dụng quản lý tác vụ đơn giản.

API này cần hỗ trợ các thao tác CRUD cho một resource tên là 'tasks'.

Hãy liệt kê các endpoint HTTP method và path tương ứng cho 'tasks' resource, cùng với mô tả ngắn gọn về chức năng của mỗi endpoint.

Ví dụ:

- GET /tasks: Lấy tất cả tác vụ

- POST /tasks: Tạo tác vụ mới"Kết quả từ AI (Output 1) sẽ là một danh sách các endpoint, ví dụ:

Output 1:

- GET /tasks: Lấy tất cả các tác vụ hiện có.

- GET /tasks/:id: Lấy thông tin chi tiết của một tác vụ cụ thể bằng ID.

- POST /tasks: Tạo một tác vụ mới. Yêu cầu body chứa thông tin tác vụ.

- PUT /tasks/:id: Cập nhật thông tin của một tác vụ hiện có bằng ID. Yêu cầu body chứa thông tin cập nhật.

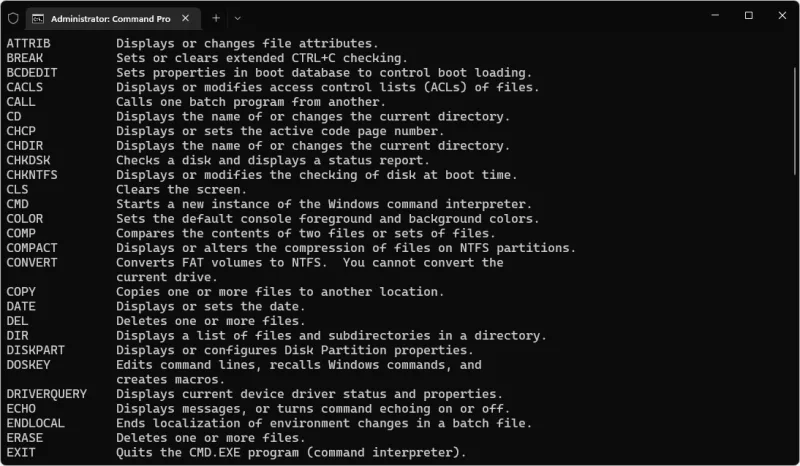

- DELETE /tasks/:id: Xóa một tác vụ cụ thể bằng ID.Bước 2: Phát Triển Backend API với Node.js và Express

Sử dụng Output 1 làm cơ sở, chúng ta sẽ yêu cầu AI viết mã nguồn Node.js/Express.

Prompt 2:

"Dựa trên các endpoint sau:

{{Output 1}}

Hãy viết mã nguồn Node.js sử dụng Express.js để triển khai các endpoint này.

Sử dụng một mảng trong bộ nhớ làm nơi lưu trữ tạm thời cho các tác vụ thay vì cơ sở dữ liệu.

Mỗi tác vụ nên có cấu trúc: `{ id: string, title: string, completed: boolean }`.

Đảm bảo có xử lý lỗi cơ bản và sử dụng JSON để trả về dữ liệu.

Cổng server là 3000."AI sẽ sinh ra code tương tự như sau:

Output 2 (Code cho `server.js`):

const express = require('express');

const bodyParser = require('body-parser');

const cors = require('cors'); // Để cho phép frontend truy cập

const { v4: uuidv4 } = require('uuid'); // Để tạo ID duy nhất

const app = express();

const PORT = 3000;

app.use(cors());

app.use(bodyParser.json());

let tasks = [

{ id: uuidv4(), title: 'Học Prompt Chaining', completed: false },

{ id: uuidv4(), title: 'Viết bài blog', completed: true }

];

// GET all tasks

app.get('/tasks', (req, res) => {

res.json(tasks);

});

// GET task by ID

app.get('/tasks/:id', (req, res) => {

const { id } = req.params;

const task = tasks.find(t => t.id === id);

if (task) {

res.json(task);

} else {

res.status(404).json({ message: 'Task not found' });

}

});

// POST new task

app.post('/tasks', (req, res) => {

const { title } = req.body;

if (!title) {

return res.status(400).json({ message: 'Title is required' });

}

const newTask = { id: uuidv4(), title, completed: false };

tasks.push(newTask);

res.status(201).json(newTask);

});

// PUT update task

app.put('/tasks/:id', (req, res) => {

const { id } = req.params;

const { title, completed } = req.body;

const taskIndex = tasks.findIndex(t => t.id === id);

if (taskIndex !== -1) {

tasks[taskIndex] = { ...tasks[taskIndex], title: title || tasks[taskIndex].title, completed: typeof completed === 'boolean' ? completed : tasks[taskIndex].completed };

res.json(tasks[taskIndex]);

} else {

res.status(404).json({ message: 'Task not found' });

}

});

// DELETE task

app.delete('/tasks/:id', (req, res) => {

const { id } = req.params;

const initialLength = tasks.length;

tasks = tasks.filter(t => t.id !== id);

if (tasks.length < initialLength) {

res.status(204).send(); // No Content

} else {

res.status(404).json({ message: 'Task not found' });

}

});

app.listen(PORT, () => {

console.log(`Server running on http://localhost:${PORT}`);

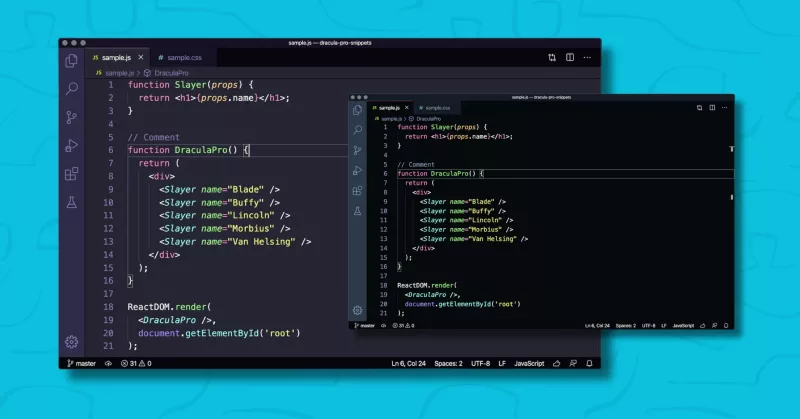

});Bước 3: Phát Triển Frontend React Component

Bây giờ, chúng ta sẽ chuyển sang phần frontend, yêu cầu AI tạo một component React để hiển thị và quản lý các tác vụ, tương tác với API vừa tạo.

Prompt 3:

"Sử dụng React.js, hãy viết một component đơn giản có tên `TaskList` để hiển thị danh sách các tác vụ.

Component này cần có khả năng:

1. Lấy danh sách tác vụ từ API backend tại `http://localhost:3000/tasks` khi component được mount.

2. Hiển thị tiêu đề và trạng thái hoàn thành của mỗi tác vụ.

3. Cho phép thêm một tác vụ mới thông qua một input field và nút 'Add Task'.

4. Cho phép đánh dấu một tác vụ là hoàn thành hoặc chưa hoàn thành.

5. Cho phép xóa một tác vụ.

Sử dụng `fetch` API để tương tác với backend. Tập trung vào logic và giao diện cơ bản."AI sẽ sinh ra code React component:

Output 3 (Code cho `TaskList.js`):

import React, { useState, useEffect } from 'react';

const API_BASE_URL = 'http://localhost:3000/tasks';

function TaskList() {

const [tasks, setTasks] = useState([]);

const [newTaskTitle, setNewTaskTitle] = useState('');

useEffect(() => {

fetchTasks();

}, []);

const fetchTasks = async () => {

try {

const response = await fetch(API_BASE_URL);

if (!response.ok) {

throw new Error(`HTTP error! status: ${response.status}`);

}

const data = await response.json();

setTasks(data);

} catch (error) {

console.error("Error fetching tasks:", error);

}

};

const handleAddTask = async () => {

if (!newTaskTitle.trim()) return;

try {

const response = await fetch(API_BASE_URL, {

method: 'POST',

headers: {

'Content-Type': 'application/json',

},

body: JSON.stringify({ title: newTaskTitle }),

});

if (!response.ok) {

throw new Error(`HTTP error! status: ${response.status}`);

}

const newTask = await response.json();

setTasks([...tasks, newTask]);

setNewTaskTitle('');

} catch (error) {

console.error("Error adding task:", error);

}

};

const handleToggleComplete = async (id, completed) => {

try {

const response = await fetch(`${API_BASE_URL}/${id}`, {

method: 'PUT',

headers: {

'Content-Type': 'application/json',

},

body: JSON.stringify({ completed: !completed }),

});

if (!response.ok) {

throw new Error(`HTTP error! status: ${response.status}`);

}

const updatedTask = await response.json();

setTasks(tasks.map(task =>

task.id === id ? { ...task, completed: updatedTask.completed } : task

));

} catch (error) {

console.error("Error toggling task complete status:", error);

}

};

const handleDeleteTask = async (id) => {

try {

const response = await fetch(`${API_BASE_URL}/${id}`, {

method: 'DELETE',

});

if (!response.ok) {

throw new Error(`HTTP error! status: ${response.status}`);

}

setTasks(tasks.filter(task => task.id !== id));

} catch (error) {

console.error("Error deleting task:", error);

}

};

return (

<div>

<h1>Task List</h1>

<div>

<input

type="text"

value={newTaskTitle}

onChange={(e) => setNewTaskTitle(e.target.value)}

placeholder="Add new task"

/>

<button onClick={handleAddTask}>Add Task</button>

</div>

<ul>

{tasks.map((task) => (

<li key={task.id} style={{ textDecoration: task.completed ? 'line-through' : 'none' }}>

{task.title}

<input

type="checkbox"

checked={task.completed}

onChange={() => handleToggleComplete(task.id, task.completed)}

/>

<button onClick={() => handleDeleteTask(task.id)}>Delete</button>

</li>

))}

</ul>

</div>

);

}

export default TaskList;Như bạn thấy, prompt chaining đã giúp chúng ta xây dựng một ứng dụng full-stack đơn giản bằng cách chia nhỏ vấn đề thành các bước logic, mỗi bước được AI xử lý một cách hiệu quả. Đây là một ví dụ mạnh mẽ về cách prompt chaining có thể tăng tốc quá trình phát triển và đảm bảo tính nhất quán giữa các thành phần.

Tips và Best Practices Khi Sử Dụng Prompt Chaining

Để tối ưu hóa hiệu quả của prompt chaining, có một số tips và best practices mà bạn nên áp dụng:

- Chia nhỏ vấn đề một cách hợp lý: Đây là nguyên tắc cốt lõi. Đừng cố gắng nhồi nhét quá nhiều yêu cầu vào một prompt. Mỗi prompt nên có một mục tiêu rõ ràng, cụ thể và có thể quản lý được. Một prompt quá dài hoặc quá phức tạp sẽ làm giảm chất lượng đầu ra của AI.

- Định dạng đầu ra rõ ràng: Luôn yêu cầu AI định dạng đầu ra của mỗi prompt theo một cấu trúc nhất quán (ví dụ: JSON, Markdown, hoặc một danh sách có gạch đầu dòng). Điều này giúp bạn dễ dàng trích xuất thông tin và sử dụng làm đầu vào cho prompt tiếp theo một cách tự động. Ví dụ, bạn có thể yêu cầu "Trả về kết quả dưới dạng JSON với khóa 'endpoints' là một mảng các đối tượng."

- Sử dụng biến và placeholders: Khi xây dựng chuỗi prompt, hãy coi các đầu ra của prompt trước là "biến" mà bạn có thể chèn vào prompt sau. Như trong ví dụ trên,

{{Output 1}}là một placeholder. Các thư viện prompt engineering hiện đại thường hỗ trợ cơ chế này. - Xử lý lỗi và xác thực đầu ra: Mặc dù AI ngày càng thông minh, nhưng không phải lúc nào nó cũng trả về kết quả hoàn hảo. Hãy thêm các bước xác thực (validation) đầu ra của mỗi prompt trước khi chuyển sang prompt tiếp theo. Nếu đầu ra không hợp lệ, bạn có thể yêu cầu AI thử lại hoặc có cơ chế fallback.

- Cung cấp ngữ cảnh đầy đủ nhưng không thừa: Mỗi prompt cần đủ ngữ cảnh để AI hiểu yêu cầu, nhưng tránh lặp lại thông tin không cần thiết từ các prompt trước đó. Chỉ cung cấp những gì cần thiết cho tác vụ hiện tại.

- Iterative refinement (Cải tiến lặp): Prompt chaining không phải là một quy trình một chiều. Đôi khi, bạn có thể cần quay lại và điều chỉnh một prompt ở giữa chuỗi nếu phát hiện ra rằng nó không cung cấp đầu ra mong muốn cho các bước tiếp theo. Đây là một quá trình học hỏi và tinh chỉnh liên tục.

- Sử dụng công cụ hỗ trợ: Có rất nhiều thư viện và framework được thiết kế để hỗ trợ prompt chaining, ví dụ như LangChain, LlamaIndex, hay các workflow engine tùy chỉnh. Những công cụ này giúp bạn quản lý chuỗi prompt, xử lý luồng dữ liệu và tích hợp các công cụ bên ngoài một cách hiệu quả.

Bằng cách tuân thủ các best practices này, bạn sẽ có thể xây dựng các chuỗi prompt mạnh mẽ và đáng tin cậy, biến các tác vụ AI coding phức tạp thành các quy trình làm việc có cấu trúc và hiệu quả.

So Sánh Prompt Chaining Với Các Kỹ Thuật Prompting Khác

Để hiểu rõ hơn giá trị của prompt chaining, chúng ta hãy so sánh nó với một số kỹ thuật prompting phổ biến khác:

Prompt Chaining vs. One-Shot/Zero-Shot Prompting

One-shot/Zero-shot prompting là cách tiếp cận cơ bản nhất, nơi bạn đưa ra một prompt duy nhất cho AI.

- Zero-shot: Chỉ cung cấp yêu cầu, không có ví dụ. Ví dụ: "Viết một bài thơ về mùa thu."

- One-shot: Cung cấp một yêu cầu kèm theo một ví dụ minh họa. Ví dụ: "Dịch từ tiếng Anh sang tiếng Việt. Ví dụ: 'Hello' -> 'Xin chào'. Bây giờ dịch 'Goodbye'."

Ưu điểm của One-shot/Zero-shot: Đơn giản, nhanh chóng, phù hợp cho các tác vụ đơn giản, không yêu cầu nhiều bước xử lý hoặc ngữ cảnh phức tạp.

Hạn chế: Kém hiệu quả với các tác vụ phức tạp, đa bước. AI dễ bị sai lệch hoặc đưa ra kết quả không đầy đủ vì thiếu khả năng chia nhỏ và xử lý từng phần. Không có khả năng điều chỉnh từng bước.

Prompt Chaining vượt trội hơn: Bằng cách chia nhỏ vấn đề, prompt chaining giải quyết được hạn chế này. Nó cho phép mỗi "shot" (mỗi prompt trong chuỗi) tập trung vào một phần của vấn đề, tích lũy ngữ cảnh và thông tin qua từng bước. Điều này giống như việc hướng dẫn một người giải toán từng bước một, thay vì chỉ đưa ra bài toán và mong đợi kết quả ngay lập tức.

Prompt Chaining vs. Few-Shot Prompting

Few-shot prompting là việc cung cấp nhiều ví dụ (vài "shot") trong một prompt duy nhất để AI học hỏi mẫu và đưa ra câu trả lời phù hợp.

- Ví dụ: "Dịch sang tiếng Việt. 'Hello' -> 'Xin chào'. 'Thank you' -> 'Cảm ơn'. 'Please' -> 'Vui lòng'. Bây giờ dịch 'Sorry'."

Ưu điểm: Nâng cao đáng kể chất lượng kết quả so với zero-shot/one-shot, đặc biệt với các tác vụ yêu cầu sự hiểu biết về mẫu hoặc phong cách cụ thể.

Hạn chế:

- Kích thước ngữ cảnh (context window) giới hạn: Với nhiều ví dụ, prompt có thể trở nên rất dài và vượt quá giới hạn token của LLM, đặc biệt với các mô hình cũ hơn hoặc các tác vụ phức tạp.

- Khó khăn trong việc debug: Nếu kết quả sai, rất khó để biết ví dụ nào hoặc phần nào của prompt gây ra lỗi.

- Không linh hoạt: Các ví dụ là tĩnh. Nếu vấn đề yêu cầu thay đổi logic giữa các bước, few-shot không thể đáp ứng.

Prompt Chaining vượt trội hơn: Prompt chaining giải quyết vấn đề giới hạn ngữ cảnh bằng cách phân tán các "ví dụ" hoặc hướng dẫn qua nhiều prompt. Mỗi prompt có thể được tinh chỉnh riêng biệt, và kết quả của mỗi bước có thể được kiểm tra và sửa đổi trước khi chuyển sang bước tiếp theo, giúp quá trình debug hiệu quả hơn nhiều. Nó mang lại sự linh hoạt cao hơn, cho phép điều chỉnh hành vi của AI ở từng giai đoạn của quy trình.

Prompt Chaining vs. Tree of Thought (ToT) / Chain of Thought (CoT)

Chain of Thought (CoT) là kỹ thuật yêu cầu LLM "suy nghĩ từng bước" hoặc "giải thích suy nghĩ của nó" trước khi đưa ra câu trả lời cuối cùng.

- Ví dụ: "Giải bài toán này và giải thích từng bước suy nghĩ của bạn."

Tree of Thought (ToT) là một mở rộng của CoT, cho phép LLM khám phá nhiều con đường suy nghĩ song song và tự đánh giá các lựa chọn tốt nhất.

Mối quan hệ với Prompt Chaining: CoT và ToT thường được coi là các chiến lược prompting bên trong một prompt, khuyến khích AI tự tạo ra các bước trung gian. Prompt chaining thì lại là một chiến lược cấp cao hơn, nơi con người (hoặc một hệ thống tự động) chủ động định nghĩa các bước trung gian và sử dụng các prompt riêng biệt cho mỗi bước.

Sức mạnh tổng hợp: Trên thực tế, prompt chaining và CoT/ToT có thể kết hợp với nhau. Bạn có thể sử dụng prompt chaining để định nghĩa các giai đoạn chính của một quy trình, và trong mỗi giai đoạn đó, bạn có thể áp dụng CoT hoặc ToT để khuyến khích AI suy nghĩ sâu hơn về tác vụ cụ thể của giai đoạn đó. Ví dụ, một prompt trong chuỗi có thể là "Phân tích yêu cầu này và đưa ra các bước giải quyết chi tiết, giải thích từng bước suy nghĩ của bạn (CoT)."

Tóm lại, prompt chaining không phải là một kỹ thuật thay thế mà là một kỹ thuật bổ sung mạnh mẽ, đặc biệt khi bạn cần xây dựng các ứng dụng AI phức tạp, có cấu trúc và yêu cầu sự kiểm soát chặt chẽ qua từng giai đoạn xử lý.

Các Lưu Ý Quan Trọng

- Chi phí: Mỗi lần gọi API của LLM đều tốn chi phí. Prompt chaining có thể dẫn đến nhiều lời gọi API hơn, do đó cần cân nhắc hiệu quả chi phí, đặc biệt với các mô hình đắt tiền.

- Độ trễ (Latency): Việc thực hiện nhiều prompt liên tiếp sẽ làm tăng tổng độ trễ của quy trình. Đối với các ứng dụng yêu cầu phản hồi theo thời gian thực, cần tối ưu hóa số lượng và độ phức tạp của các prompt trong chuỗi.

- Quản lý ngữ cảnh: Đảm bảo rằng ngữ cảnh được truyền từ prompt này sang prompt khác một cách hiệu quả và không bị mất mát thông tin quan trọng. Đồng thời, tránh truyền quá nhiều thông tin không cần thiết, gây lãng phí token và làm loãng ngữ cảnh.

- Sự nhất quán của mô hình: Khi sử dụng prompt chaining, bạn đang dựa vào sự nhất quán của mô hình qua nhiều lượt tương tác. Đôi khi, cùng một prompt có thể cho ra kết quả hơi khác nhau. Cần có cơ chế xử lý sự không nhất quán này, ví dụ như thử lại hoặc có các quy tắc kiểm tra đầu ra nghiêm ngặt hơn.

- Tính bảo mật và quyền riêng tư: Nếu chuỗi prompt xử lý dữ liệu nhạy cảm, hãy đảm bảo rằng dữ liệu đó được xử lý an toàn qua từng bước và không bị rò rỉ hoặc lưu trữ không đúng cách trong các nhật ký của LLM.

- Khả năng mở rộng: Khi thiết kế chuỗi prompt, hãy nghĩ đến khả năng mở rộng. Liệu chuỗi này có dễ dàng thêm các bước mới, điều chỉnh logic hay không? Sử dụng các thư viện như LangChain có thể giúp ích rất nhiều trong việc này.

- Phản hồi của người dùng (Human-in-the-loop): Đối với các tác vụ quan trọng, việc có một bước "human-in-the-loop" (con người tham gia vào vòng lặp) để xem xét và phê duyệt kết quả từ một prompt quan trọng trước khi chuyển sang prompt tiếp theo có thể tăng cường độ tin cậy.

Câu Hỏi Thường Gặp

Prompt chaining có phải là một kỹ thuật cho người mới bắt đầu không?

Prompt chaining thường được coi là một kỹ thuật nâng cao hơn so với prompt đơn lẻ. Nó đòi hỏi sự hiểu biết về cách LLM hoạt động, khả năng phân tích vấn đề thành các bước nhỏ và kỹ năng thiết kế luồng công việc. Tuy nhiên, với các hướng dẫn và ví dụ cụ thể, người mới bắt đầu hoàn toàn có thể học và áp dụng hiệu quả.

Làm thế nào để kiểm soát kích thước ngữ cảnh khi sử dụng prompt chaining?

Để kiểm soát kích thước ngữ cảnh, bạn nên chắt lọc thông tin cần thiết nhất từ đầu ra của prompt trước để đưa vào prompt sau. Tránh sao chép toàn bộ văn bản. Bạn có thể sử dụng các kỹ thuật tóm tắt (summarization) hoặc trích xuất thông tin chính (information extraction) làm một bước trong chuỗi để giảm bớt lượng dữ liệu truyền đi, đặc biệt khi làm việc với các đoạn văn bản dài.

Có công cụ nào hỗ trợ xây dựng và quản lý prompt chaining không?

Chắc chắn rồi! Các framework như LangChain và LlamaIndex là những công cụ hàng đầu hỗ trợ prompt chaining. Chúng cung cấp các module để tạo chuỗi, quản lý các tác nhân (agents), tích hợp công cụ (tool integration) và xử lý luồng dữ liệu, giúp việc xây dựng các ứng dụng phức tạp với LLM trở nên dễ dàng hơn rất nhiều.

Prompt chaining có thể tự động hóa hoàn toàn các tác vụ coding không?

Prompt chaining có thể tự động hóa một phần lớn các tác vụ coding, đặc biệt là các phần lặp lại, tạo boilerplate code, hoặc phân tích thiết kế. Tuy nhiên, việc tự động hóa hoàn toàn thường vẫn cần sự giám sát và tinh chỉnh của con người, đặc biệt đối với các logic nghiệp vụ phức tạp hoặc các quyết định thiết kế kiến trúc quan trọng. Nó giúp tăng năng suất chứ không hoàn toàn thay thế lập trình viên.

Kết Luận

Prompt chaining không chỉ là một kỹ thuật; nó là một triết lý tiếp cận trong AI development, giúp chúng ta biến các tương tác rời rạc với AI thành một quy trình làm việc có cấu trúc, hiệu quả và đáng tin cậy. Bằng cách chia nhỏ vấn đề, định nghĩa rõ ràng các bước và liên kết chúng lại với nhau một cách logic, chúng ta có thể khai thác tối đa sức mạnh của các mô hình ngôn ngữ lớn để giải quyết các tác vụ phức tạp một cách chưa từng có.

Việc nắm vững prompt chaining sẽ là một lợi thế cạnh tranh đáng kể cho bất kỳ nhà phát triển AI nào. Nó mở ra cánh cửa cho việc xây dựng các ứng dụng thông minh hơn, tự động hóa các quy trình phát triển và nâng cao chất lượng sản phẩm. Hãy bắt đầu thử nghiệm và tích hợp prompt chaining vào quy trình làm việc của bạn ngay hôm nay để trải nghiệm sự khác biệt. Đừng quên ghé thăm vibe coding để cập nhật thêm nhiều kiến thức và kỹ thuật AI coding tiên tiến khác!