Giới Thiệu Prompt Engineering Đa Tầng: Kiến Tạo Hệ Thống AI Thông Minh Từ Sơ Đồ Tư Duy

Trong kỷ nguyên bùng nổ của Trí tuệ Nhân tạo, việc giao tiếp hiệu quả với các mô hình ngôn ngữ lớn (LLMs) không còn là một kỹ năng bổ trợ mà đã trở thành một năng lực cốt lõi. Đặc biệt, khi chúng ta hướng tới việc xây dựng các hệ thống AI phức tạp, tích hợp nhiều tác vụ và yêu cầu sự phối hợp chặt chẽ, phương pháp Prompt Engineering truyền thống thường bộc lộ những hạn chế. Bài viết về prompt engineering nâng cao này sẽ giúp bạn khám phá Prompt Engineering Đa Tầng – một cách tiếp cận đột phá, cho phép chúng ta kiến tạo các hệ thống AI thông minh và linh hoạt hơn, bắt đầu từ những sơ đồ tư duy trực quan.

Prompt Engineering Đa Tầng: Vượt Xa Giới Hạn Prompt Đơn

Prompt Engineering (PE) ban đầu tập trung vào việc tạo ra một prompt duy nhất, tối ưu để đạt được kết quả mong muốn từ mô hình AI. Tuy nhiên, khi các yêu cầu trở nên phức tạp hơn – chẳng hạn như phân tích một tài liệu dài, tổng hợp thông tin từ nhiều nguồn, hoặc thực hiện một quy trình gồm nhiều bước – một prompt đơn lẻ thường không đủ. Nó dễ dẫn đến tình trạng "context window overflow" (vượt quá giới hạn token đầu vào), hoặc "hallucination" (mô hình tạo ra thông tin sai lệch) do không thể xử lý hết độ phức tạp của yêu cầu.

Prompt Engineering Đa Tầng (Multi-layered Prompt Engineering) ra đời để giải quyết những thách thức này. Thay vì một prompt "God-prompt" duy nhất, chúng ta chia nhỏ vấn đề thành các tác vụ con, mỗi tác vụ được xử lý bởi một prompt chuyên biệt. Các prompt này được sắp xếp theo một cấu trúc logic, thường được lấy cảm hứng từ sơ đồ tư duy (mind map) hoặc quy trình làm việc (workflow), tạo thành một "chuỗi" hoặc "mạng lưới" các tương tác với AI. Kết quả đầu ra của một prompt có thể trở thành đầu vào cho prompt tiếp theo, tạo nên một luồng xử lý thông tin mạnh mẽ và có kiểm soát.

Ưu điểm chính của phương pháp này là khả năng quản lý độ phức tạp. Bằng cách phân chia vấn đề thành các phần nhỏ hơn, dễ quản lý hơn, chúng ta giảm tải nhận thức cho cả người tạo prompt và mô hình AI. Điều này giúp cải thiện độ chính xác, giảm thiểu lỗi, và cho phép chúng ta xây dựng các hệ thống AI có khả năng thực hiện các tác vụ tinh vi mà trước đây chỉ có con người mới làm được. Đây chính là một kỹ thuật prompt engineering nâng cao cần thiết cho các nhà phát triển AI hiện đại.

Một khía cạnh quan trọng khác là khả năng Debug và tối ưu hóa. Khi một hệ thống AI đa tầng gặp lỗi hoặc cho kết quả không mong muốn, chúng ta có thể dễ dàng xác định prompt nào trong chuỗi là nguyên nhân gây ra vấn đề. Điều này giúp quá trình tinh chỉnh và cải thiện hiệu suất trở nên hiệu quả hơn nhiều so với việc phải sửa một prompt lớn, phức tạp. Nó mở ra cánh cửa cho việc xây dựng các "AI Agent" tự động hóa các quy trình kinh doanh và phân tích dữ liệu.

Kiến Tạo Hệ Thống AI Thông Minh Từ Sơ Đồ Tư Duy: Hướng Dẫn Thực Hành

Để minh họa Prompt Engineering Đa Tầng, chúng ta hãy xem xét một ví dụ thực tế: xây dựng một hệ thống AI để tóm tắt và phân tích cảm xúc từ các đánh giá sản phẩm trực tuyến. Thay vì cố gắng nhồi nhét tất cả yêu cầu vào một prompt duy nhất, chúng ta sẽ chia nó thành các bước logic.

Bước 1: Phân Tích Yêu Cầu và Lập Sơ Đồ Tư Duy

Giả sử chúng ta muốn:

- Tóm tắt nội dung chính của từng đánh giá.

- Phân loại cảm xúc (tích cực, tiêu cực, trung lập).

- Trích xuất các tính năng sản phẩm được đề cập và cảm xúc liên quan đến từng tính năng.

- Tổng hợp các điểm mạnh, điểm yếu chính của sản phẩm từ tất cả đánh giá.

- Đầu vào: Văn bản đánh giá sản phẩm.

- Bước 1 (Prompt 1 - Tóm tắt): Nhận văn bản, trả về bản tóm tắt ngắn.

- Bước 2 (Prompt 2 - Phân loại cảm xúc): Nhận bản tóm tắt, trả về nhãn cảm xúc.

- Bước 3 (Prompt 3 - Trích xuất tính năng/cảm xúc): Nhận văn bản gốc + bản tóm tắt, trả về danh sách các tính năng và cảm xúc liên quan.

- Bước 4 (Prompt 4 - Tổng hợp cuối cùng): Nhận tất cả đầu ra từ các bước trên (của nhiều đánh giá), trả về tổng hợp điểm mạnh/yếu.

Bước 2: Xây Dựng Các Prompt Chuyên Biệt

Chúng ta sẽ sử dụng một lớp trừu tượng (hoặc một hàm trong code) để gọi API của mô hình LLM. Ví dụ, hàm call_llm(prompt_template, input_data).

Prompt 1: Tóm tắt Đánh giá

PROMPT_SUMMARY = """

Bạn là một trợ lý AI chuyên tóm tắt đánh giá sản phẩm.

Hãy tóm tắt ngắn gọn đánh giá sau đây thành 2-3 câu, tập trung vào các điểm chính mà người dùng đề cập.

Đánh giá:

{review_text}

Tóm tắt:

"""Đây là một ví dụ cơ bản về prompt engineering nâng cao để tạo tóm tắt.

Prompt 2: Phân loại Cảm xúc

PROMPT_SENTIMENT = """

Bạn là một AI phân tích cảm xúc.

Hãy phân loại cảm xúc của đánh giá sau đây là 'Tích cực', 'Tiêu cực', hoặc 'Trung lập'.

Đánh giá:

{summary_text}

Cảm xúc:

"""Prompt 3: Trích xuất Tính năng và Cảm xúc liên quan

PROMPT_FEATURE_EXTRACTION = """

Bạn là một AI chuyên trích xuất thông tin.

Từ đánh giá sản phẩm gốc sau đây, hãy xác định các tính năng sản phẩm được đề cập và cảm xúc (Tích cực/Tiêu cực/Trung lập) mà người dùng thể hiện đối với từng tính năng đó.

Đánh giá gốc:

{review_text}

Định dạng đầu ra JSON:

[

{ "feature": "Tên tính năng 1", "sentiment": "Cảm xúc 1" },

{ "feature": "Tên tính năng 2", "sentiment": "Cảm xúc 2" }

]

"""Lưu ý việc yêu cầu định dạng JSON để dễ dàng xử lý đầu ra bằng code.

Prompt 4: Tổng hợp Cuối cùng (từ nhiều đánh giá)

PROMPT_FINAL_SYNTHESIS = """

Bạn là một AI phân tích sản phẩm.

Dưới đây là danh sách các tính năng và cảm xúc liên quan được trích xuất từ nhiều đánh giá sản phẩm.

Hãy tổng hợp các điểm mạnh và điểm yếu chính của sản phẩm dựa trên dữ liệu này.

Tập trung vào các tính năng được nhắc đến nhiều nhất và cảm xúc chủ đạo liên quan.

Dữ liệu tính năng và cảm xúc:

{all_features_sentiment_json}

Tổng hợp:

Điểm mạnh:

- [Điểm mạnh 1]

- [Điểm mạnh 2]

...

Điểm yếu:

- [Điếu yếu 1]

- [Điếu yếu 2]

...

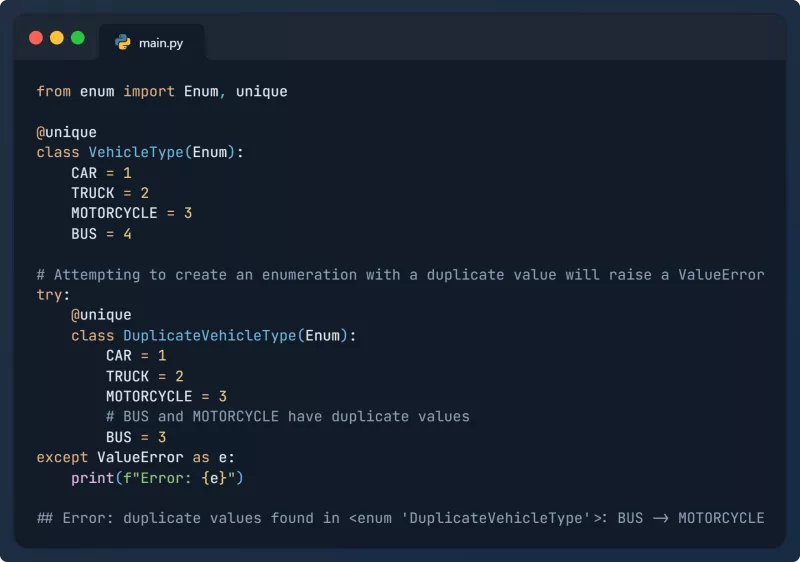

"""Bước 3: Xây Dựng Luồng Xử Lý (Python Example)

Giả sử chúng ta có một danh sách các đánh giá sản phẩm list_of_reviews.

import json

def call_llm(prompt_template, input_data):

# Đây là hàm giả định để gọi API của LLM (ví dụ: OpenAI GPT-4, Gemini, Claude)

# Trong thực tế, bạn sẽ thay thế bằng code gọi API thực tế

# Ví dụ:

# from openai import OpenAI

# client = OpenAI()

# response = client.chat.completions.create(

# model="gpt-4o",

# messages=[

# {"role": "system", "content": "You are a helpful assistant."},

# {"role": "user", "content": prompt_template.format(<strong>input_data)}

# ]

# )

# return response.choices[0].message.content.strip()

print(f"\n--- Gọi LLM với Prompt ---")

print(prompt_template.format(</strong>input_data))

print("--- (Trả về kết quả giả định) ---")

# Giả lập kết quả trả về

if "Tóm tắt:" in prompt_template:

return f"Người dùng khen ngợi chất lượng ảnh và pin trâu nhưng phàn nàn về giá cao."

elif "Cảm xúc:" in prompt_template:

return "Tích cực" if "khen ngợi" in input_data.get("summary_text", "") else "Tiêu cực"

elif "Định dạng đầu ra JSON:" in prompt_template:

return json.dumps([

{"feature": "chất lượng ảnh", "sentiment": "Tích cực"},

{"feature": "pin", "sentiment": "Tích cực"},

{"feature": "giá", "sentiment": "Tiêu cực"}

])

elif "Tổng hợp:" in prompt_template:

return """

Điểm mạnh:

- Chất lượng ảnh xuất sắc, màu sắc chân thực.

- Thời lượng pin vượt trội, sử dụng lâu dài.

Điểm yếu:

- Giá thành cao, khó tiếp cận với một số người dùng.

- Trải nghiệm phần mềm đôi khi còn giật lag.

"""

return "Kết quả không xác định"

all_processed_data = []

list_of_reviews = [

"Máy ảnh này chụp đẹp quá, màu sắc chân thực, ảnh sắc nét. Pin dùng cả ngày không hết, rất hài lòng. Chỉ có điều giá hơi chát.",

"Điện thoại mới mua về dùng được vài ngày đã thấy lag rồi, tốc độ xử lý không như quảng cáo. Thiết kế thì đẹp nhưng hiệu năng kém.",

# Thêm nhiều đánh giá khác ở đây

]

for review_text in list_of_reviews:

# Bước 1: Tóm tắt

summary = call_llm(PROMPT_SUMMARY, {"review_text": review_text})

# Bước 2: Phân loại cảm xúc

sentiment = call_llm(PROMPT_SENTIMENT, {"summary_text": summary})

# Bước 3: Trích xuất tính năng và cảm xúc

feature_sentiment_raw = call_llm(PROMPT_FEATURE_EXTRACTION, {"review_text": review_text})

try:

feature_sentiment = json.loads(feature_sentiment_raw)

except json.JSONDecodeError:

feature_sentiment = [] # Xử lý lỗi nếu LLM không trả về JSON hợp lệ

all_processed_data.append({

"original_review": review_text,

"summary": summary,

"sentiment": sentiment,

"features": feature_sentiment

})

# Tổng hợp dữ liệu để chuẩn bị cho Prompt 4

all_features_for_synthesis = []

for data in all_processed_data:

all_features_for_synthesis.extend(data["features"])

final_synthesis = call_llm(PROMPT_FINAL_SYNTHESIS, {

"all_features_sentiment_json": json.dumps(all_features_for_synthesis, indent=2)

})

print("\n--- KẾT QUẢ TỔNG HỢP CUỐI CÙNG ---")

print(final_synthesis)Đoạn code trên minh họa cách chúng ta xâu chuỗi các prompt lại với nhau. Mỗi prompt giải quyết một phần nhỏ của vấn đề, và đầu ra của nó được truyền làm đầu vào cho prompt tiếp theo hoặc tổng hợp lại ở bước cuối cùng. Phương pháp prompt engineering nâng cao này cho phép xây dựng các hệ thống AI phức tạp một cách có tổ chức.

Tips và Best Practices cho Prompt Engineering Đa Tầng

Để tối ưu hóa hiệu quả của Prompt Engineering Đa Tầng, hãy lưu ý những điểm sau:

- Sơ Đồ Tư Duy Là Kim Chỉ Nam: Luôn bắt đầu bằng việc phác thảo sơ đồ tư duy hoặc quy trình làm việc rõ ràng. Điều này giúp bạn hình dung các bước, các điểm giao nhau, và đảm bảo không bỏ sót bất kỳ khía cạnh nào của vấn đề. Một sơ đồ tốt sẽ là nền tảng vững chắc cho các prompt sau này.

- Prompt Nhỏ Gọn, Chuyên Biệt: Mỗi prompt nên tập trung vào một tác vụ cụ thể, rõ ràng. Tránh cố gắng nhồi nhét quá nhiều yêu cầu vào một prompt. Điều này giúp mô hình AI dễ dàng hiểu và thực hiện chính xác hơn. Ví dụ, một prompt chỉ để tóm tắt, một prompt khác chỉ để phân loại cảm xúc.

- Xác Định Định Dạng Đầu Ra Rõ Ràng: Luôn yêu cầu mô hình AI trả về kết quả theo một định dạng cụ thể (ví dụ: JSON, XML, danh sách gạch đầu dòng, bảng). Điều này cực kỳ quan trọng để tự động hóa việc xử lý đầu ra và truyền nó làm đầu vào cho prompt tiếp theo. Sử dụng các cấu trúc như

"Định dạng đầu ra JSON: { ... }"là một cách hiệu quả. - Xử Lý Lỗi và Giá Trị Mặc Định: Trong một hệ thống đa tầng, khả năng một prompt trả về kết quả không mong muốn hoặc không theo định dạng yêu cầu là luôn có. Hãy xây dựng cơ chế xử lý lỗi (ví dụ: dùng

try-exceptkhi parse JSON) và các giá trị mặc định để đảm bảo luồng xử lý không bị gián đoạn. - Kiểm Thử Từng Prompt Độc Lập: Trước khi tích hợp vào hệ thống, hãy kiểm thử từng prompt một cách độc lập với các dữ liệu đầu vào khác nhau. Điều này giúp bạn tinh chỉnh và tối ưu hóa từng "viên gạch" trước khi xây dựng cả "tòa nhà".

- Tối Ưu Hóa Chi Phí và Độ Trễ: Mỗi lần gọi API LLM đều tốn chi phí và thời gian. Hãy cân nhắc xem có thể kết hợp một số tác vụ đơn giản vào một prompt nếu chúng không làm tăng độ phức tạp quá mức, hoặc sử dụng các mô hình nhỏ hơn, nhanh hơn cho các tác vụ ít đòi hỏi hơn. Đây cũng là một khía cạnh quan trọng của prompt engineering nâng cao.

- Sử Dụng "System Role" Hiệu Quả: Đối với các mô hình hỗ trợ vai trò hệ thống (

system_role), hãy tận dụng nó để thiết lập bối cảnh, tính cách, hoặc các quy tắc chung cho toàn bộ chuỗi prompt. Ví dụ:"You are a helpful assistant that always responds in JSON format."

So Sánh Prompt Engineering Đa Tầng với Các Phương Pháp Khác

Prompt Đơn Lẻ (Single Prompt)

Ưu điểm: Đơn giản, dễ triển khai cho các tác vụ nhỏ, ít phức tạp. Nhanh chóng để có kết quả ban đầu. Nhược điểm: Khó khăn với các tác vụ phức tạp, dễ dẫn đến lỗi "hallucination", khó kiểm soát đầu ra, giới hạn bởi context window. Khó debug và tối ưu hóa khi có vấn đề. Không phù hợp cho việc xây dựng các hệ thống AI lớn.

Few-shot Prompting

Ưu điểm: Cải thiện đáng kể hiệu suất so với zero-shot bằng cách cung cấp các ví dụ minh họa trực tiếp trong prompt. Khá hiệu quả cho các tác vụ phân loại hoặc tạo văn bản theo mẫu. Nhược điểm: Vẫn bị giới hạn bởi context window nếu số lượng ví dụ quá lớn. Các ví dụ phải được chọn lọc kỹ càng và có thể tốn công sức. Không giải quyết triệt để vấn đề về độ phức tạp tác vụ hoặc xử lý chuỗi logic.

Prompt Chaining (Chuỗi Prompt Đơn Giản)

Prompt Chaining là một dạng Prompt Engineering Đa Tầng cơ bản nhất, nơi đầu ra của prompt A trở thành đầu vào của prompt B. Ưu điểm: Là bước đầu tiên để giải quyết các vấn đề phức tạp theo từng bước. Dễ hiểu và triển khai hơn so với một prompt "God-prompt" khổng lồ. Nhược điểm: Có thể trở nên khó quản lý nếu chuỗi quá dài hoặc logic phân nhánh phức tạp. Thiếu tính linh hoạt khi cần các luồng xử lý phi tuyến tính hoặc điều kiện. Prompt Engineering Đa tầng là sự mở rộng và tổng quát hóa của Prompt Chaining.

Prompt Engineering Đa Tầng (Multi-layered Prompt Engineering)

Ưu điểm:

- Xử lý phức tạp: Khả năng phân tách và giải quyết các vấn đề phức tạp thành các tác vụ con, dễ quản lý.

- Kiểm soát tốt hơn: Mỗi tầng/prompt có một mục tiêu rõ ràng, giúp kiểm soát đầu ra và hành vi của mô hình tốt hơn.

- Dễ Debug: Khi có lỗi, dễ dàng xác định prompt nào gây ra vấn đề và tinh chỉnh.

- Linh hoạt: Cho phép xây dựng các luồng xử lý phi tuyến tính, có điều kiện, hoặc lặp lại.

- Tái sử dụng: Các prompt con có thể được tái sử dụng trong các hệ thống khác.

- Hiệu quả: Giảm thiểu "hallucination" và cải thiện độ chính xác tổng thể của hệ thống.

- Phức tạp trong thiết kế: Yêu cầu tư duy hệ thống và kỹ năng thiết kế quy trình.

- Chi phí và độ trễ: Tăng số lượng cuộc gọi API LLM, dẫn đến chi phí và độ trễ cao hơn.

- Quản lý trạng thái: Cần cơ chế quản lý và truyền dữ liệu hiệu quả giữa các prompt.

Nhìn chung, Prompt Engineering Đa Tầng là lựa chọn tối ưu cho việc xây dựng các hệ thống AI phức tạp, đòi hỏi sự chính xác và khả năng xử lý nhiều bước. Nó biến LLM từ một công cụ tạo văn bản đơn thuần thành một thành phần cốt lõi trong một kiến trúc AI động.

Các Lưu Ý Quan Trọng

- Tầm quan trọng của Sơ Đồ Tư Duy: Đừng bỏ qua bước này. Một sơ đồ tư duy rõ ràng giúp bạn hình dung toàn bộ luồng xử lý, các điểm quyết định và các tác vụ con. Nó giống như bản thiết kế kiến trúc cho hệ thống AI của bạn.

- Xác định ranh giới rõ ràng cho mỗi "tầng": Mỗi prompt trong kiến trúc đa tầng cần có một mục tiêu và phạm vi rõ ràng. Điều này giúp ngăn chặn sự chồng chéo và đảm bảo rằng mỗi bước thực hiện đúng chức năng của nó.

- Đầu vào và Đầu ra của mỗi tầng: Luôn định nghĩa rõ ràng những gì một prompt mong đợi làm đầu vào và những gì nó sẽ trả về làm đầu ra. Điều này là then chốt để các tầng có thể "kết nối" với nhau một cách liền mạch.

- Xử lý dữ liệu trung gian: Dữ liệu từ một tầng có thể cần được xử lý, lọc, hoặc định dạng lại trước khi truyền cho tầng tiếp theo. Đừng ngại viết code để xử lý logic này bên ngoài các lời gọi LLM.

- Tối ưu hóa các vòng lặp phản hồi: Trong các hệ thống phức tạp, có thể có các vòng lặp phản hồi nơi đầu ra của một tầng được sử dụng để điều chỉnh các tầng trước đó. Thiết kế các vòng lặp này một cách cẩn thận để tránh vòng lặp vô tận hoặc hiệu suất kém.

- Kiểm soát "Token Budget": Với các mô hình LLM, giới hạn token là một yếu tố quan trọng. Hãy thiết kế các prompt để chúng không vượt quá giới hạn này, đặc biệt khi truyền dữ liệu từ các tầng trước đó. Có thể cần tóm tắt hoặc lọc bớt thông tin nếu cần.

- Sử dụng các công cụ hỗ trợ: Các thư viện như LangChain, LlamaIndex được thiết kế đặc biệt để giúp bạn xây dựng các chuỗi prompt, agents và quản lý các luồng xử lý phức tạp, giúp việc triển khai prompt engineering nâng cao trở nên dễ dàng hơn.

- Đánh giá liên tục: Các hệ thống AI đa tầng cần được đánh giá liên tục. Theo dõi hiệu suất của từng prompt và toàn bộ hệ thống để xác định các điểm yếu và cải thiện.

Câu Hỏi Thường Gặp

Prompt Engineering Đa Tầng có khác gì Prompt Chaining?

Prompt Chaining là một dạng cơ bản của Prompt Engineering Đa Tầng, nơi các prompt được nối tiếp nhau theo một chuỗi tuyến tính. Prompt Engineering Đa Tầng là khái niệm rộng hơn, cho phép các cấu trúc phức tạp hơn như phân nhánh, vòng lặp, và các luồng xử lý phi tuyến tính, thường được hình dung thông qua sơ đồ tư duy hoặc đồ thị.

Khi nào nên sử dụng Prompt Engineering Đa Tầng thay vì một prompt đơn?

Bạn nên sử dụng Prompt Engineering Đa Tầng khi tác vụ quá phức tạp để một prompt đơn xử lý hiệu quả, khi bạn cần kiểm soát chính xác từng bước của quy trình, khi cần giảm thiểu "hallucination", hoặc khi bạn muốn xây dựng một hệ thống AI có khả năng mở rộng và dễ bảo trì hơn.

Làm thế nào để xử lý dữ liệu giữa các tầng hiệu quả?

Sử dụng các định dạng dữ liệu có cấu trúc như JSON hoặc XML làm đầu ra cho mỗi prompt. Sau đó, sử dụng code (ví dụ: Python) để parse, xử lý, lọc và định dạng lại dữ liệu này trước khi truyền nó làm đầu vào cho prompt tiếp theo. Điều này đảm bảo tính nhất quán và khả năng tự động hóa.

Prompt Engineering Đa Tầng có tốn kém và chậm hơn không?

Có, vì nó liên quan đến nhiều cuộc gọi API LLM hơn. Mỗi cuộc gọi đều tốn chi phí và thêm độ trễ. Tuy nhiên, sự đánh đổi này thường đáng giá cho các tác vụ phức tạp, nơi độ chính xác, độ tin cậy và khả năng kiểm soát là ưu tiên hàng đầu. Bạn có thể tối ưu hóa bằng cách chọn mô hình phù hợp và tối thiểu hóa số lượng cuộc gọi cần thiết.

Có công cụ nào hỗ trợ xây dựng hệ thống Prompt Đa Tầng không?

Tuyệt đối có. Các framework như LangChain, LlamaIndex, hay Guidance (của Microsoft) được thiết kế để giúp các nhà phát triển xây dựng các "prompt chain", "agents" và các luồng xử lý phức tạp với LLMs một cách có cấu trúc và dễ quản lý hơn.

Kết Luận

Prompt Engineering Đa Tầng không chỉ là một kỹ thuật, mà là một triết lý thiết kế hệ thống AI. Bằng cách phân chia các vấn đề phức tạp thành các tác vụ nhỏ hơn, có thể quản lý được, và xâu chuỗi chúng lại một cách logic dựa trên sơ đồ tư duy, chúng ta có thể mở khóa tiềm năng to lớn của các mô hình ngôn ngữ lớn. Nó cho phép các nhà phát triển tạo ra các ứng dụng AI mạnh mẽ, đáng tin cậy và có khả năng giải quyết những thách thức thực tế trong nhiều lĩnh vực.

Việc nắm vững prompt engineering nâng cao này là chìa khóa để kiến tạo các hệ thống AI thông minh thực sự, vượt ra ngoài giới hạn của các prompt đơn lẻ. Hãy bắt đầu từ một sơ đồ tư duy rõ ràng, xây dựng từng prompt chuyên biệt và kết nối chúng bằng code, bạn sẽ thấy khả năng của AI được nâng lên một tầm cao mới. Hãy tiếp tục theo dõi vibe coding để cập nhật những kiến thức và xu hướng mới nhất trong thế giới AI đầy sôi động này!