Giới Thiệu Vibe Coding Tiết Kiệm: Chiến Lược Quản Lý Token AI Hiệu Quả Như Senior Dev

Chào mừng các bạn đến với vibecoding.vin! Trong thế giới phát triển AI đang bùng nổ như hiện nay, việc tối ưu hóa chi phí là một yếu tố then chốt, đặc biệt là khi làm việc với các mô hình ngôn ngữ lớn (LLMs). Bài viết này sẽ đi sâu vào chiến lược quản lý token AI, một kỹ năng mà mọi senior developer và AI engineer đều cần nắm vững để vừa đảm bảo hiệu suất, vừa tiết kiệm chi phí. Chúng ta sẽ khám phá cách "vibe coding" không chỉ là về phong cách mà còn là về sự thông minh trong việc sử dụng tài nguyên.

Token AI Là Gì và Tại Sao Chúng Ta Cần Quản Lý Chúng?

Để hiểu về token AI, chúng ta cần hình dung cách các mô hình ngôn ngữ như GPT-3.5, GPT-4 hay Claude hoạt động. Khi bạn gửi một đoạn văn bản (prompt) đến các mô hình này, chúng không xử lý trực tiếp các ký tự hay từ. Thay vào đó, văn bản của bạn sẽ được "token hóa" (tokenization) thành các đơn vị nhỏ hơn gọi là tokens. Một token có thể là một từ, một phần của từ, một dấu câu, hoặc thậm chí là một ký tự đặc biệt. Ví dụ, từ "tokenization" có thể được chia thành các token như "token", "iz", "ation". Số lượng token này quyết định chi phí bạn phải trả cho mỗi lần gọi API, cũng như giới hạn độ dài của prompt và response mà mô hình có thể xử lý (context window).

Việc quản lý token không chỉ dừng lại ở việc tiết kiệm tiền. Nó còn ảnh hưởng trực tiếp đến hiệu suất của ứng dụng AI của bạn. Một prompt quá dài có thể vượt quá giới hạn context window, dẫn đến lỗi hoặc làm cho mô hình bỏ qua các phần quan trọng. Ngược lại, một prompt được tối ưu hóa về số lượng token nhưng vẫn giữ được đầy đủ thông tin cần thiết sẽ giúp mô hình hoạt động hiệu quả hơn, đưa ra kết quả chính xác và nhanh chóng hơn. Đây là một kỹ năng quan trọng mà bất kỳ ai muốn phát triển các ứng dụng AI chuyên nghiệp đều phải thành thạo.

Mỗi mô hình AI có một cách token hóa riêng, và số lượng token cho cùng một đoạn văn bản có thể khác nhau giữa các mô hình. Điều này đòi hỏi chúng ta phải hiểu rõ về cách thức hoạt động của từng mô hình mà mình đang sử dụng. Ví dụ, một số mô hình sử dụng Byte Pair Encoding (BPE), trong khi những mô hình khác có thể có các thuật toán token hóa độc quyền. Việc nắm bắt những khác biệt này là bước đầu tiên để trở thành một chuyên gia trong việc quản lý token.

Hơn nữa, chi phí cho mỗi token thường được tính theo hai phần: token của prompt (input tokens) và token của phản hồi (output tokens). Thường thì output tokens sẽ đắt hơn input tokens. Do đó, việc tối ưu cả input và output là cực kỳ quan trọng. Một chiến lược hiệu quả sẽ tập trung vào việc giảm thiểu cả hai loại token này mà vẫn đảm bảo chất lượng của tương tác.

Chiến Lược Vibe Coding Tiết Kiệm: Thực Hành Quản Lý Token AI

Để quản lý token AI hiệu quả, chúng ta cần áp dụng nhiều kỹ thuật khác nhau, từ việc thiết kế prompt cho đến việc sử dụng các công cụ hỗ trợ. Dưới đây là một số chiến lược cụ thể mà senior dev thường áp dụng:

1. Tối Ưu Hóa Prompt Engineering

Đây là nền tảng của mọi chiến lược tiết kiệm token. Một prompt rõ ràng, súc tích và đi thẳng vào vấn đề sẽ giảm đáng kể số lượng token đầu vào mà vẫn đảm bảo chất lượng phản hồi.

- Sử dụng ngôn ngữ chính xác, tránh dài dòng: Loại bỏ các từ thừa, câu rườm rà. Thay vì "Could you please kindly provide me with a summary of the following article, making sure to highlight the key points and main ideas?", hãy thử "Summarize this article, focusing on key points."

- Cung cấp ngữ cảnh vừa đủ: Chỉ đưa những thông tin cần thiết cho nhiệm vụ. Đừng sao chép toàn bộ một tài liệu nếu chỉ cần một đoạn nhỏ.

- Sử dụng ví dụ (few-shot prompting) một cách thông minh: Thay vì quá nhiều ví dụ, hãy chọn 1-2 ví dụ chất lượng cao, đại diện tốt cho trường hợp sử dụng.

- Chỉ định định dạng đầu ra: Khi bạn yêu cầu mô hình phản hồi theo một định dạng cụ thể (JSON, list, bullet points), nó sẽ cần ít token hơn để "suy nghĩ" và cấu trúc câu trả lời.

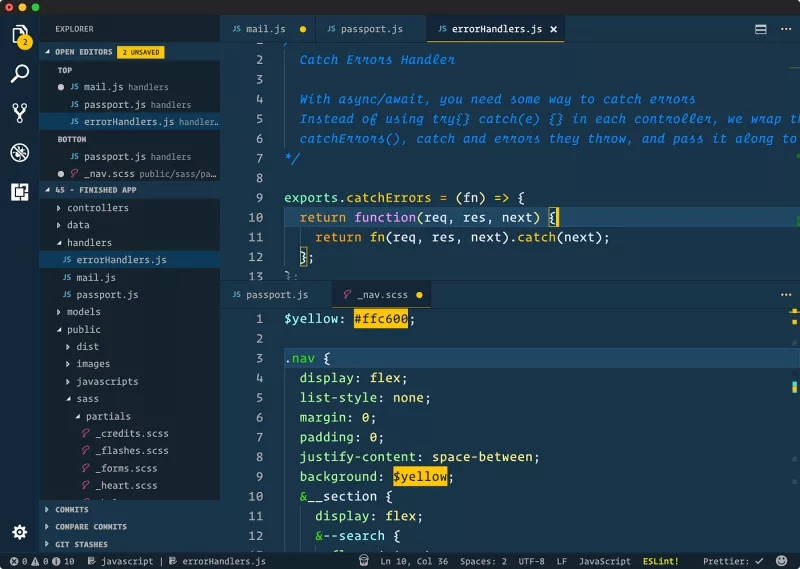

Ví dụ về cách tối ưu hóa prompt:

// Prompt kém tối ưu:

const verbosePrompt = `I would be extremely grateful if you could take a moment to

carefully read through the entire attached document below and then, subsequent to

your thorough review, provide me with a comprehensive and detailed summary of the

main arguments, key findings, and overall conclusions presented within the text.

Please ensure that your summary is both concise and informative, capturing all

the essential aspects without omitting any critical information. Here is the document:

[document content]`;

// Prompt tối ưu hơn:

const optimizedPrompt = `Summarize the key arguments, findings, and conclusions

from the following document. Be concise and informative. Document: [document content]`;Sự khác biệt về số lượng token giữa hai prompt này có thể là đáng kể, đặc biệt khi bạn thực hiện hàng ngàn, thậm chí hàng triệu lượt gọi API.

2. Kỹ Thuật Retrieval Augmented Generation (RAG)

RAG là một kỹ thuật mạnh mẽ giúp giảm thiểu số lượng token cần gửi đến LLM bằng cách chỉ cung cấp những thông tin liên quan nhất (relevant context) thay vì toàn bộ dữ liệu. Thay vì nhồi nhét cả một cuốn sách vào prompt, bạn sẽ sử dụng một hệ thống truy xuất thông tin (retrieval system) để tìm kiếm các đoạn văn bản liên quan nhất từ cơ sở dữ liệu của bạn, sau đó chèn chúng vào prompt.

Quy trình cơ bản của RAG:

- Lưu trữ dữ liệu: Chia nhỏ tài liệu lớn thành các "chunks" nhỏ hơn và tạo embeddings cho chúng. Lưu trữ embeddings này trong một vector database (ví dụ: Pinecone, Weaviate, ChromaDB).

- Truy vấn: Khi người dùng đặt câu hỏi, tạo embedding cho câu hỏi đó.

- Tìm kiếm: Tìm kiếm các chunks có embedding tương tự nhất trong vector database.

- Xây dựng prompt: Lấy các chunks liên quan nhất và chèn chúng vào prompt cùng với câu hỏi của người dùng.

- Gọi LLM: Gửi prompt đã được xây dựng đến LLM.

// Pseudocode cho RAG

async function generateAnswerWithRAG(userQuery, vectorDatabase) {

// 1. Tạo embedding cho câu hỏi người dùng

const queryEmbedding = await createEmbedding(userQuery);

// 2. Tìm kiếm các tài liệu liên quan trong vector database

const relevantChunks = await vectorDatabase.search(queryEmbedding, { topK: 3 });

// 3. Xây dựng context từ các chunks

const context = relevantChunks.map(chunk => chunk.text).join('\n\n');

// 4. Xây dựng prompt cho LLM

const prompt = `Based on the following context, answer the question:

Context:

${context}

Question: ${userQuery}

Answer:`;

// 5. Gửi prompt đến LLM và nhận câu trả lời

const response = await callLLM(prompt);

return response.answer;

}Kỹ thuật này không chỉ tiết kiệm token AI mà còn giúp mô hình đưa ra câu trả lời chính xác hơn, dựa trên thông tin thực tế thay vì "hư cấu" (hallucination).

3. Tóm Tắt Từng Phần (Summarization/Chunking)

Nếu bạn phải xử lý một lượng lớn văn bản mà không thể dùng RAG (ví dụ, bạn cần tóm tắt toàn bộ tài liệu), hãy xem xét việc chia nhỏ tài liệu thành các đoạn nhỏ hơn (chunks) và tóm tắt từng đoạn một. Sau đó, tóm tắt các bản tóm tắt đó. Đây là cách tiếp cận "map-reduce" cho việc tóm tắt.

// Ví dụ về tóm tắt theo từng phần

async function recursiveSummarize(documentText, chunkSize, overlapSize) {

const chunks = splitTextIntoChunks(documentText, chunkSize, overlapSize);

let summaries = [];

for (const chunk of chunks) {

const prompt = `Summarize the following text concisely:\n${chunk}`;

const summary = await callLLM(prompt, { maxTokens: 100 }); // Giới hạn output tokens

summaries.push(summary);

}

if (summaries.length === 1) {

return summaries[0];

} else {

// Tóm tắt các bản tóm tắt

const combinedSummaries = summaries.join('\n\n');

const finalPrompt = `Summarize these individual summaries into one comprehensive summary:\n${combinedSummaries}`;

const finalSummary = await callLLM(finalPrompt, { maxTokens: 250 });

return finalSummary;

}

}Kỹ thuật này đòi hỏi nhiều lượt gọi API hơn, nhưng mỗi lượt gọi lại sử dụng ít token hơn, điều này thường dẫn đến chi phí thấp hơn tổng thể so với việc cố gắng nhồi nhét tất cả vào một prompt duy nhất (nếu có thể).

4. Tối Ưu Hóa Output Tokens

Không chỉ input tokens, output tokens cũng là một yếu tố chi phí quan trọng. Bạn có thể kiểm soát chúng bằng cách:

- Đặt giới hạn

max_tokens: Luôn đặt một giới hạn tối đa cho số lượng token mà mô hình có thể tạo ra trong phản hồi của nó. Điều này không chỉ tiết kiệm chi phí mà còn ngăn chặn mô hình tạo ra những phản hồi quá dài không cần thiết. - Chỉ định định dạng đầu ra ngắn gọn: Yêu cầu mô hình trả lời bằng các định dạng như JSON, liệt kê (list), hoặc gạch đầu dòng (bullet points) thay vì đoạn văn xuôi dài dòng. Ví dụ, thay vì "The main points are that the sky is blue, the grass is green, and the sun is hot.", hãy yêu cầu "Main points: - Sky is blue - Grass is green - Sun is hot."

- Yêu cầu câu trả lời trực tiếp: Nếu bạn chỉ cần một câu trả lời ngắn gọn, hãy yêu cầu mô hình "Trả lời bằng một từ" hoặc "Chỉ đưa ra tên".

// Ví dụ về giới hạn max_tokens và định dạng output

async function getSentiment(text) {

const prompt = `Analyze the sentiment of the following text. Respond with only "Positive", "Negative", or "Neutral".

Text: "${text}"`;

const response = await callLLM(prompt, { maxTokens: 10, temperature: 0.0 }); // Rất ít token, nhiệt độ thấp để có câu trả lời rõ ràng

return response.trim();

}Các Tips & Best Practices Nâng Cao

Để trở thành một senior dev thực thụ trong việc quản lý token AI, bạn cần áp dụng những kinh nghiệm thực tế sau:

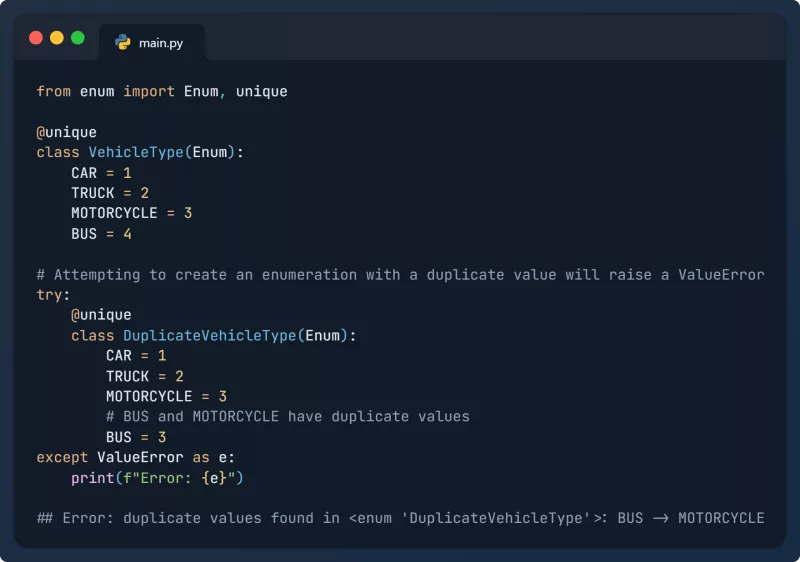

1. Sử Dụng Công Cụ Đếm Token

Trước khi gửi prompt đến API, hãy sử dụng các thư viện đếm token (ví dụ: tiktoken của OpenAI) để ước tính số lượng token. Điều này giúp bạn kiểm soát và điều chỉnh prompt trước khi phát sinh chi phí.

import tiktoken

def count_tokens(text, model="gpt-4"):

"""Đếm số token của một đoạn văn bản cho một mô hình cụ thể."""

encoding = tiktoken.encoding_for_model(model)

return len(encoding.encode(text))

prompt = "Đây là một đoạn văn bản kiểm tra số lượng token."

num_tokens = count_tokens(prompt)

print(f"Số token cho prompt này là: {num_tokens}")Việc tích hợp công cụ này vào quy trình phát triển sẽ giúp bạn có cái nhìn rõ ràng về chi phí tiềm năng và tối ưu hóa ngay lập tức.

2. Cache Phản Hồi

Nếu bạn có những prompt thường xuyên được gọi và có câu trả lời ổn định, hãy cache các phản hồi đó. Điều này giúp giảm số lượt gọi API và tiết kiệm token đáng kể. Ví dụ, nếu bạn thường xuyên hỏi về định nghĩa của một thuật ngữ cố định, hãy lưu trữ định nghĩa đó sau lần đầu tiên.

3. Chọn Mô Hình Phù Hợp

Không phải lúc nào cũng cần sử dụng mô hình mạnh nhất và đắt nhất (ví dụ: GPT-4). Đối với các tác vụ đơn giản như phân loại, trích xuất thông tin cơ bản, hoặc tóm tắt ngắn, các mô hình nhỏ hơn, rẻ hơn (ví dụ: GPT-3.5 Turbo, hoặc các mô hình mã nguồn mở như Llama-2) có thể đáp ứng tốt yêu cầu với chi phí thấp hơn nhiều. Hãy đánh giá cẩn thận nhu cầu của bạn để chọn mô hình phù hợp nhất.

4. Fine-tuning Mô Hình Nhỏ (Nếu Có Thể)

Đối với các tác vụ chuyên biệt và lặp đi lặp lại, việc fine-tuning một mô hình nhỏ hơn với dữ liệu của riêng bạn có thể hiệu quả hơn về lâu dài. Một mô hình đã được fine-tuning có thể hiểu ngữ cảnh tốt hơn với ít prompt tokens hơn, và có thể cho ra kết quả mong muốn với ít output tokens hơn so với một mô hình lớn tổng quát.

5. Tối Ưu Hóa Cấu Trúc Dữ Liệu Đầu Vào

Khi gửi dữ liệu có cấu trúc (ví dụ: JSON) đến mô hình, hãy đảm bảo rằng cấu trúc đó gọn gàng và không chứa các khóa (keys) hay giá trị (values) không cần thiết. Ví dụ, thay vì gửi:

{

"user_information": {

"first_name": "Nguyen",

"last_name": "Van A",

"email_address": "[email protected]",

"phone_number": "123-456-7890",

"address_details": {

"street": "123 Le Loi",

"city": "Ho Chi Minh",

"country": "Vietnam"

}

},

"request_details": {

"request_id": "REQ001",

"request_type": "Support",

"priority_level": "High",

"description_of_issue": "My application is crashing unexpectedly."

}

}Nếu bạn chỉ cần tên và mô tả lỗi, hãy gửi:

{

"name": "Nguyen Van A",

"issue_description": "Application crashing unexpectedly."

}Mỗi ký tự, mỗi dấu cách, mỗi dấu ngoặc đều được tính là token, nên việc tối giản hóa cấu trúc dữ liệu cũng góp phần tiết kiệm đáng kể.

So Sánh Các Phương Pháp Quản Lý Token AI

Việc lựa chọn chiến lược quản lý token phù hợp phụ thuộc vào nhiều yếu tố như loại tác vụ, lượng dữ liệu, tần suất sử dụng và ngân sách. Dưới đây là bảng so sánh một số phương pháp chính:

- Prompt Engineering (Tối ưu hóa prompt):

- Ưu điểm: Dễ triển khai nhất, hiệu quả ngay lập tức, không yêu cầu cơ sở hạ tầng phức tạp.

- Nhược điểm: Giới hạn bởi độ dài context window, khó mở rộng cho dữ liệu rất lớn.

- Phù hợp cho: Hầu hết các tác vụ, đặc biệt là khi dữ liệu đầu vào không quá lớn.

- Retrieval Augmented Generation (RAG):

- Ưu điểm: Xử lý lượng lớn dữ liệu, giảm thiểu hallucination, cung cấp thông tin cập nhật, tiết kiệm token hiệu quả cho các tác vụ hỏi đáp trên tài liệu riêng.

- Nhược điểm: Yêu cầu cơ sở hạ tầng vector database, phức tạp hơn để triển khai và bảo trì.

- Phù hợp cho: Xây dựng chatbot, hệ thống hỏi đáp trên tri thức chuyên biệt, tổng hợp thông tin từ kho dữ liệu lớn.

- Tóm Tắt Từng Phần (Recursive Summarization):

- Ưu điểm: Xử lý tài liệu rất dài vượt quá context window, linh hoạt trong việc điều chỉnh độ sâu tóm tắt.

- Nhược điểm: Tốn nhiều lượt gọi API, có thể làm mất đi một số chi tiết nhỏ trong quá trình tóm tắt nhiều lớp.

- Phù hợp cho: Tóm tắt sách, báo cáo dài, tài liệu pháp lý.

- Fine-tuning:

- Ưu điểm: Hiệu suất cao cho tác vụ cụ thể, giảm thiểu token đầu vào/đầu ra, có thể sử dụng mô hình nhỏ hơn.

- Nhược điểm: Yêu cầu tập dữ liệu huấn luyện lớn và chất lượng cao, tốn chi phí và thời gian ban đầu để huấn luyện.

- Phù hợp cho: Các ứng dụng có tác vụ lặp đi lặp lại, yêu cầu độ chính xác cao và hiệu quả chi phí lâu dài.

Một senior dev sẽ biết cách kết hợp các phương pháp này một cách linh hoạt. Ví dụ, sử dụng RAG để lấy các đoạn văn bản liên quan, sau đó áp dụng prompt engineering để tóm tắt các đoạn đó một cách hiệu quả, và cuối cùng, fine-tuning một mô hình nhỏ để xử lý các yêu cầu thường xuyên nhất.

Các Lưu Ý Quan Trọng

- Đừng hy sinh chất lượng vì tiết kiệm: Mục tiêu cuối cùng vẫn là sản phẩm chất lượng. Đừng cắt giảm token đến mức làm giảm độ chính xác hoặc tính hữu ích của phản hồi. Hãy luôn cân bằng giữa chi phí và chất lượng.

- Theo dõi chi phí thường xuyên: Hầu hết các nhà cung cấp AI đều có dashboard để bạn theo dõi mức tiêu thụ token và chi phí. Hãy kiểm tra định kỳ để phát hiện sớm các vấn đề và điều chỉnh chiến lược.

- Hiểu rõ cách token được tính: Mỗi nhà cung cấp có thể có cách tính token hơi khác nhau. Ví dụ, một số chỉ tính token đầu vào, số khác tính cả đầu vào và đầu ra. Đọc kỹ tài liệu API.

- Sử dụng các API có sẵn: Nhiều LLM provider cung cấp các API chuyên biệt cho các tác vụ như tóm tắt, dịch thuật, mà có thể có mức giá token khác hoặc được tối ưu hóa hơn cho tác vụ đó.

- Kiểm thử A/B: Khi bạn tối ưu hóa prompt, hãy thực hiện kiểm thử A/B để so sánh hiệu quả và chi phí giữa các phiên bản prompt khác nhau.

- Tự động hóa việc tối ưu: Đối với các ứng dụng phức tạp, hãy xem xét việc tự động hóa quá trình tối ưu prompt hoặc chọn lọc ngữ cảnh dựa trên độ dài và nội dung của query.

- Cập nhật kiến thức: Lĩnh vực AI phát triển rất nhanh. Các kỹ thuật mới, mô hình mới và cách tính token mới liên tục xuất hiện. Hãy luôn cập nhật kiến thức để áp dụng những chiến lược hiệu quả nhất.

Câu Hỏi Thường Gặp

Làm thế nào để biết một đoạn văn bản có bao nhiêu token?

Bạn có thể sử dụng các thư viện đếm token được cung cấp bởi các nhà phát triển mô hình. Ví dụ, OpenAI cung cấp thư viện tiktoken cho các mô hình của họ. Một số nền tảng cũng có công cụ đếm token trực tuyến.

Có phải tất cả các mô hình AI đều tính token theo cùng một cách không?

Không, cách token hóa và số lượng token cho cùng một đoạn văn bản có thể khác nhau đáng kể giữa các mô hình và các nhà cung cấp khác nhau. Luôn tham khảo tài liệu của mô hình bạn đang sử dụng.

Việc sử dụng ví dụ (few-shot prompting) có tốn nhiều token không?

Có, mỗi ví dụ bạn cung cấp trong prompt đều làm tăng số lượng input token. Do đó, hãy chọn lọc các ví dụ một cách cẩn thận, chỉ cung cấp đủ để mô hình hiểu ý định của bạn, tránh đưa quá nhiều ví dụ không cần thiết.

Nếu tôi vượt quá giới hạn token (context window), điều gì sẽ xảy ra?

Thông thường, API sẽ trả về lỗi, hoặc mô hình sẽ tự động cắt bớt phần cuối của prompt để phù hợp với giới hạn, điều này có thể dẫn đến kết quả không chính xác hoặc thiếu sót. Luôn kiểm tra số lượng token trước khi gửi request lớn.

Tôi nên ưu tiên giảm input token hay output token?

Tùy thuộc vào mô hình và nhà cung cấp, chi phí cho output token thường cao hơn input token. Do đó, bạn nên ưu tiên tối ưu cả hai, nhưng đặc biệt chú ý đến việc kiểm soát độ dài của phản hồi bằng cách đặt max_tokens và yêu cầu định dạng đầu ra ngắn gọn.

Kết Luận

Quản lý token AI không chỉ là một kỹ năng kỹ thuật mà còn là một tư duy chiến lược, giúp bạn xây dựng các ứng dụng AI hiệu quả, mạnh mẽ và tiết kiệm chi phí. Từ việc tối ưu hóa prompt, áp dụng RAG, đến việc lựa chọn mô hình và cache phản hồi, mỗi bước đều góp phần vào sự thành công của dự án. Với vai trò là một chuyên gia về vibe coding và AI development, tôi tin rằng việc nắm vững các chiến lược này sẽ giúp bạn không chỉ tiết kiệm ngân sách mà còn nâng cao chất lượng sản phẩm AI của mình lên một tầm cao mới. Hãy tiếp tục khám phá và học hỏi cùng vibe coding để luôn dẫn đầu trong thế giới công nghệ đầy biến động này!