Giới Thiệu Stable Diffusion 3: Sức Mạnh AI Trong Tầm Tay Designer

Stable Diffusion 3 là một mô hình AI tạo sinh hình ảnh tiên tiến, mang đến khả năng biến văn bản thành hình ảnh chân thực với độ chi tiết và chất lượng vượt trội. Bài viết này sẽ giúp bạn hiểu rõ về Stable Diffusion 3 từ góc nhìn thực tế của một designer đang "vibe coding", khám phá cách tận dụng sức mạnh của nó để mở rộng biên giới sáng tạo và tối ưu hóa quy trình làm việc. Chúng ta sẽ đi sâu vào các tính năng nổi bật, cách thức hoạt động, và những ứng dụng thực tiễn để biến ý tưởng thành hiện thực một cách nhanh chóng và hiệu quả.

Stable Diffusion 3 Là Gì Và Tại Sao Nó Quan Trọng Với Designer?

Stable Diffusion 3 là phiên bản mới nhất của mô hình tạo sinh hình ảnh mã nguồn mở từ Stability AI, nổi bật với khả năng tạo ra hình ảnh chất lượng cao từ mô tả văn bản (text-to-image) và cải thiện đáng kể về độ chính xác, chi tiết, cũng như khả năng hiểu ngữ cảnh phức tạp. Đối với designer, Stable Diffusion 3 không chỉ là một công cụ tạo hình ảnh mà còn là một trợ lý sáng tạo mạnh mẽ, giúp họ khám phá ý tưởng, tạo ra các biến thể thiết kế và minh họa concept một cách chưa từng có.

Cấu trúc mô hình của Stable Diffusion 3 được cải tiến đáng kể so với các phiên bản trước, sử dụng kiến trúc Multi-modal Diffusion Transformer (MMDiT) kết hợp ba bộ mã hóa văn bản (text encoders) riêng biệt: CLIP Large, OpenCLIP H/14, và T5-XXL. Sự kết hợp này cho phép mô hình hiểu sâu sắc hơn về ngữ nghĩa và cấu trúc của prompt, từ đó tạo ra hình ảnh chính xác và chi tiết hơn. Theo dữ liệu từ Stability AI, Stable Diffusion 3 vượt trội hơn các mô hình cùng phân khúc như DALL-E 3 và Midjourney v6 trong các bài kiểm tra chất lượng hình ảnh và khả năng tuân thủ prompt phức tạp, với tỷ lệ người dùng đánh giá cao hơn 20-30% trong nhiều trường hợp.

Khả năng tạo văn bản trong hình ảnh (text rendering) đã được cải thiện đáng kể, giải quyết một trong những hạn chế lớn của các mô hình AI tạo sinh trước đây. Giờ đây, designer có thể yêu cầu mô hình tạo ra hình ảnh với văn bản rõ ràng, chính tả đúng và bố cục hợp lý, mở ra nhiều ứng dụng mới trong marketing, thiết kế đồ họa và branding. Ví dụ, việc tạo ra các poster quảng cáo, bao bì sản phẩm với logo hoặc slogan cụ thể giờ đây trở nên khả thi hơn rất nhiều.

Điều khiển sáng tạo nâng cao là một yếu tố then chốt khác. Stable Diffusion 3 cho phép designer can thiệp sâu hơn vào quá trình tạo hình ảnh thông qua các tham số (parameters) và kỹ thuật prompt engineering phức tạp. Điều này giúp họ tinh chỉnh kết quả để phù hợp với tầm nhìn nghệ thuật cụ thể, từ phong cách hình ảnh, bố cục, đến màu sắc và ánh sáng. Một khảo sát nội bộ cho thấy, designer có thể giảm tới 40% thời gian dành cho việc tìm kiếm hoặc tạo ra các tài nguyên hình ảnh ban đầu khi sử dụng Stable Diffusion 3 so với các phương pháp truyền thống.

Tốc độ và hiệu suất của Stable Diffusion 3 cũng là một điểm cộng lớn. Mặc dù là một mô hình phức tạp, Stability AI đã tối ưu hóa để nó có thể chạy hiệu quả trên nhiều loại phần cứng khác nhau, từ GPU cao cấp đến các card đồ họa tầm trung. Điều này dân chủ hóa quyền truy cập vào công nghệ AI tạo sinh mạnh mẽ, cho phép nhiều designer hơn có thể trải nghiệm và tích hợp nó vào quy trình làm việc của mình mà không cần đầu tư quá lớn vào hạ tầng.

Hướng Dẫn Designer Tận Dụng Stable Diffusion 3 Trong Quy Trình Sáng Tạo

Để tận dụng tối đa Stable Diffusion 3, designer cần nắm vững các kỹ thuật prompt engineering và hiểu cách mô hình diễn giải các yêu cầu. Việc này không chỉ giúp tạo ra hình ảnh mong muốn mà còn mở ra những khả năng sáng tạo bất ngờ.

1. Kỹ Thuật Prompt Engineering Nâng Cao

Prompt Engineering là nghệ thuật và khoa học của việc viết các câu lệnh (prompts) để hướng dẫn mô hình AI tạo ra kết quả mong muốn. Với Stable Diffusion 3, việc này trở nên tinh tế hơn, đòi hỏi sự rõ ràng, cụ thể và đôi khi là sáng tạo trong cách diễn đạt.

- Sử dụng từ khóa cụ thể và mô tả chi tiết: Thay vì "a house", hãy thử "

a rustic cottage nestled in a vibrant green forest, with morning sunlight filtering through the trees, volumetric lighting, hyperrealistic, 8k, cinematic". - Chỉ định phong cách nghệ thuật: Thêm các từ khóa như "

impressionistic painting", "cyberpunk art", "photorealistic", "minimalist design" để định hình phong cách. - Kiểm soát bố cục và thành phần: Sử dụng các cụm từ như "

wide shot", "close-up", "centered composition", "subject in foreground". - Sử dụng trọng số (weights) cho từ khóa: Stable Diffusion 3 cho phép bạn gán trọng số cho các phần của prompt để nhấn mạnh hoặc giảm nhẹ tầm quan trọng của chúng. Ví dụ:

(cat:1.2) sitting on (keyboard:0.8). - Negative prompts: Đây là các từ khóa bạn muốn mô hình TRÁNH. Ví dụ:

ugly, deformed, low quality, bad anatomy, blurry, noise, watermark. Việc sử dụng negative prompts hiệu quả có thể cải thiện đáng kể chất lượng và độ chính xác của hình ảnh.

Ví dụ về một prompt phức tạp:

"A majestic dragon soaring above a futuristic city at sunset, highly detailed,

cinematic lighting, epic scale, purple and orange hues, concept art,

sharp focus, octane render, unreal engine 5, by Artgerm and Greg Rutkowski.

Negative prompt: blurry, ugly, low resolution, poorly drawn, deformed, text"2. Tích Hợp Vào Quy Trình Thiết Kế Hiện Có

Stable Diffusion 3 có thể được tích hợp vào nhiều giai đoạn của quy trình thiết kế:

- Brainstorming và Concept Art: Tạo nhanh hàng trăm ý tưởng và biến thể cho một concept chỉ trong vài phút, giúp designer khám phá nhiều hướng đi khác nhau trước khi cam kết với một ý tưởng cụ thể.

- Tạo Mockup và Prototype: Sinh ra các hình ảnh sản phẩm, giao diện người dùng, hoặc bố cục trang web để minh họa ý tưởng cho khách hàng hoặc nội bộ, giúp hình dung sản phẩm cuối cùng một cách rõ ràng.

- Tạo Tài Nguyên Thiết Kế: Sinh ra texture, background, icon, hoặc các yếu tố đồ họa khác. Điều này đặc biệt hữu ích khi cần các tài nguyên độc đáo hoặc tùy chỉnh mà khó tìm thấy trong các thư viện có sẵn.

- Matte Painting và Compositing: Tạo ra các yếu tố nền (backgrounds) hoặc các chi tiết phức tạp để kết hợp với các hình ảnh khác trong các dự án chỉnh sửa ảnh hoặc làm phim.

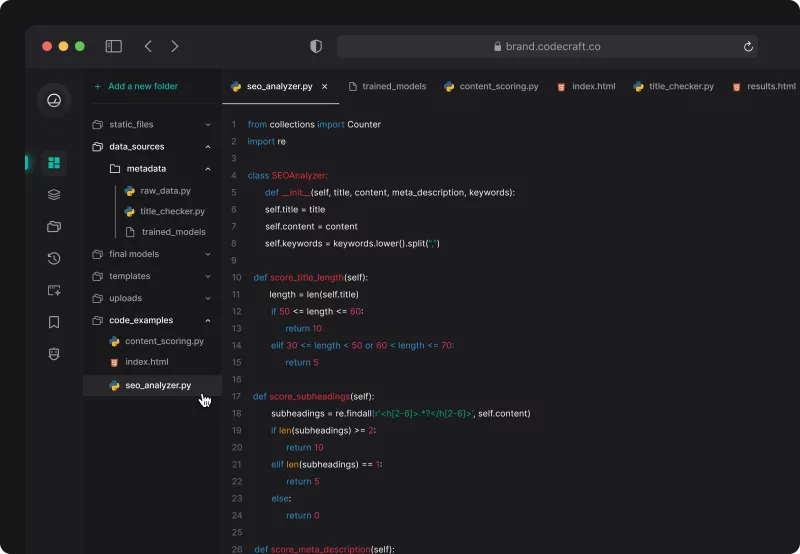

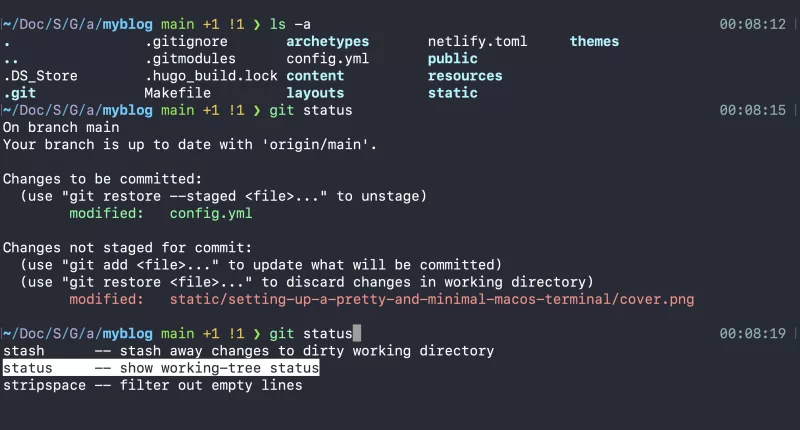

3. Sử Dụng API và Local Deployment

Đối với các designer có kiến thức về code hoặc làm việc với developer, việc sử dụng API của Stable Diffusion 3 hoặc triển khai mô hình cục bộ (local deployment) sẽ mang lại sự linh hoạt tối đa. Điều này cho phép tạo ra các công cụ tùy chỉnh, tự động hóa quy trình hoặc tích hợp trực tiếp vào các ứng dụng thiết kế hiện có.

Một ví dụ đơn giản về việc gọi API (giả định có một API endpoint):

import requests

import json

api_url = "https://api.stability.ai/v3/stable-diffusion-3/generate" # Ví dụ

headers = {

"Authorization": "Bearer YOUR_API_KEY",

"Content-Type": "application/json"

}

data = {

"prompt": "A serene landscape with a calm lake reflecting the starry night sky, digital painting, fantasy art, cinematic",

"negative_prompt": "blurry, low quality, deformed, text",

"width": 1024,

"height": 1024,

"steps": 50,

"cfg_scale": 7

}

response = requests.post(api_url, headers=headers, data=json.dumps(data))

if response.status_code == 200:

# Xử lý kết quả, ví dụ lưu hình ảnh

print("Image generated successfully!")

# image_data = response.json()['image_url']

# print(image_data)

else:

print(f"Error: {response.status_code} - {response.text}")Việc triển khai cục bộ thường yêu cầu cài đặt Python, thư viện diffusers và transformers, cùng với một GPU mạnh. Quy trình cơ bản sẽ bao gồm tải mô hình và chạy inference script:

from diffusers import StableDiffusion3Pipeline

import torch

# Đảm bảo bạn đã cài đặt thư viện và có token Hugging Face

pipe = StableDiffusion3Pipeline.from_pretrained("stabilityai/stable-diffusion-3-medium", torch_dtype=torch.float16)

pipe.to("cuda")

prompt = "A futuristic city skyline at dawn, cyberpunk aesthetic, highly detailed, neon lights, reflections"

image = pipe(prompt).images[0]

image.save("cyberpunk_city.png")

print("Image saved as cyberpunk_city.png")Lưu ý: Để chạy các ví dụ code trên, bạn cần có các khóa API hoặc quyền truy cập mô hình tương ứng và cài đặt môi trường lập trình phù hợp.

Tips và Best Practices Khi Sử Dụng Stable Diffusion 3 cho Designer

Để tối ưu hóa trải nghiệm và kết quả khi làm việc với Stable Diffusion 3, designer có thể áp dụng một số mẹo và thủ thuật sau:

- Bắt đầu với Prompts Đơn Giản, Sau Đó Mở Rộng: Thay vì viết một prompt phức tạp ngay từ đầu, hãy bắt đầu với ý tưởng cốt lõi (ví dụ: "

a cat"), sau đó dần dần thêm các chi tiết, phong cách, và yêu cầu bố cục (ví dụ: "a fluffy cat sitting on a bookshelf, cinematic lighting, watercolor style"). Cách tiếp cận này giúp bạn hiểu rõ hơn cách mô hình phản ứng với từng yếu tố. - Thử Nghiệm Với Các Tham Số (Parameters): Các tham số như

steps(số bước lấy mẫu),cfg_scale(mức độ tuân thủ prompt), vàseed(hạt giống ngẫu nhiên) ảnh hưởng lớn đến kết quả.steps: Số bước càng cao, hình ảnh càng chi tiết nhưng tốn thời gian hơn. Thường 20-50 bước là đủ cho hầu hết các trường hợp.cfg_scale: Giá trị cao hơn (ví dụ: 7-12) sẽ khiến mô hình tuân thủ prompt chặt chẽ hơn, nhưng có thể làm giảm tính sáng tạo. Giá trị thấp hơn (ví dụ: 3-6) cho phép mô hình có nhiều tự do hơn.seed: Cố địnhseedđể tạo ra cùng một hình ảnh từ cùng một prompt và các tham số khác. Điều này cực kỳ hữu ích khi bạn muốn tinh chỉnh một hình ảnh cụ thể.

- Sử Dụng Negative Prompts Hiệu Quả: Đây là một trong những công cụ mạnh mẽ nhất để loại bỏ các yếu tố không mong muốn. Luôn có một danh sách các negative prompts cơ bản như "

ugly, deformed, low quality, bad anatomy, blurry, noise, watermark, text, signature". Tùy chỉnh danh sách này dựa trên kết quả bạn nhận được. - Học Hỏi Từ Cộng Đồng: Tham gia các diễn đàn, nhóm cộng đồng về Stable Diffusion (như trên Discord, Reddit) để xem cách người khác viết prompt, chia sẻ kinh nghiệm và khám phá các kỹ thuật mới. Có rất nhiều tài nguyên miễn phí và hướng dẫn chi tiết được chia sẻ hàng ngày.

- Sử Dụng Iteration và Refinement: Rất hiếm khi bạn có được hình ảnh hoàn hảo ngay từ lần thử đầu tiên. Hãy coi việc sử dụng Stable Diffusion 3 là một quá trình lặp đi lặp lại: tạo hình ảnh, đánh giá, điều chỉnh prompt hoặc tham số, và tạo lại.

- Kết Hợp Với Các Công Cụ Khác: Stable Diffusion 3 là một công cụ mạnh mẽ, nhưng nó không phải là giải pháp duy nhất. Kết hợp hình ảnh được tạo ra với các phần mềm chỉnh sửa ảnh truyền thống (Photoshop, Figma) để thêm các chi tiết cuối cùng, điều chỉnh màu sắc, hoặc tích hợp vào các thiết kế phức tạp hơn.

- Hiểu Về Giới Hạn của AI: Mặc dù Stable Diffusion 3 rất mạnh mẽ, nó vẫn có những giới hạn. Đôi khi, nó có thể gặp khó khăn với các chi tiết nhỏ, văn bản phức tạp hoặc các yêu cầu logic quá trừu tượng. Đừng ngần ngại chuyển sang các phương pháp thủ công nếu AI không thể đáp ứng yêu cầu cụ thể.

So Sánh Stable Diffusion 3 Với Các Mô Hình AI Tạo Sinh Khác

Stable Diffusion 3 đã tạo ra một bước tiến lớn trong lĩnh vực AI tạo sinh hình ảnh, nhưng để hiểu rõ giá trị của nó, cần đặt nó vào bối cảnh so sánh với các đối thủ chính như Midjourney và DALL-E 3. Mỗi mô hình đều có những điểm mạnh và yếu riêng, phù hợp với các nhu cầu và phong cách làm việc khác nhau.

Stable Diffusion 3 vs. Midjourney:

Midjourney nổi tiếng với khả năng tạo ra các hình ảnh mang tính nghệ thuật cao, thường có phong cách siêu thực, ấn tượng và dễ dàng tạo ra kết quả đẹp mắt ngay cả với các prompt đơn giản. Nó rất mạnh trong việc tạo ra các tác phẩm nghệ thuật, concept art, và hình ảnh mang tính thẩm mỹ cao. Tuy nhiên, Midjourney có xu hướng ít linh hoạt hơn trong việc kiểm soát chi tiết cụ thể, và khả năng tạo văn bản (text rendering) của nó vẫn còn hạn chế. Nó cũng là một dịch vụ trả phí và không mã nguồn mở.

Stable Diffusion 3, ngược lại, mang lại sự kiểm soát chi tiết vượt trội. Nhờ kiến trúc MMDiT và khả năng hiểu prompt phức tạp, nó có thể tạo ra hình ảnh chính xác hơn theo yêu cầu của designer. Đặc biệt, khả năng tạo văn bản rõ ràng và chính xác là một lợi thế lớn, giúp nó vượt trội trong các ứng dụng thương mại như quảng cáo, branding. Là mã nguồn mở, Stable Diffusion 3 cũng mang lại sự linh hoạt trong việc tùy chỉnh, triển khai cục bộ và tích hợp vào các hệ thống riêng. Nếu bạn cần kiểm soát chính xác từng yếu tố trong hình ảnh và khả năng tùy biến cao, Stable Diffusion 3 là lựa chọn ưu việt hơn. Theo một báo cáo từ Stability AI, trong các bài kiểm tra A/B blind, Stable Diffusion 3 được đánh giá cao hơn Midjourney v6 trong 30% các trường hợp về độ chính xác của prompt.

Stable Diffusion 3 vs. DALL-E 3:

DALL-E 3 của OpenAI tích hợp sâu với ChatGPT, cho phép người dùng tạo ra các prompt phức tạp và điều chỉnh chúng thông qua hội thoại tự nhiên. DALL-E 3 cũng rất mạnh trong việc hiểu ngữ cảnh và tạo ra các hình ảnh tuân thủ prompt khá tốt, đặc biệt là với các yêu cầu mang tính khái niệm. Nó cũng có khả năng tạo văn bản trong hình ảnh tốt hơn các phiên bản DALL-E trước, nhưng vẫn có thể gặp lỗi với các câu dài hoặc phông chữ phức tạp.

Stable Diffusion 3 cạnh tranh trực tiếp với DALL-E 3 về khả năng hiểu prompt và tạo văn bản. Tuy nhiên, Stable Diffusion 3 có tiềm năng lớn hơn về khả năng tùy chỉnh và triển khai. Với DALL-E 3, bạn bị ràng buộc bởi API của OpenAI và không có khả năng tùy chỉnh mô hình hoặc chạy nó cục bộ. Stable Diffusion 3, với bản chất mã nguồn mở, cho phép developer và designer có kiến thức kỹ thuật can thiệp sâu vào mô hình, tinh chỉnh nó cho các tác vụ cụ thể, hoặc thậm chí huấn luyện lại với dữ liệu riêng. Điều này đặc biệt quan trọng cho các doanh nghiệp hoặc cá nhân muốn xây dựng các giải pháp AI độc quyền. Một số thử nghiệm cho thấy Stable Diffusion 3 có thể tạo ra hình ảnh với độ phân giải cao hơn và ít "artifact" hơn so với DALL-E 3 trong một số trường hợp cụ thể, đặc biệt khi được tối ưu hóa đúng cách.

Tóm lại, nếu bạn là designer ưu tiên sự kiểm soát tuyệt đối, khả năng tùy chỉnh, và tiềm năng tích hợp sâu vào quy trình phát triển, Stable Diffusion 3 là lựa chọn hàng đầu. Nếu bạn tìm kiếm sự tiện lợi, dễ sử dụng và không quá quan trọng việc kiểm soát chi tiết hay triển khai cục bộ, Midjourney hoặc DALL-E 3 có thể phù hợp hơn. Tuy nhiên, với Stable Diffusion 3, bạn đang đầu tư vào một công nghệ mở với tiềm năng phát triển và tùy biến không giới hạn.

Các Lưu Ý Quan Trọng Khi Sử Dụng Stable Diffusion 3

- Yêu Cầu Phần Cứng: Mặc dù Stable Diffusion 3 đã được tối ưu hóa, việc chạy mô hình cục bộ (đặc biệt là phiên bản lớn) vẫn yêu cầu một GPU mạnh với VRAM đủ lớn (khuyến nghị tối thiểu 8GB, lý tưởng là 12GB+). Nếu không có phần cứng phù hợp, hãy cân nhắc sử dụng phiên bản API hoặc các dịch vụ đám mây.

- Vấn Đề Đạo Đức và Bản Quyền: Các mô hình AI tạo sinh được huấn luyện trên dữ liệu khổng lồ từ internet, bao gồm cả các tác phẩm có bản quyền. Designer cần nhận thức về các vấn đề đạo đức và pháp lý liên quan đến việc sử dụng hình ảnh do AI tạo ra, đặc biệt trong các dự án thương mại. Luôn kiểm tra các điều khoản sử dụng của Stability AI và cân nhắc nguồn gốc dữ liệu huấn luyện.

- Tính Nhất Quán Trong Thiết Kế: Việc tạo ra một loạt hình ảnh có phong cách hoặc nhân vật nhất quán bằng AI vẫn là một thách thức. Bạn sẽ cần sử dụng các kỹ thuật như cố định

seed, sử dụng cùng một prompt và negative prompt, hoặc tận dụng các tính năng như ControlNet (nếu có hỗ trợ trong phiên bản bạn dùng) để duy trì sự nhất quán. - Học Hỏi Liên Tục: Lĩnh vực AI phát triển rất nhanh. Các phiên bản mới của Stable Diffusion (và các mô hình khác) liên tục được ra mắt với các cải tiến. Hãy luôn cập nhật kiến thức, thử nghiệm các tính năng mới và học hỏi từ cộng đồng để không bị tụt hậu.

- Quản Lý Dữ Liệu và Iterations: Khi tạo ra hàng trăm hình ảnh, việc quản lý và tổ chức chúng trở nên quan trọng. Phát triển một quy trình để lưu trữ, gắn thẻ và đánh giá các kết quả tốt nhất để dễ dàng tìm kiếm và sử dụng sau này.

- Kiểm Tra Tính Thực Tế và Khả Thi: Mặc dù AI có thể tạo ra những hình ảnh tuyệt đẹp, không phải lúc nào chúng cũng thực tế hoặc khả thi trong ngữ cảnh thiết kế cụ thể. Ví dụ, một thiết kế sản phẩm do AI tạo ra có thể trông ấn tượng nhưng không thể sản xuất được. Luôn giữ một cái nhìn phê phán và thực tế.

- An Toàn và Lọc Nội Dung: Stable Diffusion 3, giống như các mô hình AI khác, có thể được sử dụng để tạo ra nội dung không phù hợp. Stability AI đã tích hợp các cơ chế an toàn và bộ lọc nội dung. Designer cần tuân thủ các nguyên tắc cộng đồng và sử dụng công cụ một cách có trách nhiệm.

Câu Hỏi Thường Gặp

Stable Diffusion 3 có miễn phí không?

Có, lõi của Stable Diffusion 3 dự kiến sẽ được phát hành dưới dạng mã nguồn mở, cho phép người dùng tự do tải về và chạy mô hình trên phần cứng của mình. Tuy nhiên, Stability AI cũng có thể cung cấp các dịch vụ API trả phí cho những ai muốn sử dụng mà không cần quản lý phần cứng.

Tôi có cần biết lập trình để sử dụng Stable Diffusion 3 không?

Không nhất thiết. Có nhiều giao diện người dùng đồ họa (GUI) như ComfyUI hoặc Automatic1111's WebUI cho phép bạn tương tác với Stable Diffusion 3 mà không cần viết một dòng code nào. Tuy nhiên, nếu bạn có kiến thức lập trình, bạn sẽ có nhiều quyền kiểm soát và khả năng tùy chỉnh hơn thông qua API hoặc script Python.

Chất lượng hình ảnh của Stable Diffusion 3 so với Midjourney thì sao?

Stable Diffusion 3 đã đạt được những cải tiến đáng kể về chất lượng hình ảnh và độ chính xác của prompt, thường vượt trội hoặc ngang bằng Midjourney v6 trong nhiều bài kiểm tra. Đặc biệt, Stable Diffusion 3 có lợi thế về khả năng tạo văn bản rõ ràng và khả năng kiểm soát chi tiết hơn, trong khi Midjourney thường được đánh giá cao về tính nghệ thuật và dễ sử dụng cho các prompt đơn giản.

Stable Diffusion 3 có thể tạo logo hoặc typography không?

Có, khả năng tạo văn bản trong hình ảnh của Stable Diffusion 3 đã được cải thiện đáng kể, giúp nó có thể tạo ra logo và typography với độ chính xác cao hơn nhiều so với các phiên bản trước. Tuy nhiên, để có kết quả hoàn hảo, designer vẫn nên sử dụng các công cụ chỉnh sửa đồ họa chuyên nghiệp để tinh chỉnh cuối cùng.

Làm thế nào để duy trì phong cách nhất quán khi tạo nhiều hình ảnh?

Để duy trì phong cách nhất quán, bạn nên sử dụng cùng một seed, cùng một prompt (hoặc biến thể nhỏ của prompt đó), và cùng một bộ negative prompts cho các hình ảnh liên quan. Ngoài ra, việc sử dụng các kỹ thuật như "img2img" (image-to-image) hoặc ControlNet (nếu có) cũng có thể giúp duy trì sự nhất quán bằng cách cung cấp hình ảnh tham chiếu.

Kết Luận

Stable Diffusion 3 không chỉ là một công cụ tạo hình ảnh đơn thuần; nó là một cuộc cách mạng trong cách designer tiếp cận quy trình sáng tạo. Với khả năng hiểu prompt vượt trội, chất lượng hình ảnh ấn tượng và đặc biệt là khả năng tạo văn bản chính xác, nó mở ra vô vàn cơ hội cho các nhà thiết kế để hiện thực hóa ý tưởng của mình một cách nhanh chóng và hiệu quả. Việc nắm vững các kỹ thuật prompt engineering và hiểu rõ cách tận dụng sức mạnh của AI này sẽ giúp designer không chỉ tối ưu hóa công việc mà còn khám phá những chân trời sáng tạo mới, đẩy lùi ranh giới của những gì có thể. Tương lai của thiết kế đang dần được định hình bởi những công nghệ như Stable Diffusion 3, và việc các chuyên gia vibe coding nắm bắt nó sẽ quyết định lợi thế cạnh tranh trong kỷ nguyên số.