Kiểm Soát Chất Lượng Code AI: Chiến Lược Testing Tự Động Toàn Diện Với Vibe Coding

Kiểm soát chất lượng code AI là yếu tố then chốt đảm bảo độ tin cậy và hiệu suất của các hệ thống trí tuệ nhân tạo. Bài viết này sẽ đi sâu vào các chiến lược testing tự động toàn diện, giúp bạn hiểu rõ về test code AI từ góc độ chuyên gia và cách tích hợp chúng vào quy trình phát triển AI với vibe coding. Chúng ta sẽ khám phá các phương pháp, công cụ và best practices để tối ưu hóa quy trình kiểm thử, giảm thiểu lỗi và nâng cao chất lượng sản phẩm AI của bạn.

Tại Sao Test Code AI Lại Quan Trọng Hơn Bao Giờ Hết?

Test code AI là quá trình đánh giá và xác minh tính đúng đắn, hiệu suất, độ tin cậy và tính công bằng của các mô hình và ứng dụng AI. Tầm quan trọng của việc test code AI đã tăng lên đáng kể do sự phức tạp ngày càng cao của các mô hình, sự nhạy cảm của dữ liệu và những tác động tiềm ẩn đến xã hội. Một nghiên cứu của IBM năm 2023 chỉ ra rằng, các lỗi trong hệ thống AI có thể gây thiệt hại trung bình 3 triệu USD cho mỗi sự cố, đồng thời làm giảm 60% lòng tin của người dùng.

Khác với phần mềm truyền thống nơi logic được định nghĩa rõ ràng, AI hoạt động dựa trên dữ liệu và học hỏi từ các mẫu. Điều này tạo ra những thách thức độc đáo trong việc kiểm thử. Ví dụ, một mô hình nhận diện hình ảnh có thể hoạt động tốt trên dữ liệu huấn luyện nhưng lại thất bại thảm hại khi gặp phải các trường hợp biên (edge cases) hoặc dữ liệu bị nhiễu. Việc thiếu kiểm thử kỹ lưỡng có thể dẫn đến các vấn đề nghiêm trọng như thiên vị (bias) trong quyết định, hiệu suất kém trong môi trường thực tế, hoặc thậm chí là các lỗi an ninh.

Vibe coding, với khả năng tự động sinh code và tích hợp AI vào quy trình phát triển, càng nhấn mạnh tầm quan trọng của việc test code AI. Khi AI tạo ra code, việc xác minh rằng code đó không chỉ chạy được mà còn đáp ứng các yêu cầu về chất lượng, hiệu suất và độ chính xác là cực kỳ cần thiết. Theo thống kê, việc áp dụng các phương pháp test tự động có thể giảm 40% thời gian debug và tăng 25% độ tin cậy của mô hình AI trong giai đoạn triển khai.

Mục tiêu của test code AI không chỉ là tìm lỗi mà còn là để hiểu rõ hơn về hành vi của mô hình, đảm bảo tính minh bạch và có thể giải thích được (explainability). Điều này đặc biệt quan trọng trong các lĩnh vực nhạy cảm như y tế, tài chính hoặc pháp luật, nơi các quyết định của AI có thể có ảnh hưởng lớn đến cuộc sống con người. Việc đầu tư vào test code AI ngay từ đầu sẽ giúp tiết kiệm chi phí sửa lỗi về sau, vốn có thể cao gấp 10 lần nếu phát hiện ở giai đoạn sản xuất.

Chiến Lược Testing Tự Động Toàn Diện Cho Code AI

Để đảm bảo chất lượng cho code AI, chúng ta cần một chiến lược testing tự động toàn diện, bao gồm nhiều cấp độ và loại hình kiểm thử khác nhau. Một chiến lược hiệu quả thường bao gồm Data Testing, Model Testing, Integration Testing và Adversarial Testing.

1. Data Testing (Kiểm Thử Dữ Liệu)

Data Testing là quá trình xác minh chất lượng, tính nhất quán và tính phù hợp của dữ liệu được sử dụng để huấn luyện và đánh giá mô hình AI. Đây là bước kiểm thử nền tảng, vì "garbage in, garbage out" – chất lượng mô hình phụ thuộc trực tiếp vào chất lượng dữ liệu. Một nghiên cứu của Google cho thấy, hơn 60% các vấn đề về hiệu suất của mô hình AI có nguồn gốc từ chất lượng dữ liệu kém.

- Kiểm tra tính hợp lệ và cấu trúc dữ liệu: Đảm bảo dữ liệu tuân thủ định dạng, kiểu dữ liệu và các ràng buộc đã định. Ví dụ, các trường số phải là số, các trường ngày tháng phải đúng định dạng.

- Phát hiện giá trị thiếu (missing values) và ngoại lai (outliers): Xử lý các giá trị null hoặc các điểm dữ liệu bất thường có thể làm sai lệch quá trình huấn luyện mô hình.

- Kiểm tra tính nhất quán và trùng lặp: Đảm bảo không có dữ liệu mâu thuẫn hoặc bản ghi trùng lặp gây nhiễu.

- Đánh giá phân phối dữ liệu và thiên vị (bias): Phân tích sự phân bố của dữ liệu để phát hiện các mất cân bằng hoặc thiên vị tiềm ẩn có thể ảnh hưởng đến tính công bằng của mô hình.

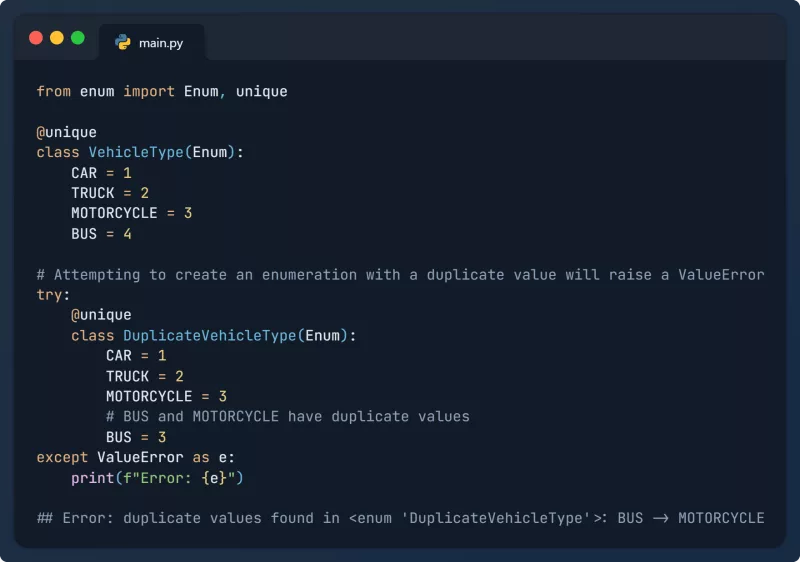

Ví dụ về kiểm tra dữ liệu bằng Python:

import pandas as pd

from sklearn.model_selection import train_test_split

def test_data_quality(df):

# Check for missing values

assert df.isnull().sum().sum() == 0, "Dữ liệu có giá trị thiếu!"

# Check for duplicates

assert df.duplicated().sum() == 0, "Dữ liệu có bản ghi trùng lặp!"

# Check data types (example for a specific column)

assert pd.api.types.is_numeric_dtype(df['feature_numeric']), "Cột 'feature_numeric' không phải dạng số!"

# Check for outliers (simple example using IQR)

Q1 = df['feature_numeric'].quantile(0.25)

Q3 = df['feature_numeric'].quantile(0.75)

IQR = Q3 - Q1

assert df[(df['feature_numeric'] < (Q1 - 1.5 * IQR)) | (df['feature_numeric'] > (Q3 + 1.5 * IQR))].empty, "Dữ liệu có ngoại lai đáng kể!"

print("Kiểm tra chất lượng dữ liệu ban đầu thành công!")

# Load dummy data

data = {'feature_numeric': [1, 2, 3, 100, 5, 6, 7, 8, 9, 10],

'feature_categorical': ['A', 'B', 'A', 'C', 'B', 'A', 'C', 'B', 'A', 'B'],

'target': [0, 1, 0, 1, 0, 1, 0, 1, 0, 1]}

df = pd.DataFrame(data)

# Introduce a missing value and a duplicate for testing failure cases

# df.loc[0, 'feature_numeric'] = None

# df = pd.DataFrame(data).append(df.iloc[0], ignore_index=True)

test_data_quality(df)

2. Model Testing (Kiểm Thử Mô Hình)

Model Testing tập trung vào việc đánh giá hiệu suất và hành vi của mô hình AI sau khi được huấn luyện. Đây là giai đoạn quan trọng nhất để xác định liệu mô hình có đáp ứng được các mục tiêu nghiệp vụ hay không. Theo một khảo sát của Deloitte, các công ty hàng đầu dành tới 30% tổng thời gian phát triển AI cho việc kiểm thử mô hình.

- Unit Testing (Kiểm thử đơn vị) cho các thành phần mô hình: Kiểm tra từng phần nhỏ của mô hình, ví dụ như các hàm tiền xử lý dữ liệu, lớp mạng nơ-ron tùy chỉnh, hoặc các hàm tính toán metric.

- Performance Testing (Kiểm thử hiệu suất): Đánh giá các metric như độ chính xác (accuracy), độ thu hồi (recall), độ chuẩn xác (precision), F1-score, AUC-ROC cho các tác vụ phân loại; RMSE, MAE, R-squared cho các tác vụ hồi quy.

- Robustness Testing (Kiểm thử độ bền vững): Đánh giá khả năng của mô hình duy trì hiệu suất khi đối mặt với dữ liệu nhiễu, không đầy đủ hoặc bị biến đổi nhẹ.

- Bias and Fairness Testing (Kiểm thử thiên vị và công bằng): Phát hiện và giảm thiểu các thiên vị trong mô hình đối với các nhóm nhân khẩu học cụ thể, đảm bảo mô hình đưa ra quyết định công bằng.

- Explainability Testing (Kiểm thử khả năng giải thích): Đảm bảo rằng mô hình có thể cung cấp lý do cho các quyết định của nó, đặc biệt quan trọng trong các lĩnh vực yêu cầu minh bạch cao.

- Regression Testing (Kiểm thử hồi quy): Đảm bảo rằng các thay đổi mới trong code hoặc dữ liệu không làm suy giảm hiệu suất của mô hình đã có.

Ví dụ về kiểm thử hiệu suất mô hình với scikit-learn:

from sklearn.linear_model import LogisticRegression

from sklearn.model_selection import train_test_split

from sklearn.metrics import accuracy_score, precision_score, recall_score, f1_score

from sklearn.datasets import make_classification

def train_and_test_model(X, y):

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

model = LogisticRegression(random_state=42)

model.fit(X_train, y_train)

y_pred = model.predict(X_test)

accuracy = accuracy_score(y_test, y_pred)

precision = precision_score(y_test, y_pred)

recall = recall_score(y_test, y_pred)

f1 = f1_score(y_test, y_pred)

# Assertions for performance metrics

assert accuracy > 0.7, f"Độ chính xác quá thấp: {accuracy}"

assert precision > 0.6, f"Precision quá thấp: {precision}"

assert recall > 0.6, f"Recall quá thấp: {recall}"

assert f1 > 0.65, f"F1-score quá thấp: {f1}"

print(f"Model performance tests passed: Accuracy={accuracy:.2f}, Precision={precision:.2f}, Recall={recall:.2f}, F1={f1:.2f}")

return model

# Generate dummy classification data

X, y = make_classification(n_samples=1000, n_features=10, n_informative=5, n_redundant=0, random_state=42)

trained_model = train_and_test_model(X, y)

3. Integration Testing (Kiểm Thử Tích Hợp)

Integration Testing xác minh rằng mô hình AI hoạt động đúng cách khi được tích hợp vào hệ thống lớn hơn, bao gồm các API, cơ sở dữ liệu và các thành phần phần mềm khác. Đây là nơi các vấn đề về giao tiếp, định dạng dữ liệu và hiệu suất hệ thống thường xuất hiện. Việc tích hợp kém có thể làm giảm hiệu suất tổng thể của hệ thống tới 20-30% ngay cả khi mô hình hoạt động tốt độc lập.

- Kiểm tra API: Đảm bảo các API của mô hình hoạt động đúng, phản hồi đúng định dạng và có hiệu suất chấp nhận được.

- Kiểm tra luồng dữ liệu: Xác minh rằng dữ liệu được truyền tải chính xác giữa các thành phần khác nhau của hệ thống (ví dụ: từ cơ sở dữ liệu đến mô hình, từ mô hình đến giao diện người dùng).

- Kiểm tra hiệu suất hệ thống: Đánh giá độ trễ (latency), thông lượng (throughput) và khả năng mở rộng (scalability) của toàn bộ hệ thống khi mô hình AI được tích hợp.

- Kiểm tra lỗi và phục hồi: Đảm bảo hệ thống có thể xử lý các lỗi một cách gracefully và phục hồi sau các sự cố.

4. Adversarial Testing (Kiểm Thử Đối Kháng)

Adversarial Testing là một kỹ thuật kiểm thử nâng cao nhằm mục đích tìm kiếm các lỗ hổng bảo mật và điểm yếu của mô hình AI bằng cách tạo ra các đầu vào được thiết kế đặc biệt để đánh lừa mô hình. Đây là một lĩnh vực nghiên cứu đang phát triển nhanh chóng, với các cuộc tấn công đối kháng có khả năng làm thay đổi đáng kể đầu ra của mô hình chỉ với những nhiễu loạn nhỏ, không thể nhận thấy bằng mắt thường.

- Adversarial Examples: Tạo ra các ví dụ đầu vào có thay đổi nhỏ nhưng đủ để khiến mô hình đưa ra dự đoán sai. Ví dụ, thêm một nhiễu nhỏ vào hình ảnh có thể khiến mô hình nhận diện sai đối tượng.

- Data Poisoning: Đưa dữ liệu độc hại vào tập huấn luyện để làm suy giảm hiệu suất hoặc tạo ra các hành vi không mong muốn trong mô hình.

- Model Inversion Attacks: Cố gắng tái tạo lại dữ liệu huấn luyện hoặc thông tin nhạy cảm từ các dự đoán của mô hình.

Mặc dù phức tạp, Adversarial Testing là cần thiết để xây dựng các hệ thống AI an toàn và đáng tin cậy, đặc biệt trong các ứng dụng quan trọng. Một báo cáo của NIST năm 2022 khuyến nghị các tổ chức nên tích hợp kiểm thử đối kháng vào quy trình phát triển AI của họ để giảm thiểu rủi ro.

Best Practices và Công Cụ Hỗ Trợ Test Code AI

Để triển khai một chiến lược test code AI hiệu quả, cần áp dụng các best practices và sử dụng các công cụ phù hợp. Vibe coding, với khả năng tự động hóa và tích hợp AI, có thể hỗ trợ đáng kể trong việc này.

1. Tích Hợp Testing Vào Quy Trình CI/CD

Tích hợp testing vào CI/CD là việc tự động hóa các quy trình kiểm thử và triển khai. Mỗi khi có thay đổi code, các bài test (data tests, model performance tests, integration tests) sẽ tự động chạy. Nếu bất kỳ bài test nào thất bại, quá trình triển khai sẽ bị dừng lại, giúp phát hiện lỗi sớm. Theo thống kê, việc áp dụng CI/CD có thể giảm 80% thời gian tìm và sửa lỗi.

- Sử dụng các công cụ CI/CD như

Jenkins,GitLab CI/CD,GitHub Actionsđể tự động hóa việc chạy các bài test. - Thiết lập các ngưỡng chấp nhận được cho các metric hiệu suất của mô hình.

- Đảm bảo rằng code của các bài test cũng được quản lý phiên bản và review như code sản phẩm.

2. Sử Dụng Công Cụ Quản Lý Dữ Liệu Và Phiên Bản (Data Versioning)

Quản lý dữ liệu và phiên bản là việc theo dõi và kiểm soát các thay đổi của dữ liệu và mô hình AI theo thời gian.

- Sử dụng các công cụ như

DVC (Data Version Control)hoặcMLflowđể quản lý các phiên bản dữ liệu, mô hình và siêu tham số (hyperparameters). - Điều này giúp tái tạo kết quả, dễ dàng quay lại các phiên bản trước đó nếu phát hiện lỗi và đảm bảo tính nhất quán trong quá trình phát triển.

3. Áp Dụng Test-Driven Development (TDD) Cho Các Thành Phần AI

Test-Driven Development (TDD) là một phương pháp phát triển phần mềm nơi các bài test được viết trước khi code thực tế được viết.

- Mặc dù khó áp dụng hoàn toàn cho toàn bộ mô hình AI, TDD có thể rất hiệu quả cho các thành phần phi-model như tiền xử lý dữ liệu, các hàm tính toán metric hoặc các API phục vụ mô hình.

- Điều này giúp đảm bảo rằng mỗi thành phần hoạt động đúng như mong đợi và dễ dàng bảo trì.

4. Giám Sát Mô Hình Sau Triển Khai (Monitoring)

Giám sát mô hình sau triển khai là việc theo dõi hiệu suất của mô hình AI trong môi trường sản xuất.

- Các mô hình AI có thể bị suy giảm hiệu suất theo thời gian do sự thay đổi của dữ liệu đầu vào (data drift) hoặc thay đổi trong mối quan hệ giữa các biến (concept drift).

- Sử dụng các công cụ giám sát như

Prometheus,Grafanahoặc các nền tảng MLOps chuyên dụng để theo dõi các metric hiệu suất, độ trễ và các cảnh báo về chất lượng dữ liệu. - Thiết lập các ngưỡng cảnh báo để chủ động phát hiện và khắc phục các vấn đề trước khi chúng ảnh hưởng nghiêm trọng đến người dùng.

5. Tận Dụng Vibe Coding Để Tạo Các Bài Test

Vibe coding có thể đóng vai trò quan trọng trong việc tự động hóa quy trình test code AI.

- Tự động sinh test cases: Với khả năng hiểu ngữ cảnh và yêu cầu, vibe coding có thể giúp sinh ra các test case cho data validation, unit tests cho các hàm xử lý dữ liệu, hoặc thậm chí là các kịch bản kiểm thử hiệu suất cơ bản.

- Phân tích kết quả test: AI có thể hỗ trợ phân tích các báo cáo kiểm thử, xác định các điểm yếu tiềm ẩn hoặc các mẫu lỗi trong dữ liệu hoặc mô hình.

- Tối ưu hóa quy trình testing: Vibe coding có thể đề xuất các chiến lược kiểm thử hiệu quả hơn dựa trên đặc điểm của mô hình và dữ liệu, giúp tiết kiệm thời gian và nguồn lực.

So Sánh Kiểm Thử Code AI Với Kiểm Thử Phần Mềm Truyền Thống

Kiểm thử code AI có những điểm tương đồng nhưng cũng có những khác biệt cơ bản so với kiểm thử phần mềm truyền thống. Mặc dù cả hai đều nhằm mục đích đảm bảo chất lượng, độ tin cậy và hiệu suất, các thách thức và phương pháp tiếp cận lại khác nhau đáng kể.

Phần mềm truyền thống thường dựa trên logic rõ ràng, các quy tắc được định nghĩa trước và hành vi có thể dự đoán được. Các bài kiểm thử chủ yếu tập trung vào việc xác minh rằng code thực hiện đúng các chức năng đã được chỉ định (functional requirements) và tuân thủ các yêu cầu phi chức năng (non-functional requirements) như hiệu suất và bảo mật. Các kỹ thuật như unit testing, integration testing, system testing, và acceptance testing là phổ biến. Coverage code (ví dụ: statement coverage, branch coverage) là một metric quan trọng để đánh giá mức độ kiểm thử.

Ngược lại, code AI và các mô hình học máy hoạt động dựa trên dữ liệu và học hỏi từ các mẫu. Hành vi của chúng có thể không hoàn toàn dự đoán được, đặc biệt là trong các trường hợp biên hoặc khi đối mặt với dữ liệu chưa từng thấy. Điều này dẫn đến một số khác biệt chính:

- Tính determinism: Phần mềm truyền thống thường là deterministic (đầu vào giống nhau luôn cho ra đầu ra giống nhau). Mô hình AI có thể non-deterministic do yếu tố ngẫu nhiên trong quá trình huấn luyện hoặc khi xử lý các đầu vào phức tạp.

- Phụ thuộc vào dữ liệu: Chất lượng và đặc điểm của dữ liệu là yếu tố quyết định hàng đầu đến hiệu suất của AI. Kiểm thử dữ liệu trở thành một phần không thể thiếu. Trong khi đó, phần mềm truyền thống ít phụ thuộc vào chất lượng của dữ liệu đầu vào theo cách này.

- Metric đánh giá: Ngoài các metric phần mềm truyền thống, AI yêu cầu các metric chuyên biệt như accuracy, precision, recall, F1-score, AUC, RMSE để đánh giá hiệu suất mô hình. Các khái niệm như bias, fairness, và explainability cũng là những khía cạnh quan trọng cần được kiểm thử.

- Kiểm thử đối kháng: Các cuộc tấn công đối kháng là một loại kiểm thử đặc thù của AI, không có đối trọng trực tiếp trong phần mềm truyền thống.

- Khó khăn trong việc định nghĩa "đúng": Trong phần mềm truyền thống, "đúng" thường được định nghĩa rõ ràng. Với AI, "đúng" có thể là một vùng xám, phụ thuộc vào mục tiêu tối ưu hóa, dữ liệu và bối cảnh sử dụng.

Tóm lại, kiểm thử code AI đòi hỏi một bộ công cụ và tư duy kiểm thử mở rộng hơn, không chỉ tập trung vào code mà còn vào dữ liệu, mô hình và các tương tác phức tạp trong môi trường thực tế. Việc kết hợp các phương pháp kiểm thử truyền thống với các kỹ thuật kiểm thử AI chuyên biệt là chìa khóa để xây dựng các hệ thống AI mạnh mẽ và đáng tin cậy.

Các Lưu Ý Quan Trọng

- Đừng quên kiểm thử dữ liệu: Hơn 50% vấn đề của mô hình AI bắt nguồn từ dữ liệu kém chất lượng. Đầu tư vào data validation và data quality tests là ưu tiên hàng đầu.

- Định nghĩa rõ ràng các metric thành công: Trước khi bắt đầu huấn luyện, hãy xác định rõ ràng các metric hiệu suất (accuracy, F1-score, RMSE, v.v.) và ngưỡng chấp nhận được cho mô hình của bạn.

- Thường xuyên cập nhật bộ test: Khi mô hình và dữ liệu phát triển, các bài test cũng cần được cập nhật để phản ánh những thay đổi này. Các bài test cũ có thể không còn phù hợp hoặc bỏ sót các trường hợp mới.

- Đảm bảo tính tái tạo (Reproducibility): Việc có thể tái tạo lại kết quả của mô hình là cực kỳ quan trọng cho việc debug và kiểm thử. Ghi lại các phiên bản code, dữ liệu, siêu tham số và môi trường thực thi.

- Kiểm thử trên nhiều tập dữ liệu: Không chỉ kiểm thử trên tập test set đã chia, mà còn sử dụng các tập dữ liệu độc lập khác hoặc dữ liệu từ môi trường thực tế để đánh giá tính tổng quát của mô hình.

- Đánh giá thiên vị và công bằng: Đặc biệt quan trọng trong các ứng dụng nhạy cảm. Sử dụng các kỹ thuật như Aequitas hoặc Fairlearn để đánh giá và giảm thiểu bias.

- Tận dụng công cụ MLOps: Các nền tảng MLOps (Machine Learning Operations) giúp tự động hóa và quản lý toàn bộ vòng đời của mô hình AI, bao gồm cả testing và monitoring.

Câu Hỏi Thường Gặp

Kiểm thử tự động có thực sự cần thiết cho mọi dự án AI không?

Có, kiểm thử tự động là cực kỳ cần thiết cho hầu hết các dự án AI, đặc biệt là những dự án có quy mô lớn, phức tạp hoặc yêu cầu độ tin cậy cao. Nó giúp phát hiện lỗi sớm, giảm chi phí sửa lỗi, đảm bảo tính nhất quán và cho phép các nhà phát triển lặp lại nhanh chóng các thay đổi. Với vibe coding, việc tạo ra các bài test tự động cũng trở nên dễ dàng hơn, làm cho việc này càng khả thi và hiệu quả.

Làm thế nào để kiểm thử các mô hình AI không có kết quả "đúng" rõ ràng?

Đối với các mô hình AI không có kết quả "đúng" rõ ràng (ví dụ: mô hình tạo sinh, mô hình khám phá), việc kiểm thử cần tập trung vào các metric định tính và dựa trên con người. Các phương pháp như đánh giá của chuyên gia (human-in-the-loop evaluation), A/B testing, hoặc các metric proxy (ví dụ: sự đa dạng của đầu ra, tính hợp lý của cấu trúc) có thể được sử dụng. Ví dụ, với mô hình sinh văn bản, bạn có thể kiểm tra tính mạch lạc, độ chính xác ngữ pháp và sự phù hợp với ngữ cảnh.

Vibe coding giúp ích gì trong việc test code AI?

Vibe coding giúp ích rất nhiều trong việc test code AI thông qua khả năng tự động sinh code và hiểu ngữ cảnh. Nó có thể giúp tự động tạo ra các test cases cho data validation, unit tests cho các hàm xử lý dữ liệu, hoặc thậm chí là các kịch bản kiểm thử hiệu suất cơ bản. AI cũng có thể hỗ trợ phân tích kết quả test, xác định các điểm yếu tiềm ẩn hoặc các mẫu lỗi trong dữ liệu hoặc mô hình, từ đó tối ưu hóa quy trình testing và giảm thiểu công sức thủ công.

Tôi nên bắt đầu với loại kiểm thử nào khi mới triển khai một dự án AI?

Bạn nên bắt đầu với Data Testing (kiểm thử dữ liệu) và Unit Testing cho các thành phần phi-model. Đảm bảo dữ liệu đầu vào chất lượng cao và các hàm tiền xử lý hoạt động đúng là nền tảng vững chắc. Sau đó, chuyển sang Model Performance Testing để đánh giá hiệu suất cơ bản của mô hình và Integration Testing khi mô hình được tích hợp vào hệ thống lớn hơn. Adversarial Testing có thể được xem xét ở các giai đoạn sau, khi mô hình đã ổn định và yêu cầu bảo mật cao.

Kết Luận

Kiểm soát chất lượng code AI thông qua chiến lược testing tự động toàn diện không chỉ là một yêu cầu kỹ thuật mà còn là yếu tố sống còn để xây dựng các hệ thống AI đáng tin cậy, công bằng và hiệu quả. Bằng cách kết hợp Data Testing, Model Testing, Integration Testing và Adversarial Testing, cùng với việc áp dụng các best practices và tận dụng sức mạnh của vibe coding, các nhà phát triển có thể giảm thiểu rủi ro, tối ưu hóa hiệu suất và nâng cao giá trị mà AI mang lại. Việc đầu tư vào test code AI ngay từ đầu sẽ giúp bạn tiết kiệm chi phí, tăng tốc độ phát triển và xây dựng niềm tin cho người dùng.