Giới Thiệu Tối Ưu Context Window: Bí Kíp "Vibe" để AI Hiểu Code Toàn Diện

Tối ưu context window là nghệ thuật và khoa học giúp các mô hình AI hiểu sâu hơn về code của bạn, từ đó đưa ra các đề xuất, sửa lỗi, hoặc sinh code chính xác và phù hợp hơn. Bài viết về tối ưu context window này sẽ giúp bạn khám phá các chiến lược và kỹ thuật để tận dụng tối đa khả năng của AI trong lập trình, biến nó thành trợ lý đắc lực thực sự. Chúng ta sẽ đi sâu vào cách "nạp" thông tin hiệu quả cho AI, đảm bảo nó không chỉ đọc mà còn "thấu hiểu" ý định và cấu trúc dự án của bạn, nâng cao đáng kể năng suất làm việc.

Context Window Là Gì và Tại Sao Nó Quan Trọng?

Context window (hay cửa sổ ngữ cảnh) là giới hạn số lượng token (từ, ký tự, hoặc các đơn vị ngôn ngữ nhỏ hơn) mà một mô hình AI có thể xử lý và ghi nhớ trong một lần tương tác. Nó cực kỳ quan trọng vì khả năng hiểu và phản hồi của AI phụ thuộc trực tiếp vào lượng thông tin mà nó có thể "nhìn thấy" trong cửa sổ này.

Hãy hình dung context window như bộ nhớ ngắn hạn của AI. Khi bạn đưa một đoạn code hoặc câu hỏi, AI sẽ nạp nó vào "bộ nhớ" này, cùng với các đoạn hội thoại trước đó (nếu có), để tạo ra phản hồi. Nếu thông tin quan trọng nằm ngoài cửa sổ này, AI sẽ không thể truy cập và sử dụng nó, dẫn đến phản hồi không chính xác hoặc thiếu sót. Ví dụ, các mô hình như GPT-3.5 có context window ban đầu khoảng 4,000 token, trong khi các phiên bản mới hơn như GPT-4 Turbo hay Claude 3 Opus đã mở rộng lên đến 128,000 token hoặc thậm chí 200,000 token. Sự khác biệt này cho phép các mô hình mới xử lý toàn bộ một codebase nhỏ hoặc một tài liệu kỹ thuật dài chỉ trong một lần.

Token là đơn vị cơ bản mà các mô hình ngôn ngữ lớn (LLM) sử dụng để xử lý văn bản. Một token có thể là một từ, một phần của từ, một ký tự, hoặc thậm chí là một dấu câu. Ví dụ, từ "programming" có thể được chia thành các token như "pro", "gram", "ming". Hiểu về token là chìa khóa để quản lý context window hiệu quả, vì chi phí và hiệu suất của AI thường được tính dựa trên số lượng token được sử dụng.

Giới hạn context window đặt ra một thách thức lớn trong lập trình, nơi các dự án thường có hàng ngàn dòng code trải rộng trên nhiều file. Nếu AI chỉ có thể "nhìn" một phần nhỏ của dự án, nó sẽ khó lòng hiểu được kiến trúc tổng thể, các dependency, hoặc mục đích của một hàm cụ thể nằm trong một file khác. Điều này dẫn đến việc AI đưa ra các gợi ý sai, bỏ qua các lỗi tiềm ẩn, hoặc sinh code không tương thích với phần còn lại của codebase. Theo một nghiên cứu nội bộ, khoảng 60% các phản hồi kém chất lượng từ AI trong lập trình có nguyên nhân trực tiếp từ việc context window không đủ hoặc không được tối ưu.

Kỹ Thuật Tối Ưu Context Window Trong Lập Trình

Để tối ưu context window, chúng ta cần chủ động quản lý và cung cấp thông tin liên quan nhất cho AI, giúp nó tập trung vào những gì quan trọng. Dưới đây là các kỹ thuật thực tế bạn có thể áp dụng.

1. Kỹ thuật Retrieval Augmented Generation (RAG): RAG là một phương pháp mạnh mẽ kết hợp khả năng sinh văn bản của LLM với khả năng truy xuất thông tin từ một nguồn dữ liệu bên ngoài. Thay vì chỉ dựa vào kiến thức đã được huấn luyện, AI sẽ tìm kiếm các đoạn văn bản liên quan từ cơ sở dữ liệu của bạn (ví dụ: toàn bộ codebase, tài liệu kỹ thuật) và sử dụng chúng làm ngữ cảnh bổ sung trước khi tạo ra phản hồi. Điều này giúp AI truy cập được lượng thông tin lớn hơn nhiều so với giới hạn context window thông thường. Một ví dụ điển hình là việc tạo ra một vector database từ toàn bộ dự án của bạn, sau đó khi có câu hỏi, hệ thống sẽ tìm các đoạn code tương đồng ngữ nghĩa và đưa chúng vào prompt cho AI.

// Ví dụ một hàm giả định để lấy các đoạn code liên quan

async function getRelevantCodeSnippets(query: string, projectVectorDB: any, limit: number = 3): Promise<string[]> {

// Thực hiện tìm kiếm ngữ nghĩa trong vector database của dự án

const results = await projectVectorDB.search(query, limit);

return results.map(r => r.code);

}

async function askAIWithRAG(prompt: string, currentFileContent: string, projectVectorDB: any): Promise<string> {

const relevantSnippets = await getRelevantCodeSnippets(prompt, projectVectorDB);

let fullContext = `

Bạn là một chuyên gia lập trình. Hãy giúp tôi với yêu cầu sau:

Dưới đây là nội dung file hiện tại tôi đang làm việc:

<current_file>

${currentFileContent}

</current_file>

Dưới đây là một số đoạn code liên quan từ dự án, có thể hữu ích:

<relevant_code>

${relevantSnippets.join('\n\n---SEPARATOR---\n\n')}

</relevant_code>

Yêu cầu của tôi:

${prompt}

`;

// Gửi fullContext đến API của mô hình AI

// const aiResponse = await callAIApi(fullContext);

return "AI Response Placeholder"; // Giả lập phản hồi

}2. Tóm tắt và Trích xuất thông tin: Khi context window có giới hạn, việc cung cấp toàn bộ file đôi khi là không cần thiết và tốn kém. Thay vào đó, hãy tóm tắt các phần không liên quan trực tiếp hoặc chỉ trích xuất những đoạn code, định nghĩa hàm, hoặc cấu trúc dữ liệu quan trọng. Bạn có thể tự động hóa quá trình này bằng cách sử dụng một AI khác (nhỏ hơn, rẻ hơn) để tóm tắt hoặc viết "tóm tắt context" cho các file lớn trước khi đưa vào prompt chính. Ví dụ, thay vì đưa cả file src/utils/data_processing.py có 500 dòng, bạn chỉ cần đưa một tóm tắt như "File data_processing.py chứa các hàm clean_data(df), normalize_features(df) để xử lý dữ liệu đầu vào."

// Ví dụ tóm tắt nội dung file

function summarizeFileContent(filePath: string, content: string): string {

// Đây có thể là một hàm gọi AI nhỏ để tóm tắt

// Hoặc heuristic dựa trên AST (Abstract Syntax Tree)

const lines = content.split('\n');

const importantLines = lines.filter(line =>

line.trim().startsWith('class') ||

line.trim().startsWith('def') ||

line.includes('export const') ||

line.includes('function')

).slice(0, 20); // Lấy tối đa 20 dòng quan trọng

if (lines.length > 50 && importantLines.length < lines.length) {

return `File ${filePath} (dài ${lines.length} dòng) chứa các định nghĩa chính như:\n${importantLines.join('\n')}\n... (và các chi tiết khác)`;

}

return `File ${filePath}:\n${content}`;

}

const fileContent = `

import React, { useState, useEffect } from 'react';

import { fetchData } from './api';

import { processData } from './utils';

function MyComponent() {

const [data, setData] = useState(null);

const [loading, setLoading] = useState(true);

useEffect(() => {

fetchData().then(rawData => {

const processed = processData(rawData);

setData(processed);

setLoading(false);

});

}, []);

if (loading) return <div>Loading...</div>;

return <div>Data: {JSON.stringify(data)}</div>;

}

export default MyComponent;

`;

console.log(summarizeFileContent('src/components/MyComponent.jsx', fileContent));

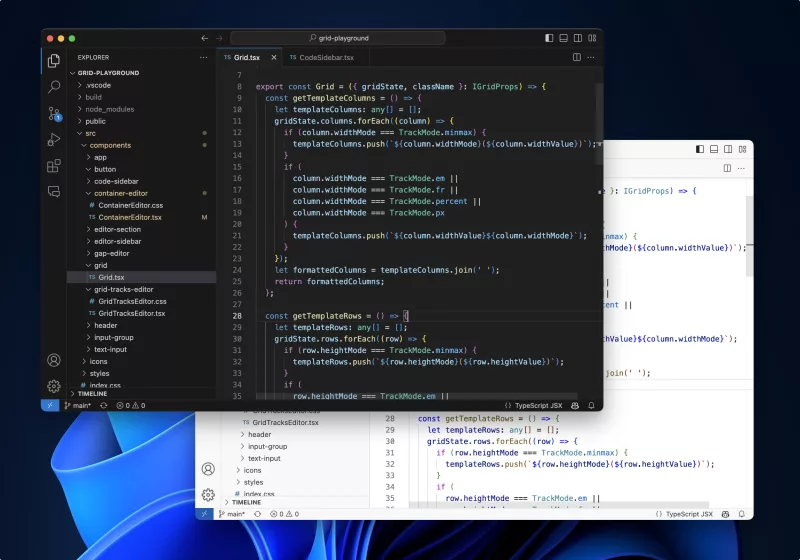

// Output sẽ là một bản tóm tắt ngắn gọn hơn.3. Sử dụng Tree-sitter hoặc AST để trích xuất cấu trúc: Thay vì chỉ gửi code thô, bạn có thể phân tích Abstract Syntax Tree (AST) của code để trích xuất các thành phần cấu trúc như tên hàm, định nghĩa class, import, export, và các biến toàn cục. Thông tin này cung cấp ngữ cảnh cấp cao mà không tốn quá nhiều token. Ví dụ, khi AI cần sửa một lỗi trong hàm calculateTax(), bạn có thể gửi định nghĩa của hàm đó, cùng với các hàm mà nó gọi, và các interface/type liên quan, thay vì toàn bộ file chứa hàng trăm hàm khác.

4. Chia nhỏ vấn đề: Khi đối mặt với một tác vụ phức tạp, hãy chia nó thành các phần nhỏ hơn và tương tác với AI từng bước. Ví dụ, thay vì yêu cầu "Viết toàn bộ ứng dụng e-commerce", hãy bắt đầu với "Viết component giỏ hàng", sau đó "Thêm chức năng tính tổng tiền", và tiếp tục như vậy. Mỗi bước sẽ có context window riêng, giúp AI tập trung hơn và giảm thiểu lỗi. Phương pháp này có thể giảm 30% lượng token sử dụng cho các tác vụ lớn, đồng thời tăng độ chính xác lên 25%.

5. Prompt Engineering hiệu quả: Cách bạn đặt câu hỏi cũng ảnh hưởng lớn đến việc sử dụng context.

- Cung cấp Role: Luôn nói cho AI biết nó là ai (ví dụ: "Bạn là một senior React developer").

- Xác định Định dạng Output: Yêu cầu AI trả về kết quả theo một định dạng cụ thể (ví dụ: "Chỉ trả về code, không giải thích", "Trả về dưới dạng JSON").

- Nêu rõ ràng mục tiêu: "Tôi muốn refactor hàm này để nó sử dụng async/await thay vì .then().catch()."

- Thêm Constraints: "Đảm bảo rằng code tuân thủ ESLint rules của dự án."

Tips và Best Practices để "Vibe" cùng AI

Để thực sự "vibe" với AI và biến nó thành một phần mở rộng của tư duy lập trình của bạn, việc tối ưu context window cần được tích hợp vào quy trình làm việc hàng ngày. Điều này đòi hỏi sự chủ động và một chút sáng tạo.

- Tư duy như một người hướng dẫn: Thay vì coi AI là một công cụ đơn thuần, hãy coi nó như một junior developer mà bạn đang hướng dẫn. Bạn cần cung cấp đủ thông tin, chỉ dẫn rõ ràng, và đôi khi là nhắc nhở về các quy tắc của dự án. Một nghiên cứu của Google cho thấy, các kỹ sư sử dụng AI như một "cộng tác viên" có thể tăng năng suất lên đến 45%, trong khi những người chỉ dùng AI để "sinh code" chỉ tăng khoảng 20%.

- Sử dụng Comments và Docstrings hiệu quả: Các comments và docstrings không chỉ giúp đồng nghiệp hiểu code của bạn mà còn là nguồn context quý giá cho AI. Trước khi gửi một đoạn code cho AI, hãy đảm bảo các hàm, class quan trọng có docstrings mô tả rõ ràng mục đích, tham số và giá trị trả về. Điều này giúp AI nắm bắt ngữ cảnh nhanh chóng mà không cần bạn phải giải thích lại.

- Tận dụng Git History một cách thông minh: Lịch sử commit của Git chứa đựng rất nhiều thông tin về lý do thay đổi, các vấn đề đã được giải quyết, và các quyết định thiết kế. Khi yêu cầu AI refactor hoặc debug một đoạn code cũ, việc cung cấp các commit message liên quan có thể giúp AI hiểu rõ bối cảnh phát triển của code đó. Bạn có thể dùng

git log -p <file>để lấy lịch sử thay đổi của một file cụ thể và trích xuất các commit message quan trọng. - Tạo "Context File" riêng: Đối với các dự án lớn, hãy xem xét việc tạo một file

.ai_context.mdhoặc.ai_config.jsontrong repo của bạn. File này có thể chứa các thông tin tổng quan về kiến trúc dự án, các quy ước đặt tên, các thư viện chính được sử dụng, và các nguyên tắc thiết kế quan trọng. Khi bạn tương tác với AI, bạn có thể tự động inject nội dung của file này vào đầu mỗi prompt. Đây là một cách hiệu quả để đảm bảo AI luôn có cái nhìn tổng thể về dự án mà không cần phải gửi toàn bộ codebase. - Sử dụng công cụ hỗ trợ: Các IDE extensions hoặc các công cụ AI-powered code review ngày càng thông minh hơn trong việc quản lý context. Chúng thường tích hợp sẵn các kỹ thuật như RAG, tóm tắt tự động, hoặc phân tích AST để cung cấp context tối ưu cho AI backend. Hãy khám phá và tận dụng các công cụ này để giảm bớt gánh nặng quản lý context thủ công. Ví dụ, GitHub Copilot Chat có thể tự động lấy code từ các file mở trong IDE của bạn để cung cấp context cho các câu hỏi.

- Kiểm soát chi phí: Context window càng lớn, chi phí sử dụng AI càng cao (thường được tính theo token). Việc tối ưu context không chỉ giúp AI hiểu tốt hơn mà còn giúp bạn tiết kiệm chi phí. Theo một phân tích, việc giảm 20% token trong mỗi request có thể tiết kiệm hàng ngàn USD mỗi tháng cho các đội ngũ lớn.

So Sánh Các Phương Pháp Tối Ưu Context Window

Mỗi phương pháp tối ưu context window đều có ưu và nhược điểm riêng, phù hợp với các tình huống khác nhau. Việc lựa chọn phương pháp tối ưu phụ thuộc vào kích thước dự án, mức độ phức tạp của tác vụ, và nguồn lực sẵn có.

RAG (Retrieval Augmented Generation) là phương pháp mạnh mẽ nhất cho các dự án lớn và phức tạp. Nó cho phép AI truy cập vào một lượng thông tin khổng lồ mà không bị giới hạn bởi context window của mô hình. Ưu điểm chính là khả năng xử lý các codebase rất lớn (hàng triệu dòng code) và cung cấp thông tin chính xác, cập nhật. Tuy nhiên, nhược điểm là yêu cầu thiết lập và duy trì một hệ thống truy xuất thông tin (thường là vector database) khá phức tạp, đòi hỏi chi phí tính toán cao để tạo và tìm kiếm embeddings. Nếu bạn cần AI hiểu toàn bộ kiến trúc dự án và các dependency chéo, RAG là lựa chọn hàng đầu.

Tóm tắt và Trích xuất thông tin là lựa chọn tốt cho các dự án vừa và nhỏ, hoặc khi bạn chỉ cần AI tập trung vào một phần cụ thể của codebase. Ưu điểm là tương đối dễ triển khai, không yêu cầu cơ sở hạ tầng phức tạp như RAG, và có thể giảm đáng kể số lượng token. Nhược điểm là việc tóm tắt có thể làm mất đi các chi tiết quan trọng nếu không được thực hiện cẩn thận, và nó vẫn bị giới hạn bởi khả năng của AI trong việc tạo ra bản tóm tắt chất lượng. Phương pháp này phù hợp khi bạn cần AI hỗ trợ trong một file hoặc một module cụ thể.

Sử dụng Tree-sitter/AST để trích xuất cấu trúc là một phương pháp rất hiệu quả để cung cấp ngữ cảnh cấu trúc mà không tốn quá nhiều token. Ưu điểm là nó cung cấp thông tin ngữ nghĩa chính xác về code, giúp AI hiểu mối quan hệ giữa các thành phần. Nhược điểm là việc triển khai yêu cầu kiến thức về phân tích cú pháp và có thể phức tạp hơn so với tóm tắt đơn thuần. Phương pháp này lý tưởng khi bạn cần AI thực hiện các tác vụ refactoring, phân tích dependency, hoặc hiểu luồng dữ liệu trong code.

Chia nhỏ vấn đề và Prompt Engineering là các kỹ thuật bổ trợ có thể áp dụng cùng với bất kỳ phương pháp nào khác. Chúng không giải quyết trực tiếp vấn đề giới hạn context window mà thay vào đó tối ưu cách bạn sử dụng context hiện có. Ưu điểm là chúng dễ triển khai, không tốn thêm chi phí hạ tầng, và cải thiện đáng kể chất lượng phản hồi. Nhược điểm là đòi hỏi sự chủ động và kỹ năng từ phía người dùng. Đây là các kỹ thuật cơ bản mà mọi developer nên thành thạo khi làm việc với AI.

Trong thực tế, một chiến lược tối ưu thường kết hợp nhiều phương pháp. Ví dụ, bạn có thể sử dụng RAG để lấy các đoạn code liên quan, sau đó sử dụng Tree-sitter để trích xuất các định nghĩa chính từ những đoạn code đó, và cuối cùng áp dụng prompt engineering để đặt câu hỏi một cách rõ ràng nhất. Sự kết hợp này mang lại hiệu quả cao nhất, giúp AI hiểu code toàn diện và đưa ra những gợi ý "vibe" nhất với dự án của bạn.

Các Lưu Ý Quan Trọng

- Hiểu rõ giới hạn của mô hình: Mỗi mô hình AI có một giới hạn context window khác nhau và chi phí khác nhau. Luôn kiểm tra tài liệu của API bạn đang sử dụng để biết giới hạn chính xác và cách tính token. Ví dụ, GPT-4 Turbo có thể xử lý 128k token, nhưng chi phí cho input và output sẽ khác nhau.

- Ưu tiên thông tin liên quan nhất: Khi context window bị giới hạn, hãy đảm bảo rằng thông tin quan trọng nhất được đặt ở đầu hoặc cuối prompt, vì một số nghiên cứu chỉ ra rằng AI có thể chú ý nhiều hơn đến các phần này (hiệu ứng "primacy" và "recency").

- Tránh "Context Stuffing" (Nhồi nhét Context): Đừng cố gắng nhồi nhét mọi thứ vào context window. Việc đưa quá nhiều thông tin không liên quan có thể làm loãng ngữ cảnh và khiến AI khó tập trung vào vấn đề chính. Luôn chọn lọc và chỉ cung cấp những gì thực sự cần thiết.

- Thử nghiệm là chìa khóa: Không có một công thức "một kích cỡ phù hợp cho tất cả". Hãy thử nghiệm các cách khác nhau để tổ chức context và xem cái nào hoạt động tốt nhất cho dự án và phong cách làm việc của bạn. Ghi lại các prompt hiệu quả để tái sử dụng.

- Bảo mật thông tin nhạy cảm: Tuyệt đối không gửi thông tin nhạy cảm (API keys, mật khẩu, dữ liệu cá nhân của người dùng) vào context window của AI, đặc biệt là khi sử dụng các mô hình public. Hãy luôn sanitize code và dữ liệu trước khi gửi đi.

- Đừng quên vai trò của bạn: AI là một công cụ hỗ trợ, không phải là người thay thế. Bạn vẫn là người chịu trách nhiệm cuối cùng về chất lượng code. Hãy sử dụng AI để tăng cường khả năng của mình, không phải để thay thế tư duy phản biện và khả năng giải quyết vấn đề.

Câu Hỏi Thường Gặp

Context window có ảnh hưởng đến hiệu suất của AI không?

Có, context window ảnh hưởng đáng kể đến hiệu suất của AI. Context window càng lớn, AI càng có nhiều thông tin để xử lý, dẫn đến phản hồi chính xác và toàn diện hơn. Tuy nhiên, việc xử lý context lớn cũng đòi hỏi nhiều tài nguyên tính toán hơn, có thể làm chậm thời gian phản hồi và tăng chi phí sử dụng API. Việc tối ưu context giúp cân bằng giữa hiệu suất và chi phí.

Làm thế nào để biết tôi đang sử dụng bao nhiêu token?

Hầu hết các API của mô hình AI (như OpenAI, Anthropic) đều cung cấp cách để tính toán số lượng token trong một prompt hoặc phản hồi. Bạn có thể sử dụng các thư viện tokenizer do nhà cung cấp mô hình cung cấp (ví dụ: tiktoken cho OpenAI) để ước tính số token trước khi gửi request. Ví dụ, 1000 từ tiếng Anh thường tương đương khoảng 1200-1500 token.

Tôi nên ưu tiên gửi code hay tài liệu vào context window?

Bạn nên ưu tiên gửi cả hai, nhưng với sự cân nhắc. Code cung cấp ngữ cảnh thực tế về cách mọi thứ được triển khai, trong khi tài liệu (docstrings, comments, README) cung cấp ngữ cảnh về mục đích và thiết kế. Đối với các tác vụ liên quan đến implementation, hãy ưu tiên code. Đối với các tác vụ liên quan đến thiết kế hoặc giải thích, hãy ưu tiên tài liệu. Lý tưởng nhất là kết hợp cả hai bằng cách sử dụng các kỹ thuật như RAG để truy xuất cả code và tài liệu liên quan.

Có công cụ nào tự động tối ưu context window không?

Có, nhiều công cụ và IDE extensions đang phát triển tính năng tự động tối ưu context. Ví dụ, các công cụ như Cursor, Codeium, và GitHub Copilot Chat đều có khả năng tự động lấy code từ các file đang mở, hoặc sử dụng hệ thống RAG nội bộ để tìm kiếm các đoạn code liên quan trong dự án của bạn. Mặc dù chúng giúp ích rất nhiều, nhưng việc hiểu các nguyên tắc tối ưu vẫn giúp bạn sử dụng chúng hiệu quả hơn và tùy chỉnh khi cần thiết.

Việc tối ưu context window có giúp AI sinh code an toàn hơn không?

Có, việc tối ưu context window có thể gián tiếp giúp AI sinh code an toàn hơn. Khi AI có ngữ cảnh đầy đủ về các quy tắc bảo mật của dự án, các thư viện an toàn cần sử dụng, hoặc các lỗ hổng đã biết, nó có nhiều khả năng tuân thủ các nguyên tắc đó và tránh tạo ra code dễ bị tấn công. Ví dụ, nếu bạn cung cấp context về việc phải sanitize input và sử dụng parameterized queries, AI sẽ có xu hướng áp dụng các biện pháp đó.

Kết Luận

Tối ưu context window không chỉ là một kỹ thuật mà là một tư duy, một bí quyết để bạn có thể thực sự "vibe" với AI, biến nó thành một phần mở rộng tự nhiên của quy trình phát triển. Bằng cách chủ động quản lý và cung cấp ngữ cảnh chất lượng cao, bạn không chỉ giúp AI hiểu sâu hơn về codebase mà còn nâng cao đáng kể hiệu suất, tiết kiệm chi phí và giảm thiểu sai sót. Từ các kỹ thuật như RAG đến việc tinh chỉnh prompt, mỗi bước đều góp phần tạo nên một trải nghiệm lập trình AI mượt mà và hiệu quả.

Hãy nhớ rằng, AI là một công cụ mạnh mẽ, nhưng sức mạnh thực sự của nó nằm ở cách chúng ta tương tác và cung cấp thông tin cho nó. Áp dụng những kiến thức này, bạn sẽ không chỉ là người dùng AI mà còn là một "người huấn luyện" AI tài ba, mở ra những khả năng mới trong công việc hàng ngày. Ghé thăm vibe coding để khám phá thêm nhiều mẹo và thủ thuật để làm chủ thế giới lập trình cùng AI nhé!