Giới Thiệu Vibe Coding: Mẹo Giảm Token AI Hiệu Quả – Tiết Kiệm Chi Phí, Tăng Tốc Phát Triển

Trong kỷ nguyên AI bùng nổ, việc quản lý và tối ưu hóa chi phí vận hành các mô hình ngôn ngữ lớn (LLMs) trở thành ưu tiên hàng đầu cho mọi nhà phát triển. Bài viết này sẽ giúp bạn hiểu rõ về tối ưu token AI từ góc nhìn thực tế, cung cấp các mẹo giảm token AI hiệu quả để tiết kiệm chi phí và tăng tốc độ phát triển. Chúng ta sẽ đi sâu vào các kỹ thuật giảm số lượng token mà mô hình AI xử lý, từ đó cải thiện hiệu suất và giảm đáng kể chi phí API.

Token AI Là Gì và Tại Sao Cần Tối Ưu?

Token AI là đơn vị cơ bản mà các mô hình ngôn ngữ lớn (LLMs) sử dụng để xử lý văn bản, có thể là một từ, một phần của từ, hoặc một ký tự đặc biệt. Hiểu một cách đơn giản, khi bạn gửi một câu hỏi hoặc bất kỳ văn bản nào đến một mô hình AI như GPT-4, văn bản đó sẽ được chia nhỏ thành các token, và mô hình sẽ xử lý dựa trên số lượng token này. Ví dụ, từ "tokenization" có thể được chia thành các token như "token", "iz", "ation".

Việc tối ưu token AI là cực kỳ quan trọng bởi vì chi phí sử dụng API của các LLMs thường được tính dựa trên số lượng token đầu vào (prompt) và đầu ra (completion). Nếu một ứng dụng AI xử lý hàng triệu hoặc hàng tỷ token mỗi ngày, chi phí có thể lên đến hàng nghìn, thậm chí hàng chục nghìn đô la mỗi tháng. Theo ước tính từ OpenAI, một trang A4 thông thường có khoảng 500-700 từ, tương đương với 700-1000 token. Một dự án AI tương tác cao có thể dễ dàng tiêu thụ hàng triệu token mỗi ngày, dẫn đến chi phí vận hành tăng vọt 30-50% nếu không được tối ưu.

Ngoài chi phí, số lượng token cũng ảnh hưởng trực tiếp đến tốc độ phản hồi của mô hình. Càng nhiều token, mô hình càng mất nhiều thời gian để xử lý và tạo ra phản hồi. Giảm token không chỉ là tiết kiệm tiền mà còn là cách để tăng tốc độ phản hồi của ứng dụng AI lên tới 20-40%, cải thiện trải nghiệm người dùng và hiệu quả hoạt động.

Các Kỹ Thuật Tối Ưu Token AI Hiệu Quả

Để tối ưu token AI, chúng ta cần áp dụng nhiều kỹ thuật khác nhau từ giai đoạn tiền xử lý dữ liệu đến thiết kế prompt. Mỗi kỹ thuật đều có vai trò riêng và khi kết hợp lại sẽ mang lại hiệu quả đáng kể.

1. Rút Gọn Prompt (Prompt Abbreviation)

Rút gọn prompt là kỹ thuật đơn giản nhất nhưng lại cực kỳ hiệu quả để giảm số lượng token đầu vào. Thay vì viết những câu dài dòng, hãy cố gắng truyền tải ý định của bạn một cách ngắn gọn và súc tích nhất có thể mà vẫn đảm bảo AI hiểu đúng ngữ cảnh. Ví dụ, thay vì "Please provide a detailed summary of the following article, highlighting the main points and key takeaways, ensuring the summary is concise and easy to understand," bạn có thể viết "Summarize this article, focus on main points, be concise."

Một ví dụ cụ thể khác cho việc tối ưu token AI:

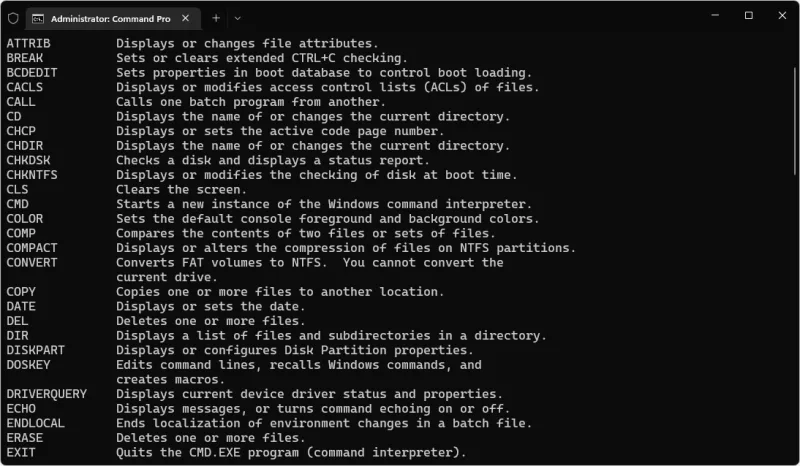

// Prompt gốc (token cao)

const longPrompt = `As an expert in software engineering and artificial intelligence, I need you to analyze the provided Python code snippet.

Your task is to identify any potential bugs, suggest improvements for performance and readability, and explain your reasoning in detail.

Also, consider best practices for asynchronous programming if applicable. The code is for a web scraping utility.`;

// Prompt đã rút gọn (token thấp)

const shortPrompt = `Review this Python web scraping code. Find bugs, suggest perf/readability improvements, explain. Consider async best practices.`;

console.log(`Long prompt tokens: ${estimateTokens(longPrompt)}`); // Giả sử 50-70 tokens

console.log(`Short prompt tokens: ${estimateTokens(shortPrompt)}`); // Giả sử 20-30 tokens

function estimateTokens(text) {

// Đây chỉ là một hàm ước lượng đơn giản, không phải tokenization thực tế

// Các thư viện như 'tiktoken' sẽ cung cấp kết quả chính xác hơn

return text.split(/\s+/).length + Math.floor(text.length / 4);

}Việc rút gọn prompt có thể giảm số lượng token đầu vào từ 30% đến 50% mà vẫn giữ nguyên chất lượng phản hồi, đặc biệt là khi bạn đã quen thuộc với khả năng hiểu của mô hình.

2. Sử Dụng Các Kỹ Thuật Tạo Prompt Nâng Cao

Kỹ thuật tạo prompt nâng cao giúp AI hiểu rõ hơn ý định của bạn mà không cần quá nhiều từ ngữ. Một số kỹ thuật phổ biến bao gồm:

- Few-shot prompting: Cung cấp một vài ví dụ đầu vào/đầu ra mong muốn để AI học theo pattern. Thay vì mô tả chi tiết yêu cầu, bạn chỉ cần đưa 2-3 cặp ví dụ. Điều này giúp AI nắm bắt ngữ cảnh nhanh hơn và giảm số lượng instruction tokens.

- Chain-of-Thought (CoT) prompting: Yêu cầu AI đưa ra lập luận từng bước trước khi đưa ra câu trả lời cuối cùng. Mặc dù CoT có thể tăng số token đầu ra, nó lại giúp AI đưa ra câu trả lời chính xác hơn, giảm thiểu việc phải gửi lại prompt nhiều lần hoặc cung cấp thêm ngữ cảnh ở các lượt sau, từ đó tối ưu tổng số token cho một tác vụ hoàn chỉnh.

- Sử dụng placeholders: Thay vì nhúng trực tiếp dữ liệu lớn vào prompt, hãy sử dụng các placeholders và thay thế chúng sau. Ví dụ: "Summarize the article:

{{ARTICLE_TEXT}}". Điều này giúp bạn quản lý cấu trúc prompt dễ dàng hơn và chỉ chèn dữ liệu cần thiết.

3. Tóm Tắt (Summarization) và Rút Trích Thông Tin (Information Extraction)

Tóm tắt là việc giảm độ dài của văn bản gốc trong khi vẫn giữ lại các ý chính. Khi bạn có một lượng lớn dữ liệu cần xử lý (ví dụ: một bài báo dài, một cuộc hội thoại), thay vì đưa toàn bộ văn bản đó vào prompt, hãy sử dụng một mô hình AI nhỏ hơn hoặc một thuật toán tóm tắt để rút gọn thông tin trước. Chỉ những thông tin đã được tóm tắt hoặc các điểm mấu chốt được rút trích mới được gửi tới mô hình LLM chính.

Ví dụ, nếu bạn cần phân tích sentiment của một cuộc trò chuyện dài 2000 từ, bạn có thể tóm tắt nó thành 200 từ trước khi gửi cho LLM. Điều này có thể giảm 90% số token đầu vào. Các thư viện như transformers của Hugging Face cung cấp các mô hình tóm tắt sẵn có.

import transformers

# Ví dụ tóm tắt văn bản trước khi gửi đến LLM chính

# Sử dụng một mô hình tóm tắt nhỏ hơn, chuyên dụng

summarizer_pipeline = transformers.pipeline("summarization", model="sshleifer/distilbart-cnn-12-6")

long_text = """

The latest report from the Intergovernmental Panel on Climate Change (IPCC) paints a stark picture of our planet's future.

Global temperatures are rising at an unprecedented rate, leading to more frequent and intense extreme weather events.

Scientists warn that without immediate and drastic action, the world could face irreversible damage.

The report emphasizes the need for a rapid transition away from fossil fuels, investment in renewable energy,

and widespread adoption of sustainable practices across all sectors.

Many nations have pledged to reduce carbon emissions, but the pace of change needs to accelerate significantly

to meet the goals set in the Paris Agreement.

The economic impact of climate change is also highlighted, with potential losses in agriculture,

coastal infrastructure, and public health.

International cooperation is crucial for a global response to this existential threat.

"""

# Tóm tắt văn bản

summary = summarizer_pipeline(long_text, max_length=50, min_length=25, do_sample=False)

print(f"Original text tokens (approx): {estimateTokens(long_text)}")

print(f"Summarized text tokens (approx): {estimateTokens(summary[0]['summary_text'])}")

print(f"Summary: {summary[0]['summary_text']}")

# Sau đó, gửi summary[0]['summary_text'] đến LLM chính để phân tích hoặc trả lời câu hỏi.

Kỹ thuật này đặc biệt hữu ích cho các ứng dụng xử lý tài liệu dài, email, hoặc transcripts cuộc họp.

4. Fine-tuning Mô Hình Nhỏ Hơn (Fine-tuning Smaller Models)

Fine-tuning mô hình nhỏ hơn là quá trình huấn luyện lại một mô hình ngôn ngữ nhỏ hơn trên tập dữ liệu chuyên biệt của bạn. Thay vì luôn dựa vào các LLMs khổng lồ như GPT-4 cho mọi tác vụ, bạn có thể huấn luyện một mô hình nhỏ hơn (ví dụ: GPT-3.5, Llama 2 7B) để thực hiện các tác vụ cụ thể mà bạn cần. Mô hình nhỏ hơn sau khi fine-tuned thường có thể đạt được hiệu suất tương đương hoặc thậm chí tốt hơn cho các tác vụ chuyên biệt, với chi phí token thấp hơn đáng kể (do bạn có thể chạy mô hình này trên hạ tầng của mình hoặc sử dụng các API rẻ hơn).

Mặc dù việc fine-tuning đòi hỏi đầu tư ban đầu về thời gian và tài nguyên, nó có thể giảm chi phí vận hành lâu dài lên đến 70-85% cho các tác vụ lặp đi lặp lại. Đây là một chiến lược tối ưu token AI dài hạn cho các ứng dụng quy mô lớn.

5. Quản Lý Lịch Sử Cuộc Trò Chuyện (Conversation History Management)

Trong các ứng dụng chatbot hoặc trợ lý ảo, lịch sử cuộc trò chuyện có thể nhanh chóng làm tăng số lượng token đầu vào. Mỗi lượt tương tác, toàn bộ hoặc một phần lịch sử cuộc trò chuyện thường được gửi lại cho mô hình để duy trì ngữ cảnh. Để tối ưu token AI, bạn cần có chiến lược quản lý lịch sử cuộc trò chuyện thông minh:

- Rút gọn lịch sử: Thay vì gửi toàn bộ lịch sử, chỉ gửi những đoạn hội thoại gần nhất hoặc những đoạn chứa thông tin quan trọng.

- Tóm tắt lịch sử: Sử dụng AI để tóm tắt các đoạn hội thoại cũ thành một bản tóm tắt ngắn gọn và chỉ gửi bản tóm tắt đó.

- Sử dụng bộ nhớ ngoài: Lưu trữ các thông tin quan trọng đã được AI rút trích vào một cơ sở dữ liệu (vector database) và chỉ truy vấn khi cần thiết, thay vì nhồi nhét vào prompt.

Ví dụ về cách quản lý lịch sử:

// Lịch sử cuộc trò chuyện (giả định)

let conversationHistory = [

{ role: "user", content: "Tôi muốn đặt một chuyến bay đến Paris." },

{ role: "assistant", content: "Bạn muốn bay từ đâu và vào ngày nào?" },

{ role: "user", content: "Từ Hà Nội, vào ngày 15 tháng 8." },

{ role: "assistant", content: "Chuyến bay một chiều hay khứ hồi?" },

{ role: "user", content: "Khứ hồi, về vào ngày 22 tháng 8." }

];

// Kỹ thuật 1: Chỉ giữ N tin nhắn gần nhất

const MAX_MESSAGES = 3;

const recentHistory = conversationHistory.slice(-MAX_MESSAGES);

// Kỹ thuật 2: Tóm tắt lịch sử cũ

// Giả sử có một hàm summarizeHistory() dùng LLM hoặc thuật toán khác

function summarizeHistory(history) {

if (history.length > MAX_MESSAGES) {

const oldHistory = history.slice(0, history.length - MAX_MESSAGES);

// Gửi oldHistory đến một mô hình tóm tắt để lấy bản tóm tắt ngắn gọn

// Ví dụ: "Người dùng muốn đặt vé khứ hồi Hà Nội - Paris, đi 15/8 về 22/8."

return [{ role: "system", content: "Tóm tắt: " + "..." }];

}

return [];

}

const summarizedOldHistory = summarizeHistory(conversationHistory);

const finalPromptMessages = [...summarizedOldHistory, ...recentHistory];

// Gửi finalPromptMessages đến LLM

Các phương pháp này có thể giảm lượng token gửi đi trong mỗi lượt tương tác từ 50% đến 80% trong các cuộc hội thoại dài.

6. Sử Dụng Embeddings và Vector Databases

Embeddings là các biểu diễn số học (vector) của văn bản, cho phép máy tính hiểu được ngữ nghĩa của từ và câu. Vector databases là các cơ sở dữ liệu được thiết kế để lưu trữ và truy vấn các vector embeddings một cách hiệu quả. Thay vì gửi toàn bộ tài liệu tham khảo vào prompt, bạn có thể chuyển đổi các tài liệu đó thành embeddings, lưu trữ chúng trong một vector database. Khi người dùng đặt câu hỏi, bạn chuyển đổi câu hỏi đó thành embedding, sau đó truy vấn vector database để tìm các đoạn văn bản có ngữ nghĩa tương đồng nhất với câu hỏi. Chỉ những đoạn văn bản liên quan nhất này (thường chỉ vài trăm token) mới được đưa vào prompt làm ngữ cảnh.

Cách tiếp cận này, thường được gọi là Retrieval-Augmented Generation (RAG), giúp tối ưu token AI bằng cách chỉ cung cấp thông tin thực sự cần thiết, giảm đáng kể độ dài của prompt. Một nghiên cứu cho thấy RAG có thể giảm số lượng token đầu vào lên đến 95% so với việc nhồi nhét toàn bộ tài liệu vào prompt.

Các Lưu Ý Quan Trọng

- Hiểu rõ mô hình của bạn: Mỗi mô hình AI có một "context window" (giới hạn token) khác nhau. Nắm rõ giới hạn này để không vượt quá, tránh lỗi hoặc bị cắt bớt thông tin.

- Kiểm tra và đo lường: Luôn đo lường số lượng token trước và sau khi áp dụng các kỹ thuật tối ưu. Sử dụng các công cụ token counter (ví dụ:

tiktokencho OpenAI) để có số liệu chính xác. - Cân bằng giữa hiệu quả và chất lượng: Việc giảm token quá mức có thể làm giảm chất lượng phản hồi của AI. Luôn kiểm tra xem AI có còn hiểu đúng ngữ cảnh và đưa ra câu trả lời chính xác sau khi tối ưu hay không. Mục tiêu là tối ưu token AI mà không ảnh hưởng tiêu cực đến kết quả.

- Sử dụng API chat completion thay vì text completion: Các API chat completion (ví dụ:

/v1/chat/completionscủa OpenAI) thường hiệu quả hơn cho các cuộc hội thoại và cho phép bạn định nghĩa rõ ràng các vai trò (system, user, assistant), giúp AI hiểu ngữ cảnh tốt hơn với ít token hơn. - Cập nhật liên tục: Các mô hình AI và API luôn được cập nhật. Hãy theo dõi các tính năng mới, chẳng hạn như khả năng gọi hàm (function calling) hoặc các mô hình context window lớn hơn, để tận dụng tối đa.

- Tận dụng system prompt: Sử dụng system prompt để thiết lập vai trò, tone giọng và các quy tắc chung cho AI. Điều này giúp AI hoạt động nhất quán mà không cần lặp lại các hướng dẫn đó trong mỗi user prompt, tiết kiệm token đáng kể về lâu dài.

- Sử dụng JSON/YAML cho cấu trúc dữ liệu: Khi cần truyền dữ liệu có cấu trúc, sử dụng JSON hoặc YAML thay vì văn bản tự do. Các định dạng này giúp AI dễ dàng phân tích và hiểu, thường yêu cầu ít token hơn để biểu diễn cùng một lượng thông tin so với văn bản không có cấu trúc.

Câu Hỏi Thường Gặp

Làm thế nào để biết chính xác số lượng token của một đoạn văn bản?

Có, bạn có thể biết chính xác số lượng token. Các nhà cung cấp LLMs thường cung cấp các thư viện tokenization riêng. Ví dụ, với OpenAI, bạn có thể sử dụng thư viện tiktoken trong Python. Với các mô hình khác, bạn có thể tìm kiếm thư viện tokenization tương ứng hoặc sử dụng các công cụ online token counter. Việc này rất quan trọng để tối ưu token AI một cách khoa học.

import tiktoken

def num_tokens_from_string(string: str, encoding_name: str) -> int:

"""Returns the number of tokens in a text string."""

encoding = tiktoken.get_encoding(encoding_name)

num_tokens = len(encoding.encode(string))

return num_tokens

text_to_check = "Đây là một ví dụ về văn bản cần kiểm tra số lượng token."

print(f"Số token (gpt-4): {num_tokens_from_string(text_to_check, "cl100k_base")}")

print(f"Số token (gpt-3.5-turbo): {num_tokens_from_string(text_to_check, "cl100k_base")}")

Việc giảm token có ảnh hưởng đến chất lượng phản hồi của AI không?

Có, việc giảm token có thể ảnh hưởng đến chất lượng phản hồi nếu không được thực hiện cẩn thận. Nếu bạn rút gọn prompt quá mức hoặc loại bỏ thông tin quan trọng, AI có thể không có đủ ngữ cảnh để đưa ra câu trả lời chính xác hoặc đầy đủ. Mục tiêu là tìm sự cân bằng giữa việc tối ưu token AI và duy trì chất lượng phản hồi mong muốn. Luôn kiểm tra kỹ lưỡng sau khi áp dụng các kỹ thuật giảm token.

Kỹ thuật nào mang lại hiệu quả giảm token cao nhất?

Không có một kỹ thuật nào là "hiệu quả nhất" cho mọi trường hợp, nhưng việc kết hợp Tóm tắt/Rút trích thông tin và Sử dụng Embeddings/Vector Databases (RAG) thường mang lại hiệu quả giảm token cao nhất cho các ứng dụng xử lý lượng lớn dữ liệu. Rút gọn prompt và quản lý lịch sử cuộc trò chuyện cũng rất hiệu quả cho các ứng dụng chatbot. Sự lựa chọn phụ thuộc vào loại ứng dụng và dữ liệu bạn đang xử lý.

Có công cụ nào hỗ trợ tối ưu token không?

Có, nhiều công cụ và thư viện hỗ trợ tối ưu token. Ngoài tiktoken đã đề cập, các thư viện xử lý ngôn ngữ tự nhiên như Hugging Face transformers cung cấp các mô hình tóm tắt hoặc rút trích thông tin. Ngoài ra, một số nền tảng phát triển AI còn tích hợp sẵn các công cụ theo dõi và ước tính token sử dụng. Việc sử dụng các công cụ này là chìa khóa để thực hiện tối ưu token AI một cách hiệu quả.

Khi nào nên fine-tune một mô hình thay vì chỉ dùng prompt engineering?

Bạn nên xem xét fine-tune một mô hình khi bạn có một tập dữ liệu lớn, chất lượng cao và muốn mô hình thực hiện một tác vụ rất cụ thể, lặp đi lặp lại với độ chính xác cao mà prompt engineering không thể đạt được hoặc quá tốn kém về token. Fine-tuning cũng là lựa chọn tốt khi bạn cần kiểm soát nhiều hơn về hành vi của mô hình, giảm độ trễ và đặc biệt là tối ưu chi phí cho các tác vụ quy mô lớn, giúp tối ưu token AI về lâu dài.

Kết Luận

Tối ưu token AI không chỉ là một kỹ thuật để tiết kiệm chi phí mà còn là một chiến lược quan trọng để tăng tốc độ phát triển và cải thiện hiệu suất của các ứng dụng AI. Bằng cách áp dụng các mẹo như rút gọn prompt, sử dụng kỹ thuật tạo prompt nâng cao, tóm tắt thông tin, quản lý lịch sử cuộc trò chuyện, và tận dụng embeddings cùng vector databases, bạn có thể giảm đáng kể số lượng token tiêu thụ mà vẫn đảm bảo chất lượng phản hồi.

Việc liên tục đo lường, kiểm tra và thử nghiệm các chiến lược khác nhau sẽ giúp bạn tìm ra phương pháp tối ưu nhất cho từng trường hợp sử dụng cụ thể. Với sự phát triển nhanh chóng của AI, việc làm chủ các kỹ thuật tối ưu token sẽ là một lợi thế cạnh tranh lớn cho mọi nhà phát triển và doanh nghiệp. Hãy bắt đầu áp dụng những kiến thức này vào các dự án của bạn ngay hôm nay để trải nghiệm hiệu quả mà vibe coding mang lại trong việc tối ưu tài nguyên AI.