Giới Thiệu AI Agent Tối Ưu Hóa Game Logic: Từ Ý Tưởng Đến Code Thực Chiến Cùng Vibe Coding

Trong thế giới game phát triển không ngừng, việc tạo ra những trải nghiệm độc đáo và cuốn hút là chìa khóa để giữ chân người chơi. Một trong những yếu tố cốt lõi quyết định chất lượng của một tựa game chính là game logic – cách mà các quy tắc, hành vi của nhân vật, và cơ chế tương tác được thiết kế. Và đó chính là lúc trí tuệ nhân tạo (AI) bước vào cuộc chơi, không chỉ để tạo ra các đối thủ thông minh mà còn để tối ưu hóa, tinh chỉnh và thậm chí tự động hóa việc phát triển game logic phức tạp. Bài viết về AI game logic này sẽ giúp bạn hiểu rõ về cách xây dựng các AI agent mạnh mẽ, có khả năng học hỏi và thích nghi, từ những ý tưởng ban đầu cho đến những dòng code thực chiến, tất cả đều được Vibe Coding chia sẻ một cách chi tiết và dễ hiểu nhất.

AI Game Logic: Hơn Cả Đối Thủ Máy

Khi nhắc đến AI trong game, nhiều người thường nghĩ ngay đến các NPC (Non-Player Character) hoặc boss có hành vi thông minh. Tuy nhiên, AI game logic còn bao hàm một phạm vi rộng lớn hơn rất nhiều. Nó không chỉ là việc tạo ra một đối thủ biết tấn công, phòng thủ mà còn là cách AI có thể tự động điều chỉnh độ khó của game, tạo ra các nhiệm vụ ngẫu nhiên, quản lý tài nguyên trong game, hay thậm chí là thiết kế cấp độ dựa trên phản hồi của người chơi. Mục tiêu cuối cùng là tạo ra một hệ thống logic game linh hoạt, tự động, và mang lại trải nghiệm cá nhân hóa tối đa cho từng game thủ.

Việc tích hợp AI vào game logic giúp các nhà phát triển giải quyết nhiều thách thức. Thay vì phải viết hàng ngàn dòng code điều kiện if-else phức tạp để xử lý mọi tình huống có thể xảy ra, chúng ta có thể huấn luyện AI để nó tự học cách phản ứng một cách tối ưu. Điều này không chỉ tiết kiệm thời gian phát triển mà còn mở ra cánh cửa cho những game play chưa từng có, nơi mà game có thể "hiểu" và "thích nghi" với phong cách chơi của từng người.

Một ví dụ điển hình là việc sử dụng thuật toán học tăng cường (Reinforcement Learning - RL) để huấn luyện các AI agent. Thay vì lập trình rõ ràng mọi nước đi có thể, chúng ta chỉ cần định nghĩa mục tiêu (ví dụ: chiến thắng trận đấu, thu thập điểm cao) và các phần thưởng/hình phạt tương ứng. AI agent sẽ tự khám phá môi trường game, thử nghiệm các hành động khác nhau và học cách tối đa hóa phần thưởng của mình. Đây là một cách tiếp cận cực kỳ mạnh mẽ để tạo ra AI game logic phức tạp mà không cần can thiệp quá sâu vào từng chi tiết hành vi.

Bên cạnh RL, các kỹ thuật AI khác như Machine Learning truyền thống (phân loại, hồi quy), hệ thống dựa trên luật (Rule-based Systems), hoặc thuật toán tìm kiếm (Pathfinding, Minimax) cũng đóng vai trò quan trọng trong việc xây dựng game logic. Sự kết hợp linh hoạt giữa các phương pháp này cho phép chúng ta tạo ra các agent không chỉ thông minh mà còn có khả năng giải thích hành vi của mình, điều này rất quan trọng trong quá trình debug và tinh chỉnh game.

Xây Dựng AI Agent Tối Ưu Hóa Game Logic: Từ Lý Thuyết Đến Code Thực Chiến

Để minh họa việc xây dựng một AI agent cho game logic, chúng ta sẽ xem xét một ví dụ đơn giản: một AI agent điều khiển một nhân vật trong game platformer để thu thập tất cả vật phẩm trên màn hình một cách hiệu quả nhất. Đây là một bài toán tối ưu hóa đường đi điển hình, nơi AI cần tìm ra chuỗi hành động (đi, nhảy) tối ưu. Chúng ta sẽ sử dụng một thuật toán tìm kiếm đơn giản như A* hoặc một mô hình RL cơ bản.

Bước 1: Định Nghĩa Môi Trường Game và Trạng Thái

Đầu tiên, chúng ta cần định nghĩa môi trường game mà AI agent sẽ tương tác. Điều này bao gồm bản đồ, vị trí của nhân vật, vị trí của các vật phẩm, các chướng ngại vật. Trạng thái (state) của môi trường là thông tin mà AI agent có thể quan sát được tại một thời điểm nhất định để đưa ra quyết định. Ví dụ, state có thể bao gồm:

- Vị trí

(x, y)hiện tại của nhân vật. - Danh sách các vật phẩm còn lại cần thu thập.

- Thông tin về các nền tảng, tường, chướng ngại vật xung quanh nhân vật.

Hành động (action) mà AI agent có thể thực hiện có thể là: DiChuyenTrai, DiChuyenPhai, Nhay, DungYen.

Bước 2: Chọn Thuật Toán AI Phù Hợp

Đối với bài toán thu thập vật phẩm, chúng ta có thể bắt đầu với thuật toán tìm kiếm như Breadth-First Search (BFS) hoặc A* nếu môi trường có thể biểu diễn dưới dạng đồ thị. Tuy nhiên, để thể hiện khả năng học hỏi của AI, chúng ta sẽ sử dụng một cách tiếp cận RL đơn giản: Q-learning.

Q-learning là một thuật toán học tăng cường không cần mô hình (model-free) cho phép agent học một chính sách tối ưu về hành động nào cần thực hiện trong trạng thái nào để tối đa hóa tổng phần thưởng.

Bước 3: Triển Khai Q-learning Agent

Chúng ta sẽ cần một bảng Q-table để lưu trữ giá trị Q (expected future reward) cho mỗi cặp (state, action). Vì không gian trạng thái có thể lớn, chúng ta có thể cần mã hóa trạng thái một cách hiệu quả hoặc sử dụng mạng nơ-ron nếu không gian trạng thái quá lớn để lưu trữ toàn bộ Q-table.

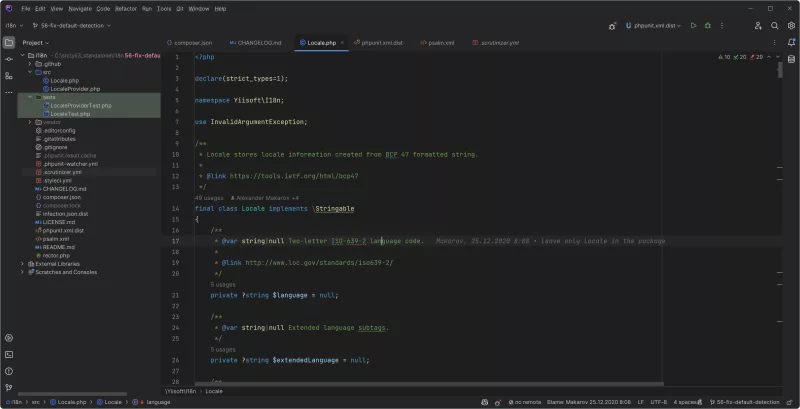

Dưới đây là một ví dụ đơn giản về cấu trúc của một Q-learning agent bằng Python:

import numpy as np

class QLearningAgent:

def __init__(self, actions, learning_rate=0.1, discount_factor=0.9, epsilon=0.1):

self.actions = actions

self.lr = learning_rate # Tốc độ học

self.gamma = discount_factor # Hệ số chiết khấu

self.epsilon = epsilon # Tham số khám phá (exploration rate)

self.q_table = {} # Bảng Q-table: key là state, value là dictionary {action: Q_value}

def _get_q_values(self, state):

# Chuyển state thành dạng hashable (ví dụ: tuple)

state_key = tuple(state)

if state_key not in self.q_table:

self.q_table[state_key] = {action: 0.0 for action in self.actions}

return self.q_table[state_key]

def choose_action(self, state):

# Chiến lược epsilon-greedy: khám phá hoặc khai thác

if np.random.uniform(0, 1) < self.epsilon:

return np.random.choice(self.actions) # Khám phá: chọn hành động ngẫu nhiên

else:

q_values = self._get_q_values(state)

# Khai thác: chọn hành động có Q-value cao nhất

max_q = max(q_values.values())

# Xử lý trường hợp có nhiều hành động cùng Q-value cao nhất

best_actions = [action for action, q_val in q_values.items() if q_val == max_q]

return np.random.choice(best_actions)

def learn(self, state, action, reward, next_state):

state_key = tuple(state)

next_state_key = tuple(next_state)

q_values = self._get_q_values(state)

next_q_values = self._get_q_values(next_state)

# Công thức cập nhật Q-value

old_q_value = q_values[action]

max_next_q = max(next_q_values.values()) if next_q_values else 0.0

new_q_value = old_q_value + self.lr <em> (reward + self.gamma </em> max_next_q - old_q_value)

self.q_table[state_key][action] = new_q_value

Bước 4: Định Nghĩa Phần Thưởng và Hình Phạt

Để AI agent có thể học, chúng ta cần cung cấp phản hồi dưới dạng phần thưởng (reward) và hình phạt (penalty).

- Phần thưởng lớn khi thu thập một vật phẩm (ví dụ: +10).

- Phần thưởng nhỏ khi đạt được mục tiêu cuối cùng (ví dụ: +100 khi thu thập hết vật phẩm).

- Hình phạt nhỏ cho mỗi bước đi (ví dụ: -1) để khuyến khích AI tìm đường ngắn nhất.

- Hình phạt lớn khi gặp chướng ngại vật hoặc rơi khỏi bản đồ (ví dụ: -50).

Bước 5: Vòng Lặp Huấn Luyện (Training Loop)

Quá trình huấn luyện diễn ra qua nhiều "episode" (vòng chơi). Trong mỗi episode, agent sẽ tương tác với môi trường, thực hiện hành động, nhận phần thưởng và cập nhật Q-table của mình. Khi agent học, giá trị epsilon thường được giảm dần để agent chuyển từ khám phá sang khai thác.

# Giả sử chúng ta có một môi trường game đơn giản (my_game_env)

# my_game_env.reset() trả về trạng thái ban đầu

# my_game_env.step(action) trả về (next_state, reward, done)

# Định nghĩa các hành động

actions = ['DiChuyenTrai', 'DiChuyenPhai', 'Nhay', 'DungYen']

agent = QLearningAgent(actions, learning_rate=0.1, discount_factor=0.9, epsilon=1.0) # Bắt đầu với epsilon cao

num_episodes = 1000

epsilon_decay_rate = 0.001

min_epsilon = 0.01

for episode in range(num_episodes):

current_state = my_game_env.reset()

done = False

total_reward = 0

while not done:

action = agent.choose_action(current_state)

next_state, reward, done = my_game_env.step(action)

agent.learn(current_state, action, reward, next_state)

current_state = next_state

total_reward += reward

# Giảm epsilon sau mỗi episode để giảm khám phá

agent.epsilon = max(min_epsilon, agent.epsilon - epsilon_decay_rate)

if episode % 100 == 0:

print(f"Episode {episode}: Total Reward = {total_reward}, Epsilon = {agent.epsilon:.2f}")

# Sau khi huấn luyện, agent có thể được sử dụng để chơi game

# bằng cách chỉ chọn hành động tốt nhất (epsilon = 0)

Bước 6: Tích Hợp Vào Game Engine

Sau khi agent được huấn luyện, chúng ta có thể tích hợp nó vào game engine (Unity, Unreal Engine, Godot, Pygame, v.v.). Các hành động mà agent đưa ra sẽ được dịch thành các lệnh điều khiển nhân vật trong game. Ví dụ, nếu agent chọn DiChuyenPhai, game engine sẽ di chuyển nhân vật sang phải.

Việc triển khai một môi trường game đơn giản (my_game_env) là một phần quan trọng. Nó cần mô phỏng đủ các yếu tố của game để AI có thể học. Đây là nơi mà AI game logic trở nên sống động, khi các quyết định của AI trực tiếp ảnh hưởng đến diễn biến trong game.

Tips và Best Practices Khi Phát Triển AI Game Logic

- Bắt Đầu Đơn Giản: Đừng cố gắng giải quyết một bài toán quá phức tạp ngay từ đầu. Bắt đầu với một môi trường game nhỏ, ít trạng thái và hành động. Dần dần mở rộng độ phức tạp khi AI agent của bạn đã học được cách hoạt động cơ bản.

- Định Nghĩa Phần Thưởng Rõ Ràng: Hệ thống phần thưởng là linh hồn của các thuật toán học tăng cường. Hãy dành thời gian để thiết kế nó một cách cẩn thận. Phần thưởng nên khuyến khích các hành vi mong muốn và phạt các hành vi không mong muốn. Tránh các phần thưởng quá thưa thớt (sparse rewards) hoặc quá dày đặc (dense rewards) không cần thiết.

- Sử Dụng Trạng Thái Hiệu Quả: Không gian trạng thái có thể bùng nổ nếu bạn đưa vào quá nhiều thông tin không cần thiết. Hãy chọn lọc những thông tin quan trọng nhất mà AI cần để đưa ra quyết định. Đôi khi, việc mã hóa trạng thái (state representation) một cách thông minh có thể giảm đáng kể độ phức tạp.

- Kết Hợp Các Kỹ Thuật AI: Không phải lúc nào một thuật toán AI cũng là câu trả lời cho mọi vấn đề. Hãy xem xét việc kết hợp các kỹ thuật khác nhau. Ví dụ, sử dụng thuật toán tìm đường (pathfinding) truyền thống để di chuyển và dùng RL để ra quyết định chiến thuật cao cấp hơn.

- Visual hóa Quá Trình Học: Việc theo dõi hiệu suất của AI agent trong quá trình huấn luyện là cực kỳ quan trọng. Visual hóa các thông số như tổng phần thưởng theo từng episode, giá trị Q-value, hoặc thậm chí là hành vi của agent trong game sẽ giúp bạn hiểu rõ hơn về cách nó đang học và debug các vấn đề tiềm ẩn.

- Tối Ưu Hóa Tham Số (Hyperparameter Tuning): Các tham số như

learning_rate,discount_factor, vàepsiloncó ảnh hưởng lớn đến quá trình học của AI. Hãy thử nghiệm với các giá trị khác nhau để tìm ra bộ tham số tối ưu cho bài toán của bạn. - Xử Lý Các Trường Hợp Cạnh (Edge Cases): Game logic thường có rất nhiều trường hợp cạnh không lường trước được. Hãy đảm bảo AI của bạn có thể xử lý các tình huống này một cách hợp lý, ngay cả khi nó chưa từng gặp phải trong quá trình huấn luyện.

So Sánh Các Phương Pháp Xây Dựng AI Game Logic

Có nhiều cách tiếp cận để xây dựng AI game logic, mỗi phương pháp có ưu và nhược điểm riêng:

- Rule-Based AI (AI Dựa Trên Luật):

- Ưu điểm: Dễ triển khai cho các hành vi đơn giản, dễ debug, hành vi có thể dự đoán được.

- Nhược điểm: Rất khó mở rộng cho các game phức tạp, không linh hoạt, không học hỏi được. Mất nhiều thời gian để viết và duy trì hàng ngàn luật

if-else. - Khi nào sử dụng: NPC đơn giản, tutorial, các cơ chế game cố định không cần sự thích nghi.

- State Machine AI (AI Máy Trạng Thái):

- Ưu điểm: Cấu trúc rõ ràng, dễ quản lý các hành vi phức tạp hơn Rule-Based, có thể chuyển đổi giữa các trạng thái khác nhau (ví dụ: "Tấn công", "Phòng thủ", "Tìm đường").

- Nhược điểm: Vẫn cần lập trình viên định nghĩa các trạng thái và chuyển đổi, khó xử lý các tình huống không lường trước.

- Khi nào sử dụng: Hầu hết các NPC trong game hiện đại, hành vi của boss, quản lý các phase trong trận đấu.

- Behavior Tree AI (AI Cây Hành Vi):

- Ưu điểm: Cấu trúc module, dễ mở rộng, cho phép tạo ra các hành vi phức tạp bằng cách kết hợp các node đơn giản, dễ debug hơn State Machine.

- Nhược điểm: Có thể trở nên phức tạp nếu cây quá lớn, yêu cầu thiết kế cẩn thận.

- Khi nào sử dụng: Hành vi NPC phức tạp, AI của đồng đội hoặc kẻ thù trong các game thế giới mở.

- Machine Learning (Học Máy) và Reinforcement Learning (Học Tăng Cường):

- Ưu điểm: Có khả năng học hỏi và thích nghi với môi trường, tạo ra các hành vi không dự đoán được, có thể tối ưu hóa các bài toán phức tạp, giảm công sức lập trình thủ công.

- Nhược điểm: Yêu cầu dữ liệu huấn luyện (ML) hoặc môi trường mô phỏng tốt (RL), quá trình huấn luyện có thể tốn thời gian và tài nguyên, khó giải thích hành vi của AI (black box), khó debug khi AI hành động "khác thường".

- Khi nào sử dụng: Tối ưu hóa game logic, điều chỉnh độ khó động, tạo ra các đối thủ cực kỳ thông minh, mô phỏng người chơi, tạo nội dung game tự động.

Lựa chọn phương pháp phù hợp thường phụ thuộc vào độ phức tạp của game, tài nguyên có sẵn và mục tiêu cụ thể của AI. Trong nhiều trường hợp, sự kết hợp của các phương pháp này (ví dụ: Behavior Tree để quản lý hành vi cấp cao, RL để tối ưu hóa hành vi cấp thấp) mang lại hiệu quả tốt nhất.

Các Lưu Ý Quan Trọng

- Hiệu suất (Performance): AI agent, đặc biệt là các mô hình ML/RL phức tạp, có thể tiêu tốn nhiều tài nguyên CPU và GPU. Cần tối ưu hóa code và mô hình để đảm bảo game vẫn chạy mượt mà. Xem xét việc chạy các tính toán AI trên luồng riêng (separate thread) hoặc sử dụng các kỹ thuật tối ưu hóa như quantization cho các mô hình neural network.

- Tính công bằng (Fairness) và Độ khó (Difficulty): AI không nên quá mạnh đến mức người chơi không có cơ hội chiến thắng, cũng không nên quá yếu khiến game trở nên nhàm chán. AI game logic cần được cân bằng cẩn thận để mang lại trải nghiệm thử thách nhưng công bằng. Dynamic Difficulty Adjustment (DDA) là một lĩnh vực mà AI có thể giúp tự động điều chỉnh độ khó dựa trên hiệu suất của người chơi.

- Khả năng giải thích (Interpretability): Đặc biệt với các mô hình học sâu, việc hiểu tại sao AI lại đưa ra một quyết định cụ thể có thể rất khó. Điều này gây khó khăn trong việc debug và tinh chỉnh. Cố gắng thiết kế AI sao cho bạn có thể theo dõi và hiểu được logic đằng sau các quyết định của nó.

- Tính ngẫu nhiên (Randomness): Một chút ngẫu nhiên có thể làm cho AI trở nên "sống động" và ít dự đoán được hơn, tránh cảm giác "robot". Tuy nhiên, đừng lạm dụng ngẫu nhiên, vì nó có thể khiến AI trở nên kém hiệu quả hoặc khó hiểu.

- Quản lý dữ liệu (Data Management): Nếu bạn sử dụng các phương pháp học máy, việc thu thập, lưu trữ và quản lý dữ liệu huấn luyện là rất quan trọng. Dữ liệu chất lượng cao sẽ dẫn đến AI chất lượng cao.

- Vòng lặp phản hồi (Feedback Loop): Tích hợp một hệ thống thu thập phản hồi từ người chơi (ví dụ: thông qua telemetry) để liên tục cải thiện và tinh chỉnh AI game logic của bạn.

- Bảo mật (Security): Trong các game multiplayer, AI agent cần được bảo vệ khỏi các hành vi gian lận hoặc khai thác lỗ hổng. Đảm bảo rằng AI không thể truy cập các thông tin không công bằng hoặc thực hiện các hành động không hợp lệ.

Câu Hỏi Thường Gặp

AI game logic có thể giúp tôi tạo ra game thế giới mở như thế nào?

AI game logic đóng vai trò quan trọng trong việc tạo ra các game thế giới mở bằng cách quản lý hành vi của NPC, tạo nhiệm vụ ngẫu nhiên (procedural quest generation), điều khiển hệ sinh thái động vật và thực vật, và thậm chí là tạo ra các sự kiện bất ngờ. Nó giúp thế giới game trở nên sống động, phản ứng và luôn thay đổi, mang lại trải nghiệm độc đáo cho mỗi người chơi mà không cần lập trình thủ công từng chi tiết.

Làm thế nào để debug một AI agent khi nó hoạt động không như mong đợi?

Debug AI agent, đặc biệt là với RL, có thể khó khăn. Các bước hiệu quả bao gồm: visual hóa quá trình huấn luyện (đồ thị phần thưởng, lỗi), ghi lại các trạng thái và hành động của agent để phân tích các chuỗi quyết định, kiểm tra kỹ hệ thống phần thưởng và hình phạt, đảm bảo rằng môi trường mô phỏng hoạt động chính xác, và đôi khi là giảm độ phức tạp của bài toán để cô lập vấn đề.

Tôi có cần kiến thức sâu về Machine Learning để bắt đầu xây dựng AI game logic không?

Bạn không nhất thiết phải có kiến thức sâu ngay từ đầu. Có rất nhiều thư viện và frameworks AI (như OpenAI Gym, Stable Baselines 3 cho Python) giúp bạn dễ dàng bắt đầu với các thuật toán RL cơ bản mà không cần phải triển khai từ đầu. Tuy nhiên, việc nắm vững các khái niệm cơ bản về ML và RL sẽ giúp bạn hiểu rõ hơn về cách các thuật toán hoạt động và cách tinh chỉnh chúng hiệu quả.

AI game logic có thể được sử dụng để cân bằng độ khó game tự động không?

Hoàn toàn có. Đây là một ứng dụng mạnh mẽ của AI game logic, được gọi là Dynamic Difficulty Adjustment (DDA). AI có thể theo dõi hiệu suất của người chơi (tỷ lệ thắng/thua, thời gian hoàn thành, số lần chết) và tự động điều chỉnh các thông số của game như số lượng kẻ địch, sức mạnh của kẻ địch, lượng tài nguyên, hoặc thậm chí là hành vi của AI đối thủ để đảm bảo người chơi luôn cảm thấy thử thách nhưng không quá nản lòng.

Kết Luận

Xây dựng AI agent để tối ưu hóa game logic là một lĩnh vực đầy tiềm năng, mở ra vô số cơ hội để tạo ra những tựa game độc đáo và hấp dẫn hơn bao giờ hết. Từ việc thiết kế các đối thủ thông minh đến việc tự động hóa quá trình tạo nội dung và điều chỉnh trải nghiệm người chơi, AI game logic đang định hình lại ngành công nghiệp game.

Qua bài viết này, hy vọng bạn đã có cái nhìn tổng quan về các khái niệm, quy trình và những công cụ cần thiết để bắt đầu hành trình xây dựng AI agent của riêng mình. Hãy nhớ rằng, sự kiên trì, thử nghiệm và khả năng học hỏi từ những thất bại là chìa khóa để thành công trong lĩnh vực này. Tại vibe coding, chúng tôi luôn khuyến khích bạn khám phá và áp dụng những công nghệ tiên tiến nhất để biến ý tưởng thành hiện thực.

Nếu bạn có bất kỳ câu hỏi nào hoặc muốn đào sâu hơn vào một khía cạnh cụ thể của AI game logic, đừng ngần ngại để lại bình luận. Chúng tôi luôn sẵn lòng hỗ trợ bạn trên con đường chinh phục thế giới lập trình và AI!