Giới Thiệu AI Agent Đọc & Tóm Tắt PDF: Tăng Cường Hiệu Suất Nghiên Cứu với Vibe Coding

Trong kỷ nguyên thông tin bùng nổ, việc xử lý và tổng hợp dữ liệu từ các tài liệu PDF khổng lồ đã trở thành một thách thức lớn đối với nhiều nhà nghiên cứu, sinh viên và chuyên gia. Chúng ta thường xuyên phải vật lộn với hàng trăm trang tài liệu, tìm kiếm thông tin quan trọng và cố gắng chắt lọc những ý chính. Đây là lúc công nghệ trí tuệ nhân tạo (AI) phát huy sức mạnh của mình. Bài viết về AI tóm tắt PDF này sẽ giúp bạn hiểu rõ cách xây dựng một AI Agent mạnh mẽ, có khả năng đọc, phân tích và tóm tắt nội dung PDF một cách hiệu quả, từ góc nhìn thực tế của vibe coding.

Chúng ta sẽ cùng nhau khám phá quy trình từ việc trích xuất văn bản, xử lý ngôn ngữ tự nhiên (NLP) cho đến việc tích hợp các mô hình ngôn ngữ lớn (LLM) để tạo ra bản tóm tắt chất lượng cao. Mục tiêu không chỉ là tự động hóa mà còn là nâng cao chất lượng và hiệu suất làm việc, giúp bạn tiết kiệm thời gian quý báu và tập trung vào những khía cạnh sáng tạo hơn trong công việc của mình.

Sức Mạnh của AI Agent trong Xử Lý Tài Liệu PDF

Một AI Agent đọc và tóm tắt PDF không chỉ đơn thuần là một công cụ trích xuất văn bản. Nó là một hệ thống thông minh được thiết kế để hiểu ngữ cảnh, xác định các ý chính và tổng hợp thông tin một cách mạch lạc. Hãy tưởng tượng bạn có một "trợ lý" AI có khả năng đọc và hiểu hàng chục bài báo khoa học trong vài phút, sau đó cung cấp cho bạn một bản tóm tắt súc tích, chỉ ra những điểm nổi bật nhất. Điều này biến việc nghiên cứu từ một quá trình tốn thời gian thành một trải nghiệm nhanh chóng và hiệu quả.

Cốt lõi của một AI Agent như vậy nằm ở sự kết hợp của nhiều công nghệ AI tiên tiến. Đầu tiên là khả năng xử lý các định dạng tài liệu phức tạp như PDF, vốn không phải lúc nào cũng dễ dàng trích xuất văn bản. Sau đó, các kỹ thuật NLP sẽ được áp dụng để phân tích cấu trúc ngôn ngữ, nhận diện chủ đề, và xác định các câu hoặc đoạn văn quan trọng. Cuối cùng, và quan trọng nhất, là sự tham gia của các Large Language Models (LLMs) như GPT-3, GPT-4 hay các mô hình mã nguồn mở như Llama, để thực sự "hiểu" nội dung và tạo ra bản tóm tắt có ý nghĩa.

Việc xây dựng một AI tóm tắt PDF đòi hỏi sự hiểu biết về các thư viện Python như PyPDF2, pdfplumber hoặc fitz (PyMuPDF) để trích xuất văn bản. Sau khi văn bản được trích xuất, chúng ta cần các thư viện NLP như NLTK, spaCy hoặc Hugging Face Transformers để tiền xử lý và phân tích. Cuối cùng, việc tích hợp với các API của LLM hoặc triển khai các mô hình LLM cục bộ sẽ hoàn thiện khả năng tóm tắt của Agent. Sự kết hợp này mang lại một công cụ mạnh mẽ, không chỉ hữu ích cho cá nhân mà còn có tiềm năng ứng dụng rộng rãi trong các doanh nghiệp, từ phân tích hợp đồng, báo cáo tài chính đến tổng hợp tài liệu pháp lý.

Hơn nữa, một AI Agent tốt còn có khả năng học hỏi và cải thiện theo thời gian. Bằng cách thu thập feedback từ người dùng về chất lượng tóm tắt, chúng ta có thể tinh chỉnh các tham số của mô hình hoặc thậm chí huấn luyện lại mô hình để đạt được kết quả tốt hơn. Đây là một ví dụ điển hình về cách vibe coding có thể biến những ý tưởng phức tạp thành các giải pháp thực tế, mang lại giá trị cao.

Xây Dựng AI Agent Đọc & Tóm Tắt PDF: Hướng Dẫn Thực Hành

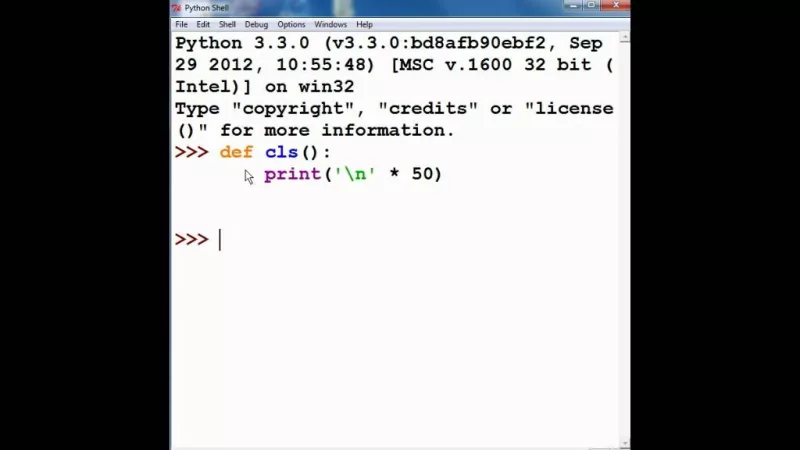

Để xây dựng một AI Agent tóm tắt PDF, chúng ta sẽ đi qua các bước chính sau: trích xuất văn bản, tiền xử lý, và tóm tắt bằng LLM. Phần này sẽ tập trung vào việc cung cấp các đoạn code mẫu và giải thích chi tiết.

Bước 1: Trích Xuất Văn Bản từ PDF

Đầu tiên, chúng ta cần trích xuất văn bản từ file PDF. Có nhiều thư viện Python có thể làm điều này, nhưng PyMuPDF (hay fitz) thường được đánh giá cao về hiệu suất và khả năng xử lý các định dạng PDF phức tạp.

import fitz # PyMuPDF

def extract_text_from_pdf(pdf_path):

"""

Trích xuất toàn bộ văn bản từ một file PDF.

"""

text = ""

try:

doc = fitz.open(pdf_path)

for page_num in range(doc.page_count):

page = doc.load_page(page_num)

text += page.get_text()

doc.close()

except Exception as e:

print(f"Lỗi khi trích xuất văn bản từ PDF: {e}")

return None

return text

# Ví dụ sử dụng:

# pdf_content = extract_text_from_pdf("du_lieu_mau.pdf")

# if pdf_content:

# print(f"Đã trích xuất {len(pdf_content)} ký tự.")

Sử dụng fitz.open(pdf_path) để mở tài liệu PDF và sau đó lặp qua từng trang để lấy văn bản. Điều quan trọng là phải xử lý các trường hợp ngoại lệ (try-except) vì file PDF có thể bị hỏng hoặc có cấu trúc bất thường.

Bước 2: Tiền Xử Lý Văn Bản

Văn bản thô từ PDF thường chứa các ký tự lạ, xuống dòng không mong muốn hoặc khoảng trắng thừa. Chúng ta cần tiền xử lý để làm sạch dữ liệu trước khi đưa vào LLM.

import re

def preprocess_text(text):

"""

Tiền xử lý văn bản: loại bỏ khoảng trắng thừa, ký tự đặc biệt, v.v.

"""

if not text:

return ""

# Loại bỏ nhiều khoảng trắng thành một

text = re.sub(r'\s+', ' ', text)

# Loại bỏ các ký tự không phải chữ, số, dấu câu cơ bản

text = re.sub(r'[^a-zA-Z0-9À-ỹ\s.,;!?-]', '', text) # Thêm hỗ trợ tiếng Việt

# Loại bỏ khoảng trắng ở đầu và cuối

text = text.strip()

return text

# Ví dụ sử dụng:

# raw_text = " Đây là một ví dụ. Với nhiều khoảng trắng và ký tự đặc biệt! @#$ "

# cleaned_text = preprocess_text(raw_text)

# print(f"Văn bản đã làm sạch: {cleaned_text}")

Hàm preprocess_text sử dụng biểu thức chính quy (re) để chuẩn hóa văn bản. Các bước này bao gồm loại bỏ nhiều khoảng trắng, các ký tự không cần thiết và cắt bỏ khoảng trắng ở đầu/cuối.

Bước 3: Tóm Tắt Văn Bản bằng Large Language Model (LLM)

Đây là bước quan trọng nhất. Chúng ta sẽ sử dụng một LLM để tóm tắt nội dung. Với mục đích minh họa, chúng ta sẽ sử dụng thư viện transformers của Hugging Face để tương tác với một mô hình tóm tắt có sẵn. Bạn có thể sử dụng các API của OpenAI (GPT-3/4) hoặc các LLM mã nguồn mở khác nếu muốn.

from transformers import pipeline

def summarize_text_with_llm(text, max_length=150, min_length=50):

"""

Sử dụng LLM để tóm tắt văn bản.

"""

if not text:

return "Không có văn bản để tóm tắt."

# Khởi tạo pipeline tóm tắt. Có thể chọn các mô hình khác nhau.

# Ví dụ: "facebook/bart-large-cnn" hoặc "sshleifer/distilbart-cnn-12-6"

# Đối với tiếng Việt, có thể cần fine-tune hoặc dùng mô hình đa ngôn ngữ.

summarizer = pipeline("summarization", model="sshleifer/distilbart-cnn-12-6")

# LLM có giới hạn về độ dài input. Cần chia nhỏ văn bản nếu quá dài.

# Đây là một giải pháp đơn giản, có thể cần phức tạp hơn cho văn bản rất dài.

chunk_size = 1000 # Kích thước chunk (số từ)

chunks = [text[i:i+chunk_size] for i in range(0, len(text), chunk_size)]

summaries = []

for chunk in chunks:

try:

summary = summarizer(chunk, max_length=max_length, min_length=min_length, do_sample=False)

summaries.append(summary[0]['summary_text'])

except Exception as e:

print(f"Lỗi khi tóm tắt một chunk: {e}")

# Nếu một chunk quá dài, thử lại với max_length nhỏ hơn hoặc bỏ qua

pass

# Kết hợp các bản tóm tắt nếu có nhiều chunk.

# Có thể cần một bước tóm tắt lại các bản tóm tắt nhỏ.

final_summary = " ".join(summaries)

# Nếu bản tóm tắt cuối cùng vẫn còn quá dài, có thể tóm tắt lại lần nữa

if len(final_summary.split()) > max_length and len(summaries) > 1:

print("Tóm tắt lại các bản tóm tắt nhỏ...")

final_summary = summarizer(final_summary, max_length=max_length, min_length=min_length, do_sample=False)[0]['summary_text']

return final_summary

# Ví dụ sử dụng:

# sample_text = "Trí tuệ nhân tạo (AI) là một lĩnh vực của khoa học máy tính tập trung vào việc tạo ra các máy móc thông minh có khả năng hoạt động và phản ứng như con người. AI bao gồm học máy (machine learning), học sâu (deep learning), xử lý ngôn ngữ tự nhiên (natural language processing) và thị giác máy tính (computer vision). Các ứng dụng của AI rất đa dạng, từ xe tự lái, nhận dạng giọng nói đến các hệ thống khuyến nghị và chẩn đoán y tế. Sự phát triển của AI đang thay đổi cách chúng ta sống và làm việc, mang lại nhiều cơ hội nhưng cũng đặt ra không ít thách thức về đạo đức và xã hội."

# summary_result = summarize_text_with_llm(sample_text, max_length=100, min_length=30)

# print(f"Bản tóm tắt: {summary_result}")

Trong hàm summarize_text_with_llm, chúng ta sử dụng pipeline("summarization") từ thư viện transformers. Lưu ý rằng các LLM có giới hạn về độ dài input (context window). Đối với tài liệu PDF dài, chúng ta cần chia nhỏ văn bản thành các "chunk" và tóm tắt từng phần, sau đó có thể tóm tắt lại các bản tóm tắt nhỏ này để có được một bản tóm tắt tổng thể.

Kết hợp thành một AI Agent hoàn chỉnh

Cuối cùng, chúng ta kết hợp các bước trên thành một lớp hoặc một hàm duy nhất để tạo thành AI Agent tóm tắt PDF.

class PdfSummarizationAgent:

def __init__(self, model_name="sshleifer/distilbart-cnn-12-6"):

self.summarizer = pipeline("summarization", model=model_name)

print(f"AI Agent đã sẵn sàng với mô hình: {model_name}")

def process_pdf_and_summarize(self, pdf_path, max_length=150, min_length=50, chunk_size=1000):

"""

Quy trình hoàn chỉnh: trích xuất, tiền xử lý và tóm tắt PDF.

"""

print(f"Đang xử lý file PDF: {pdf_path}")

# 1. Trích xuất văn bản

raw_text = extract_text_from_pdf(pdf_path)

if not raw_text:

return "Không thể trích xuất văn bản từ PDF."

# 2. Tiền xử lý văn bản

cleaned_text = preprocess_text(raw_text)

if not cleaned_text:

return "Văn bản sau tiền xử lý trống."

print(f"Đã trích xuất và làm sạch {len(cleaned_text)} ký tự.")

# 3. Tóm tắt bằng LLM

print("Đang tóm tắt nội dung...")

summaries = []

# Chia nhỏ văn bản thành các đoạn nhỏ hơn để phù hợp với giới hạn của LLM

# Đây là một cách chia đơn giản, có thể cần phức tạp hơn (ví dụ: theo câu, đoạn)

chunks = [cleaned_text[i:i+chunk_size] for i in range(0, len(cleaned_text), chunk_size)]

for i, chunk in enumerate(chunks):

try:

# print(f"Đang tóm tắt chunk {i+1}/{len(chunks)}...")

summary = self.summarizer(chunk, max_length=max_length, min_length=min_length, do_sample=False)

summaries.append(summary[0]['summary_text'])

except Exception as e:

print(f"Lỗi khi tóm tắt chunk {i+1}: {e}")

# Có thể log lỗi hoặc thử các chiến lược khác

pass

final_summary = " ".join(summaries)

# Nếu tổng các bản tóm tắt con vẫn quá dài, tóm tắt lại lần nữa

if len(final_summary.split()) > max_length and len(summaries) > 1:

print("Tóm tắt lại các bản tóm tắt nhỏ để có bản cuối cùng...")

try:

final_summary = self.summarizer(final_summary, max_length=max_length, min_length=min_length, do_sample=False)[0]['summary_text']

except Exception as e:

print(f"Lỗi khi tóm tắt lại bản tổng hợp: {e}")

return final_summary

# Sử dụng AI Agent

# agent = PdfSummarizationAgent()

# pdf_file = "path/to/your/document.pdf" # Thay thế bằng đường dẫn file PDF của bạn

# final_summary = agent.process_pdf_and_summarize(pdf_file, max_length=200, min_length=75)

# print("\n--- BẢN TÓM TẮT CUỐI CÙNG ---")

# print(final_summary)

Lưu ý: Để chạy được code này, bạn cần cài đặt các thư viện: pip install PyMuPDF transformers sentencepiece (sentencepiece cần cho một số tokenizer của Transformers). Đối với các mô hình lớn hơn hoặc yêu cầu tiếng Việt, bạn có thể cần tìm kiếm các mô hình đã được huấn luyện trước (pre-trained models) chuyên biệt hoặc cân nhắc fine-tune một mô hình hiện có.

Tips và Best Practices khi Xây Dựng AI Tóm Tắt PDF

Việc xây dựng một AI tóm tắt PDF hiệu quả không chỉ dừng lại ở việc ghép nối các thư viện. Có rất nhiều yếu tố cần được xem xét để tối ưu hóa hiệu suất và chất lượng của bản tóm tắt.

- Lựa chọn Mô hình LLM phù hợp: Không phải LLM nào cũng phù hợp cho mọi tác vụ. Đối với tóm tắt, các mô hình như BART, T5, hoặc các phiên bản DistilBERT/DistilBART thường cho kết quả tốt. Nếu cần tóm tắt bằng tiếng Việt, hãy tìm các mô hình đã được huấn luyện trên dữ liệu tiếng Việt hoặc các mô hình đa ngôn ngữ. Các mô hình lớn hơn như GPT-4 qua API sẽ cho chất lượng cao nhất nhưng đi kèm với chi phí và độ trễ.

- Xử lý Giới hạn Context Window của LLM: Đây là một thách thức lớn với các tài liệu dài. Chiến lược chia nhỏ (chunking) là cần thiết. Tuy nhiên, cách chia nhỏ cũng rất quan trọng. Chia theo đoạn văn (paragraph) hoặc theo ngữ nghĩa sẽ tốt hơn là chia theo số ký tự cứng nhắc, để tránh cắt ngang một ý tưởng quan trọng. Sau khi tóm tắt các chunk, việc tóm tắt lại các bản tóm tắt nhỏ (hierarchical summarization) có thể cải thiện chất lượng tổng thể.

- Tối ưu hóa Preprocessing: Văn bản từ PDF có thể rất "bẩn". Ngoài việc loại bỏ khoảng trắng và ký tự đặc biệt, bạn có thể cần xử lý các trường hợp như header/footer lặp lại, số trang, mục lục, hoặc các bảng biểu không cần thiết. Đôi khi, việc sử dụng các thư viện OCR (Optical Character Recognition) chuyên biệt như

Tesseractkết hợp vớipdf2imagetrước khi trích xuất văn bản có thể cải thiện đáng kể chất lượng input nếu PDF là ảnh scan. - Đánh giá và Cải tiến: Chất lượng bản tóm tắt là chủ quan. Hãy xây dựng một cơ chế để người dùng có thể đánh giá bản tóm tắt (ví dụ: điểm từ 1-5, hoặc phản hồi "có ích/không có ích"). Dữ liệu này có thể được sử dụng để tinh chỉnh mô hình hoặc điều chỉnh các tham số tóm tắt (

max_length,min_length). - Xử lý các loại PDF khác nhau: Một số PDF có cấu trúc phức tạp (multi-column, bảng biểu, hình ảnh). Các thư viện như

pdfplumbercó khả năng trích xuất văn bản theo từng block, giúp duy trì cấu trúc tốt hơn so với trích xuất toàn bộ trang. Việc kết hợp nhiều thư viện trích xuất hoặc có logic xử lý riêng cho từng loại PDF có thể cần thiết.

Bằng cách áp dụng những tips này, bạn không chỉ xây dựng được một công cụ tóm tắt PDF cơ bản mà còn nâng tầm nó thành một AI Agent thực sự hữu ích và mạnh mẽ, tối ưu hóa quy trình làm việc và tăng cường hiệu suất nghiên cứu.

So Sánh Các Chiến Lược Tóm Tắt và Công Cụ AI tóm tắt PDF

Khi nói đến AI tóm tắt PDF, có hai chiến lược chính: tóm tắt trích xuất (extractive summarization) và tóm tắt trừu tượng (abstractive summarization), cùng với sự đa dạng của các công cụ và mô hình.

Tóm tắt Trích Xuất (Extractive Summarization): Phương pháp này hoạt động bằng cách xác định và trích xuất các câu hoặc cụm từ quan trọng nhất từ văn bản gốc để tạo thành bản tóm tắt. Ưu điểm là các câu trong bản tóm tắt luôn đúng ngữ pháp và chính xác về thông tin vì chúng được lấy trực tiếp từ tài liệu gốc. Nhược điểm là đôi khi bản tóm tắt có thể không mạch lạc hoặc thiếu sự kết nối tự nhiên giữa các câu. Các kỹ thuật truyền thống bao gồm TextRank hoặc LexRank. Đối với AI tóm tắt PDF, phương pháp này ít khi được dùng trực tiếp cho toàn bộ tài liệu mà thường là một bước trung gian để lọc ra các câu quan trọng trước khi đưa vào LLM.

Tóm tắt Trừu Tượng (Abstractive Summarization): Đây là phương pháp tiên tiến hơn, trong đó AI Agent không chỉ trích xuất mà còn tạo ra các câu mới để diễn đạt lại nội dung chính. Điều này giống với cách con người tóm tắt: đọc hiểu và viết lại bằng lời văn của mình. Ưu điểm là bản tóm tắt thường mạch lạc, tự nhiên và súc tích hơn. Nhược điểm là đôi khi mô hình có thể "hallucinate" (tạo ra thông tin không có trong văn bản gốc) hoặc mắc lỗi ngữ pháp. Các LLM hiện đại như GPT-3/4, BART, T5 đều sử dụng phương pháp trừu tượng này. Đây là lựa chọn ưu tiên cho các AI tóm tắt PDF mong muốn chất lượng cao và khả năng ứng dụng rộng rãi.

So sánh công cụ và mô hình:

- Thư viện mã nguồn mở (Hugging Face Transformers): Cung cấp quyền truy cập vào hàng ngàn mô hình tóm tắt đã được huấn luyện trước. Ưu điểm là linh hoạt, miễn phí (trừ chi phí tính toán), và có thể chạy cục bộ. Nhược điểm là yêu cầu kiến thức kỹ thuật để triển khai và quản lý tài nguyên. Phù hợp cho các dự án vibe coding tùy chỉnh và nghiên cứu.

- API của các nhà cung cấp lớn (OpenAI, Google, Anthropic): Cung cấp các LLM mạnh mẽ nhất thông qua API. Ưu điểm là chất lượng tóm tắt thường rất cao, dễ tích hợp và không cần quản lý hạ tầng AI. Nhược điểm là chi phí theo token, phụ thuộc vào bên thứ ba và có thể có vấn đề về quyền riêng tư dữ liệu nếu không cẩn thận.

- Các giải pháp chuyên biệt: Một số công ty cung cấp các dịch vụ tóm tắt PDF dưới dạng SaaS (Software as a Service). Chúng thường có giao diện người dùng thân thiện, dễ sử dụng nhưng ít linh hoạt hơn trong việc tùy chỉnh và có thể có chi phí định kỳ.

Việc lựa chọn công cụ và chiến lược phù hợp cho AI tóm tắt PDF phụ thuộc vào yêu cầu cụ thể của dự án: ngân sách, tài nguyên tính toán, mức độ tùy chỉnh cần thiết và yêu cầu về hiệu suất. Đối với một dự án vibe coding, việc bắt đầu với các mô hình mã nguồn mở trên Hugging Face là một lựa chọn tuyệt vời để học hỏi và thử nghiệm trước khi cân nhắc các giải pháp thương mại.

Các Lưu Ý Quan Trọng

- Bảo mật Dữ liệu: Khi xử lý các tài liệu PDF, đặc biệt là những tài liệu chứa thông tin nhạy cảm, hãy đảm bảo rằng dữ liệu được xử lý an toàn. Nếu sử dụng API của bên thứ ba, hãy đọc kỹ chính sách bảo mật và quyền riêng tư của họ. Đối với các dự án nội bộ, việc chạy mô hình cục bộ hoặc trên máy chủ riêng là lựa chọn tốt hơn.

- Hiệu suất và Chi phí: LLM tiêu thụ nhiều tài nguyên. Việc chọn mô hình có kích thước phù hợp, tối ưu hóa các tham số tóm tắt (

max_length,min_length) và chiến lược chia nhỏ văn bản có thể ảnh hưởng đáng kể đến hiệu suất và chi phí (nếu dùng API hoặc GPU cloud). - Xử lý Ngôn ngữ: Nếu tài liệu PDF có nhiều ngôn ngữ khác nhau, hãy sử dụng các mô hình LLM đa ngôn ngữ hoặc triển khai các mô hình riêng biệt cho từng ngôn ngữ. Đối với tiếng Việt, hãy ưu tiên các mô hình đã được huấn luyện trên corpus tiếng Việt để đảm bảo chất lượng tóm tắt.

- Khả năng Giải thích (Explainability): Trong một số trường hợp, người dùng có thể muốn biết tại sao AI lại đưa ra bản tóm tắt đó. Việc thiết kế Agent để có thể chỉ ra các câu hoặc đoạn văn gốc mà bản tóm tắt được tạo ra từ đó có thể tăng cường độ tin cậy.

- Cập nhật Mô hình: Lĩnh vực AI phát triển rất nhanh. Hãy thường xuyên theo dõi các mô hình LLM mới và các kỹ thuật tóm tắt tiên tiến để cập nhật và cải thiện AI Agent của bạn.

- Giao diện Người dùng (UI/UX): Một AI Agent mạnh mẽ sẽ trở nên vô dụng nếu không có giao diện người dùng thân thiện. Hãy cân nhắc xây dựng một giao diện web đơn giản (sử dụng Flask, Django, Streamlit hoặc Gradio) để người dùng có thể dễ dàng tải lên PDF và nhận bản tóm tắt.

- Xử lý lỗi mạnh mẽ: PDF có thể có nhiều định dạng và cấu trúc khác nhau, dễ gây ra lỗi trong quá trình trích xuất. Đảm bảo code của bạn có khả năng xử lý các trường hợp ngoại lệ (exception handling) một cách robust để tránh crash.

Câu Hỏi Thường Gặp

Làm thế nào để xử lý các file PDF được scan (chỉ chứa hình ảnh)?

Đối với các file PDF được scan, bạn cần sử dụng công nghệ nhận dạng ký tự quang học (OCR). Các thư viện như PyTesseract (kết hợp với Tesseract OCR engine) hoặc các dịch vụ OCR đám mây (Google Cloud Vision, AWS Textract) có thể chuyển đổi hình ảnh thành văn bản trước khi áp dụng các bước tiền xử lý và tóm tắt bằng LLM.

AI tóm tắt PDF có thể tóm tắt các bảng biểu hoặc đồ thị không?

Hầu hết các AI tóm tắt PDF hiện tại tập trung vào văn bản. Việc tóm tắt thông tin từ bảng biểu hoặc đồ thị là một thách thức lớn hơn, đòi hỏi các kỹ thuật trích xuất dữ liệu có cấu trúc (structured data extraction) và xử lý hình ảnh phức tạp. Một số mô hình LLM tiên tiến hơn có thể hiểu được văn bản trong ngữ cảnh của bảng, nhưng vẫn là một lĩnh vực đang phát triển.

Làm thế nào để đảm bảo bản tóm tắt chính xác và không "hallucinate"?

Để giảm thiểu "hallucination", bạn có thể sử dụng các mô hình LLM được tinh chỉnh đặc biệt cho tác vụ tóm tắt. Ngoài ra, việc giới hạn độ dài bản tóm tắt, sử dụng phương pháp tóm tắt trích xuất (nếu phù hợp), và đặc biệt là kiểm tra chéo (cross-checking) bản tóm tắt với văn bản gốc có thể giúp tăng cường độ chính xác. Một số framework như RAG (Retrieval-Augmented Generation) cũng có thể giúp hạn chế lỗi này bằng cách cung cấp ngữ cảnh chính xác hơn cho LLM.

Có cách nào để tóm tắt các phần cụ thể của PDF thay vì toàn bộ tài liệu không?

Có, bạn có thể điều chỉnh AI Agent để tóm tắt các phần cụ thể. Sau khi trích xuất văn bản, bạn có thể sử dụng các kỹ thuật NLP như nhận dạng tiêu đề, đoạn văn để phân đoạn tài liệu. Sau đó, chỉ đưa các đoạn văn mong muốn vào LLM để tóm tắt. Thư viện như spaCy có thể giúp nhận diện cấu trúc tài liệu tốt hơn.

Mô hình nào phù hợp nhất cho việc tóm tắt PDF tiếng Việt?

Đối với tiếng Việt, bạn nên tìm kiếm các mô hình LLM đã được huấn luyện hoặc tinh chỉnh trên tập dữ liệu tiếng Việt. Một số lựa chọn tiềm năng có thể là các mô hình đa ngôn ngữ lớn như XLM-RoBERTa hoặc các mô hình được phát triển bởi cộng đồng AI Việt Nam. Nếu có đủ dữ liệu và tài nguyên, việc fine-tune một mô hình cơ sở với dữ liệu tóm tắt tiếng Việt chất lượng cao sẽ mang lại kết quả tốt nhất.

Kết Luận

Việc xây dựng một AI Agent đọc và tóm tắt PDF là một dự án đầy tiềm năng, mang lại giá trị to lớn trong việc tăng cường hiệu suất nghiên cứu và xử lý thông tin. Từ việc trích xuất văn bản phức tạp đến áp dụng các mô hình ngôn ngữ lớn để tạo ra bản tóm tắt súc tích, mỗi bước đều đòi hỏi sự kết hợp giữa kiến thức chuyên môn và kỹ năng lập trình.

Thông qua bài viết này, chúng ta đã cùng nhau khám phá các thành phần cốt lõi, từ lý thuyết đến thực hành, cùng với những lời khuyên và best practices để xây dựng một hệ thống mạnh mẽ. Hy vọng rằng những kiến thức và ví dụ code được cung cấp sẽ truyền cảm hứng cho bạn để bắt tay vào dự án của riêng mình, góp phần tạo ra những giải pháp AI sáng tạo. Hãy tiếp tục theo dõi vibe coding để cập nhật thêm nhiều dự án và kiến thức AI hấp dẫn khác nhé!