Giới Thiệu: Khai Thác Sức Mạnh Tri Thức Nội Bộ Bằng RAG AI

Trong kỷ nguyên số hóa, dữ liệu là tài sản quý giá nhất của mọi doanh nghiệp. Tuy nhiên, việc biến khối lượng dữ liệu khổng lồ đó thành tri thức hữu ích, dễ tiếp cận lại là một thách thức không nhỏ. Đây chính là lúc các công nghệ AI tiên tiến như RAG (Retrieval-Augmented Generation) phát huy tác dụng. Bài viết này sẽ giúp bạn hiểu rõ về xây dựng RAG AI từ góc nhìn thực tế, từ những khái niệm cơ bản đến các bước triển khai cụ thể, và cách mà prompt engineering đóng vai trò then chốt trong việc tối ưu hóa hệ thống này cho doanh nghiệp của bạn.

Chúng ta sẽ cùng khám phá cách RAG không chỉ giúp các mô hình ngôn ngữ lớn (LLM) vượt qua giới hạn về thông tin mà chúng được huấn luyện, mà còn mang lại khả năng cung cấp câu trả lời chính xác, đáng tin cậy dựa trên nguồn dữ liệu nội bộ của doanh nghiệp. Hãy cùng vibecoding.vin đi sâu vào hành trình biến dữ liệu "chết" thành nguồn tri thức sống động, phục vụ mọi nhu cầu từ hỗ trợ khách hàng đến ra quyết định chiến lược.

RAG AI Là Gì và Tại Sao Doanh Nghiệp Cần Nó?

RAG, viết tắt của Retrieval-Augmented Generation, là một kiến trúc AI kết hợp sức mạnh của hệ thống truy xuất thông tin (retrieval) với khả năng tạo sinh văn bản của các mô hình ngôn ngữ lớn (Large Language Models - LLMs). Thay vì chỉ dựa vào kiến thức đã được huấn luyện trong các tham số của mình, một hệ thống RAG sẽ tìm kiếm thông tin liên quan từ một kho dữ liệu bên ngoài (knowledge base) và sử dụng thông tin đó để làm phong phú thêm câu trả lời của LLM.

Hãy tưởng tượng một LLM như một bộ não siêu việt nhưng đôi khi "quên" những chi tiết cụ thể hoặc chưa được cập nhật với thông tin mới nhất của doanh nghiệp bạn. Hệ thống retrieval chính là "thư viện" mà LLM có thể tham khảo ngay lập tức. Khi người dùng đặt câu hỏi, hệ thống retrieval sẽ tìm kiếm các đoạn văn bản, tài liệu, hay dữ liệu liên quan nhất trong kho tri thức nội bộ của bạn. Sau đó, những thông tin này sẽ được đưa vào làm ngữ cảnh (context) cho LLM để tạo ra câu trả lời cuối cùng.

Tại sao doanh nghiệp cần xây dựng RAG AI? Có ba lý do chính:

- Giảm thiểu "hallucination" (ảo giác) của LLM: LLM đôi khi tạo ra thông tin không chính xác hoặc không tồn tại. RAG giúp LLM dựa trên dữ liệu thực tế, giảm đáng kể hiện tượng này.

- Cập nhật thông tin liên tục và chính xác: Dữ liệu nội bộ của doanh nghiệp thay đổi hàng ngày. RAG cho phép LLM truy cập thông tin mới nhất mà không cần phải huấn luyện lại toàn bộ mô hình, tiết kiệm chi phí và thời gian.

- Tận dụng tri thức nội bộ: Các tài liệu hướng dẫn, báo cáo, dữ liệu khách hàng, chính sách nội bộ là kho báu tri thức. RAG biến chúng thành nguồn thông tin có thể truy vấn, giúp nhân viên và khách hàng nhanh chóng tìm được câu trả lời mà không cần sự can thiệp của con người. Điều này đặc biệt hữu ích khi bạn muốn xây dựng RAG AI để tạo chatbot hỗ trợ khách hàng hoặc công cụ tìm kiếm nội bộ.

Việc triển khai RAG giúp doanh nghiệp tối ưu hóa quy trình làm việc, nâng cao hiệu quả hỗ trợ khách hàng và cung cấp thông tin chính xác, kịp thời cho các quyết định kinh doanh.

Xây Dựng RAG AI: Hướng Dẫn Chi Tiết Cùng Prompt Engineering

Quá trình xây dựng RAG AI bao gồm nhiều bước, từ chuẩn bị dữ liệu đến tối ưu hóa prompt. Dưới đây là các bước cơ bản và cách chúng ta áp dụng prompt engineering để đạt hiệu quả cao nhất.

Bước 1: Chuẩn Bị Dữ Liệu Nội Bộ (Knowledge Base)

Đây là nền tảng của mọi hệ thống RAG. Dữ liệu có thể bao gồm tài liệu PDF, file Word, trang web, cơ sở dữ liệu, file CSV, v.v. Quan trọng là phải làm sạch, chuẩn hóa và chia nhỏ dữ liệu thành các đoạn (chunks) có kích thước phù hợp.

- Thu thập và làm sạch: Đảm bảo dữ liệu không có lỗi, trùng lặp và được định dạng nhất quán.

- Phân đoạn (Chunking): Chia các tài liệu lớn thành các đoạn nhỏ hơn. Kích thước đoạn (chunk size) và chiến lược chồng lấn (overlap strategy) rất quan trọng. Đoạn quá lớn có thể chứa quá nhiều thông tin không liên quan, làm nhiễu LLM. Đoạn quá nhỏ có thể mất ngữ cảnh.

- Chuyển đổi thành Embeddings: Mỗi đoạn văn bản sẽ được chuyển đổi thành một vector số (embedding) bằng các mô hình embedding. Các vector này sẽ được lưu trữ trong một cơ sở dữ liệu vector (vector database) như Pinecone, Weaviate, Milvus, ChromaDB, v.v. để phục vụ cho việc tìm kiếm nhanh chóng.

Ví dụ về cách chia đoạn và tạo embedding cơ bản với thư viện LangChain và OpenAIEmbeddings:

from langchain.text_splitter import RecursiveCharacterTextSplitter

from langchain_openai import OpenAIEmbeddings

from langchain_community.document_loaders import TextLoader

from langchain_community.vectorstores import Chroma

# 1. Tải dữ liệu

loader = TextLoader("data/my_internal_document.txt")

documents = loader.load()

# 2. Chia đoạn

text_splitter = RecursiveCharacterTextSplitter(chunk_size=1000, chunk_overlap=200)

chunks = text_splitter.split_documents(documents)

# 3. Tạo embeddings và lưu vào vector database (ví dụ Chroma)

# Đảm bảo bạn đã cài đặt 'openai' và 'chromadb'

embeddings = OpenAIEmbeddings(model="text-embedding-ada-002")

vectorstore = Chroma.from_documents(documents=chunks, embedding=embeddings, persist_directory="./chroma_db")

vectorstore.persist()

print(f"Đã tạo {len(chunks)} chunks và lưu vào vector database.")Bước 2: Hệ Thống Truy Xuất (Retrieval System)

Khi người dùng đặt câu hỏi, hệ thống sẽ chuyển câu hỏi đó thành embedding và tìm kiếm các vector gần nhất trong cơ sở dữ liệu vector. Các đoạn văn bản tương ứng với các vector này chính là những thông tin liên quan nhất.

- Semantic Search: Thay vì tìm kiếm từ khóa, semantic search tìm kiếm ý nghĩa ngữ nghĩa của câu hỏi, giúp tìm ra các tài liệu liên quan ngay cả khi không chứa các từ khóa chính xác.

- Ranking và Filtering: Sau khi truy xuất, có thể áp dụng các kỹ thuật ranking để ưu tiên các tài liệu phù hợp nhất hoặc lọc bỏ những tài liệu không đáp ứng tiêu chí nhất định.

Ví dụ truy xuất từ vector database:

# Tải lại vectorstore nếu đã persist

from langchain_community.vectorstores import Chroma

from langchain_openai import OpenAIEmbeddings

embeddings = OpenAIEmbeddings(model="text-embedding-ada-002")

vectorstore = Chroma(persist_directory="./chroma_db", embedding_function=embeddings)

query = "Chính sách nghỉ phép của công ty được quy định như thế nào?"

retrieved_docs = vectorstore.similarity_search(query, k=3) # Truy xuất 3 tài liệu liên quan nhất

print("\nCác tài liệu được truy xuất:")

for i, doc in enumerate(retrieved_docs):

print(f"--- Document {i+1} ---")

print(doc.page_content[:200] + "...") # Hiển thị 200 ký tự đầu tiênBước 3: Tạo Sinh Văn Bản (Generation) với LLM và Prompt Engineering

Đây là nơi prompt engineering phát huy sức mạnh. Các đoạn văn bản đã truy xuất (retrieved_docs) sẽ được đưa vào cùng với câu hỏi của người dùng để tạo thành một prompt hoàn chỉnh cho LLM.

- Contextual Prompting: Xây dựng prompt sao cho LLM hiểu rõ vai trò của các đoạn văn bản được cung cấp.

- Instruction Tuning: Chỉ dẫn LLM cách sử dụng thông tin và cách tạo ra câu trả lời mong muốn (ngắn gọn, chi tiết, theo định dạng cụ thể, v.v.).

- Temperature và Top_P: Điều chỉnh các tham số của LLM để kiểm soát mức độ sáng tạo và tính ngẫu nhiên của câu trả lời.

Ví dụ về một prompt điển hình cho RAG:

from langchain_openai import ChatOpenAI

from langchain_core.prompts import ChatPromptTemplate

# Khởi tạo LLM

llm = ChatOpenAI(model="gpt-3.5-turbo", temperature=0.7)

# Xây dựng prompt template

template = """Bạn là một trợ lý AI thân thiện và hữu ích, chuyên cung cấp thông tin dựa trên các tài liệu nội bộ.

Hãy trả lời câu hỏi của người dùng dựa trên ngữ cảnh được cung cấp dưới đây.

Nếu câu trả lời không có trong ngữ cảnh, hãy nói rằng bạn không tìm thấy thông tin đó trong các tài liệu của mình.

Không tạo ra thông tin ngoài ngữ cảnh.

Ngữ cảnh:

{context}

Câu hỏi: {question}

Trả lời:"""

prompt = ChatPromptTemplate.from_template(template)

# Chuẩn bị context từ các tài liệu đã truy xuất

context_str = "\n\n".join([doc.page_content for doc in retrieved_docs])

# Tạo chuỗi xử lý (chain)

rag_chain = prompt | llm

# Gọi chain để tạo câu trả lời

response = rag_chain.invoke({"context": context_str, "question": query})

print("\n--- Câu trả lời của AI ---")

print(response.content)Bước 4: Đánh Giá và Tối Ưu Hóa

Không có hệ thống RAG nào hoàn hảo ngay từ đầu. Cần liên tục đánh giá chất lượng câu trả lời và tối ưu hóa các thành phần:

- Đánh giá Retrieval: Các tài liệu được truy xuất có thực sự liên quan đến câu hỏi không? Có cần điều chỉnh kích thước chunk, mô hình embedding, hoặc thuật toán tìm kiếm không?

- Đánh giá Generation: Câu trả lời của LLM có chính xác, đầy đủ, dễ hiểu và tuân thủ các hướng dẫn trong prompt không? Có bị "hallucination" không?

- Tối ưu hóa Prompt: Thử nghiệm các biến thể prompt khác nhau để cải thiện chất lượng câu trả lời. Đây là một phần quan trọng của việc xây dựng RAG AI hiệu quả.

Prompt Engineering Nâng Cao cho RAG

Prompt engineering không chỉ là viết một câu lệnh đơn giản. Với RAG, nó trở thành một nghệ thuật để hướng dẫn LLM tận dụng tối đa ngữ cảnh được cung cấp.

- Clear Instructions (Hướng dẫn rõ ràng): Luôn bắt đầu prompt với vai trò của AI và các quy tắc cơ bản. Ví dụ: "Bạn là một chuyên gia hỗ trợ khách hàng. Hãy trả lời câu hỏi dựa trên thông tin sau. Nếu không có thông tin, hãy yêu cầu thêm chi tiết."

- Specificity (Tính cụ thể): Yêu cầu kết quả theo định dạng cụ thể (ví dụ: "Trả lời dưới dạng gạch đầu dòng", "Tóm tắt trong 3 câu", "Chỉ cung cấp ngày tháng và tên sự kiện").

- Persona (Nhân vật): Gán cho LLM một persona để nó tạo ra câu trả lời với giọng điệu và phong cách phù hợp (ví dụ: "Hãy trả lời với giọng điệu chuyên nghiệp và thân thiện").

- Chain-of-Thought (Chuỗi suy nghĩ): Đối với các câu hỏi phức tạp, hãy yêu cầu LLM "suy nghĩ từng bước" trước khi đưa ra câu trả lời cuối cùng. Mặc dù RAG đã cung cấp ngữ cảnh, nhưng việc yêu cầu LLM phân tích ngữ cảnh trước khi tổng hợp câu trả lời có thể cải thiện độ chính xác. Ví dụ: "Trước tiên, hãy xác định các đoạn văn bản liên quan nhất. Sau đó, tổng hợp thông tin từ chúng để trả lời câu hỏi."

- Negative Constraints (Ràng buộc phủ định): Rõ ràng chỉ ra những gì LLM KHÔNG NÊN làm. Ví dụ: "Không tạo ra thông tin. Chỉ sử dụng ngữ cảnh được cung cấp." hoặc "Không sử dụng ngôn ngữ kỹ thuật nếu không cần thiết."

Một ví dụ về prompt nâng cao với Chain-of-Thought:

advanced_template = """Bạn là một trợ lý AI chuyên nghiệp và tỉ mỉ, có trách nhiệm phân tích tài liệu nội bộ để trả lời các câu hỏi.

Hãy thực hiện các bước sau:

1. Đọc kỹ ngữ cảnh được cung cấp.

2. Xác định các thông tin chính trong ngữ cảnh có liên quan trực tiếp đến câu hỏi.

3. Nếu có đủ thông tin, hãy tổng hợp một câu trả lời chính xác và đầy đủ, sử dụng ngôn ngữ dễ hiểu.

4. Nếu thông tin không đủ hoặc không có trong ngữ cảnh, hãy ghi rõ rằng bạn không thể trả lời câu hỏi dựa trên các tài liệu hiện có và đề xuất người dùng cung cấp thêm thông tin.

Ngữ cảnh:

{context}

Câu hỏi: {question}

Suy nghĩ từng bước và sau đó đưa ra câu trả lời cuối cùng:"""

advanced_prompt = ChatPromptTemplate.from_template(advanced_template)

advanced_rag_chain = advanced_prompt | llm

response_advanced = advanced_rag_chain.invoke({"context": context_str, "question": query})

print("\n--- Câu trả lời AI với Prompt nâng cao ---")

print(response_advanced.content)Việc liên tục thử nghiệm và điều chỉnh các prompt là chìa khóa để tối ưu hóa hiệu suất khi xây dựng RAG AI cho các trường hợp sử dụng cụ thể của doanh nghiệp.

Các Trường Hợp Sử Dụng Thực Tế của RAG trong Doanh Nghiệp

RAG không chỉ là một lý thuyết mà đã được ứng dụng rộng rãi, mang lại giá trị kinh doanh rõ rệt.

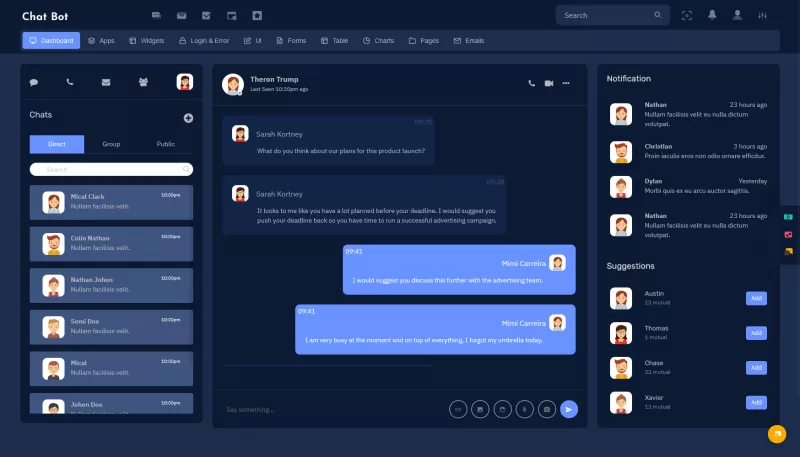

- Hỗ trợ khách hàng (Customer Support): Xây dựng chatbot RAG có thể trả lời các câu hỏi thường gặp, cung cấp thông tin sản phẩm, chính sách đổi trả, hướng dẫn sử dụng dựa trên tài liệu hỗ trợ của công ty. Điều này giúp giảm tải cho đội ngũ hỗ trợ và nâng cao trải nghiệm khách hàng.

- Tìm kiếm tri thức nội bộ (Internal Knowledge Search): Giúp nhân viên nhanh chóng tìm kiếm thông tin trong hàng ngàn tài liệu nội bộ như quy trình, chính sách, báo cáo kỹ thuật, dữ liệu dự án. Điều này tăng hiệu suất làm việc và giảm thời gian tìm kiếm thông tin.

- Phân tích tài liệu pháp lý và hợp đồng: RAG có thể giúp luật sư và chuyên gia pháp lý nhanh chóng trích xuất các điều khoản, điều kiện quan trọng từ các hợp đồng phức tạp, tiết kiệm thời gian đáng kể.

- Đào tạo và Onboarding nhân viên: Cung cấp một nguồn tài nguyên hỏi đáp tự động cho nhân viên mới để tìm hiểu về công ty, văn hóa, các công cụ làm việc và quy trình.

- Nghiên cứu và phát triển (R&D): Hỗ trợ các nhà nghiên cứu truy cập và tổng hợp thông tin từ các báo cáo khoa học, bài báo nội bộ, dữ liệu thử nghiệm để đẩy nhanh quá trình sáng tạo.

Mỗi trường hợp sử dụng này đều đòi hỏi một chiến lược xây dựng RAG AI và prompt engineering cụ thể để tối đa hóa hiệu quả.

Các Lưu Ý Quan Trọng Khi Triển Khai RAG

- Chất lượng dữ liệu là trên hết: Một hệ thống RAG chỉ tốt khi dữ liệu đầu vào của nó tốt. Dữ liệu bẩn, không chính xác sẽ dẫn đến câu trả lời kém chất lượng. Đầu tư vào quá trình làm sạch và quản lý dữ liệu là cực kỳ quan trọng.

- Lựa chọn mô hình Embedding phù hợp: Các mô hình embedding khác nhau có thể hoạt động tốt hơn với các loại dữ liệu khác nhau. Thử nghiệm và lựa chọn mô hình phù hợp với ngữ cảnh dữ liệu của bạn.

- Cân nhắc kích thước Chunk và Overlap: Đây là một tham số cần được tinh chỉnh. Quá lớn sẽ làm nhiễu, quá nhỏ sẽ mất ngữ cảnh. Overlap giúp đảm bảo ngữ cảnh không bị đứt đoạn giữa các chunk.

- Bảo mật và Quyền riêng tư: Khi xử lý dữ liệu nội bộ, đặc biệt là dữ liệu nhạy cảm, cần đảm bảo các biện pháp bảo mật chặt chẽ và tuân thủ các quy định về quyền riêng tư (ví dụ: GDPR, HIPAA). Đừng đưa dữ liệu nhạy cảm vào các dịch vụ LLM công cộng nếu không có biện pháp bảo vệ phù hợp.

- Giám sát và Cải thiện liên tục: RAG không phải là giải pháp "set-and-forget". Cần có cơ chế giám sát hiệu suất, thu thập phản hồi của người dùng và liên tục cải thiện hệ thống, từ chất lượng dữ liệu, mô hình embedding, đến các prompt.

- Chi phí: Việc sử dụng LLM và dịch vụ embedding có chi phí liên quan. Cần tính toán và tối ưu hóa để đảm bảo hiệu quả kinh tế.

- Tích hợp với hệ thống hiện có: RAG cần được tích hợp mượt mà vào các ứng dụng và quy trình làm việc hiện có của doanh nghiệp để mang lại giá trị tối đa.

Câu Hỏi Thường Gặp

RAG có thể thay thế hoàn toàn việc huấn luyện lại LLM không?

Không hoàn toàn. RAG giúp LLM truy cập thông tin mới và cụ thể mà không cần huấn luyện lại, nhưng nó không thay thế được việc huấn luyện cơ bản của LLM về ngữ pháp, cú pháp, và khả năng suy luận tổng quát. RAG bổ trợ cho LLM, không thay thế nó.

Làm thế nào để chọn Vector Database phù hợp?

Việc lựa chọn Vector Database phụ thuộc vào quy mô dữ liệu, yêu cầu về tốc độ, chi phí, và khả năng tích hợp với hệ thống hiện có. Các lựa chọn phổ biến bao gồm Pinecone (managed service), Weaviate, Milvus (self-hosted), và ChromaDB (nhẹ, dễ triển khai cho dự án nhỏ).

Prompt Engineering có thực sự quan trọng khi đã có RAG?

Hoàn toàn có. RAG cung cấp ngữ cảnh, nhưng prompt engineering là yếu tố quyết định cách LLM sử dụng ngữ cảnh đó để tạo ra câu trả lời. Một prompt tốt có thể biến một câu trả lời trung bình thành một câu trả lời xuất sắc, chính xác và phù hợp với mục đích sử dụng.

Kết Luận

Khai thác tri thức nội bộ là một lợi thế cạnh tranh then chốt trong bối cảnh kinh doanh hiện đại. Với RAG AI, doanh nghiệp có thể biến khối lượng dữ liệu khổng lồ thành một nguồn tài nguyên thông minh, dễ dàng truy cập và sử dụng. Từ việc nâng cao hiệu quả hỗ trợ khách hàng đến việc tối ưu hóa quy trình ra quyết định, việc xây dựng RAG AI mang lại giá trị vượt trội. Tại vibe coding, chúng tôi tin rằng việc hiểu sâu sắc các khái niệm, thực hành đúng phương pháp, và đặc biệt là nắm vững nghệ thuật prompt engineering sẽ giúp bạn triển khai thành công các hệ thống RAG mạnh mẽ, đưa doanh nghiệp của bạn lên một tầm cao mới trong cuộc cách mạng AI.

Hãy bắt đầu hành trình biến dữ liệu của bạn thành sức mạnh tri thức ngay hôm nay!