Giới Thiệu: AI Coding Khi Offline – Bí Kíp Tận Dụng Trợ Lý AI Ngay Cả Khi Mất Mạng

Trong kỷ nguyên số hóa, AI đã trở thành trợ thủ đắc lực cho các lập trình viên. Từ việc gợi ý code, sửa lỗi, đến tự động hóa tác vụ, AI giúp chúng ta tăng tốc độ và hiệu quả công việc đáng kể. Tuy nhiên, một thách thức lớn thường gặp là sự phụ thuộc vào kết nối internet. Điều gì sẽ xảy ra khi bạn đang ở một nơi không có mạng, hay đơn giản là internet nhà bạn "đình công"? Đừng lo lắng! Bài viết về AI offline coding này sẽ giúp bạn khám phá những bí kíp để tận dụng sức mạnh của trợ lý AI ngay cả khi không có kết nối internet, đảm bảo flow công việc của bạn không bị gián đoạn. Chúng ta sẽ đi sâu vào các công cụ, phương pháp và chiến lược để biến AI offline coding trở thành một phần không thể thiếu trong bộ công cụ của bạn.

AI Offline Coding: Khái Niệm và Tiềm Năng

AI offline coding hay lập trình với AI ngoại tuyến, là khả năng sử dụng các công cụ hỗ trợ AI mà không cần kết nối mạng internet. Điều này thường đạt được bằng cách cài đặt các mô hình AI trực tiếp lên máy tính cục bộ của bạn, cho phép chúng xử lý dữ liệu và đưa ra gợi ý mà không cần gửi thông tin lên đám mây. Khác với các dịch vụ AI phổ biến như ChatGPT hay GitHub Copilot yêu cầu kết nối liên tục, các giải pháp AI offline coding tập trung vào việc mang sức mạnh tính toán và khả năng học máy về phía người dùng.

Tiềm năng của AI offline coding là vô cùng lớn. Imagine bạn đang trên một chuyến bay dài, làm việc trong một quán cà phê không có Wi-Fi, hoặc ở một vùng sâu vùng xa. Thay vì bị gián đoạn công việc, bạn vẫn có thể nhận được sự hỗ trợ từ AI của mình. Điều này không chỉ tăng năng suất mà còn cải thiện đáng kể trải nghiệm làm việc, giảm thiểu sự phụ thuộc vào hạ tầng mạng. Hơn nữa, việc xử lý dữ liệu cục bộ còn mang lại lợi ích về bảo mật, vì code nhạy cảm của bạn không cần phải rời khỏi máy tính cá nhân.

Để hiện thực hóa AI offline coding, chúng ta cần các mô hình AI có kích thước tương đối nhỏ gọn nhưng vẫn đủ mạnh mẽ để chạy trên phần cứng thông thường. Sự phát triển của các Large Language Models (LLMs) mã nguồn mở và các kỹ thuật tối ưu hóa mô hình đã mở ra cánh cửa cho việc triển khai AI offline coding một cách hiệu quả. Các công cụ này thường sử dụng kiến trúc Transformer hoặc các biến thể của nó, được huấn luyện trên một lượng lớn dữ liệu code để hiểu ngữ cảnh và đưa ra các gợi ý phù hợp.

Một số phương pháp tiếp cận AI offline coding phổ biến bao gồm việc sử dụng các mô hình ngôn ngữ lớn được tinh chỉnh (fine-tuned) cho nhiệm vụ sinh code, các công cụ phân tích tĩnh code tích hợp AI, hoặc các môi trường phát triển tích hợp (IDE) có khả năng dự đoán code dựa trên dữ liệu cục bộ. Mục tiêu cuối cùng là tạo ra một trải nghiệm lập trình liền mạch, nơi AI luôn sẵn sàng hỗ trợ, bất kể tình trạng kết nối internet của bạn.

Việc hiểu rõ về AI offline coding không chỉ giúp bạn làm việc hiệu quả hơn mà còn mở ra những khả năng mới trong việc phát triển phần mềm trong các môi trường hạn chế. Nó thúc đẩy sự đổi mới trong cách chúng ta tương tác với AI và cách chúng ta xây dựng các công cụ lập trình thế hệ mới.

Thực Hành AI Offline Coding: Các Công Cụ và Cách Cài Đặt

Để bắt đầu với AI offline coding, bạn cần chọn lựa các công cụ phù hợp và biết cách cài đặt chúng. Dưới đây là một số lựa chọn nổi bật và hướng dẫn cơ bản:

1. Ollama và Mô Hình Mã Nguồn Mở (Code Llama, StarCoder)

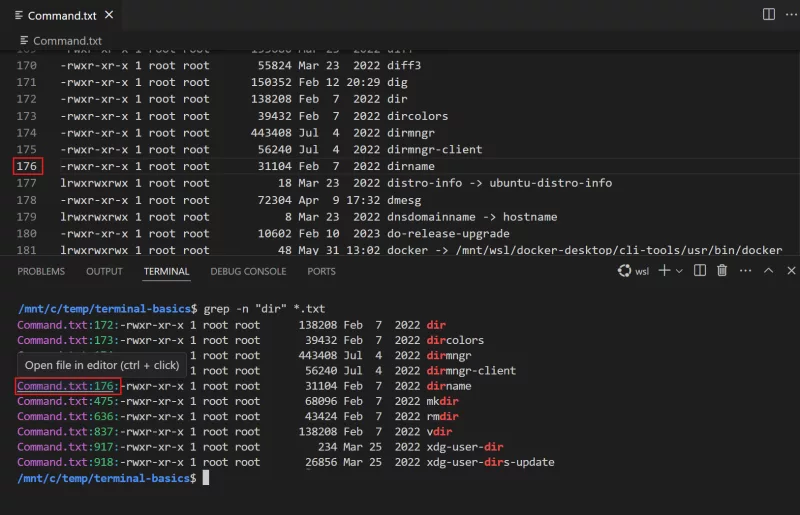

Ollama là một framework tuyệt vời cho phép bạn chạy các Large Language Models (LLMs) trên máy tính cục bộ một cách dễ dàng. Nó cung cấp giao diện dòng lệnh đơn giản để tải xuống và chạy các mô hình. Các mô hình như Code Llama, StarCoder, hoặc Deepseek Coder là những lựa chọn lý tưởng cho AI offline coding.

Cài đặt Ollama:

- Truy cập trang web chính thức của Ollama và tải xuống phiên bản phù hợp với hệ điều hành của bạn (macOS, Linux, Windows).

- Sau khi cài đặt, mở terminal và chạy lệnh để tải mô hình. Ví dụ, để tải Code Llama 7B:

ollama pull codellama - Để chạy mô hình và tương tác với nó:

ollama run codellama

Bạn có thể tích hợp Ollama với các IDE thông qua các plugin hoặc tự xây dựng các script nhỏ để gửi code và nhận gợi ý. Ví dụ, một script Python đơn giản để gửi prompt đến Ollama:

import requests

import json

def get_ollama_response(prompt, model="codellama"):

url = "http://localhost:11434/api/generate"

headers = {"Content-Type": "application/json"}

data = {"model": model, "prompt": prompt, "stream": False}

response = requests.post(url, headers=headers, data=json.dumps(data))

return response.json()["response"]

# Ví dụ sử dụng

code_prompt = "Write a Python function to calculate the factorial of a number."

response = get_ollama_response(code_prompt)

print(response)2. Local LLM IDE Integrations (Continue, CodeGPT)

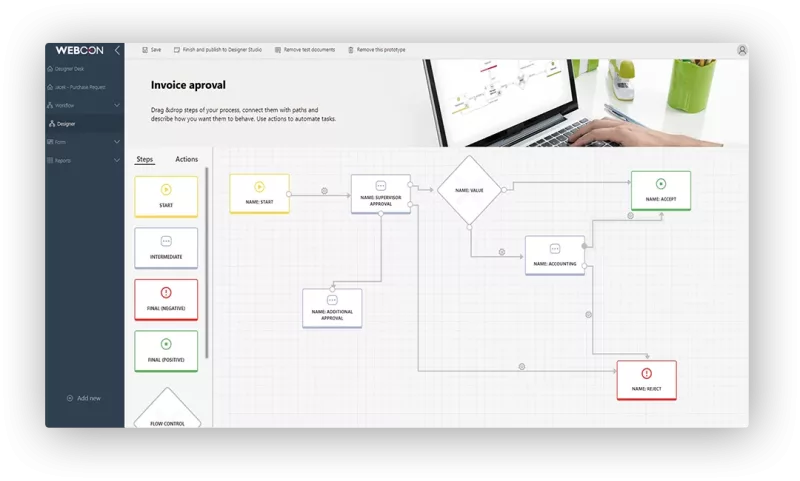

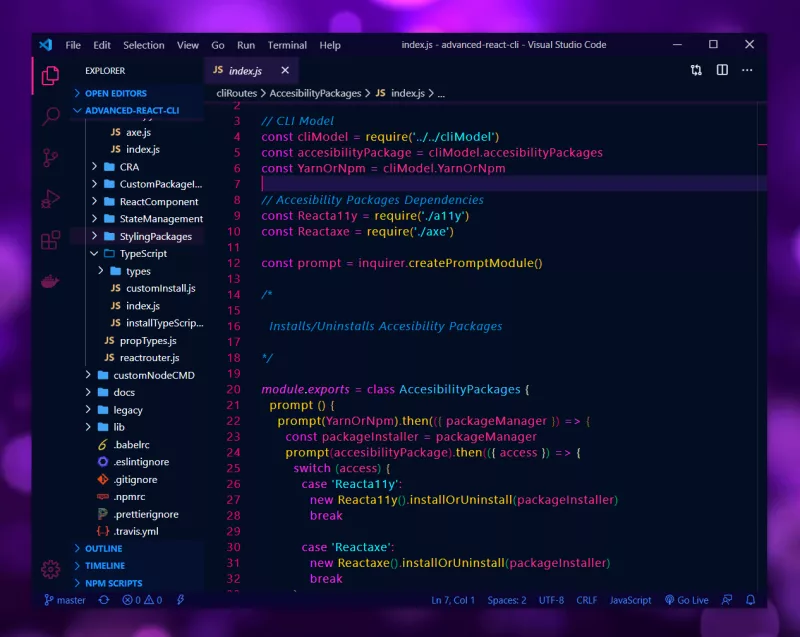

Một số plugin và extension cho các IDE phổ biến như VS Code đã bắt đầu hỗ trợ các LLM cục bộ. Chúng cho phép bạn nhận gợi ý code, hoàn thành code, và thậm chí là giải thích code mà không cần kết nối internet.

- Continue: Một plugin mạnh mẽ cho VS Code và JetBrains IDEs, hỗ trợ tích hợp nhiều LLM cục bộ thông qua Ollama, LM Studio, hoặc tự host các mô hình. Bạn có thể chat với AI, tạo code, refactor, và debug ngay trong IDE của mình.

- CodeGPT: Một plugin khác cho VS Code, ban đầu tập trung vào các API của OpenAI, nhưng đã mở rộng hỗ trợ cho các mô hình cục bộ.

Cài đặt và cấu hình Continue (ví dụ với VS Code):

- Mở VS Code, vào Extensions (

Ctrl+Shift+XhoặcCmd+Shift+X). - Tìm kiếm "Continue" và cài đặt.

- Sau khi cài đặt, mở bảng điều khiển Continue (thường là biểu tượng tia sét ở sidebar).

- Trong cài đặt Continue, bạn có thể chọn "Add Model" và cấu hình để sử dụng Ollama hoặc một local LLM khác. Ví dụ, chọn Ollama và chỉ định mô hình

codellamađã tải.

Với Continue, bạn có thể highlight một đoạn code và yêu cầu AI refactor nó, viết test, hoặc giải thích. Đây là một trải nghiệm AI offline coding thực sự mạnh mẽ.

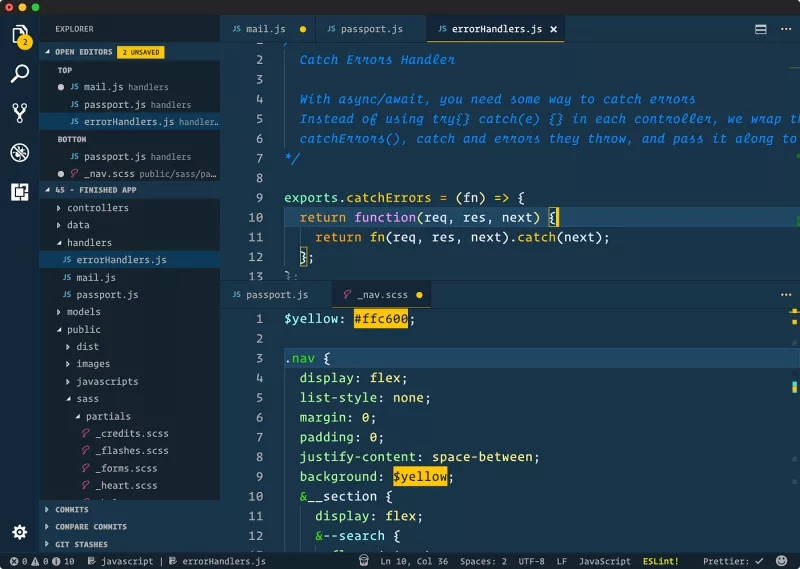

3. Các Công Cụ Phân Tích Code Tĩnh Nâng Cao

Mặc dù không phải là "generative AI" theo đúng nghĩa, các công cụ phân tích code tĩnh tích hợp các quy tắc phức tạp và đôi khi sử dụng machine learning để phát hiện lỗi, gợi ý cải tiến hiệu suất, và đảm bảo chất lượng code. Chúng thường hoạt động hoàn toàn offline.

- ESLint (JavaScript), Pylint (Python), SonarLint (đa ngôn ngữ): Các công cụ này có thể được cấu hình để chạy cục bộ, phân tích code của bạn trong thời gian thực và đưa ra các cảnh báo hoặc gợi ý.

Ví dụ, cấu hình .eslintrc.js cho JavaScript:

module.exports = {

env: {

browser: true,

es2021: true,

node: true,

},

extends: [

'eslint:recommended',

'plugin:react/recommended',

],

parserOptions: {

ecmaVersion: 'latest',

sourceType: 'module',

},

plugins: [

'react',

],

rules: {

'indent': ['error', 2],

'linebreak-style': ['error', 'unix'],

'quotes': ['error', 'single'],

'semi': ['error', 'always'],

},

};Với các công cụ này, bạn sẽ nhận được phản hồi tức thì về chất lượng code của mình, giúp bạn viết code sạch hơn và ít lỗi hơn, ngay cả khi không có kết nối internet. Đây là một khía cạnh quan trọng của AI offline coding, tập trung vào việc cải thiện chất lượng code.

Tips và Best Practices cho AI Offline Coding

Để tối ưu hóa trải nghiệm AI offline coding, có một số tips và best practices bạn nên áp dụng:

- Chọn Mô Hình Phù Hợp: Không phải mô hình nào cũng sinh ra để chạy offline. Ưu tiên các mô hình có kích thước nhỏ hơn (ví dụ: 7B hoặc 13B parameters) nhưng vẫn được tinh chỉnh tốt cho nhiệm vụ lập trình. Các mô hình như Code Llama, StarCoder 2, hoặc Deepseek Coder thường là lựa chọn tốt.

- Tối Ưu Hóa Phần Cứng: AI offline coding phụ thuộc nhiều vào CPU và RAM của máy tính bạn. Một CPU mạnh với nhiều core và ít nhất 16GB RAM (tốt nhất là 32GB) sẽ mang lại hiệu suất tốt hơn. Nếu có GPU (đặc biệt là NVIDIA với CUDA), bạn có thể tận dụng để tăng tốc độ suy luận đáng kể.

- Sử Dụng Containerization (Docker): Đối với các mô hình phức tạp hơn hoặc khi bạn muốn đảm bảo môi trường chạy ổn định, hãy cân nhắc sử dụng Docker. Điều này giúp bạn đóng gói mô hình và các dependency của nó, dễ dàng triển khai và quản lý.

- Tùy Chỉnh Prompt Hiệu Quả: Khi tương tác với AI offline coding, cách bạn đặt câu hỏi (prompt) rất quan trọng. Hãy cụ thể, rõ ràng, và cung cấp đủ ngữ cảnh. Ví dụ, thay vì "viết hàm này", hãy nói "viết một hàm Python tên là

calculate_averagenhận vào một list số nguyên và trả về giá trị trung bình". - Tích Hợp Vào Workflow Hiện Có: Đừng cố gắng thay đổi hoàn toàn workflow của bạn. Thay vào đó, hãy tìm cách tích hợp AI offline coding một cách tự nhiên. Sử dụng các plugin IDE để AI hoạt động như một trợ lý ngầm, gợi ý khi bạn gõ, hoặc chỉ sử dụng nó khi bạn cần một đoạn code cụ thể hoặc giải thích.

- Kiểm Tra và Xác Minh: AI, dù thông minh đến đâu, đôi khi vẫn mắc lỗi. Luôn kiểm tra kỹ lưỡng code do AI tạo ra, đảm bảo nó hoạt động đúng, hiệu quả và an toàn. Đừng chỉ copy-paste mà không hiểu rõ.

- Học Hỏi và Thích Nghi: Cộng đồng AI offline coding đang phát triển rất nhanh. Hãy theo dõi các dự án mã nguồn mở mới, các bản cập nhật của Ollama, và các plugin IDE để luôn cập nhật những công cụ và kỹ thuật tốt nhất.

Bằng cách tuân thủ những tips này, bạn sẽ tận dụng tối đa sức mạnh của AI offline coding, biến những lúc mất mạng thành cơ hội để tập trung và sáng tạo hơn.

So Sánh: AI Offline Coding vs. AI Online Coding

Để hiểu rõ hơn về giá trị của AI offline coding, chúng ta hãy so sánh nó với người anh em phổ biến hơn là AI online coding:

1. Hiệu Suất và Tốc Độ

- AI Online Coding: Thường có quyền truy cập vào các mô hình AI lớn hơn, mạnh hơn, được triển khai trên các cụm máy chủ với GPU chuyên dụng. Điều này có thể mang lại kết quả nhanh hơn và chính xác hơn cho các tác vụ phức tạp. Tuy nhiên, tốc độ phản hồi bị ảnh hưởng bởi độ trễ mạng (latency) và băng thông internet của bạn.

- AI Offline Coding: Tốc độ xử lý hoàn toàn phụ thuộc vào phần cứng cục bộ của bạn. Với phần cứng đủ mạnh, bạn có thể có phản hồi tức thì mà không có độ trễ mạng. Tuy nhiên, các mô hình thường nhỏ hơn, có thể không cung cấp độ chính xác hoặc khả năng sáng tạo bằng các mô hình online khổng lồ.

2. Bảo Mật và Quyền Riêng Tư

- AI Online Coding: Code của bạn (hoặc ít nhất là các prompt) được gửi lên máy chủ của nhà cung cấp dịch vụ AI. Điều này có thể gây lo ngại về bảo mật dữ liệu và quyền riêng tư, đặc biệt đối với các dự án nhạy cảm hoặc code độc quyền của công ty.

- AI Offline Coding: Mọi thứ diễn ra hoàn toàn trên máy tính của bạn. Code và dữ liệu không bao giờ rời khỏi môi trường cục bộ, mang lại mức độ bảo mật và quyền riêng tư cao nhất. Đây là một lợi thế lớn cho các lập trình viên làm việc với thông tin bí mật.

3. Chi Phí

- AI Online Coding: Thường hoạt động theo mô hình trả phí dựa trên việc sử dụng (token count), hoặc phí thuê bao hàng tháng/năm. Chi phí có thể tăng nhanh nếu bạn sử dụng nhiều.

- AI Offline Coding: Chi phí ban đầu là đầu tư vào phần cứng (nếu cần nâng cấp). Sau đó, bạn không phải trả phí cho mỗi lần sử dụng AI, làm cho nó trở thành một giải pháp kinh tế hơn về lâu dài, đặc biệt cho những người dùng cá nhân hoặc các nhóm nhỏ.

4. Khả Năng Tùy Biến và Kiểm Soát

- AI Online Coding: Thường ít khả năng tùy chỉnh. Bạn sử dụng mô hình "out-of-the-box" do nhà cung cấp cung cấp.

- AI Offline Coding: Mở ra nhiều cơ hội tùy biến hơn. Bạn có thể tinh chỉnh (fine-tune) các mô hình mã nguồn mở với dữ liệu code của riêng mình để chúng hiểu rõ hơn về phong cách và quy ước code của bạn. Bạn có toàn quyền kiểm soát môi trường và cách AI hoạt động.

5. Khả Năng Tiếp Cận và Phụ Thuộc

- AI Online Coding: Yêu cầu kết nối internet ổn định và đáng tin cậy. Nếu mất mạng, bạn hoàn toàn không thể sử dụng AI.

- AI Offline Coding: Hoạt động độc lập với kết nối internet. Đây là giải pháp lý tưởng cho những người làm việc di động, ở những nơi có kết nối mạng kém hoặc không có. Nó giảm thiểu sự phụ thuộc vào hạ tầng mạng bên ngoài.

Tóm lại, AI online coding mang lại sức mạnh và tiện lợi của các mô hình lớn, nhưng đi kèm với sự phụ thuộc vào internet và những lo ngại về bảo mật. Ngược lại, AI offline coding ưu tiên sự độc lập, bảo mật và kiểm soát, là lựa chọn tuyệt vời cho những ai cần sự ổn định và riêng tư, ngay cả khi phải đánh đổi một chút về quy mô mô hình.

Các Lưu Ý Quan Trọng Khi Triển Khai AI Offline Coding

- Yêu Cầu Phần Cứng: Đảm bảo máy tính của bạn có đủ RAM (ít nhất 16GB, lý tưởng là 32GB trở lên) và CPU mạnh. Nếu bạn có GPU tương thích (NVIDIA với CUDA), hiệu suất sẽ được cải thiện đáng kể.

- Dung Lượng Lưu Trữ: Các mô hình LLM có thể chiếm dung lượng từ vài GB đến hàng chục GB. Hãy chắc chắn ổ cứng của bạn có đủ không gian trống.

- Cập Nhật Thường Xuyên: Các công cụ và mô hình AI offline coding đang phát triển nhanh chóng. Cập nhật thường xuyên để nhận được các cải tiến về hiệu suất, tính năng và bản vá lỗi.

- Hiểu Giới Hạn của Mô Hình: Các mô hình nhỏ hơn chạy offline có thể không "thông minh" bằng các mô hình online khổng lồ. Chúng có thể gặp khó khăn với các tác vụ phức tạp, yêu cầu kiến thức rộng hoặc ngữ cảnh sâu.

- Quản Lý Tài Nguyên: Chạy LLM cục bộ có thể tiêu tốn nhiều tài nguyên. Theo dõi mức sử dụng CPU/GPU/RAM để tránh làm chậm hệ thống của bạn, đặc biệt khi chạy cùng lúc nhiều ứng dụng nặng khác.

- Bảo Mật Mô Hình: Mặc dù dữ liệu không rời khỏi máy tính, nhưng vẫn cần đảm bảo các mô hình bạn tải xuống là từ nguồn đáng tin cậy để tránh các rủi ro về mã độc.

- Học Cách Prompt Engineering: Kỹ năng đặt câu hỏi (prompt engineering) trở nên quan trọng hơn khi làm việc với các mô hình nhỏ hơn. Prompt càng chi tiết, kết quả càng chính xác.

Câu Hỏi Thường Gặp

AI offline coding có hoạt động tốt như các công cụ AI online không?

AI offline coding có thể không mạnh mẽ bằng các công cụ AI online lớn nhất như GPT-4 hoặc Claude 3 về khả năng sáng tạo và kiến thức tổng quát, nhưng nó hoạt động rất tốt cho các tác vụ lập trình cụ thể như hoàn thành code, sửa lỗi cú pháp, refactor code, và tạo ra các đoạn code boilerplate. Hiệu suất phụ thuộc nhiều vào mô hình bạn chọn và phần cứng máy tính của bạn.

Tôi có cần một GPU mạnh để sử dụng AI offline coding không?

Không bắt buộc, nhưng có GPU mạnh (đặc biệt là NVIDIA với CUDA) sẽ cải thiện đáng kể tốc độ suy luận của các mô hình LLM, giúp trải nghiệm mượt mà hơn. Nếu không có GPU, bạn vẫn có thể chạy các mô hình trên CPU, nhưng tốc độ có thể chậm hơn.

Tôi có thể tinh chỉnh (fine-tune) các mô hình AI offline coding với code của riêng mình không?

Có, đây là một trong những lợi thế lớn của AI offline coding. Bạn có thể fine-tune các mô hình mã nguồn mở như Code Llama hoặc StarCoder với tập dữ liệu code của riêng bạn để chúng hiểu rõ hơn về phong cách, quy ước và kiến trúc dự án của bạn, mang lại kết quả chính xác hơn.

AI offline coding có miễn phí không?

Phần lớn các công cụ và mô hình cho AI offline coding là mã nguồn mở và miễn phí để sử dụng (ví dụ: Ollama, Code Llama, Continue). Tuy nhiên, bạn có thể phải đầu tư vào phần cứng nếu máy tính hiện tại của bạn không đáp ứng đủ yêu cầu để chạy các mô hình lớn.

Kết Luận

AI offline coding không chỉ là một giải pháp tình thế khi mất mạng, mà còn là một phương pháp làm việc mạnh mẽ, an toàn và hiệu quả, đặc biệt phù hợp với những lập trình viên ưu tiên quyền riêng tư và sự độc lập. Bằng cách tận dụng các công cụ như Ollama, các mô hình LLM mã nguồn mở và các plugin IDE tích hợp, bạn có thể biến máy tính của mình thành một trung tâm phát triển AI mạnh mẽ, luôn sẵn sàng hỗ trợ bạn mọi lúc, mọi nơi. Khả năng làm việc không bị gián đoạn, bảo mật dữ liệu tuyệt đối và khả năng tùy biến cao là những ưu điểm vượt trội mà AI offline coding mang lại. Hãy bắt đầu khám phá và tích hợp nó vào workflow của bạn để trải nghiệm một phong cách lập trình mới mẻ và hiệu quả. Đừng quên ghé thăm vibe coding để cập nhật thêm nhiều kiến thức bổ ích về AI và lập trình nhé!