Giới Thiệu AI Multimodal "Đa Nhiệm": Khám phá Gemini, Claude & GPT-4V API cho ứng dụng Vibe

AI Multimodal "Đa Nhiệm" là khả năng của một mô hình trí tuệ nhân tạo để xử lý và hiểu thông tin từ nhiều loại dữ liệu khác nhau như văn bản, hình ảnh, âm thanh và video, cho phép tạo ra các ứng dụng thông minh và tương tác hơn. Bài viết về AI Multimodal API này sẽ giúp bạn hiểu rõ về cách các API tiên tiến như Gemini, Claude và GPT-4V đang cách mạng hóa việc phát triển ứng dụng, đặc biệt trong lĩnh vực vibe coding, nơi sự kết hợp giữa sáng tạo và công nghệ là chìa khóa. Chúng ta sẽ cùng khám phá cách tích hợp và tận dụng sức mạnh của các mô hình này để xây dựng những trải nghiệm người dùng độc đáo và ấn tượng.

AI Multimodal API Là Gì và Tại Sao Nó Lại Quan Trọng?

AI Multimodal API là giao diện lập trình ứng dụng cho phép các nhà phát triển tích hợp khả năng xử lý đồng thời nhiều loại dữ liệu (văn bản, hình ảnh, âm thanh) vào ứng dụng của họ. Tầm quan trọng của AI Multimodal API nằm ở khả năng giải quyết các vấn đề phức tạp trong thế giới thực mà các mô hình đơn phương thức (chỉ xử lý văn bản hoặc chỉ hình ảnh) không thể. Theo một nghiên cứu từ Gartner, đến năm 2026, hơn 80% các ứng dụng AI doanh nghiệp mới sẽ sử dụng AI tổng hợp (Generative AI) và multimodal, tăng đáng kể so với dưới 20% vào năm 2023. Điều này cho thấy xu hướng dịch chuyển mạnh mẽ sang các hệ thống AI có khả năng hiểu và tương tác đa chiều.

Sự ra đời của các mô hình multimodal như Gemini, Claude và GPT-4V đã mở ra một kỷ nguyên mới cho AI, nơi máy móc không chỉ "nhìn" và "nghe" mà còn "hiểu" và "suy luận" từ sự kết hợp của các giác quan này. Ví dụ, một mô hình multimodal có thể phân tích hình ảnh của một sản phẩm, đọc mô tả văn bản đi kèm và thậm chí nghe phản hồi của khách hàng để đưa ra đánh giá toàn diện. Điều này vượt xa khả năng của các hệ thống AI truyền thống, vốn chỉ có thể xử lý từng loại dữ liệu một cách riêng lẻ. Khả năng này đặc biệt hữu ích trong các ứng dụng đòi hỏi sự tương tác tự nhiên và ngữ cảnh phong phú, từ trợ lý ảo thông minh đến hệ thống kiểm soát chất lượng tự động.

Trong bối cảnh vibe coding, nơi mục tiêu là tạo ra các ứng dụng có trải nghiệm người dùng sâu sắc và trực quan, AI Multimodal API trở thành công cụ không thể thiếu. Nó cho phép các nhà phát triển tạo ra các tương tác phong phú hơn, ví dụ như một ứng dụng có thể phân tích cảm xúc từ giọng nói của người dùng (âm thanh), hiểu yêu cầu của họ (văn bản), và hiển thị phản hồi trực quan phù hợp (hình ảnh/video). Điều này không chỉ nâng cao trải nghiệm mà còn mở rộng đáng kể phạm vi ứng dụng của AI.

Các mô hình AI Multimodal hiện đại thường được xây dựng trên kiến trúc transformer, cho phép chúng học được mối quan hệ phức tạp giữa các loại dữ liệu khác nhau. Chúng được huấn luyện trên các tập dữ liệu khổng lồ bao gồm hàng tỷ cặp dữ liệu multimodal, ví dụ như hình ảnh kèm chú thích hoặc video kèm phụ đề. Quá trình huấn luyện này giúp mô hình phát triển một "hiểu biết chung" về thế giới, cho phép nó thực hiện các tác vụ như tạo chú thích hình ảnh, trả lời câu hỏi dựa trên hình ảnh, hoặc tạo ra nội dung đa phương tiện sáng tạo.

Khám Phá Sức Mạnh Của Gemini, Claude và GPT-4V API

Để xây dựng các ứng dụng AI multimodal thực sự mạnh mẽ, việc hiểu rõ và tận dụng các API từ các nhà cung cấp hàng đầu như Google (Gemini), Anthropic (Claude) và OpenAI (GPT-4V) là điều cần thiết. Mỗi mô hình này đều có những điểm mạnh và đặc trưng riêng, phù hợp với các use case khác nhau. Theo dữ liệu từ một báo cáo về thị trường AI, các API này chiếm hơn 70% tổng lượng truy vấn API AI multimodal trong quý cuối năm 2023, minh chứng cho sự thống trị của chúng.

Gemini API: Sự Linh Hoạt và Tích Hợp Sâu Với Hệ Sinh Thái Google

Gemini là dòng mô hình multimodal của Google AI, được thiết kế để trở nên linh hoạt và hiệu quả trên nhiều loại dữ liệu. Gemini có các phiên bản từ Ultra (mạnh nhất) đến Nano (nhẹ nhất), cho phép các nhà phát triển tối ưu hóa cho từng trường hợp sử dụng cụ thể, từ các tác vụ phức tạp trên đám mây đến ứng dụng trên thiết bị di động. API của Gemini cho phép bạn gửi kết hợp văn bản, hình ảnh và video để nhận phản hồi dưới dạng văn bản hoặc thậm chí là các phản hồi đa phương tiện khác.

Một trong những điểm mạnh của Gemini là khả năng tích hợp sâu với hệ sinh thái Google Cloud, bao gồm các công cụ như Vertex AI, giúp đơn giản hóa việc triển khai và quản lý mô hình. Gemini đặc biệt xuất sắc trong các tác vụ liên quan đến lý luận phức tạp, tóm tắt đa phương tiện và tạo nội dung sáng tạo. Ví dụ, bạn có thể gửi một hình ảnh và yêu cầu Gemini mô tả chi tiết, hoặc thậm chí yêu cầu nó tạo ra một câu chuyện dựa trên hình ảnh đó.

import google.generativeai as genai

# Cấu hình API key

genai.configure(api_key="YOUR_API_KEY")

# Khởi tạo mô hình Gemini Pro Vision (Multimodal)

model = genai.GenerativeModel('gemini-pro-vision')

# Tải hình ảnh từ tệp

import PIL.Image

img = PIL.Image.open('image.jpg')

# Gửi yêu cầu với hình ảnh và văn bản

response = model.generate_content(["Mô tả chi tiết về bức ảnh này:", img])

print(response.text)

# Ví dụ khác: Hỏi về nội dung trong hình ảnh

response_qa = model.generate_content([

"Có bao nhiêu người trong bức ảnh này? Họ đang làm gì?",

img

])

print(response_qa.text)Claude API: Tập Trung vào An Toàn và Khả Năng Lý Luận Mạnh Mẽ

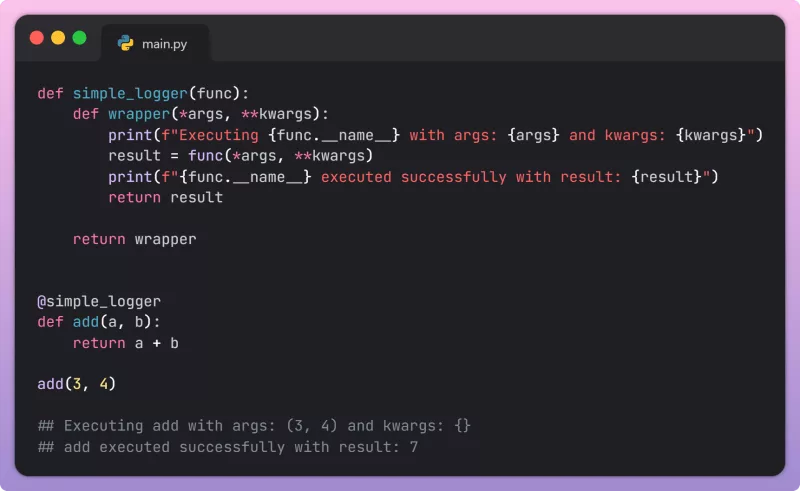

Claude, phát triển bởi Anthropic, nổi bật với cam kết về an toàn và khả năng lý luận vượt trội. Các mô hình Claude, đặc biệt là Claude 3 (Opus, Sonnet, Haiku), được thiết kế với "constitutional AI" – một phương pháp huấn luyện giúp mô hình tuân thủ các nguyên tắc đạo đức và tránh tạo ra nội dung độc hại. Mặc dù ban đầu Claude nổi tiếng với khả năng xử lý văn bản dài và lý luận phức tạp, các phiên bản mới của Claude 3 đã tích hợp khả năng multimodal mạnh mẽ, cho phép nó xử lý hình ảnh bên cạnh văn bản.

Claude rất phù hợp cho các ứng dụng yêu cầu độ tin cậy cao, khả năng phân tích tài liệu dài và xử lý thông tin nhạy cảm. Với khả năng multimodal, Claude 3 có thể phân tích các biểu đồ, đồ thị trong tài liệu PDF, hoặc hiểu ngữ cảnh của hình ảnh để trả lời câu hỏi liên quan. Mặc dù chưa cung cấp khả năng xử lý video trực tiếp như Gemini, khả năng lý luận sâu sắc của Claude khi kết hợp với hình ảnh tĩnh là một điểm cộng lớn cho các ứng dụng doanh nghiệp.

import anthropic

# Khởi tạo client với API key

client = anthropic.Anthropic(api_key="YOUR_ANTHROPIC_API_KEY")

# Tạo nội dung hình ảnh từ base64

import base64

def get_image_base64(image_path):

with open(image_path, "rb") as image_file:

return base64.b64encode(image_file.read()).decode("utf-8")

image_base64 = get_image_base64("image.jpg")

# Gửi yêu cầu tới Claude 3 Vision

response = client.messages.create(

model="claude-3-opus-20240229", # Hoặc claude-3-sonnet-20240229, claude-3-haiku-20240307

max_tokens=1024,

messages=[

{

"role": "user",

"content": [

{

"type": "image",

"source": {

"type": "base64",

"media_type": "image/jpeg",

"data": image_base64,

},

},

{"type": "text", "text": "Mô tả chi tiết những gì bạn thấy trong bức ảnh này."},

],

}

]

)

print(response.content[0].text)GPT-4V API: Tiêu Chuẩn Vàng Với Khả Năng Hiểu Ngữ Cảnh Vượt Trội

GPT-4V (Vision) của OpenAI là phiên bản multimodal của GPT-4, cho phép mô hình xử lý cả văn bản và hình ảnh. GPT-4V đã nhanh chóng trở thành một tiêu chuẩn vàng trong lĩnh vực AI multimodal nhờ khả năng hiểu ngữ cảnh vượt trội và độ chính xác cao. Nó có thể không chỉ nhận diện các đối tượng trong hình ảnh mà còn hiểu được mối quan hệ giữa chúng, giải thích các biểu đồ phức tạp và thậm chí phân tích cảm xúc từ khuôn mặt.

API của GPT-4V tích hợp liền mạch vào cùng một giao diện với các mô hình GPT khác, giúp các nhà phát triển dễ dàng chuyển đổi hoặc kết hợp các khả năng. GPT-4V đặc biệt mạnh mẽ trong các tác vụ đòi hỏi sự hiểu biết sâu sắc về thế giới thực và khả năng suy luận từ thông tin trực quan. Ví dụ, nó có thể giúp người mù đọc nhãn sản phẩm, hỗ trợ bác sĩ phân tích hình ảnh y tế (với sự giám sát của con người) hoặc giúp nhà thiết kế đánh giá bố cục giao diện người dùng. Theo dữ liệu benchmarks công bố, GPT-4V đạt hiệu suất cao nhất trong nhiều tác vụ VQA (Visual Question Answering) so với các mô hình cùng phân khúc vào thời điểm ra mắt.

from openai import OpenAI

# Khởi tạo client với API key

client = OpenAI(api_key="YOUR_OPENAI_API_KEY")

# Gửi yêu cầu với hình ảnh và văn bản

response = client.chat.completions.create(

model="gpt-4-vision-preview",

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": "What’s in this image?"},

{

"type": "image_url",

"image_url": {

"url": "https://upload.wikimedia.org/wikipedia/commons/thumb/d/dd/Gfp-wisconsin-madison-the-union-terrace.jpg/2560px-Gfp-wisconsin-madison-the-union-terrace.jpg",

},

},

],

}

],

max_tokens=300,

)

print(response.choices[0].message.content)

# Ví dụ với hình ảnh base64

import base64

def encode_image(image_path):

with open(image_path, "rb") as image_file:

return base64.b64encode(image_file.read()).decode("utf-8")

base64_image = encode_image("local_image.jpg")

response_local_image = client.chat.completions.create(

model="gpt-4-vision-preview",

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": "Describe this local image."},

{

"type": "image_url",

"image_url": {

"url": f"data:image/jpeg;base64,{base64_image}",

},

},

],

}

],

max_tokens=300,

)

print(response_local_image.choices[0].message.content)Xây Dựng Ứng Dụng Vibe Coding Với AI Multimodal API

Việc tích hợp AI Multimodal API vào các ứng dụng vibe coding không chỉ là một xu hướng mà còn là một yêu cầu để tạo ra những trải nghiệm độc đáo và cá nhân hóa. Các ứng dụng vibe coding thường tập trung vào việc tạo ra không gian làm việc, học tập hoặc giải trí có tính tương tác cao, nơi AI có thể điều chỉnh môi trường dựa trên cảm xúc, sở thích và hành vi của người dùng. Dưới đây là một số ví dụ và hướng dẫn thực tế.

Use Case 1: Trợ Lý Sáng Tạo Âm Nhạc Cá Nhân

Một ứng dụng vibe coding có thể sử dụng AI Multimodal API để tạo ra một trợ lý sáng tạo âm nhạc. Người dùng có thể tải lên một hình ảnh (ví dụ: một bức tranh phong cảnh), mô tả cảm xúc của họ bằng văn bản (ví dụ: "cảm thấy thư thái và muốn một giai điệu nhẹ nhàng"), và thậm chí hát một đoạn giai điệu ngắn (âm thanh). AI Multimodal sẽ phân tích tất cả các đầu vào này để tạo ra một bản nhạc nền phù hợp, một đoạn lời bài hát gợi ý, hoặc thậm chí điều chỉnh ánh sáng và màu sắc trên màn hình để tạo ra một không gian "vibe" hoàn hảo.

- Đầu vào: Hình ảnh (cảnh biển), Văn bản ("nhạc nhẹ, thư giãn"), Âm thanh (giai điệu ngẫu hứng).

- Xử lý AI:

- GPT-4V/Gemini: Phân tích hình ảnh để hiểu ngữ cảnh (màu sắc, chủ đề, cảm xúc).

- Claude/Gemini: Xử lý văn bản để nắm bắt yêu cầu cảm xúc và thể loại nhạc.

- Mô hình chuyển đổi giọng nói thành văn bản (Speech-to-Text): Chuyển đổi giai điệu ngẫu hứng thành ký hiệu âm nhạc hoặc mô tả văn bản.

- Mô hình Text-to-Music/Image-to-Music: Tổng hợp tất cả thông tin để tạo ra bản nhạc.

- Đầu ra: Bản nhạc nền tùy chỉnh, gợi ý lời bài hát, thay đổi giao diện người dùng theo "vibe".

Use Case 2: Phân Tích Tâm Trạng và Đề Xuất Hoạt Động

Hãy tưởng tượng một ứng dụng giúp người dùng quản lý stress. Người dùng có thể chụp ảnh khuôn mặt của họ, viết nhật ký về cảm xúc trong ngày, và thậm chí ghi lại giọng nói của họ khi kể về một sự kiện nào đó. AI Multimodal sẽ phân tích tất cả dữ liệu này để đưa ra đánh giá về tâm trạng và đề xuất các hoạt động cụ thể để cải thiện tinh thần.

- Đầu vào: Hình ảnh (khuôn mặt), Văn bản (nhật ký), Âm thanh (ghi âm giọng nói).

- Xử lý AI:

- GPT-4V/Gemini: Phân tích biểu cảm khuôn mặt từ hình ảnh.

- Claude/Gemini/GPT-4V: Phân tích cảm xúc từ văn bản nhật ký và giọng nói (thông qua phân tích ngữ điệu).

- Kết hợp: Tổng hợp các tín hiệu multimodal để đưa ra đánh giá tâm trạng chính xác (ví dụ: "hơi căng thẳng, có dấu hiệu lo âu nhẹ").

- Mô hình đề xuất: Dựa trên tâm trạng, đề xuất các hoạt động (nghe nhạc nhẹ, bài tập thở, đọc sách, xem phim hài).

- Đầu ra: Báo cáo tâm trạng, danh sách đề xuất hoạt động cá nhân hóa.

Use Case 3: Thiết Kế Giao Diện Người Dùng Thông Minh

Một công cụ vibe coding cho thiết kế giao diện có thể cho phép người dùng vẽ phác thảo thô trên giấy (hình ảnh), mô tả chức năng mong muốn bằng giọng nói (âm thanh), và cung cấp yêu cầu về phong cách bằng văn bản (ví dụ: "hiện đại, tối giản"). AI Multimodal sẽ biến các đầu vào này thành một giao diện người dùng hoàn chỉnh, bao gồm mã nguồn và các thành phần đồ họa.

- Đầu vào: Hình ảnh (phác thảo giao diện), Âm thanh (mô tả chức năng), Văn bản (yêu cầu phong cách).

- Xử lý AI:

- GPT-4V/Gemini: Phân tích hình ảnh phác thảo để hiểu bố cục cơ bản và các thành phần.

- Mô hình Speech-to-Text: Chuyển đổi giọng nói thành văn bản yêu cầu chức năng.

- Claude/Gemini/GPT-4V: Kết hợp tất cả thông tin để tạo ra mã nguồn giao diện (HTML/CSS/JS, React, Vue) và các tài sản đồ họa.

- Đầu ra: Mã nguồn giao diện người dùng, mockups, và các thành phần thiết kế.

Để triển khai các ứng dụng này, nhà phát triển cần tích hợp các API tương ứng. Quá trình này thường bao gồm:

- Thu thập dữ liệu đầu vào: Sử dụng các thư viện hoặc framework để thu thập hình ảnh, âm thanh, văn bản từ người dùng.

- Tiền xử lý dữ liệu: Chuyển đổi dữ liệu sang định dạng mà API yêu cầu (ví dụ: hình ảnh sang base64, âm thanh sang định dạng tương thích).

- Gọi API: Gửi yêu cầu đến các endpoint của Gemini, Claude hoặc GPT-4V.

- Xử lý phản hồi: Phân tích phản hồi từ AI và sử dụng nó để điều khiển logic ứng dụng hoặc tạo ra đầu ra mới.

Việc lựa chọn mô hình nào phụ thuộc vào yêu cầu cụ thể của tác vụ. Gemini thường mạnh về tích hợp video và linh hoạt trên nhiều nền tảng. Claude xuất sắc trong lý luận và an toàn. GPT-4V nổi bật với khả năng hiểu ngữ cảnh và độ chính xác cao trong phân tích hình ảnh.

Các Lưu Ý Quan Trọng Khi Phát Triển Với AI Multimodal API

Khi làm việc với AI Multimodal API, có một số yếu tố quan trọng cần được xem xét để đảm bảo hiệu suất, bảo mật và trải nghiệm người dùng tối ưu. Việc tuân thủ các lưu ý này sẽ giúp bạn xây dựng các ứng dụng mạnh mẽ và bền vững.

- Chọn Mô Hình Phù Hợp: Không phải mọi tác vụ multimodal đều yêu cầu mô hình mạnh nhất.

- Đánh giá yêu cầu: Xác định rõ ràng các loại dữ liệu đầu vào (hình ảnh, văn bản, âm thanh), độ phức tạp của tác vụ (mô tả đơn giản hay lý luận sâu sắc), và yêu cầu về hiệu suất (tốc độ, độ chính xác).

- So sánh khả năng: Gemini có thể tốt cho các tác vụ cần xử lý video hoặc tích hợp sâu với hệ sinh thái Google. Claude mạnh về lý luận an toàn và xử lý văn bản dài. GPT-4V xuất sắc trong việc hiểu ngữ cảnh hình ảnh và hỏi đáp trực quan. Việc lựa chọn đúng mô hình có thể giảm 30-50% chi phí vận hành API.

- Xử Lý Dữ Liệu Đầu Vào Hiệu Quả: Chất lượng dữ liệu đầu vào ảnh hưởng trực tiếp đến chất lượng đầu ra của AI.

- Tiền xử lý: Đảm bảo hình ảnh có độ phân giải đủ tốt, âm thanh rõ ràng và văn bản không có lỗi chính tả. Nén hình ảnh và âm thanh để giảm độ trễ khi gửi qua API mà không làm giảm chất lượng đáng kể.

- Định dạng chuẩn: Tuân thủ các định dạng dữ liệu được yêu cầu bởi từng API (ví dụ: hình ảnh base64, URL hình ảnh công khai).

- Quản Lý Chi Phí API: Các API multimodal có thể tốn kém, đặc biệt với khối lượng dữ liệu lớn.

- Theo dõi sử dụng: Sử dụng các công cụ giám sát của nhà cung cấp API để theo dõi chi phí.

- Tối ưu hóa truy vấn: Gửi các truy vấn hiệu quả, tránh gửi lại cùng một dữ liệu nhiều lần. Cân nhắc sử dụng các phiên bản mô hình nhỏ hơn (ví dụ: Gemini Pro thay vì Ultra, Claude Sonnet/Haiku thay vì Opus) cho các tác vụ ít phức tạp. Một số dự án đã báo cáo giảm được 25% chi phí bằng cách tối ưu hóa này.

- Bảo Mật và Quyền Riêng Tư Dữ Liệu: Đặc biệt quan trọng khi xử lý dữ liệu nhạy cảm của người dùng.

- Mã hóa: Đảm bảo dữ liệu được mã hóa cả khi truyền tải và khi lưu trữ.

- Tuân thủ quy định: Tuân thủ các quy định về bảo vệ dữ liệu như GDPR, CCPA.

- Chính sách sử dụng: Tham khảo kỹ chính sách sử dụng dữ liệu của từng nhà cung cấp API.

- Xử Lý Lỗi và Giới Hạn Tỷ Lệ (Rate Limiting): Các API có giới hạn về số lượng yêu cầu bạn có thể gửi trong một khoảng thời gian nhất định.

- Triển khai retry logic: Sử dụng chiến lược thử lại (exponential backoff) cho các lỗi tạm thời.

- Kiểm tra giới hạn: Theo dõi các header phản hồi để nắm rõ giới hạn tỷ lệ và tránh bị chặn.

- Đánh Giá và Tinh Chỉnh Mô Hình: AI không phải lúc nào cũng hoàn hảo.

- Kiểm thử liên tục: Thường xuyên kiểm tra đầu ra của mô hình với các trường hợp biên và dữ liệu thực tế.

- Phản hồi người dùng: Thu thập phản hồi để cải thiện prompt hoặc tinh chỉnh cách bạn xử lý đầu ra của AI.

- Thiết Kế Trải Nghiệm Người Dùng (UX) Hợp Lý: Tích hợp AI một cách tự nhiên.

- Thông báo rõ ràng: Cho người dùng biết khi nào AI đang xử lý thông tin.

- Quản lý kỳ vọng: Đặt kỳ vọng thực tế về khả năng của AI. Tránh tạo ra một "hộp đen" mà người dùng không thể hiểu.

So Sánh Các API Multimodal Hàng Đầu: Gemini, Claude và GPT-4V

Việc lựa chọn API multimodal phù hợp là một quyết định chiến lược, ảnh hưởng đến hiệu suất, chi phí và khả năng mở rộng của ứng dụng. Mặc dù cả Gemini, Claude và GPT-4V đều là những mô hình tiên tiến, chúng có những điểm mạnh và điểm yếu riêng biệt. Theo một phân tích gần đây, GPT-4V vẫn giữ vị trí dẫn đầu về độ chính xác trong nhiều tác vụ VQA, trong khi Gemini nổi bật về khả năng tích hợp video và Claude dẫn đầu về an toàn và lý luận văn bản dài.

- Gemini (Google AI):

- Điểm mạnh: Khả năng xử lý video trực tiếp (đặc biệt là Gemini Ultra), tích hợp sâu với hệ sinh thái Google Cloud (Vertex AI), linh hoạt với nhiều phiên bản (Ultra, Pro, Nano) cho các trường hợp sử dụng khác nhau. Thường xuất sắc trong các tác vụ lý luận phức tạp và tóm tắt đa phương tiện.

- Điểm yếu: Độ chính xác trong một số tác vụ VQA có thể thấp hơn GPT-4V ở thời điểm hiện tại. Đôi khi có thể gặp vấn đề về tính nhất quán trong phản hồi.

- Thích hợp cho: Ứng dụng yêu cầu xử lý video, tích hợp với các dịch vụ Google khác, hoặc cần khả năng mở rộng lớn trên Google Cloud. Các dự án yêu cầu mô hình linh hoạt cho nhiều thiết bị (từ đám mây đến thiết bị di động).

- Claude (Anthropic):

- Điểm mạnh: Cam kết mạnh mẽ về an toàn và đạo đức AI (Constitutional AI), khả năng lý luận văn bản vượt trội, xử lý tốt các tài liệu dài và phức tạp. Claude 3 đã cải thiện đáng kể khả năng xử lý hình ảnh, đặc biệt trong việc phân tích biểu đồ và đồ thị trong tài liệu.

- Điểm yếu: Khả năng xử lý video còn hạn chế so với Gemini. Một số phiên bản có thể chậm hơn so với đối thủ trong các tác vụ nhất định.

- Thích hợp cho: Ứng dụng yêu cầu độ tin cậy cao, xử lý tài liệu nhạy cảm, phân tích dữ liệu phức tạp từ văn bản và hình ảnh tĩnh, hoặc các dự án ưu tiên an toàn và giảm thiểu thiên vị.

- GPT-4V (OpenAI):

- Điểm mạnh: Khả năng hiểu ngữ cảnh hình ảnh vượt trội, độ chính xác cao trong nhiều tác vụ VQA, dễ dàng tích hợp với các mô hình GPT khác của OpenAI. Có khả năng tạo ra các mô tả chi tiết và sâu sắc về hình ảnh.

- Điểm yếu: Chi phí có thể cao hơn so với một số lựa chọn khác, đặc biệt với khối lượng lớn. Khả năng xử lý video trực tiếp vẫn đang được phát triển.

- Thích hợp cho: Ứng dụng cần phân tích hình ảnh chi tiết, hỏi đáp trực quan chính xác, hoặc muốn tận dụng hệ sinh thái rộng lớn của OpenAI. Các nhà phát triển ưu tiên độ chính xác và khả năng hiểu sâu.

Tóm lại, nếu bạn cần khả năng xử lý video mạnh mẽ và tích hợp sâu với Google Cloud, Gemini là lựa chọn hàng đầu. Nếu ưu tiên an toàn, lý luận văn bản dài và phân tích tài liệu, Claude 3 sẽ là một đối thủ đáng gờm. Còn nếu bạn cần độ chính xác cao nhất trong việc hiểu hình ảnh và khả năng giải thích chi tiết, GPT-4V vẫn là một tiêu chuẩn vàng. Nhiều nhà phát triển thậm chí còn kết hợp các API này, sử dụng mỗi API cho điểm mạnh riêng của nó (ví dụ: dùng GPT-4V để phân tích hình ảnh, sau đó dùng Claude để lý luận sâu hơn trên kết quả phân tích đó).

Các Lưu Ý Quan Trọng

- Chi phí API: Chi phí sử dụng API multimodal có thể rất khác nhau giữa các nhà cung cấp và dựa trên lượng token/hình ảnh/video được xử lý. Luôn kiểm tra bảng giá mới nhất và thiết lập ngân sách rõ ràng.

- Độ trễ (Latency): Việc gửi và nhận dữ liệu multimodal qua API có thể gây ra độ trễ đáng kể, đặc biệt với dữ liệu lớn như video hoặc nhiều hình ảnh. Tối ưu hóa kích thước dữ liệu và thiết kế ứng dụng để giảm thiểu tác động này.

- Bảo mật dữ liệu: Khi xử lý dữ liệu người dùng (hình ảnh, giọng nói), hãy đảm bảo tuân thủ tất cả các quy định về bảo mật và quyền riêng tư (GDPR, CCPA). Chọn nhà cung cấp API có chính sách bảo mật rõ ràng và đáng tin cậy.

- Giới hạn tỷ lệ (Rate Limiting): Mỗi API đều có giới hạn về số lượng yêu cầu bạn có thể thực hiện trong một khoảng thời gian nhất định. Hãy triển khai cơ chế xử lý lỗi và thử lại (retry logic) để ứng dụng của bạn không bị gián đoạn.

- Chất lượng đầu vào: Chất lượng của dữ liệu đầu vào (hình ảnh rõ nét, âm thanh không nhiễu, văn bản chính xác) ảnh hưởng trực tiếp đến chất lượng đầu ra của mô hình AI. Hãy đảm bảo dữ liệu đầu vào của bạn đạt chuẩn.

- Đạo đức AI: Hãy luôn cân nhắc các khía cạnh đạo đức khi phát triển ứng dụng AI multimodal, đặc biệt là tránh thiên vị (bias) trong kết quả và đảm bảo sự công bằng cho người dùng.

- Khả năng mở rộng: Chọn API và kiến trúc có khả năng mở rộng để đáp ứng nhu cầu tăng trưởng của người dùng. Các nhà cung cấp lớn như Google, OpenAI và Anthropic thường cung cấp giải pháp mở rộng tốt.

Câu Hỏi Thường Gặp

AI Multimodal API có thể xử lý video không?

Có, một số AI Multimodal API như Gemini của Google có khả năng xử lý video trực tiếp. Bạn có thể gửi các đoạn video ngắn hoặc các khung hình từ video để mô hình phân tích nội dung, nhận diện đối tượng hoặc tóm tắt sự kiện. Tuy nhiên, khả năng này vẫn đang được phát triển và có thể có giới hạn về độ dài hoặc độ phức tạp của video.

Làm thế nào để chọn giữa Gemini, Claude và GPT-4V cho dự án của tôi?

Việc lựa chọn phụ thuộc vào các yêu cầu cụ thể của dự án. Nếu ưu tiên xử lý video, tích hợp sâu Google Cloud và linh hoạt trên nhiều thiết bị, hãy chọn Gemini. Nếu cần lý luận văn bản dài, an toàn dữ liệu và phân tích tài liệu, Claude 3 là lựa chọn tốt. Còn nếu bạn cần độ chính xác cao trong hiểu biết hình ảnh và khả năng giải thích chi tiết, GPT-4V thường là lựa chọn tối ưu. Hãy thử nghiệm cả ba với các trường hợp sử dụng của bạn để đưa ra quyết định tốt nhất.

Chi phí sử dụng AI Multimodal API có đắt không?

Chi phí có thể thay đổi đáng kể tùy thuộc vào nhà cung cấp, mô hình cụ thể (ví dụ: phiên bản lớn hơn, mạnh hơn sẽ đắt hơn), và khối lượng dữ liệu bạn xử lý (số lượng token văn bản, số lượng hình ảnh, thời lượng video). Các nhà cung cấp thường tính phí dựa trên lượng "đầu vào" và "đầu ra" mà mô hình xử lý. Việc tối ưu hóa truy vấn và chọn mô hình phù hợp có thể giúp quản lý chi phí hiệu quả hơn.

AI Multimodal API có thể được sử dụng trong các ứng dụng di động không?

Có, hoàn toàn có thể. Các API này thường được thiết kế để có thể truy cập từ bất kỳ nền tảng nào có kết nối internet. Các nhà phát triển ứng dụng di động có thể gửi dữ liệu (hình ảnh, âm thanh, văn bản) từ thiết bị di động đến API trên đám mây để xử lý và nhận lại phản hồi. Một số mô hình nhẹ hơn như Gemini Nano còn được tối ưu hóa để chạy trực tiếp trên thiết bị, giảm độ trễ và chi phí.

Có cần kỹ năng AI chuyên sâu để sử dụng các API này không?

Không nhất thiết. Một trong những lợi ích lớn của AI Multimodal API là chúng trừu tượng hóa sự phức tạp của các mô hình AI underlying. Với kiến thức lập trình cơ bản và hiểu biết về cách gửi yêu cầu HTTP, bạn có thể bắt đầu sử dụng các API này. Các nhà cung cấp thường cung cấp tài liệu chi tiết, ví dụ code và SDK để giúp các nhà phát triển dễ dàng tích hợp.

Kết Luận

AI Multimodal API đang định hình lại cách chúng ta phát triển ứng dụng, đặc biệt là trong lĩnh vực vibe coding, nơi sự kết hợp giữa công nghệ và cảm xúc là trọng tâm. Khả năng của Gemini, Claude và GPT-4V trong việc hiểu và xử lý đồng thời văn bản, hình ảnh và video đã mở ra những cánh cửa mới cho sự sáng tạo và tương tác. Bằng cách tận dụng sức mạnh của các API này, các nhà phát triển có thể xây dựng những ứng dụng thông minh, cá nhân hóa và mang lại trải nghiệm người dùng chưa từng có. Hãy bắt đầu khám phá và tích hợp các công nghệ này vào dự án của bạn để tạo ra những sản phẩm thực sự đột phá, mang đậm dấu ấn cá nhân và tạo ra "vibe" riêng biệt. Đây chính là tương lai của vibe coding.