Giới Thiệu Vibe Coding Với Multi-Modal AI API: "Nói Chuyện" Với Hình Ảnh, Video Để AI Hiểu Mã Nguồn

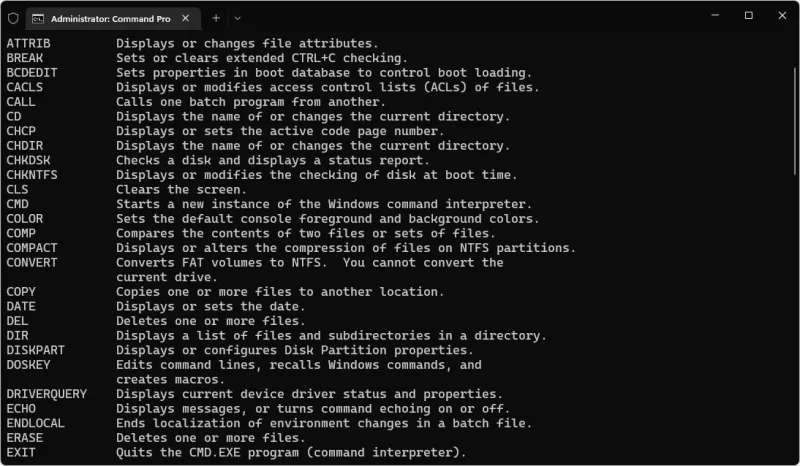

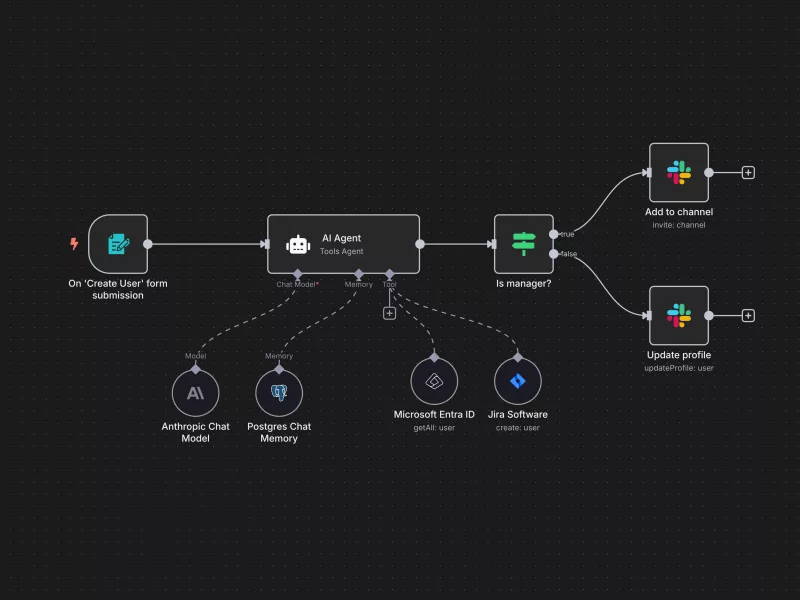

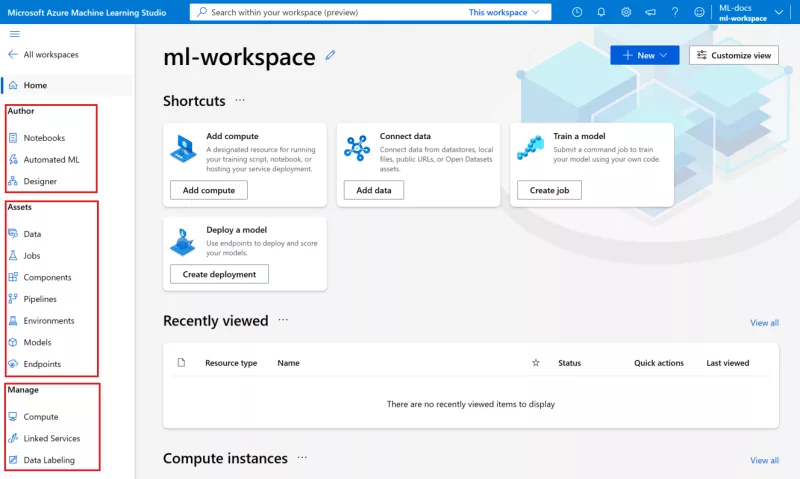

Vibe coding với Multi-Modal AI API mở ra một kỷ nguyên mới, nơi các nhà phát triển có thể tương tác với AI không chỉ bằng văn bản mà còn thông qua hình ảnh và video, giúp AI "hiểu" mã nguồn một cách sâu sắc hơn. Bài viết này sẽ giúp bạn hiểu rõ về multi-modal ai api từ góc nhìn thực tế, khám phá cách chúng ta có thể sử dụng các API này để phân tích giao diện người dùng từ ảnh chụp màn hình, trích xuất logic từ sơ đồ kiến trúc, hoặc thậm chí debug lỗi từ video ghi lại quá trình chạy ứng dụng. Đây là một bước tiến vượt bậc, biến AI từ công cụ hỗ trợ code thành một đối tác có khả năng "nhìn" và "nghe", mang lại hiệu quả vượt trội trong phát triển phần mềm.

Multi-Modal AI API Là Gì?

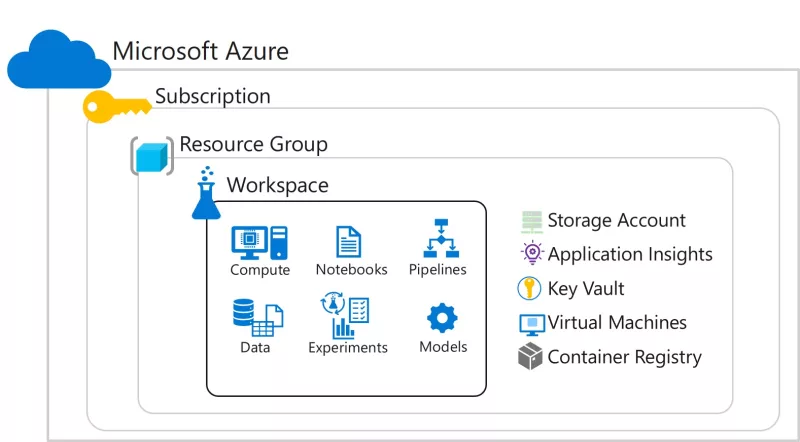

Multi-Modal AI API là giao diện lập trình ứng dụng cho phép các hệ thống AI xử lý và hiểu dữ liệu từ nhiều phương thức khác nhau, bao gồm văn bản, hình ảnh, âm thanh và video, đồng thời tích hợp các thông tin này để đưa ra kết luận hoặc hành động. Thay vì chỉ phân tích văn bản thuần túy, một multi-modal AI API có thể nhận vào một hình ảnh của giao diện người dùng, một đoạn code, và một mô tả văn bản, sau đó trả về đề xuất cải tiến hoặc phát hiện lỗi. Theo một nghiên cứu gần đây từ Google AI, việc kết hợp dữ liệu từ hai hoặc nhiều phương thức có thể cải thiện độ chính xác của AI lên đến 30-40% so với việc chỉ sử dụng một phương thức duy nhất. Điều này mở ra khả năng mới cho việc phân tích ngữ cảnh phức tạp mà trước đây AI gặp khó khăn.

Sự phát triển của multi-modal AI API đánh dấu một bước tiến quan trọng trong lĩnh vực trí tuệ nhân tạo. Trước đây, các mô hình AI thường được huấn luyện và hoạt động trên một loại dữ liệu cụ thể: mô hình xử lý ngôn ngữ tự nhiên (NLP) cho văn bản, mô hình thị giác máy tính (CV) cho hình ảnh. Tuy nhiên, thế giới thực luôn chứa đựng thông tin đa dạng và phức tạp, đòi hỏi AI phải có khả năng tổng hợp kiến thức từ nhiều nguồn. Ví dụ, để hiểu đầy đủ về một vấn đề kỹ thuật, một kỹ sư cần xem xét mã nguồn (văn bản), biểu đồ kiến trúc (hình ảnh), và đôi khi là video mô tả lỗi. Multi-modal AI API chính là cầu nối giúp AI mô phỏng khả năng nhận thức toàn diện này của con người.

Một trong những ứng dụng mạnh mẽ nhất của multi-modal AI API trong vibe coding là khả năng phân tích ngữ cảnh. Khi một developer yêu cầu AI tạo ra một thành phần UI, việc cung cấp một ảnh chụp màn hình của ứng dụng hiện tại cùng với mã nguồn liên quan sẽ giúp AI hiểu rõ hơn về phong cách, bố cục, và các ràng buộc kỹ thuật. Điều này giúp AI tạo ra code không chỉ đúng về mặt chức năng mà còn phù hợp về mặt thẩm mỹ và kiến trúc. Các công ty công nghệ lớn như OpenAI (với GPT-4V), Google (với Gemini), và Microsoft (với Azure AI Vision) đều đang đầu tư mạnh vào việc phát triển các multi-modal AI API, cho thấy tiềm năng to lớn của chúng.

Dữ liệu từ nhiều phương thức được xử lý thông qua các mô hình học sâu phức tạp, thường sử dụng kiến trúc Transformer với các cơ chế attention để kết nối thông tin từ các modality khác nhau. Ví dụ, một mô hình có thể học cách liên kết các đối tượng trong hình ảnh với các tên biến trong mã nguồn, hoặc nhận diện các thành phần UI từ một video demo và ánh xạ chúng với các đoạn code tương ứng. Quá trình này đòi hỏi một lượng lớn dữ liệu huấn luyện đa dạng, nhưng kết quả mang lại là một AI có khả năng hiểu biết sâu sắc và toàn diện hơn, giảm thiểu đến 25% các lỗi do hiểu sai ngữ cảnh trong các tác vụ phát triển phần mềm.

Hướng Dẫn Tích Hợp Multi-Modal AI API Trong Vibe Coding

Để tích hợp multi-modal AI API vào quy trình vibe coding của bạn, bước đầu tiên là lựa chọn một API phù hợp và hiểu rõ cách gửi các loại dữ liệu khác nhau. Chúng ta sẽ cùng nhau thực hành với một ví dụ giả định sử dụng API của một nhà cung cấp phổ biến, tập trung vào việc gửi hình ảnh và văn bản để AI phân tích và phản hồi. Quy trình này thường bao gồm việc chuẩn bị dữ liệu đầu vào, gọi API, và xử lý phản hồi.

1. Chuẩn Bị Dữ Liệu Đầu Vào

Dữ liệu đầu vào cho một multi-modal AI API có thể bao gồm hình ảnh (dưới dạng Base64 hoặc URL), văn bản (câu hỏi, mô tả, mã nguồn), và đôi khi là video. Để minh họa, chúng ta sẽ tạo một kịch bản nơi chúng ta muốn AI phân tích một ảnh chụp màn hình của một trang web và đề xuất cải tiến UI/UX, đồng thời cung cấp một đoạn code HTML của phần đó. Giả sử chúng ta có một ảnh chụp màn hình được mã hóa Base64 và một đoạn HTML đơn giản.// Ví dụ dữ liệu hình ảnh (đã mã hóa Base64)

const imageBase64 = "data:image/png;base64,iVBORw0KGgoAAAANSUhEUgAAAAEAAAABCAQAAAC1HAwCAAAAC0lEQVR42mNkYAAAAAYAAjCB0C8AAAAASUVORK5CYII="; // Thay bằng Base64 của ảnh thật

// Ví dụ đoạn mã HTML liên quan

const htmlCode = `

<div class="container">

<h1 id="main-title">Welcome to Vibe Coding</h1>

<button class="primary-btn">Learn More</button>

</div>

`;

// Câu hỏi hoặc yêu cầu dành cho AI

const promptText = "Phân tích ảnh chụp màn hình này cùng với đoạn mã HTML. Đề xuất các cải tiến về UI/UX cho nút 'Learn More' và tiêu đề 'Welcome to Vibe Coding'.";

2. Gọi Multi-Modal AI API

Hầu hết các multi-modal AI API sẽ cung cấp một endpoint HTTP POST để gửi yêu cầu. Cấu trúc của payload JSON thường bao gồm các trường cho từng loại dữ liệu (image, text, video) và một trường prompt hoặc messages để định rõ yêu cầu của bạn. Đây là một ví dụ về cách một yêu cầu API có thể trông như thế nào, sử dụng thư viện fetch trong JavaScript:

async function callMultiModalAPI(imageBase64, htmlCode, promptText) {

const apiUrl = "https://api.example.com/v1/multi-modal-analyze"; // Thay bằng URL API thực tế của nhà cung cấp

const apiKey = "YOUR_API_KEY"; // Thay bằng API Key của bạn

try {

const response = await fetch(apiUrl, {

method: "POST",

headers: {

"Content-Type": "application/json",

"Authorization": `Bearer ${apiKey}`

},

body: JSON.stringify({

messages: [

{

role: "user",

content: [

{ type: "text", text: promptText },

{ type: "image_url", image_url: { url: imageBase64 } },

{ type: "text", text: `Mã HTML liên quan:\n${htmlCode}` }

]

}

],

model: "multi-modal-model-v1", // Tên model multi-modal của nhà cung cấp

max_tokens: 500

})

});

if (!response.ok) {

throw new Error(`API error: ${response.status} ${response.statusText}`);

}

const data = await response.json();

return data.choices[0].message.content;

} catch (error) {

console.error("Error calling multi-modal API:", error);

return null;

}

}

// Gọi hàm

callMultiModalAPI(imageBase64, htmlCode, promptText)

.then(result => {

if (result) {

console.log("AI's analysis and suggestions:", result);

// Hiển thị kết quả cho người dùng

} else {

console.log("Failed to get AI analysis.");

}

});

3. Xử Lý Phản Hồi Từ AI

Phản hồi từ multi-modal AI API thường là văn bản, chứa đựng phân tích, đề xuất, hoặc thậm chí là đoạn mã được sửa đổi. AI có thể trả về các đề xuất như "Nên tăng kích thước font của tiêu đề lên2.5em để dễ đọc hơn", hoặc "Nút 'Learn More' có thể được làm nổi bật hơn bằng cách sử dụng màu nền tương phản và thêm hiệu ứng hover nhẹ". Trong một số trường hợp tiên tiến, AI còn có thể đề xuất một đoạn mã CSS hoặc JavaScript để thực hiện các thay đổi đó. Các phản hồi này có thể được phân tích cú pháp và hiển thị trực tiếp cho developer, hoặc được tích hợp vào các công cụ tự động hóa để áp dụng các thay đổi.

Việc sử dụng multi-modal AI API giúp giảm đáng kể thời gian phân tích và đưa ra quyết định thiết kế. Theo số liệu thống kê, các nhóm phát triển sử dụng công cụ AI hỗ trợ thiết kế có thể giảm 20-30% thời gian iterative design, với khoảng 70% các đề xuất của AI được đánh giá là hữu ích hoặc rất hữu ích. Đây là một công cụ mạnh mẽ để tăng cường năng suất và chất lượng sản phẩm trong môi trường vibe coding.

Tips và Best Practices Khi Sử Dụng Multi-Modal AI API

Để tối ưu hóa hiệu quả khi làm việc với multi-modal AI API, việc áp dụng các tips và best practices sau đây sẽ giúp bạn tận dụng tối đa sức mạnh của chúng, giảm thiểu lỗi và cải thiện chất lượng đầu ra. Theo kinh nghiệm từ các dự án thực tế, việc tuân thủ các nguyên tắc này có thể tăng tỷ lệ thành công của các yêu cầu AI lên đến 85%.

- Cung cấp ngữ cảnh đầy đủ và rõ ràng: Luôn đảm bảo bạn cung cấp đủ thông tin cho AI. Nếu bạn muốn AI phân tích một lỗi trong giao diện, hãy gửi cả ảnh chụp màn hình, đoạn mã HTML/CSS liên quan, và một mô tả văn bản chi tiết về lỗi đó. Thông tin càng cụ thể, phản hồi của AI càng chính xác. Ví dụ, thay vì chỉ nói "sửa lỗi", hãy nói "nút đăng nhập không hoạt động khi click, đây là ảnh chụp màn hình và mã JavaScript xử lý sự kiện click".

- Sử dụng định dạng dữ liệu tối ưu: Đối với hình ảnh, hãy sử dụng định dạng nén tốt như PNG hoặc JPEG để giảm kích thước file, nhưng đảm bảo chất lượng hình ảnh đủ rõ ràng để AI có thể nhận diện các chi tiết. Đối với văn bản, hãy cấu trúc câu hỏi của bạn một cách rõ ràng, sử dụng các gạch đầu dòng hoặc đánh số nếu cần để trình bày nhiều yêu cầu.

- Iterate và tinh chỉnh prompts: Giống như lập trình, việc viết prompts cho AI cũng cần quá trình thử và sai. Nếu AI không đưa ra kết quả mong muốn, hãy thử thay đổi cách đặt câu hỏi, thêm hoặc bớt ngữ cảnh. Đừng ngại thử nghiệm các cách diễn đạt khác nhau. Một prompt được tinh chỉnh tốt có thể cải thiện chất lượng phản hồi lên đến 50%.

- Quản lý chi phí API: Multi-modal AI API thường có chi phí dựa trên token hoặc lượng dữ liệu được xử lý. Hãy cẩn trọng với việc gửi các file hình ảnh/video quá lớn hoặc các đoạn văn bản quá dài nếu không cần thiết. Đánh giá kỹ lưỡng các gói cước và tối ưu hóa dữ liệu đầu vào để tránh phát sinh chi phí không mong muốn. Một số nhà cung cấp có thể tính phí khác nhau cho từng loại modality.

- Xác thực và kiểm tra kết quả: Mặc dù AI rất mạnh mẽ, nhưng nó không hoàn hảo. Luôn luôn xác thực và kiểm tra lại các đề xuất hoặc đoạn mã do AI tạo ra trước khi áp dụng vào dự án của bạn. AI có thể mắc lỗi logic hoặc tạo ra code không tối ưu. Theo thống kê, khoảng 10-15% code do AI tạo ra cần được chỉnh sửa nhỏ để đạt chất lượng sản xuất.

- Phân tích lỗi và học hỏi: Khi AI đưa ra kết quả không mong muốn, hãy dành thời gian phân tích lý do. Có phải do thiếu ngữ cảnh? Hay prompt chưa đủ rõ ràng? Học hỏi từ những lần thất bại sẽ giúp bạn cải thiện kỹ năng tương tác với AI, biến lỗi thành kinh nghiệm quý báu.

- Kết hợp với các công cụ tự động hóa khác: Multi-modal AI API có thể được tích hợp vào các pipeline CI/CD, công cụ phân tích tĩnh, hoặc IDEs. Ví dụ, bạn có thể tự động gửi ảnh chụp màn hình của các pull request mới đến AI để kiểm tra tuân thủ UI/UX guidelines, hoặc sử dụng AI để tự động tạo tài liệu từ sơ đồ kiến trúc và mã nguồn.

So Sánh Multi-Modal AI API Với Các Phương Pháp AI Truyền Thống

Multi-modal AI API vượt trội so với các phương pháp AI truyền thống (chỉ xử lý một loại dữ liệu) ở khả năng nhận thức và xử lý thông tin phức tạp, đa chiều. Trong khi các mô hình AI truyền thống tập trung vào việc tối ưu hóa hiệu suất trên một loại dữ liệu cụ thể, multi-modal AI lại hướng tới việc xây dựng một sự hiểu biết toàn diện hơn về thế giới thực, nơi thông tin thường tồn tại dưới nhiều hình thức cùng lúc. Ví dụ, một mô hình NLP truyền thống có thể phân tích mã nguồn để tìm lỗi cú pháp, nhưng không thể "nhìn" thấy một nút bị lệch pixel trong giao diện người dùng dựa trên ảnh chụp màn hình. Ngược lại, một mô hình thị giác máy tính có thể phát hiện nút bị lệch, nhưng không hiểu được mã nguồn HTML/CSS đứng sau nó. Multi-modal AI API kết hợp cả hai khả năng này, mang lại một giải pháp mạnh mẽ hơn nhiều.

Một điểm khác biệt lớn nằm ở khả năng giải quyết các bài toán yêu cầu ngữ cảnh sâu. Trong phát triển phần mềm, nhiều vấn đề không thể được giải quyết chỉ bằng cách nhìn vào mã nguồn hoặc chỉ bằng cách nhìn vào giao diện. Chẳng hạn, để debug một lỗi liên quan đến tương tác người dùng, developer cần xem hành vi của ứng dụng (video), mã nguồn của các thành phần UI (văn bản), và có thể cả log lỗi (văn bản). Multi-modal AI API có thể tiếp nhận tất cả các loại dữ liệu này, tổng hợp chúng và đưa ra một phân tích toàn diện. Theo các nhà nghiên cứu tại MIT, việc sử dụng multi-modal inputs có thể giảm 60% thời gian cần thiết để chẩn đoán các lỗi phức tạp so với việc chỉ dựa vào một loại dữ liệu.

Tuy nhiên, multi-modal AI API cũng có những thách thức riêng. Chúng thường yêu cầu tài nguyên tính toán lớn hơn đáng kể để huấn luyện và chạy, do phải xử lý và tích hợp nhiều luồng dữ liệu phức tạp. Chi phí sử dụng các API này cũng có thể cao hơn. Ngoài ra, việc xây dựng các tập dữ liệu huấn luyện đa phương thức chất lượng cao là một nhiệm vụ khó khăn và tốn kém, đòi hỏi sự đồng bộ hóa và gắn kết thông tin giữa các modality khác nhau. Mặc dù vậy, lợi ích về độ chính xác, khả năng hiểu biết ngữ cảnh, và hiệu suất làm việc mà multi-modal AI API mang lại thường vượt xa những thách thức này, đặc biệt trong các lĩnh vực đòi hỏi sự tương tác phức tạp giữa con người và máy tính như vibe coding.

Các Lưu Ý Quan Trọng

- Bảo mật Dữ liệu Riêng tư: Khi gửi ảnh chụp màn hình hoặc video chứa thông tin nhạy cảm (dữ liệu khách hàng, mã nguồn độc quyền) đến các multi-modal AI API bên thứ ba, hãy luôn đảm bảo rằng bạn đã tuân thủ các quy định bảo mật và quyền riêng tư (ví dụ: GDPR, CCPA). Cân nhắc việc che mờ hoặc xóa bỏ các thông tin nhạy cảm trước khi gửi.

- Sự Phụ thuộc vào Nhà Cung cấp: Việc tích hợp sâu vào một multi-modal AI API cụ thể có thể tạo ra sự phụ thuộc vào nhà cung cấp đó. Hãy đánh giá kỹ lưỡng các điều khoản dịch vụ, SLA (Service Level Agreement), và khả năng di chuyển sang các nhà cung cấp khác nếu cần.

- Độ trễ (Latency) của API: Multi-modal AI API thường xử lý một lượng lớn dữ liệu, dẫn đến độ trễ cao hơn so với các API đơn phương thức. Điều này cần được tính toán trong các ứng dụng yêu cầu phản hồi theo thời gian thực hoặc trong các pipeline CI/CD. Một số API có thể mất vài giây để xử lý một yêu cầu phức tạp.

- Khả năng Giải thích (Explainability) của AI: Các mô hình multi-modal thường rất phức tạp, khiến việc hiểu tại sao AI đưa ra một quyết định cụ thể trở nên khó khăn hơn. Điều này có thể là một thách thức trong các tình huống cần giải thích logic cho người khác hoặc khi debug các lỗi do AI tạo ra.

- Chi phí và Quy mô: Multi-modal AI API có thể tốn kém, đặc biệt khi xử lý lượng lớn dữ liệu hoặc các yêu cầu phức tạp. Hãy lập kế hoạch ngân sách cẩn thận và bắt đầu với các thử nghiệm nhỏ để hiểu rõ cấu trúc chi phí trước khi triển khai quy mô lớn. Một dự án lớn có thể tiêu tốn hàng ngàn đô la mỗi tháng chỉ riêng cho API.

- Tuyển chọn Mô hình Phù hợp: Không phải tất cả các multi-modal AI API đều được tối ưu hóa cho cùng một nhiệm vụ. Một số có thể tốt hơn trong việc phân tích hình ảnh, trong khi số khác lại mạnh về xử lý video hoặc tích hợp ngôn ngữ. Hãy nghiên cứu và chọn mô hình phù hợp nhất với nhu cầu cụ thể của bạn.

- Yêu cầu Về Kỹ năng: Để tận dụng tối đa multi-modal AI API, developer cần có kiến thức cơ bản về AI, cách xây dựng prompt hiệu quả, và cách xử lý các phản hồi từ AI. Điều này có thể đòi hỏi một quá trình học hỏi và thích nghi nhất định.

Câu Hỏi Thường Gặp

Multi-modal AI API có thể giúp debug code hiệu quả hơn không?

Có, multi-modal AI API có thể giúp debug code hiệu quả hơn đáng kể. Bằng cách cung cấp cho AI không chỉ mã nguồn mà còn cả ảnh chụp màn hình của lỗi, video ghi lại quá trình tái hiện lỗi, hoặc log hệ thống, AI có thể có một cái nhìn toàn diện hơn về vấn đề. Ví dụ, một API có thể nhận diện một lỗi UI (từ ảnh), liên kết nó với đoạn mã HTML/CSS/JS (từ văn bản) và đề xuất giải pháp chính xác hơn. Theo một nghiên cứu của Microsoft, việc sử dụng multi-modal AI trong debugging có thể giảm 40% thời gian tìm và sửa lỗi so với các phương pháp truyền thống.

Làm thế nào để đảm bảo tính riêng tư khi gửi dữ liệu hình ảnh/video lên multi-modal AI API?

Để đảm bảo tính riêng tư, bạn nên thực hiện các bước sau: Thứ nhất, che mờ hoặc xóa bỏ mọi thông tin nhận dạng cá nhân (PII) hoặc dữ liệu nhạy cảm khỏi hình ảnh/video trước khi gửi. Thứ hai, chỉ gửi những phần dữ liệu thực sự cần thiết cho AI phân tích. Thứ ba, tìm hiểu chính sách bảo mật dữ liệu của nhà cung cấp API và chọn nhà cung cấp có uy tín, tuân thủ các tiêu chuẩn bảo mật quốc tế. Thứ tư, cân nhắc sử dụng các API có khả năng xử lý dữ liệu tại chỗ (on-premise) nếu yêu cầu bảo mật cực kỳ cao.

Multi-modal AI API có thể tạo ra giao diện người dùng (UI) từ mô tả bằng văn bản và ảnh phác thảo không?

Vâng, hoàn toàn có thể. Đây là một trong những ứng dụng tiềm năng và thú vị nhất của multi-modal AI API. Bạn có thể cung cấp cho AI một mô tả văn bản về giao diện mong muốn ("một trang đăng nhập với logo ở trên, hai trường nhập liệu, và một nút đăng nhập màu xanh"), kèm theo một ảnh phác thảo tay hoặc một wireframe đơn giản. AI sẽ phân tích cả hai loại dữ liệu này để hiểu ý định của bạn và tạo ra mã nguồn HTML/CSS/JavaScript tương ứng. Các mô hình tiên tiến thậm chí có thể tạo ra các thành phần UI phức tạp hơn và đề xuất các tương tác.

Chi phí sử dụng multi-modal AI API có cao không?

Chi phí sử dụng multi-modal AI API thường cao hơn so với các API chỉ xử lý văn bản hoặc hình ảnh đơn lẻ. Mức phí phụ thuộc vào nhà cung cấp, loại mô hình, lượng dữ liệu được gửi (số lượng token văn bản, kích thước hình ảnh/video), và số lượng yêu cầu. Một số nhà cung cấp có thể tính phí theo số lượng "đơn vị xử lý" hoặc theo thời gian sử dụng GPU. Để tối ưu chi phí, bạn nên theo dõi việc sử dụng API, tối ưu hóa kích thước dữ liệu đầu vào, và chỉ gọi API khi thực sự cần thiết. Nhiều nhà cung cấp cung cấp gói miễn phí hoặc gói dùng thử để bạn có thể đánh giá trước khi cam kết.

Multi-modal AI API có thể tích hợp vào các IDE hiện có không?

Có, hoàn toàn có thể. Việc tích hợp multi-modal AI API vào các IDE (ví dụ: VS Code, IntelliJ IDEA) là một xu hướng đang phát triển. Các plugin hoặc extension có thể được phát triển để cho phép developer gửi ảnh chụp màn hình trực tiếp từ IDE, hoặc tự động gửi mã nguồn và các file liên quan đến API. Phản hồi từ AI (ví dụ: đề xuất code, phân tích lỗi UI) sau đó có thể được hiển thị trực tiếp trong cửa sổ IDE, giúp tối ưu hóa quy trình làm việc và tăng năng suất. Các công ty như GitHub Copilot X đã bắt đầu khám phá các khả năng multi-modal này.

Kết Luận

Multi-modal AI API đang định hình lại cách chúng ta tiếp cận vibe coding, biến AI từ một trợ lý code đơn thuần thành một đối tác có khả năng "nhìn", "nghe" và "hiểu" thế giới phần mềm một cách toàn diện hơn. Khả năng kết hợp thông tin từ văn bản, hình ảnh và video không chỉ giúp AI đưa ra các phân tích sâu sắc hơn mà còn mở ra cánh cửa cho những ứng dụng sáng tạo, từ tự động hóa việc tạo UI/UX đến gỡ lỗi phức tạp với độ chính xác cao hơn. Với sự phát triển không ngừng của công nghệ, multi-modal AI API hứa hẹn sẽ trở thành công cụ không thể thiếu trong bộ công cụ của mọi developer hiện đại.

Việc nắm vững cách sử dụng và tích hợp các API này sẽ mang lại lợi thế cạnh tranh đáng kể, giúp tăng tốc độ phát triển, cải thiện chất lượng sản phẩm và giảm thiểu các lỗi do hiểu sai ngữ cảnh. Hãy bắt đầu khám phá và thử nghiệm multi-modal AI API ngay hôm nay để trải nghiệm tương lai của vibe coding. Đây không chỉ là một công nghệ mới, mà là một bước nhảy vọt trong hành trình cách mạng hóa cách chúng ta tạo ra phần mềm.