Giới Thiệu: Xây Dựng AI Music Generator – Tự Động Sáng Tác Nhạc Với Vibe Coding

Trong kỷ nguyên số, sự giao thoa giữa công nghệ và nghệ thuật đang mở ra những chân trời mới đầy thú vị. Một trong số đó là khả năng tự động sáng tạo nghệ thuật, và đặc biệt là âm nhạc. Bài viết này sẽ đưa bạn vào thế giới của AI sáng tác nhạc, khám phá cách chúng ta có thể tận dụng sức mạnh của Trí tuệ Nhân tạo để tạo ra những giai điệu, hòa âm và thậm chí là ca khúc hoàn chỉnh. Chúng ta sẽ cùng nhau tìm hiểu từ những khái niệm cơ bản đến việc triển khai thực tế một hệ thống AI Music Generator, mang đến một góc nhìn chuyên sâu và thực tiễn cho những ai đam mê công nghệ và âm nhạc.

AI Sáng Tác Nhạc: Khái Niệm Và Tiềm Năng

AI sáng tác nhạc, hay còn gọi là Generative Music AI, là một lĩnh vực của Trí tuệ Nhân tạo tập trung vào việc tạo ra các tác phẩm âm nhạc mới một cách tự động. Thay vì chỉ phân tích hay xử lý âm thanh, các hệ thống AI này được thiết kế để "học" từ một lượng lớn dữ liệu âm nhạc hiện có và sau đó "sáng tạo" ra những bản nhạc độc đáo, chưa từng xuất hiện. Điều này không chỉ đơn thuần là sắp xếp ngẫu nhiên các nốt nhạc, mà là việc mô phỏng các quy luật, cấu trúc, phong cách và cảm xúc trong âm nhạc mà con người đã tạo ra.

Tiềm năng của AI sáng tác nhạc là vô cùng lớn. Đối với các nhạc sĩ, nó có thể trở thành một công cụ hỗ trợ đắc lực, giúp họ vượt qua những rào cản sáng tạo, thử nghiệm các ý tưởng mới hoặc tự động hóa những khâu tốn thời gian như tạo nhạc nền, hòa âm. Đối với ngành công nghiệp giải trí, AI có thể sản xuất nhạc cho phim ảnh, trò chơi điện tử, quảng cáo với chi phí thấp hơn và tốc độ nhanh hơn. Thậm chí, nó còn mở ra cánh cửa cho những trải nghiệm âm nhạc cá nhân hóa, nơi AI có thể tạo ra những bản nhạc "đo ni đóng giày" cho tâm trạng hoặc sở thích của từng người nghe.

Các thuật toán chính được sử dụng trong AI sáng tác nhạc thường bao gồm mạng nơ-ron hồi quy (Recurrent Neural Networks - RNNs), đặc biệt là Long Short-Term Memory (LSTMs), Generative Adversarial Networks (GANs) và gần đây là các mô hình Transformer. Mỗi loại mô hình có những ưu và nhược điểm riêng, phù hợp với các mục tiêu sáng tác khác nhau. RNNs và LSTMs thường mạnh trong việc tạo ra các chuỗi dữ liệu tuần tự như nốt nhạc, trong khi GANs có thể tạo ra các mẫu âm thanh chân thực hơn. Transformer lại nổi bật với khả năng xử lý các mối quan hệ dài hạn trong chuỗi và đang rất thành công trong nhiều tác vụ sinh dữ liệu.

Để một hệ thống AI có thể sáng tác nhạc, nó cần được "huấn luyện" (train) trên một tập dữ liệu âm nhạc khổng lồ. Tập dữ liệu này có thể bao gồm các file MIDI (Musical Instrument Digital Interface) mô tả các nốt nhạc, cao độ, thời lượng, hoặc các file audio dạng sóng (waveform) thực tế. Chất lượng và sự đa dạng của dữ liệu huấn luyện đóng vai trò cực kỳ quan trọng trong việc định hình phong cách và khả năng sáng tạo của AI. Một AI được huấn luyện trên nhạc cổ điển sẽ có xu hướng tạo ra các tác phẩm mang hơi hướng cổ điển, trong khi một AI được huấn luyện trên nhạc pop sẽ tạo ra giai điệu pop.

Thách thức lớn nhất trong việc phát triển AI sáng tác nhạc không chỉ là tạo ra các nốt nhạc đúng quy tắc mà còn là truyền tải cảm xúc, sự độc đáo và tính nghệ thuật vào tác phẩm. Đây là điểm mà các nhà nghiên cứu và phát triển AI vẫn đang nỗ lực cải thiện, tìm kiếm những cách thức để AI không chỉ "bắt chước" mà còn có thể "đổi mới" và "thể hiện" cảm xúc theo cách riêng của mình.

Xây Dựng AI Music Generator: Hướng Dẫn Thực Hành Với Python

Để bắt đầu xây dựng một AI Music Generator cơ bản, chúng ta sẽ tập trung vào việc sử dụng các thư viện Python để xử lý file MIDI và huấn luyện một mô hình học sâu. Mục tiêu là tạo ra một mô hình có khả năng sinh ra một chuỗi các nốt nhạc dựa trên một motif ban đầu.

Bước 1: Chuẩn Bị Môi Trường và Dữ Liệu

Trước hết, bạn cần cài đặt các thư viện cần thiết. Chúng ta sẽ sử dụng music21 để phân tích và xử lý MIDI, numpy để làm việc với mảng dữ liệu, và tensorflow (hoặc pytorch) để xây dựng mô hình học sâu.

pip install music21 numpy tensorflowDữ liệu huấn luyện là yếu tố then chốt. Bạn có thể tìm các bộ dữ liệu MIDI miễn phí trên mạng, ví dụ như các sáng tác của Bach, Mozart, hoặc các bộ dữ liệu nhạc pop. Hãy đặt các file MIDI này vào một thư mục, ví dụ midi_data/.

Bước 2: Thu Thập Và Tiền Xử Lý Dữ Liệu MIDI

Dữ liệu MIDI cần được chuyển đổi thành một định dạng mà mô hình học máy có thể hiểu được. Chúng ta sẽ trích xuất các nốt nhạc (pitch) và thời lượng (duration) từ mỗi file MIDI.

from music21 import converter, instrument, note, chord, stream

import numpy as np

import os

def get_notes():

notes = []

for file in os.listdir("midi_data"):

if file.endswith(".mid"):

try:

midi = converter.parse(os.path.join("midi_data", file))

elements = midi.flat.notesAndRests

for element in elements:

if isinstance(element, note.Note):

notes.append(str(element.pitch))

elif isinstance(element, chord.Chord):

notes.append('.'.join(str(n) for n in element.normalOrder))

except Exception as e:

print(f"Error parsing {file}: {e}")

return notes

all_notes = get_notes()

print(f"Total notes extracted: {len(all_notes)}")

print(f"Example notes: {all_notes[:10]}")Sau khi thu thập, chúng ta cần tạo một ánh xạ từ các nốt nhạc độc nhất vô nhị sang các số nguyên (integer encoding) để mô hình có thể xử lý.

# Tạo ánh xạ từ nốt nhạc sang số nguyên

unique_notes = sorted(list(set(all_notes)))

note_to_int = dict((note, number) for number, note in enumerate(unique_notes))

int_to_note = dict((number, note) for number, note in enumerate(unique_notes))

n_vocab = len(unique_notes)

print(f"Number of unique notes: {n_vocab}")

# Chuẩn bị dữ liệu đầu vào và đầu ra cho mô hình

sequence_length = 100 # Độ dài của chuỗi nốt nhạc mà mô hình sẽ học

network_input = []

network_output = []

for i in range(0, len(all_notes) - sequence_length, 1):

sequence_in = all_notes[i:i + sequence_length]

sequence_out = all_notes[i + sequence_length]

network_input.append([note_to_int[char] for char in sequence_in])

network_output.append(note_to_int[sequence_out])

n_patterns = len(network_input)

# Reshape input cho LSTM

network_input = np.reshape(network_input, (n_patterns, sequence_length, 1))

# Normalize input

network_input = network_input / float(n_vocab)

# One-hot encode output

from tensorflow.keras.utils import to_categorical

network_output = to_categorical(network_output, num_classes=n_vocab)Bước 3: Xây Dựng Mô Hình Học Sâu (LSTM)

Chúng ta sẽ sử dụng một mạng nơ-ron LSTM đơn giản để dự đoán nốt nhạc tiếp theo trong một chuỗi.

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import Dense, Dropout, LSTM, Activation, BatchNormalization

def create_network(input_shape):

model = Sequential()

model.add(LSTM(

512,

input_shape=(input_shape[1], input_shape[2]),

recurrent_dropout=0.3,

return_sequences=True

))

model.add(LSTM(512, return_sequences=True, recurrent_dropout=0.3,))

model.add(LSTM(512))

model.add(BatchNormalization())

model.add(Dropout(0.3))

model.add(Dense(256))

model.add(Activation('relu'))

model.add(BatchNormalization())

model.add(Dropout(0.3))

model.add(Dense(n_vocab))

model.add(Activation('softmax'))

model.compile(loss='categorical_crossentropy', optimizer='rmsprop')

return model

model = create_network(network_input.shape)

model.summary()Bước 4: Huấn Luyện Mô Hình

Sau khi định nghĩa mô hình, chúng ta sẽ tiến hành huấn luyện nó trên dữ liệu đã chuẩn bị.

from tensorflow.keras.callbacks import ModelCheckpoint

filepath = "weights-improvement-{epoch:02d}-{loss:.4f}-bigger.hdf5"

checkpoint = ModelCheckpoint(

filepath,

monitor='loss',

verbose=0,

save_best_only=True,

mode='min'

)

callbacks_list = [checkpoint]

model.fit(network_input, network_output, epochs=50, batch_size=64, callbacks=callbacks_list)Bước 5: Tạo Nhạc Từ Mô Hình

Sau khi mô hình được huấn luyện, chúng ta có thể sử dụng nó để sinh ra các nốt nhạc mới. Chúng ta sẽ cung cấp cho mô hình một chuỗi nốt nhạc khởi đầu, và nó sẽ dự đoán nốt nhạc tiếp theo, rồi dùng nốt đó để dự đoán nốt tiếp theo nữa, cứ thế tiếp diễn.

def generate_notes(model, network_input, int_to_note, n_vocab):

# Chọn một chuỗi ngẫu nhiên làm điểm khởi đầu

start = np.random.randint(0, len(network_input) - 1)

pattern = network_input[start]

prediction_output = []

# Tạo 500 nốt nhạc

for note_index in range(500):

prediction_input = np.reshape(pattern, (1, len(pattern), 1))

prediction_input = prediction_input / float(n_vocab)

prediction = model.predict(prediction_input, verbose=0)

index = np.argmax(prediction)

result = int_to_note[index]

prediction_output.append(result)

pattern = np.append(pattern, index)

pattern = pattern[1:len(pattern)]

return prediction_output

# Tải trọng số tốt nhất (nếu đã lưu)

# model.load_weights("weights-improvement-XX-X.XXXX-bigger.hdf5") # Thay bằng file weights của bạn

generated_notes = generate_notes(model, network_input, int_to_note, n_vocab)Bước 6: Chuyển Đổi Nốt Nhạc Thành File MIDI

Cuối cùng, chúng ta sẽ chuyển đổi chuỗi nốt nhạc đã được sinh ra thành một file MIDI để có thể nghe được.

def create_midi(prediction_output):

offset = 0

output_notes = []

for pattern in prediction_output:

if ('.' in pattern) or pattern.isdigit():

notes_in_chord = pattern.split('.')

notes = []

for current_note in notes_in_chord:

new_note = note.Note(int(current_note))

new_note.storedInstrument = instrument.Piano()

notes.append(new_note)

new_chord = chord.Chord(notes)

new_chord.offset = offset

output_notes.append(new_chord)

else:

new_note = note.Note(pattern)

new_note.offset = offset

new_note.storedInstrument = instrument.Piano()

output_notes.append(new_note)

# Cứ mỗi nốt hoặc hợp âm, tăng offset để tạo ra chuỗi thời gian

offset += 0.5 # Bạn có thể điều chỉnh giá trị này

midi_stream = stream.Stream(output_notes)

midi_stream.write('midi', fp='test_output.mid')

create_midi(generated_notes)

print("MIDI file 'test_output.mid' created successfully!")Quá trình này tuy đơn giản nhưng đã phác thảo được toàn bộ luồng làm việc của một hệ thống AI sáng tác nhạc cơ bản. Để có kết quả tốt hơn, bạn cần một lượng dữ liệu lớn hơn, mô hình phức tạp hơn và nhiều tinh chỉnh (hyperparameter tuning) hơn.

Tips và Best Practices Khi Phát Triển AI Music Generator

Việc xây dựng một AI sáng tác nhạc hiệu quả đòi hỏi không chỉ kiến thức về học máy mà còn cả sự hiểu biết về âm nhạc. Dưới đây là một số tips và best practices để bạn có thể cải thiện chất lượng của AI Music Generator:

- Chất lượng dữ liệu là Vàng: Đây là yếu tố quan trọng nhất. Dữ liệu huấn luyện càng sạch, càng đa dạng và càng phù hợp với phong cách bạn muốn tạo ra, thì kết quả càng tốt. Hãy dành thời gian tìm kiếm và tiền xử lý dữ liệu MIDI chất lượng cao. Cân nhắc sử dụng các bộ dữ liệu được tuyển chọn kỹ lưỡng.

- Mô hình hóa không chỉ nốt nhạc: Âm nhạc không chỉ là chuỗi nốt nhạc. Nó còn bao gồm nhịp điệu, cường độ, sắc thái, hòa âm, cấu trúc bài hát. Để AI sáng tác nhạc thực sự ấn tượng, bạn cần mô hình hóa nhiều khía cạnh hơn. Ví dụ, bạn có thể thêm thông tin về cường độ (velocity) của nốt nhạc, hoặc sử dụng các mô hình phức tạp hơn để học cấu trúc hợp âm.

- Thử nghiệm các kiến trúc mô hình khác nhau: LSTM là một khởi đầu tốt, nhưng đừng ngần ngại khám phá các kiến trúc khác như GRU (Gated Recurrent Units), Transformer, hoặc thậm chí là GANs. Mỗi kiến trúc có thế mạnh riêng và có thể phù hợp hơn với các loại dữ liệu hoặc mục tiêu sáng tác cụ thể. Ví dụ, Transformer rất mạnh trong việc nắm bắt các mối quan hệ xa trong chuỗi.

- Tối ưu hóa Hyperparameters: Kích thước batch (

batch_size), số epoch (epochs), tỷ lệ học (learning rate), số lớp và số đơn vị trong mỗi lớp của mạng nơ-ron đều ảnh hưởng lớn đến hiệu suất. Hãy thử nghiệm nhiều giá trị khác nhau để tìm ra cấu hình tối ưu. Kỹ thuật như Grid Search hoặc Random Search có thể hữu ích. - Sử dụng Callback hiệu quả:

ModelCheckpointđể lưu lại trọng số tốt nhất,EarlyStoppingđể dừng huấn luyện khi mô hình không còn cải thiện, vàReduceLROnPlateauđể giảm tỷ lệ học khi hiệu suất không cải thiện, đều là những công cụ quan trọng giúp quá trình huấn luyện ổn định và hiệu quả hơn. - Đánh giá khách quan và chủ quan: Bên cạnh các chỉ số mất mát (loss) của mô hình, hãy luôn lắng nghe các bản nhạc được tạo ra. Đánh giá chất lượng âm nhạc một cách chủ quan là rất quan trọng. Hỏi ý kiến những người có chuyên môn âm nhạc để nhận được phản hồi.

- Xử lý độ dài chuỗi (Sequence Length): Việc chọn

sequence_lengthphù hợp rất quan trọng. Chuỗi quá ngắn có thể không cung cấp đủ ngữ cảnh, trong khi chuỗi quá dài có thể làm tăng độ phức tạp tính toán và khó học các mối quan hệ dài hạn. - Áp dụng kiến thức âm nhạc: Kết hợp kiến thức âm nhạc vào quá trình thiết kế và huấn luyện mô hình. Ví dụ, bạn có thể giới hạn các nốt nhạc được tạo ra theo một thang âm hoặc hợp âm cụ thể để đảm bảo tính hài hòa. Đây là một cách để "dẫn dắt" AI sáng tác nhạc theo một khuôn khổ nghệ thuật nhất định.

So Sánh Các Phương Pháp AI Sáng Tác Nhạc Phổ Biến

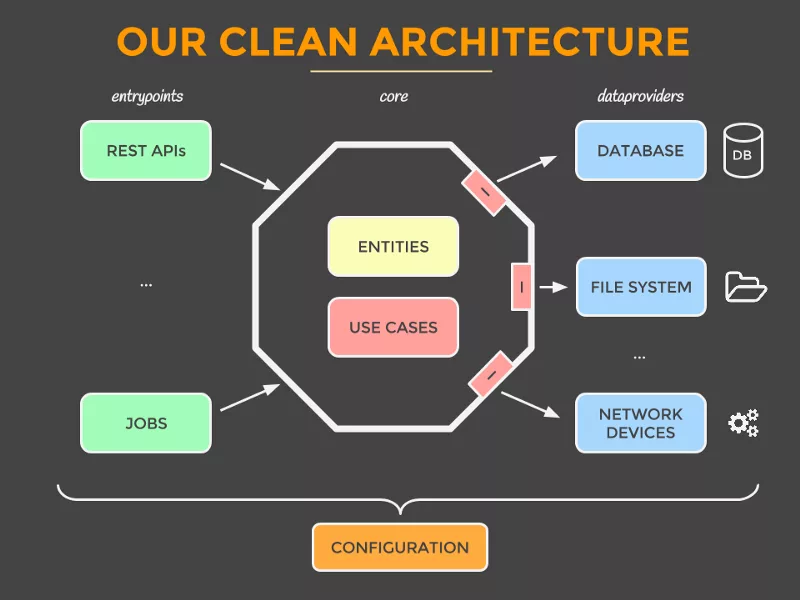

Khi nói đến AI sáng tác nhạc, có một số phương pháp chính mà các nhà nghiên cứu và phát triển thường sử dụng. Mỗi phương pháp có những ưu điểm và hạn chế riêng, phù hợp với các mục tiêu và phong cách âm nhạc khác nhau.

- Mô hình Dựa trên Xác suất (Probabilistic Models):

- Ví dụ: Markov Chains, Hidden Markov Models (HMMs).

- Ưu điểm: Đơn giản, dễ triển khai, yêu cầu ít tài nguyên tính toán. Có thể tạo ra các chuỗi nốt nhạc có vẻ hợp lý trong một số trường hợp.

- Hạn chế: Khó nắm bắt cấu trúc âm nhạc phức tạp, thiếu khả năng tạo ra sự mới lạ hoặc "cảm xúc". Thường chỉ tạo ra các chuỗi nốt nhạc ngắn, lặp lại.

- Phù hợp cho: Sáng tác giai điệu đơn giản, tạo hiệu ứng âm thanh ngẫu nhiên.

- Mạng Nơ-ron Hồi quy (Recurrent Neural Networks - RNNs), đặc biệt là LSTM và GRU:

- Ví dụ: Mô hình chúng ta đã xây dựng ở trên.

- Ưu điểm: Hiệu quả trong việc xử lý dữ liệu tuần tự như nốt nhạc. Có khả năng học các mối quan hệ phụ thuộc dài hạn trong chuỗi (nhờ LSTM/GRU). Có thể tạo ra các giai điệu và hòa âm phức tạp hơn so với mô hình xác suất.

- Hạn chế: Khó huấn luyện trên các chuỗi rất dài (vấn đề vanishing/exploding gradients), cần lượng lớn dữ liệu, tính toán tốn kém. Khó khăn trong việc kiểm soát cấu trúc tổng thể của bài hát.

- Phù hợp cho: Sáng tác giai điệu, hòa âm, tạo ra các phần nhạc cụ riêng lẻ.

- Generative Adversarial Networks (GANs):

- Ví dụ: MuseGAN, C-RNN-GAN.

- Ưu điểm: Có khả năng tạo ra dữ liệu âm nhạc rất chân thực, có tính sáng tạo cao. Có thể tạo ra nhiều track nhạc cụ cùng lúc, đảm bảo sự đồng bộ và hài hòa.

- Hạn chế: Rất khó huấn luyện (vấn đề chế độ suy sụp - mode collapse), nhạy cảm với các siêu tham số (hyperparameters). Yêu cầu tài nguyên tính toán cực kỳ lớn.

- Phù hợp cho: Tạo ra các bản nhạc hoàn chỉnh, phức tạp với nhiều nhạc cụ, mô phỏng phong cách âm nhạc cụ thể một cách chân thực.

- Mô hình Transformer:

- Ví dụ: Music Transformer, Jukebox của OpenAI.

- Ưu điểm: Rất mạnh trong việc nắm bắt các mối quan hệ phụ thuộc dài hạn trong chuỗi, vượt trội hơn RNNs. Có khả năng xử lý song song cao, cho phép huấn luyện trên các tập dữ liệu lớn hơn. Tạo ra âm nhạc có cấu trúc và tính liên kết tốt hơn.

- Hạn chế: Yêu cầu tài nguyên tính toán và bộ nhớ rất lớn, đặc biệt cho các mô hình lớn. Phức tạp để triển khai từ đầu.

- Phù hợp cho: Sáng tác các tác phẩm âm nhạc dài, phức tạp, với cấu trúc rõ ràng và tính biểu cảm cao, đặc biệt là các mô hình sinh ra audio raw.

Việc lựa chọn phương pháp phù hợp phụ thuộc vào mục tiêu dự án, tài nguyên sẵn có và mức độ phức tạp của âm nhạc bạn muốn tạo ra. Đối với người mới bắt đầu, RNNs/LSTMs là một lựa chọn tốt để làm quen với AI sáng tác nhạc. Đối với các dự án nghiêm túc hơn, Transformer và GANs mang lại tiềm năng lớn hơn về chất lượng và độ phức tạp của tác phẩm.

Các Lưu Ý Quan Trọng

- Vấn đề bản quyền: Khi sử dụng dữ liệu huấn luyện, hãy luôn kiểm tra vấn đề bản quyền. Nếu bạn sử dụng các tác phẩm có bản quyền để huấn luyện AI, sản phẩm sáng tác của AI có thể bị ảnh hưởng. Tìm kiếm các bộ dữ liệu công cộng (public domain) hoặc có giấy phép sử dụng mở.

- Sự khác biệt giữa MIDI và Audio Raw: Bài viết này tập trung vào MIDI, là một định dạng mô tả các sự kiện âm nhạc (nốt, cao độ, thời lượng). Sáng tác audio raw (trực tiếp tạo ra sóng âm) phức tạp hơn nhiều, yêu cầu các mô hình mạnh mẽ như WaveNet hoặc Jukebox và tài nguyên tính toán khổng lồ.

- Tính lặp lại và sự sáng tạo: Một vấn đề thường gặp với AI sáng tác nhạc là chúng có thể tạo ra các mẫu lặp đi lặp lại hoặc thiếu sự mới lạ. Để khắc phục, bạn có thể áp dụng các kỹ thuật như sampling ngẫu nhiên (temperature sampling) thay vì chỉ chọn nốt có xác suất cao nhất, hoặc đưa vào các yếu tố ngẫu nhiên trong quá trình sinh nhạc.

- Kiểm soát và Điều chỉnh: AI Music Generator tốt nhất là công cụ hỗ trợ chứ không phải thay thế hoàn toàn con người. Hãy thiết kế hệ thống của bạn với khả năng kiểm soát và điều chỉnh. Cho phép người dùng cung cấp các tham số đầu vào như phong cách, tâm trạng, nhạc cụ, hoặc một motif ban đầu để định hướng quá trình sáng tác.

- Tài nguyên tính toán: Huấn luyện các mô hình học sâu cho AI sáng tác nhạc, đặc biệt là các mô hình Transformer hoặc GANs, đòi hỏi GPU mạnh mẽ và nhiều thời gian. Hãy chuẩn bị sẵn sàng cho việc này, hoặc cân nhắc sử dụng các dịch vụ đám mây như Google Colab Pro, AWS, Azure.

- Đầu ra có thể không hoàn hảo: Đừng mong đợi AI của bạn sẽ tạo ra một bản hit ngay từ lần thử đầu tiên. Quá trình phát triển là một chuỗi lặp đi lặp lại của việc huấn luyện, thử nghiệm, tinh chỉnh và đánh giá. Luôn có chỗ để cải thiện.

- Khám phá các thư viện khác: Ngoài

music21, có nhiều thư viện khác nhưpretty_midi,pypianorollcó thể giúp bạn xử lý dữ liệu MIDI hiệu quả hơn. Đối với việc tạo audio, các thư viện nhưlibrosarất hữu ích.

Câu Hỏi Thường Gặp

AI sáng tác nhạc có thể thay thế nhạc sĩ không?

Hiện tại, AI sáng tác nhạc được xem là một công cụ hỗ trợ mạnh mẽ cho các nhạc sĩ, giúp họ khám phá ý tưởng mới, tự động hóa các tác vụ lặp đi lặp lại và mở rộng khả năng sáng tạo. Tuy nhiên, khả năng truyền tải cảm xúc sâu sắc, sự độc đáo trong tư duy nghệ thuật, và kinh nghiệm sống vẫn là điểm mạnh mà AI khó có thể thay thế con người.

Làm cách nào để AI tạo ra nhạc có cảm xúc?

Việc tạo ra nhạc có cảm xúc là một thách thức lớn. Các phương pháp hiện tại bao gồm huấn luyện AI trên các bộ dữ liệu được gắn nhãn cảm xúc (ví dụ: vui, buồn, tức giận), hoặc sử dụng các mô hình phức tạp hơn có khả năng học các đặc trưng âm nhạc liên quan đến cảm xúc. Tuy nhiên, việc định nghĩa và đo lường cảm xúc trong âm nhạc vẫn là một lĩnh vực nghiên cứu đang phát triển.

Tôi có thể tạo ra nhạc cụ nào bằng AI Music Generator?

Với các mô hình dựa trên MIDI, bạn có thể tạo ra các nốt nhạc và hòa âm cho bất kỳ nhạc cụ nào có thể biểu diễn qua MIDI, như piano, guitar, trống, sáo, v.v. Việc gán nhạc cụ cụ thể cho các nốt nhạc được tạo ra thường được thực hiện ở bước chuyển đổi sang file MIDI hoặc thông qua một phần mềm DAW (Digital Audio Workstation).

AI Music Generator có tạo ra thể loại nhạc cụ thể không?

Có, khả năng của AI Music Generator trong việc tạo ra một thể loại nhạc cụ thể phụ thuộc rất nhiều vào dữ liệu huấn luyện. Nếu AI được huấn luyện độc quyền trên nhạc cổ điển, nó sẽ có xu hướng tạo ra nhạc cổ điển. Để tạo ra nhiều thể loại, bạn cần một bộ dữ liệu đa dạng hoặc huấn luyện các mô hình riêng biệt cho từng thể loại, hoặc sử dụng các mô hình có khả năng học điều kiện (conditional generation) dựa trên thể loại đầu vào.

Làm sao để đảm bảo nhạc AI tạo ra không bị đạo nhái?

Đây là một câu hỏi phức tạp. Các mô hình học sâu có thể vô tình "học thuộc lòng" và tái tạo lại các đoạn nhạc từ dữ liệu huấn luyện. Để giảm thiểu rủi ro này, bạn có thể sử dụng các kỹ thuật như tăng cường dữ liệu (data augmentation), sử dụng các mô hình với khả năng sáng tạo cao hơn (ví dụ: GANs), hoặc áp dụng các thuật toán kiểm tra sự trùng lặp sau khi nhạc được tạo ra. Tuy nhiên, không có cách nào đảm bảo 100%.

Kết Luận

AI sáng tác nhạc là một lĩnh vực đầy hứa hẹn, kết hợp sự sáng tạo của nghệ thuật với sức mạnh của công nghệ. Từ những khái niệm cơ bản về cách AI học và tạo ra âm nhạc, đến việc triển khai thực tế một AI Music Generator bằng Python, chúng ta đã cùng nhau khám phá hành trình xây dựng một công cụ có khả năng tự động sáng tác. Mặc dù còn nhiều thách thức, tiềm năng của AI trong việc hỗ trợ và mở rộng khả năng sáng tạo âm nhạc là không thể phủ nhận.

Việc phát triển một AI Music Generator không chỉ là một dự án kỹ thuật mà còn là một hành trình nghệ thuật. Nó đòi hỏi sự kiên nhẫn, thử nghiệm và đôi khi là cả một chút "vibe" để tạo ra những giai điệu thực sự ấn tượng. Hy vọng bài viết này đã cung cấp cho bạn cái nhìn sâu sắc và những công cụ cần thiết để bắt đầu hành trình của riêng mình trong thế giới AI sáng tác nhạc. Hãy tiếp tục khám phá và sáng tạo cùng vibe coding!