Giới Thiệu "Bộ Não" AI Cá Nhân Hóa: Project Quản Lý Tri Thức Cộng Tác Thông Minh Với Vibe Coding

Chào mừng các anh em developer và những tâm hồn đam mê AI! Hôm nay, chúng ta sẽ cùng nhau khám phá một trong những ứng dụng AI thực tế và đầy tiềm năng nhất: xây dựng một "bộ não" AI cá nhân hóa, một hệ thống quản lý tri thức cộng tác thông minh. Bài viết về quản lý tri thức AI này sẽ giúp bạn không chỉ hiểu rõ về khái niệm mà còn cung cấp lộ trình chi tiết để biến ý tưởng thành hiện thực, mang lại giá trị to lớn cho cá nhân và tổ chức. Chúng ta sẽ cùng nhau đi sâu vào từng khía cạnh, từ việc định hình kiến trúc đến lựa chọn công nghệ, và thậm chí là những đoạn code mẫu để bạn có thể bắt tay vào làm ngay.

Quản Lý Tri Thức AI (AI-Powered Knowledge Management): Hơn Cả Một CSDL

Trong kỷ nguyên thông tin bùng nổ, việc quản lý và tận dụng tri thức là chìa khóa thành công. "Bộ não" AI cá nhân hóa không chỉ là một kho lưu trữ dữ liệu khổng lồ; nó là một hệ thống động, có khả năng học hỏi, tự động hóa việc tổ chức, tìm kiếm, tổng hợp và thậm chí là tạo ra tri thức mới dựa trên dữ liệu hiện có. Mục tiêu cuối cùng là tạo ra một trợ lý AI thông minh, có thể hiểu bối cảnh, trả lời câu hỏi phức tạp, gợi ý giải pháp và hỗ trợ ra quyết định.

Hãy hình dung một hệ thống có thể đọc hàng ngàn tài liệu, ghi nhớ các cuộc họp, tổng hợp email, và khi bạn cần thông tin về một dự án cụ thể, nó không chỉ trả về các tài liệu liên quan mà còn tóm tắt những điểm chính, chỉ ra những mâu thuẫn hoặc cơ hội tiềm năng. Đó chính là sức mạnh của quản lý tri thức AI.

Để đạt được điều này, chúng ta cần kết hợp nhiều công nghệ AI tiên tiến như Xử lý Ngôn ngữ Tự nhiên (NLP) để hiểu nội dung, Machine Learning (ML) để phân loại và học hỏi, Knowledge Graph để biểu diễn mối quan hệ giữa các khái niệm, và Retrieval-Augmented Generation (RAG) để tạo ra câu trả lời chính xác và có căn cứ. Đây không chỉ là một công cụ, mà là một đối tác tri thức đắc lực, giúp chúng ta tối ưu hóa quy trình làm việc và nâng cao hiệu suất.

Một hệ thống quản lý tri thức AI hiệu quả sẽ giúp giải quyết các vấn đề như "thông tin bị phân mảnh", "mất mát tri thức khi nhân sự nghỉ việc", và "khó khăn trong việc tìm kiếm thông tin cần thiết". Nó biến dữ liệu thô thành tri thức có thể hành động, giúp các tổ chức và cá nhân đưa ra quyết định nhanh chóng và chính xác hơn.

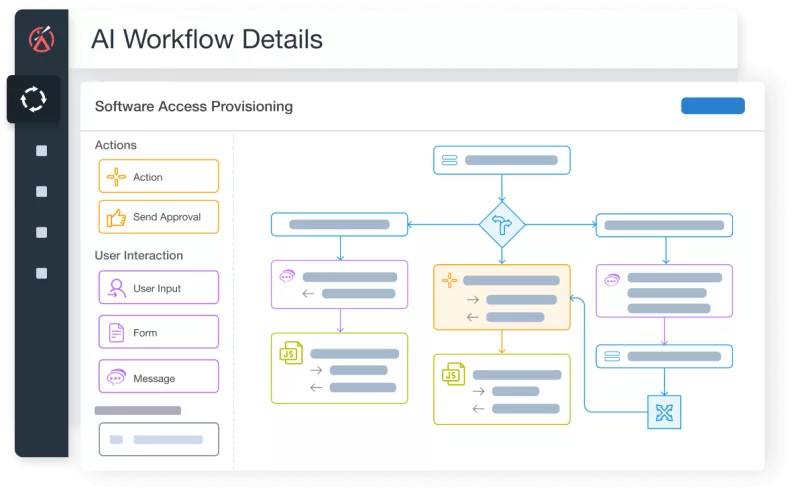

Kiến Trúc Tổng Thể của "Bộ Não" AI Cá Nhân Hóa

Để xây dựng một hệ thống quản lý tri thức AI mạnh mẽ, chúng ta cần một kiến trúc vững chắc. Dưới đây là các thành phần chính:

- Nguồn Dữ Liệu (Data Sources): Đây là nơi tri thức được thu thập. Có thể là tài liệu nội bộ (PDF, Word, Markdown), email, lịch sử chat, ghi chú cuộc họp, cơ sở dữ liệu, API từ các ứng dụng khác (Jira, Confluence, Notion), hoặc thậm chí là dữ liệu từ web.

- Bộ Thu Thập & Tiền Xử Lý Dữ Liệu (Data Ingestion & Preprocessing): Module này chịu trách nhiệm thu thập dữ liệu từ các nguồn khác nhau, chuẩn hóa định dạng, làm sạch (loại bỏ nhiễu, trùng lặp), và chia nhỏ (chunking) thành các đoạn văn bản nhỏ hơn để xử lý hiệu quả hơn.

- Mô Hình Nhúng (Embedding Models): Các mô hình này biến các đoạn văn bản thành các vector số (embeddings) trong không gian nhiều chiều. Các vector này mã hóa ý nghĩa ngữ nghĩa của văn bản, cho phép chúng ta tìm kiếm các đoạn văn bản có ý nghĩa tương tự.

- Cơ Sở Dữ Liệu Vector (Vector Database): Đây là trái tim của hệ thống RAG. Nó lưu trữ các vector embeddings cùng với siêu dữ liệu (metadata) của chúng. Cơ sở dữ liệu vector cho phép tìm kiếm ngữ nghĩa nhanh chóng và hiệu quả (semantic search).

- Mô Hình Ngôn Ngữ Lớn (Large Language Models - LLMs): Các LLM như GPT của OpenAI, Claude của Anthropic, hoặc Llama của Meta là bộ não thực sự của hệ thống. Chúng nhận các đoạn văn bản liên quan từ cơ sở dữ liệu vector và sử dụng chúng để tạo ra câu trả lời, tóm tắt, hoặc phân tích.

- Giao Diện Người Dùng (User Interface - UI): Đây là nơi người dùng tương tác với hệ thống, đặt câu hỏi, xem kết quả, và cung cấp phản hồi. Có thể là giao diện chat bot, một ứng dụng web, hoặc tích hợp vào các công cụ hiện có.

- Bộ Phản Hồi & Học Hỏi (Feedback & Learning Loop): Hệ thống cần có cơ chế để thu thập phản hồi từ người dùng (ví dụ: đánh giá độ chính xác của câu trả lời) để liên tục cải thiện hiệu suất của các mô hình và chiến lược truy xuất.

Thực Hành Xây Dựng Hệ Thống Quản Lý Tri Thức AI Với Python Và LangChain

Chúng ta sẽ sử dụng Python làm ngôn ngữ chính và thư viện LangChain để đơn giản hóa việc xây dựng các pipeline AI phức tạp. LangChain cung cấp một framework mạnh mẽ để kết nối các LLM với các nguồn dữ liệu bên ngoài, tạo điều kiện thuận lợi cho việc triển khai RAG.

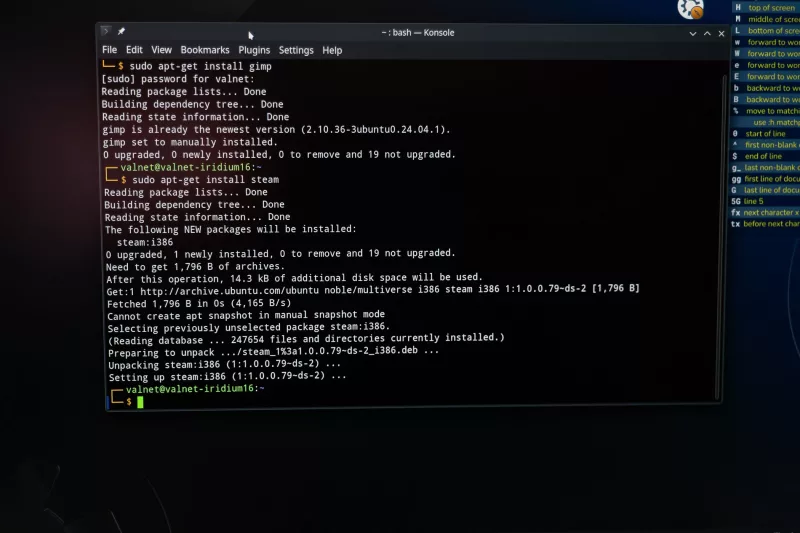

Bước 1: Thiết Lập Môi Trường

Đầu tiên, hãy cài đặt các thư viện cần thiết. Chúng ta sẽ cần langchain, openai (hoặc các thư viện tương ứng nếu dùng LLM khác), chromadb (hoặc Pinecone/Weaviate cho vector database), và unstructured (để đọc các loại tài liệu khác nhau).

pip install langchain openai chromadb unstructured pypdfBước 2: Thu Thập & Tiền Xử Lý Dữ Liệu

Giả sử chúng ta có một thư mục chứa các tài liệu PDF. Chúng ta sẽ sử dụng PyPDFLoader từ LangChain để tải các file này.

from langchain_community.document_loaders import PyPDFLoader

from langchain_text_splitters import RecursiveCharacterTextSplitter

import os

# Đường dẫn đến thư mục chứa tài liệu

data_dir = "data/"

documents = []

for filename in os.listdir(data_dir):

if filename.endswith(".pdf"):

file_path = os.path.join(data_dir, filename)

loader = PyPDFLoader(file_path)

documents.extend(loader.load())

# Chia nhỏ tài liệu thành các đoạn

text_splitter = RecursiveCharacterTextSplitter(

chunk_size=1000,

chunk_overlap=200,

length_function=len,

is_separator_regex=False,

)

chunks = text_splitter.split_documents(documents)

print(f"Tổng số chunks được tạo: {len(chunks)}")Bước 3: Tạo Embeddings và Lưu Trữ vào Vector Database

Chúng ta sẽ sử dụng OpenAI Embeddings và ChromaDB làm vector database. Bạn cần có API key của OpenAI.

from langchain_openai import OpenAIEmbeddings

from langchain_community.vectorstores import Chroma

# Khởi tạo OpenAI Embeddings

# Đảm bảo bạn đã đặt biến môi trường OPENAI_API_KEY

embeddings = OpenAIEmbeddings(model="text-embedding-ada-002")

# Tạo ChromaDB từ các chunks

# persist_directory sẽ lưu trữ database cục bộ

persist_directory = "chroma_db"

vectorstore = Chroma.from_documents(

documents=chunks,

embedding=embeddings,

persist_directory=persist_directory

)

print(f"Vector database đã được tạo và lưu trữ tại {persist_directory}")Bước 4: Xây Dựng Hệ Thống Truy Vấn (RAG Pipeline)

Bây giờ, chúng ta sẽ kết hợp vector database với một LLM (ví dụ: GPT-3.5-turbo) để tạo ra một chuỗi truy vấn thông minh.

from langchain_openai import ChatOpenAI

from langchain.chains import create_retrieval_chain

from langchain.chains.combine_documents import create_stuff_documents_chain

from langchain_core.prompts import ChatPromptTemplate

# Khởi tạo LLM

llm = ChatOpenAI(model="gpt-3.5-turbo", temperature=0.7)

# Tạo một retriever từ vectorstore

retriever = vectorstore.as_retriever(search_kwargs={"k": 5}) # Lấy 5 đoạn liên quan nhất

# Tạo prompt cho LLM

prompt = ChatPromptTemplate.from_template(

"""Trả lời câu hỏi dựa trên ngữ cảnh được cung cấp.

Nếu bạn không biết câu trả lời, hãy nói rằng bạn không biết, đừng cố bịa ra.

Ngữ cảnh:

{context}

Câu hỏi: {input}

"""

)

# Tạo chuỗi xử lý tài liệu (stuff documents chain)

document_chain = create_stuff_documents_chain(llm, prompt)

# Tạo chuỗi truy vấn (retrieval chain)

qa_chain = create_retrieval_chain(retriever, document_chain)

# Ví dụ truy vấn

question = "Những thách thức chính của dự án X là gì?"

response = qa_chain.invoke({"input": question})

print(f"Câu hỏi: {question}")

print(f"Câu trả lời: {response['answer']}")

print("\nCác nguồn tài liệu được sử dụng:")

for doc in response["context"]:

print(f"- {doc.metadata.get('source', 'Không rõ nguồn')}")Đoạn code trên minh họa một pipeline RAG cơ bản. Khi người dùng đặt câu hỏi, hệ thống sẽ:

- Nhúng câu hỏi thành vector.

- Tìm kiếm các đoạn văn bản liên quan nhất trong vector database.

- Đưa các đoạn văn bản này (context) cùng với câu hỏi vào LLM.

- LLM sử dụng context để tạo ra câu trả lời chính xác và có căn cứ.

Đây là nền tảng của một hệ thống quản lý tri thức AI mạnh mẽ. Bạn có thể mở rộng nó bằng cách thêm nhiều nguồn dữ liệu, cải thiện chiến lược chunking, tinh chỉnh prompt, và sử dụng các LLM mạnh mẽ hơn.

Tips và Best Practices cho Quản Lý Tri Thức AI Hiệu Quả

Xây dựng một hệ thống quản lý tri thức AI không chỉ là về code, mà còn là về chiến lược và tối ưu hóa. Dưới đây là một số mẹo và kinh nghiệm thực tế:

- Chất lượng dữ liệu là Vua: Dữ liệu “rác” sẽ cho ra kết quả “rác”. Đầu tư vào việc làm sạch, chuẩn hóa và duy trì chất lượng dữ liệu nguồn là cực kỳ quan trọng. Hãy đảm bảo các tài liệu được ghi chép rõ ràng, nhất quán và cập nhật.

- Chiến lược Chunking thông minh: Cách bạn chia nhỏ tài liệu (chunking) ảnh hưởng lớn đến hiệu suất của RAG. Chunk quá nhỏ có thể làm mất ngữ cảnh, chunk quá lớn có thể khiến LLM khó xử lý và tốn chi phí hơn. Hãy thử nghiệm các kích thước

chunk_sizevàchunk_overlapkhác nhau. Cân nhắc sử dụng các kỹ thuật chunking dựa trên cấu trúc tài liệu (ví dụ: theo tiêu đề, đoạn văn) thay vì chỉ dựa vào số ký tự. - Tối ưu hóa Prompt Engineering: Prompt là cầu nối giữa câu hỏi của người dùng và khả năng của LLM. Một prompt rõ ràng, cụ thể, và có hướng dẫn tốt sẽ giúp LLM tạo ra câu trả lời chất lượng cao hơn. Hãy thử nghiệm với các biến thể prompt, bao gồm các hướng dẫn về tone, độ dài, và định dạng câu trả lời mong muốn.

- Sử dụng Metadata hiệu quả: Lưu trữ metadata (như tác giả, ngày tạo, loại tài liệu, dự án liên quan) cùng với các embeddings trong vector database. Điều này cho phép bạn thực hiện các tìm kiếm có điều kiện (ví dụ: "Tìm tài liệu về dự án X do Y viết sau ngày Z") và lọc kết quả truy xuất để cung cấp ngữ cảnh chính xác hơn cho LLM.

- Liên tục theo dõi và cải thiện: Triển khai một vòng lặp phản hồi. Thu thập đánh giá của người dùng về chất lượng câu trả lời. Sử dụng dữ liệu này để tinh chỉnh các mô hình nhúng, LLM, prompt, và chiến lược truy xuất. Đây là một quá trình lặp đi lặp lại để quản lý tri thức AI ngày càng thông minh hơn.

- Bảo mật và Quyền riêng tư: Khi xử lý dữ liệu nhạy cảm, hãy đảm bảo rằng hệ thống của bạn tuân thủ các quy định về bảo mật và quyền riêng tư (ví dụ: GDPR, HIPAA). Sử dụng các giải pháp mã hóa, kiểm soát truy cập chặt chẽ và các mô hình LLM có khả năng chạy cục bộ hoặc trên môi trường an toàn nếu cần.

So Sánh Các Phương Pháp Quản Lý Tri Thức AI

Khi nói đến quản lý tri thức AI, có một số phương pháp chính mà chúng ta cần xem xét, mỗi phương pháp có ưu và nhược điểm riêng:

- RAG (Retrieval-Augmented Generation): Đây là phương pháp chúng ta vừa triển khai. RAG kết hợp khả năng truy xuất thông tin từ một kho dữ liệu bên ngoài với khả năng tạo văn bản của LLM.

- Ưu điểm: Giảm thiểu "hallucination" (LLM bịa đặt thông tin), cung cấp câu trả lời có căn cứ rõ ràng, dễ dàng cập nhật thông tin mới mà không cần huấn luyện lại toàn bộ LLM, chi phí hiệu quả hơn so với fine-tuning LLM cho dữ liệu riêng.

- Nhược điểm: Hiệu suất phụ thuộc nhiều vào chất lượng của retriever và vector database, có thể gặp khó khăn với các câu hỏi yêu cầu suy luận phức tạp hoặc tổng hợp thông tin từ nhiều nguồn rất khác nhau.

- Fine-tuning LLM: Huấn luyện một LLM hiện có trên tập dữ liệu cụ thể của bạn.

- Ưu điểm: LLM được "thấm nhuần" tri thức của bạn, có thể tạo ra câu trả lời tự nhiên và sâu sắc hơn, tốt cho các tác vụ đòi hỏi sự sáng tạo hoặc hiểu biết sâu sắc về một lĩnh vực cụ thể.

- Nhược điểm: Đắt đỏ và tốn thời gian, yêu cầu lượng lớn dữ liệu huấn luyện chất lượng cao, khó khăn trong việc cập nhật thông tin mới (phải fine-tuning lại), vẫn có nguy cơ "hallucination" nếu dữ liệu huấn luyện không đủ bao quát.

- Knowledge Graphs (Biểu đồ Tri thức): Biểu diễn tri thức dưới dạng các thực thể và mối quan hệ giữa chúng.

- Ưu điểm: Cung cấp cấu trúc rõ ràng cho tri thức, hỗ trợ suy luận phức tạp, tìm kiếm mối quan hệ ẩn, lý tưởng cho các miền tri thức có cấu trúc tốt.

- Nhược điểm: Tốn công sức để xây dựng và duy trì, khó khăn trong việc xử lý dữ liệu phi cấu trúc, cần các kỹ năng chuyên biệt về ontology và semantic web. Có thể kết hợp với RAG để tăng cường khả năng truy xuất.

Trong hầu hết các trường hợp xây dựng "bộ não" AI cá nhân hóa hoặc cộng tác, RAG là lựa chọn cân bằng tốt nhất giữa hiệu quả, chi phí và khả năng mở rộng. Nó cho phép chúng ta tận dụng sức mạnh của các LLM tiên tiến mà không cần phải tái huấn luyện chúng, đồng thời đảm bảo rằng các câu trả lời luôn được dựa trên nguồn dữ liệu đáng tin cậy của chúng ta. Quản lý tri thức AI sẽ ngày càng trở nên quan trọng hơn.

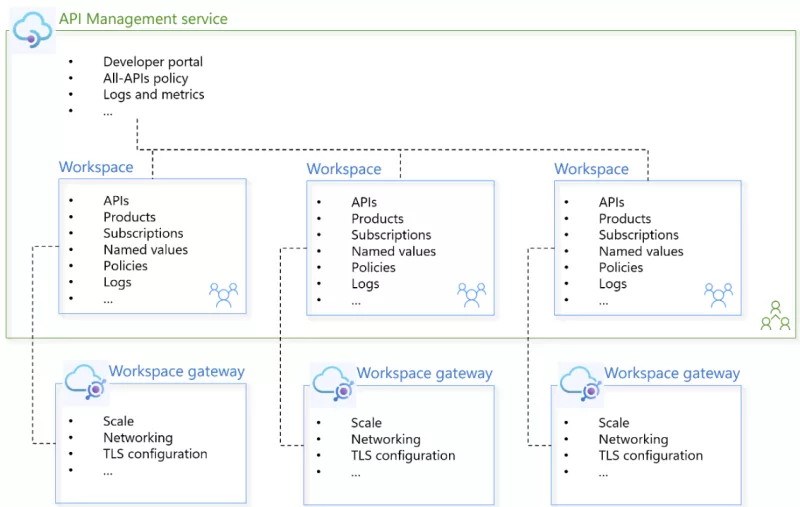

Các Lưu Ý Quan Trọng

- Tính khả mở rộng (Scalability): Khi lượng dữ liệu tăng lên, hệ thống của bạn có khả năng mở rộng để xử lý không? Cân nhắc sử dụng các dịch vụ cloud cho vector database (ví dụ: Pinecone, Weaviate Cloud) và LLM (OpenAI API, Google Cloud AI) để đảm bảo hiệu suất.

- Chi phí: Việc sử dụng LLM và embeddings có thể tốn kém, đặc biệt với khối lượng dữ liệu lớn và tần suất truy vấn cao. Theo dõi chi phí API và tối ưu hóa số lượng token được gửi đến LLM.

- Xử lý lỗi và Độ bền: Xây dựng cơ chế xử lý lỗi mạnh mẽ cho các bước thu thập dữ liệu, tạo embedding, và gọi API LLM. Đảm bảo rằng hệ thống có thể phục hồi gracefully từ các lỗi tạm thời.

- Tích hợp: "Bộ não" AI của bạn sẽ hoạt động hiệu quả nhất khi nó được tích hợp liền mạch vào quy trình làm việc hiện có của người dùng. Cân nhắc xây dựng các plugin cho các công cụ phổ biến hoặc API để các ứng dụng khác có thể tương tác.

- Đa ngôn ngữ: Nếu tổ chức của bạn hoạt động đa quốc gia, hãy xem xét khả năng hỗ trợ nhiều ngôn ngữ cho hệ thống quản lý tri thức AI của bạn, từ việc tiền xử lý dữ liệu đến mô hình nhúng và LLM.

- Tốc độ phản hồi (Latency): Đối với các ứng dụng tương tác trực tiếp (ví dụ: chatbot), tốc độ phản hồi là rất quan trọng. Tối ưu hóa chuỗi RAG để giảm thiểu độ trễ, có thể bằng cách sử dụng các LLM nhỏ hơn, nhanh hơn hoặc các kỹ thuật caching.

- Phiên bản hóa và Quản lý thay đổi: Tri thức không ngừng thay đổi. Hãy có một chiến lược để quản lý các phiên bản tài liệu và cập nhật vector database một cách định kỳ hoặc tự động khi có thay đổi trong nguồn dữ liệu.

Câu Hỏi Thường Gặp

Làm thế nào để xử lý các loại tài liệu khác nhau (Word, Excel, HTML) trong hệ thống quản lý tri thức AI?

Để xử lý các loại tài liệu khác nhau, bạn có thể sử dụng các thư viện như unstructured trong Python, nó hỗ trợ phân tích và trích xuất văn bản từ nhiều định dạng file. LangChain cũng cung cấp các loader tích hợp cho nhiều loại file, ví dụ UnstructuredWordLoader, CSVLoader, HTMLLoader. Mục tiêu là chuyển đổi tất cả thành văn bản thuần túy trước khi tạo embeddings.

Có cần phải huấn luyện lại LLM nếu dữ liệu của tôi thay đổi thường xuyên không?

Không nhất thiết. Đây là một trong những ưu điểm lớn của kiến trúc RAG. Khi dữ liệu nguồn của bạn thay đổi (ví dụ: có tài liệu mới, tài liệu cũ được cập nhật), bạn chỉ cần cập nhật lại vector database (tạo embeddings mới cho các phần dữ liệu thay đổi hoặc mới). LLM vẫn giữ nguyên, và nó sẽ sử dụng thông tin mới được truy xuất từ vector database để trả lời các câu hỏi, giúp quá trình quản lý tri thức AI linh hoạt hơn.

Có thể sử dụng các LLM mã nguồn mở thay vì OpenAI không?

Hoàn toàn có thể! Có rất nhiều LLM mã nguồn mở mạnh mẽ như Llama, Mistral, Falcon, v.v., mà bạn có thể chạy cục bộ hoặc trên các nền tảng đám mây. LangChain được thiết kế để tương thích với nhiều nhà cung cấp LLM khác nhau. Việc sử dụng LLM mã nguồn mở có thể giúp giảm chi phí và tăng cường kiểm soát dữ liệu, đặc biệt quan trọng cho các ứng dụng quản lý tri thức AI có yêu cầu bảo mật cao.

Làm thế nào để đảm bảo rằng câu trả lời của AI là chính xác và không bị "hallucination"?

Để giảm thiểu "hallucination", hãy tập trung vào việc cung cấp ngữ cảnh (context) chất lượng cao và phù hợp nhất cho LLM thông qua RAG. Tinh chỉnh prompt để yêu cầu LLM chỉ trả lời dựa trên ngữ cảnh được cung cấp và nói "tôi không biết" nếu thông tin không có. Ngoài ra, việc triển khai một vòng lặp phản hồi của người dùng để đánh giá và hiệu chỉnh câu trả lời là rất quan trọng để liên tục cải thiện độ chính xác của hệ thống quản lý tri thức AI.

Kết Luận

Xây dựng một "bộ não" AI cá nhân hóa hay một hệ thống quản lý tri thức cộng tác thông minh không còn là viễn cảnh xa vời. Với sự phát triển của các công nghệ AI như LLM và các framework như LangChain, chúng ta có trong tay những công cụ mạnh mẽ để biến ý tưởng này thành hiện thực. Từ việc thu thập dữ liệu, tạo embeddings, đến xây dựng pipeline RAG, mỗi bước đều đóng góp vào việc tạo ra một trợ lý AI có khả năng hiểu, xử lý và tạo ra tri thức một cách thông minh.

Đây là một lĩnh vực đầy tiềm năng, hứa hẹn mang lại những đột phá đáng kể trong cách chúng ta tương tác với thông tin và ra quyết định. Bằng cách áp dụng những kiến thức và ví dụ code trong bài viết này, bạn đã có một nền tảng vững chắc để bắt đầu hành trình xây dựng "bộ não" AI của riêng mình. Hãy tiếp tục khám phá, thử nghiệm và chia sẻ những thành quả của bạn. Cộng đồng tại vibe coding luôn sẵn sàng đồng hành cùng bạn trên con đường chinh phục những đỉnh cao công nghệ mới, đặc biệt trong lĩnh vực quản lý tri thức AI đầy thú vị này. Chúc bạn thành công!