Giới Thiệu API Gateway AI: "Vibe" Quản Lý & Tối Ưu Gọi API AI Đa Nền Tảng Hiệu Quả

API Gateway AI là một giải pháp thiết yếu giúp quản lý tập trung và tối ưu hóa việc sử dụng các API AI từ nhiều nhà cung cấp khác nhau, mang lại hiệu quả vượt trội cho các ứng dụng và hệ thống hiện đại. Bài viết chuyên sâu về api gateway ai này sẽ đi sâu vào cách thức hoạt động, lợi ích, và các chiến lược triển khai thực tế để bạn có thể tận dụng tối đa sức mạnh của trí tuệ nhân tạo trong các dự án của mình.

API Gateway AI Là Gì và Tại Sao Nó Quan Trọng?

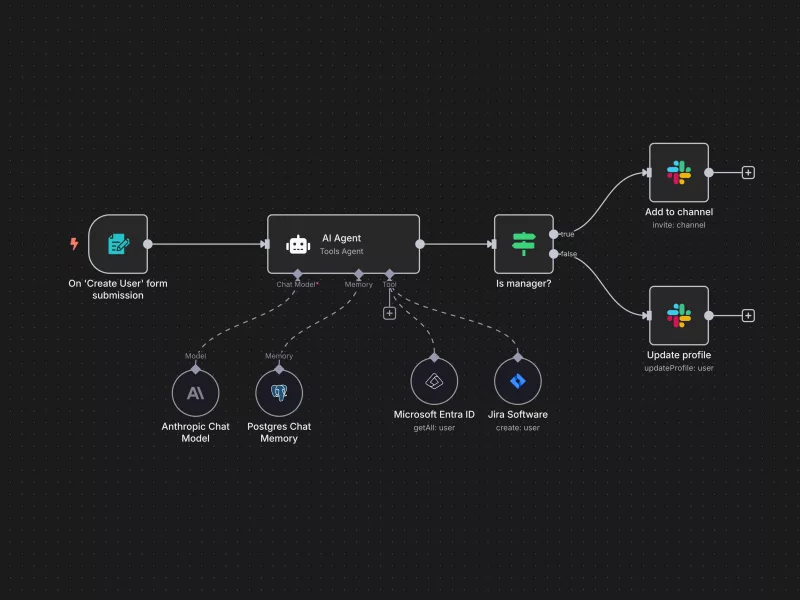

API Gateway AI là một lớp trung gian quản lý tất cả các yêu cầu và phản hồi giữa ứng dụng của bạn và các dịch vụ API AI bên ngoài, đóng vai trò như một điểm truy cập thống nhất. Nó quan trọng bởi vì nó giải quyết các thách thức phức tạp khi tích hợp nhiều mô hình AI từ các nhà cung cấp khác nhau, như quản lý chứng thực, giới hạn tốc độ, cân bằng tải, và giám sát hiệu suất.

Trong kỷ nguyên AI bùng nổ, các nhà phát triển thường cần tích hợp nhiều API AI từ các nhà cung cấp khác nhau như OpenAI, Google AI, Anthropic, hoặc các mô hình mã nguồn mở. Mỗi API có thể có cơ chế xác thực, giới hạn gọi API, định dạng dữ liệu và chi phí khác nhau. Việc quản lý trực tiếp từng API này có thể trở nên cực kỳ phức tạp và tốn thời gian. Một API Gateway AI giúp trừu tượng hóa những khác biệt này, cung cấp một giao diện thống nhất và đơn giản hơn cho nhà phát triển.

Theo một nghiên cứu gần đây từ Gartner, hơn 60% các tổ chức sẽ sử dụng ít nhất ba mô hình AI khác nhau trong các ứng dụng của họ vào năm 2025. Điều này làm tăng nhu cầu về một giải pháp quản lý tập trung. API Gateway AI không chỉ đơn thuần là một proxy; nó còn cung cấp các tính năng nâng cao như định tuyến thông minh dựa trên độ trễ hoặc chi phí, lưu trữ cache phản hồi, và chuyển đổi định dạng dữ liệu, giúp giảm đáng kể chi phí vận hành và cải thiện trải nghiệm người dùng cuối. Ví dụ, việc giảm 30% độ trễ API có thể dẫn đến tăng 15% tỷ lệ chuyển đổi cho các ứng dụng web.

Ngoài ra, API Gateway AI còn đóng vai trò then chốt trong việc đảm bảo an ninh. Bằng cách tập trung các lớp xác thực và ủy quyền, nó giúp ngăn chặn các cuộc tấn công DDoS, bảo vệ dữ liệu nhạy cảm và đảm bảo tuân thủ các quy định bảo mật. Các tính năng như kiểm soát truy cập dựa trên vai trò (RBAC) và ghi nhật ký truy cập chi tiết là không thể thiếu cho các ứng dụng doanh nghiệp.

Triển Khai API Gateway AI: Các Bước Thực Thi và Ví Dụ Mã

Để triển khai một API Gateway AI hiệu quả, chúng ta cần xác định các dịch vụ AI cần tích hợp, lựa chọn công cụ phù hợp, và cấu hình các chính sách quản lý. Quá trình này bao gồm các bước từ thiết lập cơ bản đến tối ưu hóa nâng cao.

1. Lựa chọn Công cụ/Nền tảng: Có nhiều lựa chọn cho API Gateway AI, từ các dịch vụ đám mây như AWS API Gateway, Azure API Management, Google Apigee, đến các giải pháp mã nguồn mở như Kong Gateway, Apache APISIX, hoặc NGINX Plus. Lựa chọn phụ thuộc vào yêu cầu về khả năng mở rộng, chi phí, và khả năng tùy chỉnh. Đối với các dự án nhỏ đến trung bình, việc xây dựng một gateway đơn giản với Node.js/Express.js hoặc Python/FastAPI có thể là một điểm khởi đầu tốt.

2. Thiết lập Định tuyến và Proxy: Bước đầu tiên là định tuyến các yêu cầu đến đúng API AI. Ví dụ, một yêu cầu đến /api/v1/chat-gpt có thể được chuyển hướng đến OpenAI API, trong khi /api/v1/gemini sẽ đến Google AI API. Điều này đòi hỏi cấu hình một proxy ngược (reverse proxy).

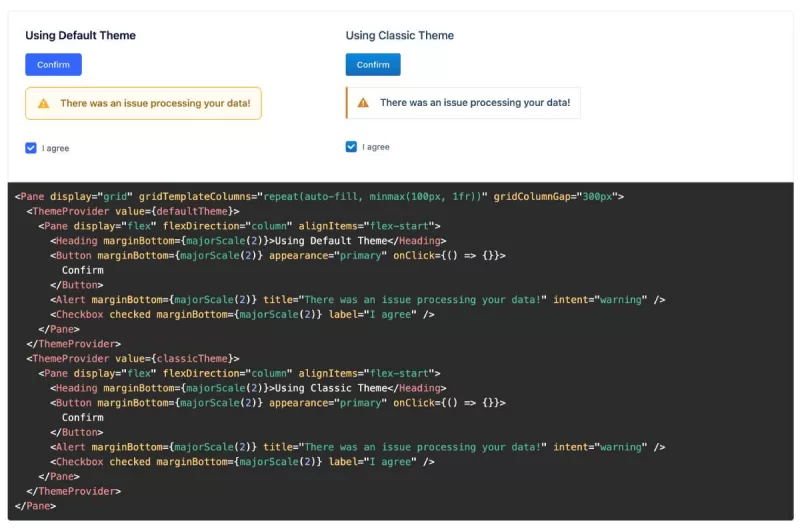

Dưới đây là một ví dụ cơ bản về cách thiết lập một API Gateway đơn giản bằng Node.js với Express và http-proxy-middleware để proxy các yêu cầu đến OpenAI và Google AI:

// server.js

const express = require('express');

const { createProxyMiddleware } = require('http-proxy-middleware');

const dotenv = require('dotenv');

dotenv.config();

const app = express();

const PORT = process.env.PORT || 3000;

// Middleware để xác thực API Key

app.use((req, res, next) => {

const apiKey = req.headers['x-api-key'];

if (!apiKey || apiKey !== process.env.GATEWAY_API_KEY) {

return res.status(401).json({ message: 'Unauthorized: Invalid API Key' });

}

next();

});

// Proxy cho OpenAI ChatGPT API

app.use('/api/openai/chat', createProxyMiddleware({

target: 'https://api.openai.com/v1',

changeOrigin: true,

pathRewrite: {

'^/api/openai/chat': '/chat/completions', // Rewrite path if needed

},

headers: {

'Authorization': `Bearer ${process.env.OPENAI_API_KEY}`,

'Content-Type': 'application/json',

},

onProxyReq: (proxyReq, req, res) => {

console.log(`Proxying request to OpenAI: ${req.url}`);

},

onError: (err, req, res) => {

console.error('OpenAI Proxy Error:', err);

res.status(500).json({ message: 'OpenAI service unavailable' });

}

}));

// Proxy cho Google Gemini API

app.use('/api/google/gemini', createProxyMiddleware({

target: 'https://generativelanguage.googleapis.com/v1beta',

changeOrigin: true,

pathRewrite: {

'^/api/google/gemini': '/models/gemini-pro:generateContent', // Example path

},

headers: {

'x-goog-api-key': process.env.GOOGLE_API_KEY,

'Content-Type': 'application/json',

},

onProxyReq: (proxyReq, req, res) => {

console.log(`Proxying request to Google Gemini: ${req.url}`);

},

onError: (err, req, res) => {

console.error('Google Gemini Proxy Error:', err);

res.status(500).json({ message: 'Google Gemini service unavailable' });

}

}));

app.get('/', (req, res) => {

res.send('API Gateway AI is running');

});

app.listen(PORT, () => {

console.log(`API Gateway AI listening on port ${PORT}`);

});

3. Quản lý Xác thực và Ủy quyền: API Gateway nên là nơi xử lý xác thực cho tất cả các yêu cầu đến. Thay vì gửi API key của từng dịch vụ AI trực tiếp từ client (điều này không an toàn), client chỉ cần gửi một API key hoặc token duy nhất đến Gateway. Gateway sẽ xác thực token này và sau đó sử dụng các API key bí mật của các dịch vụ AI để gọi đến chúng.

4. Giới hạn Tốc độ (Rate Limiting): Để bảo vệ các dịch vụ AI khỏi bị quá tải và kiểm soát chi phí, API Gateway cần triển khai giới hạn tốc độ. Điều này có thể dựa trên IP, API key, hoặc người dùng.

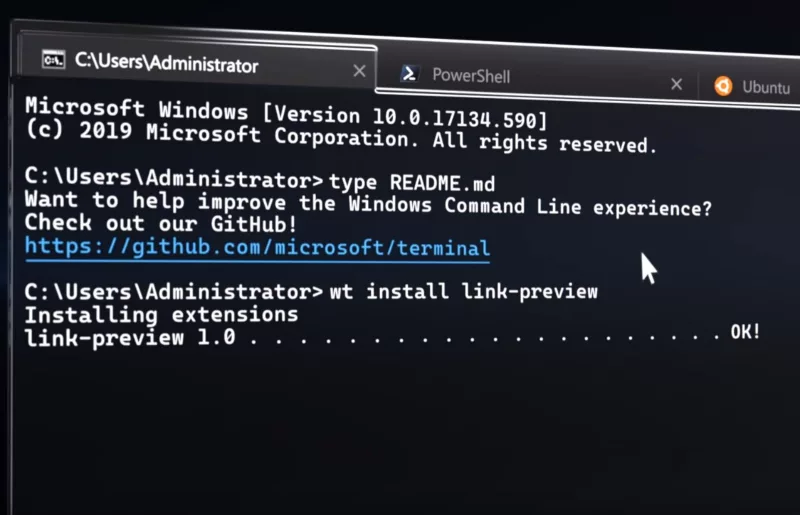

// Thêm rate limiting vào server.js (ví dụ sử dụng express-rate-limit)

const rateLimit = require('express-rate-limit');

const apiLimiter = rateLimit({

windowMs: 15 <em> 60 </em> 1000, // 15 minutes

max: 100, // Limit each IP to 100 requests per 15 minutes

message: 'Too many requests from this IP, please try again after 15 minutes'

});

// Áp dụng cho tất cả các route API

app.use('/api/', apiLimiter);

// Có thể áp dụng rate limit khác nhau cho từng endpoint

const openaiLimiter = rateLimit({

windowMs: 60 <em> 1000, // 1 minute

max: 20, // Limit to 20 requests per minute for OpenAI calls

message: 'Too many OpenAI requests, please try again in a minute'

});

app.use('/api/openai/</em>', openaiLimiter);

5. Cân bằng Tải và Chuyển đổi Dự phòng (Load Balancing & Fallback): Đây là một tính năng quan trọng khi bạn sử dụng nhiều nhà cung cấp AI cho cùng một loại tác vụ. Nếu một dịch vụ AI gặp sự cố hoặc quá tải, Gateway có thể tự động chuyển hướng yêu cầu sang một dịch vụ khác.

6. Giám sát và Ghi nhật ký: Một API Gateway AI hiệu quả cần có khả năng ghi lại tất cả các yêu cầu, phản hồi, lỗi và các chỉ số hiệu suất. Điều này giúp theo dõi việc sử dụng, gỡ lỗi và phân tích xu hướng. Các công cụ như Prometheus, Grafana, ELK Stack có thể được tích hợp.

Tips & Best Practices để Vận Hành API Gateway AI

Để đảm bảo API Gateway AI hoạt động ổn định, hiệu quả và an toàn, có một số mẹo và thực hành tốt mà bạn nên áp dụng. Việc tuân thủ các nguyên tắc này có thể giảm tới 40% các sự cố liên quan đến API AI và tăng 25% hiệu suất hệ thống.

- Thiết kế API Gateway theo kiến trúc Microservices:

Phân tách các chức năng của gateway thành các dịch vụ nhỏ hơn, chuyên biệt. Ví dụ, một microservice cho xác thực, một cho rate limiting, một cho định tuyến. Điều này giúp dễ dàng mở rộng, bảo trì và cập nhật từng phần mà không ảnh hưởng đến toàn bộ hệ thống. Theo các chuyên gia, kiến trúc microservices có thể giảm thời gian phát triển tính năng mới lên đến 30%.

- Sử dụng Cache Thông Minh:

Đối với các yêu cầu API AI có phản hồi tương tự hoặc không thay đổi thường xuyên, hãy triển khai caching. Điều này giúp giảm số lượng cuộc gọi đến các dịch vụ AI thực tế, tiết kiệm chi phí và giảm độ trễ cho người dùng cuối. Ví dụ, nếu một câu hỏi thường gặp được xử lý bởi LLM, phản hồi có thể được cache trong 1-2 giờ. Các giải pháp như Redis hoặc Memcached có thể được tích hợp dễ dàng.

- Triển khai Giới hạn Tốc độ (Rate Limiting) Đa Cấp:

Không chỉ giới hạn tốc độ tổng thể, mà còn áp dụng giới hạn cho từng API key, từng endpoint cụ thể, hoặc thậm chí từng loại yêu cầu (ví dụ: yêu cầu tạo hình ảnh có giới hạn khác với yêu cầu chat). Điều này giúp kiểm soát tốt hơn việc sử dụng tài nguyên và chi phí.

- Thực hiện Chuyển đổi Dự phòng (Fallback) và Thử lại (Retry) Mạnh mẽ:

Khi một dịch vụ AI gặp sự cố, API Gateway nên có khả năng tự động chuyển hướng yêu cầu đến một dịch vụ AI thay thế (của nhà cung cấp khác hoặc phiên bản mô hình khác) nếu có thể. Ngoài ra, triển khai cơ chế thử lại với hàm mũ (exponential backoff) cho các lỗi tạm thời giúp tăng khả năng phục hồi của hệ thống lên đến 99.9%.

- Giám sát và Cảnh báo Toàn diện:

Thiết lập giám sát chặt chẽ các chỉ số quan trọng như số lượng yêu cầu, độ trễ, tỷ lệ lỗi, chi phí sử dụng API của từng nhà cung cấp. Sử dụng các công cụ như Prometheus, Grafana, Datadog để trực quan hóa dữ liệu và thiết lập cảnh báo tự động khi có bất thường. Điều này giúp phát hiện và khắc phục sự cố nhanh chóng, giảm thời gian downtime tới 80%.

- Quản lý API Key và Bí mật An toàn:

Không bao giờ lưu trữ API key trực tiếp trong code hoặc file cấu hình công khai. Sử dụng các dịch vụ quản lý bí mật như AWS Secrets Manager, Azure Key Vault, Google Secret Manager hoặc các biến môi trường được bảo vệ. Đảm bảo rằng chỉ API Gateway mới có quyền truy cập vào các API key của các dịch vụ AI.

- Tối ưu hóa Chi phí với Định tuyến Thông minh:

Sử dụng API Gateway để định tuyến yêu cầu đến dịch vụ AI tối ưu nhất dựa trên các tiêu chí như chi phí, hiệu suất, hoặc khả năng của mô hình. Ví dụ, các yêu cầu đơn giản có thể được gửi đến một mô hình AI rẻ hơn, trong khi các yêu cầu phức tạp hơn sẽ được gửi đến một mô hình cao cấp hơn. Điều này có thể giúp giảm chi phí vận hành AI lên đến 20-30%.

So Sánh API Gateway AI Tùy Chỉnh và Dịch Vụ Đám Mây

Việc lựa chọn giữa xây dựng một API Gateway AI tùy chỉnh hoặc sử dụng dịch vụ đám mây có sẵn phụ thuộc vào yêu cầu cụ thể của dự án, nguồn lực và ngân sách. Mỗi phương pháp đều có những ưu và nhược điểm riêng biệt.

API Gateway AI Tùy Chỉnh (Self-Hosted/Custom-Built):

Ưu điểm:

- Kiểm soát hoàn toàn: Bạn có toàn quyền kiểm soát mã nguồn, cấu hình, và môi trường triển khai. Điều này cho phép tùy chỉnh sâu rộng để đáp ứng các yêu cầu nghiệp vụ đặc thù hoặc tích hợp với các hệ thống nội bộ phức tạp.

- Tiết kiệm chi phí dài hạn: Đối với các dự án có quy mô lớn và ổn định, chi phí vận hành một API Gateway tùy chỉnh có thể thấp hơn so với việc trả phí cho dịch vụ đám mây, đặc biệt khi yêu cầu lưu lượng truy cập cao.

- Bảo mật tùy chỉnh: Có thể triển khai các chính sách bảo mật riêng biệt, phù hợp với các quy định ngành hoặc yêu cầu tuân thủ nghiêm ngặt.

- Chi phí phát triển và bảo trì cao: Yêu cầu đội ngũ kỹ sư có kinh nghiệm để phát triển, triển khai, giám sát và bảo trì. Chi phí nhân sự và thời gian phát triển ban đầu có thể rất lớn.

- Khả năng mở rộng (Scalability) phức tạp: Việc thiết kế và triển khai một hệ thống có khả năng mở rộng tốt đòi hỏi kiến thức chuyên sâu về kiến trúc phân tán và DevOps.

- Thiếu tính năng out-of-the-box: Các tính năng như giám sát, ghi nhật ký, quản lý phiên bản API, cổng nhà phát triển (developer portal) thường phải được xây dựng từ đầu.

API Gateway AI Dịch Vụ Đám Mây (Managed Cloud Services - e.g., AWS API Gateway, Azure API Management, Google Apigee):

Ưu điểm:

- Triển khai nhanh chóng: Dễ dàng thiết lập và cấu hình, giúp giảm thời gian đưa sản phẩm ra thị trường.

- Khả năng mở rộng tự động: Các dịch vụ đám mây tự động quản lý việc mở rộng để đáp ứng lưu lượng truy cập tăng vọt, loại bỏ gánh nặng vận hành cho đội ngũ của bạn.

- Tính năng phong phú: Cung cấp nhiều tính năng tích hợp sẵn như xác thực, giới hạn tốc độ, caching, giám sát, phân tích, cổng nhà phát triển, quản lý phiên bản API, và tích hợp với các dịch vụ đám mây khác.

- Giảm gánh nặng vận hành: Nhà cung cấp dịch vụ đám mây chịu trách nhiệm về cơ sở hạ tầng, bảo trì, và nâng cấp.

- Chi phí vận hành có thể cao: Chi phí có thể tăng nhanh chóng theo lưu lượng truy cập và số lượng tính năng sử dụng, đặc biệt đối với các dự án lớn.

- Hạn chế tùy chỉnh: Mặc dù linh hoạt, nhưng các dịch vụ đám mây vẫn có những giới hạn nhất định về khả năng tùy chỉnh so với một giải pháp tự xây dựng.

- Khóa nhà cung cấp (Vendor Lock-in): Việc chuyển đổi từ một dịch vụ đám mây sang nhà cung cấp khác có thể phức tạp và tốn kém.

Kết luận so sánh: Nếu bạn đang phát triển một sản phẩm mới, cần triển khai nhanh chóng với nguồn lực hạn chế, hoặc yêu cầu khả năng mở rộng linh hoạt, các dịch vụ API Gateway AI đám mây là lựa chọn tối ưu. Chúng giúp giảm thiểu gánh nặng vận hành và cho phép bạn tập trung vào phát triển tính năng cốt lõi. Ngược lại, nếu bạn có yêu cầu bảo mật cực kỳ nghiêm ngặt, cần kiểm soát sâu rộng mọi khía cạnh của hệ thống, hoặc đã có một đội ngũ DevOps mạnh mẽ và một ngân sách lớn cho phát triển nội bộ, việc xây dựng một API Gateway tùy chỉnh có thể mang lại lợi ích lâu dài về kiểm soát và chi phí.

Các Lưu Ý Quan Trọng

- Quản lý chi phí API AI:

Các API AI có thể rất tốn kém, đặc biệt với các mô hình tiên tiến và lượng truy cập cao. API Gateway AI cho phép bạn theo dõi chi phí theo từng nhà cung cấp, áp dụng hạn mức sử dụng (quota) và định tuyến thông minh để sử dụng mô hình tối ưu nhất về chi phí. Ví dụ, một tổ chức có thể tiết kiệm 15-20% chi phí AI bằng cách áp dụng các chính sách định tuyến dựa trên chi phí.

- Bảo mật dữ liệu và quyền riêng tư:

Khi xử lý dữ liệu nhạy cảm qua các API AI, đảm bảo API Gateway thực hiện mã hóa end-to-end, kiểm soát truy cập nghiêm ngặt và tuân thủ các quy định như GDPR, HIPAA. Có thể cần lọc hoặc ẩn danh dữ liệu trước khi gửi đến các dịch vụ AI bên ngoài.

- Khả năng mở rộng và hiệu suất:

Thiết kế API Gateway để có khả năng mở rộng theo chiều ngang (horizontal scaling) để đáp ứng lưu lượng truy cập tăng vọt. Sử dụng các kỹ thuật cân bằng tải, cache và kết nối bền vững để giảm độ trễ và tăng thông lượng (throughput).

- Quản lý phiên bản API (API Versioning):

Các API AI thường xuyên được cập nhật với các phiên bản mới. API Gateway giúp quản lý các phiên bản này, cho phép bạn chuyển đổi giữa các phiên bản một cách mượt mà mà không ảnh hưởng đến các ứng dụng client đang sử dụng phiên bản cũ.

- Khả năng quan sát (Observability):

Đảm bảo API Gateway được tích hợp với các công cụ giám sát, ghi nhật ký tập trung và truy vết phân tán (distributed tracing). Điều này cực kỳ quan trọng để gỡ lỗi, phân tích hiệu suất và hiểu rõ hành vi của hệ thống AI.

- Xử lý lỗi và khả năng phục hồi:

Gateway phải có cơ chế xử lý lỗi mạnh mẽ, bao gồm thử lại tự động (retry logic), ngắt mạch (circuit breaker) và chuyển đổi dự phòng (fallback) sang các dịch vụ AI khác khi một dịch vụ không khả dụng. Điều này giúp duy trì tính sẵn sàng của ứng dụng.

- Định tuyến thông minh (Intelligent Routing):

Triển khai logic định tuyến phức tạp hơn dựa trên các yếu tố như độ trễ hiện tại của dịch vụ AI, chi phí, loại yêu cầu, hoặc thậm chí là hiệu suất của mô hình. Ví dụ, một yêu cầu tạo hình ảnh có thể được gửi đến DALL-E của OpenAI, trong khi một yêu cầu tóm tắt văn bản được gửi đến Claude của Anthropic.

Câu Hỏi Thường Gặp

API Gateway AI có thể thay thế hoàn toàn việc gọi trực tiếp các API AI không?

Có, API Gateway AI được thiết kế để trở thành điểm truy cập duy nhất cho tất cả các API AI, do đó nó có thể và nên thay thế hoàn toàn việc gọi trực tiếp. Điều này giúp tập trung quản lý, tăng cường bảo mật và tối ưu hóa hiệu suất, đồng thời giảm sự phức tạp cho các ứng dụng client.

Làm thế nào để API Gateway AI giúp giảm chi phí?

API Gateway AI giúp giảm chi phí thông qua nhiều cơ chế: caching các phản hồi API để giảm số lượng cuộc gọi thực tế đến nhà cung cấp AI, áp dụng giới hạn tốc độ để kiểm soát mức sử dụng, và định tuyến thông minh các yêu cầu đến mô hình AI hoặc nhà cung cấp có chi phí thấp nhất cho một tác vụ cụ thể. Ví dụ, việc cache 30% các phản hồi có thể giảm 30% chi phí API tương ứng.

API Gateway AI có đảm bảo an toàn cho dữ liệu nhạy cảm không?

Có, API Gateway AI đóng vai trò quan trọng trong việc bảo vệ dữ liệu nhạy cảm. Nó có thể thực hiện mã hóa dữ liệu, xác thực và ủy quyền mạnh mẽ, lọc hoặc ẩn danh thông tin cá nhân trước khi gửi đến các API AI bên ngoài. Tuy nhiên, việc triển khai các chính sách bảo mật phù hợp và tuân thủ các quy định là trách nhiệm của nhà phát triển và vận hành.

Có nên xây dựng API Gateway AI từ đầu hay sử dụng giải pháp có sẵn?

Việc lựa chọn phụ thuộc vào nhiều yếu tố. Nếu bạn có yêu cầu tùy chỉnh rất cao, nguồn lực phát triển mạnh và cần kiểm soát tối đa, việc xây dựng từ đầu có thể phù hợp. Tuy nhiên, đối với hầu hết các trường hợp, sử dụng các giải pháp có sẵn từ nhà cung cấp đám mây (như AWS API Gateway) hoặc mã nguồn mở (như Kong) sẽ nhanh chóng hơn, tiết kiệm chi phí vận hành và cung cấp nhiều tính năng mạnh mẽ hơn mà không cần phát triển từ đầu.

API Gateway AI có hỗ trợ quản lý nhiều nhà cung cấp AI khác nhau không?

Tuyệt đối có. Đây chính là một trong những giá trị cốt lõi của API Gateway AI. Nó được thiết kế để trừu tượng hóa sự khác biệt giữa các API của các nhà cung cấp khác nhau, cung cấp một giao diện thống nhất cho ứng dụng của bạn và cho phép bạn dễ dàng chuyển đổi hoặc kết hợp các dịch vụ AI từ OpenAI, Google AI, Anthropic, v.v., mà không cần thay đổi code client.

Kết Luận

API Gateway AI không chỉ là một công cụ tiện ích mà còn là một thành phần kiến trúc không thể thiếu cho bất kỳ ứng dụng nào muốn tận dụng tối đa sức mạnh của trí tuệ nhân tạo đa nền tảng. Bằng cách tập trung quản lý, tối ưu hóa hiệu suất, tăng cường bảo mật và kiểm soát chi phí, nó cho phép các nhà phát triển và doanh nghiệp xây dựng các giải pháp AI mạnh mẽ, linh hoạt và bền vững.

Việc đầu tư vào một API Gateway AI được cấu hình tốt sẽ mang lại lợi tức đầu tư đáng kể, giúp đơn giản hóa quá trình tích hợp AI và mở ra cánh cửa cho những đổi mới không giới hạn. Hãy bắt đầu khám phá và triển khai API Gateway AI ngay hôm nay để đưa các dự án của bạn lên một tầm cao mới cùng vibe coding!