Giới Thiệu Tối Ưu Hóa Chi Phí API AI: Chiến Lược Kết Hợp Đa Mô Hình (Multi-Model) Thách Thức Big Tech Cùng Vibe Coding

Trong kỷ nguyên AI bùng nổ, việc tích hợp các mô hình trí tuệ nhân tạo vào sản phẩm và dịch vụ đã trở thành xu thế tất yếu. Tuy nhiên, chi phí sử dụng API của các nhà cung cấp lớn như OpenAI, Google Gemini hay Anthropic Claude có thể nhanh chóng trở thành gánh nặng đáng kể, đặc biệt đối với các startup và doanh nghiệp nhỏ. Với vai trò là chuyên gia vibe coding và AI development, bài viết về Chiến lược API AI này sẽ giúp bạn hiểu rõ về cách tối ưu hóa chi phí mà vẫn đảm bảo hiệu suất và chất lượng, bằng cách áp dụng chiến lược kết hợp đa mô hình (multi-model). Chúng ta sẽ cùng nhau khám phá những phương pháp thông minh để thách thức sự độc quyền của Big Tech và xây dựng giải pháp AI bền vững.

Thực Trạng Và Thách Thức Chi Phí API AI Hiện Nay

Chi phí API AI là một trong những rào cản lớn nhất khi triển khai các ứng dụng AI quy mô lớn. Các nhà cung cấp hàng đầu thường tính phí dựa trên số lượng token đầu vào (input tokens) và token đầu ra (output tokens), đôi khi còn có phí cho các tính năng nâng cao như fine-tuning hay truy cập các mô hình chuyên biệt. Đối với các ứng dụng có lưu lượng truy cập cao, hoặc những tác vụ đòi hỏi xử lý lượng lớn dữ liệu, chi phí này có thể tăng vọt theo cấp số nhân. Điều này đặc biệt đúng với các mô hình "flagship" như GPT-4 hay Claude 3 Opus, vốn có hiệu năng vượt trội nhưng đi kèm với mức giá không hề nhỏ.

Vấn đề không chỉ nằm ở giá thành đơn vị, mà còn ở sự thiếu linh hoạt. Khi một ứng dụng phụ thuộc hoàn toàn vào một nhà cung cấp API duy nhất, doanh nghiệp sẽ đối mặt với rủi ro về sự gián đoạn dịch vụ, thay đổi chính sách giá đột ngột, hoặc thậm chí là sự chậm trễ trong việc triển khai các tính năng mới. Điều này đặt ra một nhu cầu cấp thiết về một Chiến lược API AI toàn diện, không chỉ tập trung vào việc cắt giảm chi phí mà còn tăng cường khả năng phục hồi và thích ứng của hệ thống.

Hơn nữa, không phải mọi tác vụ AI đều cần đến mô hình mạnh nhất và đắt nhất. Một lỗi phổ biến là sử dụng "súng lớn để bắn chim sẻ" – tức là dùng GPT-4 cho những tác vụ đơn giản như phân loại văn bản cơ bản hay tóm tắt ngắn gọn, trong khi một mô hình nhỏ hơn, nhanh hơn và rẻ hơn có thể hoàn thành tốt công việc. Việc nhận diện được sự khác biệt này chính là chìa khóa để bắt đầu hành trình tối ưu hóa.

Thách thức lớn nhất là làm thế nào để quản lý sự phức tạp khi tích hợp nhiều mô hình từ các nhà cung cấp khác nhau. Mỗi API có thể có cấu trúc request/response, cách xác thực và giới hạn tốc độ (rate limit) riêng. Điều này đòi hỏi một kiến trúc linh hoạt, có khả năng điều phối và chuyển đổi giữa các mô hình một cách liền mạch, mà không làm ảnh hưởng đến trải nghiệm người dùng cuối.

Chiến Lược Kết Hợp Đa Mô Hình (Multi-Model): Giải Pháp Tối Ưu Hóa

Chiến lược kết hợp đa mô hình không chỉ là một cách để giảm chi phí mà còn là một phương pháp để nâng cao độ tin cậy và hiệu suất của hệ thống AI. Ý tưởng cốt lõi là không phụ thuộc vào một mô hình duy nhất, mà thay vào đó, sử dụng nhiều mô hình từ các nhà cung cấp khác nhau, mỗi mô hình được tối ưu hóa cho một loại tác vụ cụ thể hoặc được chọn dựa trên các tiêu chí như chi phí, tốc độ, độ chính xác và khả năng phục hồi.

1. Phân Loại Tác Vụ và Lựa Chọn Mô Hình Phù Hợp

Bước đầu tiên trong Chiến lược API AI này là phân tích kỹ lưỡng các tác vụ mà ứng dụng AI của bạn cần thực hiện. Các tác vụ có thể được phân loại dựa trên độ phức tạp, yêu cầu về độ chính xác, độ trễ mong muốn và ngân sách cho phép.

- Tác vụ đơn giản, khối lượng lớn: Ví dụ: phân loại spam, tóm tắt văn bản ngắn, dịch thuật cơ bản. Đối với những tác vụ này, các mô hình nhỏ hơn, nhanh hơn và rẻ hơn như GPT-3.5 Turbo, Claude 3 Haiku, hoặc thậm chí các mô hình mã nguồn mở được host trên nền tảng như Hugging Face (ví dụ:

,Mistral-7B

) là lựa chọn lý tưởng.LLaMA-2-7B - Tác vụ phức tạp, yêu cầu độ chính xác cao: Ví dụ: phân tích hợp đồng pháp lý, tạo nội dung sáng tạo, lập luận phức tạp. Đây là lúc các mô hình hàng đầu như GPT-4 Turbo, Claude 3 Opus, hoặc Gemini 1.5 Pro phát huy tối đa sức mạnh, mặc dù với chi phí cao hơn.

- Tác vụ chuyên biệt: Một số tác vụ có thể cần các mô hình được fine-tuned hoặc các mô hình chuyên môn hóa cho một lĩnh vực cụ thể (ví dụ: y tế, tài chính).

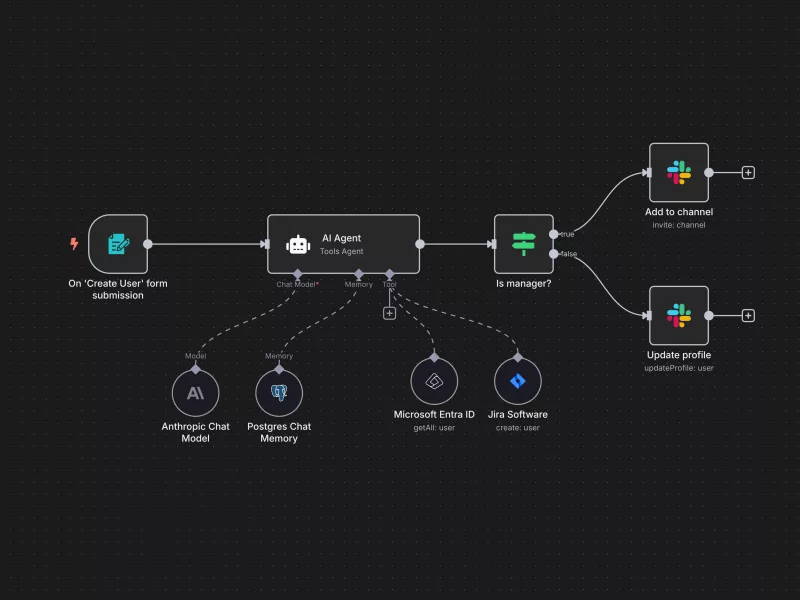

2. Xây Dựng Router AI Thông Minh

Để thực hiện chiến lược đa mô hình, bạn cần một cơ chế để "điều hướng" các yêu cầu API đến mô hình phù hợp nhất. Đây chính là vai trò của một AI Router (hoặc AI Gateway) thông minh. Router này sẽ đóng vai trò trung gian giữa ứng dụng của bạn và các API AI khác nhau.

// Ví dụ pseudo-code cho một AI Router đơn giản

class AIRouter:

def __init__(self):

self.models = {

"simple_task": {

"provider": "openai",

"model_name": "gpt-3.5-turbo",

"cost_per_token": 0.0000005 // ví dụ

},

"complex_task": {

"provider": "anthropic",

"model_name": "claude-3-opus-20240229",

"cost_per_token": 0.000015 // ví dụ

},

"fallback": {

"provider": "google",

"model_name": "gemini-pro",

"cost_per_token": 0.00000025 // ví dụ

}

}

def route_request(self, task_type, prompt):

model_config = self.models.get(task_type)

if not model_config:

model_config = self.models["fallback"] // Dùng mô hình dự phòng

provider = model_config["provider"]

model_name = model_config["model_name"]

if provider == "openai":

return self._call_openai_api(model_name, prompt)

elif provider == "anthropic":

return self._call_anthropic_api(model_name, prompt)

elif provider == "google":

return self._call_google_api(model_name, prompt)

else:

raise ValueError("Unknown AI provider")

def _call_openai_api(self, model_name, prompt):

# Logic gọi API OpenAI

print(f"Calling OpenAI {model_name} for: {prompt[:50]}...")

# ... thực hiện gọi API và trả về kết quả

return {"response": f"OpenAI {model_name} response for '{prompt[:20]}'", "cost": 0.001}

def _call_anthropic_api(self, model_name, prompt):

# Logic gọi API Anthropic

print(f"Calling Anthropic {model_name} for: {prompt[:50]}...")

# ... thực hiện gọi API và trả về kết quả

return {"response": f"Anthropic {model_name} response for '{prompt[:20]}'", "cost": 0.01}

def _call_google_api(self, model_name, prompt):

# Logic gọi API Google

print(f"Calling Google {model_name} for: {prompt[:50]}...")

# ... thực hiện gọi API và trả về kết quả

return {"response": f"Google {model_name} response for '{prompt[:20]}'", "cost": 0.0005}

# Sử dụng Router

router = AIRouter()

response_simple = router.route_request("simple_task", "Tóm tắt đoạn văn này về lịch sử Việt Nam.")

print(f"Simple task result: {response_simple}")

response_complex = router.route_request("complex_task", "Phân tích tác động của biến đổi khí hậu đến nền kinh tế toàn cầu...")

print(f"Complex task result: {response_complex}")

response_unknown = router.route_request("unknown_task", "Một yêu cầu bất kỳ.")

print(f"Unknown task result (using fallback): {response_unknown}")

AI Router có thể được xây dựng tùy chỉnh hoặc sử dụng các giải pháp mã nguồn mở/thương mại. Các tính năng quan trọng của một AI Router bao gồm:

- Điều hướng dựa trên quy tắc: Dựa vào loại tác vụ, độ dài prompt, hoặc mức độ ưu tiên.

- Điều hướng dựa trên hiệu suất/chi phí: Tự động chọn mô hình rẻ nhất hoặc nhanh nhất mà vẫn đáp ứng được yêu cầu chất lượng.

- Load Balancing: Phân phối yêu cầu đến nhiều mô hình hoặc nhiều nhà cung cấp để tránh tắc nghẽn và cải thiện độ tin cậy.

- Fallback Mechanism: Nếu một mô hình hoặc nhà cung cấp gặp sự cố, tự động chuyển sang mô hình dự phòng.

- Caching: Lưu trữ kết quả của các yêu cầu lặp lại để giảm tải và chi phí.

- Giám sát và Logging: Theo dõi hiệu suất, chi phí và lỗi của từng mô hình.

3. Đánh Giá và Giám Sát Liên Tục

Việc triển khai Chiến lược API AI đa mô hình không phải là một công việc "thiết lập và quên đi". Thị trường AI thay đổi rất nhanh chóng: các mô hình mới xuất hiện, giá cả thay đổi, hiệu suất được cải thiện. Do đó, việc đánh giá và giám sát liên tục là cực kỳ quan trọng.

- Theo dõi chi phí: Sử dụng các công cụ giám sát để theo dõi chi phí phát sinh từ mỗi API và mỗi loại tác vụ.

- Đánh giá chất lượng: Thiết lập các tiêu chí đánh giá chất lượng đầu ra của từng mô hình cho từng tác vụ cụ thể. Có thể sử dụng các phương pháp tự động hoặc thủ công (human-in-the-loop) để kiểm tra.

- So sánh hiệu suất: Định kỳ so sánh tốc độ xử lý (latency) và thông lượng (throughput) của các mô hình.

- Tối ưu hóa quy tắc điều hướng: Dựa trên dữ liệu giám sát, điều chỉnh các quy tắc trong AI Router để liên tục tối ưu hóa chi phí và hiệu suất.

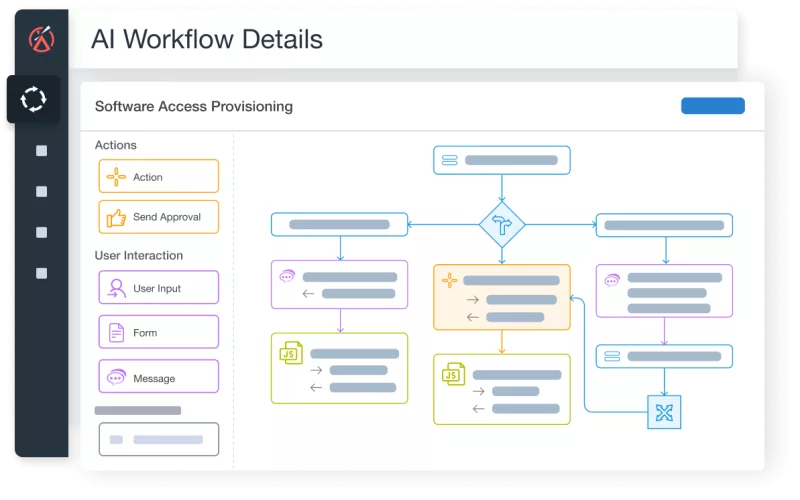

Thực Hành Triển Khai Multi-Model Với Vibe Coding

Để triển khai một hệ thống đa mô hình hiệu quả, chúng ta cần một kiến trúc linh hoạt và các công cụ hỗ trợ. Dưới đây là một ví dụ về cách bạn có thể bắt đầu với một cách tiếp cận dựa trên dịch vụ (microservices) và một AI Gateway:

1. Thiết Lập AI Gateway (API Proxy)

Thay vì gọi trực tiếp API của OpenAI, Anthropic, hay Google, ứng dụng của bạn sẽ gọi đến một API Gateway nội bộ. Gateway này sẽ chịu trách nhiệm điều hướng yêu cầu. Bạn có thể sử dụng các framework như

Express.jsFastAPISpring Boot

// Ví dụ với Express.js cho AI Gateway

const express = require('express');

const axios = require('axios'); // Để gọi các API bên ngoài

const app = express();

app.use(express.json());

// Cấu hình các mô hình và API keys

const config = {

"gpt-3.5-turbo": {

provider: "openai",

url: "https://api.openai.com/v1/chat/completions",

apiKey: process.env.OPENAI_API_KEY,

cost: 0.0000005 // Giả định cost per token

},

"claude-3-haiku": {

provider: "anthropic",

url: "https://api.anthropic.com/v1/messages",

apiKey: process.env.ANTHROPIC_API_KEY,

cost: 0.00000025

},

"gemini-pro": {

provider: "google",

url: "https://generativelanguage.googleapis.com/v1beta/models/gemini-pro:generateContent",

apiKey: process.env.GOOGLE_API_KEY,

cost: 0.0000001

}

};

// Hàm điều hướng yêu cầu

app.post('/ai/generate', async (req, res) => {

const { taskType, prompt, maxTokens = 100 } = req.body;

let selectedModel = null;

// Logic điều hướng đơn giản: chọn mô hình dựa trên taskType

if (taskType === 'summarization' || taskType === 'translation') {

selectedModel = config['claude-3-haiku']; // Rẻ hơn cho tác vụ đơn giản

} else if (taskType === 'creative_writing' || taskType === 'complex_qa') {

selectedModel = config['gpt-3.5-turbo']; // Cân bằng giữa giá và hiệu năng

} else {

selectedModel = config['gemini-pro']; // Mặc định hoặc cheapest option

}

if (!selectedModel) {

return res.status(400).json({ error: 'No suitable model found for task type.' });

}

try {

let apiResponse;

if (selectedModel.provider === "openai") {

apiResponse = await axios.post(selectedModel.url, {

model: 'gpt-3.5-turbo', // có thể dùng model_name từ config

messages: [{ role: "user", content: prompt }],

max_tokens: maxTokens

}, {

headers: {

'Authorization': `Bearer ${selectedModel.apiKey}`,

'Content-Type': 'application/json'

}

});

res.json({

response: apiResponse.data.choices[0].message.content,

model_used: 'gpt-3.5-turbo',

estimated_cost: apiResponse.data.usage.total_tokens <em> selectedModel.cost

});

} else if (selectedModel.provider === "anthropic") {

apiResponse = await axios.post(selectedModel.url, {

model: 'claude-3-haiku-20240307', // có thể dùng model_name từ config

messages: [{ role: "user", content: prompt }],

max_tokens: maxTokens

}, {

headers: {

'x-api-key': selectedModel.apiKey,

'anthropic-version': '2023-06-01',

'Content-Type': 'application/json'

}

});

res.json({

response: apiResponse.data.content[0].text,

model_used: 'claude-3-haiku',

// Anthropic không trả về usage token trực tiếp, cần tính toán ước lượng

estimated_cost: (prompt.length / 4 + maxTokens) </em> selectedModel.cost

});

} else if (selectedModel.provider === "google") {

apiResponse = await axios.post(`${selectedModel.url}?key=${selectedModel.apiKey}`, {

contents: [{ parts: [{ text: prompt }] }],

generationConfig: { maxOutputTokens: maxTokens }

}, {

headers: { 'Content-Type': 'application/json' }

});

res.json({

response: apiResponse.data.candidates[0].content.parts[0].text,

model_used: 'gemini-pro',

// Google cũng cần ước lượng hoặc dùng SDK để lấy usage

estimated_cost: (prompt.length / 4 + maxTokens) * selectedModel.cost

});

}

} catch (error) {

console.error('Error calling AI API:', error.response ? error.response.data : error.message);

res.status(500).json({ error: 'Failed to generate AI response.' });

}

});

const PORT = process.env.PORT || 3000;

app.listen(PORT, () => {

console.log(`AI Gateway running on port ${PORT}`);

});

Trong ví dụ trên, ứng dụng client sẽ gọi

POST /ai/generatetaskTypeprompttaskType2. Tích Hợp Các Mô Hình Mã Nguồn Mở (Open-Source Models)

Để giảm chi phí hơn nữa, hãy xem xét tích hợp các mô hình mã nguồn mở. Bạn có thể host chúng trên các dịch vụ như Hugging Face Inference Endpoints, Replicate, hoặc tự triển khai trên máy chủ của mình (ví dụ: với

llama.cppvLLMMột ví dụ cụ thể là sử dụng

Mistral 7Bconfig3. Caching Cơ Bản

Đối với các yêu cầu lặp lại hoặc các câu hỏi thường gặp, việc lưu trữ kết quả (caching) có thể giảm đáng kể số lượng cuộc gọi API đến các nhà cung cấp bên ngoài.

// Bổ sung caching vào AI Gateway

const NodeCache = require("node-cache");

const myCache = new NodeCache({ stdTTL: 600, checkperiod: 120 }); // Cache trong 10 phút

// ... trong hàm app.post('/ai/generate', trước khi gọi API bên ngoài ...

const cacheKey = JSON.stringify({ taskType, prompt, maxTokens });

const cachedResponse = myCache.get(cacheKey);

if (cachedResponse) {

console.log("Serving from cache for:", taskType, prompt.substring(0, 20));

return res.json(cachedResponse);

}

// ... sau khi nhận được apiResponse từ nhà cung cấp ...

const responseData = {

response: processedResponse, // Kết quả đã xử lý

model_used: selectedModel.model_name,

estimated_cost: calculatedCost

};

myCache.set(cacheKey, responseData);

res.json(responseData);

Caching là một Chiến lược API AI hiệu quả, đặc biệt cho các hệ thống chatbot hoặc trợ lý ảo nơi người dùng có thể hỏi cùng một câu hỏi nhiều lần.

Các Lưu Ý Quan Trọng

- Quản lý API Keys: Luôn bảo mật API keys. Không bao giờ hardcode chúng trong mã nguồn client-side. Sử dụng biến môi trường hoặc các dịch vụ quản lý bí mật (secret management service) như AWS Secrets Manager, Google Secret Manager.

- Xử lý lỗi và Fallback: Thiết kế hệ thống để xử lý lỗi một cách duyên dáng. Khi một API gặp sự cố, hãy có cơ chế tự động chuyển sang mô hình dự phòng hoặc thông báo cho người dùng.

- Giới hạn Tốc độ (Rate Limiting): Tuân thủ giới hạn tốc độ của từng API để tránh bị chặn. AI Gateway của bạn có thể implement rate limiting cục bộ.

- Đảm bảo tính nhất quán: Khi sử dụng nhiều mô hình, đôi khi đầu ra có thể hơi khác nhau. Cần có cơ chế để chuẩn hóa hoặc kiểm tra tính nhất quán nếu điều này quan trọng đối với ứng dụng của bạn.

- Chi phí hạ tầng: Khi tự host các mô hình mã nguồn mở, hãy tính đến chi phí cho GPU, máy chủ và băng thông. Đôi khi, việc trả phí cho API vẫn rẻ hơn so với việc tự vận hành.

- Quy định pháp lý và bảo mật dữ liệu: Đảm bảo rằng việc chuyển dữ liệu giữa các nhà cung cấp API tuân thủ các quy định về bảo mật và quyền riêng tư (ví dụ: GDPR, HIPAA).

- Đo lường và phân tích: Không ngừng thu thập dữ liệu về hiệu suất, chất lượng và chi phí của từng mô hình để đưa ra quyết định tối ưu.

Câu Hỏi Thường Gặp

Chiến lược API AI đa mô hình có phù hợp với mọi loại ứng dụng không?

Chiến lược này đặc biệt phù hợp với các ứng dụng có nhiều loại tác vụ AI khác nhau, hoặc các ứng dụng có lưu lượng truy cập lớn và yêu cầu tối ưu hóa chi phí. Đối với các ứng dụng nhỏ, đơn giản, chỉ cần một mô hình duy nhất có thể đủ, nhưng việc áp dụng chiến lược này vẫn mang lại lợi ích về độ tin cậy và khả năng mở rộng.

Làm thế nào để đánh giá chất lượng của các mô hình khác nhau cho cùng một tác vụ?

Bạn có thể tạo một bộ dữ liệu kiểm định (test dataset) gồm các câu hỏi hoặc yêu cầu mẫu. Sau đó, chạy bộ dữ liệu này qua từng mô hình và đánh giá kết quả dựa trên các tiêu chí định lượng (ví dụ: độ chính xác, độ liên quan) và định tính (ví dụ: tính mạch lạc, phong cách văn phong) do con người đánh giá hoặc sử dụng các mô hình đánh giá tự động (LLM-as-a-judge).

Việc xây dựng AI Gateway có quá phức tạp không?

Mức độ phức tạp phụ thuộc vào các tính năng bạn muốn tích hợp. Một AI Gateway cơ bản với chức năng điều hướng và fallback có thể được xây dựng khá nhanh chóng. Tuy nhiên, nếu bạn muốn thêm các tính năng nâng cao như caching thông minh, load balancing, giám sát chi phí chi tiết, hoặc khả năng tự động học hỏi để điều hướng, thì sẽ cần nhiều công sức hơn. Có nhiều thư viện và nền tảng giúp đơn giản hóa quá trình này.

Có giải pháp nào sẵn có cho AI Router không?

Có một số giải pháp mã nguồn mở và thương mại đang nổi lên để giải quyết vấn đề này. Ví dụ như

LiteLLMOpenRouter.aiKết Luận

Tối ưu hóa chi phí API AI thông qua chiến lược kết hợp đa mô hình là một bước đi chiến lược thông minh cho bất kỳ doanh nghiệp nào muốn khai thác sức mạnh của trí tuệ nhân tạo một cách bền vững. Bằng cách phân loại tác vụ, xây dựng một AI Router thông minh, và liên tục đánh giá hiệu suất, bạn có thể giảm đáng kể chi phí vận hành, đồng thời nâng cao độ tin cậy và linh hoạt của hệ thống AI của mình. Đây không chỉ là một cách để "thách thức Big Tech" mà còn là một phương pháp để xây dựng các giải pháp AI sáng tạo và hiệu quả hơn.

Tại vibe coding, chúng tôi tin rằng việc hiểu rõ và áp dụng các chiến lược tối ưu hóa như thế này là chìa khóa để phát triển các sản phẩm AI đột phá và có giá trị thực sự. Hãy bắt đầu hành trình của bạn với chiến lược API AI đa mô hình ngay hôm nay để mở khóa tiềm năng to lớn của AI mà không phải lo lắng về chi phí tăng vọt.