Giới Thiệu AutoGen: Xây Dựng Đội Ngũ AI Agent Cộng Tác Thông Minh Với Vibe Coding

Trong kỷ nguyên số hóa hiện nay, trí tuệ nhân tạo (AI) đang dần trở thành xương sống của mọi đổi mới. Từ việc tự động hóa các tác vụ đơn giản đến giải quyết những bài toán phức tạp, AI đang định hình lại cách chúng ta làm việc và tương tác. Tuy nhiên, việc phát triển và triển khai các hệ thống AI mạnh mẽ thường đòi hỏi kiến thức chuyên sâu và nguồn lực đáng kể. Điều gì sẽ xảy ra nếu chúng ta có thể tạo ra một "đội ngũ" các AI agent, mỗi agent chuyên trách một vai trò, cùng nhau cộng tác để giải quyết vấn đề? Đây chính là tầm nhìn mà Microsoft đã hiện thực hóa với AutoGen. Bài viết về AutoGen là gì này sẽ giúp bạn hiểu rõ về nền tảng mạnh mẽ này, cách nó hoạt động, và làm thế nào bạn có thể tận dụng nó để xây dựng các giải pháp tự động hóa thông minh, mang lại "vibe" mới cho quy trình phát triển AI của mình.

AutoGen Là Gì? Kiến Trúc Và Triết Lý Cốt Lõi

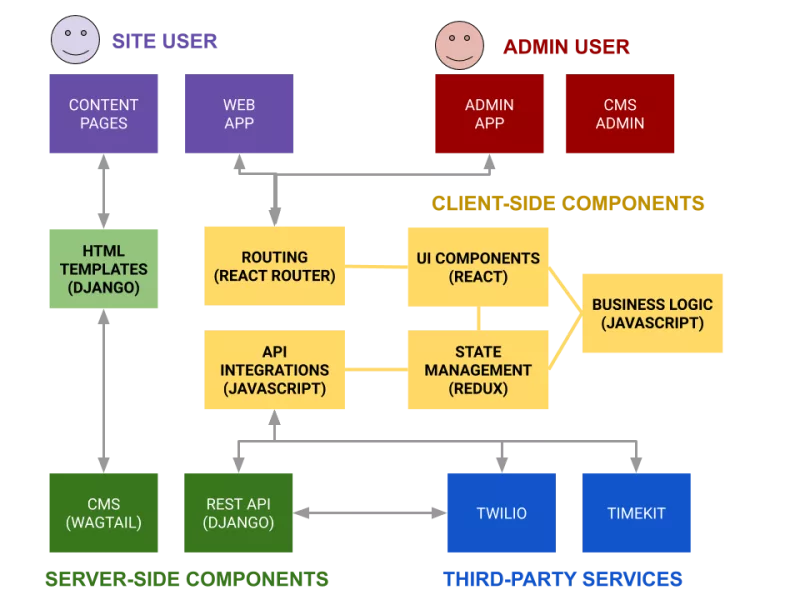

AutoGen là một framework mã nguồn mở do Microsoft giới thiệu, cho phép các nhà phát triển dễ dàng xây dựng, tối ưu hóa và điều phối các AI agent có khả năng giao tiếp và cộng tác với nhau. Thay vì chỉ có một Large Language Model (LLM) đơn lẻ cố gắng giải quyết mọi thứ, AutoGen tạo ra một môi trường nơi nhiều agent, mỗi agent được cấu hình với các khả năng và vai trò riêng, có thể tương tác thông qua các cuộc hội thoại để đạt được một mục tiêu chung. Triết lý cốt lõi của AutoGen là "đối thoại đa agent" (multi-agent conversation), nơi các agent đóng vai trò như những con người trong một nhóm, trao đổi thông tin, đưa ra ý kiến, và thậm chí lập trình để giải quyết nhiệm vụ.

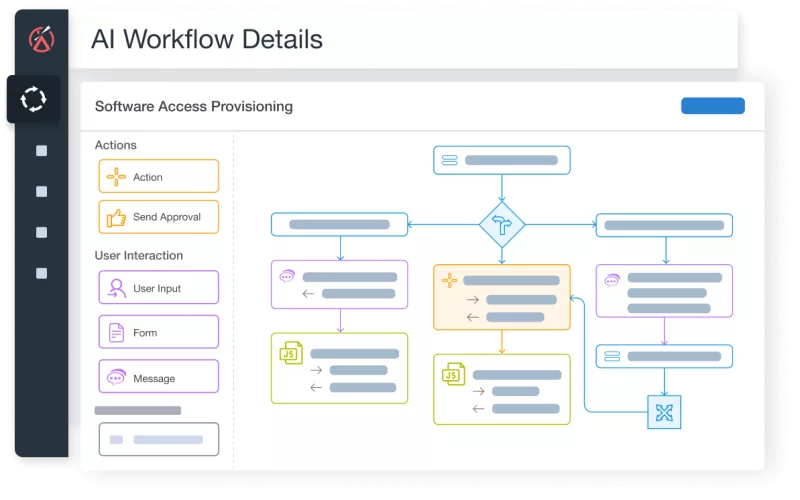

Để hiểu rõ hơn AutoGen là gì, chúng ta cần nhìn vào kiến trúc của nó. AutoGen bao gồm các thành phần chính sau:

- Agent: Đây là các thực thể chính trong AutoGen, mỗi agent có một vai trò và khả năng riêng. Các loại agent phổ biến bao gồm

UserProxyAgent(đại diện cho người dùng, có thể nhận input và thực thi code),AssistantAgent(agent dựa trên LLM để suy luận, lập kế hoạch), và các agent tùy chỉnh khác. - Conversation: Là cơ chế giao tiếp giữa các agent. Các agent trao đổi tin nhắn với nhau, và AutoGen quản lý luồng hội thoại này.

- Tools/Functions: Các agent có thể được trang bị "công cụ" hoặc "hàm" để thực hiện các tác vụ cụ thể, ví dụ như gọi API, chạy code Python, truy vấn cơ sở dữ liệu. Điều này mở rộng khả năng của LLM vượt ra ngoài việc chỉ tạo văn bản.

- Orchestration: AutoGen cung cấp các cơ chế để điều phối các agent, quyết định agent nào nên nói tiếp theo, khi nào một tác vụ hoàn thành, và khi nào cần sự can thiệp của con người.

Sức mạnh của AutoGen nằm ở khả năng tạo ra các giải pháp linh hoạt và mạnh mẽ bằng cách kết hợp sức mạnh suy luận của LLM với khả năng thực thi tác vụ của các công cụ, tất cả được điều phối trong một môi trường cộng tác đa agent. Điều này giúp khắc phục những hạn chế của LLM đơn lẻ, chẳng hạn như "hallucination" (tạo ra thông tin sai lệch) hoặc khó khăn trong việc thực hiện các tác vụ đòi hỏi logic và thực thi code phức tạp.

Xây Dựng Đội Ngũ AI Agent Với AutoGen: Hướng Dẫn Thực Hành

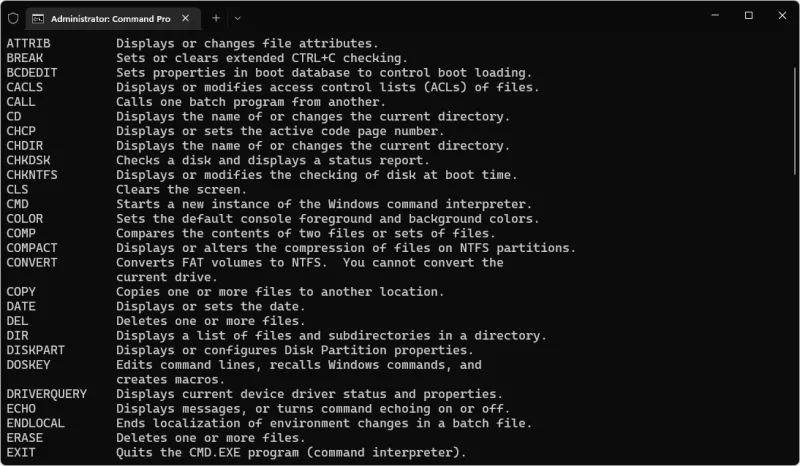

Để bắt đầu với AutoGen, bạn cần cài đặt thư viện và thiết lập môi trường. Giả sử bạn đã có API key cho OpenAI (hoặc bất kỳ LLM nào mà AutoGen hỗ trợ).

1. Cài đặt AutoGen

Mở terminal và chạy lệnh sau:

pip install pyautogen openai2. Cấu hình API Key

Bạn có thể cấu hình API key trong một file OAI_CONFIG_LIST (JSON) hoặc thông qua biến môi trường. Với vibe coding, chúng ta thường ưu tiên cách tiếp cận linh hoạt, nên việc sử dụng file cấu hình hoặc biến môi trường đều được. Ví dụ file OAI_CONFIG_LIST:

[

{

"model": "gpt-4",

"api_key": "YOUR_OPENAI_API_KEY"

},

{

"model": "gpt-3.5-turbo",

"api_key": "YOUR_OPENAI_API_KEY"

}

]Lưu ý: Thay YOUR_OPENAI_API_KEY bằng khóa API thực của bạn. Bạn cũng có thể đặt nó trong biến môi trường OPENAI_API_KEY.

3. Xây Dựng Đội Ngũ Agent Đầu Tiên

Hãy cùng xây dựng một đội ngũ đơn giản gồm hai agent: một UserProxyAgent đại diện cho người dùng và một AssistantAgent dựa trên LLM. Nhiệm vụ của đội ngũ này là viết một đoạn code Python để tính tổng các số chẵn trong một danh sách.

import autogen

# Cấu hình LLM

config_list = autogen.config_list_from_json(

"OAI_CONFIG_LIST",

filter_dict={

"model": ["gpt-4", "gpt-3.5-turbo"],

},

)

# 1. Khởi tạo AssistantAgent

# Đây là agent dựa trên LLM, có khả năng suy luận và tạo code.

assistant = autogen.AssistantAgent(

name="Assistant",

llm_config={

"seed": 42, # Để đảm bảo kết quả có thể tái tạo

"config_list": config_list,

"temperature": 0.7,

},

system_message="Bạn là một lập trình viên Python chuyên nghiệp. Hãy viết code để giải quyết vấn đề và giải thích nó."

)

# 2. Khởi tạo UserProxyAgent

# Agent này đại diện cho người dùng, có thể nhận input và thực thi code.

# code_execution_config cho phép agent thực thi code trong môi trường Docker hoặc local.

user_proxy = autogen.UserProxyAgent(

name="User_Proxy",

human_input_mode="NEVER", # NEVER: không yêu cầu input từ người dùng, TERMINATE: yêu cầu khi cần

max_consecutive_auto_reply=10, # Giới hạn số lần trả lời tự động liên tiếp

is_termination_msg=lambda x: "TERMINATE" in x.get("content", "").upper(), # Điều kiện dừng hội thoại

code_execution_config={

"work_dir": "coding", # Thư mục để lưu và chạy code

"use_docker": False, # Đặt True nếu muốn chạy trong Docker để cô lập môi trường

},

system_message="Bạn là một người quản lý dự án. Bạn sẽ giao nhiệm vụ cho Assistant và kiểm tra code của Assistant. Nếu code hoạt động, hãy kết thúc cuộc trò chuyện bằng 'TERMINATE'."

)

# 3. Bắt đầu cuộc trò chuyện

user_proxy.initiate_chat(

assistant,

message="Viết một hàm Python nhận vào một danh sách các số nguyên và trả về tổng của tất cả các số chẵn trong danh sách đó. Sau đó, viết một ví dụ để kiểm tra hàm này với danh sách [1, 2, 3, 4, 5, 6, 7, 8, 9, 10]."

)Trong ví dụ này, User_Proxy sẽ khởi xướng cuộc trò chuyện, đưa ra yêu cầu. Assistant sẽ nhận yêu cầu, suy luận, và viết code Python. Sau đó, User_Proxy sẽ nhận code, thực thi nó (nhờ code_execution_config), kiểm tra kết quả. Nếu kết quả đúng, User_Proxy sẽ gửi tin nhắn chứa "TERMINATE" để kết thúc cuộc trò chuyện. Nếu có lỗi, User_Proxy sẽ thông báo lỗi cho Assistant để sửa chữa. Đây là một ví dụ tuyệt vời về cách AutoGen cho phép các agent cộng tác để giải quyết vấn đề một cách tự động.

4. Tùy chỉnh và Mở rộng Agent

Sức mạnh của AutoGen không chỉ dừng lại ở các agent cơ bản. Bạn có thể:

- Tạo Agent tùy chỉnh: Kế thừa từ

AgenthoặcConversableAgentđể tạo ra các agent với logic riêng, ví dụ như một agent chuyên về phân tích dữ liệu, một agent chuyên về triển khai cloud. - Gán Tools/Functions: Cung cấp cho agent các hàm mà chúng có thể gọi. Ví dụ, một agent có thể có công cụ để truy vấn một database hoặc gọi một API dịch vụ thời tiết.

- Quản lý Vòng đời Cuộc trò chuyện: Điều chỉnh

human_input_mode,max_consecutive_auto_reply, vàis_termination_msgđể kiểm soát cách cuộc trò chuyện diễn ra và khi nào nó kết thúc.

Tips Và Best Practices Khi Sử Dụng AutoGen

Để tận dụng tối đa AutoGen và xây dựng các hệ thống AI agent hiệu quả, hãy cùng điểm qua một số tips và best practices từ vibe coding:

- Xác định Rõ Ràng Vai Trò Của Từng Agent: Mỗi agent nên có một vai trò và trách nhiệm cụ thể. Tránh việc một agent cố gắng làm quá nhiều việc. Ví dụ, một agent chuyên về phân tích dữ liệu, một agent chuyên về tạo báo cáo, và một agent điều phối. Điều này giúp cuộc trò chuyện mạch lạc và giảm thiểu sai sót.

- Sử Dụng

system_messageHiệu Quả: Đây là "kim chỉ nam" cho hành vi của agent. Viếtsystem_messagerõ ràng, súc tích và hướng dẫn agent về vai trò, phong cách trả lời, và các ràng buộc. Ví dụ: "Bạn là một chuyên gia bảo mật. Hãy luôn ưu tiên các giải pháp an toàn nhất." - Thiết Kế Cơ Chế Phản Hồi Và Tự Sửa Lỗi: AutoGen xuất sắc trong việc cho phép các agent tự sửa lỗi. Hãy thiết kế các kịch bản mà agent có thể nhận phản hồi (từ agent khác hoặc từ việc thực thi code) và sử dụng phản hồi đó để cải thiện kết quả. Điều này thường được thực hiện thông qua

UserProxyAgentthực thi code và báo cáo lỗi. - Quản Lý

code_execution_configCẩn Thận: Khi cho phép agent thực thi code, hãy cân nhắc môi trường. Sử dụng Docker (use_docker=True) là một cách an toàn để cô lập môi trường thực thi, ngăn chặn các tác động không mong muốn đến hệ thống của bạn. Luôn kiểm tra kỹ code do AI tạo ra trước khi cho phép nó chạy trong môi trường production. - Tối Ưu Hóa Chi Phí Với Các Mô Hình Khác Nhau: AutoGen cho phép bạn cấu hình nhiều LLM khác nhau trong

config_list. Bạn có thể ưu tiên các mô hình mạnh mẽ như GPT-4 cho các tác vụ phức tạp đòi hỏi suy luận cao, và các mô hình rẻ hơn như GPT-3.5-turbo cho các tác vụ đơn giản hơn hoặc khi cần phản hồi nhanh. - Giám Sát Và Debug Cuộc Trò Chuyện: Khi phát triển, hãy in ra toàn bộ lịch sử cuộc trò chuyện giữa các agent để hiểu luồng logic, xác định điểm nghẽn hoặc hành vi không mong muốn. AutoGen cung cấp các công cụ để dễ dàng theo dõi quá trình này.

- Sử Dụng

human_input_modePhù Hợp:"NEVER": Hoàn toàn tự động. Thích hợp cho các tác vụ đã được kiểm thử kỹ lưỡng."TERMINATE": Yêu cầu xác nhận của con người trước khi kết thúc cuộc trò chuyện. Hữu ích cho việc kiểm tra cuối cùng."ALWAYS": Luôn yêu cầu input của con người sau mỗi lượt trả lời của agent. Tuyệt vời cho việc debug và phát triển ban đầu.

AutoGen So Với Các Framework AI Agent Khác

Thị trường AI agent đang phát triển rất nhanh, với nhiều framework khác nhau như LangChain, LlamaIndex, hay CrewAI. Vậy AutoGen là gì và nó khác biệt ra sao?

- LangChain: LangChain tập trung vào việc xây dựng "chuỗi" (chains) các thành phần LLM và công cụ. Nó cung cấp một bộ công cụ phong phú để kết nối các mô hình ngôn ngữ với các nguồn dữ liệu, API, và các logic xử lý khác. Trong khi LangChain mạnh về việc tạo luồng xử lý tuần tự hoặc có điều kiện, AutoGen lại nổi bật hơn trong mô hình "đối thoại đa agent", nơi các agent tự do tương tác và cộng tác như một nhóm. AutoGen có thể được coi là bổ sung cho LangChain, hoặc ngược lại, tùy thuộc vào bài toán.

- LlamaIndex: LlamaIndex chủ yếu tập trung vào việc giúp LLM tương tác với dữ liệu tùy chỉnh của bạn (Retrieval-Augmented Generation - RAG). Nó cung cấp các công cụ để tạo chỉ mục, truy vấn và tích hợp dữ liệu phi cấu trúc vào quá trình suy luận của LLM. Mặc dù LlamaIndex có thể được sử dụng như một "công cụ" cho các agent của AutoGen, thì AutoGen lại tập trung vào việc phối hợp các agent để giải quyết vấn đề tổng thể, bao gồm cả việc tương tác với dữ liệu hoặc không.

- CrewAI: CrewAI là một framework mới hơn, được lấy cảm hứng từ AutoGen, cũng tập trung vào mô hình đa agent. Nó cung cấp một cách tiếp cận có cấu trúc hơn để định nghĩa các "phi hành đoàn" (crews) với các agent, vai trò, và nhiệm vụ cụ thể. CrewAI có thể dễ dàng hơn cho người mới bắt đầu trong việc thiết lập các kịch bản đa agent phức tạp nhờ cấu trúc rõ ràng của nó. AutoGen, với tính linh hoạt cao, cho phép tùy chỉnh sâu hơn nhưng có thể yêu cầu nhiều cấu hình hơn cho các kịch bản phức tạp.

Điểm mạnh cốt lõi của AutoGen là khả năng mô phỏng và quản lý các cuộc đối thoại mở giữa nhiều AI agent và con người. Khả năng này cho phép các hệ thống tự động hóa linh hoạt, có thể tự điều chỉnh và sửa lỗi trong quá trình thực hiện nhiệm vụ, một tính năng mà không phải framework nào cũng có thể cung cấp một cách dễ dàng và mạnh mẽ như AutoGen.

Các Lưu Ý Quan Trọng Khi Phát Triển Với AutoGen

- Chi phí API: Việc chạy nhiều LLM agent có thể dẫn đến chi phí API tăng cao, đặc biệt khi sử dụng các mô hình mạnh như GPT-4. Hãy giám sát chi phí và tối ưu hóa bằng cách sử dụng các mô hình phù hợp cho từng tác vụ hoặc áp dụng các chiến lược caching.

- Độ trễ và Hiệu năng: Các cuộc trò chuyện đa agent có thể kéo dài và tốn thời gian. Đối với các ứng dụng yêu cầu phản hồi nhanh, bạn cần cân nhắc kiến trúc và tối ưu hóa các bước trong cuộc trò chuyện.

- Bảo mật và Quyền riêng tư: Khi các agent được phép thực thi code hoặc truy cập dữ liệu, hãy đảm bảo rằng bạn đã triển khai các biện pháp bảo mật phù hợp. Cẩn thận với việc cấp quyền truy cập quá rộng cho các agent.

- Kiểm soát Hallucination: Mặc dù mô hình đa agent giúp giảm thiểu hallucination, nhưng nó không loại bỏ hoàn toàn. Luôn có cơ chế kiểm tra và xác minh thông tin quan trọng.

- Quản lý State (Trạng thái): Trong các cuộc trò chuyện phức tạp, việc quản lý trạng thái và bối cảnh của từng agent có thể trở nên thách thức. AutoGen giúp ích phần nào, nhưng bạn vẫn cần thiết kế các tác vụ sao cho mỗi agent có đủ thông tin cần thiết để hoạt động hiệu quả.

- Thử nghiệm và Lặp lại: Phát triển hệ thống đa agent là một quá trình lặp lại. Bạn sẽ cần thử nghiệm nhiều cấu hình agent,

system_message, và luồng trò chuyện để đạt được kết quả mong muốn. - Hiểu rõ Giới hạn của LLM: Dù mạnh mẽ đến đâu, LLM vẫn có những giới hạn. Đừng mong đợi các agent của bạn sẽ giải quyết mọi vấn đề một cách hoàn hảo mà không cần sự can thiệp hoặc giám sát.

Câu Hỏi Thường Gặp Về AutoGen

AutoGen có thể tích hợp với các LLM mã nguồn mở không?

Có, AutoGen được thiết kế để linh hoạt và có thể tích hợp với nhiều LLM khác nhau, bao gồm cả các mô hình mã nguồn mở như Llama 2, Mixtral thông qua các API tương thích OpenAI (ví dụ: vLLM, Ollama, LiteLLM) hoặc bằng cách tạo các connector tùy chỉnh.

Làm thế nào để AutoGen xử lý các lỗi trong quá trình thực thi code?

Khi một agent (thường là UserProxyAgent) thực thi code và gặp lỗi, AutoGen sẽ tự động gửi thông báo lỗi ngược lại cho agent đã tạo ra code đó (thường là AssistantAgent). Agent này sau đó sẽ cố gắng phân tích lỗi và sửa code, tạo ra một phiên bản mới để thử lại. Quá trình lặp lại này diễn ra cho đến khi code chạy thành công hoặc đạt đến giới hạn số lần thử.

AutoGen có hỗ trợ việc gọi các API bên ngoài không?

Chắc chắn rồi. Một trong những tính năng mạnh mẽ của AutoGen là khả năng cho phép các agent sử dụng "tools" hoặc "functions". Bạn có thể định nghĩa các hàm Python để gọi bất kỳ API bên ngoài nào (ví dụ: API thời tiết, API cơ sở dữ liệu, API quản lý dự án) và đăng ký chúng với các agent. Khi LLM trong agent xác định rằng một công cụ cần được sử dụng để giải quyết vấn đề, nó sẽ gọi hàm đó.

Sự khác biệt chính giữa UserProxyAgent và AssistantAgent là gì?

AssistantAgent chủ yếu dựa vào LLM để suy luận, lập kế hoạch và tạo nội dung (ví dụ: code, văn bản). Nó không có khả năng thực thi code mặc định. Ngược lại, UserProxyAgent được thiết kế để đại diện cho người dùng, có khả năng nhận input từ con người, cũng như thực thi code (thông qua code_execution_config) và chuyển kết quả hoặc lỗi trở lại các agent khác. Nó đóng vai trò như một cầu nối giữa người dùng/thế giới thực và các agent dựa trên LLM.

Tôi có thể sử dụng AutoGen cho những loại dự án nào?

AutoGen có thể được áp dụng cho rất nhiều loại dự án, từ tự động hóa quy trình phát triển phần mềm (viết code, debug, kiểm thử), phân tích dữ liệu chuyên sâu, tạo nội dung động, quản lý dự án, đến xây dựng các chatbot thông minh có khả năng tương tác phức tạp. Bất kỳ tác vụ nào có thể được chia thành các bước logic và yêu cầu cộng tác giữa nhiều "chuyên gia" đều có thể hưởng lợi từ AutoGen.

Kết Luận

AutoGen không chỉ là một framework; nó là một triết lý mới trong việc phát triển AI, cho phép chúng ta xây dựng các hệ thống thông minh hơn, linh hoạt hơn bằng cách tận dụng sức mạnh cộng tác của nhiều AI agent. Từ việc tự động hóa các tác vụ lập trình đến giải quyết các vấn đề kinh doanh phức tạp, khả năng của AutoGen là vô hạn. Với sự hiểu biết sâu sắc về AutoGen là gì và cách triển khai nó, bạn có thể biến các ý tưởng đột phá thành hiện thực, mang lại một "vibe" hoàn toàn mới cho các dự án AI của mình. Hãy sẵn sàng để khám phá và tạo ra những đội ngũ AI agent của riêng bạn, mở ra cánh cửa cho những đổi mới không ngừng. Nếu bạn muốn tìm hiểu sâu hơn về AI, coding và các công nghệ mới, hãy ghé thăm vibe coding để cập nhật những kiến thức và xu hướng mới nhất!