Giới Thiệu: Phía Sau Mã Nguồn AI: Checklist Bảo Mật Cho Code Được Tạo Bởi Trí Tuệ Nhân Tạo

Trong kỷ nguyên số hóa hiện nay, Trí tuệ Nhân tạo (AI) đã trở thành một công cụ không thể thiếu, không chỉ hỗ trợ mà còn trực tiếp tham gia vào quá trình phát triển phần mềm, từ việc sinh mã, tối ưu hóa đến kiểm thử. Tuy nhiên, cùng với những lợi ích to lớn, việc sử dụng AI để tạo ra mã nguồn cũng đặt ra những thách thức bảo mật đáng kể. Bài viết này sẽ đi sâu vào khía cạnh quan trọng này, cung cấp một checklist toàn diện về các biện pháp bảo mật AI code, giúp các nhà phát triển và tổ chức đảm bảo an toàn cho sản phẩm của mình. Chúng ta sẽ cùng nhau khám phá những rủi ro tiềm ẩn và cách phòng ngừa hiệu quả khi làm việc với mã nguồn được sinh ra bởi AI.

AI Sinh Mã Nguồn: Cơ Hội và Thách Thức Bảo Mật

AI, đặc biệt là các mô hình ngôn ngữ lớn (LLMs), đang cách mạng hóa cách chúng ta viết code. Từ việc tự động hoàn thành dòng code (autocomplete), gợi ý đoạn mã (code suggestion) cho đến việc sinh ra toàn bộ hàm hay thậm chí là các module phức tạp, AI đang giúp tăng tốc độ phát triển và giảm gánh nặng cho lập trình viên. Các công cụ như GitHub Copilot, Amazon CodeWhisperer hay Google Gemini đều là những ví dụ điển hình cho thấy sức mạnh này. Chúng có thể giúp giải quyết các vấn đề lặp đi lặp lại, tạo ra boilerplate code, và thậm chí là dịch mã từ ngôn ngữ này sang ngôn ngữ khác.

Tuy nhiên, sự tiện lợi này đi kèm với một mặt trái đáng lo ngại: bảo mật. Mã nguồn được sinh ra bởi AI không phải lúc nào cũng hoàn hảo. Chúng có thể kế thừa các lỗ hổng bảo mật từ dữ liệu huấn luyện, mắc phải lỗi logic, hoặc thậm chí là tạo ra những đoạn mã có chủ đích độc hại nếu mô hình bị tấn công. Một nghiên cứu của Stanford cho thấy, mã nguồn do AI tạo ra có xu hướng chứa nhiều lỗ hổng bảo mật hơn so với mã do con người viết trong một số trường hợp. Điều này đòi hỏi chúng ta phải có một cách tiếp cận chủ động và nghiêm ngặt hơn trong việc kiểm tra và xác thực mã nguồn này.

Thách thức lớn nhất nằm ở việc "mù quáng" tin tưởng vào output của AI. Khi một đoạn code được sinh ra tự động, lập trình viên có thể bỏ qua bước kiểm tra kỹ lưỡng, dẫn đến việc các lỗ hổng bị bỏ sót và đưa vào môi trường sản xuất. Các lỗ hổng này có thể bao gồm SQL Injection, Cross-Site Scripting (XSS), insecure direct object references (IDOR), hoặc các lỗi cấu hình bảo mật. Do đó, việc hiểu rõ cách thức hoạt động của AI, những giới hạn của nó, và áp dụng các biện pháp bảo mật AI code là cực kỳ cần thiết.

Checklist Bảo Mật Toàn Diện Cho Mã Nguồn AI

1. Xác Thực và Làm Sạch Dữ Liệu Đầu Vào (Input Validation & Sanitization)

Ngay cả khi AI sinh ra code, code đó vẫn phải xử lý dữ liệu đầu vào. Đây là điểm khởi đầu phổ biến nhất cho các cuộc tấn công. Đảm bảo rằng mọi dữ liệu nhận được từ người dùng, API bên ngoài, hoặc bất kỳ nguồn không đáng tin cậy nào khác đều được xác thực và làm sạch nghiêm ngặt.

- Kiểm tra kiểu dữ liệu và định dạng: Đảm bảo dữ liệu đúng định dạng mong muốn (ví dụ: số nguyên, chuỗi, email).

- Giới hạn độ dài: Ngăn chặn tràn bộ đệm hoặc các cuộc tấn công từ chối dịch vụ (DoS).

- Loại bỏ ký tự đặc biệt: Sử dụng các hàm làm sạch (sanitization) để loại bỏ hoặc mã hóa các ký tự có thể gây ra SQL Injection, XSS, hoặc Command Injection.

Ví dụ về làm sạch dữ liệu trong Python để ngăn chặn XSS:

import html

def sanitize_user_input(input_string):

"""

Sanitizes user input to prevent XSS attacks.

"""

if not isinstance(input_string, str):

return ""

return html.escape(input_string)

user_comment = "<script>alert('XSS');</script>Hello World!"

sanitized_comment = sanitize_user_input(user_comment)

print(f"Original: {user_comment}")

print(f"Sanitized: {sanitized_comment}")

# Output: Sanitized: <script>alert('XSS');</script>Hello World!

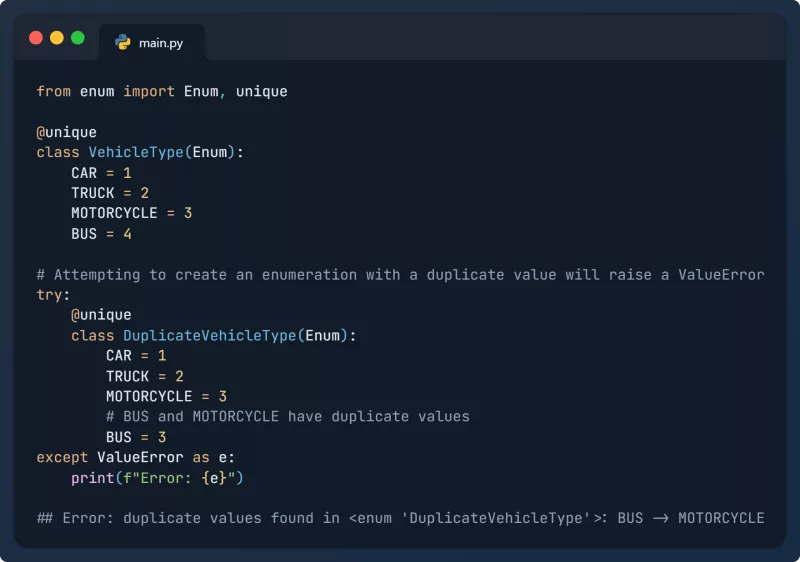

2. Kiểm Tra Mã Nguồn Tĩnh (Static Application Security Testing - SAST)

SAST là công cụ không thể thiếu để phát hiện các lỗ hổng bảo mật trong mã nguồn mà không cần thực thi nó. Dù code được viết bởi con người hay AI, SAST vẫn là lớp phòng thủ đầu tiên quan trọng.

- Tích hợp vào CI/CD: Tự động quét mã mỗi khi có thay đổi hoặc trước khi deploy.

- Sử dụng nhiều công cụ SAST: Không có công cụ nào hoàn hảo, sử dụng kết hợp các công cụ như SonarQube, Bandit (cho Python), ESLint (cho JavaScript) để có phạm vi bao phủ tốt hơn.

- Đào tạo AI về bảo mật: Nếu có thể, sử dụng các mô hình AI đã được huấn luyện trên dữ liệu mã nguồn an toàn hoặc có khả năng nhận diện lỗ hổng bảo mật.

3. Kiểm Tra Mã Nguồn Động (Dynamic Application Security Testing - DAST)

DAST kiểm tra ứng dụng khi nó đang chạy, mô phỏng các cuộc tấn công thực tế để tìm ra các lỗ hổng mà SAST có thể bỏ lỡ, đặc biệt là các vấn đề liên quan đến cấu hình hoặc runtime. Điều này đặc biệt quan trọng cho bảo mật AI code.

- Thực hiện quét DAST định kỳ: Sử dụng các công cụ như OWASP ZAP, Burp Suite để quét ứng dụng đang chạy.

- Kiểm tra các API do AI tạo ra: Đảm bảo các API endpoint được sinh bởi AI tuân thủ các nguyên tắc bảo mật và không có lỗ hổng.

4. Đánh Giá Phân Tích Thành Phần (Software Composition Analysis - SCA)

Mã nguồn do AI tạo ra thường sử dụng các thư viện và framework mã nguồn mở. SCA giúp xác định và quản lý các lỗ hổng bảo mật trong các thành phần bên thứ ba này.

- Kiểm kê các thư viện: Liệt kê tất cả các thư viện và phiên bản của chúng.

- Theo dõi lỗ hổng đã biết: Sử dụng công cụ SCA như Snyk, Dependabot để cảnh báo về các lỗ hổng CVE (Common Vulnerabilities and Exposures) trong các thư viện được sử dụng.

- Cập nhật thường xuyên: Đảm bảo luôn sử dụng các phiên bản thư viện mới nhất và vá lỗi bảo mật.

Ví dụ về cách sử dụng pip-audit để kiểm tra lỗ hổng trong các thư viện Python:

# Cài đặt pip-audit

pip install pip-audit

# Chạy kiểm tra trên môi trường hiện tại

pip-audit

5. Kiểm Tra Thủ Công và Đánh Giá Code (Manual Review & Code Audit)

Không có công cụ tự động nào có thể thay thế hoàn toàn được sự tinh tế của con người. Kiểm tra mã nguồn thủ công là bước cuối cùng và quan trọng nhất để đảm bảo bảo mật AI code.

- Review bởi đồng nghiệp: Yêu cầu một nhà phát triển khác (hoặc thậm chí tốt hơn là một chuyên gia bảo mật) xem xét mã nguồn do AI tạo ra.

- Tập trung vào các đoạn mã nhạy cảm: Ưu tiên kiểm tra các phần mã xử lý dữ liệu nhạy cảm, xác thực, ủy quyền, và giao tiếp mạng.

- Hiểu rõ ngữ cảnh: Đánh giá mã nguồn trong bối cảnh toàn bộ ứng dụng để phát hiện các lỗ hổng logic hoặc thiết kế.

6. Quản Lý Bí Mật (Secret Management)

Mã nguồn do AI sinh ra có thể vô tình bao gồm các thông tin nhạy cảm như API keys, mật khẩu, hoặc chứng chỉ. Điều này là một rủi ro bảo mật nghiêm trọng.

- Không bao giờ hardcode bí mật: Luôn sử dụng biến môi trường, dịch vụ quản lý bí mật (ví dụ: AWS Secrets Manager, HashiCorp Vault), hoặc các công cụ quản lý cấu hình an toàn.

- Kiểm tra lịch sử Git: Đảm bảo không có bí mật nào bị rò rỉ vào hệ thống kiểm soát phiên bản (Git history). Sử dụng các công cụ như

git-secretshoặctrufflehog.

Ví dụ về cách phát hiện bí mật trong Git history bằng trufflehog:

# Cài đặt trufflehog

pip install trufflehog

# Quét một repository Git

trufflehog git https://github.com/example/repo.git

7. Tuân Thủ Nguyên Tắc Bảo Mật Cơ Bản

AI có thể tạo ra code, nhưng nguyên tắc bảo mật vẫn phải được áp dụng một cách nhất quán.

- Least Privilege (Nguyên tắc đặc quyền tối thiểu): Code (và các dịch vụ liên quan) chỉ nên có quyền truy cập tối thiểu cần thiết để thực hiện chức năng của nó.

- Secure by Design: Tích hợp bảo mật ngay từ giai đoạn thiết kế, không phải là một tính năng bổ sung sau này.

- Defense in Depth: Áp dụng nhiều lớp bảo mật để nếu một lớp bị phá vỡ, các lớp khác vẫn có thể bảo vệ.

- Logging và Monitoring: Ghi lại các sự kiện quan trọng và giám sát hoạt động của ứng dụng để phát hiện các hành vi bất thường.

Tối Ưu Hóa Quy Trình Phát Triển Với Mã Nguồn AI An Toàn

Để tối đa hóa lợi ích của AI trong phát triển phần mềm mà vẫn đảm bảo an toàn, chúng ta cần tích hợp các biện pháp bảo mật vào mọi giai đoạn của vòng đời phát triển phần mềm (SDLC).

1. Huấn Luyện AI Với Dữ Liệu An Toàn

Nếu bạn đang huấn luyện hoặc tinh chỉnh các mô hình AI để sinh mã, hãy ưu tiên sử dụng các tập dữ liệu đã được kiểm tra bảo mật kỹ lưỡng. Tránh sử dụng các mã nguồn công khai không rõ nguồn gốc hoặc có lịch sử lỗ hổng.

2. Tích Hợp Bảo Mật Vào CI/CD

Tự động hóa các bước kiểm tra bảo mật (SAST, SCA) vào pipeline CI/CD. Điều này giúp phát hiện lỗ hổng sớm, giảm chi phí sửa chữa và đảm bảo rằng mọi thay đổi mã nguồn, dù là do con người hay AI tạo ra, đều trải qua quy trình kiểm tra nghiêm ngặt.

3. Giáo Dục Lập Trình Viên

Ngay cả khi AI tạo ra code, trách nhiệm cuối cùng vẫn thuộc về lập trình viên. Đào tạo lập trình viên về các nguyên tắc bảo mật cơ bản, cách nhận diện lỗ hổng, và cách sử dụng các công cụ bảo mật là rất quan trọng. Họ cần hiểu rằng mã nguồn AI cũng cần được xem xét kỹ lưỡng như mã nguồn được viết thủ công.

4. Sử Dụng Công Cụ Hỗ Trợ AI Có Tính Năng Bảo Mật

Nhiều công cụ trợ lý mã hóa AI đang tích hợp các tính năng bảo mật. Ví dụ, GitHub Copilot có tính năng gợi ý các biện pháp khắc phục lỗ hổng, hoặc cảnh báo về các đoạn mã có thể không an toàn. Ưu tiên sử dụng các công cụ có tích hợp bảo mật làm yếu tố cốt lõi.

Các Lưu Ý Quan Trọng

- Không tin tưởng hoàn toàn vào AI: Luôn coi mã nguồn do AI tạo ra như một gợi ý, không phải là giải pháp cuối cùng. Luôn xem xét, đánh giá và kiểm thử kỹ lưỡng.

- Hiểu rõ mô hình AI: Nếu có thể, hãy tìm hiểu về mô hình AI được sử dụng, dữ liệu huấn luyện của nó, và các giới hạn đã biết.

- Kiểm soát phiên bản chặt chẽ: Sử dụng hệ thống kiểm soát phiên bản mạnh mẽ và quy trình review code nghiêm ngặt cho mọi thay đổi, bất kể nguồn gốc.

- Phản ứng nhanh với lỗ hổng: Thiết lập quy trình rõ ràng để xử lý và vá lỗi các lỗ hổng bảo mật được phát hiện một cách nhanh chóng.

- Cập nhật kiến thức bảo mật liên tục: Lĩnh vực bảo mật và AI phát triển rất nhanh. Luôn cập nhật các mối đe dọa mới và các phương pháp bảo vệ hiệu quả.

- Xem xét trách nhiệm pháp lý: Hiểu rõ các vấn đề pháp lý và tuân thủ liên quan đến việc sử dụng mã nguồn do AI tạo ra, đặc biệt là trong các ngành công nghiệp có quy định chặt chẽ.

- Sử dụng code review tools: Ngoài SAST, các công cụ review code chuyên biệt có thể giúp tìm ra các vấn đề về chất lượng và bảo mật.

Câu Hỏi Thường Gặp

Mã nguồn do AI tạo ra có an toàn hơn mã nguồn do con người viết không?

Không nhất thiết. Mặc dù AI có thể tránh được một số lỗi lặp lại của con người, nó cũng có thể tạo ra các lỗ hổng mới hoặc kế thừa lỗ hổng từ dữ liệu huấn luyện. Mức độ an toàn phụ thuộc vào chất lượng của mô hình AI, dữ liệu huấn luyện, và quy trình kiểm thử bảo mật sau đó.

Làm thế nào để phát hiện lỗ hổng trong mã nguồn AI mà không cần biết nó được tạo ra bởi AI?

Các phương pháp kiểm thử bảo mật truyền thống như SAST, DAST, SCA và kiểm tra thủ công vẫn hoàn toàn hiệu quả. Mục tiêu là kiểm tra mã nguồn, không phải nguồn gốc của nó. Tuy nhiên, việc biết mã nguồn được sinh bởi AI có thể giúp bạn tập trung vào các loại lỗ hổng phổ biến hơn trong mã nguồn AI.

Có công cụ nào chuyên biệt để kiểm tra bảo mật cho mã nguồn AI không?

Hiện tại, chưa có công cụ nào "chuyên biệt" hoàn toàn để kiểm tra bảo mật cho mã nguồn AI khác biệt đáng kể so với các công cụ bảo mật ứng dụng truyền thống. Tuy nhiên, các công cụ SAST và DAST đang được cải tiến để hiểu rõ hơn các pattern code do AI tạo ra. Ngoài ra, việc kiểm tra các mô hình AI (model security) để đảm bảo chúng không bị tấn công (adversarial attacks) cũng là một lĩnh vực đang phát triển.

Kết Luận

Trí tuệ nhân tạo đang mở ra một kỷ nguyên mới trong phát triển phần mềm, mang lại hiệu suất và khả năng sáng tạo chưa từng có. Tuy nhiên, việc khai thác những lợi ích này đòi hỏi một sự cảnh giác cao độ về bảo mật. Bằng cách áp dụng một checklist bảo mật toàn diện, từ việc xác thực dữ liệu đầu vào, sử dụng các công cụ SAST, DAST, SCA, đến việc kiểm tra mã nguồn thủ công và quản lý bí mật chặt chẽ, chúng ta có thể đảm bảo rằng mã nguồn được tạo bởi AI không chỉ hiệu quả mà còn an toàn.

Hãy nhớ rằng, bảo mật không phải là một tính năng được thêm vào sau cùng, mà là một phần không thể thiếu của toàn bộ quy trình phát triển. Với cách tiếp cận đúng đắn, chúng ta có thể tận dụng sức mạnh của AI để xây dựng những ứng dụng mạnh mẽ và an toàn. Hãy cùng vibe coding để tiếp tục khám phá và làm chủ những công nghệ tiên tiến này!