Giới Thiệu AI Agent & Chuỗi Tác Vụ Tương Lai: Kiến Tạo Quy Trình Phức Tạp, Vận Hành Trơn Tru Với Vibe Coding

Trong thế giới công nghệ phát triển như vũ bão hiện nay, việc tự động hóa các quy trình ngày càng trở nên quan trọng. Đặc biệt, sự xuất hiện của AI Agent đã mở ra kỷ nguyên mới, nơi các tác vụ không còn là những hành động rời rạc mà được xâu chuỗi thành các quy trình thông minh, tự động và linh hoạt. Bài viết này sẽ giúp bạn hiểu rõ về chuỗi tác vụ AI từ góc nhìn thực tế, cách chúng kiến tạo nên các hệ thống phức tạp và làm thế nào để vận hành trơn tru với triết lý của vibe coding.

Chuỗi Tác Vụ AI Agent: Nền Tảng Của Tự Động Hóa Thông Minh

Chuỗi tác vụ AI Agent (AI Agent Chains) là một mô hình kiến trúc mạnh mẽ, nơi nhiều AI Agent hoặc các mô hình AI khác nhau được kết nối tuần tự hoặc song song để hoàn thành một mục tiêu lớn hơn, phức tạp hơn. Thay vì một AI Agent cố gắng giải quyết toàn bộ vấn đề, chuỗi tác vụ chia nhỏ vấn đề thành các bước nhỏ hơn, mỗi bước được xử lý bởi một Agent chuyên biệt hoặc một công cụ (tool) cụ thể. Điều này giống như một dây chuyền sản xuất thông minh, nơi mỗi trạm làm việc (Agent) có một chức năng riêng, nhưng tất cả đều hướng tới sản phẩm cuối cùng.

Sức mạnh của chuỗi tác vụ AI nằm ở khả năng phân rã vấn đề (problem decomposition) và tích hợp các công cụ (tool integration). Một AI Agent có thể được giao nhiệm vụ tìm kiếm thông tin trên internet, một Agent khác phân tích dữ liệu thu thập được, và một Agent thứ ba tổng hợp kết quả để tạo báo cáo. Sự phối hợp nhịp nhàng này giúp vượt qua giới hạn của từng mô hình AI đơn lẻ, cho phép giải quyết các bài toán mà trước đây đòi hỏi sự can thiệp đáng kể của con người.

Ví dụ, trong lĩnh vực phát triển phần mềm, một chuỗi tác vụ AI có thể bắt đầu bằng việc nhận yêu cầu từ người dùng, sau đó một Agent dựa trên LLM (Large Language Model) sẽ phân tích yêu cầu để tạo ra các user story. Agent tiếp theo có thể sử dụng các công cụ lập trình để viết code, một Agent khác chạy unit test, và cuối cùng là một Agent tự động triển khai (deploy) ứng dụng. Toàn bộ quy trình này tạo thành một pipeline tự động, giảm thiểu thời gian và công sức.

Khái niệm về chuỗi tác vụ AI không chỉ dừng lại ở các tác vụ tuyến tính. Chúng có thể bao gồm các vòng lặp phản hồi (feedback loops), nơi output của một Agent trở thành input cho một Agent trước đó để điều chỉnh và tối ưu hóa. Điều này mang lại khả năng tự học và thích nghi, làm cho các hệ thống AI trở nên mạnh mẽ và linh hoạt hơn rất nhiều.

Việc xây dựng một chuỗi tác vụ AI hiệu quả đòi hỏi sự hiểu biết sâu sắc về cách các thành phần tương tác, quản lý trạng thái (state management) và xử lý lỗi (error handling). Đây chính là lúc triết lý vibe coding phát huy tác dụng, giúp chúng ta kiến tạo các hệ thống không chỉ hoạt động mà còn "cảm thấy" đúng đắn, dễ bảo trì và mở rộng.

Kiến Tạo Chuỗi Tác Vụ AI Với Vibe Coding: Từ Lý Thuyết Đến Thực Tiễn

Để xây dựng một chuỗi tác vụ AI mạnh mẽ, chúng ta cần một cách tiếp cận có hệ thống. Vibe coding khuyến khích việc tập trung vào sự rõ ràng, khả năng mở rộng và trải nghiệm của nhà phát triển. Hãy cùng xem xét một ví dụ thực tế về việc tạo ra một chuỗi tác vụ đơn giản để tóm tắt một tài liệu dài và trích xuất các điểm chính.

Bước 1: Định nghĩa các AI Agent và Công cụ

Mỗi Agent trong chuỗi sẽ có một vai trò cụ thể. Chúng ta có thể định nghĩa các Agent sau:

- Input Agent: Tiếp nhận tài liệu đầu vào (ví dụ: URL, file text).

- Scraper Agent: Nếu input là URL, Agent này sẽ thu thập nội dung từ trang web.

- Chunking Agent: Chia nhỏ tài liệu lớn thành các đoạn nhỏ hơn để xử lý hiệu quả bởi LLM.

- Summarizer Agent: Sử dụng LLM để tóm tắt từng đoạn và sau đó tóm tắt tổng thể.

- Keyword Extractor Agent: Trích xuất các từ khóa chính từ bản tóm tắt.

- Output Agent: Trình bày kết quả cuối cùng.

Mỗi Agent này có thể được triển khai dưới dạng một hàm hoặc một class riêng biệt, với các công cụ (tools) cụ thể mà chúng có thể sử dụng. Ví dụ, Scraper Agent có thể sử dụng thư viện như BeautifulSoup hoặc Playwright.

# Ví dụ về một công cụ Scraper đơn giản

import requests

from bs4 import BeautifulSoup

class WebScraperTool:

def __init__(self):

pass

def scrape(self, url: str) -> str:

try:

response = requests.get(url)

response.raise_for_status() # Raise HTTPError for bad responses (4xx or 5xx)

soup = BeautifulSoup(response.text, 'html.parser')

# Extract main content, e.g., paragraphs

paragraphs = soup.find_all('p')

text_content = ' '.join([p.get_text() for p in paragraphs])

return text_content

except requests.exceptions.RequestException as e:

print(f"Error scraping URL {url}: {e}")

return ""

# Một Agent có thể sử dụng công cụ này

class ScraperAgent:

def __init__(self):

self.scraper_tool = WebScraperTool()

def run(self, url: str) -> str:

print(f"ScraperAgent: Scraping content from {url}...")

content = self.scraper_tool.scrape(url)

return content

Bước 2: Xây dựng Chuỗi Tác Vụ

Chúng ta sẽ kết nối các Agent này lại với nhau để tạo thành một luồng công việc. Các framework như LangChain, CrewAI, hay AutoGen cung cấp các abstraction mạnh mẽ để làm điều này. Đối với ví dụ đơn giản, chúng ta có thể tự xây dựng một luồng:

from typing import List, Dict

from abc import ABC, abstractmethod

from openai import OpenAI # Giả sử sử dụng OpenAI API cho LLM

# Base class cho các Agent

class BaseAgent(ABC):

@abstractmethod

def run(self, input_data: any) -> any:

pass

# Chunking Agent (ví dụ đơn giản)

class ChunkingAgent(BaseAgent):

def __init__(self, chunk_size: int = 1000, overlap: int = 200):

self.chunk_size = chunk_size

self.overlap = overlap

def run(self, text: str) -> List[str]:

print("ChunkingAgent: Splitting text into chunks...")

# Đây là một ví dụ đơn giản, trong thực tế sẽ dùng thư viện như LangChain Text Splitter

chunks = []

for i in range(0, len(text), self.chunk_size - self.overlap):

chunks.append(text[i:i + self.chunk_size])

return chunks

# Summarizer Agent

class SummarizerAgent(BaseAgent):

def __init__(self, model_name: str = "gpt-3.5-turbo"):

self.client = OpenAI()

self.model_name = model_name

def summarize_chunk(self, chunk: str) -> str:

response = self.client.chat.completions.create(

model=self.model_name,

messages=[

{"role": "system", "content": "You are a helpful assistant that summarizes text."},

{"role": "user", "content": f"Please summarize the following text concisely:\n\n{chunk}"}

]

)

return response.choices[0].message.content.strip()

def run(self, chunks: List[str]) -> str:

print("SummarizerAgent: Summarizing chunks...")

individual_summaries = [self.summarize_chunk(chunk) for chunk in chunks]

# Tóm tắt tổng thể từ các tóm tắt nhỏ

final_summary_prompt = "Combine the following summaries into a single, comprehensive summary:\n\n" + "\n\n".join(individual_summaries)

response = self.client.chat.completions.create(

model=self.model_name,

messages=[

{"role": "system", "content": "You are a helpful assistant that combines summaries."},

{"role": "user", "content": final_summary_prompt}

]

)

return response.choices[0].message.content.strip()

# Keyword Extractor Agent

class KeywordExtractorAgent(BaseAgent):

def __init__(self, model_name: str = "gpt-3.5-turbo"):

self.client = OpenAI()

self.model_name = model_name

def run(self, summary: str) -> List[str]:

print("KeywordExtractorAgent: Extracting keywords...")

response = self.client.chat.completions.create(

model=self.model_name,

messages=[

{"role": "system", "content": "You are a helpful assistant that extracts keyphrases."},

{"role": "user", "content": f"Extract the 5 most important keywords/keyphrases from the following summary, separated by commas:\n\n{summary}"}

]

)

keywords_str = response.choices[0].message.content.strip()

return [kw.strip() for kw in keywords_str.split(',') if kw.strip()]

# Định nghĩa chuỗi tác vụ chính

class DocumentSummarizationChain:

def __init__(self):

self.scraper_agent = ScraperAgent()

self.chunking_agent = ChunkingAgent()

self.summarizer_agent = SummarizerAgent()

self.keyword_extractor_agent = KeywordExtractorAgent()

def run(self, url: str) -> Dict[str, any]:

print("Starting Document Summarization Chain...")

# Bước 1: Scraping

content = self.scraper_agent.run(url)

if not content:

return {"error": "Failed to scrape content."}

# Bước 2: Chunking

chunks = self.chunking_agent.run(content)

if not chunks:

return {"error": "Content is too short or chunking failed."}

# Bước 3: Summarization

final_summary = self.summarizer_agent.run(chunks)

# Bước 4: Keyword Extraction

keywords = self.keyword_extractor_agent.run(final_summary)

print("Document Summarization Chain Completed.")

return {

"original_url": url,

"summary": final_summary,

"keywords": keywords

}

# Sử dụng chuỗi tác vụ

if __name__ == "__main__":

# Đặt biến môi trường OPENAI_API_KEY

# import os

# os.environ["OPENAI_API_KEY"] = "YOUR_OPENAI_API_KEY"

chain = DocumentSummarizationChain()

# Thay thế bằng một URL thực tế để kiểm tra

result = chain.run("https://vibecoding.vin/chuoi-tac-vu-ai-agent")

print("\n--- Final Result ---")

print(f"Summary: {result.get('summary')}")

print(f"Keywords: {', '.join(result.get('keywords', []))}")

Đoạn code trên minh họa cách chúng ta có thể xây dựng một chuỗi tác vụ AI cơ bản. Mỗi Agent là một module độc lập, dễ dàng thay thế hoặc nâng cấp. Triết lý vibe coding ở đây thể hiện qua cấu trúc code rõ ràng, tách bạch trách nhiệm, và việc sử dụng các class/hàm có tên gọi dễ hiểu. Điều này giúp các nhà phát triển khác dễ dàng đọc, hiểu và đóng góp vào dự án.

Bước 3: Tối ưu hóa và Vận hành

Sau khi chuỗi tác vụ hoạt động, việc tối ưu hóa hiệu suất, chi phí và độ tin cậy là rất quan trọng. Điều này bao gồm:

- Quản lý lỗi: Thêm các cơ chế

try-exceptmạnh mẽ hơn, retry logic cho các API call. - Caching: Lưu trữ kết quả của các bước trung gian để tránh tính toán lại không cần thiết.

- Giám sát (Monitoring): Theo dõi hiệu suất của từng Agent, thời gian phản hồi, tỷ lệ lỗi.

- Tối ưu hóa chi phí LLM: Sử dụng các mô hình nhỏ hơn cho các tác vụ đơn giản, hoặc kỹ thuật prompt engineering để giảm token usage.

Vibe coding không chỉ là viết code, mà còn là về việc xây dựng các hệ thống bền vững, có khả năng thích nghi và dễ dàng mở rộng trong tương lai.

Best Practices Cho Chuỗi Tác Vụ AI Và Vibe Coding

Để đảm bảo chuỗi tác vụ AI của bạn hiệu quả và dễ quản lý, hãy áp dụng các best practices sau:

- Chia nhỏ vấn đề: Luôn cố gắng phân rã mục tiêu lớn thành các tác vụ nhỏ hơn, chuyên biệt. Mỗi tác vụ nên được xử lý bởi một Agent hoặc một công cụ riêng. Điều này giúp giảm độ phức tạp, tăng khả năng tái sử dụng và dễ dàng debug.

- Thiết kế Agent độc lập: Mỗi AI Agent nên có trách nhiệm rõ ràng và giao diện (API) định nghĩa tốt. Điều này cho phép bạn thay đổi hoặc nâng cấp một Agent mà không ảnh hưởng đến toàn bộ chuỗi.

- Quản lý trạng thái và bối cảnh (Context Management): Trong một chuỗi tác vụ, việc truyền thông tin (context) giữa các Agent là rất quan trọng. Hãy thiết kế cơ chế truyền dữ liệu rõ ràng, có thể là qua một đối tượng shared state, hoặc qua các tham số đầu vào/đầu ra của hàm.

- Xử lý lỗi và phục hồi: Các hệ thống AI không phải lúc nào cũng hoàn hảo. Xây dựng các cơ chế xử lý lỗi mạnh mẽ, bao gồm retry, fallback mechanism, và thông báo lỗi rõ ràng để hệ thống có thể tự phục hồi hoặc cung cấp thông tin hữu ích khi gặp sự cố.

- Tái sử dụng và mô đun hóa: Khuyến khích việc tạo ra các Agent và công cụ có thể tái sử dụng trong nhiều chuỗi tác vụ khác nhau. Việc mô đun hóa giúp giảm trùng lặp code và tăng tốc độ phát triển.

- Giám sát và Logging: Triển khai hệ thống giám sát để theo dõi hiệu suất của từng Agent và toàn bộ chuỗi. Logging chi tiết các bước thực hiện, input/output và lỗi xảy ra là cực kỳ quan trọng cho việc debug và tối ưu hóa.

- Bảo mật và Quyền riêng tư: Đặc biệt khi làm việc với dữ liệu nhạy cảm, hãy đảm bảo rằng dữ liệu được xử lý an toàn và tuân thủ các quy định về quyền riêng tư.

- Kiểm thử tự động: Viết unit test và integration test cho từng Agent và cho toàn bộ chuỗi tác vụ để đảm bảo chúng hoạt động đúng như mong đợi và không gây ra lỗi hồi quy khi có thay đổi.

Áp dụng những nguyên tắc này sẽ giúp bạn xây dựng các chuỗi tác vụ AI không chỉ mạnh mẽ về mặt chức năng mà còn "vibe" tốt về mặt kiến trúc và trải nghiệm phát triển.

So Sánh Các Phương Pháp Xây Dựng Chuỗi Tác Vụ AI

Khi xây dựng chuỗi tác vụ AI, có nhiều cách tiếp cận khác nhau, mỗi cách có ưu và nhược điểm riêng:

- Xây dựng thủ công (Custom Orchestration): Đây là cách chúng ta đã thấy trong ví dụ trên, nơi bạn tự viết logic để kết nối các Agent.

- Ưu điểm: Linh hoạt tối đa, kiểm soát hoàn toàn từng chi tiết, phù hợp cho các trường hợp đặc biệt hoặc khi cần hiệu suất cao và tùy chỉnh sâu.

- Nhược điểm: Tốn thời gian phát triển, đòi hỏi nhiều công sức cho việc quản lý trạng thái, xử lý lỗi và giám sát. Dễ phát sinh code boilerplate.

- Sử dụng Framework (ví dụ: LangChain, CrewAI, AutoGen): Các framework này cung cấp các abstraction và công cụ mạnh mẽ để định nghĩa và quản lý chuỗi tác vụ.

- Ưu điểm: Tăng tốc độ phát triển, giảm thiểu code boilerplate, cung cấp sẵn các cơ chế xử lý lỗi, caching, logging và tích hợp với nhiều LLM/công cụ khác. Có cộng đồng hỗ trợ lớn.

- Nhược điểm: Có thể bị giới hạn bởi các abstraction của framework, đôi khi khó tùy chỉnh sâu nếu logic quá phức tạp hoặc khác biệt so với mô hình của framework. Có thể có overhead về hiệu suất.

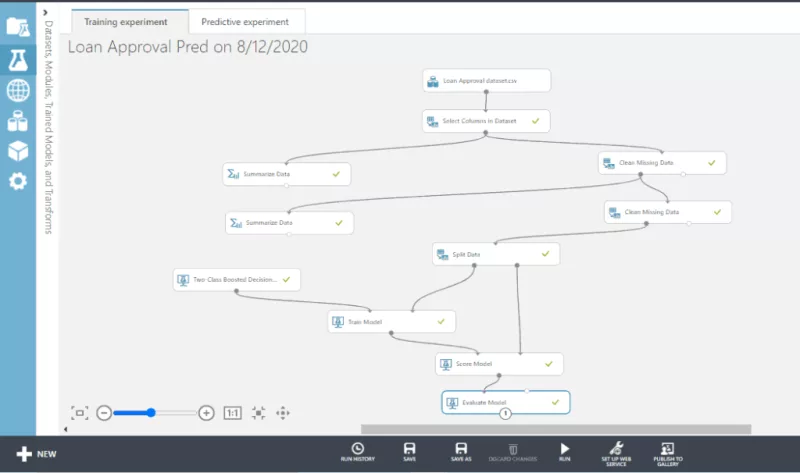

- Mô hình dựa trên đồ thị (Graph-based Models): Một số nền tảng cho phép bạn định nghĩa luồng công việc dưới dạng đồ thị (graph) với các node (Agent/tác vụ) và edge (luồng dữ liệu).

- Ưu điểm: Trực quan hóa luồng công việc rõ ràng, dễ dàng quản lý các luồng phức tạp với các nhánh rẽ và vòng lặp.

- Nhược điểm: Có thể yêu cầu học một công cụ hoặc ngôn ngữ mô hình hóa mới. Việc debug có thể khó khăn nếu đồ thị quá lớn.

Lựa chọn phương pháp phụ thuộc vào độ phức tạp của chuỗi tác vụ, yêu cầu về hiệu suất, thời gian phát triển và mức độ kiểm soát mà bạn muốn có. Đối với các dự án khởi đầu hoặc có yêu cầu tiêu chuẩn, các framework là lựa chọn tuyệt vời. Đối với các hệ thống lớn, hiệu suất cao, hoặc yêu cầu tùy chỉnh đặc biệt, việc xây dựng thủ công hoặc kết hợp với các công cụ orchestration tùy chỉnh có thể là cần thiết.

Các Lưu Ý Quan Trọng

- Chi phí vận hành (Operational Cost): Mỗi lời gọi LLM đều tốn chi phí. Thiết kế chuỗi tác vụ sao cho tối ưu số lượng lời gọi, kích thước input/output và chọn đúng mô hình cho từng tác vụ để giảm thiểu chi phí. Kỹ thuật caching là cực kỳ quan trọng.

- Độ trễ (Latency): Chuỗi tác vụ có nhiều bước có thể dẫn đến độ trễ tổng thể cao. Cân nhắc chạy song song các tác vụ không phụ thuộc nhau, tối ưu hóa các Agent riêng lẻ và chọn các mô hình LLM có tốc độ phản hồi nhanh hơn nếu cần.

- Tính nhất quán và độ tin cậy: Đảm bảo rằng các Agent trong chuỗi hoạt động một cách nhất quán và đáng tin cậy. Xử lý các trường hợp ngoại lệ, dữ liệu đầu vào không hợp lệ và phản hồi không mong muốn từ các API bên ngoài.

- Quản lý phiên bản (Versioning): Khi các Agent và mô hình AI phát triển, việc quản lý phiên bản của chuỗi tác vụ là rất quan trọng để đảm bảo khả năng tái tạo và dễ dàng rollback khi có vấn đề.

- Khả năng mở rộng (Scalability): Thiết kế chuỗi tác vụ sao cho nó có thể mở rộng để xử lý khối lượng công việc tăng lên. Điều này có thể liên quan đến việc sử dụng các dịch vụ serverless, containerization (Docker, Kubernetes) hoặc các hệ thống hàng đợi tin nhắn (message queues).

- Đạo đức và thiên vị (Ethics and Bias): Khi sử dụng AI Agent, đặc biệt là LLM, cần nhận thức về các vấn đề đạo đức và thiên vị tiềm ẩn. Thường xuyên kiểm tra và tinh chỉnh các Agent để giảm thiểu rủi ro này.

- Phản hồi người dùng: Đối với các chuỗi tác vụ tương tác với người dùng, cung cấp phản hồi rõ ràng về tiến độ và trạng thái của chuỗi. Điều này giúp cải thiện trải nghiệm người dùng và quản lý kỳ vọng.

Câu Hỏi Thường Gặp

Chuỗi tác vụ AI khác gì so với một pipeline xử lý dữ liệu thông thường?

Mặc dù cả hai đều liên quan đến các bước tuần tự, chuỗi tác vụ AI thường có tính "thông minh" và "tự trị" cao hơn. Các Agent trong chuỗi có khả năng ra quyết định, sử dụng công cụ một cách linh hoạt, và thậm chí học hỏi để điều chỉnh hành vi. Trong khi pipeline xử lý dữ liệu truyền thống thường là các bước được định nghĩa cứng nhắc, chuỗi tác vụ AI có thể thích nghi với các tình huống mới.

Làm thế nào để debug một chuỗi tác vụ AI phức tạp?

Debug chuỗi tác vụ AI đòi hỏi các công cụ và phương pháp chuyên biệt. Quan trọng nhất là logging chi tiết từng bước, input và output của mỗi Agent. Sử dụng các công cụ visualization để xem luồng dữ liệu và trạng thái của chuỗi. Các framework như LangChain có tích hợp công cụ trace (ví dụ: LangSmith) để theo dõi từng lời gọi LLM và công cụ.

Có nên sử dụng một framework hay tự xây dựng chuỗi tác vụ?

Đối với hầu hết các trường hợp, đặc biệt là khi bắt đầu, việc sử dụng các framework như LangChain, CrewAI hoặc AutoGen là lựa chọn tốt. Chúng giúp giảm đáng kể thời gian phát triển và cung cấp nhiều tính năng hữu ích. Tự xây dựng chỉ nên được cân nhắc khi bạn có yêu cầu rất đặc biệt về hiệu suất, tùy chỉnh sâu hoặc khi framework hiện có không đáp ứng được.

Kết Luận

Chuỗi tác vụ AI Agent là tương lai của tự động hóa thông minh, cho phép chúng ta kiến tạo các quy trình phức tạp và vận hành chúng một cách trơn tru. Từ việc phân rã vấn đề, tích hợp công cụ, đến việc quản lý trạng thái và xử lý lỗi, mỗi khía cạnh đều quan trọng để xây dựng một hệ thống mạnh mẽ và bền vững.

Với triết lý của vibe coding, chúng ta không chỉ viết mã hoạt động mà còn tạo ra những kiến trúc rõ ràng, dễ bảo trì và có khả năng mở rộng. Bằng cách áp dụng các best practices và hiểu rõ các công cụ sẵn có, bạn có thể khai thác tối đa tiềm năng của chuỗi tác vụ AI, đưa các ứng dụng và hệ thống của mình lên một tầm cao mới. Hãy cùng nhau khám phá và xây dựng những giải pháp AI đột phá!