Giới Thiệu Đạo đức & Quyền riêng tư AI: Ranh giới mới trong lập trình và kinh doanh tech

Đạo đức AI và quyền riêng tư là những thách thức cốt lõi định hình tương lai của công nghệ và kinh doanh, đòi hỏi các nhà phát triển và doanh nghiệp phải xây dựng các hệ thống AI có trách nhiệm. Bài viết này sẽ giúp bạn hiểu rõ về Đạo đức AI từ góc nhìn thực tế, cung cấp kiến thức nền tảng và các chiến lược thực tiễn để giải quyết những vấn đề phức tạp này, từ đó tạo ra giá trị bền vững trong kỷ nguyên số.

Đạo đức AI và Quyền Riêng Tư là gì?

Đạo đức AI là tập hợp các nguyên tắc và giá trị hướng dẫn việc thiết kế, phát triển, triển khai và sử dụng các hệ thống trí tuệ nhân tạo một cách có trách nhiệm, công bằng và minh bạch, nhằm đảm bảo lợi ích cho xã hội và tránh gây hại. Cùng với đó, quyền riêng tư trong AI đề cập đến việc bảo vệ thông tin cá nhân khỏi sự thu thập, xử lý và sử dụng không được phép hoặc không phù hợp bởi các hệ thống AI.

Trong bối cảnh AI ngày càng thâm nhập sâu vào mọi khía cạnh của đời sống, các vấn đề về đạo đức và quyền riêng tư trở nên cấp bách hơn bao giờ hết. Một báo cáo của PwC năm 2023 chỉ ra rằng 85% người tiêu dùng toàn cầu lo ngại về cách các công ty sử dụng dữ liệu cá nhân của họ, trong khi 60% tin rằng AI cần được quản lý chặt chẽ hơn. Điều này cho thấy yêu cầu ngày càng cao từ phía người dùng về sự minh bạch và trách nhiệm giải trình của các hệ thống AI.

Các nguyên tắc đạo đức AI thường bao gồm tính công bằng (fairness), trách nhiệm giải trình (accountability), minh bạch (transparency), khả năng giải thích (explainability) và bảo mật (security). Ví dụ, một hệ thống AI được thiết kế để cấp tín dụng phải đảm bảo rằng nó không phân biệt đối xử dựa trên chủng tộc, giới tính hay tầng lớp xã hội. Nếu hệ thống đó đưa ra quyết định từ chối một khoản vay, người dùng có quyền được biết lý do tại sao, chứ không phải một "hộp đen" bí ẩn. Việc không tuân thủ các nguyên tắc này không chỉ gây ra rủi ro về mặt pháp lý và danh tiếng mà còn làm suy yếu niềm tin của công chúng vào công nghệ AI.

Quyền riêng tư dữ liệu là một trụ cột không thể thiếu của Đạo đức AI. Với lượng dữ liệu khổng lồ mà các mô hình AI tiêu thụ, việc bảo vệ thông tin cá nhân là tối quan trọng. Các quy định như GDPR (General Data Protection Regulation) của Liên minh Châu Âu và CCPA (California Consumer Privacy Act) ở Mỹ đã thiết lập các tiêu chuẩn nghiêm ngặt về cách dữ liệu cá nhân được thu thập, lưu trữ và xử lý. Việc vi phạm các quy định này có thể dẫn đến các khoản phạt khổng lồ, như trường hợp của Meta bị phạt 1.3 tỷ Euro vào năm 2023 vì vi phạm GDPR liên quan đến chuyển dữ liệu xuyên biên giới.

Tóm lại, Đạo đức AI và quyền riêng tư không chỉ là những khái niệm trừu tượng mà là những yêu cầu thực tế, cần được tích hợp vào toàn bộ vòng đời phát triển AI. Từ giai đoạn thiết kế ban đầu đến triển khai và giám sát, mọi quyết định đều phải được cân nhắc kỹ lưỡng dưới lăng kính đạo đức và quyền riêng tư để xây dựng một tương lai AI bền vững và có trách nhiệm.

Triển khai Đạo đức AI và Quyền Riêng Tư trong Phát triển Phần mềm

Để triển khai Đạo đức AI và quyền riêng tư, nhà phát triển cần áp dụng các phương pháp thiết kế lấy con người làm trung tâm, mã hóa có trách nhiệm và kiểm tra nghiêm ngặt ngay từ đầu vòng đời phát triển sản phẩm. Việc này không chỉ là một yêu cầu pháp lý mà còn là một lợi thế cạnh tranh, giúp xây dựng niềm tin và sự chấp nhận của người dùng đối với sản phẩm AI.

Thiết kế lấy con người làm trung tâm (Human-Centric Design)

Thiết kế lấy con người làm trung tâm là phương pháp đặt nhu cầu, khả năng và giới hạn của người dùng làm trọng tâm trong toàn bộ quá trình thiết kế và phát triển hệ thống AI. Thay vì chỉ tập trung vào hiệu suất kỹ thuật, chúng ta cần xem xét tác động xã hội, tâm lý và đạo đức của AI lên con người. Điều này bao gồm việc thu thập phản hồi từ người dùng cuối, các bên liên quan và chuyên gia đạo đức ngay từ giai đoạn đầu. Ví dụ, khi phát triển một chatbot hỗ trợ sức khỏe tâm thần, cần tham khảo ý kiến của các nhà tâm lý học và bệnh nhân để đảm bảo chatbot đưa ra lời khuyên an toàn, hữu ích và không gây hiểu lầm. Việc này giúp giảm thiểu rủi ro về định kiến (bias) và đảm bảo rằng hệ thống AI phục vụ lợi ích thực sự của con người.

Mã hóa có trách nhiệm (Responsible Coding Practices)

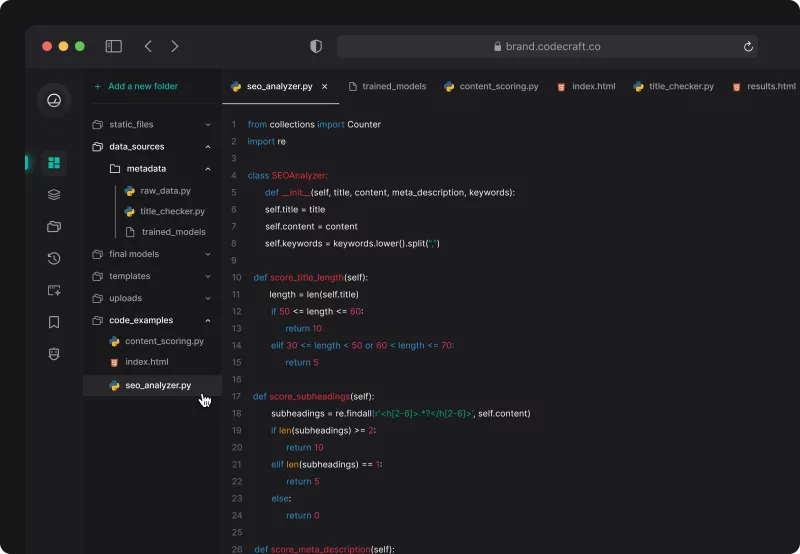

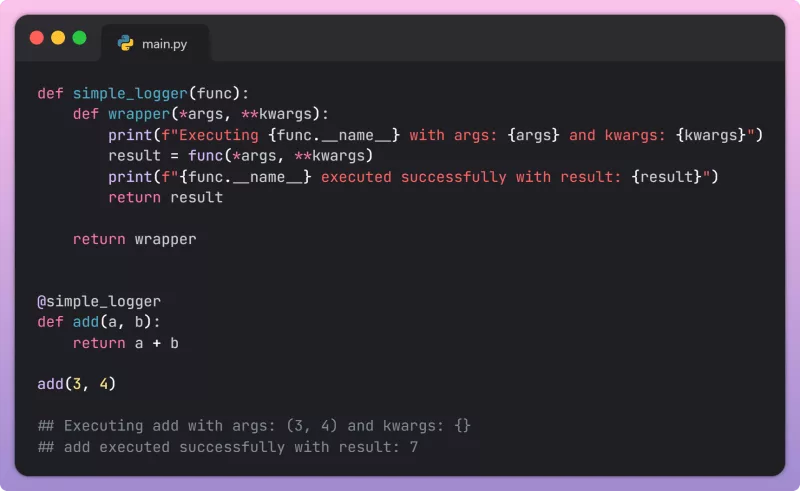

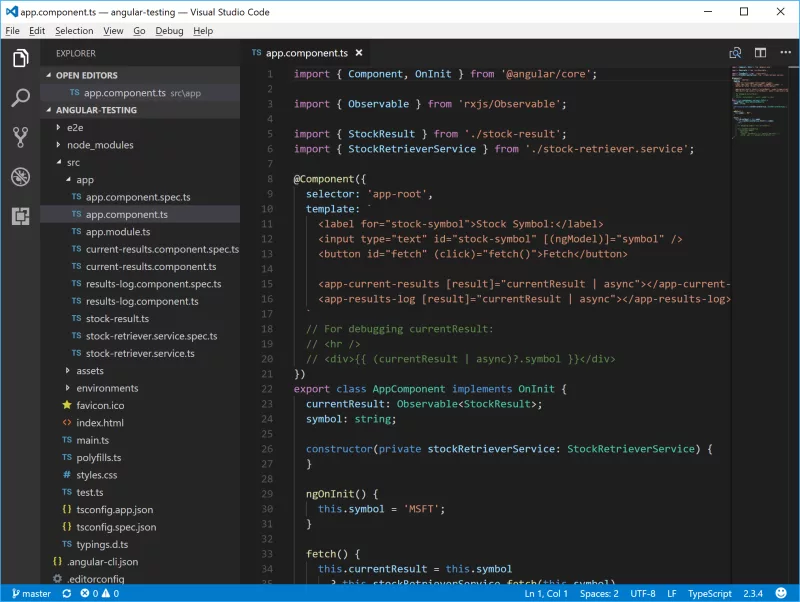

Mã hóa có trách nhiệm đòi hỏi các developer phải viết code không chỉ hiệu quả mà còn an toàn, bảo mật và công bằng. Điều này bao gồm việc sử dụng các thư viện và framework đã được kiểm chứng, thực hiện kiểm tra định kỳ để phát hiện và giảm thiểu sai sót. Một ví dụ cụ thể là việc xử lý dữ liệu nhạy cảm. Thay vì lưu trữ dữ liệu gốc, chúng ta có thể sử dụng các kỹ thuật như ẩn danh hóa (anonymization) hoặc mã hóa (encryption).

Giả sử bạn đang xây dựng một hệ thống AI phân tích dữ liệu y tế. Thay vì xử lý trực tiếp thông tin bệnh nhân, bạn có thể áp dụng mã hóa đầu cuối:

from cryptography.fernet import Fernet

# Tạo một khóa mã hóa (chỉ làm một lần và lưu trữ an toàn)

key = Fernet.generate_key()

cipher_suite = Fernet(key)

# Dữ liệu nhạy cảm

sensitive_data = b"Patient_ID: 12345, Diagnosis: Flu"

# Mã hóa dữ liệu

encrypted_data = cipher_suite.encrypt(sensitive_data)

print(f"Dữ liệu mã hóa: {encrypted_data}")

# Giải mã dữ liệu (chỉ khi cần thiết và có quyền)

decrypted_data = cipher_suite.decrypt(encrypted_data)

print(f"Dữ liệu giải mã: {decrypted_data.decode()}")Việc này đảm bảo rằng ngay cả khi dữ liệu bị đánh cắp, nó vẫn không thể đọc được nếu không có khóa giải mã. Ngoài ra, việc sử dụng các công cụ kiểm tra độ công bằng (fairness tools) như IBM AI Fairness 360 hoặc Google's What-If Tool có thể giúp phát hiện và khắc phục định kiến trong mô hình AI. Ví dụ, công cụ này giúp các nhà phát triển phân tích xem mô hình có hoạt động khác nhau đối với các nhóm dân số khác nhau hay không, chẳng hạn như giới tính hoặc sắc tộc, và cung cấp các phương pháp để giảm thiểu sự thiên vị.

Kiểm thử và Giám sát Liên tục

Việc kiểm thử và giám sát không chỉ dừng lại ở việc đảm bảo chức năng của hệ thống mà còn mở rộng sang các khía cạnh đạo đức và quyền riêng tư. Điều này có nghĩa là chúng ta cần thực hiện các bài kiểm tra định kỳ để phát hiện định kiến, rò rỉ dữ liệu hoặc các hành vi không mong muốn của AI. Các kỹ thuật như kiểm thử đối kháng (adversarial testing) có thể giúp phát hiện các lỗ hổng mà kẻ tấn công có thể khai thác để gây hại hoặc làm sai lệch kết quả của AI. Ví dụ, một mô hình nhận diện khuôn mặt có thể bị đánh lừa bởi các hình ảnh được thiết kế đặc biệt, dẫn đến việc nhận diện sai người. Giám sát liên tục (continuous monitoring) sau khi triển khai cũng rất quan trọng để đảm bảo rằng hệ thống AI vẫn hoạt động đúng cách và không phát sinh các vấn đề đạo đức mới theo thời gian.

Sử dụng các công cụ như TensorFlow Model Card Toolkit để tài liệu hóa các thuộc tính của mô hình, bao gồm cả các đánh giá về độ công bằng và hiệu suất trên các nhóm dữ liệu khác nhau:

# Ví dụ về việc tạo Model Card

from model_card_toolkit import ModelCardToolkit

mct = ModelCardToolkit()

model_card = mct.scaffold_model_card()

model_card.model_details.name = "Credit Scoring Model"

model_card.model_details.overview = (

"Mô hình dự đoán khả năng vỡ nợ của khách hàng dựa trên dữ liệu tài chính."

)

model_card.model_details.developers = ["Vibe Coding Team"]

# Thêm các thông tin về độ công bằng

model_card.fairness_considerations.fairness_assessments.add(

name="Gender Fairness",

description="Đánh giá hiệu suất của mô hình đối với các nhóm giới tính khác nhau.",

quantitative_analysis="FPR (Female): 0.15, FPR (Male): 0.12"

)

mct.export_to_html(model_card)Tóm lại, việc tích hợp Đạo đức AI và quyền riêng tư vào quá trình phát triển phần mềm không phải là một tùy chọn mà là một yêu cầu bắt buộc. Bằng cách áp dụng thiết kế lấy con người làm trung tâm, mã hóa có trách nhiệm và kiểm thử nghiêm ngặt, chúng ta có thể xây dựng các hệ thống AI đáng tin cậy, công bằng và có trách nhiệm.

Tips và Best Practices để Đảm Bảo Đạo đức AI và Quyền Riêng Tư

Để đảm bảo Đạo đức AI và quyền riêng tư trong các dự án công nghệ, việc áp dụng các tips và best practices là cực kỳ quan trọng, giúp giảm thiểu rủi ro và xây dựng hệ thống AI đáng tin cậy.

- Thành lập Ủy ban Đạo đức AI: Một ủy ban chuyên trách gồm các chuyên gia từ nhiều lĩnh vực (AI, đạo đức, luật, xã hội học) có thể đưa ra các hướng dẫn và đánh giá độc lập về các dự án AI. Theo một khảo sát của Deloitte năm 2022, 35% các công ty hàng đầu đã thành lập các nhóm hoặc ủy ban chuyên trách về Đạo đức AI.

- Thực hiện Đánh giá Tác động Đạo đức (Ethical Impact Assessment - EIA): Tương tự như đánh giá tác động môi trường, EIA giúp xác định các rủi ro đạo đức tiềm ẩn của một hệ thống AI trước khi triển khai. Điều này bao gồm việc phân tích các kịch bản xấu nhất và chuẩn bị các biện pháp giảm thiểu.

- Sử dụng Dữ liệu Tổng hợp hoặc Ẩn danh: Khi có thể, hãy sử dụng dữ liệu tổng hợp (synthetic data) hoặc đã được ẩn danh hóa (anonymized data) để huấn luyện mô hình. Điều này giúp bảo vệ quyền riêng tư cá nhân mà vẫn đảm bảo đủ dữ liệu cho việc phát triển AI. Một nghiên cứu của Gartner cho thấy đến năm 2025, 60% dữ liệu được sử dụng cho AI sẽ là dữ liệu tổng hợp.

- Minh bạch trong Quyết định của AI: Cung cấp khả năng giải thích (explainability) cho các quyết định của AI. Người dùng nên có quyền được biết tại sao một hệ thống AI lại đưa ra một kết quả cụ thể. Sử dụng các kỹ thuật như LIME (Local Interpretable Model-agnostic Explanations) hoặc SHAP (Shapley Additive exPlanations) để giải thích các dự đoán của mô hình.

- Đào tạo và Nâng cao Nhận thức: Đảm bảo rằng tất cả các thành viên trong nhóm phát triển, từ kỹ sư đến quản lý sản phẩm, đều được đào tạo về Đạo đức AI và các quy định về quyền riêng tư. Nâng cao nhận thức về các hậu quả tiềm tàng của việc bỏ qua các nguyên tắc này.

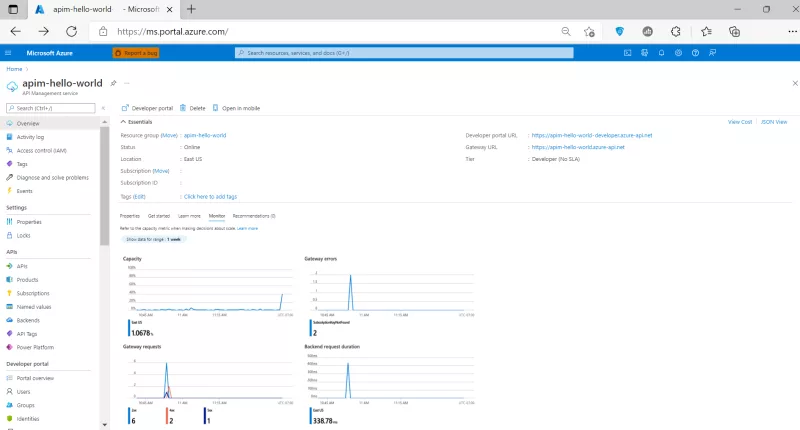

- Áp dụng Thiết kế Bảo mật từ Đầu (Security by Design): Tích hợp các biện pháp bảo mật vào mọi giai đoạn của vòng đời phát triển AI, từ thiết kế kiến trúc đến triển khai và vận hành. Điều này bao gồm việc bảo vệ dữ liệu, mô hình và cơ sở hạ tầng AI khỏi các cuộc tấn công mạng.

- Tuân thủ Quy định Pháp luật: Luôn cập nhật và tuân thủ các quy định pháp luật liên quan đến quyền riêng tư dữ liệu như GDPR, CCPA, và các luật địa phương khác. Việc này không chỉ tránh được các khoản phạt mà còn xây dựng lòng tin với người dùng.

So Sánh Các Khung Đạo đức AI Phổ Biến

Các khung đạo đức AI phổ biến như của EU, OECD và IEEE đều nhấn mạnh các nguyên tắc cốt lõi về công bằng, minh bạch và trách nhiệm giải trình, nhưng có sự khác biệt nhỏ về trọng tâm và cách tiếp cận, cho phép các tổ chức lựa chọn khung phù hợp nhất với bối cảnh hoạt động của mình.

Khung Đạo đức AI của Liên minh Châu Âu (EU)

Khung của EU, nổi bật với "Đạo luật AI" (AI Act) đang được triển khai, tập trung mạnh vào việc phân loại AI theo mức độ rủi ro. Các hệ thống AI có "rủi ro cao" (high-risk AI systems) như trong y tế, giao thông, hoặc tuyển dụng, sẽ phải tuân thủ các yêu cầu nghiêm ngặt nhất về chất lượng dữ liệu, giám sát con người, minh bạch và an toàn. Mục tiêu chính là bảo vệ quyền cơ bản của công dân EU. Ví dụ, một hệ thống AI dùng để chấm điểm tín dụng sẽ thuộc loại rủi ro cao và phải trải qua các quy trình đánh giá tuân thủ chặt chẽ. Nếu bạn hoạt động trong các lĩnh vực nhạy cảm, khung của EU là lựa chọn tốt nhất để đảm bảo tuân thủ pháp lý và xây dựng lòng tin.

Nguyên tắc AI của OECD

Tổ chức Hợp tác và Phát triển Kinh tế (OECD) đã đưa ra 5 nguyên tắc AI dựa trên giá trị và 5 khuyến nghị cho chính phủ, tập trung vào tăng trưởng bao trùm, phát triển bền vững và phúc lợi. Các nguyên tắc này bao gồm: 1. Tăng trưởng bao trùm, phát triển bền vững và phúc lợi; 2. Giá trị lấy con người làm trung tâm và công bằng; 3. Minh bạch và khả năng giải thích; 4. Sự mạnh mẽ, an toàn và bảo mật; 5. Trách nhiệm giải trình. Khung của OECD mang tính toàn cầu hơn và ít quy định cụ thể hơn so với EU, hướng đến việc tạo ra một môi trường thuận lợi cho sự đổi mới AI có trách nhiệm. Nếu bạn là một doanh nghiệp hoạt động đa quốc gia và muốn một bộ nguyên tắc linh hoạt nhưng vẫn toàn diện, OECD là một điểm khởi đầu tốt.

Sáng kiến Đạo đức AI của IEEE

Viện Kỹ sư Điện và Điện tử (IEEE) tập trung vào việc tạo ra các tiêu chuẩn kỹ thuật cụ thể để triển khai các nguyên tắc Đạo đức AI trong thực tế. Sáng kiến "Ethically Aligned Design" của IEEE cung cấp các hướng dẫn chi tiết về cách tích hợp các giá trị đạo đức vào thiết kế, phát triển và thử nghiệm các hệ thống tự động và AI. Ví dụ, IEEE đã phát triển các tiêu chuẩn cho việc đo lường độ công bằng trong thuật toán hoặc cách thiết kế giao diện người dùng để tăng cường sự minh bạch. Nếu bạn là một kỹ sư hoặc nhà phát triển đang tìm kiếm các giải pháp kỹ thuật cụ thể để áp dụng Đạo đức AI, các tiêu chuẩn của IEEE sẽ rất hữu ích.

Tóm lại, cả ba khung đều có mục tiêu chung là thúc đẩy AI có trách nhiệm. Khung của EU phù hợp nhất cho các tổ chức cần tuân thủ pháp lý nghiêm ngặt trong các lĩnh vực rủi ro cao. Khung của OECD cung cấp các nguyên tắc cấp cao, lý tưởng cho việc định hướng chiến lược toàn cầu. Trong khi đó, IEEE cung cấp các công cụ và tiêu chuẩn kỹ thuật để triển khai Đạo đức AI trên thực tế. Việc hiểu rõ sự khác biệt này giúp các doanh nghiệp và nhà phát triển lựa chọn hướng tiếp cận phù hợp nhất với nhu cầu và bối cảnh hoạt động của mình.

Các Lưu Ý Quan Trọng

- Định kiến trong Dữ liệu Huấn luyện: Các mô hình AI học từ dữ liệu mà chúng được cung cấp. Nếu dữ liệu này chứa đựng định kiến xã hội (ví dụ: dữ liệu tuyển dụng chỉ ưu tiên nam giới), AI sẽ tái tạo và thậm chí khuếch đại những định kiến đó. Theo một nghiên cứu của MIT, một số hệ thống nhận diện khuôn mặt có sai số lên đến 34% đối với phụ nữ da màu, trong khi chỉ 0.8% đối với nam giới da trắng.

- Vấn đề "Hộp Đen" (Black Box Problem): Nhiều mô hình AI phức tạp, đặc biệt là mạng nơ-ron sâu, hoạt động như một "hộp đen" – rất khó để hiểu tại sao chúng lại đưa ra một quyết định cụ thể. Điều này gây khó khăn cho việc giải thích, kiểm tra và đảm bảo trách nhiệm giải trình.

- Rủi ro về Quyền Riêng Tư Dữ liệu: Việc thu thập và xử lý lượng lớn dữ liệu cá nhân bởi AI tiềm ẩn nguy cơ rò rỉ, lạm dụng hoặc tấn công mạng. Ngay cả khi dữ liệu được ẩn danh, các kỹ thuật tái nhận dạng (re-identification) vẫn có thể được sử dụng để liên kết dữ liệu với cá nhân.

- Tự động hóa và Thay thế Việc làm: AI có thể tự động hóa nhiều công việc, dẫn đến lo ngại về việc làm và tác động xã hội. Cần có các chính sách để hỗ trợ người lao động chuyển đổi và đào tạo lại.

- Sử dụng Sai mục đích hoặc Độc hại: AI có thể bị sử dụng cho các mục đích độc hại như vũ khí tự hành, giám sát hàng loạt hoặc tạo ra thông tin sai lệch (deepfake).

- Thiếu Quy định và Khung Pháp lý: Mặc dù đang có những nỗ lực, tốc độ phát triển của AI vẫn nhanh hơn tốc độ xây dựng các quy định pháp lý. Điều này tạo ra một khoảng trống nơi các vấn đề đạo đức có thể phát sinh mà không có cơ chế giải quyết rõ ràng.

- Trách nhiệm Giải trình: Khi một hệ thống AI gây ra lỗi hoặc thiệt hại, việc xác định ai chịu trách nhiệm (nhà phát triển, nhà triển khai, người vận hành) là một thách thức phức tạp.

Câu Hỏi Thường Gặp

Làm thế nào để giảm thiểu định kiến trong mô hình AI?

Để giảm thiểu định kiến trong mô hình AI, bạn cần tập trung vào việc thu thập dữ liệu huấn luyện đa dạng và cân bằng, áp dụng các kỹ thuật tiền xử lý dữ liệu để loại bỏ hoặc giảm bớt định kiến, và sử dụng các thuật toán công bằng (fairness-aware algorithms). Việc kiểm tra định kỳ bằng các công cụ đo lường độ công bằng như IBM AI Fairness 360 cũng rất quan trọng để phát hiện và khắc phục các sai lệch.

GDPR và CCPA ảnh hưởng thế nào đến phát triển AI?

GDPR (General Data Protection Regulation) và CCPA (California Consumer Privacy Act) có ảnh hưởng đáng kể đến phát triển AI bằng cách đặt ra các yêu cầu nghiêm ngặt về quyền riêng tư dữ liệu. Các quy định này yêu cầu các nhà phát triển AI phải có sự đồng ý rõ ràng từ người dùng khi thu thập dữ liệu cá nhân, cung cấp quyền truy cập và xóa dữ liệu, và thực hiện đánh giá tác động quyền riêng tư (DPIA). Việc không tuân thủ có thể dẫn đến các khoản phạt tài chính rất lớn và mất niềm tin từ người dùng.

Khả năng giải thích (Explainability) của AI có ý nghĩa gì?

Khả năng giải thích của AI (Explainable AI - XAI) có nghĩa là khả năng hiểu được tại sao một hệ thống AI lại đưa ra một quyết định hoặc dự đoán cụ thể. Điều này quan trọng để xây dựng lòng tin, đảm bảo trách nhiệm giải trình, phát hiện lỗi và định kiến trong mô hình. Các kỹ thuật như LIME hoặc SHAP giúp minh bạch hóa các mô hình "hộp đen" bằng cách giải thích các yếu tố đầu vào nào có ảnh hưởng lớn nhất đến kết quả đầu ra.

Làm thế nào để đảm bảo an toàn và bảo mật cho các hệ thống AI?

Để đảm bảo an toàn và bảo mật cho các hệ thống AI, bạn cần áp dụng các biện pháp bảo mật từ giai đoạn thiết kế (Security by Design), bao gồm mã hóa dữ liệu, xác thực mạnh mẽ, và kiểm soát truy cập. Ngoài ra, cần bảo vệ mô hình AI khỏi các cuộc tấn công đối kháng (adversarial attacks) có thể làm sai lệch kết quả, và thực hiện kiểm tra thâm nhập định kỳ. Giám sát liên tục các hoạt động của hệ thống AI cũng giúp phát hiện và phản ứng kịp thời với các mối đe dọa.

Việc sử dụng AI có thể gây ra những rủi ro đạo đức nào?

Việc sử dụng AI có thể gây ra nhiều rủi ro đạo đức, bao gồm định kiến và phân biệt đối xử (do dữ liệu huấn luyện không công bằng), thiếu minh bạch ("hộp đen" AI), xâm phạm quyền riêng tư (do thu thập và xử lý dữ liệu cá nhân), mất việc làm do tự động hóa, và khả năng sử dụng AI cho các mục đích độc hại như giám sát hoặc vũ khí tự hành. Những rủi ro này đòi hỏi sự cân nhắc kỹ lưỡng và các biện pháp giảm thiểu chủ động.

Kết Luận

Đạo đức AI và quyền riêng tư không chỉ là những thách thức mà còn là cơ hội để định hình một tương lai công nghệ có trách nhiệm và bền vững. Bằng cách tích hợp các nguyên tắc đạo đức vào mọi giai đoạn phát triển, từ thiết kế đến triển khai, chúng ta có thể xây dựng các hệ thống AI không chỉ mạnh mẽ về mặt kỹ thuật mà còn đáng tin cậy và công bằng cho xã hội. Việc này đòi hỏi sự hợp tác giữa các nhà phát triển, doanh nghiệp, chính phủ và cộng đồng để tạo ra một khuôn khổ toàn diện. Tại vibe coding, chúng tôi tin rằng việc nắm vững và áp dụng các nguyên tắc này là chìa khóa để khai thác tối đa tiềm năng của AI, đồng thời bảo vệ các giá trị cốt lõi của con người trong kỷ nguyên số.