Giới Thiệu "Vibe Coding": Kỹ thuật Debugging AI hiệu quả vượt trội cho Dev

Debugging AI là một kỹ năng thiết yếu giúp các nhà phát triển xác định, phân tích và khắc phục lỗi trong các hệ thống trí tuệ nhân tạo, đảm bảo chúng hoạt động đúng như mong đợi. Bài viết về debugging ai này sẽ giúp bạn nâng tầm kỹ năng này, biến quá trình gỡ lỗi từ một thử thách thành một lợi thế, đặc biệt trong bối cảnh phát triển AI ngày càng phức tạp. Chúng ta sẽ khám phá các phương pháp, công cụ và tư duy cần thiết để tiếp cận debugging AI một cách hiệu quả, từ các mô hình học máy truyền thống đến các hệ thống học sâu phức tạp, giúp bạn "bắt bệnh" AI nhanh chóng và chính xác.

"Debugging AI" Là Gì và Tại Sao Nó Quan Trọng?

Debugging AI là quá trình kiểm tra, phân tích và sửa chữa các lỗi hoặc hành vi không mong muốn trong các hệ thống trí tuệ nhân tạo, bao gồm cả lỗi trong dữ liệu, mô hình, cấu trúc code hoặc logic thuật toán. Nó quan trọng bởi vì ngay cả những mô hình AI phức tạp nhất cũng có thể mắc lỗi, dẫn đến kết quả không chính xác, thiên vị hoặc thậm chí là các quyết định nguy hiểm trong các ứng dụng thực tế. Theo một nghiên cứu của IBM, các nhà phát triển dành tới 30-45% thời gian dự án để gỡ lỗi, và với AI, con số này có thể cao hơn do tính chất "hộp đen" của nhiều mô hình.

Điểm khác biệt cốt lõi giữa debugging AI và debugging phần mềm truyền thống nằm ở tính khó đoán và sự phụ thuộc vào dữ liệu của AI. Trong khi code phần mềm thường có logic rõ ràng và deterministic, hành vi của AI lại chịu ảnh hưởng mạnh mẽ bởi dữ liệu huấn luyện, kiến trúc mô hình và các tham số siêu (hyperparameters). Một lỗi nhỏ trong dữ liệu có thể dẫn đến sự sai lệch lớn trong dự đoán. Ví dụ, một mô hình phân loại hình ảnh được huấn luyện với dữ liệu thiên vị có thể nhận diện sai người hoặc vật thể, gây ra những hậu quả nghiêm trọng.

Việc không thể gỡ lỗi AI hiệu quả có thể dẫn đến nhiều vấn đề. Đầu tiên là chi phí phát triển tăng cao, vì việc tìm ra nguyên nhân gốc rễ của một lỗi AI thường tốn nhiều thời gian và tài nguyên hơn. Thứ hai là giảm độ tin cậy của hệ thống AI, khiến người dùng khó chấp nhận và tin tưởng vào các giải pháp dựa trên AI. Thứ ba, và có lẽ quan trọng nhất, là rủi ro về đạo đức và pháp lý, đặc biệt trong các lĩnh vực nhạy cảm như y tế, tài chính hay tự động hóa, nơi quyết định sai lầm của AI có thể gây ra thiệt hại lớn. Do đó, việc nắm vững các kỹ thuật debugging AI không chỉ là một kỹ năng kỹ thuật mà còn là một yêu cầu đạo đức đối với bất kỳ nhà phát triển AI nào.

Một trong những thách thức lớn nhất khi debugging AI là sự thiếu minh bạch (lack of interpretability). Nhiều mô hình học sâu hoạt động như "hộp đen," rất khó để lý giải tại sao chúng lại đưa ra một quyết định cụ thể. Điều này đòi hỏi các phương pháp debugging đặc biệt, tập trung vào việc hiểu hành vi của mô hình thay vì chỉ đơn thuần tìm lỗi cú pháp. Khoảng 60% các dự án AI thất bại trong việc triển khai do các vấn đề liên quan đến độ tin cậy và khả năng giải thích, trong đó debugging đóng vai trò then chốt.

Hướng Dẫn Thực Hành: Các Kỹ Thuật Debugging AI Cơ Bản

Để debugging AI hiệu quả, chúng ta cần tiếp cận một cách có hệ thống, bắt đầu từ những nguyên nhân phổ biến nhất. Các kỹ thuật sau đây sẽ giúp bạn chẩn đoán và khắc phục lỗi trong quá trình phát triển AI của mình.

1. Kiểm Tra Dữ Liệu (Data Inspection)

Kiểm tra dữ liệu là bước đầu tiên và thường là quan trọng nhất trong debugging AI, vì "garbage in, garbage out" vẫn là chân lý. Khoảng 80% các vấn đề về hiệu suất mô hình AI bắt nguồn từ dữ liệu. Bạn cần đảm bảo dữ liệu sạch, không thiên vị và được định dạng đúng.

- Phân tích thống kê: Sử dụng các công cụ như Pandas để kiểm tra phân phối, giá trị thiếu, ngoại lệ (outliers) và các mối tương quan. Ví dụ, nếu bạn đang xây dựng một mô hình phân loại, hãy đảm bảo các lớp được phân bổ tương đối đồng đều.

- Trực quan hóa dữ liệu: Biểu đồ, đồ thị (histograms, scatter plots) giúp phát hiện các mẫu bất thường hoặc lỗi trong dữ liệu mà các con số thống kê có thể bỏ qua.

- Kiểm tra lỗi nhập liệu: Đôi khi, lỗi chỉ đơn giản là do nhập liệu sai, giá trị ngoài phạm vi hoặc định dạng không nhất quán.

import pandas as pd

import matplotlib.pyplot as plt

import seaborn as sns

# Giả sử bạn có DataFrame df

df = pd.read_csv('your_dataset.csv')

# Kiểm tra thông tin cơ bản

print(df.info())

print(df.describe())

# Kiểm tra giá trị thiếu

print(df.isnull().sum())

# Trực quan hóa phân phối của một cột số

plt.figure(figsize=(10, 6))

sns.histplot(df['numerical_feature'], kde=True)

plt.title('Distribution of Numerical Feature')

plt.show()

# Trực quan hóa mối quan hệ giữa hai biến

plt.figure(figsize=(10, 6))

sns.scatterplot(x='feature_A', y='target_B', data=df)

plt.title('Feature A vs Target B')

plt.show()2. Kiểm Tra Mã Nguồn Mô Hình (Model Code Inspection)

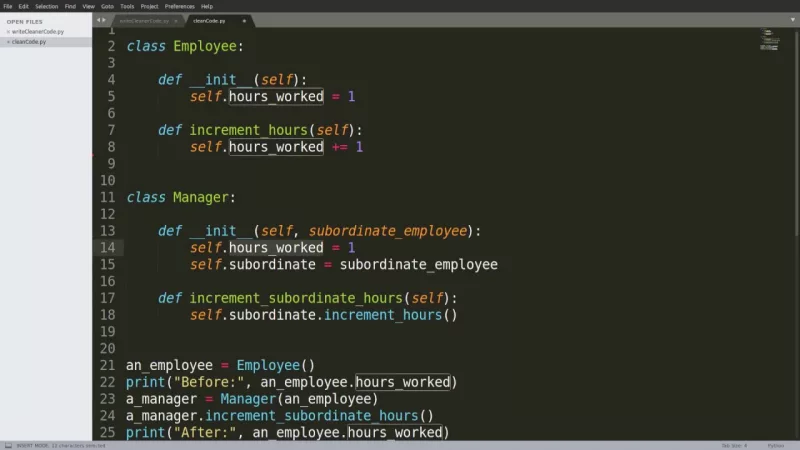

Kiểm tra mã nguồn mô hình bao gồm việc rà soát lại logic xây dựng mô hình, các hàm mất mát (loss functions), tối ưu hóa (optimizers) và các lớp kiến trúc. Ngay cả khi bạn sử dụng các thư viện AI phổ biến, vẫn có thể có lỗi trong cách bạn kết nối các thành phần.

- Kiểm tra kích thước tensor/shape: Đây là lỗi phổ biến nhất trong các mạng nơ-ron. Đảm bảo các kích thước đầu vào và đầu ra của mỗi lớp khớp với nhau. Thư viện như PyTorch hoặc TensorFlow thường cung cấp thông báo lỗi rõ ràng khi có sự không khớp về shape.

- Kiểm tra hàm mất mát và thuật toán tối ưu: Sử dụng đúng hàm mất mát cho bài toán của bạn (ví dụ:

BinaryCrossentropycho phân loại nhị phân,CategoricalCrossentropycho phân loại đa lớp). Đảm bảo tốc độ học (learning rate) của optimizer không quá cao hoặc quá thấp. - Kiểm tra lỗi logic: Đôi khi, lỗi không phải ở cú pháp mà ở logic thuật toán. Ví dụ, bạn có thể áp dụng sai phép chuẩn hóa (normalization) hoặc khởi tạo trọng số không phù hợp.

import tensorflow as tf

from tensorflow.keras import layers, models

def build_model(input_shape):

model = models.Sequential([

layers.Input(shape=input_shape),

layers.Conv2D(32, (3, 3), activation='relu'),

layers.MaxPooling2D((2, 2)),

layers.Conv2D(64, (3, 3), activation='relu'),

layers.MaxPooling2D((2, 2)),

layers.Flatten(),

layers.Dense(64, activation='relu'),

layers.Dense(10, activation='softmax') # Output 10 classes

])

return model

input_shape = (28, 28, 1) # Ví dụ cho ảnh grayscale 28x28

model = build_model(input_shape)

# In tóm tắt mô hình để kiểm tra shape của các lớp

model.summary()

# Kiểm tra cấu hình compile

model.compile(optimizer='adam',

loss=tf.keras.losses.SparseCategoricalCrossentropy(from_logits=False),

metrics=['accuracy'])3. Giám Sát Quá Trình Huấn Luyện (Training Process Monitoring)

Giám sát quá trình huấn luyện là việc theo dõi các chỉ số hiệu suất (metrics) và hàm mất mát (loss) trong suốt quá trình mô hình học. Điều này giúp phát hiện các vấn đề như overfitting, underfitting hoặc gradient vanishing/exploding.

- Theo dõi Loss và Accuracy/Metrics: Sử dụng công cụ như TensorBoard (TensorFlow) hoặc Comet ML, Weights & Biases (PyTorch) để trực quan hóa biểu đồ loss và các chỉ số trên tập huấn luyện và tập validation.

- Nếu loss huấn luyện giảm nhưng loss validation tăng, đó là dấu hiệu của overfitting.

- Nếu cả loss huấn luyện và validation đều cao và không giảm, đó là dấu hiệu của underfitting.

- Kiểm tra Learning Rate: Tốc độ học quá cao có thể khiến loss dao động mạnh hoặc không hội tụ. Tốc độ học quá thấp khiến quá trình huấn luyện diễn ra rất chậm.

- Kiểm tra Gradient: Đối với các mô hình học sâu, gradient vanishing (gradient quá nhỏ) hoặc exploding (gradient quá lớn) là vấn đề thường gặp. Các công cụ như TensorBoard có thể hiển thị phân phối gradient của các lớp.

4. Phân Tích Lỗi Dự Đoán (Prediction Error Analysis)

Phân tích lỗi dự đoán là việc xem xét các trường hợp mà mô hình đưa ra dự đoán sai để hiểu rõ hơn về điểm yếu của nó. Đây là một kỹ thuật debugging AI rất hiệu quả.

- Phân loại lỗi: Chia các lỗi dự đoán thành các loại cụ thể (ví dụ: mô hình nhầm lẫn giữa mèo và chó, hoặc không nhận diện được vật thể trong điều kiện ánh sáng kém).

- Trực quan hóa các ví dụ lỗi: Hiển thị các ví dụ mà mô hình dự đoán sai cùng với dự đoán của nó. Điều này thường tiết lộ các mẫu dữ liệu mà mô hình gặp khó khăn.

- Ma trận nhầm lẫn (Confusion Matrix): Đối với bài toán phân loại, ma trận nhầm lẫn là công cụ tuyệt vời để xem lớp nào bị nhầm lẫn với lớp nào.

from sklearn.metrics import confusion_matrix, classification_report

import numpy as np

# Giả sử y_true là nhãn thực tế, y_pred là nhãn dự đoán của mô hình

y_true = np.array([0, 1, 2, 0, 1, 2, 0, 0, 1, 2])

y_pred = np.array([0, 1, 1, 0, 2, 2, 0, 1, 1, 2])

# Tạo ma trận nhầm lẫn

cm = confusion_matrix(y_true, y_pred)

print("Confusion Matrix:\n", cm)

# Báo cáo phân loại chi tiết

print("\nClassification Report:\n", classification_report(y_true, y_pred))

# Tìm các ví dụ bị dự đoán sai

incorrect_indices = np.where(y_true != y_pred)[0]

print(f"\nIndices of incorrectly predicted samples: {incorrect_indices}")

# Ví dụ: nếu bạn có ảnh, bạn có thể hiển thị ảnh tại các chỉ số này

# for idx in incorrect_indices:

# display_image(X_test[idx], y_true[idx], y_pred[idx])Tips và Best Practices để Nâng Tầm Debugging AI

Để trở thành một chuyên gia debugging AI, bạn cần áp dụng các phương pháp và tư duy chiến lược. Dưới đây là những lời khuyên thực tế từ kinh nghiệm của các dev AI hàng đầu.

- Bắt đầu với mô hình đơn giản: Khi gặp lỗi, hãy thử đơn giản hóa mô hình của bạn. Một mô hình nhỏ hơn, ít lớp hơn, hoặc thậm chí là một thuật toán machine learning truyền thống có thể giúp bạn xác định liệu vấn đề nằm ở kiến trúc phức tạp hay ở dữ liệu và cài đặt cơ bản. Cách tiếp cận này giúp cô lập vấn đề nhanh hơn, giảm 70% thời gian tìm lỗi ban đầu.

- Sử dụng dữ liệu nhỏ, sạch: Để kiểm tra các lỗi logic cơ bản, hãy tạo một tập dữ liệu nhỏ (ví dụ: 10-100 mẫu) mà bạn biết chắc chắn là sạch và có thể dễ dàng kiểm tra bằng mắt thường. Điều này giúp bạn xác nhận rằng mô hình có thể học được trên một tập dữ liệu lý tưởng trước khi đối mặt với sự phức tạp của dữ liệu lớn.

- Kiểm soát ngẫu nhiên (Seed Randomness): Để đảm bảo khả năng tái lập (reproducibility) của các lỗi, hãy luôn seed các hàm ngẫu nhiên (random seeds) trong thư viện như NumPy, TensorFlow, PyTorch. Điều này đảm bảo rằng mỗi lần bạn chạy code, kết quả sẽ nhất quán (nếu không có thay đổi nào khác), giúp việc debug dễ dàng hơn.

import numpy as np import tensorflow as tf import random def set_seed(seed=42): np.random.seed(seed) tf.random.set_seed(seed) random.seed(seed) # Nếu dùng Pytorch # import torch # torch.manual_seed(seed) # torch.cuda.manual_seed(seed) # torch.backends.cudnn.deterministic = True # torch.backends.cudnn.benchmark = False set_seed(123) - Sử dụng các công cụ trực quan hóa mạnh mẽ: Không chỉ TensorBoard, hãy khám phá các công cụ như SHAP (SHapley Additive exPlanations) và LIME (Local Interpretable Model-agnostic Explanations) để hiểu tại sao mô hình đưa ra một dự đoán cụ thể. Các công cụ này giúp "mở hộp đen" của mô hình, cho bạn biết yếu tố nào trong dữ liệu đầu vào đã đóng góp nhiều nhất vào kết quả dự đoán. Theo thống kê, việc sử dụng các công cụ giải thích mô hình có thể giảm 40% thời gian debugging các lỗi liên quan đến hành vi mô hình.

- Ghi log chi tiết và có chiến lược: Đừng chỉ ghi log các giá trị cuối cùng. Ghi log các giá trị trung gian quan trọng (ví dụ: giá trị của gradient, đầu ra của các lớp ẩn, phân phối trọng số) trong quá trình huấn luyện. Điều này cung cấp cái nhìn sâu sắc về những gì đang xảy ra bên trong mô hình.

- Viết Unit Tests cho các thành phần AI: Mặc dù khó kiểm thử toàn bộ mô hình AI, bạn hoàn toàn có thể viết unit tests cho các phần riêng lẻ của pipeline: tiền xử lý dữ liệu, các hàm mất mát tùy chỉnh, các lớp kiến trúc tùy chỉnh, hoặc các hàm đánh giá metrics. Điều này giúp đảm bảo từng mảnh ghép hoạt động đúng trước khi lắp ráp thành hệ thống lớn.

- Tìm kiếm các mẫu lỗi (Error Patterns): Khi mô hình mắc lỗi, hãy tìm kiếm các mẫu chung. Ví dụ: liệu nó có mắc lỗi trên cùng một loại dữ liệu (ảnh tối, văn bản có từ hiếm), hay cùng một lớp cụ thể? Việc nhận diện các mẫu này sẽ giúp bạn thu hẹp phạm vi tìm kiếm nguyên nhân.

- Đừng ngại hỏi và tìm kiếm cộng đồng: Cộng đồng AI rất lớn và tích cực. Nếu bạn đã thử mọi thứ mà vẫn bế tắc, đừng ngần ngại chia sẻ vấn đề của mình trên các diễn đàn như Stack Overflow, GitHub Issues của các thư viện bạn đang dùng, hoặc các nhóm chuyên môn. Một góc nhìn mới có thể là chìa khóa giải quyết vấn đề.

So Sánh Debugging AI Truyền Thống và Debugging AI Hiện Đại

Debugging AI đã phát triển đáng kể cùng với sự tiến bộ của công nghệ. Ban đầu, việc gỡ lỗi AI chủ yếu tập trung vào việc kiểm tra các thuật toán Machine Learning truyền thống và các lỗi trong code. Ngày nay, với sự bùng nổ của học sâu, debugging AI đã trở nên phức tạp hơn, đòi hỏi các công cụ và phương pháp tiếp cận mới.

Debugging AI truyền thống (khi làm việc với các thuật toán như Linear Regression, Decision Trees, SVMs) thường tập trung vào:

- Kiểm tra dữ liệu: Đảm bảo dữ liệu sạch, không có ngoại lệ.

- Kiểm tra siêu tham số: Tinh chỉnh các siêu tham số (hyperparameters) như C trong SVM, max_depth trong Decision Tree.

- Phân tích lỗi mô hình: Đánh giá các metrics như precision, recall, F1-score và phân tích các trường hợp dự đoán sai.

- Kiểm tra lỗi logic code: Đảm bảo thuật toán được triển khai đúng.

Debugging AI hiện đại (khi làm việc với Deep Learning, Reinforcement Learning) phải đối mặt với những thách thức lớn hơn:

- Tính "hộp đen": Các mạng nơ-ron sâu với hàng triệu tham số rất khó để lý giải hành vi bên trong.

- Sự phụ thuộc vào GPU/TPU: Lỗi có thể xuất hiện do sự không tương thích phần cứng, driver hoặc cấu hình môi trường.

- Độ nhạy cảm với dữ liệu: Một sự thay đổi nhỏ trong dữ liệu đầu vào có thể dẫn đến sự thay đổi lớn trong đầu ra (adversarial examples).

- Phức tạp của kiến trúc: Các kiến trúc như Transformers, GANs có nhiều thành phần tương tác phức tạp, khiến việc xác định nguồn gốc lỗi trở nên khó khăn.

Các Lưu Ý Quan Trọng

- Đừng bỏ qua việc kiểm tra môi trường: Đôi khi lỗi không nằm ở code hay dữ liệu mà ở môi trường phát triển (phiên bản thư viện, driver GPU, cấu hình CUDA). Luôn đảm bảo môi trường của bạn được thiết lập đúng cách và nhất quán.

- Hiểu rõ bài toán của bạn: Trước khi lao vào debug, hãy dành thời gian hiểu rõ bài toán kinh doanh, mục tiêu và kỳ vọng từ mô hình AI. Điều này giúp bạn xác định "lỗi" là gì và liệu mô hình có thực sự cần một giải pháp phức tạp hay không.

- Ghi lại quá trình debug: Ghi lại các bước bạn đã thực hiện, những gì bạn đã thử và kết quả. Điều này không chỉ giúp bạn theo dõi tiến độ mà còn là tài liệu quý giá cho các lần debug sau hoặc khi làm việc nhóm.

- Thử nghiệm từng phần: Trong một pipeline AI phức tạp, hãy thử nghiệm từng phần (data loading, preprocessing, model forward pass, loss calculation, backward pass) một cách độc lập. Điều này giúp cô lập lỗi nhanh chóng.

- Học cách đọc thông báo lỗi: Các thông báo lỗi từ TensorFlow, PyTorch hay Scikit-learn thường cung cấp gợi ý rất giá trị về nguyên nhân gốc rễ. Đừng bỏ qua chúng.

- Thường xuyên cập nhật kiến thức: Lĩnh vực AI phát triển rất nhanh. Các công cụ và kỹ thuật debugging mới liên tục xuất hiện. Hãy luôn cập nhật để sử dụng những phương pháp hiệu quả nhất.

- Đừng sợ khởi động lại từ đầu: Đôi khi, khi bạn đã thử quá nhiều thứ và mọi thứ trở nên rối bời, việc khởi động lại từ một môi trường sạch, với một phiên bản code đã biết là hoạt động, có thể là cách nhanh nhất để tìm ra lỗi.

Câu Hỏi Thường Gặp

Làm thế nào để phân biệt Overfitting và Underfitting khi Debugging AI?

Để phân biệt Overfitting và Underfitting, bạn cần theo dõi hiệu suất của mô hình trên cả tập huấn luyện (training set) và tập kiểm định (validation set). Nếu mô hình có Overfitting, loss trên tập huấn luyện sẽ giảm rất thấp, nhưng loss trên tập kiểm định lại tăng hoặc duy trì ở mức cao, cho thấy mô hình học thuộc lòng dữ liệu huấn luyện mà không khái quát hóa được. Ngược lại, nếu mô hình bị Underfitting, cả loss trên tập huấn luyện và tập kiểm định đều cao và không giảm đáng kể, cho thấy mô hình quá đơn giản hoặc không đủ sức mạnh để học được các mẫu trong dữ liệu.

Công cụ nào là tốt nhất cho việc trực quan hóa quá trình huấn luyện và Debugging AI?

Có nhiều công cụ mạnh mẽ cho việc trực quan hóa và debugging AI, tùy thuộc vào framework bạn sử dụng. Đối với TensorFlow và Keras, TensorBoard là lựa chọn hàng đầu, cung cấp khả năng trực quan hóa loss, metrics, đồ thị mô hình, phân phối trọng số và gradient. Đối với PyTorch, các công cụ như Weights & Biases (W&B) và Comet ML rất phổ biến, hỗ trợ đa framework và cung cấp các tính năng nâng cao như theo dõi siêu tham số, quản lý thí nghiệm và phân tích mô hình. Ngoài ra, các thư viện như Matplotlib và Seaborn trong Python cũng rất hữu ích cho việc trực quan hóa dữ liệu và kết quả dự đoán.

Làm thế nào để Debug lỗi liên quan đến dữ liệu bị thiên vị (biased data) trong AI?

Debugging lỗi liên quan đến dữ liệu thiên vị đòi hỏi một cách tiếp cận đa chiều. Đầu tiên, bạn cần phân tích thống kê và trực quan hóa dữ liệu để xác định các phân phối không đồng đều hoặc các nhóm thiểu số bị bỏ qua. Sử dụng các kỹ thuật như phân tích thành phần chính (PCA) hoặc t-SNE để trực quan hóa dữ liệu trong không gian giảm chiều và phát hiện các cụm thiên vị. Sau đó, bạn có thể áp dụng các chiến lược như thu thập thêm dữ liệu từ các nhóm thiểu số, kỹ thuật cân bằng lớp (ví dụ: oversampling, undersampling), trọng số lớp (class weighting) trong hàm mất mát, hoặc sử dụng các thuật toán fairness-aware AI. Việc kiểm tra và phân tích lỗi dự đoán trên các nhóm dữ liệu khác nhau cũng sẽ giúp bạn hiểu rõ hơn về tác động của sự thiên vị.

Kết Luận

Debugging AI là một nghệ thuật và khoa học đòi hỏi sự kiên nhẫn, tư duy logic và khả năng phân tích sâu sắc. Việc nắm vững các kỹ thuật từ kiểm tra dữ liệu, phân tích mã nguồn, giám sát quá trình huấn luyện đến phân tích lỗi dự đoán sẽ giúp bạn không chỉ khắc phục vấn đề mà còn hiểu sâu hơn về cách các mô hình AI hoạt động. Bằng cách áp dụng các tips và best practices như bắt đầu với mô hình đơn giản, sử dụng các công cụ trực quan hóa mạnh mẽ và ghi log chi tiết, bạn có thể biến quá trình debugging từ một trải nghiệm đầy thử thách thành một cơ hội học hỏi và cải thiện.

Trong hành trình phát triển AI, việc "bắt bệnh" và "chữa lành" cho các mô hình là một phần không thể thiếu. Chúc bạn luôn giữ vững tinh thần chuyên nghiệp và tận hưởng hành trình khám phá thế giới của vibe coding và AI development. Hãy nhớ rằng, mỗi lỗi được tìm thấy là một bước tiến gần hơn đến một hệ thống AI hoàn hảo hơn.