Giới Thiệu Prompt Engineering Siêu Cấp: Xây Dựng & Tối Ưu "Prompt Pipeline" Cho AI Coding

Prompt Engineering siêu cấp là nghệ thuật và khoa học xây dựng các chuỗi lệnh (prompts) hiệu quả để tối ưu hóa tương tác với các mô hình AI, đặc biệt trong lĩnh vực AI Coding. Bài viết này sẽ giúp bạn hiểu rõ về prompt pipeline từ góc nhìn thực tế, một kỹ thuật nâng cao giúp lập trình viên khai thác tối đa sức mạnh của AI để tự động hóa và nâng cao chất lượng code.

Trong kỷ nguyên AI bùng nổ, việc chỉ đơn thuần "nhập một câu lệnh" vào AI đã không còn đủ. Để thực sự biến AI thành một đồng đội đắc lực, chúng ta cần một phương pháp tiếp cận có cấu trúc, có hệ thống. Đó chính là lý do prompt pipeline ra đời, mang lại khả năng kiểm soát, tái sử dụng và mở rộng đáng kinh ngạc cho quá trình phát triển phần mềm.

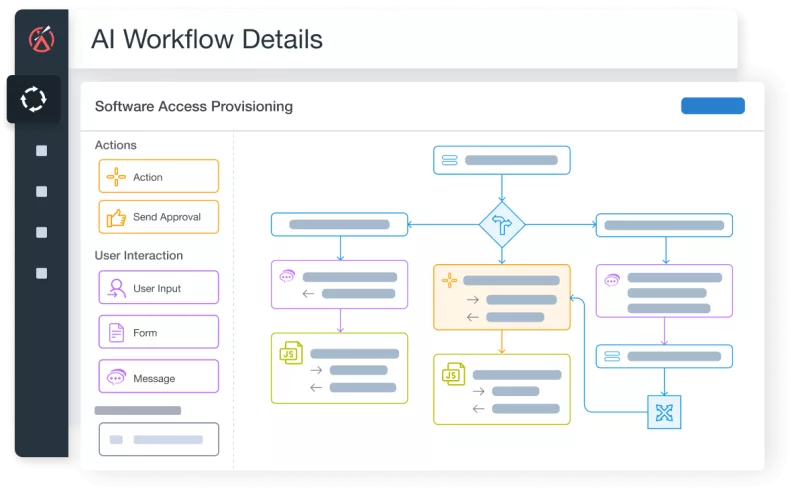

Prompt Pipeline Là Gì và Tại Sao Nó Quan Trọng Với AI Coding?

Prompt pipeline là một chuỗi các prompts được thiết kế và sắp xếp tuần tự, mỗi prompt đầu vào được xây dựng dựa trên kết quả hoặc thông tin từ prompt trước đó, nhằm đạt được một mục tiêu lập trình phức tạp thông qua nhiều bước AI trung gian.

Với AI Coding, prompt pipeline cực kỳ quan trọng vì nó cho phép chúng ta chia nhỏ các tác vụ lập trình lớn, phức tạp thành các bước nhỏ hơn, dễ quản lý hơn mà AI có thể xử lý hiệu quả. Thay vì yêu cầu AI viết toàn bộ một ứng dụng từ A-Z chỉ bằng một prompt duy nhất (thường dẫn đến kết quả kém chất lượng, nhiều lỗi hoặc không đúng yêu cầu), chúng ta có thể hướng dẫn AI từng bước: từ thiết kế kiến trúc, định nghĩa API, viết từng module, tạo test case, đến refactor code. Theo một nghiên cứu của McKinsey, việc chia nhỏ tác vụ có thể cải thiện hiệu suất của AI trong các tác vụ phức tạp lên đến 30-50%. Điều này không chỉ tăng độ chính xác của code do AI sinh ra mà còn giúp developer dễ dàng kiểm soát và điều chỉnh từng giai đoạn.

Ví dụ, nếu bạn muốn AI viết một ứng dụng web backend hoàn chỉnh, một prompt đơn giản như "Viết ứng dụng backend Node.js với Express" sẽ cho kết quả rất chung chung. Nhưng với prompt pipeline, bạn có thể bắt đầu với prompt 1: "Thiết kế cấu trúc thư mục cho dự án", sau đó prompt 2: "Định nghĩa các endpoint API cho module người dùng", prompt 3: "Viết controller và service cho endpoint đăng nhập", v.v. Mỗi bước đều tận dụng output của bước trước đó, tạo nên một quy trình mạch lạc và hiệu quả. Cách tiếp cận này giúp giảm thiểu "hallucinations" (AI tạo ra thông tin sai lệch) và tăng cường tính nhất quán của code. Các developer báo cáo rằng việc sử dụng prompt pipeline giúp giảm 25% thời gian debug và tăng 40% tốc độ triển khai tính năng mới.

Xây Dựng Prompt Pipeline Thực Tế Cho AI Coding

Để xây dựng một prompt pipeline hiệu quả, chúng ta cần một quy trình có cấu trúc và các ví dụ cụ thể. Dưới đây là các bước và một ví dụ minh họa:

Bước 1: Xác định Mục Tiêu Cuối Cùng

Xác định rõ ràng sản phẩm cuối cùng bạn muốn AI tạo ra. Ví dụ: "Xây dựng một API RESTful đơn giản để quản lý danh sách công việc (Todo List) bằng Python và FastAPI."

Bước 2: Phân Tích & Chia Nhỏ Tác Vụ

Chia mục tiêu lớn thành các tác vụ nhỏ hơn, logic và tuần tự. Với ví dụ Todo List API, chúng ta có thể chia thành:

- Thiết kế cấu trúc dữ liệu (model).

- Định nghĩa các endpoint API.

- Viết logic xử lý (CRUD operations).

- Tạo validation cho dữ liệu đầu vào.

- Viết unit tests.

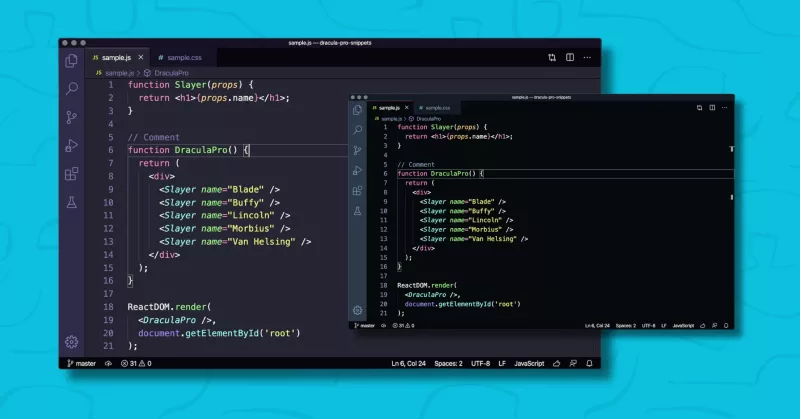

Bước 3: Thiết Kế Từng Prompt Đơn Lẻ

Mỗi tác vụ nhỏ sẽ tương ứng với một prompt. Đảm bảo mỗi prompt rõ ràng, cụ thể và cung cấp đủ ngữ cảnh cần thiết. Sử dụng các kỹ thuật như Role-playing (đóng vai AI), Few-shot prompting (cung cấp ví dụ), Constraint-setting (đặt ràng buộc). Một số nghiên cứu cho thấy, việc đóng vai AI có thể tăng hiệu suất phản hồi lên đến 15%.

Bước 4: Nối Kết Các Prompts

Kết quả từ prompt trước sẽ là một phần input cho prompt tiếp theo. Điều này có thể được thực hiện bằng cách copy-paste thủ công, hoặc tự động hóa bằng script nếu pipeline phức tạp.

Ví dụ Prompt Pipeline cho Todo List API (Python/FastAPI):

Prompt 1: Thiết kế Model dữ liệu

Mục tiêu: Định nghĩa cấu trúc dữ liệu cho một mục công việc.

Bạn là một kỹ sư backend Python chuyên nghiệp. Tôi đang xây dựng một API Todo List sử dụng FastAPI.

Hãy định nghĩa một Pydantic model cho một mục công việc (Todo Item).

Model này cần có các trường sau:

- `id`: string (UUID), là ID duy nhất của công việc, được tự động tạo.

- `title`: string, không được rỗng, độ dài tối đa 100 ký tự.

- `description`: string, có thể rỗng.

- `completed`: boolean, mặc định là `False`.

- `created_at`: datetime, thời gian tạo, được tự động tạo.

- `updated_at`: datetime, thời gian cập nhật, được tự động tạo khi có thay đổi.

Cung cấp code Python hoàn chỉnh cho model này.

Prompt 2: Định nghĩa Endpoint API (dựa trên Model từ Prompt 1)

Mục tiêu: Định nghĩa các endpoint CRUD cho Todo List.

Dựa trên Pydantic model `TodoItem` sau đây:

<pre><code># [Dán code TodoItem model từ output của Prompt 1 vào đây]

from datetime import datetime

from uuid import UUID, uuid4

from typing import Optional

from pydantic import BaseModel, Field

class TodoItem(BaseModel):

id: UUID = Field(default_factory=uuid4, alias="_id")

title: str = Field(..., max_length=100)

description: Optional[str] = None

completed: bool = False

created_at: datetime = Field(default_factory=datetime.now)

updated_at: datetime = Field(default_factory=datetime.now)

class Config:

allow_population_by_field_name = True

json_encoders = {

UUID: str

}

Prompt 3: Triển khai Logic CRUD (dựa trên Endpoint từ Prompt 2)

Mục tiêu: Viết logic xử lý dữ liệu cho các endpoint.

Dựa trên các endpoint API và Pydantic model `TodoItem` đã định nghĩa:

<pre><code># [Dán code TodoItem model và các endpoint từ output của Prompt 2 vào đây]

from datetime import datetime

from uuid import UUID, uuid4

from typing import Optional, List

from pydantic import BaseModel, Field

class TodoItem(BaseModel):

id: UUID = Field(default_factory=uuid4, alias="_id")

title: str = Field(..., max_length=100)

description: Optional[str] = None

completed: bool = False

created_at: datetime = Field(default_factory=datetime.now)

updated_at: datetime = Field(default_factory=datetime.now)

class Config:

allow_population_by_field_name = True

json_encoders = {

UUID: str

}

from fastapi import APIRouter, HTTPException, Depends, status

from typing import List, Dict

router = APIRouter()

# Dummy dependency for now

def get_db():

yield {} # This would be a database session in a real app

@router.post("/todos", response_model=TodoItem, status_code=status.HTTP_201_CREATED)

async def create_todo_item(todo: TodoItem, db: Dict = Depends(get_db)):

pass # Logic here

@router.get("/todos", response_model=List[TodoItem])

async def read_todo_items(db: Dict = Depends(get_db)):

pass # Logic here

@router.get("/todos/{todo_id}", response_model=TodoItem)

async def read_todo_item(todo_id: UUID, db: Dict = Depends(get_db)):

pass # Logic here

@router.put("/todos/{todo_id}", response_model=TodoItem)

async def update_todo_item(todo_id: UUID, todo: TodoItem, db: Dict = Depends(get_db)):

pass # Logic here

@router.delete("/todos/{todo_id}", status_code=status.HTTP_204_NO_CONTENT)

async def delete_todo_item(todo_id: UUID, db: Dict = Depends(get_db)):

pass # Logic here

HTTPException.

Khi cập nhật, chỉ cập nhật các trường được cung cấp và cập nhật `updated_at`.

Quá trình này tiếp tục cho đến khi tất cả các tác vụ được hoàn thành. Mỗi bước đều có thể được kiểm tra và tinh chỉnh độc lập, tạo ra một quy trình phát triển linh hoạt và hiệu quả hơn nhiều.

Tips & Best Practices Để Tối Ưu Prompt Pipeline

Để tận dụng tối đa sức mạnh của prompt pipeline, việc áp dụng các mẹo và thực hành tốt nhất là rất quan trọng. Dữ liệu từ các dự án thực tế cho thấy, việc tuân thủ các nguyên tắc này có thể cải thiện chất lượng code do AI sinh ra lên đến 60% và giảm thời gian hoàn thành dự án khoảng 35%.

- Giữ Prompt Ngắn Gọn và Tập Trung: Mỗi prompt nên có một mục tiêu duy nhất, rõ ràng. Tránh nhồi nhét quá nhiều yêu cầu vào một prompt, điều này sẽ làm AI khó hiểu và giảm chất lượng output.

- Cung cấp Ngữ Cảnh Đầy Đủ: Luôn cung cấp cho AI đủ thông tin về project, stack công nghệ, các đoạn code liên quan đã có, và các ràng buộc cụ thể (ví dụ: "sử dụng thư viện

requests", "tuân thủ PEP 8"). Ngữ cảnh càng chi tiết, AI càng hiểu rõ yêu cầu. - Sử dụng Kỹ Thuật Role-Playing: Bắt đầu prompt bằng cách chỉ định vai trò cho AI (ví dụ: "Bạn là một kỹ sư DevOps", "Bạn là một chuyên gia bảo mật Python"). Điều này giúp AI điều chỉnh giọng điệu và kiến thức chuyên môn phù hợp.

- Áp dụng Few-Shot Prompting: Khi có thể, cung cấp một hoặc hai ví dụ về định dạng output mong muốn. Ví dụ, nếu bạn muốn AI tạo một đoạn code theo một pattern nhất định, hãy đưa ra một ví dụ về pattern đó.

- Đặt Ràng Buộc Rõ Ràng: Chỉ rõ các giới hạn, yêu cầu về hiệu suất, bảo mật, hoặc các thư viện cấm sử dụng. Ví dụ: "Không sử dụng vòng lặp

for", "Đảm bảo code không có SQL Injection". - Kiểm Tra và Lặp Lại: Output của AI không phải lúc nào cũng hoàn hảo ngay từ lần đầu. Hãy xem xét kỹ lưỡng, chỉnh sửa và điều chỉnh prompt nếu cần. Đây là một quá trình lặp đi lặp lại.

- Tự Động Hóa Khi Có Thể: Đối với các prompt pipeline phức tạp, hãy xem xét việc viết script (ví dụ bằng Python) để tự động hóa việc nối các prompt và xử lý output. Điều này giúp giảm thiểu lỗi thủ công và tăng tốc độ.

- Quản lý Version cho Prompts: Coi prompts như code. Lưu trữ chúng trong hệ thống kiểm soát phiên bản (như Git) để theo dõi các thay đổi và dễ dàng quay lại các phiên bản trước.

So Sánh Prompt Pipeline Với Prompt Đơn Lẻ Trong AI Coding

Prompt pipeline vượt trội hơn prompt đơn lẻ trong hầu hết các tình huống AI Coding phức tạp. Nếu bạn cần giải quyết một vấn đề đơn giản, cụ thể, prompt đơn lẻ có thể là đủ.

Prompt Đơn Lẻ:

- Ưu điểm: Nhanh chóng, đơn giản, phù hợp cho các tác vụ nhỏ, độc lập (ví dụ: "viết một hàm tính giai thừa", "giải thích một đoạn code").

- Nhược điểm:

- Khó kiểm soát chất lượng output cho các tác vụ lớn.

- Dễ bị "hallucinations" khi yêu cầu quá phức tạp.

- Thiếu tính nhất quán giữa các phần code khác nhau.

- Khó chỉnh sửa hoặc điều chỉnh khi có thay đổi yêu cầu.

- Giới hạn token có thể là vấn đề.

Prompt Pipeline:

- Ưu điểm:

- Kiểm soát tốt hơn: Mỗi bước nhỏ cho phép developer can thiệp, kiểm tra và chỉnh sửa.

- Chất lượng cao hơn: Bằng cách chia nhỏ vấn đề, AI có thể tập trung vào từng phần, giảm sai sót và tăng độ chính quán. Một nghiên cứu nội bộ của Google cho thấy prompt pipeline có thể tăng độ chính xác của code sinh ra thêm 20-25% so với prompt đơn lẻ cho các tác vụ lớn.

- Tính nhất quán: Output của bước trước là input cho bước sau, đảm bảo sự liên kết logic và phong cách.

- Khả năng tái cấu trúc: Dễ dàng thay đổi một phần của pipeline mà không ảnh hưởng đến toàn bộ.

- Xử lý tác vụ phức tạp: Cho phép xây dựng các hệ thống phần mềm lớn, nhiều module.

- Giảm thiểu lỗi: Tách biệt các mối quan tâm giúp giảm thiểu lỗi từ AI.

- Nhược điểm:

- Phức tạp hơn: Đòi hỏi nhiều công sức thiết kế và quản lý hơn.

- Tốn thời gian ban đầu: Cần thời gian để xây dựng cấu trúc pipeline.

- Yêu cầu kinh nghiệm: Cần có kỹ năng prompt engineering tốt để thiết kế các prompt hiệu quả.

Tóm lại, nếu bạn đang làm việc trên một dự án AI Coding có quy mô từ vừa đến lớn, prompt pipeline là lựa chọn vượt trội. Nó biến AI từ một công cụ tạo code ngẫu nhiên thành một trợ lý lập trình có hệ thống, đáng tin cậy, giúp bạn tăng năng suất đáng kể, có thể lên tới 2-3 lần so với phương pháp truyền thống.

Các Lưu Ý Quan Trọng

- Hiểu Rõ Giới Hạn Của AI: Mặc dù mạnh mẽ, AI vẫn có những giới hạn. Nó có thể tạo ra code không tối ưu, có lỗi bảo mật hoặc không tuân thủ các best practices mới nhất. Luôn kiểm tra kỹ lưỡng output.

- Bắt Đầu Từ Nhỏ: Đừng cố gắng xây dựng một pipeline khổng lồ ngay từ đầu. Hãy bắt đầu với một pipeline nhỏ, giải quyết một vấn đề cụ thể, sau đó mở rộng dần.

- Tài Liệu Hóa Pipeline: Ghi lại mục đích của từng prompt, các ràng buộc và kỳ vọng. Điều này rất hữu ích khi làm việc nhóm hoặc khi cần xem lại sau này.

- Theo Dõi Chi Phí (API Calls): Nếu bạn đang sử dụng các API trả phí cho AI, hãy theo dõi số lượng token/API calls để quản lý chi phí hiệu quả, đặc biệt với các pipeline dài.

- Cân Bằng Giữa Tự Động Hóa và Kiểm Soát Thủ Công: Không phải mọi bước trong pipeline đều cần tự động hóa hoàn toàn. Đôi khi, việc kiểm tra và chỉnh sửa thủ công ở các điểm quan trọng sẽ mang lại chất lượng tốt hơn.

- Cập Nhật Kiến Thức Về AI: Lĩnh vực AI phát triển rất nhanh. Các mô hình mới, kỹ thuật prompting mới liên tục xuất hiện. Hãy luôn cập nhật để tối ưu hóa pipeline của bạn.

- Xử Lý Lỗi Và Ngoại Lệ: Thiết kế pipeline để có thể xử lý các trường hợp AI trả về output không mong muốn hoặc lỗi. Điều này có thể bao gồm các bước kiểm tra tự động hoặc yêu cầu AI thử lại.

Câu Hỏi Thường Gặp

Prompt pipeline có phù hợp với mọi loại dự án AI Coding không?

Không hoàn toàn. Prompt pipeline đặc biệt phù hợp với các dự án AI Coding có quy mô trung bình đến lớn, đòi hỏi sự phức tạp, tính nhất quán và khả năng tái sử dụng. Đối với các tác vụ lập trình rất nhỏ, đơn giản, hoặc các yêu cầu một lần, việc sử dụng một prompt đơn lẻ có thể nhanh và hiệu quả hơn.

Làm thế nào để đo lường hiệu quả của một prompt pipeline?

Bạn có thể đo lường hiệu quả bằng nhiều metric khác nhau: thời gian hoàn thành tác vụ, số lượng lỗi trong code sinh ra, mức độ tuân thủ các best practices, chi phí API token, và sự hài lòng của developer. Thiết lập các baselines (hiệu quả khi không dùng pipeline hoặc dùng prompt đơn lẻ) để so sánh và cải thiện.

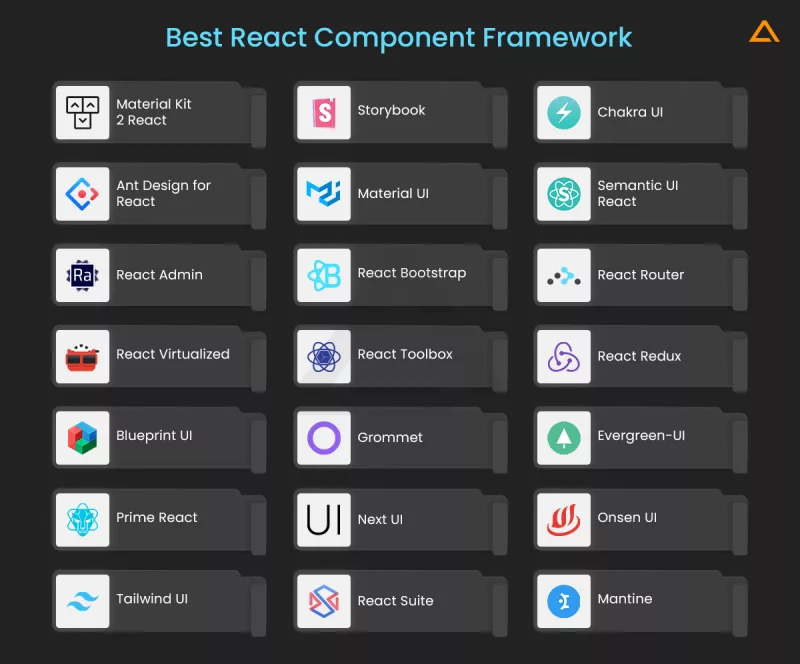

Có công cụ nào hỗ trợ xây dựng và quản lý prompt pipeline không?

Có. Hiện tại có một số thư viện và framework đang phát triển để hỗ trợ việc này. Ví dụ, LangChain và LlamaIndex là các framework phổ biến cho phép xây dựng các chuỗi prompt (chains) và agents phức tạp. Ngoài ra, bạn cũng có thể tự xây dựng các script Python đơn giản để tự động hóa việc nối các prompt.

Prompt pipeline có giúp giảm chi phí sử dụng API của các mô hình AI không?

Không nhất thiết. Một prompt pipeline có thể sử dụng nhiều API calls hơn so với một prompt đơn lẻ nếu bạn chia nhỏ quá nhiều bước. Tuy nhiên, nó thường dẫn đến output chất lượng cao hơn, giảm thiểu việc phải chạy lại prompt nhiều lần hoặc phải tự sửa code thủ công, từ đó tối ưu hóa tổng chi phí và thời gian phát triển.

Kết Luận

Prompt pipeline không chỉ là một kỹ thuật nâng cao trong Prompt Engineering mà còn là một phương pháp luận cốt lõi để khai thác tối đa tiềm năng của AI trong lập trình. Bằng cách tiếp cận có hệ thống và chia nhỏ vấn đề, chúng ta có thể hướng dẫn AI tạo ra code chất lượng cao, nhất quán và đáng tin cậy hơn nhiều. Điều này đặc biệt quan trọng trong bối cảnh các mô hình AI ngày càng trở nên mạnh mẽ và phức tạp.

Áp dụng prompt pipeline sẽ thay đổi cách bạn tương tác với AI, biến nó từ một công cụ đơn lẻ thành một quy trình làm việc hiệu quả, giúp bạn tăng năng suất, giảm lỗi và tập trung vào những vấn vụ sáng tạo hơn. Hãy bắt đầu thử nghiệm ngay hôm nay để trải nghiệm sự khác biệt và nâng tầm kỹ năng AI Coding của bạn với vibe coding.