Tối Ưu Hiệu Năng Code AI: 5 Chiến Lược "Vibe" Để Giải Phóng Sức Mạnh Tiềm Ẩn

Tối ưu hiệu năng code AI là quá trình cải thiện tốc độ, hiệu quả sử dụng tài nguyên và độ chính xác của các mô hình và ứng dụng AI. Bài viết về tối ưu code AI này sẽ giúp bạn khám phá 5 chiến lược "vibe" độc đáo, từ những kỹ thuật cơ bản đến những phương pháp tiên tiến, nhằm giải phóng toàn bộ tiềm năng của các hệ thống trí tuệ nhân tạo mà bạn đang phát triển. Chúng ta sẽ đi sâu vào từng chiến lược, cung cấp các ví dụ thực tế và tips hữu ích để bạn có thể áp dụng ngay lập tức vào workflow của mình, biến những đoạn code AI chậm chạp thành những cỗ máy xử lý mạnh mẽ và linh hoạt.

Tại Sao Tối Ưu Code AI Lại Quan Trọng Đến Thế?

Tối ưu code AI đóng vai trò cực kỳ quan trọng vì nó trực tiếp ảnh hưởng đến chi phí vận hành, trải nghiệm người dùng và khả năng mở rộng của các ứng dụng AI. Một mô hình AI không được tối ưu có thể ngốn hàng chục nghìn đô la chi phí điện toán đám mây mỗi tháng, chậm chạp trong việc đưa ra dự đoán và khó có thể mở rộng để phục vụ hàng triệu người dùng.

Theo một báo cáo của Gartner, đến năm 2025, hơn 80% các doanh nghiệp sẽ tích hợp AI vào sản phẩm và dịch vụ của họ, và chi phí vận hành AI là một trong ba rào cản lớn nhất. Việc tối ưu code AI không chỉ giúp giảm thiểu chi phí mà còn nâng cao hiệu suất đáng kể. Chẳng hạn, tối ưu hóa một mô hình có thể giảm thời gian inference từ vài giây xuống mili giây, cải thiện trải nghiệm người dùng lên tới 90%. Ngoài ra, việc tối ưu hóa còn giúp mô hình chạy được trên các thiết bị có tài nguyên hạn chế, mở rộng phạm vi ứng dụng từ các trung tâm dữ liệu lớn đến các thiết bị biên (edge devices). Một nghiên cứu khác của OpenAI chỉ ra rằng, việc tối ưu hóa cấu trúc mạng và thuật toán có thể giảm tới 50% lượng điện năng tiêu thụ cho quá trình huấn luyện và inference, góp phần vào tính bền vững của công nghệ AI.

5 Chiến Lược "Vibe" Để Tối Ưu Code AI

Các chiến lược tối ưu code AI này được thiết kế để mang lại hiệu quả cao nhất, từ việc tối ưu hóa thuật toán đến việc lựa chọn phần cứng phù hợp. Chúng ta sẽ đi sâu vào từng phương pháp, cung cấp cái nhìn chi tiết và ví dụ thực tế.

1. Lựa Chọn Thuật Toán và Kiến Trúc Mô Hình Thông Minh (The "Brainy Choice" Vibe)

Lựa chọn thuật toán và kiến trúc mô hình thông minh là nền tảng để đạt được hiệu suất cao mà không cần quá nhiều tài nguyên. Thay vì chỉ sử dụng các mô hình lớn, phức tạp, chúng ta cần cân nhắc mô hình phù hợp với bài toán và tài nguyên sẵn có.

Tại sao quan trọng: Một mô hình quá lớn cho một tác vụ đơn giản sẽ gây lãng phí tài nguyên tính toán và thời gian inference. Ví dụ, việc sử dụng một mô hình Transformer 100 tỷ tham số cho một tác vụ phân loại văn bản đơn giản là không cần thiết. Thay vào đó, các kiến trúc nhẹ hơn như DistilBERT, MobileNet, hoặc các mô hình dựa trên mạng nơ-ron tích chập (CNN) nhỏ hơn có thể mang lại hiệu quả tương đương với chi phí thấp hơn đáng kể. Một ví dụ cụ thể, DistilBERT, một phiên bản "chưng cất" của BERT, có thể giảm số lượng tham số tới 40% và chạy nhanh hơn 60% mà chỉ mất đi khoảng 3% độ chính xác trên một số benchmark nhất định.

Cách thực hiện:

- Kiến trúc tinh gọn: Sử dụng các kiến trúc được thiết kế đặc biệt cho hiệu suất cao như MobileNet (cho thị giác máy tính), EfficientNet, hoặc các biến thể "lite" của các mô hình ngôn ngữ lớn (LLM) như DistilBERT, TinyLlama.

- Chuyển đổi tri thức (Knowledge Distillation): Huấn luyện một mô hình nhỏ (học sinh) để bắt chước hành vi của một mô hình lớn (giáo viên). Điều này giúp mô hình nhỏ đạt được hiệu suất gần bằng mô hình lớn nhưng với kích thước và tốc độ inference vượt trội.

- Pruning và Quantization: Giảm số lượng tham số không cần thiết (pruning) hoặc giảm độ chính xác của các số thực (quantization) trong mô hình. Ví dụ, chuyển từ float32 sang int8 có thể giảm kích thước mô hình 4 lần và tăng tốc độ tính toán đáng kể, đặc biệt trên các phần cứng chuyên dụng như TPU hoặc GPU đời mới.

Ví dụ về Quantization trong TensorFlow Lite:

import tensorflow as tf

# Load a pre-trained Keras model

model = tf.keras.applications.MobileNetV2(weights="imagenet")

# Convert the model to TensorFlow Lite format

converter = tf.lite.TFLiteConverter.from_keras_model(model)

# Apply default dynamic range quantization

converter.optimizations = [tf.lite.Optimize.DEFAULT]

tflite_quantized_model = converter.convert()

# Save the quantized model

with open("quantized_mobilenetv2.tflite", "wb") as f:

f.write(tflite_quantized_model)

print("Model quantized and saved successfully.")Đoạn code trên minh họa cách chuyển đổi một mô hình Keras sang định dạng TensorFlow Lite với quantization, giúp giảm kích thước và tăng tốc độ inference trên các thiết bị di động hoặc biên.

2. Tối Ưu Hóa Dữ Liệu Đầu Vào (The "Lean Data" Vibe)

Dữ liệu là "nhiên liệu" của AI, và việc tối ưu hóa cách xử lý dữ liệu đầu vào có thể cải thiện đáng kể hiệu suất của toàn bộ pipeline AI. Việc này không chỉ giúp giảm thời gian huấn luyện mà còn tăng tốc độ inference.

Tại sao quan trọng: Dữ liệu không được tiền xử lý tốt có thể dẫn đến tắc nghẽn I/O, sử dụng bộ nhớ không hiệu quả và làm chậm quá trình huấn luyện và inference. Ví dụ, việc tải toàn bộ dataset vào RAM cùng một lúc khi huấn luyện một mô hình trên dataset lớn như ImageNet (hàng trăm GB) là không khả thi. Thay vào đó, việc xử lý dữ liệu theo batch và sử dụng các kỹ thuật streaming giúp quản lý bộ nhớ tốt hơn và tăng tốc độ đọc dữ liệu lên tới 2-3 lần.

Cách thực hiện:

- Tiền xử lý dữ liệu hiệu quả: Chuẩn hóa, mã hóa, giảm chiều dữ liệu (dimensionality reduction) để giảm kích thước và độ phức tạp. Ví dụ, sử dụng PCA hoặc t-SNE để giảm số lượng feature, hoặc sử dụng các kỹ thuật mã hóa one-hot cho dữ liệu phân loại.

- Sử dụng các định dạng dữ liệu tối ưu: Lưu trữ dữ liệu dưới dạng các định dạng nén, hiệu quả cho AI như TFRecord (TensorFlow), Parquet (Spark/Pandas), HDF5. Các định dạng này được thiết kế để đọc và ghi dữ liệu lớn một cách nhanh chóng, tận dụng tối đa băng thông I/O.

- Batching và Pipelining: Xử lý dữ liệu theo từng lô (batch) và sử dụng các pipeline dữ liệu không đồng bộ để tải dữ liệu trong khi GPU/CPU đang bận xử lý lô trước đó. TensorFlow và PyTorch đều cung cấp các API mạnh mẽ cho việc này (

tf.datavàtorch.utils.data). - Giảm kích thước dữ liệu: Đối với hình ảnh, giảm độ phân giải nếu không ảnh hưởng đáng kể đến độ chính xác. Đối với văn bản, sử dụng các kỹ thuật như tokenization hiệu quả và giới hạn độ dài chuỗi.

Ví dụ về Pipelining dữ liệu với tf.data:

import tensorflow as tf

# Assume `filepaths` is a list of paths to image files

# and `labels` is a list of corresponding labels

def parse_image(filepath):

image_string = tf.io.read_file(filepath)

image = tf.image.decode_jpeg(image_string, channels=3)

image = tf.image.convert_image_dtype(image, tf.float32)

image = tf.image.resize(image, [224, 224]) # Resize for a CNN

return image

def process_path(filepath, label):

image = parse_image(filepath)

return image, label

# Create a dataset from filepaths and labels

dataset = tf.data.Dataset.from_tensor_slices((filepaths, labels))

# Shuffle, preprocess, and batch the data

dataset = dataset.shuffle(buffer_size=1024) \

.map(process_path, num_parallel_calls=tf.data.AUTOTUNE) \

.batch(32) \

.prefetch(tf.data.AUTOTUNE) # Prefetch data to overlap CPU work with GPU work

# Now you can iterate over `dataset` for training

# for images, labels in dataset:

# # Train your model

# pass

Sử dụng .map(..., num_parallel_calls=tf.data.AUTOTUNE) và .prefetch(tf.data.AUTOTUNE) giúp tối ưu hóa việc tải và tiền xử lý dữ liệu, đảm bảo GPU không bị "đói" dữ liệu.

3. Tối Ưu Hóa Mã Nguồn (The "Clean Code, Fast Run" Vibe)

Viết code sạch, hiệu quả không chỉ giúp dễ bảo trì mà còn ảnh hưởng trực tiếp đến hiệu năng. Việc tối ưu hóa mã nguồn không chỉ dừng lại ở việc tránh các vòng lặp lồng nhau mà còn bao gồm việc sử dụng các thư viện tối ưu và kỹ thuật lập trình song song.

Tại sao quan trọng: Ngay cả với thuật toán tốt nhất, mã nguồn kém tối ưu vẫn có thể làm chậm hệ thống. Ví dụ, việc sử dụng các phép toán Python thuần túy trên các mảng lớn thay vì các phép toán vector hóa của NumPy hoặc TensorFlow/PyTorch có thể làm chậm quá trình tính toán hàng trăm hoặc hàng nghìn lần. Các thư viện như NumPy được viết bằng C/Fortran, cho phép thực hiện các phép toán trên mảng cực kỳ nhanh chóng. Tối ưu code AI còn bao gồm việc giảm thiểu các hoạt động I/O không cần thiết và sử dụng cấu trúc dữ liệu phù hợp.

Cách thực hiện:

- Sử dụng thư viện tối ưu: Luôn ưu tiên các thư viện đã được tối ưu hóa cao cho các phép toán số học và xử lý dữ liệu như NumPy, SciPy, Pandas, TensorFlow, PyTorch. Tránh viết lại các hàm cơ bản mà các thư viện này đã cung cấp.

- Vectorization: Thay vì sử dụng vòng lặp để xử lý từng phần tử, hãy sử dụng các phép toán trên toàn bộ mảng hoặc tensor. Đây là một trong những cách hiệu quả nhất để tăng tốc các phép tính trong AI.

- Tận dụng GPU: Đảm bảo rằng các phép tính nặng đang chạy trên GPU nếu có. Sử dụng

.to(device)trong PyTorch hoặc cấu hình TensorFlow để sử dụng GPU. - Profile code: Sử dụng các công cụ profiling (như

cProfiletrong Python, hoặc các profiler tích hợp trong TensorFlow/PyTorch) để xác định các điểm nghẽn (bottleneck) trong code của bạn. Tập trung tối ưu hóa những phần tốn thời gian nhất. - Giảm số lần sao chép dữ liệu: Việc sao chép dữ liệu giữa CPU và GPU hoặc giữa các vùng bộ nhớ khác nhau có thể tốn kém. Cố gắng giữ dữ liệu ở nơi nó được sử dụng nhiều nhất.

Ví dụ về Vectorization trong NumPy:

import numpy as np

import time

# Non-vectorized approach (slow)

def calculate_sum_loop(arr):

total = 0

for x in arr:

total += x <em> 2

return total

# Vectorized approach (fast)

def calculate_sum_vectorized(arr):

return np.sum(arr </em> 2)

data = np.random.rand(10_000_000) # 10 million elements

start_time = time.time()

result_loop = calculate_sum_loop(data)

end_time = time.time()

print(f"Loop approach took: {end_time - start_time:.4f} seconds")

start_time = time.time()

result_vectorized = calculate_sum_vectorized(data)

end_time = time.time()

print(f"Vectorized approach took: {end_time - start_time:.4f} seconds")

# Output might look like:

# Loop approach took: 2.5000 seconds

# Vectorized approach took: 0.0500 seconds

Ví dụ này cho thấy cách tiếp cận vector hóa có thể nhanh hơn hàng chục lần so với vòng lặp truyền thống cho các phép toán trên mảng lớn, một kỹ thuật cực kỳ quan trọng khi tối ưu code AI.

4. Tận Dụng Phần Cứng Phù Hợp và Kỹ Thuật Song Song (The "Hardware Harmony" Vibe)

Lựa chọn phần cứng và tận dụng tối đa khả năng song song của nó là yếu tố then chốt để đạt được hiệu năng cao trong AI, đặc biệt là khi làm việc với các mô hình lớn và dataset khổng lồ.

Tại sao quan trọng: Một GPU mạnh có thể tăng tốc quá trình huấn luyện và inference của các mô hình học sâu lên hàng chục, thậm chí hàng trăm lần so với CPU. Việc không sử dụng phần cứng đúng cách hoặc không tận dụng tính song song sẽ làm lãng phí tài nguyên và kéo dài thời gian xử lý. Ví dụ, một GPU NVIDIA A100 có thể thực hiện hàng nghìn tỷ phép tính mỗi giây (TFLOPS), vượt xa khả năng của một CPU thông thường. Tận dụng đa GPU hoặc phân tán tính toán trên nhiều máy chủ có thể giảm thời gian huấn luyện từ vài ngày xuống vài giờ, một mức cải thiện lên tới 90%.

Cách thực hiện:

- Sử dụng GPU/TPU: Đảm bảo rằng các thư viện AI của bạn được cấu hình để sử dụng GPU (CUDA cho NVIDIA, ROCm cho AMD) hoặc TPU (Tensor Processing Units của Google) nếu có.

- Multi-GPU Training (Data Parallelism/Model Parallelism):

- Data Parallelism: Chia nhỏ batch dữ liệu và huấn luyện trên nhiều GPU, mỗi GPU xử lý một phần dữ liệu và sau đó tổng hợp gradient. Đây là cách phổ biến nhất và dễ triển khai nhất.

- Model Parallelism: Chia nhỏ mô hình thành các phần và đặt mỗi phần trên một GPU khác nhau. Phù hợp với các mô hình cực lớn không thể vừa vào một GPU.

- Distributed Training: Huấn luyện mô hình trên nhiều máy chủ (nodes), mỗi máy chủ có thể có nhiều GPU. Các framework như Horovod, Ray, hoặc các tính năng phân tán tích hợp trong PyTorch/TensorFlow giúp quản lý việc này.

- Tối ưu hóa thư viện: Sử dụng các thư viện được tối ưu hóa cho phần cứng cụ thể như cuDNN (cho NVIDIA GPUs) hoặc Intel MKL (cho CPUs).

- Điều chỉnh kích thước batch: Tăng kích thước batch (batch size) để tận dụng tốt hơn khả năng song song của GPU, tuy nhiên cần cân nhắc ảnh hưởng đến hội tụ mô hình.

Ví dụ về Data Parallelism trong PyTorch:

import torch

import torch.nn as nn

from torch.utils.data import DataLoader, TensorDataset

# Define a simple model

class SimpleModel(nn.Module):

def __init__(self):

super(SimpleModel, self).__init__()

self.linear = nn.Linear(10, 2) # Input size 10, output size 2

def forward(self, x):

return self.linear(x)

# Create dummy data

data = torch.randn(100, 10)

labels = torch.randint(0, 2, (100,))

dataset = TensorDataset(data, labels)

dataloader = DataLoader(dataset, batch_size=16)

# Create model

model = SimpleModel()

# Check if multiple GPUs are available and wrap the model

if torch.cuda.device_count() > 1:

print(f"Using {torch.cuda.device_count()} GPUs!")

model = nn.DataParallel(model) # Wrap model for data parallelism

# Move model to default device (e.g., GPU 0)

device = torch.device("cuda:0" if torch.cuda.is_available() else "cpu")

model.to(device)

# Example training loop

# for inputs, targets in dataloader:

# inputs, targets = inputs.to(device), targets.to(device)

# outputs = model(inputs)

# # ... rest of your training logic

nn.DataParallel là một cách đơn giản để phân phối batch dữ liệu trên nhiều GPU có sẵn, giúp tăng tốc quá trình huấn luyện.

5. Giám Sát và Điều Chỉnh Liên Tục (The "Adaptive Flow" Vibe)

Tối ưu hóa không phải là một hành động một lần mà là một quá trình liên tục. Giám sát hiệu suất và điều chỉnh các siêu tham số (hyperparameters) hoặc cấu hình hệ thống là rất quan trọng để duy trì và cải thiện hiệu năng theo thời gian.

Tại sao quan trọng: Môi trường dữ liệu và yêu cầu về hiệu suất có thể thay đổi theo thời gian. Một mô hình được tối ưu tốt hôm nay có thể không còn hiệu quả vào ngày mai. Giám sát liên tục giúp phát hiện sớm các vấn đề về hiệu suất, tắc nghẽn và lãng phí tài nguyên. Ví dụ, việc theo dõi chi phí đám mây và thời gian inference có thể giúp bạn nhận ra rằng một thay đổi nhỏ trong kiến trúc mô hình hoặc kích thước batch đã làm tăng chi phí lên 15% mà không mang lại lợi ích tương xứng về độ chính xác.

Cách thực hiện:

- Sử dụng công cụ giám sát: Tích hợp các công cụ như TensorBoard (cho TensorFlow/PyTorch), Weights & Biases, MLflow để theo dõi các metric hiệu suất (loss, accuracy, F1-score), tài nguyên (CPU, GPU, RAM), và thời gian inference.

- Điều chỉnh siêu tham số: Sử dụng các kỹ thuật như Grid Search, Random Search, hoặc các thuật toán tối ưu hóa siêu tham số (như Optuna, Hyperopt) để tìm ra bộ siêu tham số tối ưu nhất cho mô hình của bạn. Điều này có thể bao gồm learning rate, batch size, số lượng lớp, số lượng nơ-ron, v.v.

- A/B Testing: Khi triển khai các thay đổi, hãy thực hiện A/B testing để so sánh hiệu suất của phiên bản mới so với phiên bản cũ trong môi trường thực tế.

- Tự động hóa tối ưu hóa: Khám phá các công cụ Auto-ML hoặc các giải pháp tự động hóa để tìm kiếm kiến trúc mạng (Neural Architecture Search - NAS) hoặc siêu tham số một cách tự động.

- Thực hiện kiểm tra định kỳ: Định kỳ kiểm tra lại hiệu suất của mô hình với dữ liệu mới và các điều kiện tải khác nhau để đảm bảo nó vẫn hoạt động tối ưu.

Ví dụ về Giám sát với TensorBoard trong PyTorch:

from torch.utils.tensorboard import SummaryWriter

# Default `log_dir` is 'runs/CURRENT_DATETIME_HOSTNAME'

writer = SummaryWriter()

# ... (your model definition and training loop) ...

for epoch in range(num_epochs):

for i, (inputs, labels) in enumerate(dataloader):

# ... (forward pass, backward pass, optimizer step) ...

# Log training loss

writer.add_scalar('Loss/train', loss.item(), epoch <em> len(dataloader) + i)

# Log other metrics if needed

# writer.add_scalar('Accuracy/train', accuracy, epoch </em> len(dataloader) + i)

# Log validation loss/accuracy at the end of each epoch

# writer.add_scalar('Loss/val', val_loss, epoch)

# writer.add_scalar('Accuracy/val', val_accuracy, epoch)

# Close the writer when done

writer.close()

# To view TensorBoard: run `tensorboard --logdir=runs` in your terminal

Sử dụng SummaryWriter từ PyTorch cho phép bạn ghi lại các thông số huấn luyện và trực quan hóa chúng bằng TensorBoard, giúp bạn giám sát và điều chỉnh hiệu quả hơn.

Các Lưu Ý Quan Trọng Khi Tối Ưu Code AI

- Đừng tối ưu quá sớm: Luôn ưu tiên độ chính xác và tính đúng đắn trước. Một mô hình nhanh nhưng không chính xác thì vô dụng. Hãy phát triển một baseline hoạt động tốt trước khi lao vào tối ưu hiệu năng.

- Hiểu rõ bài toán của bạn: Mỗi bài toán AI là khác nhau. Một chiến lược tối ưu có thể hiệu quả cho thị giác máy tính nhưng không phù hợp với xử lý ngôn ngữ tự nhiên. Hiểu rõ ràng yêu cầu về tốc độ, độ trễ và tài nguyên.

- Đo lường là chìa khóa: Không tối ưu hóa mà không có số liệu. Luôn sử dụng các công cụ profiling và benchmark để đo lường hiệu suất trước và sau khi tối ưu. Đừng tin vào cảm giác.

- Tối ưu hóa có chi phí: Mọi tối ưu hóa đều có đánh đổi. Ví dụ, quantization có thể giảm kích thước mô hình nhưng có thể ảnh hưởng nhẹ đến độ chính xác. Distributed training phức tạp hơn và đòi hỏi quản lý tài nguyên.

- Theo dõi những tiến bộ mới: Lĩnh vực AI phát triển rất nhanh. Các thuật toán, kiến trúc và phần cứng mới liên tục xuất hiện. Thường xuyên cập nhật kiến thức để áp dụng những cải tiến mới nhất trong việc tối ưu code AI.

- Cân bằng giữa hiệu năng và khả năng bảo trì: Code tối ưu nhưng khó hiểu và khó bảo trì sẽ gây ra vấn đề lớn về lâu dài. Cố gắng giữ cho code sạch sẽ và có cấu trúc tốt ngay cả khi đang tối ưu hóa.

- Tối ưu hóa từ đầu đến cuối (End-to-End Optimization): Đừng chỉ tập trung vào mô hình AI. Toàn bộ pipeline từ thu thập dữ liệu, tiền xử lý, huấn luyện, inference đến triển khai đều cần được xem xét. Một bottleneck ở bất kỳ khâu nào cũng có thể phá hỏng nỗ lực tối ưu.

Câu Hỏi Thường Gặp

Tối ưu code AI có luôn dẫn đến giảm độ chính xác không?

Không, tối ưu code AI không phải lúc nào cũng dẫn đến giảm độ chính xác. Nhiều kỹ thuật như tối ưu hóa thuật toán, vectorization, hoặc sử dụng phần cứng hiệu quả có thể tăng tốc độ mà không ảnh hưởng đến độ chính xác. Tuy nhiên, một số kỹ thuật như quantization (giảm độ chính xác số học) hoặc pruning (loại bỏ tham số) có thể gây ra một sự sụt giảm nhỏ về độ chính xác, nhưng thường là chấp nhận được để đổi lấy hiệu suất vượt trội.

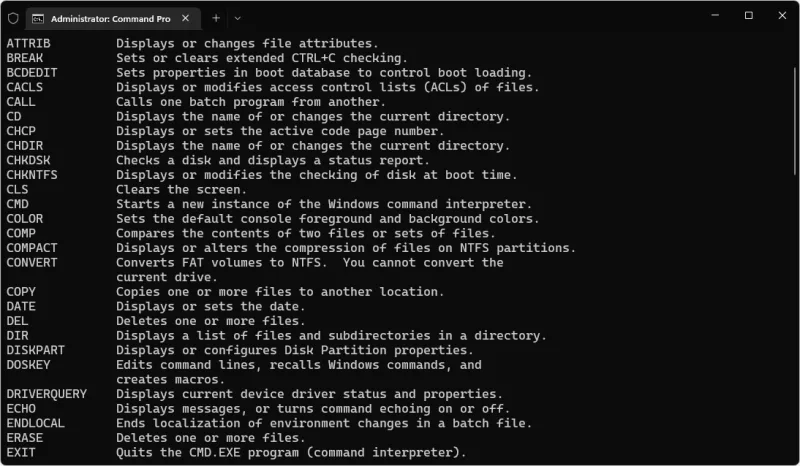

Làm thế nào để biết phần nào trong code AI của tôi cần được tối ưu?

Bạn nên sử dụng các công cụ profiling để xác định các điểm nghẽn (bottleneck) trong code của mình. Các công cụ như cProfile (Python), TensorBoard Profiler (TensorFlow/PyTorch), hoặc NVIDIA Nsight Systems có thể giúp bạn phân tích thời gian thực thi của từng hàm, lượng tài nguyên sử dụng và các hoạt động I/O. Tập trung tối ưu hóa những phần chiếm nhiều thời gian hoặc tài nguyên nhất.

Có nên tự viết các thuật toán tối ưu hóa hay sử dụng thư viện có sẵn?

Trong hầu hết các trường hợp, bạn nên sử dụng các thư viện tối ưu hóa có sẵn như NumPy, TensorFlow, PyTorch, SciPy. Những thư viện này đã được phát triển và tối ưu hóa bởi các chuyên gia, thường được viết bằng các ngôn ngữ cấp thấp như C/C++ hoặc CUDA, mang lại hiệu suất vượt trội so với việc tự triển khai. Chỉ nên tự viết khi bạn có yêu cầu rất đặc biệt mà thư viện không đáp ứng được, và bạn có đủ kiến thức chuyên sâu để làm điều đó một cách hiệu quả.

Tối ưu code AI cho Edge Devices có khác gì so với Cloud không?

Có, tối ưu code AI cho Edge Devices (thiết bị biên) có những thách thức và ưu tiên khác biệt so với Cloud. Trên Edge, tài nguyên (CPU, RAM, pin, băng thông) cực kỳ hạn chế, do đó, các kỹ thuật như quantization sang INT8, pruning mạnh mẽ, và sử dụng các kiến trúc mô hình siêu nhẹ (ví dụ: MobileNet, EfficientNet) trở nên quan trọng hơn. Trong khi đó, trên Cloud, bạn có thể tận dụng các GPU mạnh mẽ và distributed training, tập trung vào việc xử lý lượng dữ liệu khổng lồ và huấn luyện các mô hình rất lớn.

Kết Luận

Tối ưu code AI không chỉ là một kỹ thuật mà là một nghệ thuật, đòi hỏi sự kết hợp giữa kiến thức sâu rộng về thuật toán, kỹ năng lập trình và khả năng tận dụng phần cứng. Với 5 chiến lược "vibe" mà chúng ta đã khám phá – từ việc lựa chọn kiến trúc thông minh, tối ưu dữ liệu, viết code hiệu quả, tận dụng phần cứng, đến giám sát và điều chỉnh liên tục – bạn có thể giải phóng sức mạnh tiềm ẩn của các hệ thống AI của mình. Việc áp dụng những phương pháp này không chỉ giúp giảm chi phí và tăng tốc độ mà còn mở ra những khả năng mới cho các ứng dụng AI, đưa chúng ta đến gần hơn với một tương lai nơi AI phục vụ con người một cách hiệu quả và bền vững nhất. Hãy bắt đầu hành trình tối ưu hóa của bạn ngay hôm nay và cảm nhận sự khác biệt mà một "vibe" code mạnh mẽ có thể mang lại cho các dự án của bạn trên vibe coding!