Giới Thiệu Trợ Lý AI Đa Mô Hình: Hướng Dẫn Tích Hợp Vercel AI SDK

Chào mừng các bạn đến với một chủ đề đầy hấp dẫn và tiềm năng trong thế giới phát triển AI hiện đại: xây dựng trợ lý AI đa mô hình. Khi công nghệ AI phát triển với tốc độ chóng mặt, khả năng tích hợp nhiều mô hình AI khác nhau để tạo ra các ứng dụng thông minh, linh hoạt và mạnh mẽ trở nên ngày càng quan trọng. Bài viết này sẽ giúp bạn hiểu rõ về Vercel AI SDK từ góc nhìn thực tế, khám phá cách nó đơn giản hóa quy trình phát triển và cho phép chúng ta tạo ra các trải nghiệm người dùng vượt trội. Chúng ta sẽ cùng nhau đi sâu vào cách tận dụng Vercel AI SDK để xây dựng một trợ lý AI có khả năng tương tác với nhiều loại hình dữ liệu và mô hình AI khác nhau, từ đó mở ra cánh cửa cho những ứng dụng sáng tạo không giới hạn.

Vercel AI SDK: Nền Tảng Cho AI Đa Mô Hình

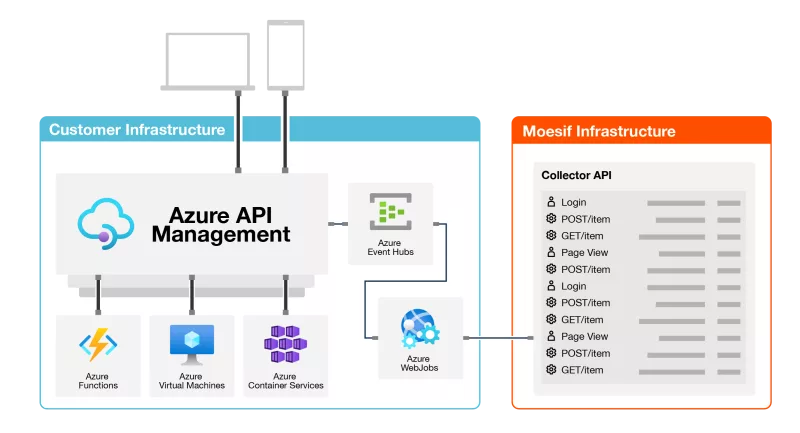

Vercel AI SDK là một bộ công cụ phát triển mạnh mẽ và linh hoạt, được thiết kế để đơn giản hóa việc xây dựng các ứng dụng AI dựa trên các mô hình ngôn ngữ lớn (LLMs) và các mô hình AI khác. SDK này cung cấp một API thống nhất, cho phép các nhà phát triển dễ dàng tích hợp các mô hình từ nhiều nhà cung cấp khác nhau như OpenAI, Anthropic, Google Gemini, và cả các mô hình tự host. Điều đặc biệt là Vercel AI SDK được tối ưu hóa cho các ứng dụng Next.js và Edge Functions, mang lại hiệu suất cao và khả năng mở rộng tuyệt vời. Nó không chỉ hỗ trợ việc tạo các luồng chat thông thường mà còn mở rộng ra các tính năng nâng cao như function calling, tool use, và stream data, vốn là những yếu tố then chốt để xây dựng các trợ lý AI đa mô hình thực sự thông minh.

Một trong những ưu điểm nổi bật của Vercel AI SDK là khả năng xử lý stream data một cách hiệu quả. Thay vì chờ đợi toàn bộ phản hồi từ mô hình AI, SDK cho phép ứng dụng nhận và hiển thị từng phần của phản hồi ngay lập tức, cải thiện đáng kể trải nghiệm người dùng. Điều này đặc biệt quan trọng đối với các ứng dụng trò chuyện hoặc tạo nội dung, nơi người dùng mong muốn nhận được phản hồi nhanh chóng. SDK cũng cung cấp các hook React tiện lợi như useChat và useCompletion, giúp việc quản lý state và tương tác với API AI trở nên dễ dàng hơn bao giờ hết, giảm thiểu lượng boilerplate code cần thiết.

Hơn nữa, Vercel AI SDK được xây dựng với tư duy "provider-agnostic", nghĩa là nó không bị ràng buộc bởi một nhà cung cấp mô hình cụ thể nào. Điều này mang lại sự linh hoạt tối đa cho nhà phát triển, cho phép họ dễ dàng chuyển đổi hoặc kết hợp các mô hình từ các nhà cung cấp khác nhau tùy theo nhu cầu của dự án. Ví dụ, bạn có thể sử dụng OpenAI cho các tác vụ tạo văn bản sáng tạo, trong khi sử dụng Anthropic cho các tác vụ yêu cầu độ an toàn và đáng tin cậy cao hơn. Khả năng này là nền tảng cho việc xây dựng các trợ lý AI đa mô hình, nơi mỗi mô hình có thể được tối ưu hóa cho một nhiệm vụ cụ thể.

Tóm lại, Vercel AI SDK không chỉ là một thư viện đơn thuần; nó là một hệ sinh thái toàn diện giúp các nhà phát triển nhanh chóng hiện thực hóa ý tưởng AI của mình. Với sự hỗ trợ mạnh mẽ cho các ứng dụng web hiện đại, khả năng tương thích với nhiều nhà cung cấp AI, và các tính năng tối ưu hóa hiệu suất, SDK này thực sự là một công cụ không thể thiếu cho bất kỳ ai muốn xây dựng các ứng dụng AI tiên tiến.

Hướng Dẫn Tích Hợp Vercel AI SDK Để Xây Dựng Trợ Lý AI Đa Mô Hình

Để bắt đầu xây dựng trợ lý AI đa mô hình với Vercel AI SDK, chúng ta sẽ đi qua các bước cơ bản từ cài đặt đến cấu hình và sử dụng. Giả sử bạn đã có một dự án Next.js cơ bản. Nếu chưa, bạn có thể tạo một dự án mới bằng lệnh npx create-next-app@latest.

Bước 1: Cài đặt Vercel AI SDK

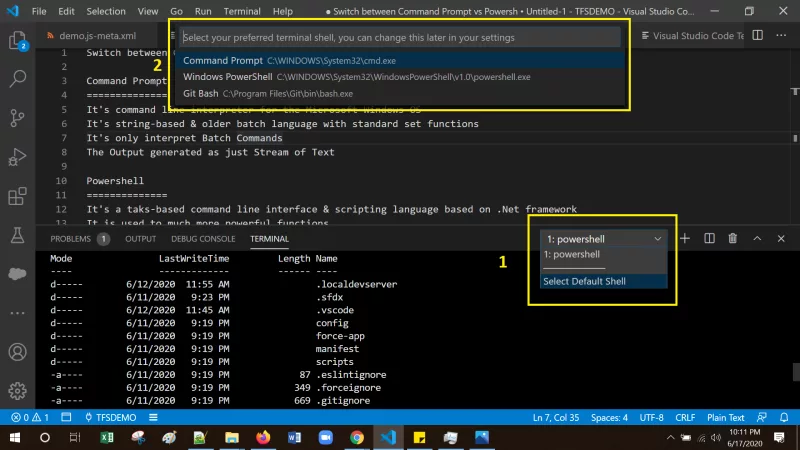

Đầu tiên, chúng ta cần cài đặt thư viện Vercel AI SDK vào dự án của mình. Mở terminal trong thư mục gốc của dự án và chạy lệnh sau:

npm install ai

# hoặc

yarn add ai

# hoặc

pnpm add aiBước 2: Cấu hình API Key

Để Vercel AI SDK có thể giao tiếp với các mô hình AI, bạn cần cung cấp API keys từ các nhà cung cấp dịch vụ AI mà bạn muốn sử dụng (ví dụ: OpenAI, Anthropic, Google). Chúng ta nên lưu trữ các khóa này trong file .env.local để đảm bảo an toàn và không bị commit vào hệ thống kiểm soát phiên bản.

OPENAI_API_KEY=sk-your-openai-key

ANTHROPIC_API_KEY=sk-your-anthropic-key

GOOGLE_GENERATIVE_LANGUAGE_API_KEY=your-google-gemini-keyĐảm bảo rằng các biến môi trường này được truy cập từ server-side (ví dụ: trong API routes của Next.js) chứ không phải client-side để tránh rò rỉ thông tin.

Bước 3: Tạo API Route cho Chat

Trong Next.js, chúng ta sẽ tạo một API route để xử lý các yêu cầu chat. Đây là nơi chúng ta sẽ khởi tạo các mô hình AI và định tuyến các yêu cầu đến mô hình phù hợp. Tạo một file app/api/chat/route.ts (đối với App Router) hoặc pages/api/chat.ts (đối với Pages Router).

Ví dụ với OpenAI:

// app/api/chat/route.ts

import { OpenAIStream, StreamingTextResponse } from 'ai';

import OpenAI from 'openai';

// Create an OpenAI API client (and send options via the API key param)

const openai = new OpenAI({

apiKey: process.env.OPENAI_API_KEY || '',

});

export const runtime = 'edge'; // Optional, but recommended for Vercel Edge Functions

export async function POST(req: Request) {

// Extract the `prompt` from the request body

const { messages } = await req.json();

// Request the OpenAI API for the response based on the prompt

const response = await openai.chat.completions.create({

model: 'gpt-4o-mini',

stream: true,

messages: messages,

});

// Convert the response into a friendly text-stream

const stream = OpenAIStream(response);

// Respond with the stream

return new StreamingTextResponse(stream);

}Để hỗ trợ đa mô hình, chúng ta có thể thêm logic để chọn mô hình dựa trên input hoặc cấu hình. Ví dụ, bạn có thể gửi một tham số modelProvider trong request body để chỉ định mô hình nào sẽ được sử dụng.

// app/api/chat/route.ts (ví dụ đa mô hình)

import { OpenAIStream, StreamingTextResponse } from 'ai';

import OpenAI from 'openai';

import { AnthropicStream } from 'ai'; // Import Anthropic if needed

import Anthropic from '@anthropic-ai/sdk'; // Import Anthropic SDK

const openai = new OpenAI({ apiKey: process.env.OPENAI_API_KEY || '' });

const anthropic = new Anthropic({ apiKey: process.env.ANTHROPIC_API_KEY || '' });

export const runtime = 'edge';

export async function POST(req: Request) {

const { messages, modelProvider } = await req.json();

let stream;

if (modelProvider === 'openai') {

const response = await openai.chat.completions.create({

model: 'gpt-4o-mini',

stream: true,

messages: messages,

});

stream = OpenAIStream(response);

} else if (modelProvider === 'anthropic') {

const response = await anthropic.messages.create({

model: 'claude-3-haiku-20240307',

stream: true,

messages: messages,

max_tokens: 1024,

});

stream = AnthropicStream(response);

} else {

// Default to OpenAI or handle error

const response = await openai.chat.completions.create({

model: 'gpt-4o-mini',

stream: true,

messages: messages,

});

stream = OpenAIStream(response);

}

return new StreamingTextResponse(stream);

}Bước 4: Xây dựng giao diện người dùng (Client-side)

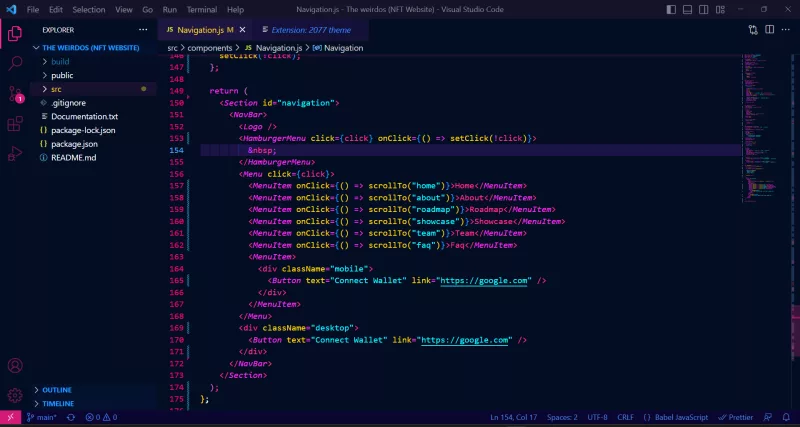

Sử dụng hook useChat từ Vercel AI SDK để dễ dàng tích hợp chức năng chat vào component React của bạn. Tạo một component như ChatComponent.tsx:

// app/page.tsx hoặc components/ChatComponent.tsx

'use client';

import { useChat } from 'ai/react';

import { useState } from 'react';

export default function Chat() {

const [modelProvider, setModelProvider] = useState('openai'); // State để chọn mô hình

const { messages, input, handleInputChange, handleSubmit, isLoading } = useChat({

api: '/api/chat', // API route của chúng ta

body: { modelProvider }, // Truyền modelProvider vào body

});

const handleProviderChange = (e: React.ChangeEvent<HTMLSelectElement>) => {

setModelProvider(e.target.value);

};

return (

<div className="flex flex-col w-full max-w-md py-24 mx-auto stretch">

<h1 className="text-2xl font-bold mb-4">AI Assistant</h1>

<select

value={modelProvider}

onChange={handleProviderChange}

className="p-2 border rounded mb-4"

>

<option value="openai">OpenAI (GPT-4o-mini)</option>

<option value="anthropic">Anthropic (Claude 3 Haiku)</option>

</select>

{messages.map(m => (

<div key={m.id} className="whitespace-pre-wrap">

<strong>{m.role === 'user' ? 'User: ' : 'AI: '}</strong>

{m.content}

</div>

))}

<form onSubmit={handleSubmit} className="fixed bottom-0 w-full max-w-md p-2 flex">

<input

className="flex-grow p-2 border border-gray-300 rounded shadow-xl"

value={input}

placeholder="Say something..."

onChange={handleInputChange}

disabled={isLoading}

/>

<button

type="submit"

className="ml-2 p-2 bg-blue-500 text-white rounded shadow-xl"

disabled={isLoading}

>

Send

</button>

</form>

</div>

);

}Với các bước trên, bạn đã có một trợ lý AI cơ bản có khả năng chọn mô hình AI để tương tác. Đây là nền tảng để mở rộng thành các trợ lý AI đa mô hình phức tạp hơn, có thể tích hợp nhiều chức năng và mô hình khác nhau.

Tips và Best Practices Khi Sử Dụng Vercel AI SDK

Để tối ưu hóa trải nghiệm phát triển và hiệu suất ứng dụng khi sử dụng Vercel AI SDK, có một số tips và best practices bạn nên ghi nhớ:

- Quản lý API Keys an toàn: Luôn sử dụng biến môi trường (

.env.local) và đảm bảo rằng API keys chỉ được truy cập từ server-side (API routes hoặc server components). Tránh để lộ API keys ra client-side bằng mọi giá. - Xử lý lỗi và phản hồi: Xây dựng cơ chế xử lý lỗi mạnh mẽ cho các yêu cầu API đến các mô hình AI. Hiển thị thông báo lỗi thân thiện cho người dùng và có thể cung cấp tùy chọn thử lại. Vercel AI SDK cung cấp các trạng thái loading và error thông qua

useChathook, hãy tận dụng chúng. - Tối ưu hóa chi phí: Các mô hình AI thường có chi phí dựa trên số lượng token được sử dụng. Hãy cân nhắc chọn các mô hình phù hợp với tác vụ (ví dụ:

gpt-4o-minicho các tác vụ đơn giản,gpt-4ocho các tác vụ phức tạp), và tối ưu hóa prompt để tránh lãng phí token. Sử dụng các kỹ thuật như "few-shot learning" hoặc "retrieval-augmented generation (RAG)" để giảm tải cho LLM chính. - Sử dụng Streaming hiệu quả: Vercel AI SDK được thiết kế để hoạt động tốt với streaming. Hãy đảm bảo rằng bạn đang tận dụng tính năng này để cung cấp phản hồi tức thì cho người dùng, đặc biệt trong các ứng dụng chat. Điều này cải thiện đáng kể trải nghiệm người dùng.

- Thiết kế Prompt Engineering: Chất lượng của phản hồi từ AI phụ thuộc rất nhiều vào prompt bạn cung cấp. Dành thời gian để thiết kế các prompt rõ ràng, súc tích và có cấu trúc. Đối với các trợ lý đa mô hình, bạn có thể cần các prompt khác nhau cho từng mô hình hoặc từng tác vụ cụ thể.

- Tích hợp Function Calling/Tool Use: Đối với các trợ lý AI phức tạp, khả năng gọi các hàm hoặc sử dụng các công cụ bên ngoài là rất quan trọng. Vercel AI SDK hỗ trợ mạnh mẽ cho function calling. Hãy tìm hiểu cách sử dụng nó để trợ lý AI của bạn có thể tương tác với cơ sở dữ liệu, API bên ngoài, hoặc thực hiện các hành động cụ thể.

- Test và Iterate: Phát triển AI là một quá trình lặp đi lặp lại. Thường xuyên thử nghiệm trợ lý AI của bạn với nhiều loại input khác nhau, thu thập phản hồi từ người dùng và liên tục cải thiện các prompt, logic định tuyến mô hình và xử lý lỗi.

So Sánh Vercel AI SDK Với Các Giải Pháp Khác

Trong bối cảnh phát triển AI hiện nay, Vercel AI SDK không phải là lựa chọn duy nhất. Tuy nhiên, nó có những ưu điểm đặc trưng khiến nó trở thành một công cụ mạnh mẽ, đặc biệt cho các nhà phát triển web. Hãy cùng so sánh nó với một số giải pháp phổ biến khác:

1. So với việc Tích hợp API Trực tiếp từ các nhà cung cấp (OpenAI API, Anthropic API, Google Gemini API):

- Vercel AI SDK: Cung cấp một API thống nhất, trừu tượng hóa sự khác biệt giữa các nhà cung cấp. Điều này giúp bạn dễ dàng chuyển đổi hoặc kết hợp các mô hình mà không cần viết lại nhiều code. Nó cũng tối ưu hóa cho streaming và tích hợp chặt chẽ với React/Next.js thông qua các hook tiện lợi.

- API Trực tiếp: Yêu cầu bạn phải tự quản lý từng API của nhà cung cấp, xử lý các định dạng request/response khác nhau, và tự implement streaming. Điều này mang lại sự kiểm soát tối đa nhưng cũng tăng độ phức tạp và thời gian phát triển, đặc biệt khi làm việc với nhiều mô hình.

2. So với LangChain/LlamaIndex:

- Vercel AI SDK: Tập trung vào việc cung cấp một lớp trừu tượng nhẹ và hiệu quả cho việc tương tác với LLMs, đặc biệt trong môi trường web (Next.js, Edge Functions). Nó rất tốt cho việc xây dựng giao diện người dùng tương tác và xử lý luồng dữ liệu.

- LangChain/LlamaIndex: Là các framework toàn diện hơn, được thiết kế để xây dựng các ứng dụng LLM phức tạp, bao gồm cả việc quản lý chuỗi (chains), agents, retrieval-augmented generation (RAG) và tích hợp với nhiều nguồn dữ liệu. Chúng thường yêu cầu một đường cong học tập cao hơn và có thể quá mức cần thiết nếu bạn chỉ cần một giao diện chat đơn giản. Tuy nhiên, bạn hoàn toàn có thể kết hợp Vercel AI SDK với LangChain/LlamaIndex ở backend (API routes) để tận dụng sức mạnh của cả hai.

3. So với các Framework Frontend AI khác (ví dụ: Boilerplates/Templates):

- Vercel AI SDK: Là một thư viện cốt lõi cung cấp các hook và helper để tương tác với AI. Nó mang lại sự linh hoạt cao để bạn xây dựng giao diện và logic riêng.

- Boilerplates/Templates: Thường là các ứng dụng hoàn chỉnh, có sẵn với một số tính năng AI nhất định. Chúng tốt cho việc khởi động nhanh nhưng có thể giới hạn khả năng tùy chỉnh nếu bạn có yêu cầu đặc biệt. Vercel AI SDK thường là thành phần cốt lõi của nhiều boilerplates AI chất lượng cao.

Nhìn chung, Vercel AI SDK nổi bật với sự đơn giản, hiệu quả và khả năng tích hợp sâu với hệ sinh thái Vercel/Next.js. Nó là lựa chọn lý tưởng cho các nhà phát triển muốn xây dựng các ứng dụng AI tương tác, có hiệu suất cao và dễ dàng mở rộng trên nền tảng web hiện đại. Khả năng hỗ trợ đa nhà cung cấp là một điểm cộng lớn, cho phép bạn xây dựng các trợ lý AI đa mô hình linh hoạt mà không bị khóa vào một công nghệ cụ thể.

Các Lưu Ý Quan Trọng

- Đảm bảo tính nhất quán của API: Khi tích hợp nhiều mô hình, hãy cố gắng chuẩn hóa định dạng dữ liệu đầu vào và đầu ra càng nhiều càng tốt. Điều này giúp giảm thiểu logic chuyển đổi và làm cho mã của bạn dễ bảo trì hơn.

- Quản lý phiên (Session Management): Đối với các ứng dụng chat, việc duy trì lịch sử cuộc trò chuyện (message history) là rất quan trọng để AI có thể hiểu ngữ cảnh. Vercel AI SDK hỗ trợ điều này thông qua hook

useChat, nhưng bạn cần cân nhắc cách lưu trữ lịch sử này nếu cần duy trì nó giữa các phiên của người dùng. - Xử lý Rate Limiting: Các nhà cung cấp AI thường áp đặt giới hạn về số lượng yêu cầu API (rate limits). Hãy chuẩn bị cơ chế xử lý khi gặp lỗi rate limiting (ví dụ: exponential backoff) để ứng dụng của bạn không bị gián đoạn.

- Sử dụng Edge Functions: Vercel AI SDK được tối ưu hóa cho Edge Functions. Việc triển khai các API route trên Edge Functions của Vercel có thể cải thiện đáng kể hiệu suất và độ trễ do API được chạy gần người dùng cuối hơn.

- Bảo mật dữ liệu người dùng: Khi xây dựng trợ lý AI, đặc biệt là với các mô hình đa phương thức, hãy luôn ưu tiên bảo mật và quyền riêng tư của dữ liệu người dùng. Đảm bảo rằng dữ liệu nhạy cảm không được gửi đến các mô hình AI hoặc được lưu trữ một cách không an toàn.

- Cập nhật phiên bản SDK: Vercel AI SDK và các thư viện AI liên quan thường xuyên được cập nhật để thêm tính năng mới và cải thiện hiệu suất. Hãy đảm bảo bạn luôn sử dụng phiên bản mới nhất để tận dụng các cải tiến này.

- Tối ưu hóa trải nghiệm người dùng: Ngoài chức năng cốt lõi, hãy tập trung vào việc tạo ra một giao diện người dùng trực quan và phản hồi nhanh. Các yếu tố như loading states, thông báo lỗi rõ ràng, và khả năng copy/paste phản hồi đều góp phần tạo nên trải nghiệm tốt.

Câu Hỏi Thường Gặp

Vercel AI SDK có hỗ trợ mô hình AI tự host không?

Có, Vercel AI SDK được thiết kế linh hoạt để hỗ trợ cả các mô hình AI tự host (self-hosted models). Bạn có thể tích hợp API của mô hình tự host của mình vào Vercel AI SDK bằng cách tạo một adapter hoặc sử dụng các hàm helper chung được cung cấp, miễn là API của bạn tuân thủ định dạng streaming tương tự như các nhà cung cấp lớn.

Làm thế nào để tích hợp function calling với Vercel AI SDK?

Vercel AI SDK cung cấp hỗ trợ mạnh mẽ cho function calling. Bạn có thể định nghĩa các công cụ (tools) hoặc hàm mà AI có thể gọi trong API route của mình và sau đó cấu hình AI để sử dụng các công cụ đó. Khi AI quyết định gọi một hàm, SDK sẽ cung cấp cho bạn thông tin cần thiết để thực thi hàm đó và gửi lại kết quả cho AI.

Có thể sử dụng Vercel AI SDK với các framework frontend khác ngoài Next.js không?

Mặc dù Vercel AI SDK được tối ưu hóa và tích hợp sâu với Next.js, đặc biệt là với App Router và Edge Functions, bạn vẫn có thể sử dụng các phần client-side của SDK (ví dụ: useChat hook) trong các framework React khác như Vite hoặc Create React App. Tuy nhiên, bạn sẽ cần tự quản lý phần API backend của mình.

Vercel AI SDK có miễn phí không?

Vercel AI SDK là một thư viện mã nguồn mở và hoàn toàn miễn phí để sử dụng. Tuy nhiên, các dịch vụ AI mà bạn tích hợp (như OpenAI, Anthropic, Google Gemini) thường có chi phí liên quan đến việc sử dụng API của họ, tùy thuộc vào số lượng token hoặc yêu cầu bạn gửi.

Kết Luận

Xây dựng trợ lý AI đa mô hình không còn là một nhiệm vụ phức tạp và tốn kém nhờ vào các công cụ mạnh mẽ như Vercel AI SDK. Qua bài viết này, chúng ta đã cùng nhau khám phá cách SDK này đơn giản hóa quá trình tích hợp nhiều mô hình AI từ các nhà cung cấp khác nhau, từ đó mở ra cánh cửa cho việc tạo ra các ứng dụng thông minh, linh hoạt và có khả năng thích ứng cao. Từ việc cài đặt, cấu hình cho đến các tips tối ưu và so sánh với các giải pháp khác, hy vọng bạn đã có cái nhìn toàn diện và sẵn sàng bắt tay vào xây dựng trợ lý AI của riêng mình.

Sức mạnh của Vercel AI SDK nằm ở khả năng kết nối bạn với thế giới AI rộng lớn một cách hiệu quả, cho phép bạn tập trung vào việc sáng tạo và mang lại giá trị cho người dùng. Đừng ngần ngại thử nghiệm, kết hợp các mô hình và khám phá những khả năng không giới hạn mà AI mang lại. Hãy tiếp tục theo dõi vibe coding để cập nhật những kiến thức và xu hướng công nghệ mới nhất, cùng nhau tạo ra những sản phẩm AI đột phá!