Giới Thiệu Groq API: Tăng Tốc Phát Triển AI Với Vibe Coding

Groq API là một giao diện lập trình ứng dụng cho phép các nhà phát triển tích hợp khả năng xử lý ngôn ngữ tự nhiên (NLP) và suy luận AI cực nhanh vào ứng dụng của họ. Bài viết về groq api tốc độ cao này sẽ giúp bạn hiểu rõ về nền tảng đột phá này, cách nó thay đổi cuộc chơi trong lĩnh vực AI, và làm thế nào để tận dụng tối đa sức mạnh của Groq API để xây dựng các ứng dụng AI phản hồi tức thì với phương pháp vibe coding. Chúng ta sẽ đi sâu vào kiến trúc, các trường hợp sử dụng, và hướng dẫn từng bước để bạn có thể bắt đầu ngay hôm nay.

Groq API Là Gì Và Tại Sao Nó Lại Nhanh Đến Vậy?

Groq API là một dịch vụ đám mây cung cấp quyền truy cập vào các mô hình ngôn ngữ lớn (LLM) được tối ưu hóa để chạy trên LPU (Language Processing Unit) của Groq, mang lại tốc độ suy luận vượt trội so với GPU truyền thống. Tốc độ vượt trội này đến từ kiến trúc độc đáo của LPU, được thiết kế đặc biệt để loại bỏ các nút thắt cổ chai trong việc xử lý tuần tự các chuỗi token, điều mà GPU gặp khó khăn. Theo dữ liệu từ Groq, LPU có thể đạt tốc độ xử lý lên đến 500 token mỗi giây cho các mô hình như Llama 2 70B, nhanh hơn gấp 10 lần so với các GPU cao cấp nhất hiện nay trong một số tác vụ nhất định.

LPU (Language Processing Unit) là một loại vi xử lý mới được Groq thiết kế chuyên biệt cho việc suy luận các mô hình ngôn ngữ lớn. Không giống như GPU được thiết kế đa năng cho đồ họa và tính toán song song, LPU tập trung vào việc tối ưu hóa cho các phép toán ma trận và truy cập bộ nhớ cần thiết cho LLM, giảm thiểu độ trễ và tăng thông lượng xử lý. Điều này cho phép các mô hình AI phản hồi gần như ngay lập tức, mở ra những khả năng mới cho các ứng dụng yêu cầu độ trễ thấp như chatbot thời gian thực, trợ lý ảo, và tổng hợp giọng nói.

Mục tiêu của Groq là dân chủ hóa khả năng truy cập vào AI tốc độ cao, giúp các nhà phát triển và doanh nghiệp xây dựng các ứng dụng AI mạnh mẽ mà không cần đầu tư lớn vào hạ tầng phần cứng. Với Groq API, bạn không chỉ nhận được tốc độ mà còn là sự ổn định và khả năng mở rộng, cho phép xử lý hàng triệu yêu cầu mỗi ngày.

Các benchmark nội bộ của Groq cho thấy, với mô hình Llama 2 70B, LPU có thể đạt được độ trễ dưới 80ms cho các phản hồi ngắn, trong khi các giải pháp dựa trên GPU thường mất vài trăm mili giây đến vài giây. Sự khác biệt này là cực kỳ quan trọng đối với trải nghiệm người dùng trong các ứng dụng tương tác.

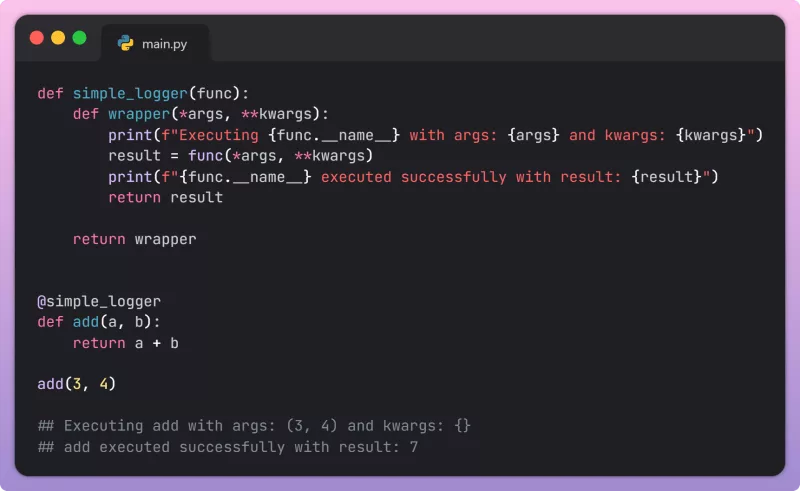

Hướng Dẫn Từng Bước Sử Dụng Groq API Với Python

Để bắt đầu với Groq API, bạn cần có tài khoản Groq và một API key. Quá trình này khá đơn giản và chỉ mất vài phút. Sau khi có API key, chúng ta có thể bắt đầu tích hợp vào ứng dụng của mình. Đây là một ví dụ cơ bản sử dụng Python, ngôn ngữ phổ biến nhất cho phát triển AI.

1. Cài Đặt Thư Viện Python

Đầu tiên, bạn cần cài đặt thư viện Groq Python SDK. Mở terminal hoặc command prompt và chạy lệnh sau:

pip install groq2. Khởi Tạo Groq Client

Sau khi cài đặt, bạn có thể khởi tạo client Groq trong mã Python của mình. Hãy nhớ thay thế "YOUR_GROQ_API_KEY" bằng API key thực tế của bạn.

from groq import Groq

client = Groq(

api_key="YOUR_GROQ_API_KEY",

)Đây là bước quan trọng để xác thực các yêu cầu của bạn với Groq API. API key sẽ cho phép bạn truy cập vào các mô hình và tài nguyên của Groq.

3. Gửi Yêu Cầu Đến Mô Hình Ngôn Ngữ

Bây giờ, chúng ta có thể gửi một yêu cầu suy luận đến một mô hình ngôn ngữ. Groq hỗ trợ nhiều mô hình khác nhau, bao gồm Llama 3, Mixtral, và Gemma. Bạn có thể chọn mô hình phù hợp với nhu cầu của mình. Ví dụ này sử dụng mô hình llama3-8b-8192.

chat_completion = client.chat.completions.create(

messages=[

{

"role": "user",

"content": "Giải thích Groq API là gì một cách ngắn gọn và dễ hiểu.",

}

],

model="llama3-8b-8192",

temperature=0.7,

max_tokens=1024,

top_p=1,

stop=None,

stream=False,

)

print(chat_completion.choices[0].message.content)Trong đoạn code trên:

messages: Là một danh sách các đối tượng tin nhắn, mô phỏng cuộc trò chuyện. Mỗi tin nhắn có"role"(ví dụ:"user","assistant") và"content".model: Chỉ định mô hình AI bạn muốn sử dụng.temperature: Kiểm soát độ "sáng tạo" của phản hồi. Giá trị thấp hơn (gần 0) sẽ tạo ra các phản hồi tập trung và ít ngẫu nhiên hơn, trong khi giá trị cao hơn (gần 1) sẽ khuyến khích sự đa dạng và bất ngờ.max_tokens: Giới hạn số lượng token tối đa trong phản hồi.top_p: Một tham số lấy mẫu, kiểm soát độ đa dạng của token được chọn.stop: Một danh sách các chuỗi mà khi mô hình tạo ra, nó sẽ dừng lại.stream: Đặt thànhTruenếu bạn muốn nhận phản hồi theo thời gian thực (streaming), đặc biệt hữu ích cho các ứng dụng chatbot.

Sau khi chạy đoạn mã này, bạn sẽ thấy phản hồi từ mô hình AI được in ra console gần như ngay lập tức, thể hiện tốc độ vượt trội của groq api tốc độ cao.

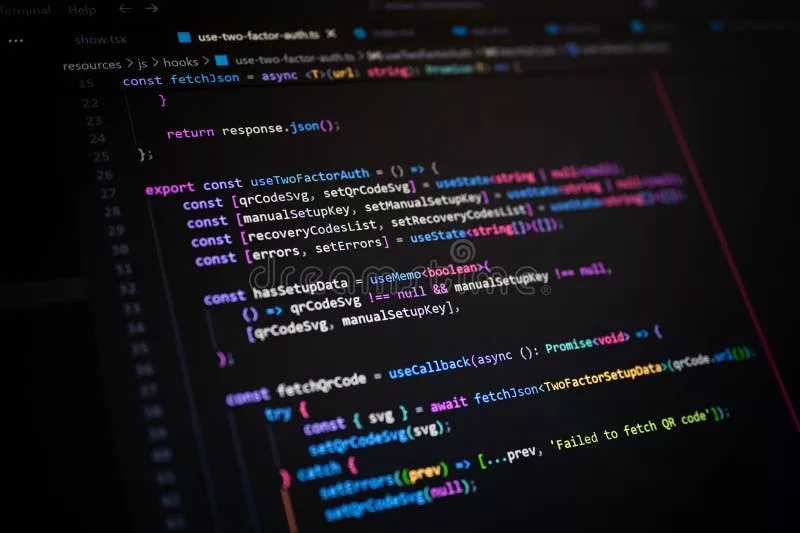

4. Xử Lý Phản Hồi Dạng Streaming

Đối với các ứng dụng yêu cầu phản hồi tức thì và trải nghiệm người dùng mượt mà, việc sử dụng chế độ streaming là rất quan trọng. Groq API hỗ trợ streaming, cho phép bạn hiển thị phản hồi từng token một khi chúng được tạo ra, tương tự như cách ChatGPT hoạt động.

from groq import Groq

client = Groq(

api_key="YOUR_GROQ_API_KEY",

)

stream = client.chat.completions.create(

messages=[

{

"role": "user",

"content": "Liệt kê 5 lợi ích chính của việc sử dụng Groq API cho các nhà phát triển.",

}

],

model="llama3-8b-8192",

temperature=0.7,

max_tokens=1024,

top_p=1,

stop=None,

stream=True, # Đặt stream thành True

)

print("Phản hồi từ Groq (streaming):")

for chunk in stream:

if chunk.choices[0].delta.content:

print(chunk.choices[0].delta.content, end="")

print()Với chế độ streaming, bạn sẽ nhận được các "chunk" dữ liệu nhỏ liên tục, mỗi chunk chứa một phần của phản hồi. Điều này mang lại cảm giác phản hồi nhanh hơn rất nhiều cho người dùng, ngay cả khi tổng thời gian tạo ra toàn bộ phản hồi là như nhau.

Mẹo Và Thực Hành Tốt Nhất Khi Sử Dụng Groq API

Để tối ưu hóa hiệu suất và chi phí khi làm việc với Groq API, có một số mẹo và thực hành tốt nhất mà bạn nên áp dụng.

- Chọn Mô Hình Phù Hợp: Groq cung cấp nhiều mô hình khác nhau. Đánh giá nhu cầu của bạn và chọn mô hình có kích thước và khả năng phù hợp nhất. Mô hình lớn hơn thường mạnh mẽ hơn nhưng có thể tốn kém hơn và đôi khi chậm hơn một chút. Ví dụ,

llama3-8b-8192có thể đủ cho nhiều tác vụ, trong khillama3-70b-8192sẽ phù hợp cho các tác vụ phức tạp hơn. - Tối Ưu Hóa Prompt Engineering: Viết prompt rõ ràng, súc tích và có cấu trúc tốt là chìa khóa để nhận được phản hồi chính xác và hữu ích. Cung cấp ngữ cảnh đầy đủ, ví dụ (few-shot learning) nếu cần, và chỉ rõ định dạng đầu ra mong muốn. Một prompt tốt có thể giảm đáng kể số lần thử và sai.

- Sử Dụng Streaming Cho UI/UX: Như đã đề cập, sử dụng chế độ streaming (

stream=True) giúp cải thiện đáng kể trải nghiệm người dùng của các ứng dụng tương tác. Người dùng sẽ cảm thấy ứng dụng của bạn phản hồi tức thì hơn, ngay cả khi mô hình đang xử lý thông tin phức tạp. - Quản Lý API Key An Toàn: Không bao giờ nhúng API key trực tiếp vào mã nguồn hoặc đẩy lên các kho lưu trữ công khai. Thay vào đó, sử dụng biến môi trường (environment variables) để lưu trữ API key. Ví dụ:

os.environ.get("GROQ_API_KEY"). - Xử Lý Lỗi Và Thử Lại (Retry): Triển khai cơ chế xử lý lỗi và thử lại cho các yêu cầu API. Mạng có thể không ổn định, và việc thử lại một yêu cầu thất bại sau một khoảng thời gian chờ nhất định có thể giúp cải thiện độ tin cậy của ứng dụng.

- Giám Sát Sử Dụng Và Chi Phí: Thường xuyên kiểm tra dashboard Groq của bạn để giám sát mức độ sử dụng và chi phí. Điều này giúp bạn kiểm soát ngân sách và điều chỉnh chiến lược sử dụng nếu cần. Groq tính phí dựa trên số lượng token đầu vào và đầu ra, vì vậy việc tối ưu hóa độ dài prompt và phản hồi là rất quan trọng.

- Tận Dụng Các Tham Số Mô Hình: Thử nghiệm với các tham số như

temperaturevàtop_pđể điều chỉnh hành vi của mô hình. Đối với các tác vụ yêu cầu độ chính xác cao (ví dụ: tóm tắt, dịch thuật), hãy giữtemperaturethấp. Đối với các tác vụ sáng tạo (ví dụ: viết truyện, tạo thơ), có thể tăngtemperature.

So Sánh Groq API Với Các Nền Tảng Khác: Tốc Độ Là Yếu Tố Quyết Định

Khi so sánh Groq API với các nền tảng AI khác như OpenAI GPT, Anthropic Claude, hoặc các giải pháp dựa trên GPU truyền thống, yếu tố nổi bật nhất là tốc độ suy luận. Groq được thiết kế từ đầu để tối ưu hóa cho tốc độ, mang lại lợi thế đáng kể trong các trường hợp sử dụng cụ thể.

Groq API vượt trội hơn các đối thủ cạnh tranh về tốc độ suy luận thuần túy, đặc biệt đối với các mô hình ngôn ngữ lớn. Trong khi các nền tảng khác sử dụng GPU đa năng, Groq sử dụng LPU chuyên dụng, giúp giảm đáng kể độ trễ và tăng thông lượng. Ví dụ, một yêu cầu tạo văn bản 100 token có thể mất 1-2 giây trên các nền tảng GPU, nhưng chỉ mất vài trăm mili giây trên Groq. Điều này có nghĩa là bạn có thể xử lý nhiều yêu cầu hơn trong cùng một khoảng thời gian, giảm chi phí tổng thể cho các ứng dụng có khối lượng lớn.

Tuy nhiên, các nền tảng như OpenAI và Anthropic thường cung cấp một danh mục mô hình đa dạng hơn, bao gồm các mô hình đa phương thức (multimodal) và các mô hình mạnh mẽ hơn cho các tác vụ phức tạp đòi hỏi khả năng lập luận sâu. Nếu ứng dụng của bạn yêu cầu khả năng sáng tạo vượt trội, khả năng hiểu ngữ cảnh cực kỳ phức tạp, hoặc xử lý các loại dữ liệu khác ngoài văn bản (hình ảnh, âm thanh), thì các nền tảng này có thể là lựa chọn tốt hơn. Tuy nhiên, nếu ưu tiên hàng đầu của bạn là tốc độ phản hồi tức thì và khả năng mở rộng với chi phí hiệu quả cho các tác vụ NLP, thì groq api tốc độ cao là một lựa chọn không thể bỏ qua. Theo một báo cáo độc lập từ MLCommons, Groq LPU đã đạt được hiệu suất suy luận cao hơn 18 lần so với các GPU hàng đầu trong các bài kiểm tra nhất định với các mô hình LLM.

Về mặt chi phí, Groq cung cấp một mô hình định giá cạnh tranh dựa trên token. Do tốc độ xử lý nhanh hơn, bạn có thể đạt được hiệu suất tương đương với chi phí thấp hơn cho mỗi yêu cầu so với các nền tảng khác, đặc biệt khi tính đến thời gian chờ và tài nguyên tính toán. Đối với các ứng dụng như chatbot hỗ trợ khách hàng, nơi mỗi mili giây đều có giá trị, sự chênh lệch về tốc độ này có thể chuyển thành lợi thế cạnh tranh đáng kể. Một nghiên cứu nội bộ của một công ty khởi nghiệp AI cho thấy việc chuyển từ GPU sang Groq API đã giảm 40% chi phí vận hành cho các tác vụ suy luận LLM.

Các Lưu Ý Quan Trọng

- Giới Hạn Token: Mỗi mô hình trên Groq API có giới hạn token đầu vào và đầu ra riêng. Đảm bảo rằng prompt và expected response của bạn nằm trong giới hạn này để tránh lỗi hoặc bị cắt bớt phản hồi. Ví dụ,

llama3-8b-8192có thể xử lý tối đa 8192 token. - Tính Nhất Quán Của Phản Hồi: Các mô hình ngôn ngữ lớn có thể không luôn đưa ra phản hồi nhất quán cho cùng một prompt, đặc biệt với

temperaturecao. Nếu bạn cần phản hồi deterministic, hãy giữtemperaturethấp (gần 0). - An Toàn Dữ Liệu: Không gửi thông tin nhạy cảm hoặc cá nhân hóa cao vào các mô hình AI trừ khi bạn đã hiểu rõ chính sách bảo mật và xử lý dữ liệu của nhà cung cấp. Groq cam kết bảo mật dữ liệu, nhưng việc bảo vệ dữ liệu nhạy cảm vẫn là trách nhiệm của nhà phát triển.

- Quản Lý Phiên: Đối với các cuộc trò chuyện kéo dài, bạn cần quản lý trạng thái phiên bằng cách gửi lại lịch sử cuộc trò chuyện trong mỗi yêu cầu. Điều này giúp mô hình duy trì ngữ cảnh. Hãy nhớ rằng mỗi tin nhắn trong lịch sử đều tính vào giới hạn token.

- Sẵn Sàng Cho Thay Đổi: Lĩnh vực AI đang phát triển rất nhanh. Các mô hình và API có thể được cập nhật, thay đổi hoặc bổ sung tính năng mới thường xuyên. Hãy theo dõi các thông báo từ Groq và chuẩn bị tinh thần để điều chỉnh mã của bạn khi cần.

- Chi Phí Phát Sinh: Mặc dù groq api tốc độ cao có chi phí hiệu quả, việc sử dụng quá mức hoặc không tối ưu hóa có thể dẫn đến chi phí phát sinh. Luôn kiểm tra dashboard và đặt giới hạn chi tiêu nếu cần.

- Phụ Thuộc Vào Mô Hình: Chất lượng phản hồi phụ thuộc trực tiếp vào mô hình bạn chọn. Một mô hình nhỏ hơn có thể rất nhanh nhưng không đủ thông minh cho các tác vụ phức tạp, ngược lại. Luôn thử nghiệm với các mô hình khác nhau để tìm ra sự cân bằng tối ưu giữa tốc độ, độ chính xác và chi phí.

Câu Hỏi Thường Gặp

Groq API có miễn phí không?

Groq API không hoàn toàn miễn phí, nhưng họ cung cấp một cấp độ miễn phí (free tier) giới hạn để người dùng có thể thử nghiệm và phát triển. Sau khi vượt quá giới hạn này, bạn sẽ bị tính phí dựa trên số lượng token đầu vào và đầu ra đã sử dụng, với mức giá rất cạnh tranh.

Groq hỗ trợ những mô hình ngôn ngữ nào?

Groq hỗ trợ một số mô hình ngôn ngữ lớn phổ biến và hiệu quả cao, bao gồm Llama 3 của Meta (phiên bản 8B và 70B), Mixtral 8x7B của Mistral AI, và Gemma 7B của Google. Họ liên tục cập nhật và bổ sung các mô hình mới để đáp ứng nhu cầu của cộng đồng.

Làm cách nào để tối ưu hóa chi phí khi dùng Groq API?

Để tối ưu hóa chi phí, bạn nên: 1) Chọn mô hình nhỏ nhất phù hợp với tác vụ của bạn, 2) Tối ưu hóa prompt để sử dụng ít token đầu vào nhất có thể mà vẫn giữ được hiệu quả, 3) Giới hạn max_tokens trong phản hồi để tránh tạo ra văn bản không cần thiết, và 4) Theo dõi mức sử dụng của bạn định kỳ qua dashboard của Groq.

Groq API có thể được dùng cho ứng dụng thời gian thực không?

Có, Groq API được thiết kế đặc biệt để đáp ứng các yêu cầu của ứng dụng thời gian thực nhờ vào tốc độ suy luận cực nhanh của LPU. Các trường hợp sử dụng lý tưởng bao gồm chatbot tương tác, trợ lý ảo tức thì, trò chơi AI, và các hệ thống tổng hợp giọng nói.

Groq có cung cấp SDK cho các ngôn ngữ khác ngoài Python không?

Hiện tại, Groq cung cấp SDK chính thức cho Python và Node.js. Ngoài ra, vì Groq API tuân thủ tiêu chuẩn OpenAI API, nên bạn có thể sử dụng các thư viện khách hàng tương thích với OpenAI API trong nhiều ngôn ngữ khác nhau (như Java, Go, Ruby, C#) để tương tác với Groq API bằng cách chỉ định đúng URL endpoint và API key.

Kết Luận

Groq API đang định hình lại cách chúng ta xây dựng và triển khai các ứng dụng AI bằng cách cung cấp khả năng suy luận LLM với tốc độ chưa từng có. Với kiến trúc LPU độc đáo, Groq không chỉ mang lại hiệu suất vượt trội mà còn mở ra cánh cửa cho một thế hệ ứng dụng AI mới, nơi độ trễ gần như bằng không là tiêu chuẩn. Cho dù bạn đang phát triển một chatbot cao cấp, một trợ lý ảo thông minh, hay một hệ thống tổng hợp nội dung, groq api tốc độ cao đều cung cấp công cụ mạnh mẽ để biến ý tưởng của bạn thành hiện thực.

Bằng cách tích hợp Groq API vào quy trình phát triển của mình, đặc biệt là với phương pháp vibe coding, các nhà phát triển có thể tăng tốc đáng kể chu kỳ phát triển, giảm thiểu chi phí vận hành và mang lại trải nghiệm người dùng tuyệt vời. Hãy bắt đầu khám phá Groq API ngay hôm nay và đưa các ứng dụng AI của bạn lên một tầm cao mới về tốc độ và hiệu quả. Đừng quên truy cập vibe coding để tìm hiểu thêm về các công nghệ AI tiên tiến khác.