Giới Thiệu AI Multi-Modal: Khai Phá Sức Mạnh Dữ Liệu Đa Phương Thức Với Vibe Coding

Trong thế giới AI đầy biến động, chúng ta đã chứng kiến những bước nhảy vọt đáng kinh ngạc từ các mô hình học sâu (deep learning) chuyên biệt. Tuy nhiên, để thực sự mô phỏng trí tuệ con người, việc xử lý thông tin từ nhiều giác quan khác nhau là điều không thể thiếu. Đây chính là lúc khái niệm AI Multi-Modal trở nên cực kỳ quan trọng, mở ra kỷ nguyên mới cho các ứng dụng thông minh. Bài viết này sẽ giúp bạn hiểu rõ về AI Multi-Modal từ góc nhìn thực tế, cách nó hoạt động và làm thế nào chúng ta có thể tích hợp nó vào các dự án của mình thông qua vibe coding.

AI Multi-Modal không chỉ đơn thuần là việc kết hợp nhiều loại dữ liệu (như hình ảnh, văn bản, âm thanh) mà còn là khả năng học hỏi mối quan hệ phức tạp giữa chúng để đưa ra những quyết định chính xác và toàn diện hơn. Nó là chìa khóa để xây dựng các hệ thống AI có khả năng "hiểu" thế giới theo cách gần giống con người nhất, từ đó giải quyết các bài toán phức tạp mà các mô hình đơn phương thức (unimodal) không thể làm được.

AI Multi-Modal là gì? Khám phá Nền tảng của Sự Thông Minh Đa Giác Quan

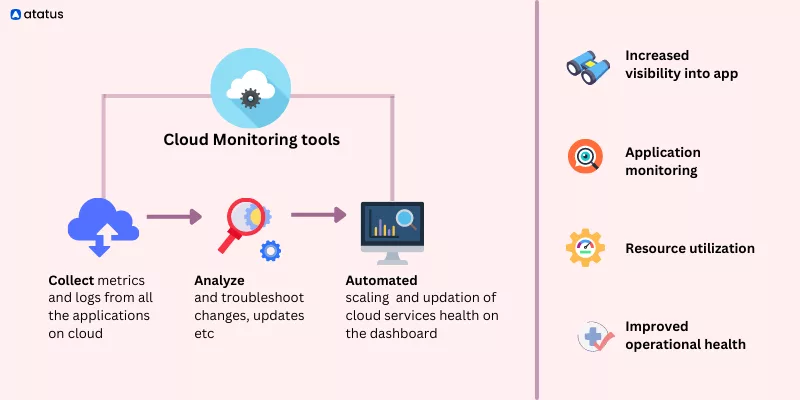

AI Multi-Modal là một lĩnh vực của trí tuệ nhân tạo tập trung vào việc phát triển các mô hình có khả năng xử lý và hiểu thông tin từ nhiều phương thức (modalities) khác nhau. Thay vì chỉ phân tích văn bản, hình ảnh, hoặc âm thanh riêng lẻ, các mô hình AI Multi-Modal tổng hợp dữ liệu từ tất cả các nguồn này để có được cái nhìn toàn diện và sâu sắc hơn về ngữ cảnh. Ví dụ, một mô hình unimodal chỉ có thể nhận diện đối tượng trong ảnh, hoặc dịch một đoạn văn bản. Nhưng một mô hình AI Multi-Modal có thể mô tả chi tiết một bức ảnh (kết hợp thị giác và ngôn ngữ), hoặc nhận diện cảm xúc từ cả giọng điệu (âm thanh) và biểu cảm khuôn mặt (thị giác).

Lý do AI Multi-Modal lại trở nên mạnh mẽ đến vậy nằm ở cách con người chúng ta tiếp nhận thông tin. Chúng ta không chỉ nhìn, nghe hay đọc một cách độc lập; mà chúng ta kết hợp tất cả các giác quan để tạo ra một bức tranh hoàn chỉnh về thế giới xung quanh. Khi nghe ai đó nói, chúng ta không chỉ phân tích từ ngữ mà còn cả ngữ điệu, biểu cảm khuôn mặt, cử chỉ cơ thể. AI Multi-Modal cố gắng tái tạo khả năng này, giúp máy móc hiểu được sự phong phú và phức tạp của dữ liệu thực tế.

Các phương thức dữ liệu phổ biến bao gồm:

- Văn bản (Text): Các câu văn, tài liệu, bài viết, đoạn chat.

- Hình ảnh (Images): Ảnh tĩnh, đồ họa, biểu đồ.

- Video: Chuỗi hình ảnh động kèm âm thanh.

- Âm thanh (Audio): Giọng nói, âm nhạc, tiếng ồn môi trường.

- Dữ liệu cảm biến (Sensor Data): Nhiệt độ, độ ẩm, dữ liệu từ cảm biến IoT.

- Dữ liệu cấu trúc (Structured Data): Bảng tính, cơ sở dữ liệu.

Trong vibe coding, việc triển khai các hệ thống AI Multi-Modal mang lại sự linh hoạt và khả năng sáng tạo không giới hạn. Chúng ta có thể xây dựng các ứng dụng thông minh hơn, từ chatbot có khả năng "nhìn" và "nghe", đến các hệ thống giám sát an ninh thông minh, hoặc thậm chí là các công cụ sáng tạo nội dung đa phương tiện tự động.

Tích Hợp AI Multi-Modal Với Vibe Coding: Hướng Dẫn Thực Hành và Ví Dụ Code

Để tích hợp AI Multi-Modal vào các dự án của mình, chúng ta cần hiểu các bước cơ bản và các công cụ hỗ trợ. Dưới đây là một ví dụ thực tế về cách chúng ta có thể xây dựng một mô hình đơn giản kết hợp văn bản và hình ảnh để phân loại cảm xúc từ các bài đăng trên mạng xã hội, sử dụng Python và các thư viện phổ biến.

Bước 1: Chuẩn Bị Dữ Liệu Đa Phương Thức

Giả sử chúng ta có một tập dữ liệu gồm các bài đăng trên Twitter, mỗi bài gồm một đoạn văn bản (tweet) và một hình ảnh đính kèm. Mục tiêu là phân loại cảm xúc (tích cực, tiêu cực, trung lập) dựa trên cả hai yếu tố này. Dữ liệu cần được tiền xử lý riêng biệt cho từng phương thức.

Ví dụ cấu trúc dữ liệu:

data = [

{"text": "Cảm thấy rất vui vẻ hôm nay! #happy", "image_path": "images/img_001.jpg", "label": "positive"},

{"text": "Thật thất vọng với dịch vụ này.", "image_path": "images/img_002.jpg", "label": "negative"},

# ...

]Bước 2: Trích Xuất Đặc Trưng Từ Mỗi Phương Thức

Chúng ta sẽ sử dụng các mô hình tiền huấn luyện (pre-trained models) để trích xuất đặc trưng. Đối với văn bản, BERT hoặc RoBERTa là lựa chọn tuyệt vời. Đối với hình ảnh, ResNet hoặc Vision Transformer (ViT) thường được sử dụng.

Trích Xuất Đặc Trưng Văn Bản với Transformers

Sử dụng thư viện transformers của Hugging Face:

from transformers import AutoTokenizer, AutoModel

import torch

# Load pre-trained tokenizer and model

tokenizer = AutoTokenizer.from_pretrained("vinai/phobert-base-v2")

text_model = AutoModel.from_pretrained("vinai/phobert-base-v2")

def get_text_features(text):

inputs = tokenizer(text, return_tensors="pt", padding=True, truncation=True, max_length=128)

with torch.no_grad():

outputs = text_model(**inputs)

# Lấy vector [CLS] token làm đại diện cho toàn bộ câu

return outputs.last_hidden_state[:, 0, :].squeeze().numpy()

# Ví dụ sử dụng

# text_embedding = get_text_features("Hôm nay trời đẹp quá!")

# print(text_embedding.shape) # (768,)Trích Xuất Đặc Trưng Hình Ảnh với PyTorch và torchvision

Sử dụng một mô hình ResNet tiền huấn luyện trên ImageNet:

from torchvision import transforms

from torchvision.models import resnet50, ResNet50_Weights

from PIL import Image

import numpy as np

# Load pre-trained ResNet model

# Sử dụng weights mới nhất

weights = ResNet50_Weights.DEFAULT

image_model = resnet50(weights=weights)

image_model.eval() # Chuyển sang chế độ đánh giá

# Xóa lớp cuối cùng (fully connected layer) để lấy đặc trưng

image_model = torch.nn.Sequential(*(list(image_model.children())[:-1]))

# Define image transformations

preprocess = weights.transforms()

def get_image_features(image_path):

image = Image.open(image_path).convert("RGB")

image_tensor = preprocess(image)

image_tensor = image_tensor.unsqueeze(0) # Thêm batch dimension

with torch.no_grad():

features = image_model(image_tensor)

return features.squeeze().numpy()

# Ví dụ sử dụng

# image_embedding = get_image_features("images/img_001.jpg")

# print(image_embedding.shape) # (2048,)Bước 3: Hợp Nhất Đặc Trưng (Feature Fusion)

Sau khi có các vector đặc trưng từ văn bản và hình ảnh, chúng ta cần kết hợp chúng lại. Các kỹ thuật hợp nhất phổ biến bao gồm:

- Concatenation (Nối trực tiếp): Đơn giản nhất, nối hai vector lại với nhau.

- Element-wise operations (Phép toán từng phần tử): Cộng, nhân từng phần tử.

- Attention mechanisms: Học cách gán trọng số cho các đặc trưng từ mỗi phương thức.

def fuse_features(text_features, image_features):

return np.concatenate((text_features, image_features))

# Ví dụ:

# fused_embedding = fuse_features(text_embedding, image_embedding)

# print(fused_embedding.shape) # (768 + 2048,) = (2816,)Bước 4: Xây Dựng Mô Hình Phân Loại Cuối Cùng

Với các vector đặc trưng đã hợp nhất, chúng ta có thể huấn luyện một mô hình phân loại truyền thống như Logistic Regression, SVM, hoặc một mạng neural network đơn giản.

from sklearn.model_selection import train_test_split

from sklearn.linear_model import LogisticRegression

from sklearn.metrics import accuracy_score

# Giả định đã có danh sách các fused_features và labels

# fused_features_list = [fuse_features(get_text_features(d["text"]), get_image_features(d["image_path"])) for d in data]

# labels = [d["label"] for d in data]

# Để đơn giản, tạo dữ liệu giả lập cho ví dụ này

num_samples = 100

text_dim = 768

image_dim = 2048

fused_dim = text_dim + image_dim

X = np.random.rand(num_samples, fused_dim)

y = np.random.choice(['positive', 'negative', 'neutral'], num_samples)

# Chia tập dữ liệu

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# Huấn luyện mô hình Logistic Regression

classifier = LogisticRegression(max_iter=1000)

classifier.fit(X_train, y_train)

# Đánh giá mô hình

y_pred = classifier.predict(X_test)

accuracy = accuracy_score(y_test, y_pred)

print(f"Accuracy của mô hình Multi-Modal: {accuracy:.4f}")Ví dụ trên minh họa một cách tiếp cận cơ bản để xây dựng hệ thống AI Multi-Modal. Trong thực tế, các kiến trúc phức tạp hơn như Cross-Attention Transformers hoặc các mô hình end-to-end có thể mang lại hiệu suất tốt hơn, nhưng nguyên lý cơ bản vẫn là trích xuất, hợp nhất và phân loại.

Tips và Best Practices Khi Triển Khai AI Multi-Modal

Triển khai các hệ thống AI Multi-Modal không chỉ là về việc viết code mà còn là về việc hiểu rõ dữ liệu và tối ưu hóa quá trình học. Dưới đây là một số mẹo và thực tiễn tốt nhất từ góc nhìn của một chuyên gia vibe coding:

- Tiền xử lý dữ liệu cẩn thận: Mỗi phương thức dữ liệu có những đặc thù riêng và yêu cầu tiền xử lý chuyên biệt. Văn bản cần tokenization, loại bỏ stop words, stemming/lemmatization. Hình ảnh cần resize, normalize, data augmentation. Âm thanh cần trích xuất spectrograms hoặc Mel-frequency cepstral coefficients (MFCCs). Chất lượng tiền xử lý ảnh hưởng trực tiếp đến chất lượng đặc trưng đầu vào.

- Sử dụng mô hình tiền huấn luyện (Pre-trained Models): Đối với các phương thức như văn bản và hình ảnh, việc sử dụng các mô hình tiền huấn luyện trên các tập dữ liệu lớn (như BERT cho văn bản, ResNet/ViT cho hình ảnh) là cực kỳ quan trọng. Chúng đã học được các đặc trưng cấp thấp và trung gian rất hiệu quả, giúp tiết kiệm thời gian huấn luyện và cải thiện hiệu suất đáng kể, đặc biệt khi dữ liệu đa phương thức của bạn có giới hạn.

- Lựa chọn chiến lược hợp nhất (Fusion Strategy) phù hợp:

- Early Fusion: Nối các đặc trưng thô hoặc đã tiền xử lý ngay từ đầu, sau đó đưa vào một mô hình duy nhất. Đơn giản nhưng có thể bỏ lỡ các tương tác phức tạp giữa các phương thức.

- Late Fusion: Huấn luyện các mô hình riêng biệt cho từng phương thức, sau đó kết hợp các dự đoán cuối cùng (ví dụ: bằng cách bỏ phiếu, trung bình cộng). Dễ triển khai nhưng có thể bỏ lỡ các tương tác cấp thấp.

- Intermediate/Hybrid Fusion: Trích xuất đặc trưng từ mỗi phương thức, sau đó hợp nhất các đặc trưng này ở một lớp trung gian và đưa vào mô hình chung. Đây thường là cách tiếp cận hiệu quả nhất, cho phép mô hình học các mối quan hệ phức tạp. Các cơ chế attention (ví dụ: cross-attention) là một ví dụ mạnh mẽ của hình thức này.

- Xử lý sự không đồng nhất của dữ liệu (Modality Imbalance/Missing Modalities): Trong thế giới thực, không phải lúc nào chúng ta cũng có đủ dữ liệu cho tất cả các phương thức. Một số mẫu có thể thiếu hình ảnh, hoặc âm thanh. Các chiến lược như imputation (điền giá trị thiếu), hoặc thiết kế kiến trúc mô hình có khả năng xử lý dữ liệu thiếu (ví dụ: sử dụng các kỹ thuật dropout, hoặc các mô hình có nhánh riêng cho từng phương thức) là cần thiết.

- Đánh giá mô hình toàn diện: Không chỉ đánh giá độ chính xác tổng thể, mà còn cần phân tích hiệu suất của mô hình trên từng phương thức riêng lẻ để hiểu rõ đóng góp của mỗi loại dữ liệu. Các metric như F1-score, precision, recall là quan trọng.

- Tối ưu hóa tài nguyên: Các mô hình AI Multi-Modal thường rất lớn và đòi hỏi nhiều tài nguyên tính toán (GPU, RAM). Cần cân nhắc kỹ giữa hiệu suất và khả năng triển khai. Kỹ thuật như knowledge distillation hoặc pruning có thể giúp giảm kích thước mô hình mà vẫn giữ được hiệu suất tốt.

- Kiểm soát phiên bản và tái sản xuất: Trong vibe coding, việc quản lý mã nguồn, dữ liệu, và các phiên bản mô hình là tối quan trọng. Sử dụng Git, DVC (Data Version Control) và các công cụ MLOps để đảm bảo tính tái sản xuất và dễ dàng mở rộng.

Bằng cách áp dụng những tips này, bạn không chỉ xây dựng được các mô hình AI Multi-Modal mạnh mẽ hơn mà còn duy trì được "vibe" chuyên nghiệp và hiệu quả trong quá trình phát triển.

So Sánh AI Multi-Modal với AI Đơn Phương Thức (Unimodal) và Đánh Giá Tiềm Năng

Để đánh giá đúng giá trị của AI Multi-Modal, chúng ta cần so sánh nó với các hệ thống AI đơn phương thức truyền thống. Sự khác biệt không chỉ nằm ở số lượng loại dữ liệu mà còn ở khả năng hiểu và giải quyết vấn đề.

AI Đơn Phương Thức (Unimodal AI): Là các mô hình chỉ tập trung vào một loại dữ liệu duy nhất. Ví dụ:

- Xử lý ngôn ngữ tự nhiên (NLP): Phân tích văn bản để dịch, tóm tắt, phân loại cảm xúc.

- Thị giác máy tính (Computer Vision): Nhận diện đối tượng, phân đoạn ảnh, nhận diện khuôn mặt từ hình ảnh.

- Xử lý âm thanh (Audio Processing): Nhận dạng giọng nói, phân loại âm thanh.

AI Multi-Modal: Như đã đề cập, AI Multi-Modal kết hợp nhiều loại dữ liệu. Lợi ích chính của nó bao gồm:

- Hiểu biết toàn diện hơn: Có khả năng nắm bắt ngữ cảnh đầy đủ hơn. Ví dụ, một câu nói "Tuyệt vời!" có thể mang ý nghĩa tích cực nếu kèm theo nụ cười, nhưng lại là mỉa mai nếu kèm theo khuôn mặt cau có. AI unimodal (chỉ xử lý văn bản) sẽ khó phân biệt được.

- Khả năng chống nhiễu (Robustness): Nếu một phương thức bị nhiễu hoặc thiếu thông tin, các phương thức khác có thể bù đắp. Ví dụ, nếu hình ảnh mờ, văn bản mô tả vẫn có thể cung cấp thông tin quan trọng.

- Giải quyết các bài toán phức tạp: Các tác vụ như captioning hình ảnh (tạo mô tả văn bản cho ảnh), trả lời câu hỏi thị giác (Visual Question Answering - VQA), phân tích cảm xúc đa phương thức, hoặc xây dựng robot tương tác là những lĩnh vực mà AI Multi-Modal vượt trội hoàn toàn.

- Mô phỏng trí tuệ con người tốt hơn: Gần gũi hơn với cách con người nhận thức và xử lý thông tin từ môi trường xung quanh.

Các Lưu Ý Quan Trọng Khi Phát Triển AI Multi-Modal

- Chọn đúng các phương thức (modalities): Không phải lúc nào nhiều phương thức cũng tốt hơn. Hãy xác định những phương thức nào thực sự mang lại thông tin bổ sung và có ý nghĩa cho bài toán của bạn. Việc thêm một phương thức không liên quan hoặc nhiễu có thể làm giảm hiệu suất.

- Xử lý sự không khớp dữ liệu (Data misalignment): Dữ liệu từ các phương thức khác nhau có thể có tốc độ lấy mẫu, độ dài, hoặc định dạng khác nhau. Việc đồng bộ hóa (synchronization) chúng là rất quan trọng, đặc biệt trong các ứng dụng thời gian thực như video và âm thanh.

- Vấn đề giải thích (Explainability): Các mô hình Multi-Modal thường phức tạp hơn, làm cho việc hiểu cách chúng đưa ra quyết định trở nên khó khăn hơn. Phát triển các kỹ thuật XAI (Explainable AI) cho Multi-Modal là một lĩnh vực nghiên cứu đang phát triển.

- Đảm bảo tính riêng tư và đạo đức: Khi kết hợp nhiều loại dữ liệu cá nhân (ví dụ: hình ảnh khuôn mặt, giọng nói, văn bản), cần đặc biệt chú ý đến các vấn đề về quyền riêng tư, bảo mật dữ liệu và các khía cạnh đạo đức liên quan đến việc sử dụng AI.

- Đừng quên về hiệu suất: Các mô hình Multi-Modal có thể rất nặng. Cần tối ưu hóa mã, sử dụng các thư viện hiệu quả (như PyTorch, TensorFlow), và tận dụng phần cứng mạnh mẽ (GPU) để đảm bảo thời gian huấn luyện và suy luận chấp nhận được.

- Khả năng mở rộng (Scalability): Khi dữ liệu và số lượng phương thức tăng lên, kiến trúc mô hình cần có khả năng mở rộng để xử lý được khối lượng thông tin lớn hơn mà vẫn duy trì hiệu suất.

- Cộng đồng và tài nguyên: Tận dụng cộng đồng mã nguồn mở (Hugging Face, PyTorch, TensorFlow) và các tài nguyên học tập để cập nhật kiến thức và tìm kiếm giải pháp cho các thách thức.

Câu Hỏi Thường Gặp

AI Multi-Modal có phải là tương lai của AI không?

Có, nhiều chuyên gia tin rằng AI Multi-Modal là một bước tiến quan trọng hướng tới AGI (Artificial General Intelligence). Khả năng xử lý và hiểu thông tin từ nhiều giác quan là yếu tố cần thiết để AI có thể tương tác và hoạt động hiệu quả trong thế giới thực, giống như con người. Nó mở ra cánh cửa cho các ứng dụng thông minh và tự động hóa cao cấp hơn.

Những ngành công nghiệp nào sẽ được hưởng lợi nhiều nhất từ AI Multi-Modal?

Hầu hết các ngành công nghiệp đều có thể hưởng lợi. Các ví dụ điển hình bao gồm: y tế (chẩn đoán bệnh từ hình ảnh y tế và bệnh án), ô tô tự lái (kết hợp camera, radar, lidar), an ninh (giám sát video và âm thanh), dịch vụ khách hàng (chatbot hiểu cả giọng nói và văn bản), giáo dục (hệ thống học tập cá nhân hóa), và giải trí (sáng tạo nội dung đa phương tiện).

Thách thức lớn nhất khi xây dựng hệ thống AI Multi-Modal là gì?

Thách thức lớn nhất bao gồm việc thu thập và gán nhãn dữ liệu đa phương thức chất lượng cao, thiết kế kiến trúc mô hình hiệu quả để hợp nhất thông tin từ các phương thức khác nhau, xử lý dữ liệu bị thiếu hoặc không đồng nhất, và yêu cầu tài nguyên tính toán lớn. Việc đảm bảo mô hình có thể giải thích được cũng là một thách thức đáng kể.

Có những công cụ hoặc thư viện nào hỗ trợ phát triển AI Multi-Modal?

Các thư viện học sâu như PyTorch và TensorFlow cung cấp nền tảng vững chắc. Thư viện Hugging Face Transformers rất hữu ích cho các mô hình văn bản và gần đây đã mở rộng sang các mô hình Multi-Modal. Torchvision và OpenCV cho hình ảnh/video. Ngoài ra, có các framework chuyên biệt như MMF (Multi-modal Framework) từ Facebook AI Research (FAIR) hoặc Multimodal-Toolkit đang được phát triển để đơn giản hóa quá trình này.

Kết Luận

AI Multi-Modal không chỉ là một khái niệm hấp dẫn về mặt lý thuyết mà còn là một lĩnh vực đầy tiềm năng với những ứng dụng thực tế sâu rộng. Bằng cách kết hợp sức mạnh của các loại dữ liệu khác nhau, chúng ta có thể xây dựng các hệ thống AI thông minh hơn, có khả năng hiểu và tương tác với thế giới theo cách toàn diện hơn bao giờ hết. Với vibe coding, chúng ta có trong tay các công cụ và kỹ thuật để biến những ý tưởng phức tạp này thành hiện thực, mở ra kỷ nguyên mới của trí tuệ nhân tạo.

Hy vọng bài viết này đã cung cấp cho bạn một cái nhìn sâu sắc và thực tế về AI Multi-Modal, cùng với những hướng dẫn ban đầu để bắt đầu hành trình khám phá và phát triển các ứng dụng đa phương thức của riêng bạn. Hãy tiếp tục theo dõi vibe coding để cập nhật những kiến thức và xu hướng công nghệ AI mới nhất!