Giới Thiệu Vibe Coding: Tận Dụng AI API Bằng Serverless Function – Tối ưu chi phí và tăng tốc triển khai!

Trong thế giới phát triển phần mềm hiện đại, việc tích hợp trí tuệ nhân tạo (AI) vào ứng dụng đã trở thành một xu hướng tất yếu. Bài viết này sẽ giúp bạn hiểu rõ về serverless ai api từ góc nhìn thực tế, khám phá cách kết hợp sức mạnh của các API AI tiên tiến với sự linh hoạt và hiệu quả của kiến trúc serverless function để tối ưu chi phí và tăng tốc độ triển khai. Chúng ta sẽ đi sâu vào các lợi ích, thách thức và cách triển khai serverless AI API một cách hiệu quả nhất.

Serverless AI API: Khái Niệm và Lợi Ích Vượt Trội

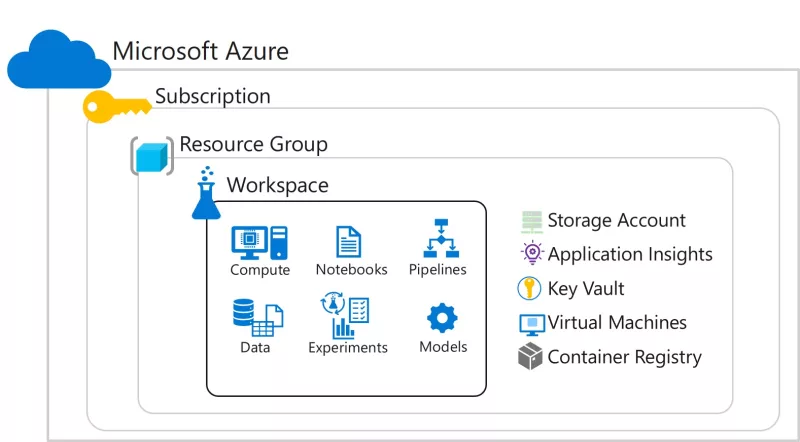

Serverless AI API là phương pháp triển khai các API của các dịch vụ AI (như OpenAI, Google AI, Azure AI) thông qua các hàm Serverless (Function-as-a-Service - FaaS) trên các nền tảng đám mây. Điều này có nghĩa là thay vì phải quản lý các máy chủ vật lý hoặc máy ảo, bạn chỉ cần viết code cho chức năng cụ thể và nền tảng đám mây sẽ tự động quản lý việc mở rộng, cân bằng tải và bảo trì. Theo một báo cáo của Gartner năm 2023, việc sử dụng serverless có thể giảm tới 30% chi phí vận hành cho các ứng dụng dựa trên API.

Việc kết hợp AI API với kiến trúc serverless mang lại nhiều lợi ích đáng kể:

- Tối ưu chi phí: Bạn chỉ trả tiền cho thời gian hàm được thực thi (compute time) và lượng tài nguyên tiêu thụ, thay vì phải trả tiền cho máy chủ hoạt động 24/7. Đối với các tác vụ AI không liên tục hoặc có lưu lượng truy cập biến động lớn, đây là một lợi thế tài chính khổng lồ, ước tính tiết kiệm 40-60% so với mô hình máy chủ truyền thống.

- Khả năng mở rộng (Scalability) tự động: Khi nhu cầu sử dụng AI API tăng lên, nền tảng serverless sẽ tự động khởi tạo thêm các phiên bản của hàm của bạn để xử lý tải. Điều này đảm bảo ứng dụng luôn hoạt động ổn định, ngay cả khi có hàng triệu yêu cầu đồng thời, mà không cần can thiệp thủ công từ phía developer.

- Giảm thiểu công sức quản lý hạ tầng: Các nhà phát triển có thể tập trung hoàn toàn vào việc viết code và logic nghiệp vụ, mà không cần lo lắng về việc cấu hình máy chủ, bảo trì hệ điều hành, cập nhật bảo mật, hay quản lý mạng. Theo một khảo sát của Cloud Native Computing Foundation (CNCF) năm 2024, 75% các tổ chức sử dụng serverless đã báo cáo giảm đáng kể gánh nặng quản lý hạ tầng.

- Tăng tốc độ triển khai (Time-to-Market): Với ít công việc cấu hình và quản lý hơn, các nhóm có thể phát triển, thử nghiệm và triển khai các tính năng AI mới nhanh chóng hơn. Một dự án tích hợp AI có thể được đưa vào sản xuất trong vài ngày thay vì vài tuần.

- Phù hợp với các tác vụ không đồng bộ: Rất nhiều tác vụ AI như xử lý ảnh, phân tích văn bản dài, hay huấn luyện mô hình có thể mất một khoảng thời gian nhất định. Serverless functions có thể được kích hoạt bởi các sự kiện (ví dụ: upload file lên S3, tin nhắn trong queue) và xử lý các tác vụ này một cách không đồng bộ, giải phóng ứng dụng chính.

Hướng Dẫn Thực Hành: Xây Dựng Serverless AI API Với AWS Lambda và OpenAI

Để minh họa cách triển khai serverless AI API, chúng ta sẽ xây dựng một hàm AWS Lambda đơn giản sử dụng Python để gọi API của OpenAI, cụ thể là mô hình GPT-3.5 Turbo, để tạo ra nội dung văn bản. Quy trình này bao gồm cài đặt môi trường, viết code, và triển khai lên AWS Lambda.

Bước 1: Chuẩn bị môi trường và tài khoản

- Tài khoản AWS: Đảm bảo bạn có tài khoản AWS và quyền tạo Lambda functions, IAM roles.

- Tài khoản OpenAI: Đăng ký tài khoản OpenAI và lấy API Key của bạn. Lưu trữ key này an toàn.

- Cài đặt AWS CLI và SAM CLI: Đây là các công cụ dòng lệnh giúp bạn tương tác với AWS và triển khai ứng dụng serverless.

pip install awscli pip install aws-sam-cli

Bước 2: Tạo project Serverless với SAM CLI

Sử dụng SAM CLI để khởi tạo một project Python cơ bản. Chọn template aws-python3.9.

sam init --runtime python3.9 --name my-ai-api --app-template hello-worldDi chuyển vào thư mục project vừa tạo: cd my-ai-api. Cấu trúc project sẽ có một file template.yaml và một thư mục hello_world chứa code Python.

Bước 3: Viết Code cho Serverless Function

Trong thư mục hello_world, mở file app.py và chỉnh sửa nội dung như sau. Chúng ta sẽ cần cài đặt thư viện openai. Thư viện này sẽ được đóng gói cùng với Lambda function.

import json

import os

import openai

# Set your OpenAI API key from environment variables

# This is crucial for security and best practice

openai.api_key = os.environ.get("OPENAI_API_KEY")

def lambda_handler(event, context):

"""

AWS Lambda function to interact with OpenAI's GPT-3.5 Turbo.

Expects a POST request with a JSON body containing a 'prompt' field.

"""

try:

if event['httpMethod'] != 'POST':

return {

'statusCode': 405,

'body': json.dumps({'message': 'Method Not Allowed'})

}

body = json.loads(event['body'])

user_prompt = body.get('prompt')

if not user_prompt:

return {

'statusCode': 400,

'body': json.dumps({'message': 'Missing prompt in request body'})

}

# Call OpenAI API

response = openai.ChatCompletion.create(

model="gpt-3.5-turbo",

messages=[

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": user_prompt}

],

max_tokens=150,

temperature=0.7

)

ai_response_content = response.choices[0].message['content'].strip()

return {

'statusCode': 200,

'headers': {

'Content-Type': 'application/json',

'Access-Control-Allow-Origin': '*' # Allow CORS for frontend integration

},

'body': json.dumps({

'message': 'AI response generated successfully!',

'ai_content': ai_response_content

})

}

except openai.error.OpenAIError as e:

print(f"OpenAI API Error: {e}")

return {

'statusCode': 500,

'body': json.dumps({'message': f'OpenAI API error: {str(e)}'})

}

except Exception as e:

print(f"An unexpected error occurred: {e}")

return {

'statusCode': 500,

'body': json.dumps({'message': f'Internal server error: {str(e)}'})

}

Bước 4: Cập nhật file template.yaml

Để đảm bảo hàm Lambda có thể truy cập biến môi trường OPENAI_API_KEY và cài đặt thư viện openai, chúng ta cần chỉnh sửa file template.yaml. Thêm Environment và Policies cho Lambda.

AWSTemplateFormatVersion: '2010-09-09'

Transform: AWS::Serverless-2016-10-31

Description: A serverless AI API using AWS Lambda and OpenAI

Globals:

Function:

Timeout: 30 # Increase timeout if AI responses can be slow

MemorySize: 256 # Increase memory if needed (default is 128MB)

Resources:

HelloWorldFunction:

Type: AWS::Serverless::Function

Properties:

CodeUri: hello_world/

Handler: app.lambda_handler

Runtime: python3.9

Architectures:

- x86_64

Events:

HelloWorld:

Type: Api

Properties:

Path: /generate-text

Method: post

Environment:

Variables:

OPENAI_API_KEY: "{{resolve:secretsmanager:/openai/api_key:SecretString}}" # Stored securely in AWS Secrets Manager

Policies:

# Policy to allow Lambda to retrieve secrets from Secrets Manager

- SecretsManagerReadWritePolicy:

SecretId: arn:aws:secretsmanager:REGION:ACCOUNT_ID:secret:/openai/api_key

Lưu ý quan trọng:

- Thay

REGIONvàACCOUNT_IDbằng thông tin AWS của bạn. - Chúng ta sử dụng AWS Secrets Manager để lưu trữ

OPENAI_API_KEYmột cách an toàn. Bạn cần tạo một secret tên/openai/api_keytrong Secrets Manager và đặt giá trị là API Key của OpenAI. Đây là một best practice cực kỳ quan trọng về bảo mật. - Thêm

openaivào filerequirements.txttrong thư mụchello_world/:openai

Bước 5: Đóng gói và triển khai

Chạy các lệnh sau trong thư mục gốc của project:

sam build --cached # Build the project, installs dependencies

sam deploy --guided # Deploy to AWS. Follow the prompts.

Trong quá trình sam deploy --guided, bạn sẽ được hỏi về tên stack, khu vực (region), và các biến môi trường. Đảm bảo bạn đã cấu hình đúng Secret Manager cho OPENAI_API_KEY. Sau khi triển khai thành công, SAM CLI sẽ hiển thị URL của API Gateway endpoint. Ví dụ: https://abcdefgh.execute-api.us-east-1.amazonaws.com/Prod/generate-text.

Bước 6: Kiểm thử API

Sử dụng curl hoặc Postman để kiểm tra API của bạn:

curl -X POST \

https://abcdefgh.execute-api.us-east-1.amazonaws.com/Prod/generate-text \

-H 'Content-Type: application/json' \

-d '{ "prompt": "Viết một đoạn văn ngắn về lợi ích của lập trình serverless." }'

Bạn sẽ nhận được phản hồi JSON chứa nội dung do AI tạo ra.

Tips và Best Practices Khi Sử Dụng Serverless AI API

Để tối ưu hiệu suất, chi phí và bảo mật cho serverless AI API, hãy áp dụng các mẹo sau:

- Quản lý API Key an toàn: KHÔNG BAO GIỜ hardcode API key vào code. Luôn sử dụng các dịch vụ quản lý bí mật như AWS Secrets Manager, Azure Key Vault, hoặc Google Secret Manager. Điều này giúp ngăn chặn việc lộ key và tuân thủ các quy tắc bảo mật.

- Tối ưu hóa thời gian khởi động lạnh (Cold Start): Cold start là thời gian mà một hàm serverless mất để khởi tạo lần đầu tiên hoặc sau một thời gian không hoạt động. Để giảm thiểu cold start:

- Giảm kích thước gói triển khai: Chỉ bao gồm các thư viện cần thiết.

- Sử dụng runtime hiệu quả: Python, Node.js thường có cold start tốt hơn Java, .NET.

- Cấp phát bộ nhớ hợp lý: Tăng bộ nhớ RAM cho hàm Lambda cũng có thể cải thiện hiệu năng CPU và giảm cold start.

- Provisioned Concurrency (AWS Lambda): Cấu hình một số instance của hàm luôn ở trạng thái "ấm" để xử lý yêu cầu ngay lập tức. Tính năng này có thể tăng chi phí nhưng rất hiệu quả cho các API có độ trễ thấp.

- Sử dụng Caching: Đối với các yêu cầu AI API lặp lại hoặc có thể dự đoán được, hãy triển khai caching ở cấp độ API Gateway hoặc trong hàm Lambda của bạn. Điều này giúp giảm số lượng cuộc gọi đến AI API bên ngoài, tiết kiệm chi phí và cải thiện độ trễ.

- Xử lý lỗi và Retry Mechanisms: Các API AI có thể gặp lỗi mạng, giới hạn tốc độ (rate limiting) hoặc lỗi nội bộ. Triển khai logic xử lý lỗi mạnh mẽ với cơ chế thử lại (retry) có độ trễ lũy thừa (exponential backoff) để tăng độ bền của ứng dụng.

- Giám sát và Ghi Log (Monitoring & Logging): Tích hợp các công cụ giám sát như CloudWatch (AWS), Azure Monitor, Google Cloud Logging để theo dõi hiệu suất, lỗi và chi phí của các hàm serverless. Ghi log chi tiết các yêu cầu và phản hồi API để dễ dàng debug và phân tích.

- Giới hạn tài nguyên và Timeout: Cấu hình giới hạn bộ nhớ (MemorySize) và thời gian chạy (Timeout) phù hợp cho hàm Lambda của bạn. Điều này giúp ngăn chặn các hàm chạy quá lâu hoặc tiêu thụ quá nhiều tài nguyên, dẫn đến chi phí không mong muốn.

- Sử dụng API Gateway Throttling và Quotas: Để bảo vệ AI API của bạn khỏi lạm dụng và kiểm soát chi phí, cấu hình throttling (giới hạn số lượng yêu cầu mỗi giây) và quotas (tổng số yêu cầu trong một khoảng thời gian) trên API Gateway.

- Bảo mật đầu cuối (End-to-End Security): Đảm bảo tất cả các kết nối đều sử dụng HTTPS. Áp dụng các chính sách IAM (Identity and Access Management) với quyền hạn tối thiểu (least privilege) cho hàm Lambda của bạn.

So Sánh Serverless AI API với Triển Khai AI API Truyền Thống

Việc lựa chọn giữa kiến trúc serverless và truyền thống khi tích hợp AI API phụ thuộc vào nhiều yếu tố. Dưới đây là bảng so sánh chi tiết:

Serverless AI API (ví dụ: AWS Lambda, Azure Functions, Google Cloud Functions)

Ưu điểm:

- Chi phí: Rất hiệu quả về chi phí cho các tác vụ không liên tục hoặc có lưu lượng truy cập biến động. Bạn chỉ trả tiền cho thời gian thực thi (ví dụ: 0.0000002 USD/ms cho Lambda), có thể tiết kiệm 50-70% so với máy chủ ảo.

- Quản lý: Không cần quản lý máy chủ, hệ điều hành, hay patching bảo mật. Giảm gánh nặng vận hành đáng kể, cho phép đội ngũ tập trung vào phát triển tính năng.

- Khả năng mở rộng: Tự động mở rộng gần như vô hạn và tức thì để đáp ứng mọi lưu lượng truy cập, từ 0 đến hàng triệu yêu cầu mỗi giây.

- Thời gian triển khai: Nhanh chóng, thường chỉ mất vài phút để triển khai hoặc cập nhật một hàm.

- Tính linh hoạt: Phù hợp với kiến trúc microservices, tích hợp dễ dàng với các dịch vụ đám mây khác thông qua sự kiện.

Nhược điểm:

- Cold Start: Có thể có độ trễ đáng chú ý (vài trăm mili giây đến vài giây) cho yêu cầu đầu tiên sau một thời gian không hoạt động.

- Giới hạn tài nguyên: Giới hạn về thời gian chạy (ví dụ: 15 phút cho Lambda), bộ nhớ (ví dụ: 10GB cho Lambda) và kích thước gói triển khai.

- Debugging phức tạp: Debugging và giám sát có thể phức tạp hơn do môi trường phân tán và tạm thời.

- Vendor Lock-in: Phụ thuộc vào nền tảng đám mây cụ thể (AWS, Azure, GCP), có thể khó di chuyển giữa các nhà cung cấp.

Triển Khai AI API Truyền Thống (ví dụ: EC2 instance, Virtual Machine, Kubernetes)

Ưu điểm:

- Kiểm soát hoàn toàn: Toàn quyền kiểm soát môi trường runtime, hệ điều hành và cấu hình phần cứng.

- Không Cold Start: Ứng dụng luôn chạy, không có độ trễ khởi động.

- Giới hạn tài nguyên cao hơn: Có thể cấu hình tài nguyên lớn hơn nhiều, phù hợp cho các tác vụ AI nặng, dài hạn (ví dụ: huấn luyện mô hình).

- Dễ dàng Debugging: Môi trường quen thuộc, dễ dàng truy cập log và debug trực tiếp trên máy chủ.

- Tính di động: Dễ dàng di chuyển giữa các nhà cung cấp đám mây hoặc sang môi trường on-premise.

Nhược điểm:

- Chi phí: Thường đắt hơn vì bạn phải trả tiền cho máy chủ hoạt động liên tục, ngay cả khi không có lưu lượng truy cập. Chi phí có thể cao hơn 30-50% cho các trường hợp sử dụng không liên tục.

- Quản lý: Yêu cầu quản lý hạ tầng đáng kể (cấu hình, bảo trì, bảo mật, vá lỗi).

- Khả năng mở rộng: Mở rộng thủ công hoặc cần cấu hình phức tạp (Auto Scaling Groups, Kubernetes). Không linh hoạt bằng serverless.

- Thời gian triển khai: Lâu hơn do cần cấu hình và provisioning máy chủ.

Kết luận so sánh: Nếu bạn cần một giải pháp hiệu quả về chi phí, có khả năng mở rộng tự động và không muốn bận tâm về quản lý hạ tầng cho các tác vụ AI không liên tục hoặc dựa trên sự kiện, serverless AI API là lựa chọn vượt trội. Ngược lại, nếu bạn cần kiểm soát tuyệt đối môi trường, xử lý các tác vụ AI nặng, liên tục và không chấp nhận cold start, thì kiến trúc truyền thống có thể phù hợp hơn. Tuy nhiên, với sự phát triển của serverless, ngay cả các tác vụ nặng cũng đang dần được tối ưu để chạy trên các nền tảng FaaS.

Các Lưu Ý Quan Trọng

- Hiểu rõ giới hạn của nhà cung cấp Serverless: Mỗi nhà cung cấp dịch vụ đám mây (AWS, Azure, Google Cloud) có những giới hạn khác nhau về thời gian chạy, bộ nhớ, kích thước gói triển khai và số lượng yêu cầu đồng thời. Hãy đọc kỹ tài liệu để thiết kế ứng dụng phù hợp.

- Chi phí tiềm ẩn: Mặc dù serverless có vẻ rẻ, nhưng đối với các ứng dụng có lưu lượng truy cập cực lớn hoặc phức tạp với nhiều hàm tương tác, chi phí có thể tăng lên nhanh chóng. Hãy theo dõi chi phí chặt chẽ và sử dụng các công cụ tối ưu hóa chi phí.

- Quản lý trạng thái (State Management): Serverless functions là stateless (không trạng thái). Nếu ứng dụng của bạn cần duy trì trạng thái, bạn phải sử dụng các dịch vụ bên ngoài như cơ sở dữ liệu (DynamoDB, Cosmos DB), bộ nhớ đệm (Redis), hoặc hàng đợi tin nhắn (SQS, Kafka).

- Kiến trúc Event-Driven: Tư duy theo hướng sự kiện (event-driven architecture) là chìa khóa để tận dụng tối đa serverless. Thay vì gọi API trực tiếp, hãy cân nhắc sử dụng các sự kiện (ví dụ: file upload, tin nhắn queue) để kích hoạt các hàm xử lý AI.

- Bảo mật: Đảm bảo rằng các hàm serverless của bạn có quyền truy cập tối thiểu cần thiết (least privilege) đến các tài nguyên khác. Sử dụng các cơ chế xác thực và ủy quyền mạnh mẽ cho các API endpoint.

- Kiểm thử: Kiểm thử các hàm serverless có thể phức tạp hơn do bản chất phân tán. Sử dụng các công cụ kiểm thử cục bộ (như SAM Local, Serverless Offline) và xây dựng các chiến lược kiểm thử tích hợp và end-to-end mạnh mẽ.

- Đảm bảo tuân thủ (Compliance): Đối với các ngành có quy định nghiêm ngặt (y tế, tài chính), hãy đảm bảo rằng việc sử dụng serverless và các dịch vụ AI tuân thủ tất cả các yêu cầu về bảo mật dữ liệu và quyền riêng tư (GDPR, HIPAA).

Câu Hỏi Thường Gặp

Serverless AI API có phù hợp với tất cả các loại mô hình AI không?

Không hoàn toàn. Serverless AI API rất phù hợp với việc gọi các mô hình AI đã được huấn luyện sẵn thông qua API (như GPT, DALL-E, nhận diện hình ảnh của Google Vision AI) hoặc các mô hình nhỏ, nhẹ mà bạn tự triển khai. Tuy nhiên, đối với các tác vụ huấn luyện mô hình AI nặng, cần nhiều tài nguyên tính toán liên tục trong thời gian dài, hoặc các mô hình AI có kích thước rất lớn yêu cầu khởi động lâu, thì kiến trúc serverless có thể không phải là lựa chọn tối ưu do giới hạn về thời gian chạy và bộ nhớ.

Làm thế nào để quản lý phiên bản (versioning) của các hàm serverless AI API?

Các nền tảng serverless như AWS Lambda, Azure Functions, và Google Cloud Functions đều hỗ trợ quản lý phiên bản tích hợp. Bạn nên sử dụng các alias và versioning để quản lý nhiều phiên bản của hàm của mình. Điều này cho phép bạn triển khai phiên bản mới, kiểm thử nó với một phần lưu lượng truy cập (canary deployment) và dễ dàng quay lại phiên bản trước nếu có lỗi, đảm bảo tính ổn định của API AI mà không ảnh hưởng đến người dùng cuối.

Chi phí serverless AI API có thực sự thấp hơn đáng kể không?

Có, chi phí serverless AI API thường thấp hơn đáng kể cho các ứng dụng có lưu lượng truy cập không đều hoặc theo sự kiện. Bạn chỉ trả tiền cho số lần hàm được thực thi và tổng thời gian tính toán, thay vì phải trả tiền cho một máy chủ chạy 24/7. Ví dụ, AWS Lambda có tầng miễn phí khá hào phóng (1 triệu yêu cầu và 400.000 GB-giây tính toán mỗi tháng), cho phép bạn xây dựng và thử nghiệm các API AI mà không tốn kém. Đối với các ứng dụng có lưu lượng truy cập cao và ổn định, chi phí có thể tiệm cận hoặc thậm chí vượt quá chi phí máy chủ truyền thống, nhưng vẫn mang lại lợi ích về quản lý và khả năng mở rộng.

Kết Luận

Serverless AI API là một sự kết hợp mạnh mẽ, mang lại khả năng tối ưu hóa chi phí và tăng tốc độ triển khai cho các ứng dụng tích hợp trí tuệ nhân tạo. Bằng cách tận dụng các hàm serverless, các nhà phát triển có thể tập trung vào việc tạo ra giá trị từ AI mà không phải lo lắng về gánh nặng quản lý hạ tầng. Với những lợi ích vượt trội về khả năng mở rộng, hiệu quả chi phí và sự linh hoạt, mô hình này chắc chắn sẽ tiếp tục là xu hướng chủ đạo trong việc xây dựng các ứng dụng AI hiện đại.

Hy vọng bài viết này đã cung cấp cho bạn cái nhìn sâu sắc và những kiến thức thực tế để bắt đầu hành trình xây dựng serverless AI API. Đừng quên truy cập vibe coding để khám phá thêm nhiều bài viết hữu ích về AI và phát triển phần mềm!