Giới Thiệu Tối Ưu Hóa Trải Nghiệm AI Với Streaming API: Hướng Dẫn Vibe Coding Tích Hợp Phản Hồi Real-time

Trong kỷ nguyên AI bùng nổ, việc xây dựng các ứng dụng thông minh không chỉ dừng lại ở tính năng, mà còn phải tối ưu hóa trải nghiệm người dùng. Một trong những yếu tố then chốt để đạt được điều này chính là khả năng phản hồi theo thời gian thực (real-time feedback) từ các mô hình AI phức tạp. Đây là lúc công nghệ streaming api ai phát huy tối đa sức mạnh của mình. Bài viết này sẽ đi sâu vào cách chúng ta có thể tận dụng streaming API để mang lại một trải nghiệm AI mượt mà, trực quan và hấp dẫn hơn cho người dùng, từ góc nhìn thực tế của một chuyên gia vibe coding.

Sức Mạnh Của Streaming API Trong Bối Cảnh AI

Khi tương tác với các mô hình AI lớn như Large Language Models (LLMs) hay các hệ thống xử lý ảnh, video phức tạp, người dùng thường phải chờ đợi một khoảng thời gian nhất định để nhận được kết quả cuối cùng. Điều này có thể gây ra cảm giác chờ đợi, làm giảm sự hài lòng và trải nghiệm tổng thể. Streaming API ra đời để giải quyết vấn đề này, cho phép dữ liệu được truyền tải từng phần, liên tục ngay khi có sẵn, thay vì chờ đợi toàn bộ phản hồi được tạo ra.

Hãy hình dung bạn đang trò chuyện với một chatbot AI. Thay vì chờ đợi chatbot hoàn thành toàn bộ câu trả lời dài dòng rồi mới hiển thị, streaming API cho phép từng từ, từng câu được hiển thị ngay lập tức, giống như cách một người thật đang gõ phím. Điều này không chỉ tạo ra cảm giác tương tác tự nhiên, mà còn giúp người dùng cảm thấy ứng dụng nhanh hơn, phản hồi hơn, ngay cả khi thời gian xử lý tổng thể không thay đổi đáng kể. Đây là một yếu tố quan trọng trong việc tạo ra một "vibe" tích cực cho ứng dụng AI của bạn.

Về mặt kỹ thuật, streaming API thường được triển khai thông qua các giao thức như HTTP long polling, Server-Sent Events (SSE) hoặc WebSockets. Mỗi phương pháp có những ưu và nhược điểm riêng, phù hợp với các kịch bản sử dụng khác nhau. Đối với các ứng dụng AI đòi hỏi phản hồi liên tục và một chiều từ server về client, SSE thường là lựa chọn tối ưu vì sự đơn giản và hiệu quả. Trong khi đó, WebSockets sẽ phù hợp hơn cho các tương tác hai chiều, thời gian thực như trò chuyện trực tiếp.

Việc tích hợp streaming api ai không chỉ là một cải tiến về mặt giao diện người dùng mà còn là một tối ưu hóa về mặt kiến trúc. Nó cho phép các phần của ứng dụng xử lý dữ liệu ngay khi chúng được nhận, giảm độ trễ (latency) và tăng cường khả năng phản hồi của hệ thống. Điều này đặc biệt quan trọng trong các ứng dụng yêu cầu độ trễ thấp như giao dịch tài chính, game online, hay các hệ thống điều khiển tự động.

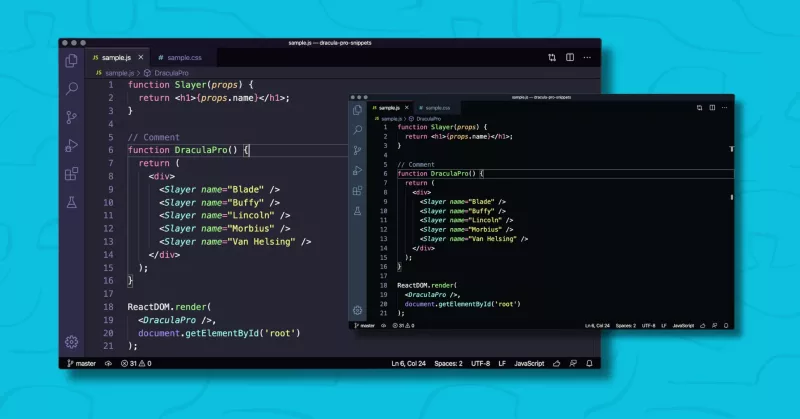

Hướng Dẫn Vibe Coding Tích Hợp Streaming API Cho AI

Để minh họa cách tích hợp streaming API vào ứng dụng AI, chúng ta sẽ tập trung vào kịch bản phổ biến nhất hiện nay: tích hợp với các Large Language Models (LLMs) như OpenAI GPT, Google Gemini, hoặc các mô hình mã nguồn mở khác. Chúng ta sẽ sử dụng Server-Sent Events (SSE) vì sự đơn giản và phù hợp với việc truyền tải phản hồi từng phần từ AI.

Bước 1: Thiết Lập Backend AI Với Streaming

Giả sử bạn đang xây dựng một API backend bằng Python (với Flask hoặc FastAPI) để tương tác với LLM. Hầu hết các thư viện AI hiện đại đều hỗ trợ chế độ streaming. Dưới đây là ví dụ sử dụng OpenAI API:

# app.py (FastAPI example)

from fastapi import FastAPI, Request

from fastapi.responses import StreamingResponse

import openai

import asyncio

app = FastAPI()

# Thay thế bằng API key của bạn

openai.api_key = "YOUR_OPENAI_API_KEY"

async def generate_response_stream(prompt: str):

response = openai.Completion.create(

model="text-davinci-003", # Hoặc gpt-3.5-turbo, gpt-4

prompt=prompt,

max_tokens=100,

stream=True # Kích hoạt chế độ streaming

)

for chunk in response:

# Lấy phần văn bản từ chunk và gửi đi

text = chunk['choices'][0]['text']

yield f"data: {text}\n\n" # Định dạng SSE

@app.post("/stream_chat")

async def stream_chat_endpoint(request: Request):

data = await request.json()

prompt = data.get("prompt")

if not prompt:

return {"error": "Prompt is required"}, 400

return StreamingResponse(generate_response_stream(prompt), media_type="text/event-stream")

# Để chạy ứng dụng này, bạn cần cài đặt uvicorn: pip install fastapi uvicorn openai

# Sau đó chạy: uvicorn app:app --reload

Trong đoạn code trên, hàm generate_response_stream là trái tim của việc streaming. Chúng ta gọi API của OpenAI với tham số stream=True. Sau đó, chúng ta lặp qua các "chunk" phản hồi và định dạng chúng theo chuẩn SSE (data: [nội dung]\n\n) trước khi yield về client. Endpoint /stream_chat sử dụng StreamingResponse của FastAPI để xử lý luồng dữ liệu này.

Bước 2: Xử Lý Streaming Ở Frontend

Ở phía frontend, chúng ta có thể sử dụng JavaScript với đối tượng EventSource để lắng nghe và xử lý các sự kiện được gửi từ backend. Đây là một ví dụ đơn giản sử dụng React hoặc vanilla JavaScript:

// frontend.js (React component example)

import React, { useState, useRef } from 'react';

function AIChat() {

const [prompt, setPrompt] = useState('');

const [response, setResponse] = useState('');

const eventSourceRef = useRef(null);

const handleSubmit = async (e) => {

e.preventDefault();

setResponse(''); // Xóa phản hồi cũ

// Tạo một EventSource kết nối đến endpoint streaming của backend

eventSourceRef.current = new EventSource('http://localhost:8000/stream_chat?prompt=' + encodeURIComponent(prompt));

eventSourceRef.current.onmessage = (event) => {

// Mỗi khi có dữ liệu mới, nối vào phản hồi hiện tại

setResponse(prev => prev + event.data);

};

eventSourceRef.current.onerror = (error) => {

console.error('EventSource failed:', error);

if (eventSourceRef.current) {

eventSourceRef.current.close();

}

};

// Đóng kết nối khi hoàn tất hoặc khi người dùng rời trang

// (Thường backend sẽ tự đóng khi hết stream)

// Tuy nhiên, việc quản lý EventSource cần cẩn thận trong React

// để tránh memory leaks. Ví dụ: dùng useEffect để đóng khi component unmount.

};

// Để gửi POST request, bạn cần dùng fetch và xử lý response stream thủ công hơn

// Hoặc điều chỉnh backend để chấp nhận GET cho đơn giản.

// Với POST, fetch API và Response.body.getReader() sẽ phức tạp hơn EventSource.

// Ví dụ dưới đây cho POST:

const handleSubmitPost = async (e) => {

e.preventDefault();

setResponse('');

const controller = new AbortController();

const signal = controller.signal;

try {

const res = await fetch('http://localhost:8000/stream_chat', {

method: 'POST',

headers: { 'Content-Type': 'application/json' },

body: JSON.stringify({ prompt }),

signal: signal // Cho phép hủy request

});

if (!res.body) return;

const reader = res.body.getReader();

const decoder = new TextDecoder();

let accumulatedResponse = '';

while (true) {

const { done, value } = await reader.read();

if (done) break;

const chunk = decoder.decode(value, { stream: true });

// Xử lý chunk, SSE format có thể phức tạp hơn

// Cần parse "data: ..." và "\n\n"

const lines = chunk.split('\n\n').filter(line => line.startsWith('data: '));

for (const line of lines) {

const data = line.substring(6); // Bỏ "data: "

accumulatedResponse += data;

setResponse(accumulatedResponse);

}

}

} catch (error) {

if (error.name === 'AbortError') {

console.log('Fetch aborted');

} else {

console.error('Fetch error:', error);

}

}

};

return (

<div>

<form onSubmit={handleSubmitPost}> {/<em> Sử dụng handleSubmitPost cho POST </em>/}

<input

type="text"

value={prompt}

onChange={(e) => setPrompt(e.target.value)}

placeholder="Hỏi AI điều gì đó..."

/>

<button type="submit">Gửi</button>

</form>

<div>

<h3 id="heading-6">Phản hồi AI:</h3>

<p>{response}</p>

</div>

</div>

);

}

export default AIChat;

Lưu ý: Đối với phương thức POST, EventSource không hỗ trợ trực tiếp. Bạn sẽ cần sử dụng fetch API và đọc Response.body dưới dạng ReadableStream, sau đó xử lý từng chunk dữ liệu để tái tạo lại hành vi của SSE. Đây là cách tiếp cận phổ biến hơn khi các request cần gửi dữ liệu phức tạp hơn là chỉ một tham số URL. Đoạn code ví dụ đã được cập nhật để sử dụng fetch với POST và xử lý stream thủ công.

Bằng cách này, người dùng sẽ thấy phản hồi của AI xuất hiện từng chữ một, tạo cảm giác tương tác mượt mà và tự nhiên hơn rất nhiều. Việc này không chỉ áp dụng cho văn bản mà còn có thể mở rộng sang các loại dữ liệu khác như các bước xử lý của một tác vụ AI phức tạp, tiến độ tạo ảnh, v.v.

Tips và Best Practices Khi Sử Dụng Streaming API AI

Để ứng dụng streaming api ai một cách hiệu quả, có một số tips và best practices mà bạn nên cân nhắc:

- Xử lý lỗi và kết nối lại: Kết nối streaming có thể bị ngắt do nhiều yếu tố (mạng, server lỗi). Đảm bảo frontend của bạn có cơ chế xử lý lỗi (ví dụ:

onerrorchoEventSource) và thử kết nối lại một cách thông minh (exponential backoff). - Quản lý state hiệu quả ở Frontend: Với các framework như React, việc cập nhật state liên tục (mỗi khi nhận được một chunk mới) có thể gây ra hiệu suất không mong muốn nếu không được tối ưu. Sử dụng

useRefhoặc các kỹ thuật debounce/throttle nếu cần, nhưng thường thì việc nối chuỗi đơn giản là đủ. Đảm bảo rằng việc cập nhật UI không gây re-render quá mức. - Bảo mật API Key: KHÔNG BAO GIỜ nhúng API Key của các dịch vụ AI trực tiếp vào frontend code. Luôn luôn gọi API AI từ backend của bạn. Backend sẽ chịu trách nhiệm xác thực và ủy quyền.

- Kiểm soát tốc độ gửi dữ liệu (Rate Limiting): Đảm bảo backend của bạn có cơ chế rate limiting để tránh lạm dụng API và bảo vệ tài nguyên. Các dịch vụ AI cũng thường có rate limiting riêng.

- Xử lý Timeout: Đặt timeout cho các yêu cầu backend để tránh các kết nối bị treo vĩnh viễn. Nếu một mô hình AI mất quá nhiều thời gian để phản hồi, bạn cần có cơ chế hủy yêu cầu.

- Tối ưu hóa Server-Side: Đảm bảo server của bạn có thể xử lý nhiều kết nối streaming đồng thời một cách hiệu quả. Các framework như FastAPI (với Uvicorn) hay Node.js (với Express) thường có khả năng này rất tốt.

- Tích hợp UI Feedback: Khi streaming, người dùng vẫn cần biết rằng ứng dụng đang hoạt động. Hiển thị một indicator "đang gõ" hoặc "đang xử lý" sẽ tăng cường trải nghiệm.

- Xử lý dữ liệu không hoàn chỉnh: Khi nhận các chunk dữ liệu, đôi khi một chunk có thể bị cắt ngang một từ hoặc một thẻ HTML/JSON. Frontend cần có logic để ghép nối các chunk lại thành dữ liệu hoàn chỉnh trước khi hiển thị hoặc xử lý.

So Sánh Các Phương Pháp Streaming: SSE vs. WebSockets

Khi nói đến streaming API, hai lựa chọn phổ biến nhất là Server-Sent Events (SSE) và WebSockets. Mỗi giao thức có những ưu điểm và nhược điểm riêng, phù hợp với các trường hợp sử dụng khác nhau.

Server-Sent Events (SSE): SSE là một giao thức streaming một chiều, nghĩa là dữ liệu chỉ được gửi từ server đến client. Nó hoạt động trên giao thức HTTP thông thường, sử dụng một kết nối HTTP duy nhất được giữ mở.

- Ưu điểm:

- Đơn giản, dễ triển khai: Sử dụng API

EventSourceở frontend rất dễ dàng. - Dựa trên HTTP: Tận dụng cơ sở hạ tầng HTTP hiện có (proxy, load balancer).

- Tự động kết nối lại:

EventSourcetự động cố gắng kết nối lại nếu kết nối bị ngắt. - Overhead thấp hơn so với WebSockets đối với trường hợp một chiều.

- Đơn giản, dễ triển khai: Sử dụng API

- Nhược điểm:

- Một chiều: Không thể gửi dữ liệu từ client lên server qua cùng một kênh streaming.

- Giới hạn số lượng kết nối: Các trình duyệt cũ có thể giới hạn số lượng kết nối SSE đồng thời.

- Thích hợp cho: Phản hồi AI từ LLM, cập nhật feed tin tức, thông báo, dòng dữ liệu sensor, bất cứ khi nào server cần đẩy dữ liệu liên tục đến client mà client không cần phản hồi ngay lập tức.

WebSockets: WebSockets cung cấp một kênh giao tiếp hai chiều, full-duplex qua một kết nối TCP duy nhất. Sau khi bắt tay (handshake) qua HTTP, kết nối được nâng cấp thành WebSocket.

- Ưu điểm:

- Hai chiều: Client và server có thể gửi và nhận dữ liệu bất cứ lúc nào.

- Độ trễ thấp: Giảm đáng kể overhead so với HTTP request/response truyền thống.

- Hiệu quả cho tương tác liên tục: Lý tưởng cho các ứng dụng yêu cầu trao đổi dữ liệu thường xuyên.

- Nhược điểm:

- Phức tạp hơn để triển khai: Yêu cầu server phải có hỗ trợ WebSocket và thư viện client riêng.

- Không tự động kết nối lại: Cần tự implement logic kết nối lại.

- Yêu cầu cơ sở hạ tầng đặc biệt: Có thể cần cấu hình lại proxy/load balancer.

- Thích hợp cho: Chat trực tiếp, game online, ứng dụng cộng tác thời gian thực, các hệ thống điều khiển từ xa, bất cứ khi nào cả client và server cần gửi dữ liệu cho nhau liên tục và tức thì.

Trong bối cảnh streaming api ai cho phản hồi từ LLM, SSE thường là lựa chọn ban đầu tốt hơn vì sự đơn giản và phù hợp với mô hình "server-to-client stream". Tuy nhiên, nếu bạn đang xây dựng một ứng dụng AI đàm thoại phức tạp hơn, nơi AI cũng cần nhận các cập nhật trạng thái từ người dùng trong khi đang tạo phản hồi, hoặc các ứng dụng AI cộng tác, thì WebSockets có thể là lựa chọn mạnh mẽ hơn.

Các Lưu Ý Quan Trọng

- Quản lý Tài nguyên Server: Mỗi kết nối streaming giữ một kết nối mở trên server. Cần đảm bảo server của bạn có đủ tài nguyên (CPU, RAM, số lượng file descriptor) để xử lý một lượng lớn kết nối đồng thời.

- Tương thích Trình duyệt:

EventSourceđược hỗ trợ rộng rãi trên các trình duyệt hiện đại, nhưng vẫn nên kiểm tra tính tương thích nếu bạn cần hỗ trợ các trình duyệt rất cũ. Đối với WebSockets, hỗ trợ cũng rất tốt. - Thiết kế API nhất quán: Dù bạn chọn SSE hay WebSockets, hãy đảm bảo rằng API của bạn có thiết kế nhất quán và dễ hiểu. Tài liệu hóa rõ ràng các sự kiện và định dạng dữ liệu.

- Xử lý dữ liệu nhạy cảm: Khi streaming dữ liệu AI, đặc biệt là dữ liệu cá nhân hoặc nhạy cảm, hãy đảm bảo rằng bạn áp dụng các biện pháp bảo mật phù hợp (HTTPS, mã hóa đầu cuối, xác thực token).

- Hiệu suất mạng: Mặc dù streaming giúp cải thiện trải nghiệm bằng cách hiển thị dữ liệu sớm, nhưng nó không làm giảm tổng lượng dữ liệu truyền đi. Hãy tối ưu hóa kích thước của mỗi chunk dữ liệu để giảm băng thông cần thiết.

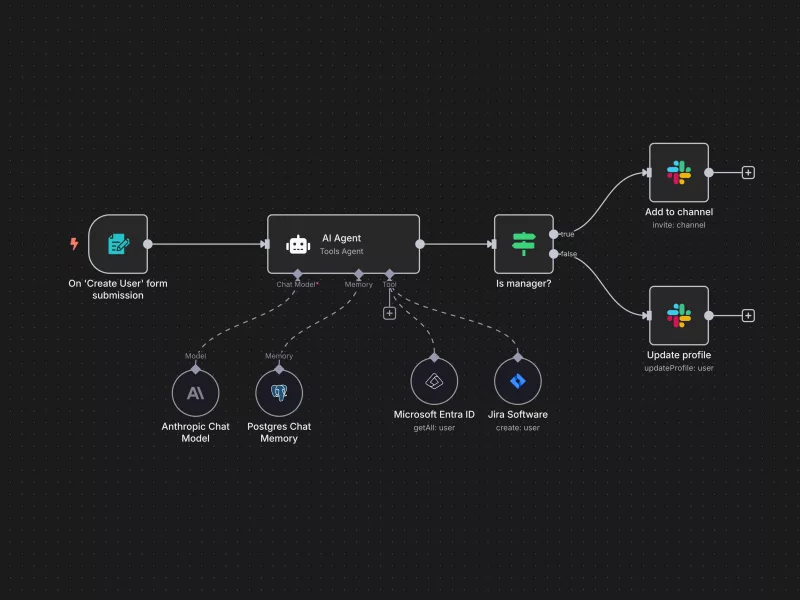

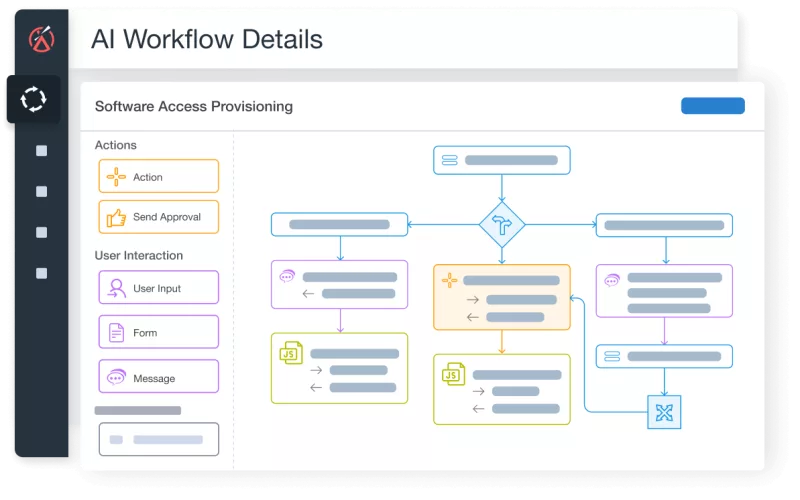

- Phản hồi không chỉ là văn bản: Streaming có thể được sử dụng cho nhiều loại dữ liệu khác ngoài văn bản. Ví dụ: streaming các tọa độ bounding box cho nhận diện vật thể theo thời gian thực, streaming các điểm ảnh khi tạo hình ảnh, hoặc streaming các bước tiến trình của một workflow AI phức tạp.

- Sử dụng thư viện hỗ trợ: Đừng cố gắng tự implement toàn bộ giao thức từ đầu. Sử dụng các thư viện và framework có sẵn (như

FastAPI.StreamingResponse,socket.iocho Node.js) để tiết kiệm thời gian và đảm bảo tính ổn định.

Câu Hỏi Thường Gặp

Streaming API có làm giảm độ trễ (latency) của mô hình AI không?

Không, bản thân streaming API không làm giảm thời gian mà mô hình AI cần để tạo ra toàn bộ phản hồi. Thay vào đó, nó giúp giảm "perceived latency" (độ trễ cảm nhận) bằng cách hiển thị dữ liệu ngay khi có sẵn, tạo cảm giác nhanh hơn cho người dùng. Thời gian xử lý thực tế của mô hình AI vẫn giữ nguyên.

Tôi có cần sử dụng một server đặc biệt để hỗ trợ streaming không?

Hầu hết các web server hiện đại và framework (như Node.js với Express, Python với FastAPI/Flask, Go với Gin) đều hỗ trợ streaming thông qua các cơ chế như HTTP long polling, Server-Sent Events (SSE) hoặc WebSockets. Bạn không nhất thiết cần một server chuyên dụng, nhưng cần cấu hình đúng cách và đảm bảo server có khả năng mở rộng để xử lý nhiều kết nối đồng thời.

Làm thế nào để xử lý việc người dùng đóng trình duyệt hoặc ngắt kết nối trong khi đang streaming?

Đối với SSE, trình duyệt sẽ tự động cố gắng kết nối lại. Đối với WebSockets, bạn cần implement logic kết nối lại ở phía client. Ở phía server, các framework thường có cơ chế để phát hiện khi client ngắt kết nối (ví dụ: sự kiện onclose cho WebSockets, hoặc kiểm tra kết nối bị ngắt khi cố gắng gửi dữ liệu cho SSE) để có thể giải phóng tài nguyên liên quan đến kết nối đó.

Streaming API có ảnh hưởng đến chi phí sử dụng các dịch vụ AI không?

Việc sử dụng streaming API không trực tiếp làm tăng chi phí sử dụng các dịch vụ AI. Chi phí thường được tính dựa trên lượng token được xử lý hoặc số lượng yêu cầu API. Tuy nhiên, nếu việc streaming khuyến khích người dùng tương tác nhiều hơn và tạo ra nhiều yêu cầu hơn, thì tổng chi phí có thể tăng gián tiếp. Điều quan trọng là phải theo dõi và quản lý việc sử dụng API của bạn.

Kết Luận

Tích hợp streaming API vào các ứng dụng AI là một bước tiến quan trọng để tối ưu hóa trải nghiệm người dùng, đặc biệt là với sự gia tăng của các mô hình AI tạo sinh và LLMs. Bằng cách cung cấp phản hồi theo thời gian thực, chúng ta không chỉ làm cho các ứng dụng trở nên nhanh nhẹn và phản hồi hơn, mà còn tạo ra một "vibe" tương tác tự nhiên và hấp dẫn hơn. Từ việc lựa chọn giao thức phù hợp như SSE hay WebSockets, đến việc triển khai backend và frontend một cách cẩn thận, mỗi bước đều góp phần xây dựng một sản phẩm AI chất lượng cao.

Hy vọng rằng hướng dẫn chi tiết này đã cung cấp cho bạn những kiến thức cần thiết để bắt đầu hành trình tích hợp streaming API vào các dự án AI của mình. Hãy thử nghiệm, sáng tạo và mang lại những trải nghiệm AI tuyệt vời nhất cho người dùng. Đừng ngần ngại khám phá thêm các bài viết chuyên sâu khác tại vibe coding để nâng cao kỹ năng phát triển AI của bạn!