Giới Thiệu Tối Ưu Chi Phí AI API: Chiến Lược Cache Prompt Thông Minh Cho Developer Vibe

Trong thế giới phát triển AI năng động ngày nay, việc sử dụng các API của các mô hình ngôn ngữ lớn (LLM) như GPT-3, GPT-4, Claude hay Gemini đã trở thành một phần không thể thiếu trong nhiều ứng dụng. Tuy nhiên, đi kèm với sức mạnh và sự tiện lợi đó là chi phí. Mỗi lần gọi API đều tốn tiền, và với những ứng dụng có lưu lượng truy cập cao hoặc yêu cầu xử lý lặp lại, chi phí này có thể tăng lên nhanh chóng một cách chóng mặt. Bài viết về cache prompt này sẽ giúp bạn hiểu rõ về cách áp dụng một chiến lược thông minh để giảm thiểu chi phí và tăng hiệu suất: cache prompt. Chúng ta sẽ cùng khám phá cách "đệm" các yêu cầu (prompt) và phản hồi (response) từ AI API để tối ưu hóa nguồn lực, mang lại giá trị cao nhất cho các developer vibe.

Cache Prompt là gì và Tại sao nó quan trọng?

Cache prompt, hay còn gọi là bộ nhớ đệm cho prompt, là một kỹ thuật lưu trữ các prompt đã được gửi đi và các phản hồi tương ứng nhận được từ AI API. Thay vì gửi lại cùng một prompt đến API mỗi lần người dùng yêu cầu, hệ thống sẽ kiểm tra xem prompt đó đã từng được xử lý trước đây hay chưa. Nếu có, nó sẽ trả về phản hồi đã lưu trữ thay vì gọi lại API. Điều này không chỉ tiết kiệm chi phí mà còn giảm độ trễ (latency) và tăng tốc độ phản hồi của ứng dụng.

Tầm quan trọng của cache prompt ngày càng tăng khi các mô hình AI trở nên mạnh mẽ hơn nhưng cũng đắt đỏ hơn. Hãy tưởng tượng một ứng dụng tạo nội dung mà người dùng thường xuyên yêu cầu các biến thể của cùng một chủ đề hoặc một chatbot hỗ trợ khách hàng nơi các câu hỏi thường gặp được lặp đi lặp lại. Mỗi lần AI tạo ra một đoạn văn bản hoặc trả lời một câu hỏi đã có sẵn trong bộ nhớ đệm, bạn đã tiết kiệm được một khoản chi phí đáng kể. Hơn nữa, việc giảm tải cho API cũng giúp hệ thống của bạn ổn định hơn, ít gặp phải các giới hạn về rate limit.

Có hai loại prompt chính mà chúng ta có thể cân nhắc cache: exact match prompts và semantic match prompts. Exact match là khi prompt đầu vào giống hệt với một prompt đã được cache. Đây là trường hợp đơn giản nhất và dễ triển khai nhất. Semantic match phức tạp hơn, nó liên quan đến việc hiểu ý nghĩa của prompt để xác định xem hai prompt có "ý nghĩa tương tự" hay không, ngay cả khi chúng có cấu trúc từ ngữ khác nhau. Ví dụ, "Thời tiết hôm nay thế nào?" và "Dự báo thời tiết cho hôm nay?" có thể được coi là các prompt tương tự về mặt ngữ nghĩa.

Việc triển khai một hệ thống cache prompt hiệu quả đòi hỏi sự cân nhắc kỹ lưỡng về kiến trúc, loại dữ liệu cần cache, thời gian tồn tại của cache (TTL), và chiến lược xóa cache (cache invalidation). Một hệ thống cache tốt không chỉ giúp tiết kiệm tiền mà còn nâng cao trải nghiệm người dùng bằng cách cung cấp phản hồi nhanh chóng và nhất quán.

Cuối cùng, đừng quên rằng việc cache không chỉ áp dụng cho prompt đầu vào mà còn cho cả các kết quả trung gian hoặc các phần của phản hồi mà AI tạo ra. Ví dụ, nếu bạn sử dụng AI để tóm tắt các tài liệu dài, bạn có thể cache các đoạn tóm tắt đã tạo ra cho các tài liệu cụ thể. Điều này đặc biệt hữu ích khi các tài liệu đó ít khi thay đổi.

Triển khai Cache Prompt: Hướng dẫn và Ví dụ Thực tế

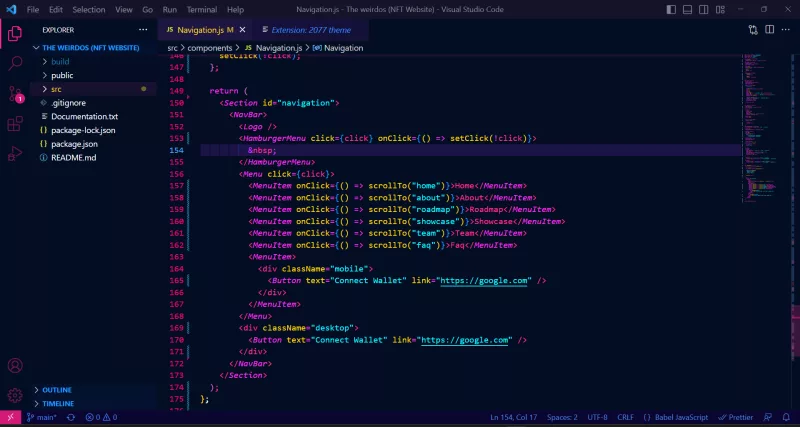

Để triển khai cache prompt, chúng ta cần một kho lưu trữ (storage) để chứa các cặp prompt-response. Kho lưu trữ này có thể là một cơ sở dữ liệu (Redis, MongoDB, PostgreSQL), một dịch vụ cache chuyên dụng (Memcached), hoặc thậm chí là một file hệ thống đơn giản cho các ứng dụng nhỏ. Dưới đây là một ví dụ minh họa bằng Python sử dụng Redis làm bộ nhớ đệm.

Bước 1: Chuẩn bị môi trường

Đảm bảo bạn đã cài đặt thư viện redis và thư viện AI API mà bạn đang sử dụng (ví dụ: openai).

pip install redis openaiBước 2: Thiết lập Redis Cache

Chúng ta sẽ tạo một lớp (class) đơn giản để quản lý việc cache. Lớp này sẽ có các phương thức để kiểm tra xem một prompt có trong cache hay không, lưu trữ một cặp prompt-response, và lấy response từ cache.

import redis

import json

import os

from datetime import datetime, timedelta

class PromptCache:

def __init__(self, host='localhost', port=6379, db=0, ttl_seconds=3600):

self.redis_client = redis.StrictRedis(host=host, port=port, db=db, decode_responses=True)

self.ttl_seconds = ttl_seconds # Time-to-live for cache entries

def _generate_key(self, prompt: str) -> str:

"""Tạo khóa cache từ prompt. Có thể dùng hash cho prompt dài."""

# Đối với prompt ngắn, dùng trực tiếp. Với prompt dài, cân nhắc hashing.

return f"ai_prompt_cache:{prompt}"

def get(self, prompt: str):

"""Lấy phản hồi từ cache."""

key = self._generate_key(prompt)

cached_response = self.redis_client.get(key)

if cached_response:

print(f"DEBUG: Lấy từ cache cho prompt: '{prompt[:50]}...'")

return json.loads(cached_response)

return None

def set(self, prompt: str, response: dict):

"""Lưu trữ phản hồi vào cache."""

key = self._generate_key(prompt)

self.redis_client.setex(key, self.ttl_seconds, json.dumps(response))

print(f"DEBUG: Lưu vào cache cho prompt: '{prompt[:50]}...'")

def invalidate(self, prompt: str):

"""Xóa một prompt cụ thể khỏi cache."""

key = self._generate_key(prompt)

self.redis_client.delete(key)

print(f"DEBUG: Xóa cache cho prompt: '{prompt[:50]}...'")

def clear_all(self):

"""Xóa toàn bộ cache."""

for key in self.redis_client.scan_iter("ai_prompt_cache:*"):

self.redis_client.delete(key)

print("DEBUG: Đã xóa toàn bộ cache AI prompt.")

# Khởi tạo cache với TTL 1 giờ

prompt_cache = PromptCache(ttl_seconds=3600)Bước 3: Tích hợp Cache vào hàm gọi AI API

Bây giờ, chúng ta sẽ bọc lời gọi API của OpenAI (hoặc bất kỳ API AI nào khác) bằng logic cache. Hàm get_ai_response sẽ kiểm tra cache trước khi thực hiện lời gọi API thực sự.

from openai import OpenAI

# Đảm bảo bạn đã thiết lập biến môi trường OPENAI_API_KEY

# hoặc truyền key trực tiếp vào client.

# client = OpenAI(api_key=os.environ.get("OPENAI_API_KEY"))

# Hoặc nếu bạn muốn thử nghiệm mà không có key, bạn có thể mock client.

# Để ví dụ này chạy mà không cần API key thực, chúng ta sẽ mock phản hồi.

# Trong môi trường thực tế, bạn sẽ khởi tạo OpenAI client.

# -- Mock OpenAI Client cho mục đích minh họa --

class MockOpenAIClient:

def chat(self):

return self

def completions(self):

return self

def create(self, model, messages, **kwargs):

print(f"DEBUG: Gọi API OpenAI thực tế với model {model}...")

# Giả lập độ trễ của API

import time

time.sleep(2)

# Giả lập phản hồi

prompt_text = messages[0]['content'] if isinstance(messages, list) else messages

if "thủ đô của Pháp" in prompt_text.lower():

response_content = "Thủ đô của Pháp là Paris."

elif "ngôn ngữ lập trình python" in prompt_text.lower():

response_content = "Python là một ngôn ngữ lập trình cấp cao, thông dịch, đa năng, được tạo ra bởi Guido van Rossum."

else:

response_content = f"Đây là phản hồi giả lập cho prompt: '{prompt_text}'"

return {

"choices": [{

"message": {

"role": "assistant",

"content": response_content

},

"finish_reason": "stop",

"index": 0

}],

"model": model,

"usage": {

"prompt_tokens": len(prompt_text.split()),

"completion_tokens": len(response_content.split()),

"total_tokens": len(prompt_text.split()) + len(response_content.split())

}

}

mock_openai_client = MockOpenAIClient()

# -- Hết Mock OpenAI Client --

def get_ai_response(prompt: str, model: str = "gpt-3.5-turbo", use_cache: bool = True):

"""

Hàm để lấy phản hồi từ AI, sử dụng cache nếu được bật.

"""

if use_cache:

cached_data = prompt_cache.get(prompt)

if cached_data:

return cached_data['response'], cached_data['source']

# Nếu không có trong cache hoặc cache bị tắt, gọi API thực tế

try:

# Trong môi trường thực tế, bạn sẽ dùng client = OpenAI()

# Đối với ví dụ này, chúng ta dùng mock_openai_client

# Nếu dùng OpenAI API thật:

# response = client.chat.completions.create(

# model=model,

# messages=[{"role": "user", "content": prompt}]

# )

# ai_response_content = response.choices[0].message.content

# usage = response.usage.total_tokens

# Dùng Mock client:

response_obj = mock_openai_client.chat().completions().create(

model=model,

messages=[{"role": "user", "content": prompt}]

)

ai_response_content = response_obj["choices"][0]["message"]["content"]

usage = response_obj["usage"]["total_tokens"]

# Lưu vào cache nếu use_cache là True

if use_cache:

prompt_cache.set(prompt, {

"response": ai_response_content,

"model": model,

"timestamp": datetime.now().isoformat(),

"usage_tokens": usage,

"source": "API"

})

return ai_response_content, "API"

except Exception as e:

print(f"Lỗi khi gọi AI API: {e}")

return "Xin lỗi, tôi không thể xử lý yêu cầu của bạn lúc này.", "Error"

# --- Thử nghiệm ---

print("--- Lần gọi đầu tiên (sẽ gọi API mock) ---")

response1, source1 = get_ai_response("Thủ đô của Pháp là gì?")

print(f"Phản hồi: {response1} (Nguồn: {source1})\n")

print("--- Lần gọi thứ hai với cùng prompt (sẽ dùng cache) ---")

response2, source2 = get_ai_response("Thủ đô của Pháp là gì?")

print(f"Phản hồi: {response2} (Nguồn: {source2})\n")

print("--- Lần gọi với prompt khác (sẽ gọi API mock) ---")

response3, source3 = get_ai_response("Python là ngôn ngữ lập trình như thế nào?")

print(f"Phản hồi: {response3} (Nguồn: {source3})\n")

print("--- Lần gọi lại prompt khác (sẽ dùng cache) ---")

response4, source4 = get_ai_response("Python là ngôn ngữ lập trình như thế nào?")

print(f"Phản hồi: {response4} (Nguồn: {source4})\n")

print("--- Xóa cache và gọi lại (sẽ gọi API mock) ---")

prompt_cache.invalidate("Thủ đô của Pháp là gì?")

response5, source5 = get_ai_response("Thủ đô của Pháp là gì?")

print(f"Phản hồi: {response5} (Nguồn: {source5})\n")

# print("--- Xóa toàn bộ cache ---")

# prompt_cache.clear_all()

# print("Cache đã được xóa.")Trong ví dụ trên, chúng ta đã xây dựng một hệ thống cache prompt cơ bản nhưng hiệu quả. Mỗi khi một prompt được gửi đi, hệ thống sẽ ưu tiên kiểm tra trong Redis. Nếu tìm thấy, nó sẽ trả về ngay lập tức, tiết kiệm thời gian và tiền bạc. Nếu không, nó sẽ gọi API AI, lưu kết quả vào cache và trả về cho người dùng. Đây là một mô hình rất phổ biến trong việc tối ưu hóa hiệu suất và chi phí.

Best Practices và Tips cho Cache Prompt Hiệu Quả

Để triển khai cache prompt một cách tối ưu, bạn cần lưu ý một số điểm quan trọng:

- Chiến lược Khóa Cache (Cache Key Strategy): Đối với các prompt đơn giản, việc sử dụng chính chuỗi prompt làm khóa có thể đủ. Tuy nhiên, với các prompt dài hoặc có cấu trúc phức tạp, việc sử dụng hàm băm (hash function) như SHA-256 trên prompt sẽ tạo ra khóa ngắn gọn và hiệu quả hơn. Đảm bảo rằng khóa cache là duy nhất và nhất quán cho cùng một prompt.

- Thời gian Tồn tại của Cache (TTL - Time-To-Live): Đây là một yếu tố cực kỳ quan trọng. Dữ liệu AI có thể thay đổi theo thời gian (ví dụ: thông tin về sự kiện, giá cả). Thiết lập TTL phù hợp sẽ giúp cân bằng giữa việc sử dụng cache và đảm bảo tính tươi mới của dữ liệu. Đối với các thông tin ít thay đổi (ví dụ: định nghĩa, kiến thức chung), TTL có thể dài. Đối với thông tin động, TTL nên ngắn hoặc cần có cơ chế xóa cache chủ động.

- Cơ chế Xóa Cache (Cache Invalidation): Khi dữ liệu nguồn thay đổi, hoặc khi các mô hình AI được cập nhật và có thể cung cấp phản hồi tốt hơn, bạn cần có khả năng xóa các mục cache cũ. Điều này có thể được thực hiện thủ công, dựa trên TTL, hoặc thông qua một cơ chế sự kiện (event-driven invalidation) khi có sự thay đổi liên quan.

- Xử lý Prompt Biến Thể (Variations): AI API thường nhạy cảm với các thay đổi nhỏ trong prompt. "Thời tiết hôm nay?" và "Dự báo thời tiết cho ngày hôm nay?" có thể cho ra phản hồi tương tự nhưng sẽ tạo ra hai mục cache khác nhau nếu dùng exact match. Cân nhắc thêm bước chuẩn hóa prompt (ví dụ: chuyển về chữ thường, loại bỏ dấu câu không cần thiết, sắp xếp từ khóa) trước khi tạo khóa cache để tăng tỷ lệ hit cache.

- Cache theo Tham số (Parameter-based Caching): Nếu bạn sử dụng các tham số khác nhau khi gọi AI API (ví dụ:

temperature,top_p,model), thì prompt không phải là yếu tố duy nhất quyết định phản hồi. Khóa cache của bạn cần kết hợp cả prompt và các tham số quan trọng này để đảm bảo tính chính xác. Ví dụ:hash(prompt + model_name + temperature). - Tầng Cache (Caching Layers): Với các ứng dụng lớn, bạn có thể cân nhắc nhiều tầng cache. Ví dụ, một cache trong bộ nhớ cục bộ (in-memory cache) cho các prompt cực kỳ phổ biến và một cache phân tán (distributed cache) như Redis cho phạm vi rộng hơn.

- Giám sát và Phân tích (Monitoring and Analytics): Theo dõi tỷ lệ hit cache (cache hit rate) là rất quan trọng. Tỷ lệ hit cao cho thấy hệ thống cache của bạn đang hoạt động hiệu quả. Nếu tỷ lệ hit thấp, bạn cần xem xét lại chiến lược cache của mình. Các công cụ giám sát sẽ giúp bạn hiểu rõ hơn về cách cache đang được sử dụng và tối ưu hóa nó.

Việc áp dụng các chiến lược này sẽ giúp bạn xây dựng một hệ thống cache prompt mạnh mẽ, không chỉ tiết kiệm chi phí mà còn cải thiện đáng kể hiệu suất và độ tin cậy của ứng dụng AI của bạn. Một hệ thống cache được thiết kế tốt là dấu hiệu của một developer vibe thực thụ, biết cách cân bằng giữa công nghệ hiện đại và tính kinh tế.

Cache Prompt so với Các Kỹ Thuật Tối Ưu Khác

Cache prompt không phải là kỹ thuật tối ưu chi phí duy nhất cho AI API, nhưng nó là một trong những kỹ thuật cơ bản và hiệu quả nhất. Để có cái nhìn toàn diện, chúng ta hãy so sánh nó với một số phương pháp khác:

- Cache Prompt vs. RAG (Retrieval Augmented Generation):

- Cache Prompt: Trực tiếp lưu trữ và trả về phản hồi đã tạo trước đó cho prompt giống hệt hoặc tương tự. Ưu tiên tốc độ và giảm chi phí cho các query lặp lại. Không yêu cầu AI phải "suy nghĩ" lại.

- RAG: Là một kỹ thuật phức tạp hơn, nơi AI được cung cấp thông tin liên quan từ một cơ sở tri thức bên ngoài (ví dụ: vector database) trước khi tạo phản hồi. RAG giúp AI trả lời các câu hỏi cụ thể, cập nhật hoặc nội bộ mà không cần phải được huấn luyện lại toàn bộ mô hình. Nó tối ưu hóa độ chính xác và khả năng trả lời các câu hỏi ngoài phạm vi kiến thức huấn luyện ban đầu của LLM.

- Sự kết hợp: Bạn có thể kết hợp cả hai. Ví dụ, nếu một prompt RAG đã được xử lý và kết quả là phù hợp, bạn có thể cache kết quả đó. Khi prompt tương tự xuất hiện lần nữa, bạn sẽ lấy từ cache thay vì chạy lại toàn bộ quy trình RAG (bao gồm cả việc truy xuất thông tin và gọi LLM).

- Cache Prompt vs. Fine-tuning/Distillation:

- Cache Prompt: Một chiến lược tối ưu hóa chi phí và hiệu suất ở cấp độ runtime, không thay đổi mô hình AI.

- Fine-tuning (Tinh chỉnh): Huấn luyện thêm một mô hình LLM nhỏ hơn hoặc một phần của mô hình lớn với tập dữ liệu cụ thể của bạn. Điều này giúp mô hình hiểu sâu hơn về lĩnh vực của bạn, tạo ra phản hồi chất lượng cao hơn và đôi khi có thể giảm chi phí (nếu mô hình tinh chỉnh nhỏ hơn và chạy cục bộ). Tuy nhiên, chi phí fine-tuning ban đầu có thể cao và nó không giải quyết vấn đề của các prompt lặp lại mà vẫn cần gọi API cho mỗi prompt mới.

- Distillation (Chưng cất): Tạo ra một mô hình nhỏ hơn ("học sinh") từ một mô hình lớn hơn ("giáo viên") mà vẫn giữ được phần lớn hiệu suất. Mô hình nhỏ hơn này có thể rẻ hơn để chạy và nhanh hơn. Giống như fine-tuning, đây là một chiến lược tối ưu hóa mô hình, không phải tối ưu hóa runtime cho các prompt đã có.

- Sự kết hợp: Bạn có thể cache phản hồi từ một mô hình đã được fine-tune hoặc distilled để tối ưu hóa thêm chi phí và hiệu suất.

- Cache Prompt vs. Prompt Engineering (Kỹ thuật Prompt):

- Cache Prompt: Tối ưu hóa việc sử dụng các prompt đã có.

- Prompt Engineering: Là nghệ thuật và khoa học thiết kế prompt để đạt được kết quả tốt nhất từ AI. Mục tiêu là làm cho AI hiểu rõ ý định của bạn và tạo ra phản hồi chính xác, hữu ích.

- Sự kết hợp: Kỹ thuật prompt tốt có thể dẫn đến các prompt chuẩn hóa hơn, dễ dàng cache hơn và tăng tỷ lệ hit cache. Nếu các prompt được thiết kế tốt để có tính nhất quán, cache prompt sẽ càng hiệu quả.

- Cache Prompt vs. Batching (Xử lý theo lô):

- Cache Prompt: Tối ưu hóa các prompt đơn lẻ lặp lại.

- Batching: Gửi nhiều prompt cùng lúc trong một yêu cầu API duy nhất. Điều này có thể giảm chi phí transaction và độ trễ do chi phí overhead của mỗi lời gọi API.

- Sự kết hợp: Bạn có thể cache kết quả của các prompt trong một batch. Nếu một phần của batch đã có trong cache, bạn chỉ cần gửi các prompt còn lại đến API.

Nhìn chung, cache prompt là một chiến lược bổ trợ mạnh mẽ, hoạt động tốt khi kết hợp với các kỹ thuật tối ưu hóa khác. Nó đặc biệt hiệu quả trong các tình huống mà các prompt có xu hướng lặp lại hoặc có thể được chuẩn hóa. Việc hiểu rõ từng kỹ thuật và biết cách kết hợp chúng một cách khéo léo sẽ mang lại hiệu quả tối đa cho ứng dụng AI của bạn.

Các Lưu Ý Quan Trọng

- Tính nhất quán của phản hồi: Đảm bảo rằng phản hồi được cache vẫn còn hợp lệ và phù hợp. Nếu AI có thể tạo ra các phản hồi ngẫu nhiên hoặc sáng tạo cho cùng một prompt (ví dụ: với

temperature > 0), việc cache có thể làm mất đi sự đa dạng đó. Cân nhắc cache chỉ khi bạn cần phản hồi nhất quán. - Bảo mật dữ liệu: Nếu prompt hoặc phản hồi chứa thông tin nhạy cảm, hãy đảm bảo rằng hệ thống cache của bạn tuân thủ các quy định bảo mật (ví dụ: GDPR, HIPAA). Mã hóa dữ liệu trong cache là một lựa chọn tốt.

- Chi phí hạ tầng cache: Mặc dù cache prompt giúp giảm chi phí API, nhưng bản thân việc duy trì hệ thống cache (như Redis) cũng có chi phí. Cân nhắc quy mô và nhu cầu của bạn để chọn giải pháp cache phù hợp và tiết kiệm.

- Độ phức tạp của hệ thống: Thêm một lớp cache sẽ tăng thêm độ phức tạp cho kiến trúc ứng dụng của bạn. Cần có cơ chế giám sát tốt để theo dõi hiệu suất cache và xử lý các vấn đề phát sinh.

- Xử lý lỗi: Khi có lỗi xảy ra trong quá trình gọi AI API, bạn có nên cache phản hồi lỗi không? Thông thường là không, để đảm bảo hệ thống có cơ hội thử lại với API thật.

- Phân biệt prompt theo người dùng/ngữ cảnh: Trong một số trường hợp, cùng một prompt có thể cần các phản hồi khác nhau tùy thuộc vào người dùng hoặc ngữ cảnh. Ví dụ, "Đề xuất sản phẩm cho tôi" sẽ có phản hồi khác nhau cho mỗi người dùng. Trong trường hợp này, khóa cache cần bao gồm cả ID người dùng hoặc ID ngữ cảnh.

- Cache cho các loại hình AI API khác: Kỹ thuật cache prompt không chỉ giới hạn ở các mô hình ngôn ngữ. Nó có thể áp dụng cho các API tạo hình ảnh (image generation), dịch thuật (translation), hoặc bất kỳ API AI nào mà đầu vào và đầu ra có thể lặp lại.

Câu Hỏi Thường Gặp

Làm thế nào để xử lý các prompt có biến số (variable prompts) khi cache?

Đối với các prompt có biến số (ví dụ: "Tóm tắt bài viết về {chủ đề}"), bạn nên chuẩn hóa prompt trước khi tạo khóa cache. Điều này có thể bao gồm việc thay thế các biến số bằng placeholder hoặc sử dụng một hàm băm trên prompt sau khi đã điền các giá trị cụ thể. Quan trọng là cùng một prompt với cùng các biến số phải tạo ra cùng một khóa cache.

Khi nào thì không nên sử dụng cache prompt?

Bạn không nên sử dụng cache prompt khi phản hồi của AI cần phải cực kỳ dynamic, cá nhân hóa cao, hoặc khi prompt đầu vào luôn thay đổi một cách đáng kể. Ngoài ra, nếu chi phí API rất thấp và độ trễ không phải là vấn đề, việc thêm một lớp cache có thể không mang lại lợi ích đáng kể so với độ phức tạp tăng thêm.

Làm thế nào để đo lường hiệu quả của cache prompt?

Hiệu quả của cache prompt thường được đo bằng "tỷ lệ hit cache" (cache hit rate). Đây là tỷ lệ phần trăm các yêu cầu được phục vụ từ cache so với tổng số yêu cầu. Bạn cũng có thể theo dõi tổng số tiền tiết kiệm được ước tính và độ trễ trung bình giảm đi để định lượng lợi ích.

Có công cụ hoặc thư viện nào hỗ trợ cache prompt không?

Có rất nhiều công cụ và thư viện có thể hỗ trợ. Các hệ thống cache phổ biến như Redis, Memcached cung cấp các API để lưu trữ và truy xuất dữ liệu nhanh chóng. Đối với Python, ngoài thư viện redis, bạn có thể dùng functools.lru_cache cho cache trong bộ nhớ hoặc các thư viện ORM hỗ trợ cache cho database. Một số framework AI cũng bắt đầu tích hợp các tính năng cache cơ bản.

Cache prompt có ảnh hưởng đến khả năng học hỏi của AI không?

Không, cache prompt hoàn toàn không ảnh hưởng đến khả năng học hỏi hoặc huấn luyện của mô hình AI. Nó chỉ đơn thuần là một lớp trung gian để lưu trữ các phản hồi đã được tạo ra. Mô hình AI vẫn hoạt động như bình thường khi một prompt không có trong cache và được gửi tới nó.

Kết Luận

Tối ưu chi phí AI API thông qua chiến lược cache prompt thông minh là một kỹ năng không thể thiếu đối với bất kỳ developer vibe nào làm việc với các mô hình ngôn ngữ lớn. Bằng cách lưu trữ và tái sử dụng các phản hồi từ AI, chúng ta không chỉ giảm đáng kể chi phí vận hành mà còn cải thiện hiệu suất, giảm độ trễ và mang lại trải nghiệm người dùng mượt mà hơn.

Việc triển khai cache prompt đòi hỏi sự cân nhắc kỹ lưỡng về chiến lược khóa cache, TTL, cơ chế xóa cache và các yếu tố bảo mật. Tuy nhiên, với những lợi ích rõ ràng mà nó mang lại, đây chắc chắn là một khoản đầu tư xứng đáng. Hãy bắt đầu áp dụng kỹ thuật này vào các dự án của bạn để tối ưu hóa nguồn lực và khai thác tối đa tiềm năng của AI mà vẫn giữ được chi phí hợp lý. Hãy tiếp tục theo dõi các bài viết chuyên sâu khác tại vibe coding để nâng cao kỹ năng phát triển AI của bạn!