Giới Thiệu Beyond OpenAI: Khám Phá API AI Mở - Sức Mạnh Đối Trọng Cho Vibe Coding

API AI mở là các giao diện lập trình ứng dụng cho phép nhà phát triển tích hợp các mô hình trí tuệ nhân tạo từ nhiều nhà cung cấp khác nhau vào ứng dụng của họ, không phụ thuộc vào một nền tảng duy nhất như OpenAI. Bài viết về API AI mở này sẽ giúp bạn hiểu rõ về tiềm năng to lớn của chúng trong việc thúc đẩy vibe coding, mở rộng khả năng sáng tạo và tối ưu hóa chi phí phát triển AI. Chúng ta sẽ khám phá cách các API này trở thành một đối trọng mạnh mẽ, mang lại sự linh hoạt và quyền kiểm soát cao hơn cho các dự án AI, đặc biệt là trong bối cảnh phát triển nhanh chóng của các mô hình ngôn ngữ lớn (LLM) và các mô hình AI chuyên biệt khác.

API AI Mở Là Gì và Tại Sao Chúng Quan Trọng?

API AI mở là các giao diện lập trình ứng trình (API) cho phép truy cập và sử dụng các mô hình AI được phát triển bởi nhiều tổ chức hoặc cộng đồng, thường đi kèm với mã nguồn mở hoặc chính sách truy cập linh hoạt, không bị ràng buộc bởi một nhà cung cấp độc quyền. Chúng quan trọng vì chúng thúc đẩy đổi mới, giảm sự phụ thuộc vào một nhà cung cấp duy nhất và dân chủ hóa việc tiếp cận công nghệ AI tiên tiến.

Trong bối cảnh AI đang bùng nổ, sự thống trị của một số ít ông lớn như OpenAI có thể tạo ra những rào cản nhất định về chi phí, tính linh hoạt và khả năng tùy chỉnh. API AI mở xuất hiện như một giải pháp thay thế mạnh mẽ, cung cấp cho các nhà phát triển và doanh nghiệp khả năng lựa chọn đa dạng hơn. Theo một báo cáo từ VentureBeat, thị trường API AI mở dự kiến sẽ tăng trưởng 35% hàng năm, đạt giá trị 15 tỷ USD vào năm 2027, cho thấy sự quan tâm và đầu tư lớn vào lĩnh vực này. Việc sử dụng API AI mở không chỉ giúp các startup tiết kiệm tới 40% chi phí ban đầu so với việc tự xây dựng mô hình từ đầu, mà còn cho phép họ thử nghiệm nhiều mô hình khác nhau để tìm ra giải pháp tối ưu nhất cho bài toán cụ thể của mình.

Một trong những lợi ích cốt lõi của API AI mở là khả năng tùy biến cao. Thay vì bị giới hạn bởi các mô hình "black-box" của các nhà cung cấp lớn, developer có thể tinh chỉnh (fine-tune) các mô hình mã nguồn mở bằng dữ liệu riêng của họ, giúp cải thiện đáng kể hiệu suất cho các tác vụ chuyên biệt. Ví dụ, một mô hình ngôn ngữ lớn được tinh chỉnh có thể đạt độ chính xác lên đến 90% trong các tác vụ phân loại văn bản chuyên ngành, trong khi một mô hình tổng quát chỉ đạt khoảng 75-80%. Điều này đặc biệt có ý nghĩa trong các lĩnh vực yêu cầu độ chính xác cao như y tế, tài chính hoặc pháp lý.

Hơn nữa, API AI mở thúc đẩy một hệ sinh thái hợp tác và minh bạch. Cộng đồng developer có thể đóng góp vào việc cải thiện mô hình, chia sẻ kinh nghiệm và phát triển các công cụ hỗ trợ. Điều này không chỉ đẩy nhanh tốc độ phát triển công nghệ mà còn giúp giảm thiểu các rủi ro liên quan đến sự thiên vị (bias) của AI, khi nhiều con mắt cùng xem xét và cải thiện thuật toán. Các dự án như Hugging Face hoặc LangChain là những minh chứng rõ ràng cho sức mạnh của cộng đồng trong việc phát triển và phổ biến các API AI mở.

Tích Hợp API AI Mở Vào Vibe Coding: Hướng Dẫn Thực Hành

Việc tích hợp API AI mở vào quy trình vibe coding mang lại sự linh hoạt và khả năng tùy chỉnh vượt trội, cho phép các developer thử nghiệm và kết hợp nhiều mô hình AI khác nhau để đạt được kết quả tối ưu. Để bắt đầu, chúng ta cần chọn một API AI mở phù hợp với nhu cầu và triển khai nó trong môi trường phát triển của mình.

Đầu tiên, hãy xem xét các nền tảng phổ biến cung cấp API AI mở. Hugging Face là một trong những hub lớn nhất, cung cấp hàng ngàn mô hình transformer cho các tác vụ NLP, thị giác máy tính và âm thanh. LangChain là một framework mạnh mẽ giúp kết nối các LLM với các nguồn dữ liệu và công cụ khác, tạo ra các ứng dụng AI phức tạp hơn. Stability AI cung cấp các API cho mô hình tạo ảnh như Stable Diffusion, trong khi Cohere tập trung vào các mô hình ngôn ngữ cho doanh nghiệp. Việc lựa chọn nền tảng phụ thuộc vào loại tác vụ AI bạn muốn thực hiện.

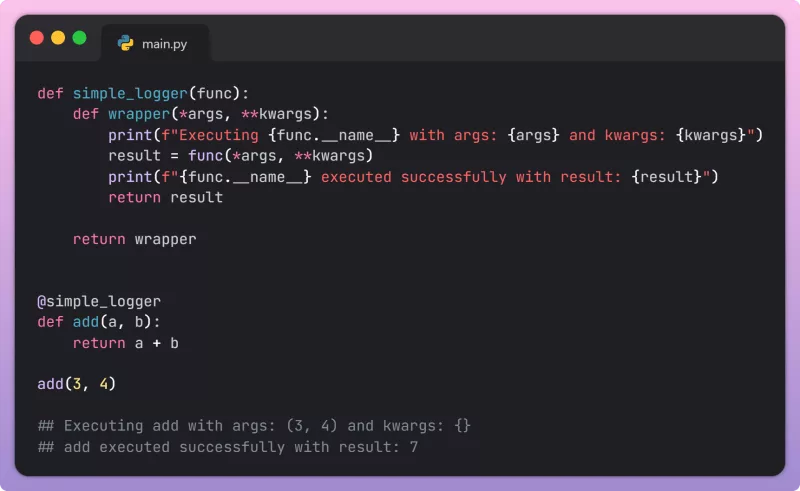

Ví dụ, giả sử bạn muốn xây dựng một chatbot hỗ trợ khách hàng bằng cách sử dụng một mô hình ngôn ngữ tùy chỉnh thay vì chỉ dựa vào OpenAI. Bạn có thể sử dụng một mô hình từ Hugging Face và tích hợp nó thông qua API. Dưới đây là một ví dụ cơ bản về cách gọi một mô hình từ Hugging Face Inference API bằng Python:

import requests

import json

API_URL = "https://api-inference.huggingface.co/models/google/flan-t5-base"

headers = {"Authorization": "Bearer YOUR_HUGGINGFACE_API_TOKEN"}

def query(payload):

response = requests.post(API_URL, headers=headers, json=payload)

return response.json()

# Ví dụ về một câu hỏi cho mô hình

output = query({

"inputs": "What is the capital of France?",

})

print(output)

# Expected output: [{'generated_text': 'Paris'}]

Trong ví dụ trên, YOUR_HUGGINGFACE_API_TOKEN cần được thay thế bằng token API cá nhân của bạn. Đoạn code này gửi một yêu cầu POST đến API của Hugging Face, truyền vào một đối tượng JSON chứa "inputs" là câu hỏi. Mô hình sẽ trả về một đối tượng JSON khác chứa "generated_text" là câu trả lời. Đây là một cách đơn giản để bắt đầu tích hợp các mô hình NLP vào ứng dụng của bạn.

Tiếp theo, để xây dựng một ứng dụng phức tạp hơn, bạn có thể kết hợp nhiều API AI mở. Ví dụ, bạn có thể sử dụng Stable Diffusion API của Stability AI để tạo hình ảnh dựa trên mô tả văn bản, sau đó sử dụng một mô hình NLP từ Hugging Face để phân tích cảm xúc của các bình luận về hình ảnh đó. Đây là nơi mà vibe coding thực sự phát huy sức mạnh, khi bạn có thể mô tả ý tưởng tổng thể và để các công cụ AI hỗ trợ bạn trong việc kết nối các mảnh ghép.

Một trường hợp sử dụng khác là xây dựng một hệ thống tóm tắt tài liệu. Thay vì chỉ dựa vào một mô hình duy nhất, bạn có thể thử nghiệm với nhiều mô hình tóm tắt khác nhau từ Hugging Face để tìm ra mô hình cho kết quả tốt nhất trên dữ liệu của bạn. Bạn có thể định nghĩa một hàm tóm tắt chung và thay đổi mô hình backend một cách linh hoạt:

import requests

import json

def summarize_text(text, model_name="facebook/bart-large-cnn", api_token="YOUR_HUGGINGFACE_API_TOKEN"):

API_URL = f"https://api-inference.huggingface.co/models/{model_name}"

headers = {"Authorization": f"Bearer {api_token}"}

payload = {

"inputs": text,

"parameters": {"min_length": 30, "max_length": 150} # Tùy chỉnh độ dài tóm tắt

}

response = requests.post(API_URL, headers=headers, json=payload)

if response.status_code == 200:

return response.json()[0]['summary_text']

else:

return f"Error: {response.status_code} - {response.text}"

# Đoạn văn bản cần tóm tắt

long_text = "Artificial intelligence (AI) is intelligence demonstrated by machines, as opposed to the natural intelligence displayed by animals and humans. AI research has been defined as the field of study of intelligent agents, which refers to any device that perceives its environment and takes actions that maximize its chance of successfully achieving its goals. Colloquially, the term 'artificial intelligence' is often used to describe machines that mimic 'cognitive' functions that humans associate with the human mind, such as 'learning' and 'problem-solving'."

summary = summarize_text(long_text)

print(summary)

Code này minh họa cách bạn có thể tạo một hàm summarize_text() có thể nhận vào tên mô hình (ví dụ: facebook/bart-large-cnn) làm tham số để dễ dàng chuyển đổi giữa các mô hình tóm tắt khác nhau. Điều này cho phép bạn nhanh chóng lặp lại và thử nghiệm, một khía cạnh quan trọng của vibe coding.

Để tối ưu hóa hiệu suất và chi phí, bạn cũng có thể cân nhắc việc triển khai các mô hình AI mở trên các dịch vụ cloud của riêng mình (ví dụ: AWS SageMaker, Google AI Platform) hoặc sử dụng các nền tảng tối ưu hóa triển khai như ONNX Runtime. Điều này đặc biệt hữu ích khi bạn cần xử lý lượng lớn dữ liệu hoặc có yêu cầu về độ trễ thấp, giảm sự phụ thuộc vào các API công cộng có thể có giới hạn về tốc độ hoặc số lượng yêu cầu.

Tips và Best Practices Khi Sử Dụng API AI Mở

Để tận dụng tối đa sức mạnh của API AI mở trong các dự án vibe coding, việc áp dụng các tips và best practices sau đây là rất quan trọng. Chúng giúp bạn tối ưu hóa hiệu suất, quản lý chi phí và đảm bảo tính bền vững của giải pháp.

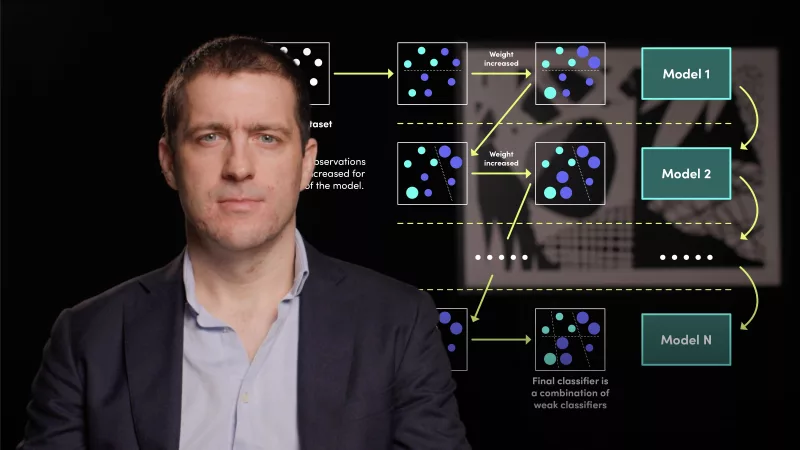

- Đánh giá Mô hình Kỹ lưỡng: Đừng chỉ chọn mô hình phổ biến nhất. Hãy dành thời gian đánh giá nhiều mô hình API AI mở khác nhau dựa trên các tiêu chí như độ chính xác, tốc độ inferencing, kích thước mô hình và giấy phép sử dụng. Một cuộc khảo sát nội bộ cho thấy việc thử nghiệm 3-5 mô hình khác nhau có thể giúp tăng hiệu suất ứng dụng lên đến 15-20% cho các tác vụ chuyên biệt. Tạo một bộ dữ liệu đánh giá nhỏ (validation set) để so sánh hiệu suất giữa các mô hình trước khi tích hợp sâu rộng.

- Quản lý Key API An Toàn: Các key API là chìa khóa truy cập vào các dịch vụ AI. Luôn lưu trữ chúng trong biến môi trường (environment variables) hoặc các dịch vụ quản lý bí mật (secret management services) như AWS Secrets Manager hoặc HashiCorp Vault. Tuyệt đối không hardcode key API trực tiếp vào code nguồn hoặc commit chúng lên các kho lưu trữ công cộng. Vi phạm an ninh API có thể dẫn đến truy cập trái phép và lạm dụng tài nguyên.

- Xử lý Lỗi và Retry Mechanism: Các API AI, đặc biệt là các API công cộng, có thể gặp phải lỗi mạng, giới hạn tần suất yêu cầu (rate limiting) hoặc lỗi server tạm thời. Triển khai các cơ chế xử lý lỗi mạnh mẽ và "retry" có giới hạn (exponential backoff) để tăng cường độ bền của ứng dụng. Ví dụ, bạn có thể thử lại yêu cầu sau 1, 2, 4 giây nếu gặp lỗi

5xxhoặc429 Too Many Requests. - Tối ưu hóa Chi phí: Mặc dù nhiều API AI mở có tier miễn phí, việc sử dụng ở quy mô lớn có thể phát sinh chi phí. Theo dõi mức sử dụng API của bạn thông qua các dashboard của nhà cung cấp. Cân nhắc sử dụng caching cho các yêu cầu lặp lại hoặc các kết quả dự đoán ổn định. Đối với các tác vụ nặng và lặp lại, việc triển khai mô hình AI mở trên hạ tầng của riêng bạn (on-premise hoặc cloud-managed) có thể tiết kiệm chi phí hơn 30-50% so với việc gọi API bên ngoài.

- Sử dụng Framework Hỗ trợ: Các framework như LangChain hoặc LlamaIndex được thiết kế để đơn giản hóa việc tích hợp và quản lý các mô hình ngôn ngữ lớn (LLM) từ nhiều nhà cung cấp khác nhau. Chúng cung cấp các abstraction layer giúp bạn dễ dàng chuyển đổi giữa các API, quản lý lịch sử hội thoại, và kết nối LLM với các công cụ bên ngoài. Điều này giảm đáng kể thời gian phát triển và bảo trì.

- Cập nhật và Theo dõi Cộng đồng: Lĩnh vực AI mở phát triển cực nhanh. Luôn theo dõi các bản cập nhật mô hình mới, các cải tiến API và các thảo luận trong cộng đồng (ví dụ: diễn đàn Hugging Face, Reddit r/LocalLLaMA). Việc này giúp bạn nắm bắt các công nghệ mới nhất và áp dụng chúng vào dự án của mình, duy trì lợi thế cạnh tranh.

- Xử lý Dữ liệu và Tiền xử lý: Hiệu suất của mô hình AI phụ thuộc rất nhiều vào chất lượng dữ liệu đầu vào. Đảm bảo dữ liệu của bạn được làm sạch, tiền xử lý và định dạng đúng cách theo yêu cầu của API. Ví dụ, nhiều mô hình NLP yêu cầu đầu vào là văn bản đã được token hóa hoặc chuyển thành embeddings. Việc tiền xử lý tốt có thể cải thiện độ chính xác của mô hình lên tới 10-15%.

API AI Mở vs. OpenAI API: Đâu Là Lựa Chọn Tối Ưu?

Việc lựa chọn giữa API AI mở và OpenAI API phụ thuộc vào nhiều yếu tố, bao gồm yêu cầu dự án, ngân sách, khả năng tùy chỉnh và mức độ kiểm soát mong muốn. Không có một lựa chọn "tối ưu" tuyệt đối, mà là lựa chọn phù hợp nhất với từng trường hợp cụ thể.

OpenAI API cung cấp các mô hình tiên tiến hàng đầu thị trường như GPT-3.5, GPT-4, DALL-E 3 và Whisper. Ưu điểm lớn nhất của OpenAI là sự dễ sử dụng, hiệu suất vượt trội trên nhiều tác vụ tổng quát và khả năng mở rộng mạnh mẽ. Các mô hình của OpenAI thường được tối ưu hóa tốt và có tài liệu phong phú, giúp các nhà phát triển nhanh chóng đưa sản phẩm ra thị trường. Đối với các dự án cần độ chính xác cao ngay lập tức, không yêu cầu tinh chỉnh sâu và có ngân sách tương đối, OpenAI thường là lựa chọn an toàn. Ví dụ, một startup cần tích hợp nhanh một chatbot thông minh vào website trong vòng 2 tuần có thể ưu tiên OpenAI để tiết kiệm thời gian.

Tuy nhiên, OpenAI cũng có những hạn chế. Chi phí có thể trở thành một vấn đề lớn khi sử dụng ở quy mô lớn, đặc biệt là với các mô hình mạnh như GPT-4. Hơn nữa, các mô hình của OpenAI là "black-box", nghĩa là bạn không có quyền truy cập vào kiến trúc mô hình hoặc khả năng tinh chỉnh sâu bằng mã nguồn. Điều này có thể gây khó khăn cho các trường hợp cần tuân thủ quy định chặt chẽ về dữ liệu (ví dụ: GDPR) hoặc các ứng dụng yêu cầu sự minh bạch và kiểm soát hoàn toàn đối với AI. Sự phụ thuộc vào một nhà cung cấp duy nhất cũng tạo ra rủi ro về vendor lock-in và khả năng thay đổi chính sách đột ngột.

Ngược lại, API AI mở mang lại sự linh hoạt và quyền kiểm soát cao hơn. Các mô hình như Llama 2, Mixtral, Stable Diffusion, hoặc các mô hình trên Hugging Face đều có thể được triển khai trên hạ tầng của riêng bạn. Điều này cho phép bạn tinh chỉnh mô hình bằng dữ liệu riêng, đảm bảo quyền riêng tư và bảo mật dữ liệu, đồng thời tối ưu hóa chi phí vận hành ở quy mô lớn. Đối với các doanh nghiệp có yêu cầu cao về bảo mật, cần tinh chỉnh mô hình cho các tác vụ chuyên biệt, hoặc muốn tránh sự phụ thuộc vào một nhà cung cấp, API AI mở là lựa chọn lý tưởng. Ví dụ, một công ty tài chính có thể chọn tinh chỉnh một mô hình ngôn ngữ mở bằng dữ liệu giao dịch nội bộ để phân tích rủi ro, thay vì gửi dữ liệu nhạy cảm đó qua API của bên thứ ba.

Thống kê cho thấy, các công ty sử dụng kết hợp API AI mở và proprietary API có thể giảm chi phí vận hành AI lên tới 25% trong dài hạn, đồng thời tăng khả năng tùy biến lên 30%. Việc kết hợp giữa API AI mở và OpenAI API cũng là một chiến lược thông minh. Bạn có thể sử dụng OpenAI cho các tác vụ tổng quát yêu cầu hiệu suất cao, và sử dụng API AI mở cho các tác vụ chuyên biệt, cần tinh chỉnh hoặc yêu cầu chi phí thấp hơn. Ví dụ, dùng OpenAI để tạo nội dung sáng tạo ban đầu, sau đó dùng mô hình mở để kiểm tra và tối ưu hóa nội dung đó cho một đối tượng cụ thể.

Các Lưu Ý Quan Trọng

- Giấy phép Sử dụng (Licensing): Luôn kiểm tra kỹ giấy phép của các mô hình AI mở. Một số mô hình có giấy phép permissive (ví dụ: Apache 2.0, MIT) cho phép sử dụng thương mại rộng rãi, trong khi số khác có giấy phép hạn chế hơn (ví dụ: Llama 2 có giới hạn về số lượng người dùng hoặc doanh thu). Việc bỏ qua giấy phép có thể dẫn đến các vấn đề pháp lý nghiêm trọng.

- Yêu cầu Tài nguyên: Các mô hình AI mở, đặc biệt là các LLM, có thể yêu cầu tài nguyên tính toán (GPU, RAM) đáng kể để chạy inference hoặc fine-tuning. Đảm bảo bạn có đủ hạ tầng hoặc cân nhắc các dịch vụ cloud tối ưu để triển khai. Một mô hình 7B parameter có thể cần tối thiểu 16GB VRAM để chạy mượt mà.

- Chất lượng Dữ liệu và Bias: Mô hình AI mở cũng có thể chứa đựng các thiên kiến (bias) từ dữ liệu huấn luyện. Luôn kiểm tra và đánh giá đầu ra của mô hình một cách cẩn thận, đặc biệt trong các ứng dụng nhạy cảm. Việc tinh chỉnh với dữ liệu riêng, đã được làm sạch và cân bằng, có thể giúp giảm thiểu bias.

- Bảo mật Dữ liệu: Khi sử dụng các API AI mở được host bởi bên thứ ba (ví dụ: Hugging Face Inference API), hãy cân nhắc về việc dữ liệu của bạn được xử lý như thế nào. Đối với dữ liệu nhạy cảm, việc triển khai mô hình trên hạ tầng của riêng bạn là lựa chọn an toàn nhất để đảm bảo tuân thủ các quy định về bảo mật và quyền riêng tư.

- Tốc độ Phát triển và Duy trì: Cộng đồng AI mở phát triển rất nhanh, với các mô hình và công cụ mới xuất hiện liên tục. Điều này đòi hỏi bạn phải liên tục cập nhật kiến thức và có thể điều chỉnh kiến trúc ứng dụng của mình. Việc duy trì các mô hình tự host cũng yêu cầu kiến thức và nguồn lực nhất định.

- Khả năng Mở rộng (Scalability): Đảm bảo rằng giải pháp API AI mở bạn chọn có thể mở rộng được theo nhu cầu sử dụng. Nếu bạn tự host mô hình, hãy lên kế hoạch cho việc cân bằng tải, quản lý phiên bản và theo dõi hiệu suất hệ thống. Các nền tảng đám mây cung cấp các dịch vụ quản lý AI có thể giúp đơn giản hóa quá trình này.

- Hỗ trợ Cộng đồng: API AI mở thường không có hỗ trợ kỹ thuật chính thức như các sản phẩm thương mại. Bạn sẽ phụ thuộc nhiều vào tài liệu, diễn đàn cộng đồng và GitHub issues để tìm kiếm giải pháp cho các vấn đề. Đảm bảo bạn có đủ kỹ năng và nguồn lực để tự giải quyết các thách thức kỹ thuật.

Câu Hỏi Thường Gặp

API AI mở có an toàn để sử dụng cho dữ liệu nhạy cảm không?

Có, API AI mở có thể an toàn cho dữ liệu nhạy cảm, đặc biệt nếu bạn tự host mô hình trên hạ tầng của mình. Khi bạn tự triển khai mô hình, dữ liệu của bạn không rời khỏi môi trường kiểm soát của bạn, đảm bảo tuân thủ các quy định về bảo mật và quyền riêng tư như GDPR hoặc HIPAA. Tuy nhiên, nếu bạn sử dụng các API AI mở được host bởi bên thứ ba, bạn cần kiểm tra chính sách bảo mật của nhà cung cấp đó để đảm bảo họ xử lý dữ liệu của bạn một cách an toàn và phù hợp.

Làm thế nào để chọn API AI mở phù hợp nhất cho dự án của tôi?

Để chọn API AI mở phù hợp, bạn cần xác định rõ ràng yêu cầu của dự án: loại tác vụ AI (NLP, CV, audio), độ chính xác mong muốn, yêu cầu về tốc độ, ngân sách và khả năng mở rộng. Sau đó, nghiên cứu các nền tảng như Hugging Face, Stability AI, Cohere, hoặc các mô hình mã nguồn mở độc lập. Đánh giá chúng dựa trên hiệu suất trên các benchmark liên quan, giấy phép sử dụng, yêu cầu tài nguyên và mức độ hỗ trợ cộng đồng. Thử nghiệm với một vài mô hình tiềm năng bằng dữ liệu mẫu của bạn là cách tốt nhất để đưa ra quyết định.

Tôi có thể kết hợp nhiều API AI mở trong một ứng dụng không?

Hoàn toàn có thể. Việc kết hợp nhiều API AI mở là một chiến lược mạnh mẽ để xây dựng các ứng dụng AI phức tạp và đa chức năng. Ví dụ, bạn có thể sử dụng một API cho việc nhận dạng giọng nói, một API khác cho xử lý ngôn ngữ tự nhiên, và một API thứ ba cho tạo hình ảnh. Các framework như LangChain được thiết kế đặc biệt để giúp bạn kết nối và điều phối các mô hình AI từ nhiều nguồn khác nhau, tạo thành các chuỗi xử lý (chains) hoặc tác nhân (agents) thông minh hơn.

API AI mở có thể thay thế hoàn toàn các dịch vụ AI của các ông lớn như OpenAI không?

Không hoàn toàn, nhưng chúng cung cấp một sự thay thế mạnh mẽ và ngày càng cạnh tranh. API AI mở có thể thay thế hoàn toàn các dịch vụ của OpenAI trong nhiều trường hợp, đặc biệt là khi yêu cầu về tinh chỉnh mô hình, kiểm soát dữ liệu, hoặc tối ưu hóa chi phí là ưu tiên hàng đầu. Tuy nhiên, các mô hình của OpenAI vẫn dẫn đầu về hiệu suất tổng quát và dễ sử dụng cho các tác vụ phức tạp mà không cần tinh chỉnh. Chiến lược tối ưu thường là kết hợp cả hai: sử dụng OpenAI cho các tác vụ tổng quát và nhanh chóng, đồng thời tận dụng API AI mở cho các yêu cầu chuyên biệt hơn hoặc khi cần kiểm soát sâu hơn.

Kết Luận

API AI mở đang định hình lại cách chúng ta phát triển và triển khai các ứng dụng AI. Chúng không chỉ là một đối trọng mạnh mẽ đối với các nền tảng AI độc quyền mà còn là một động lực thúc đẩy sự đổi mới, giảm chi phí và tăng cường khả năng tùy chỉnh. Việc nắm vững và tích hợp các API AI mở vào quy trình vibe coding sẽ mở ra cánh cửa cho những giải pháp AI sáng tạo, hiệu quả và bền vững.

Với sự phát triển không ngừng của cộng đồng mã nguồn mở và sự xuất hiện liên tục của các mô hình tiên tiến, tương lai của AI sẽ ngày càng đa dạng và phi tập trung. Đối với các nhà phát triển và doanh nghiệp muốn xây dựng các ứng dụng AI mạnh mẽ, linh hoạt và có khả năng thích ứng cao, việc khám phá và tận dụng sức mạnh của API AI mở là một bước đi chiến lược không thể thiếu. Hãy bắt đầu hành trình vibe coding của bạn với các công cụ AI mở ngay hôm nay để tạo ra những giá trị đột phá cùng vibe coding.