Giới Thiệu Tối Ưu API AI: Xây Dựng Streaming Response Mượt Mà, Giảm Chi Phí Với Vibe Coding

Trong kỷ nguyên bùng nổ của Trí tuệ Nhân tạo, việc tích hợp các mô hình AI vào ứng dụng đã trở thành một phần không thể thiếu. Tuy nhiên, một trong những thách thức lớn mà các nhà phát triển thường gặp phải là làm thế nào để xử lý các phản hồi từ API AI một cách hiệu quả, đặc biệt khi chúng có kích thước lớn hoặc cần thời gian xử lý đáng kể. Đó là lúc khái niệm streaming response AI trở nên cực kỳ quan trọng.

Bài viết này sẽ đi sâu vào việc tối ưu hóa API AI thông qua kỹ thuật streaming response, giúp bạn không chỉ cải thiện trải nghiệm người dùng mà còn giảm đáng kể chi phí vận hành. Chúng ta sẽ cùng khám phá cách xây dựng các luồng dữ liệu mượt mà, tối ưu hóa tài nguyên và áp dụng những kiến thức chuyên sâu từ góc độ của một chuyên gia vibe coding và AI development.

Với sự phát triển không ngừng của các mô hình ngôn ngữ lớn (LLMs) và các dịch vụ AI khác, việc hiểu và triển khai streaming response là chìa khóa để tạo ra các ứng dụng AI phản hồi nhanh, hiệu quả và có khả năng mở rộng. Hãy cùng bắt đầu hành trình khám phá và làm chủ kỹ thuật mạnh mẽ này.

Streaming Response AI: Nâng Cao Trải Nghiệm & Hiệu Quả

Streaming response trong ngữ cảnh API AI đề cập đến việc gửi dữ liệu phản hồi từ server về client theo từng phần nhỏ, liên tục, thay vì chờ đợi toàn bộ phản hồi được tạo ra rồi mới gửi đi một lần. Điều này đặc biệt hữu ích với các mô hình AI tạo sinh (generative AI) như ChatGPT, Claude, hay các mô hình xử lý hình ảnh, video phức tạp, nơi việc tạo ra toàn bộ kết quả có thể mất vài giây đến vài phút.

Lợi ích rõ ràng nhất của streaming response là cải thiện trải nghiệm người dùng (UX). Thay vì người dùng phải chờ đợi một khoảng thời gian dài mà không có bất kỳ phản hồi nào, họ sẽ thấy kết quả được "vẽ ra" từng chữ, từng dòng, hoặc từng phần một. Điều này tạo cảm giác ứng dụng nhanh hơn, tương tác hơn và giảm thiểu sự khó chịu do chờ đợi. Trong các ứng dụng chatbot, việc thấy câu trả lời được "gõ" ra từng chữ một mang lại cảm giác tự nhiên và chân thực hơn.

Ngoài ra, streaming response còn mang lại lợi ích đáng kể về mặt hiệu suất và chi phí. Khi dữ liệu được gửi đi từng phần, server không cần phải giữ toàn bộ phản hồi trong bộ nhớ cho đến khi hoàn tất. Điều này giúp giảm tải bộ nhớ server, đặc biệt khi xử lý đồng thời nhiều yêu cầu. Hơn nữa, việc giải phóng tài nguyên server sớm hơn có thể dẫn đến việc xử lý được nhiều yêu cầu hơn với cùng một lượng tài nguyên, từ đó giảm chi phí vận hành.

Xét về khía cạnh kỹ thuật, streaming response thường được triển khai bằng các giao thức như HTTP/1.1 chunked transfer encoding, Server-Sent Events (SSE), hoặc WebSockets. Mỗi phương pháp có ưu và nhược điểm riêng, phù hợp với các use case khác nhau. Ví dụ, SSE là lựa chọn tuyệt vời cho các trường hợp server cần đẩy dữ liệu liên tục về client một chiều, trong khi WebSockets phù hợp hơn cho giao tiếp hai chiều, thời gian thực.

Việc triển khai streaming response AI không chỉ là một kỹ thuật tối ưu hóa mà còn là một chiến lược quan trọng để xây dựng các ứng dụng AI hiện đại, có khả năng mở rộng và mang lại trải nghiệm người dùng vượt trội. Đây là một yếu tố then chốt mà mọi nhà phát triển API AI nên cân nhắc.

Xây Dựng Streaming Response AI: Hướng Dẫn Thực Hành Với Python và FastAPI

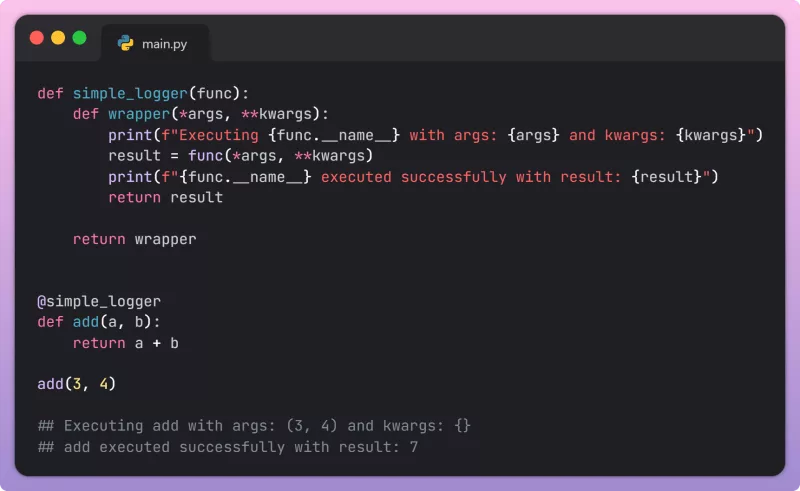

Để minh họa cách xây dựng streaming response AI, chúng ta sẽ sử dụng Python và framework FastAPI, một lựa chọn phổ biến cho việc phát triển API hiệu suất cao. Chúng ta sẽ tạo một API đơn giản mô phỏng việc tạo ra văn bản bởi một mô hình AI và truyền tải nó về client theo dạng stream.

Bước 1: Cài đặt FastAPI và Uvicorn

Đầu tiên, hãy đảm bảo bạn đã cài đặt FastAPI và Uvicorn (một máy chủ ASGI) trong môi trường Python của mình:

pip install fastapi uvicornBước 2: Tạo API Streaming Response cơ bản

Chúng ta sẽ sử dụng lớp StreamingResponse của FastAPI, kết hợp với một generator function để tạo ra dữ liệu theo từng phần. Generator function sẽ mô phỏng quá trình tạo văn bản của AI bằng cách tạm dừng (await asyncio.sleep()) giữa mỗi phần.

Tạo một file main.py với nội dung sau:

import asyncio

from fastapi import FastAPI

from fastapi.responses import StreamingResponse

import uvicorn

app = FastAPI()

async def generate_text_stream():

"""

Mô phỏng việc tạo văn bản từ mô hình AI và gửi từng phần.

"""

full_text = "Chào mừng bạn đến với vibe coding. Đây là một ví dụ về streaming response AI trong FastAPI. Chúng ta đang gửi từng từ một để minh họa cách hoạt động của nó. Hy vọng bạn thấy hữu ích!"

words = full_text.split(" ")

for word in words:

yield word + " "

await asyncio.sleep(0.2) # Mô phỏng thời gian xử lý của AI

@app.get("/stream_ai_response")

async def stream_ai_response():

"""

Endpoint để nhận phản hồi AI dưới dạng streaming.

"""

# Sử dụng StreamingResponse với một generator function

return StreamingResponse(generate_text_stream(), media_type="text/event-stream")

if __name__ == "__main__":

uvicorn.run(app, host="0.0.0.0", port=8000)Giải thích Code:

async def generate_text_stream():: Đây là một generator function bất đồng bộ. Nó "sinh ra" (yield) từng từ một của câu trả lời, mô phỏng việc AI tạo ra văn bản theo thời gian.await asyncio.sleep(0.2)giả lập độ trễ xử lý.@app.get("/stream_ai_response"): Định nghĩa một endpoint HTTP GET.return StreamingResponse(generate_text_stream(), media_type="text/event-stream"): Đây là phần cốt lõi. Chúng ta trả về một đối tượngStreamingResponse, truyền vào generator functiongenerate_text_stream.media_type="text/event-stream"là kiểu MIME cho Server-Sent Events (SSE), một giao thức phổ biến cho streaming response từ server về client.

Bước 3: Chạy API và Kiểm tra

Chạy API bằng lệnh:

uvicorn main:app --reloadSau đó, mở trình duyệt và truy cập http://localhost:8000/stream_ai_response. Bạn sẽ thấy văn bản xuất hiện từng từ một, chứ không phải toàn bộ cùng lúc. Điều này chứng tỏ streaming response AI đang hoạt động.

Để kiểm tra với JavaScript client, bạn có thể sử dụng EventSource API để lắng nghe các sự kiện:

<!DOCTYPE html>

<html>

<head>

<title>Streaming AI Response</title>

</head>

<body>

<h1>AI Response:</h1>

<div id="response"></div>

<script>

const responseDiv = document.getElementById('response');

const eventSource = new EventSource('http://localhost:8000/stream_ai_response');

eventSource.onmessage = function(event) {

responseDiv.innerHTML += event.data; // Nối dữ liệu nhận được

};

eventSource.onerror = function(err) {

console.error("EventSource failed:", err);

eventSource.close();

};

</script>

</body>

</html>Lưu file này dưới dạng index.html và mở bằng trình duyệt. Bạn sẽ thấy văn bản được hiển thị mượt mà trên trang web, từng từ một, giống như khi một chatbot đang "gõ" câu trả lời.

Đây là một ví dụ cơ bản nhưng mạnh mẽ để hiểu cách triển khai streaming response AI. Trong thực tế, generate_text_stream sẽ gọi đến một API của mô hình AI (như OpenAI's API với tham số stream=True) và truyền tải trực tiếp kết quả về client.

Tips & Best Practices Khi Triển Khai Streaming Response AI

Việc triển khai streaming response AI hiệu quả đòi hỏi nhiều hơn là chỉ bật tính năng stream. Dưới đây là một số tips và best practices quan trọng:

1. Xử lý lỗi và Ngắt kết nối một cách duyên dáng

Khi streaming, kết nối có thể bị gián đoạn bất cứ lúc nào. Server cần có cơ chế để ngừng gửi dữ liệu và client cần biết cách xử lý lỗi, hiển thị thông báo phù hợp cho người dùng và có thể thử kết nối lại. Sử dụng các cơ chế timeout và retry ở client là rất quan trọng. Ví dụ, với SSE, EventSource sẽ tự động thử kết nối lại nếu có lỗi.

2. Tối ưu hóa Buffer Size và Latency

Mặc dù mục tiêu là giảm độ trễ, việc gửi quá nhiều gói dữ liệu nhỏ liên tục có thể tạo ra overhead mạng. Ngược lại, buffer quá lớn sẽ làm tăng độ trễ. Cần tìm một sự cân bằng giữa kích thước buffer (số lượng từ/ký tự gửi trong mỗi "chunk") và tần suất gửi để đảm bảo hiệu suất tối ưu. Đối với các LLM, thường họ sẽ trả về từng token hoặc từng cụm token nhỏ.

3. Sử dụng Giao thức phù hợp: SSE hay WebSockets?

Như đã đề cập, Server-Sent Events (SSE) là lựa chọn tuyệt vời cho các tình huống server chỉ cần đẩy dữ liệu một chiều về client (ví dụ: cập nhật trạng thái, kết quả AI). Nó đơn giản để triển khai và dựa trên HTTP. WebSockets cung cấp giao tiếp hai chiều, full-duplex, phù hợp hơn cho các ứng dụng yêu cầu tương tác liên tục từ cả hai phía, như game thời gian thực hoặc các ứng dụng cộng tác. Đối với hầu hết các trường hợp streaming response AI cơ bản, SSE thường là đủ và dễ quản lý hơn.

4. Bảo mật Streaming API

Đừng quên bảo mật cho streaming response AI của bạn. Các biện pháp xác thực (authentication) và ủy quyền (authorization) vẫn phải được áp dụng. Bạn có thể sử dụng JWT (JSON Web Tokens) hoặc các cơ chế xác thực dựa trên session. Đảm bảo rằng chỉ những người dùng hoặc ứng dụng được phép mới có thể truy cập vào luồng dữ liệu của bạn.

5. Giám sát và Log

Việc giám sát hiệu suất và ghi log (logging) là rất quan trọng. Theo dõi độ trễ, tỷ lệ lỗi, và lượng dữ liệu được truyền tải để xác định các điểm nghẽn và tối ưu hóa. Các log chi tiết sẽ giúp bạn gỡ lỗi khi có sự cố xảy ra trong quá trình streaming response AI.

6. Tái Sử Dụng Kết Nối HTTP

Trong môi trường production, hãy đảm bảo rằng server của bạn (ví dụ: Nginx, Caddy) được cấu hình để hỗ trợ keep-alive connections. Điều này giúp tái sử dụng kết nối TCP hiện có cho nhiều yêu cầu stream, giảm overhead do thiết lập kết nối mới cho mỗi yêu cầu. Streaming response AI sẽ hưởng lợi rất nhiều từ việc này.

So Sánh Các Phương Pháp Streaming Response AI

Khi nói đến streaming response AI, chúng ta thường cân nhắc giữa một số phương pháp kỹ thuật chính. Mỗi phương pháp có những đặc điểm riêng, phù hợp với các yêu cầu khác nhau của ứng dụng.

1. Server-Sent Events (SSE)

SSE là một giao thức dựa trên HTTP cho phép server đẩy dữ liệu về client một chiều. Nó được thiết kế đặc biệt cho các trường hợp client cần nhận các cập nhật liên tục từ server.

- Ưu điểm:

- Đơn giản để triển khai.

- Dựa trên HTTP, dễ dàng tương thích với các proxy và firewall.

- Tự động xử lý việc kết nối lại khi có lỗi.

- Hỗ trợ gửi các loại sự kiện khác nhau (custom event types).

- Nhược điểm:

- Chỉ hỗ trợ giao tiếp một chiều (server -> client).

- Số lượng kết nối đồng thời có thể bị giới hạn bởi trình duyệt (thường là 6-8 kết nối trên mỗi domain).

- Phù hợp với: Cập nhật trạng thái, thông báo, kết quả AI tạo sinh theo thời gian thực (ví dụ: chatbot, tạo hình ảnh từng bước). Đây là lựa chọn lý tưởng cho các tình huống streaming response AI một chiều.

2. WebSockets

WebSockets cung cấp một kênh giao tiếp hai chiều, full-duplex qua một kết nối TCP duy nhất. Sau khi bắt tay (handshake) ban đầu qua HTTP, kết nối sẽ được nâng cấp lên giao thức WebSocket.

- Ưu điểm:

- Giao tiếp hai chiều, độ trễ thấp.

- Hiệu quả hơn HTTP cho các ứng dụng cần tương tác liên tục.

- Không có giới hạn kết nối như SSE (phụ thuộc vào tài nguyên server).

- Nhược điểm:

- Phức tạp hơn để triển khai so với SSE.

- Yêu cầu server và client phải có logic xử lý riêng cho giao thức WebSocket.

- Có thể gặp vấn đề với proxy hoặc firewall cũ không hỗ trợ WebSocket.

- Phù hợp với: Ứng dụng chat thời gian thực, game trực tuyến, cộng tác tài liệu, hoặc khi AI cần nhận phản hồi liên tục từ client để điều chỉnh hành vi. Nếu bạn cần AI gửi phản hồi và client cũng cần gửi yêu cầu hoặc điều khiển AI trong cùng một luồng, WebSockets là lựa chọn mạnh mẽ.

3. HTTP Chunked Transfer Encoding

Đây là một tính năng của HTTP/1.1 cho phép server gửi phản hồi về client theo từng "chunk" (khối) dữ liệu. Client không cần biết tổng kích thước của phản hồi ngay từ đầu.

- Ưu điểm:

- Là một phần của HTTP tiêu chuẩn, không cần giao thức đặc biệt.

- Dễ dàng triển khai ở phía server với nhiều framework web.

- Nhược điểm:

- Client cần tự xử lý việc nối các chunk lại với nhau.

- Không có cơ chế tự động kết nối lại như SSE.

- Thường không có "event types" rõ ràng như SSE, khó phân biệt các loại dữ liệu khác nhau trong luồng.

- Phù hợp với: Các API RESTful truyền thống cần gửi dữ liệu lớn theo từng phần mà không cần giao tiếp hai chiều hoặc các tính năng nâng cao của SSE. Một số thư viện AI có thể sử dụng phương pháp này để truyền tải kết quả. Đây là một cách tiếp cận cơ bản cho streaming response AI.

Việc lựa chọn phương pháp phù hợp phụ thuộc vào yêu cầu cụ thể của ứng dụng, mức độ phức tạp mong muốn, và sự cân bằng giữa hiệu suất, tính năng và chi phí phát triển. Đối với hầu hết các trường hợp hiển thị kết quả từ LLM một cách mượt mà, SSE thường là lựa chọn tối ưu về mặt cân bằng.

Các Lưu Ý Quan Trọng

- Tối ưu hóa phía AI Model: Đảm bảo rằng mô hình AI của bạn cũng được tối ưu hóa để tạo ra phản hồi dưới dạng stream. Nhiều LLM hiện đại (như OpenAI's GPT, Google Gemini) cung cấp API với tham số

stream=Trueđể kích hoạt tính năng này. Nếu mô hình AI không hỗ trợ stream, việc triển khai streaming response ở tầng API gateway chỉ là "mô phỏng" bằng cách chia nhỏ phản hồi đã hoàn chỉnh, không thực sự giảm độ trễ đầu tiên (time to first token). - Quản lý tài nguyên hiệu quả: Mặc dù streaming response giúp giảm tải bộ nhớ, nhưng việc duy trì nhiều kết nối mở (đặc biệt là WebSockets) vẫn tiêu tốn tài nguyên server. Cần có chiến lược quản lý kết nối, ví dụ: đóng kết nối khi không còn cần thiết, giới hạn số lượng kết nối đồng thời cho mỗi người dùng.

- Tương thích với Proxy và Load Balancer: Khi triển khai streaming response AI trong môi trường sản phẩm, cần đảm bảo các proxy ngược (reverse proxy) như Nginx, Apache hoặc các load balancer được cấu hình đúng cách để không làm gián đoạn hoặc buffer toàn bộ luồng dữ liệu. Cấu hình

proxy_buffering off;trong Nginx là một ví dụ điển hình. - Xử lý Backpressure: Đôi khi, server có thể tạo ra dữ liệu nhanh hơn client có thể xử lý. Điều này được gọi là backpressure. Các giao thức streaming như WebSockets hoặc SSE thường có cơ chế ngầm định để xử lý điều này, nhưng trong các hệ thống phức tạp hơn, bạn có thể cần triển khai logic backpressure tùy chỉnh để tránh làm quá tải client hoặc server.

- Frontend Frameworks và Streaming: Các framework frontend hiện đại như React, Vue, Angular có thể dễ dàng tích hợp với các API streaming response AI. Sử dụng

useStatehoặcuseReducertrong React để cập nhật UI khi nhận được từng phần dữ liệu sẽ mang lại trải nghiệm mượt mà. - Testing và Debugging: Việc kiểm tra và gỡ lỗi các ứng dụng streaming có thể phức tạp hơn các API truyền thống. Sử dụng các công cụ như Postman, curl, hoặc các công cụ dành riêng cho SSE/WebSocket để kiểm tra luồng dữ liệu và đảm bảo tính toàn vẹn của nó.

- Đánh giá Chi phí: Mặc dù streaming response có thể giảm chi phí tài nguyên server, nhưng cũng cần xem xét chi phí băng thông. Việc gửi nhiều gói dữ liệu nhỏ có thể tăng tổng lượng dữ liệu truyền tải. Tuy nhiên, thường thì lợi ích về trải nghiệm người dùng và hiệu suất server lớn hơn chi phí băng thông tăng thêm.

Câu Hỏi Thường Gặp

Streaming response AI có phức tạp hơn REST API truyền thống không?

Có, việc triển khai streaming response AI thường phức tạp hơn một chút so với REST API truyền thống vì nó liên quan đến việc quản lý các kết nối mở và xử lý dữ liệu theo từng phần. Tuy nhiên, với sự hỗ trợ từ các framework hiện đại như FastAPI và các thư viện frontend, độ phức tạp đã giảm đi đáng kể. Lợi ích về trải nghiệm người dùng và hiệu suất thường vượt trội hơn so với chi phí phát triển ban đầu.

Làm thế nào để xử lý bảo mật cho streaming response AI?

Bạn có thể bảo mật streaming response AI tương tự như các API khác. Sử dụng các cơ chế xác thực như JWT hoặc session tokens. Token này có thể được gửi trong header HTTP ban đầu (đối với SSE và HTTP chunked) hoặc trong quá trình bắt tay WebSocket. Luôn sử dụng HTTPS/WSS để mã hóa dữ liệu truyền tải, bảo vệ thông tin nhạy cảm khỏi bị đánh cắp hoặc sửa đổi.

Streaming response AI có thực sự giảm chi phí không?

Có, streaming response có thể giảm chi phí theo nhiều cách. Thứ nhất, nó giảm thời gian mà server phải giữ tài nguyên (bộ nhớ, CPU) cho mỗi yêu cầu, vì dữ liệu được giải phóng ngay khi được tạo ra. Điều này cho phép server xử lý nhiều yêu cầu đồng thời hơn với cùng một lượng tài nguyên, hoặc cho phép bạn sử dụng các instance server nhỏ hơn. Thứ hai, nó cải thiện trải nghiệm người dùng, có thể dẫn đến tỷ lệ giữ chân người dùng cao hơn và giảm churn, gián tiếp ảnh hưởng đến doanh thu và chi phí marketing.

Tôi có thể sử dụng streaming response cho các loại dữ liệu khác ngoài văn bản không?

Hoàn toàn có thể. Mặc dù ví dụ trong bài viết tập trung vào văn bản, bạn có thể sử dụng streaming response cho bất kỳ loại dữ liệu nào, miễn là bạn có thể chia nó thành các phần nhỏ hơn. Ví dụ, bạn có thể stream các phần của một hình ảnh lớn, các khung hình của một video, hoặc các đoạn âm thanh được tạo ra bởi AI. Quan trọng là client có thể nhận và tái tạo lại dữ liệu từ các phần nhỏ đó.

Kết Luận

Tối ưu hóa API AI thông qua kỹ thuật streaming response AI không chỉ là một xu hướng mà còn là một yêu cầu tất yếu để xây dựng các ứng dụng AI hiện đại, hiệu quả và mang lại trải nghiệm người dùng vượt trội. Bằng cách gửi dữ liệu theo từng phần nhỏ, liên tục, chúng ta có thể giảm đáng kể độ trễ cảm nhận, cải thiện hiệu suất server và tối ưu hóa chi phí vận hành.

Với những kiến thức và ví dụ thực tế được chia sẻ trong bài viết này, hy vọng bạn đã có cái nhìn sâu sắc hơn về cách triển khai streaming response AI một cách hiệu quả. Từ việc lựa chọn giao thức phù hợp (SSE, WebSockets), đến việc áp dụng các best practices về bảo mật, xử lý lỗi và tối ưu hóa tài nguyên, mỗi bước đều quan trọng để tạo ra một hệ thống mạnh mẽ.

Nếu bạn đang tìm kiếm những giải pháp công nghệ tiên tiến và định hình tương lai của AI, hãy tiếp tục theo dõi vibe coding. Chúng tôi luôn sẵn sàng chia sẻ những kiến thức chuyên sâu và kinh nghiệm thực tế để giúp bạn làm chủ công nghệ và tạo ra những sản phẩm AI đột phá.