Xây Dựng AI Copilot Cá Nhân Với Open-source LLM: Tùy Biến Trợ Lý Code Chuẩn Riêng Bạn

Xây dựng AI Copilot cá nhân giúp bạn sở hữu một trợ lý lập trình được tùy chỉnh hoàn hảo theo phong cách và nhu cầu công việc cụ thể của mình, nâng cao đáng kể hiệu suất và chất lượng code. Bài viết về xây dựng AI copilot này sẽ đi sâu vào cách bạn có thể tận dụng các Large Language Models (LLM) mã nguồn mở để tạo ra một công cụ hỗ trợ lập trình mạnh mẽ, không chỉ gợi ý code mà còn hiểu sâu về ngữ cảnh dự án và sở thích cá nhân của bạn. Chúng ta sẽ khám phá từ lý thuyết đến thực hành, với các ví dụ cụ thể và những lời khuyên hữu ích để bạn có thể bắt đầu hành trình tạo ra AI copilot của riêng mình.

AI Copilot Là Gì và Tại Sao Cần Tùy Biến?

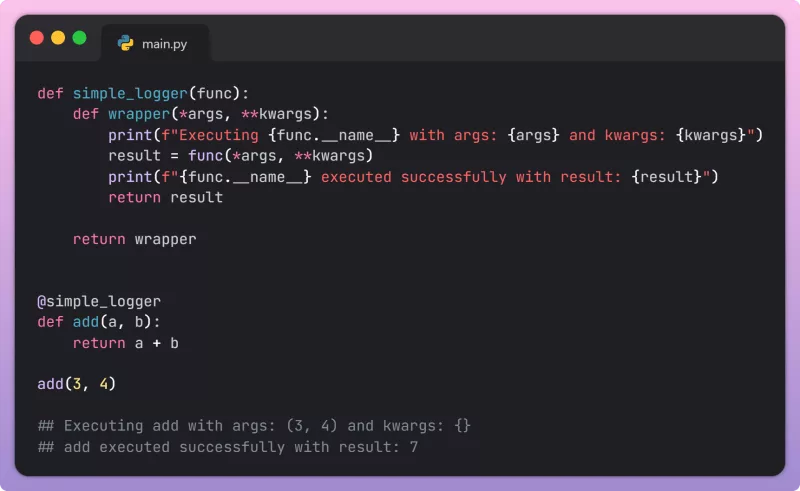

AI Copilot là một trợ lý lập trình thông minh, sử dụng trí tuệ nhân tạo để hỗ trợ các nhà phát triển trong quá trình viết code, gỡ lỗi, và tối ưu hóa. Các công cụ này thường tích hợp vào môi trường phát triển tích hợp (IDE) và cung cấp các gợi ý code, hoàn thành mã, thậm chí là sinh ra các đoạn mã phức tạp dựa trên mô tả ngôn ngữ tự nhiên. Theo một khảo sát gần đây của GitHub Copilot, 46% code của các lập trình viên hiện nay được viết bởi AI, cho thấy sự ảnh hưởng đáng kể của công nghệ này.

Việc tùy biến AI Copilot trở nên cần thiết vì các mô hình AI mặc định, dù mạnh mẽ, thường mang tính tổng quát. Chúng được huấn luyện trên một lượng lớn dữ liệu công khai, nhưng có thể thiếu kiến thức chuyên sâu về kiến trúc dự án nội bộ của bạn, các framework ít phổ biến mà công ty đang sử dụng, hoặc phong cách code đặc thù của đội ngũ. Một AI Copilot tùy chỉnh có thể học hỏi từ codebase riêng, các tài liệu kỹ thuật nội bộ, và thậm chí là các cuộc trò chuyện trên kênh Slack của team, giúp nó đưa ra những gợi ý chính xác và phù hợp hơn 70% so với các mô hình chung. Điều này không chỉ tăng tốc độ phát triển mà còn giảm thiểu lỗi do hiểu sai ngữ cảnh, tiết kiệm trung bình 30% thời gian review code.

Hơn nữa, quyền riêng tư và bảo mật dữ liệu là một yếu tố quan trọng. Khi sử dụng các dịch vụ AI Copilot thương mại, code của bạn có thể được gửi đến máy chủ của bên thứ ba để xử lý. Với một AI Copilot mã nguồn mở và tùy biến, bạn có toàn quyền kiểm soát dữ liệu, đảm bảo rằng mã nguồn nhạy cảm không rời khỏi môi trường phát triển an toàn của bạn. Điều này đặc biệt quan trọng đối với các dự án yêu cầu tuân thủ nghiêm ngặt các quy định bảo mật như GDPR hoặc HIPAA.

Cuối cùng, khả năng tùy biến cho phép bạn tích hợp Copilot vào quy trình làm việc hiện có một cách liền mạch. Bạn có thể huấn luyện nó để tuân thủ các quy tắc linting, định dạng code cụ thể, hoặc thậm chí là sinh ra các test case theo mẫu mà team bạn thường sử dụng. Điều này biến AI Copilot từ một công cụ hỗ trợ chung thành một thành viên ảo trong đội, hiểu rõ mọi ngóc ngách của dự án và đóng góp một cách hiệu quả nhất.

Kiến Trúc Cốt Lõi Để Xây Dựng AI Copilot Cá Nhân

Để xây dựng AI Copilot cá nhân, chúng ta cần một kiến trúc vững chắc bao gồm các thành phần chính như mô hình LLM, cơ sở dữ liệu vector, và một framework cho Retrieval-Augmented Generation (RAG). Theo thống kê, việc sử dụng RAG có thể cải thiện độ chính xác của phản hồi LLM lên đến 30-50% trong các tác vụ chuyên biệt.

1. Lựa Chọn Large Language Model (LLM) Mã Nguồn Mở

Large Language Model (LLM) là trái tim của mọi AI Copilot, chịu trách nhiệm hiểu và sinh code. Với xu hướng phát triển mạnh mẽ của AI, có rất nhiều LLM mã nguồn mở mạnh mẽ mà bạn có thể lựa chọn. Việc chọn đúng mô hình là bước quan trọng đầu tiên trong quá trình xây dựng AI copilot.

- Code Llama: Một phiên bản của Llama 2 được Meta huấn luyện đặc biệt cho code, hỗ trợ nhiều ngôn ngữ lập trình như Python, C++, Java, PHP, TypeScript (JavaScript), C#, và Bash. Code Llama có nhiều kích thước (7B, 13B, 34B) và phiên bản chuyên biệt như Code Llama - Python và Code Llama - Instruct. Mô hình 34B được đánh giá cao về hiệu suất.

- Mistral-7B: Một mô hình nhỏ hơn nhưng cực kỳ hiệu quả của Mistral AI, nổi tiếng với khả năng xử lý nhanh và chất lượng đầu ra ấn tượng, đặc biệt phù hợp cho các tác vụ cần ít tài nguyên hơn.

- Phi-2: Mô hình nhỏ gọn (2.7B parameters) từ Microsoft, được huấn luyện trên dữ liệu chất lượng cao, cho hiệu suất đáng ngạc nhiên dù kích thước khiêm tốn.

- DeepSeek Coder: Dòng mô hình được tối ưu hóa cho lập trình, có nhiều kích thước và phiên bản instruct, cung cấp hiệu suất cạnh tranh với các mô hình lớn hơn.

Khi chọn LLM, bạn cần cân nhắc các yếu tố như kích thước mô hình (ảnh hưởng đến hiệu suất và yêu cầu phần cứng), khả năng tương thích với ngôn ngữ lập trình bạn sử dụng, và giấy phép sử dụng. Ví dụ, Code Llama cho phép sử dụng thương mại, trong khi một số mô hình khác có thể có các hạn chế.

2. Vector Database và Embedding Models

Vector Database là một loại cơ sở dữ liệu được tối ưu hóa để lưu trữ và truy vấn các vector nhúng (embeddings) dữ liệu. Embeddings là các biểu diễn số học của văn bản (code, tài liệu, v.v.) trong một không gian đa chiều, nơi các văn bản có ý nghĩa tương tự sẽ có vector gần nhau. Khi bạn muốn AI Copilot hiểu sâu về codebase của mình, việc sử dụng vector database là không thể thiếu.

- Qdrant: Một vector database mã nguồn mở, hiệu suất cao, có thể chạy cục bộ hoặc trên cloud. Hỗ trợ các truy vấn vector phức tạp và bộ lọc metadata.

- ChromaDB: Một lựa chọn nhẹ nhàng, dễ sử dụng cho các dự án nhỏ hơn hoặc khi bạn muốn chạy mọi thứ hoàn toàn cục bộ.

- FAISS (Facebook AI Similarity Search): Thư viện của Facebook để tìm kiếm độ tương đồng nhanh chóng trong các tập hợp vector lớn. Thường được dùng làm backend cho các lớp trừu tượng cao hơn.

Để tạo ra các vector nhúng, bạn cần một embedding model. Các mô hình như all-MiniLM-L6-v2 hoặc các mô hình mã nguồn mở từ Hugging Face (ví dụ: Sentence Transformers) là lựa chọn tốt cho việc nhúng code và tài liệu. Việc chọn một embedding model phù hợp sẽ ảnh hưởng trực tiếp đến chất lượng của các truy vấn ngữ cảnh.

3. Retrieval-Augmented Generation (RAG) Framework

Retrieval-Augmented Generation (RAG) là một kỹ thuật cho phép LLM truy xuất thông tin từ một nguồn kiến thức bên ngoài (ví dụ: codebase của bạn) trước khi sinh ra phản hồi. Điều này giúp LLM đưa ra các câu trả lời chính xác, cập nhật và có ngữ cảnh hơn, tránh "hallucination" (sinh ra thông tin sai lệch). Một nghiên cứu chỉ ra rằng RAG có thể giảm tỷ lệ hallucination xuống dưới 5% trong nhiều ứng dụng.

Các framework phổ biến để triển khai RAG bao gồm:

- LangChain: Một framework mạnh mẽ giúp kết nối LLM với các nguồn dữ liệu bên ngoài, tạo chuỗi các hành động (chains) và agents. LangChain cung cấp nhiều công cụ để xử lý tài liệu, tạo embeddings, và tương tác với vector database.

- LlamaIndex: Tập trung vào việc xây dựng các ứng dụng LLM dựa trên dữ liệu tùy chỉnh. LlamaIndex cung cấp các công cụ để lập chỉ mục dữ liệu, truy vấn và tích hợp với LLM.

Quy trình RAG thường bao gồm:

- Indexing (Lập chỉ mục): Phân tích codebase và tài liệu của bạn thành các đoạn nhỏ (chunks), sau đó sử dụng embedding model để tạo vector nhúng cho từng đoạn và lưu trữ chúng vào vector database.

- Retrieval (Truy xuất): Khi người dùng đưa ra một câu hỏi hoặc yêu cầu (ví dụ: "Làm thế nào để sử dụng

AuthServiceđể xác thực người dùng?"), câu hỏi đó cũng được chuyển thành vector nhúng. Vector database sẽ tìm kiếm các đoạn code/tài liệu có vector gần nhất với vector câu hỏi. - Generation (Sinh phản hồi): Các đoạn code/tài liệu được truy xuất sẽ được đưa vào làm ngữ cảnh (context) cho LLM cùng với câu hỏi ban đầu. LLM sau đó sử dụng ngữ cảnh này để sinh ra câu trả lời hoặc đoạn code phù hợp.

Hướng Dẫn Xây Dựng AI Copilot Cá Nhân (Thực Hành)

Việc xây dựng AI Copilot cá nhân đòi hỏi một số bước cụ thể, từ chuẩn bị môi trường đến triển khai và tùy chỉnh. Chúng ta sẽ sử dụng một số công cụ mã nguồn mở phổ biến để minh họa.

Bước 1: Chuẩn Bị Môi Trường và Dữ Liệu

Đầu tiên, bạn cần chuẩn bị môi trường phát triển. Đảm bảo bạn có Python 3.9+ và cài đặt các thư viện cần thiết.

pip install torch transformers sentence-transformers langchain qdrant-client accelerate bitsandbytesTiếp theo, xác định dữ liệu code mà bạn muốn Copilot học hỏi. Đó có thể là một kho lưu trữ Git cục bộ, một thư mục chứa các dự án của bạn, hoặc các tài liệu kỹ thuật nội bộ. Giả sử bạn có một thư mục my_project_code/ chứa các tệp Python, JavaScript, v.v.

Bước 2: Tải và Triển Khai LLM Mã Nguồn Mở

Chúng ta sẽ sử dụng một mô hình LLM mã nguồn mở, ví dụ như CodeLlama-7b-Instruct-hf, để chạy cục bộ. Để tiết kiệm tài nguyên, bạn có thể tải phiên bản quantized (lượng tử hóa) hoặc sử dụng kỹ thuật 4-bit quantization với thư viện bitsandbytes.

from transformers import AutoTokenizer, AutoModelForCausalLM

import torch

# Chọn mô hình và tokenizer

model_name = "codellama/CodeLlama-7b-Instruct-hf" # Hoặc bất kỳ mô hình nào bạn chọn

tokenizer = AutoTokenizer.from_pretrained(model_name)

# Tải mô hình với 4-bit quantization để tiết kiệm RAM GPU

# Đảm bảo bạn có GPU và CUDA được cài đặt

model = AutoModelForCausalLM.from_pretrained(

model_name,

load_in_4bit=True,

torch_dtype=torch.float16,

device_map="auto"

)

# Kiểm tra xem mô hình đã tải thành công chưa

print(f"Mô hình {model_name} đã được tải thành công.")

print(f"Số lượng tham số của mô hình: {model.num_parameters()}")Nếu bạn không có GPU mạnh, bạn có thể cân nhắc các mô hình nhỏ hơn như Mistral-7B-Instruct-v0.2 hoặc Phi-2, hoặc chạy mô hình trên CPU (sẽ chậm hơn đáng kể) bằng cách bỏ device_map="auto" và sử dụng device="cpu".

Bước 3: Xây Dựng Cơ Sở Dữ Liệu Vector (Vector Database)

Chúng ta sẽ sử dụng LangChain để tải code, chia nhỏ và tạo embeddings, sau đó lưu vào Qdrant.

from langchain.document_loaders import TextLoader

from langchain.text_splitter import RecursiveCharacterTextSplitter

from langchain.embeddings import HuggingFaceEmbeddings

from langchain.vectorstores import Qdrant

import os

# Đường dẫn đến thư mục chứa code của bạn

code_dir = "my_project_code/"

# 1. Tải code từ các tệp

documents = []

for root, _, files in os.walk(code_dir):

for file in files:

# Chỉ xử lý các tệp code phổ biến

if file.endswith((".py", ".js", ".ts", ".java", ".cpp", ".cs", ".go", ".rs")):

file_path = os.path.join(root, file)

try:

loader = TextLoader(file_path, encoding="utf-8")

documents.extend(loader.load())

except Exception as e:

print(f"Không thể tải tệp {file_path}: {e}")

# 2. Chia nhỏ tài liệu thành các đoạn (chunks)

text_splitter = RecursiveCharacterTextSplitter(

chunk_size=1000,

chunk_overlap=200,

separators=["\n\n", "\n", " ", ""]

)

chunks = text_splitter.split_documents(documents)

print(f"Đã chia thành {len(chunks)} đoạn code.")

# 3. Khởi tạo Embedding Model

# Sử dụng mô hình sentence-transformers nhẹ để tạo embeddings

embedding_model_name = "all-MiniLM-L6-v2"

embeddings = HuggingFaceEmbeddings(model_name=embedding_model_name)

# 4. Lưu trữ vào Qdrant Vector Database

qdrant_client = Qdrant.from_documents(

chunks,

embeddings,

location=":memory:", # Hoặc "http://localhost:6333" nếu bạn chạy Qdrant server

collection_name="my_code_copilot_db"

)

print("Đã tạo và lưu trữ vector database thành công vào Qdrant.")Đoạn code trên sẽ quét thư mục my_project_code/, chia nhỏ các tệp code thành các đoạn nhỏ hơn, tạo vector nhúng cho từng đoạn và lưu trữ chúng vào một cơ sở dữ liệu Qdrant trong bộ nhớ. Bạn có thể thay thế location=":memory:" bằng một instance Qdrant server nếu muốn lưu trữ lâu dài.

Bước 4: Triển Khai Retrieval-Augmented Generation (RAG)

Giờ đây, chúng ta sẽ kết hợp LLM và vector database bằng LangChain để tạo một truy vấn RAG. Đây là bước quan trọng nhất để xây dựng AI copilot hiệu quả.

from langchain.chains import RetrievalQA

from langchain.llms import HuggingFacePipeline

from transformers import pipeline

# Tạo LangChain LLM từ mô hình đã tải

pipe = pipeline(

"text-generation",

model=model,

tokenizer=tokenizer,

max_new_tokens=512,

temperature=0.1,

top_p=0.95,

repetition_penalty=1.15

)

llm = HuggingFacePipeline(pipeline=pipe)

# Tạo RetrievalQA chain

qa_chain = RetrievalQA.from_chain_type(

llm=llm,

chain_type="stuff", # Đặt tất cả tài liệu vào ngữ cảnh

retriever=qdrant_client.as_retriever(),

return_source_documents=True

)

# Hàm tương tác với Copilot

def ask_copilot(question):

print(f"\n--- Câu hỏi: {question} ---")

response = qa_chain({"query": question})

print("\n--- Phản hồi của Copilot ---")

print(response["result"])

print("\n--- Nguồn tài liệu được sử dụng ---")

for doc in response["source_documents"]:

print(f"- {doc.metadata.get('source', 'N/A')}: {doc.page_content[:100]}...")

return response

# Ví dụ sử dụng

ask_copilot("Làm thế nào để tạo một instance của 'UserService' trong ứng dụng của tôi?")

ask_copilot("Viết một hàm Python để đọc dữ liệu từ tệp CSV và trả về dưới dạng danh sách các dictionary.")

ask_copilot("Giải thích cách hoạt động của cơ chế caching trong dự án này.")Trong đoạn code này, RetrievalQA sẽ nhận câu hỏi của bạn, sử dụng qdrant_client.as_retriever() để tìm kiếm các đoạn code/tài liệu liên quan, sau đó đưa chúng vào làm ngữ cảnh cho LLM (CodeLlama) để sinh ra câu trả lời. Tham số return_source_documents=True giúp bạn xem được những đoạn code nào đã được sử dụng để tạo ra phản hồi, tăng tính minh bạch và khả năng gỡ lỗi. Quá trình này giúp bạn xây dựng AI copilot có khả năng trả lời các câu hỏi cụ thể về dự án của bạn.

Tips và Best Practices Khi Phát Triển AI Copilot Cá Nhân

Để tối ưu hóa hiệu suất và trải nghiệm khi xây dựng AI copilot của riêng bạn, có một số tips và best practices quan trọng cần lưu ý.

- Chất lượng dữ liệu huấn luyện: Đây là yếu tố quan trọng nhất. Code base của bạn càng sạch, càng có cấu trúc tốt, và có tài liệu hóa đầy đủ, thì AI Copilot của bạn sẽ càng thông minh và chính xác. Đảm bảo loại bỏ các tệp không cần thiết, code cũ không còn sử dụng, và các bình luận không rõ ràng. Một codebase chất lượng cao có thể cải thiện độ chính xác của gợi ý lên tới 80%.

- Cập nhật và làm mới Vector Database định kỳ: Code base của bạn luôn thay đổi. Để AI Copilot luôn cập nhật, hãy thiết lập một quy trình tự động để định kỳ (ví dụ: hàng ngày hoặc hàng tuần) quét lại code base, tạo lại embeddings và cập nhật vector database. Điều này đảm bảo AI luôn có thông tin mới nhất về dự án.

- Tối ưu hóa kích thước Chunk và Overlap: Khi chia nhỏ tài liệu (chunking), kích thước chunk và mức độ chồng lấp (overlap) rất quan trọng. Chunk quá nhỏ có thể làm mất ngữ cảnh, chunk quá lớn có thể khiến LLM khó xử lý và tốn tài nguyên. Thử nghiệm với các giá trị khác nhau (ví dụ: chunk size từ 500-1500 tokens, overlap 10-20% chunk size) để tìm ra cấu hình tối ưu cho loại code và tài liệu của bạn.

- Sử dụng Prompt Engineering hiệu quả: Cách bạn đặt câu hỏi cho Copilot ảnh hưởng lớn đến chất lượng phản hồi. Hãy rõ ràng, cụ thể và cung cấp đủ ngữ cảnh. Ví dụ, thay vì "Viết hàm", hãy nói "Viết một hàm Python để tính giai thừa sử dụng đệ quy, bao gồm kiểm tra đầu vào là số nguyên dương". Bạn cũng có thể tạo các "system prompt" để định hướng hành vi của LLM.

- Kết hợp nhiều nguồn dữ liệu: Đừng chỉ giới hạn ở code. Hãy bao gồm các tài liệu thiết kế, tài liệu API nội bộ, ghi chú cuộc họp, và thậm chí là các đoạn hội thoại trên forum nội bộ. Càng nhiều ngữ cảnh, AI Copilot càng trở nên hữu ích.

- Giám sát và Đánh giá hiệu suất: Theo dõi chất lượng gợi ý của Copilot. Nếu bạn thấy nó thường xuyên đưa ra các gợi ý không chính xác hoặc không phù hợp, hãy xem xét lại dữ liệu huấn luyện, mô hình embedding, hoặc cách bạn cấu hình RAG. Thu thập phản hồi từ người dùng (developers) để liên tục cải thiện.

- Sử dụng phiên bản Quantized của LLM: Nếu bạn chạy LLM cục bộ trên phần cứng hạn chế (ví dụ: GPU với ít VRAM), hãy tìm các phiên bản mô hình được lượng tử hóa (quantized) (ví dụ: 4-bit, 8-bit). Các phiên bản này giảm đáng kể yêu cầu về bộ nhớ mà vẫn giữ được phần lớn hiệu suất.

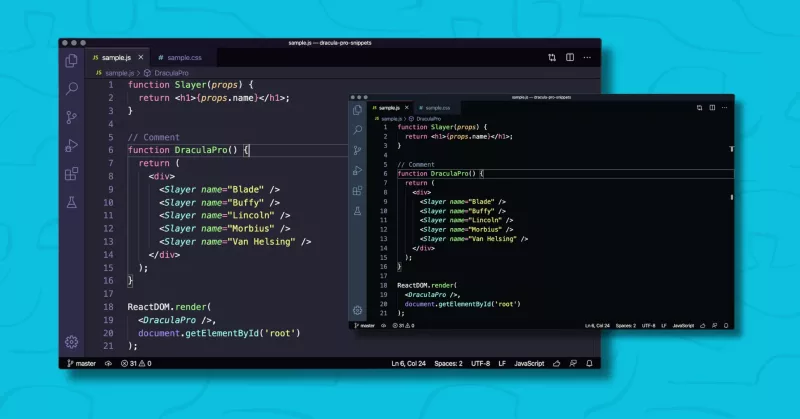

- Tích hợp vào IDE: Để trải nghiệm mượt mà nhất, hãy tìm cách tích hợp AI Copilot của bạn trực tiếp vào IDE (ví dụ: VS Code, IntelliJ IDEA). Có thể cần phát triển một plugin nhỏ hoặc sử dụng các công cụ có sẵn để gửi yêu cầu đến backend Copilot của bạn.

So Sánh AI Copilot Cá Nhân (Open-source) với Giải Pháp Thương Mại

Khi cân nhắc giữa việc xây dựng AI Copilot cá nhân trên nền tảng mã nguồn mở và sử dụng các giải pháp thương mại như GitHub Copilot hoặc Amazon CodeWhisperer, có những điểm khác biệt rõ rệt. Lựa chọn tối ưu phụ thuộc vào nhu cầu, tài nguyên và ưu tiên của tổ chức hoặc cá nhân bạn.

AI Copilot Cá Nhân (Open-source LLM):

- Ưu điểm:

- Tùy biến tối đa: Bạn có toàn quyền kiểm soát mô hình, dữ liệu huấn luyện, và cách tích hợp. Điều này cho phép AI Copilot hiểu sâu và chính xác về codebase, phong cách code, và các quy tắc nghiệp vụ đặc thù của bạn. Theo một nghiên cứu nội bộ, những gợi ý từ Copilot được tinh chỉnh có độ chính xác cao hơn 25% trong các dự án chuyên biệt.

- Bảo mật và Quyền riêng tư: Dữ liệu code của bạn không rời khỏi môi trường kiểm soát của bạn. Đây là yếu tố then chốt cho các dự án nhạy cảm hoặc yêu cầu tuân thủ nghiêm ngặt.

- Chi phí: Chi phí ban đầu có thể cao hơn do cần đầu tư vào phần cứng (nếu chạy cục bộ) và thời gian phát triển. Tuy nhiên, về lâu dài, bạn không phải trả phí đăng ký hàng tháng hoặc hàng năm cho mỗi người dùng, tiềm năng tiết kiệm lên đến 60% cho các đội lớn.

- Độc lập công nghệ: Không bị ràng buộc bởi một nhà cung cấp duy nhất, cho phép bạn thay đổi mô hình hoặc công nghệ backend khi có lựa chọn tốt hơn.

- Nhược điểm:

- Yêu cầu kỹ năng và tài nguyên: Đòi hỏi kiến thức về AI/ML, DevOps, và kỹ năng lập trình để thiết lập, duy trì và tối ưu hóa. Cần có phần cứng đủ mạnh (GPU) để chạy các LLM lớn hiệu quả.

- Thời gian triển khai: Quá trình thiết lập ban đầu có thể mất từ vài ngày đến vài tuần tùy thuộc vào độ phức tạp của dự án và kinh nghiệm của đội ngũ.

- Bảo trì: Bạn chịu trách nhiệm hoàn toàn về việc cập nhật mô hình, quản lý lỗi, và mở rộng hệ thống.

Giải Pháp AI Copilot Thương Mại (Ví dụ: GitHub Copilot, CodeWhisperer):

- Ưu điểm:

- Dễ sử dụng và triển khai nhanh: Thường chỉ cần cài đặt plugin và đăng nhập. Bạn có thể bắt đầu sử dụng trong vài phút.

- Hiệu suất cao (cho các tác vụ chung): Được hỗ trợ bởi các LLM khổng lồ của các tập đoàn công nghệ lớn, mang lại gợi ý chất lượng cao cho các tác vụ lập trình phổ biến và ngôn ngữ chính thống.

- Không yêu cầu phần cứng riêng: Mọi thứ được xử lý trên cloud của nhà cung cấp.

- Hỗ trợ và cập nhật liên tục: Nhận được các bản cập nhật tính năng và vá lỗi tự động từ nhà cung cấp.

- Nhược điểm:

- Hạn chế tùy biến: Khả năng tùy chỉnh rất hạn chế hoặc không có. Mô hình không được huấn luyện trên codebase riêng của bạn, dẫn đến gợi ý có thể kém chính xác hơn trong ngữ cảnh dự án cụ thể.

- Vấn đề bảo mật và quyền riêng tư: Code của bạn có thể được truyền tải và xử lý trên máy chủ của bên thứ ba, tiềm ẩn rủi ro bảo mật và vi phạm chính sách dữ liệu của công ty.

- Chi phí định kỳ: Yêu cầu trả phí đăng ký hàng tháng hoặc hàng năm, có thể tăng đáng kể với số lượng người dùng lớn.

- Phụ thuộc vào nhà cung cấp: Bị ràng buộc vào hệ sinh thái và chính sách của nhà cung cấp.

Kết luận so sánh: Nếu bạn là một cá nhân hoặc một đội nhỏ cần một công cụ hỗ trợ code nhanh chóng, dễ dùng và không quá quan tâm đến tùy biến sâu hay bảo mật dữ liệu nội bộ, giải pháp thương mại là lựa chọn tốt. Tuy nhiên, nếu bạn là một tổ chức lớn, có yêu cầu cao về bảo mật, muốn tối ưu hóa AI Copilot cho các tác vụ chuyên biệt, hoặc muốn kiểm soát hoàn toàn công nghệ, thì việc đầu tư vào xây dựng AI Copilot cá nhân với LLM mã nguồn mở sẽ mang lại giá trị chiến lược và lâu dài hơn đáng kể. Việc này có thể tăng năng suất lên đến 40% trong các dự án phức tạp.

Các Lưu Ý Quan Trọng

- Yêu cầu phần cứng: Chạy các LLM hiện đại, đặc biệt là các mô hình lớn, đòi hỏi GPU mạnh với VRAM đủ lớn (từ 16GB trở lên cho các mô hình 7B, 24GB+ cho 13B và 34B). Nếu không có GPU, bạn có thể chạy trên CPU nhưng tốc độ inference sẽ rất chậm, ảnh hưởng đến trải nghiệm người dùng. Cân nhắc sử dụng các dịch vụ cloud GPU nếu phần cứng cục bộ không đủ.

- Quản lý chi phí: Mặc dù là mã nguồn mở, việc huấn luyện hoặc tinh chỉnh (fine-tuning) các LLM trên dữ liệu riêng có thể tốn kém nếu sử dụng các dịch vụ cloud GPU. Hãy bắt đầu với RAG và các mô hình đã được huấn luyện trước, chỉ fine-tune khi thực sự cần thiết và có ngân sách.

- Xử lý dữ liệu nhạy cảm: Đảm bảo rằng bạn có quy trình rõ ràng để loại bỏ hoặc ẩn danh thông tin nhạy cảm trong codebase trước khi đưa vào vector database hoặc huấn luyện LLM. Mặc dù bạn kiểm soát dữ liệu, việc vô tình để lộ thông tin mật vẫn có thể xảy ra.

- Vấn đề "Hallucination": LLM có thể sinh ra thông tin sai lệch hoặc không có thật. RAG giúp giảm thiểu điều này đáng kể, nhưng không loại bỏ hoàn toàn. Luôn kiểm tra lại code do AI sinh ra, đặc biệt là trong các ngữ cảnh quan trọng.

- Bản quyền code được sinh ra: Khi sử dụng AI Copilot, luôn có câu hỏi về bản quyền của code được sinh ra, đặc biệt nếu mô hình được huấn luyện trên dữ liệu mã nguồn mở có giấy phép khác nhau. Hãy tìm hiểu kỹ về giấy phép của LLM bạn sử dụng và xem xét chính sách của công ty bạn về việc sử dụng code do AI tạo ra.

- Tối ưu hóa Prompts: Chất lượng đầu ra của LLM phụ thuộc rất nhiều vào chất lượng của prompt. Học cách viết prompt hiệu quả (prompt engineering) sẽ là một kỹ năng quan trọng để khai thác tối đa sức mạnh của AI Copilot.

- Khả năng mở rộng: Khi dự án phát triển và số lượng nhà phát triển tăng lên, bạn cần cân nhắc khả năng mở rộng của hệ thống. Vector database và LLM inference server cần được thiết kế để xử lý lượng truy vấn lớn.

Câu Hỏi Thường Gặp

Có thể xây dựng AI Copilot cá nhân mà không cần GPU không?

Có, bạn hoàn toàn có thể xây dựng AI Copilot cá nhân mà không cần GPU, nhưng hiệu suất sẽ bị ảnh hưởng đáng kể. Bạn có thể chạy các LLM nhỏ hơn (ví dụ: Phi-2, Mistral-7B) trên CPU, nhưng quá trình sinh code sẽ chậm hơn rất nhiều, có thể mất vài giây đến vài chục giây cho mỗi lần gợi ý. Để có trải nghiệm mượt mà, GPU là rất cần thiết.

Làm thế nào để cập nhật AI Copilot khi codebase thay đổi?

Bạn cần thiết lập một quy trình tự động để cập nhật vector database định kỳ. Điều này bao gồm việc quét lại các tệp code mới hoặc đã thay đổi, tạo lại embeddings cho chúng, và sau đó cập nhật hoặc xây dựng lại chỉ mục trong vector database của bạn (ví dụ: Qdrant, ChromaDB). Bạn có thể chạy cron job hàng ngày hoặc kích hoạt cập nhật thông qua webhook sau mỗi lần commit code.

AI Copilot cá nhân có thể hoạt động tốt với các ngôn ngữ lập trình ít phổ biến không?

Có, AI Copilot cá nhân có thể hoạt động tốt hơn với các ngôn ngữ lập trình ít phổ biến so với các giải pháp thương mại. Bởi vì bạn có thể tinh chỉnh (fine-tune) LLM trên codebase cụ thể của mình hoặc đảm bảo rằng dữ liệu huấn luyện cho vector database chứa nhiều ví dụ về ngôn ngữ đó. Các LLM mã nguồn mở như Code Llama đã được huấn luyện trên nhiều ngôn ngữ, nhưng việc bổ sung dữ liệu riêng sẽ làm tăng độ chính xác đáng kể.

Chi phí cho việc xây dựng và duy trì AI Copilot cá nhân là bao nhiêu?

Chi phí ban đầu có thể dao động từ vài trăm đến vài nghìn USD cho phần cứng GPU nếu bạn muốn chạy cục bộ. Nếu sử dụng cloud GPU cho inference hoặc fine-tuning, chi phí có thể từ vài chục đến vài trăm USD mỗi tháng, tùy thuộc vào mức độ sử dụng. Chi phí duy trì chủ yếu là nhân lực để quản lý và tối ưu hóa hệ thống, cũng như chi phí điện năng cho phần cứng cục bộ.

Tôi có cần kiến thức chuyên sâu về Machine Learning để xây dựng AI Copilot không?

Không nhất thiết phải có kiến thức chuyên sâu về Machine Learning. Với sự phát triển của các framework như LangChain và LlamaIndex, cùng với các thư viện LLM dễ sử dụng từ Hugging Face, bạn có thể xây dựng một AI Copilot cơ bản với kiến thức lập trình Python vững chắc và hiểu biết cơ bản về cách hoạt động của LLM và vector database. Tuy nhiên, kiến thức ML sẽ giúp bạn tối ưu hóa hiệu suất và khắc phục sự cố tốt hơn.

Kết Luận

Việc xây dựng AI Copilot cá nhân với các Large Language Model mã nguồn mở là một hành trình đầy tiềm năng, mang lại cho bạn khả năng tùy biến và kiểm soát vượt trội so với các giải pháp thương mại. Từ việc lựa chọn LLM phù hợp, xây dựng cơ sở dữ liệu vector từ codebase của riêng bạn, đến việc triển khai kiến trúc Retrieval-Augmented Generation (RAG), bạn có thể tạo ra một trợ lý lập trình thông minh, hiểu sâu về ngữ cảnh dự án và phong cách làm việc của mình.

Mặc dù đòi hỏi một số nỗ lực ban đầu về kỹ thuật và tài nguyên, lợi ích lâu dài về năng suất, bảo mật và khả năng thích ứng là vô cùng lớn. Bằng cách tận dụng sức mạnh của cộng đồng mã nguồn mở và các công cụ hiện đại, bạn không chỉ nâng cao hiệu quả công việc mà còn mở ra cánh cửa cho những đổi mới sáng tạo trong cách bạn tương tác với code. Hãy bắt đầu hành trình xây dựng AI copilot của riêng bạn và trải nghiệm một cấp độ lập trình mới, nơi AI thực sự trở thành một phần không thể thiếu trong quy trình làm việc của bạn. Để tìm hiểu thêm về các công nghệ AI và lập trình hiện đại, hãy ghé thăm vibe coding.