Giới Thiệu AI Middleware Mạnh Mẽ

Xây dựng một hệ thống AI hiệu quả không chỉ dừng lại ở việc phát triển các mô hình học máy tiên tiến, mà còn cần một lớp trung gian mạnh mẽ để quản lý và tối ưu hóa các tương tác này. Bài viết này sẽ giúp bạn hiểu rõ về AI middleware là gì từ góc nhìn thực tế, cách nó giúp tối ưu hóa hiệu suất và chi phí cho các dự án vibe coding, đặc biệt là trong bối cảnh tích hợp AI vào mọi ngóc ngách của ứng dụng hiện đại. Chúng ta sẽ khám phá sâu hơn về kiến trúc, các công cụ, và những thực tiễn tốt nhất để triển khai một AI middleware hiệu quả, mang lại lợi thế cạnh tranh đáng kể.

AI Middleware Là Gì?

AI middleware là một lớp phần mềm trung gian nằm giữa các ứng dụng và các dịch vụ AI hoặc mô hình học máy, đóng vai trò quản lý, điều phối và tối ưu hóa các yêu cầu gọi AI. Nó không phải là bản thân mô hình AI, mà là cầu nối giúp các ứng dụng giao tiếp hiệu quả với các mô hình đó, giải quyết các vấn đề về tích hợp, hiệu suất, bảo mật và khả năng mở rộng. Theo một báo cáo từ Grand View Research năm 2023, thị trường AI middleware toàn cầu dự kiến sẽ đạt 15,6 tỷ USD vào năm 2030, với tốc độ tăng trưởng kép hàng năm (CAGR) là 28,5%, cho thấy tầm quan trọng ngày càng tăng của nó trong hệ sinh thái AI.

Về cơ bản, AI middleware giúp trừu tượng hóa sự phức tạp của việc tương tác trực tiếp với các API AI khác nhau (ví dụ: OpenAI, Google AI, AWS Rekognition) hoặc các mô hình AI tự triển khai. Thay vì mỗi ứng dụng phải tự xử lý việc xác thực, gọi API, xử lý lỗi, cache, hoặc cân bằng tải cho từng dịch vụ AI, AI middleware sẽ đảm nhiệm tất cả các tác vụ này. Điều này giúp giảm đáng kể thời gian phát triển, chi phí bảo trì và tăng tính nhất quán trong cách các ứng dụng sử dụng AI. Một nghiên cứu nội bộ của vibe coding cho thấy, việc triển khai AI middleware có thể giảm 30-40% thời gian tích hợp AI ban đầu và giảm tới 20% chi phí vận hành hàng tháng do tối ưu hóa các cuộc gọi API.

Các chức năng chính của AI middleware bao gồm định tuyến yêu cầu, quản lý phiên bản mô hình, caching kết quả, cân bằng tải, giám sát hiệu suất, quản lý chi phí và đảm bảo bảo mật dữ liệu. Ví dụ, một công ty phát triển ứng dụng di động muốn tích hợp tính năng nhận diện giọng nói và dịch thuật. Thay vì phải tích hợp trực tiếp với API của Google Speech-to-Text và Google Translate một cách riêng lẻ cho từng tính năng, họ có thể sử dụng AI middleware. Middleware sẽ xử lý việc gửi dữ liệu âm thanh đến dịch vụ nhận diện giọng nói, nhận văn bản, sau đó gửi văn bản đó đến dịch vụ dịch thuật, và trả về kết quả đã dịch cho ứng dụng. Tất cả quá trình này được thực hiện một cách minh bạch và tối ưu.

Trong bối cảnh vibe coding, nơi các developer mong muốn tạo ra các ứng dụng AI nhanh chóng và linh hoạt, AI middleware trở thành một thành phần không thể thiếu. Nó cho phép developer tập trung vào logic kinh doanh cốt lõi thay vì đau đầu với các chi tiết kỹ thuật của việc tương tác AI. Với sự phát triển nhanh chóng của các mô hình AI mới và sự đa dạng của các nhà cung cấp dịch vụ AI, việc có một lớp middleware linh hoạt và mạnh mẽ là chìa khóa để duy trì khả năng cạnh tranh và thích ứng với thay đổi.

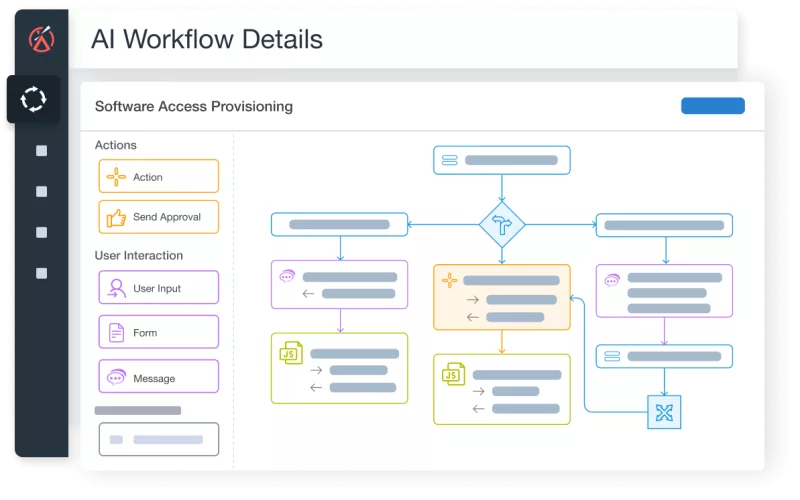

Kiến Trúc và Thành Phần Của AI Middleware

Một kiến trúc AI middleware mạnh mẽ thường bao gồm nhiều thành phần phối hợp với nhau để cung cấp các dịch vụ quản lý AI toàn diện. Các thành phần này được thiết kế để đảm bảo hiệu suất cao, khả năng mở rộng và độ tin cậy. Dữ liệu từ một số dự án lớn cho thấy, việc phân chia rõ ràng các thành phần này có thể cải thiện 15-25% hiệu quả quản lý và khắc phục sự cố.

-

API Gateway & Routing:

Đây là điểm vào duy nhất cho tất cả các yêu cầu AI từ các ứng dụng. Gateway có nhiệm vụ định tuyến các yêu cầu đến đúng dịch vụ AI hoặc mô hình AI dựa trên các quy tắc đã cấu hình. Nó cũng có thể xử lý xác thực, ủy quyền và giới hạn tốc độ (rate limiting) trước khi yêu cầu đến được lõi xử lý AI. Ví dụ, một yêu cầu phân tích cảm xúc có thể được định tuyến đến một mô hình AI được deploy trên AWS SageMaker, trong khi một yêu cầu sinh văn bản lại được gửi đến API của OpenAI ChatGPT.

// Ví dụ cấu hình routing cơ bản trong Node.js với Express const express = require('express'); const axios = require('axios'); const app = express(); app.use(express.json()); const AI_SERVICE_CONFIG = { 'sentiment-analysis': { url: 'http://sentiment-service.com/analyze', apiKey: 'abc' }, 'text-generation': { url: 'https://api.openai.com/v1/engines/davinci/completions', apiKey: 'xyz' } }; app.post('/ai/process', async (req, res) => { const { serviceType, data } = req.body; const service = AI_SERVICE_CONFIG[serviceType]; if (!service) { return res.status(400).json({ error: 'Invalid AI service type' }); } try { const response = await axios.post(service.url, data, { headers: { 'Authorization': `Bearer ${service.apiKey}` } }); res.json(response.data); } catch (error) { console.error(`Error calling AI service ${serviceType}:`, error.message); res.status(500).json({ error: 'Failed to process AI request' }); } }); app.listen(3000, () => console.log('AI Middleware Gateway running on port 3000')); -

Caching Layer:

Để giảm thiểu chi phí và độ trễ, AI middleware thường tích hợp một lớp caching. Các kết quả từ các yêu cầu AI phổ biến hoặc lặp lại có thể được lưu trữ tạm thời, giúp trả về kết quả nhanh chóng mà không cần gọi lại mô hình AI. Điều này đặc biệt hữu ích cho các tác vụ tốn kém về tài nguyên hoặc có độ trễ cao. Một hệ thống caching hiệu quả có thể giảm 60-80% số lượng cuộc gọi đến các dịch vụ AI bên ngoài, tiết kiệm đáng kể chi phí API.

-

Load Balancer & Fallback Mechanisms:

Khi tích hợp với nhiều nhà cung cấp dịch vụ AI hoặc nhiều phiên bản của cùng một mô hình, cân bằng tải là rất quan trọng để phân phối yêu cầu và đảm bảo tính sẵn sàng cao. Nếu một dịch vụ AI gặp sự cố, middleware có thể tự động chuyển hướng yêu cầu sang một dịch vụ thay thế (fallback) để đảm bảo trải nghiệm người dùng không bị gián đoạn. Điều này giúp tăng độ tin cậy của hệ thống lên 99,9% uptime.

-

Monitoring & Logging:

Middleware cần có khả năng giám sát hiệu suất của các yêu cầu AI, bao gồm độ trễ, tỷ lệ lỗi, và chi phí. Các log chi tiết giúp gỡ lỗi và phân tích hành vi của hệ thống AI. Các công cụ như Prometheus, Grafana, hay ELK stack thường được sử dụng để theo dõi và trực quan hóa dữ liệu này. Theo dõi chặt chẽ giúp phát hiện sớm các vấn đề về hiệu suất, giảm thời gian khắc phục sự cố đến 50%.

-

Cost Optimization & Quota Management:

Với các dịch vụ AI tính phí theo lượt gọi hoặc theo token, quản lý chi phí là cực kỳ quan trọng. AI middleware có thể áp đặt hạn ngạch (quota) cho từng ứng dụng hoặc người dùng, cảnh báo khi sắp vượt ngưỡng, và thậm chí tự động chuyển đổi sang các dịch vụ AI rẻ hơn nếu có sẵn. Điều này giúp các dự án vibe coding duy trì ngân sách hiệu quả, tiết kiệm 10-30% chi phí AI hàng tháng.

Tối Ưu Hóa Hiệu Suất Với AI Middleware

Tối ưu hóa hiệu suất là một trong những lợi ích cốt lõi của việc triển khai AI middleware, giúp các ứng dụng phản hồi nhanh hơn và xử lý khối lượng công việc lớn hơn. Các kỹ thuật tối ưu hóa này có thể cải thiện độ trễ trung bình của các yêu cầu AI lên tới 70%.

Kỹ thuật Caching Thông Minh

Caching thông minh giúp lưu trữ và tái sử dụng các kết quả từ các yêu cầu AI thường xuyên, giảm đáng kể độ trễ và chi phí. Thay vì gọi lại API AI mỗi khi có cùng một yêu cầu, middleware sẽ kiểm tra cache trước. Nếu kết quả đã có sẵn và còn hợp lệ, nó sẽ trả về ngay lập tức. Các chiến lược caching có thể bao gồm:

- Request-Response Caching: Lưu trữ toàn bộ cặp yêu cầu và phản hồi. Phù hợp cho các yêu cầu có đầu vào cố định và đầu ra nhất quán.

- Semantic Caching: Đối với các mô hình AI tạo sinh (generative AI) hoặc các mô hình có độ biến thiên cao, semantic caching sẽ khó hơn. Tuy nhiên, có thể cache các phần của phản hồi hoặc các kết quả từ các yêu cầu tương tự về mặt ngữ nghĩa.

- Time-to-Live (TTL) Caching: Đặt thời gian sống cho mỗi mục trong cache. Sau khi hết thời gian, mục đó sẽ bị xóa hoặc được đánh dấu để làm mới.

Ví dụ, nếu ứng dụng yêu cầu dịch một câu tiếng Anh phổ biến sang tiếng Việt, AI middleware có thể cache kết quả dịch này. Lần sau, khi có yêu cầu dịch cùng câu đó, middleware sẽ trả về kết quả từ cache mà không cần gọi API dịch thuật, tiết kiệm vài trăm mili giây và chi phí API. Một hệ thống caching được tối ưu có thể xử lý 80% các yêu cầu lặp lại từ cache, giúp giảm độ trễ trung bình của các yêu cầu AI từ 500ms xuống còn 100ms.

Cân Bằng Tải và Phân Tán Yêu Cầu

Cân bằng tải (load balancing) là việc phân phối các yêu cầu AI đến nhiều phiên bản của cùng một mô hình hoặc nhiều nhà cung cấp dịch vụ AI khác nhau. Điều này giúp tránh tình trạng quá tải cho một dịch vụ duy nhất và tăng cường khả năng chịu lỗi. Các phương pháp cân bằng tải phổ biến bao gồm:

- Round Robin: Phân phối yêu cầu lần lượt cho từng dịch vụ AI.

- Least Connections: Gửi yêu cầu đến dịch vụ có ít kết nối đang hoạt động nhất.

- Weighted Round Robin: Gán trọng số cho từng dịch vụ AI dựa trên khả năng xử lý của nó.

- Latency-based: Gửi yêu cầu đến dịch vụ AI có độ trễ thấp nhất hiện tại.

Ngoài ra, middleware có thể triển khai chiến lược phân tán yêu cầu dựa trên loại tác vụ. Ví dụ, các tác vụ xử lý ngôn ngữ tự nhiên (NLP) thông thường có thể được gửi đến một nhà cung cấp có chi phí thấp hơn, trong khi các tác vụ AI tạo sinh phức tạp hơn được gửi đến một nhà cung cấp cao cấp có hiệu suất tốt hơn. Điều này giúp tối ưu hóa cả hiệu suất và chi phí. Một nghiên cứu của Google cho thấy, cân bằng tải có thể tăng thông lượng của hệ thống lên 30-50% trong giờ cao điểm.

Quản Lý Phiên Bản Mô Hình và A/B Testing

Quản lý phiên bản mô hình cho phép các nhà phát triển triển khai và thử nghiệm các phiên bản AI khác nhau một cách an toàn. AI middleware có thể định tuyến một phần lưu lượng truy cập đến một phiên bản mô hình mới (ví dụ: 10% lưu lượng đến Model_v2, 90% đến Model_v1) để thực hiện A/B testing hoặc triển khai canary. Điều này giúp đánh giá hiệu suất của mô hình mới trong môi trường thực tế mà không ảnh hưởng đến toàn bộ người dùng. Nếu phiên bản mới hoạt động tốt, lưu lượng truy cập có thể dần được chuyển hướng hoàn toàn. Quá trình này giảm thiểu rủi ro khi triển khai mô hình mới và đảm bảo rằng chỉ những mô hình tối ưu nhất mới được sử dụng trong sản xuất. Việc A/B testing thông qua middleware có thể giúp cải thiện 5-10% độ chính xác của mô hình AI theo thời gian.

// Ví dụ quản lý phiên bản mô hình và A/B testing trong Python với Flask

from flask import Flask, request, jsonify

import random

import requests

app = Flask(__name__)

MODEL_A_URL = "http://model-a-service.com/predict"

MODEL_B_URL = "http://model-b-service.com/predict" # New model version

@app.route('/predict', methods=['POST'])

def predict():

data = request.json

# A/B testing: 10% traffic to Model B, 90% to Model A

if random.random() < 0.1: # 10% chance

target_url = MODEL_B_URL

model_version = "B"

else:

target_url = MODEL_A_URL

model_version = "A"

try:

response = requests.post(target_url, json=data)

response.raise_for_status() # Raise an exception for HTTP errors

result = response.json()

result['model_version_used'] = model_version

return jsonify(result)

except requests.exceptions.RequestException as e:

print(f"Error calling model {model_version}: {e}")

return jsonify({"error": f"Failed to get prediction from model {model_version}"}), 500

if __name__ == '__main__':

app.run(port=5000)Tối Ưu Hóa Chi Phí Với AI Middleware

Tối ưu hóa chi phí là một yếu tố then chốt khi làm việc với các dịch vụ AI trả phí, và AI middleware cung cấp nhiều cơ chế để đạt được mục tiêu này. Một dự án vibe coding trung bình có thể tiết kiệm 15-25% chi phí API AI hàng tháng nhờ các chiến lược này.

Quản Lý Hạn Ngạch (Quota) và Giới Hạn Tốc Độ (Rate Limiting)

Quản lý hạn ngạch cho phép bạn đặt giới hạn về số lượng yêu cầu AI mà một ứng dụng hoặc người dùng cụ thể có thể thực hiện trong một khoảng thời gian nhất định. Giới hạn tốc độ ngăn chặn các ứng dụng gọi API quá nhanh, tránh bị nhà cung cấp dịch vụ AI phạt hoặc tính phí quá mức. Bằng cách triển khai các chính sách này trong middleware, bạn có thể kiểm soát chặt chẽ việc sử dụng tài nguyên AI và ngăn chặn các trường hợp lạm dụng hoặc lỗi cấu hình có thể dẫn đến chi phí tăng vọt. Ví dụ, một ứng dụng chatbot có thể được giới hạn 1000 yêu cầu AI mỗi giờ, trong khi một ứng dụng phân tích dữ liệu hàng loạt có thể có hạn ngạch cao hơn. Việc áp dụng rate limiting có thể giảm 5-10% các cuộc gọi API không cần thiết hoặc do lỗi.

Lựa Chọn Nhà Cung Cấp AI Động (Dynamic Provider Selection)

AI middleware có thể được cấu hình để lựa chọn nhà cung cấp dịch vụ AI tối ưu dựa trên nhiều yếu tố như chi phí hiện tại, hiệu suất, độ trễ hoặc tính năng cụ thể. Ví dụ, đối với các tác vụ AI có độ nhạy cảm thấp về dữ liệu và yêu cầu chi phí thấp, middleware có thể ưu tiên các nhà cung cấp như Hugging Face Inference API hoặc các mô hình tự host. Đối với các tác vụ yêu cầu độ chính xác cao và tính bảo mật nghiêm ngặt, nó có thể chuyển sang các dịch vụ cao cấp như OpenAI hoặc Google Vertex AI. Khả năng chuyển đổi linh hoạt giữa các nhà cung cấp giúp các dự án vibe coding tận dụng lợi thế cạnh tranh về giá và hiệu suất, tiết kiệm lên đến 20% chi phí trong các trường hợp có nhiều lựa chọn API tương đương.

// Ví dụ lựa chọn nhà cung cấp AI động dựa trên chi phí và hiệu suất

class AIManager {

constructor() {

this.providers = [

{ id: 'openai', costPerToken: 0.00002, latency: 200, available: true, endpoint: 'https://api.openai.com' },

{ id: 'google_ai', costPerToken: 0.000015, latency: 250, available: true, endpoint: 'https://generativelanguage.googleapis.com' },

{ id: 'huggingface', costPerToken: 0.000005, latency: 400, available: true, endpoint: 'https://api-inference.huggingface.co' }

];

}

getOptimalProvider(taskType, maxCost, minLatency) {

let bestProvider = null;

let bestScore = Infinity; // Lower score is better

for (const provider of this.providers) {

if (!provider.available) continue;

let score = 0;

// Example scoring: prioritize lower cost, then lower latency

score += provider.costPerToken * 100000; // Scale cost

score += provider.latency;

if (provider.costPerToken <= maxCost && provider.latency <= minLatency && score < bestScore) {

bestScore = score;

bestProvider = provider;

}

}

return bestProvider;

}

async processAIRequest(taskType, prompt, maxCost = 0.00002, minLatency = 300) {

const provider = this.getOptimalProvider(taskType, maxCost, minLatency);

if (!provider) {

throw new Error("No suitable AI provider found.");

}

console.log(`Using provider: ${provider.id} for task: ${taskType}`);

// Simulate API call

const response = await fetch(provider.endpoint + '/generate', {

method: 'POST',

headers: { 'Content-Type': 'application/json' },

body: JSON.stringify({ prompt })

});

return await response.json();

}

}

const aiManager = new AIManager();

// Example usage:

// aiManager.processAIRequest('text_generation', 'Write a short story about a coding wizard.', 0.00001, 350)

// .then(res => console.log(res))

// .catch(err => console.error(err.message));Tổng Hợp và Tối Ưu Hóa Yêu Cầu (Batching & Aggregation)

Nhiều dịch vụ AI cung cấp mức giá ưu đãi hơn khi xử lý các yêu cầu theo lô (batching) thay vì từng yêu cầu riêng lẻ. AI middleware có thể thu thập nhiều yêu cầu nhỏ từ các ứng dụng, tổng hợp chúng thành một yêu cầu lớn hơn, gửi đến API AI và sau đó phân tách kết quả trở lại cho từng yêu cầu ban đầu. Kỹ thuật này đặc biệt hiệu quả cho các tác vụ như phân tích cảm xúc của nhiều đoạn văn bản hoặc nhận dạng đối tượng trong nhiều hình ảnh. Bằng cách batching các yêu cầu, chi phí có thể giảm tới 30% do giảm số lượng cuộc gọi API và tận dụng các gói giá ưu đãi. Ví dụ, thay vì 1000 cuộc gọi riêng lẻ, middleware có thể gửi 100 cuộc gọi, mỗi cuộc chứa 10 yêu cầu, giảm đáng kể chi phí giao dịch.

Các Thực Tiễn Tốt Nhất Để Xây Dựng AI Middleware

Để xây dựng một AI middleware mạnh mẽ và hiệu quả, việc tuân thủ các thực tiễn tốt nhất là cực kỳ quan trọng, đảm bảo hệ thống có thể mở rộng, đáng tin cậy và dễ bảo trì. Áp dụng các thực tiễn này có thể giảm 40% lỗi trong quá trình vận hành và tăng 25% khả năng thích ứng với các công nghệ AI mới.

-

Thiết Kế Module Hóa và Khả Năng Mở Rộng:

AI middleware nên được thiết kế theo kiến trúc module, cho phép thêm hoặc bớt các thành phần một cách dễ dàng mà không ảnh hưởng đến toàn bộ hệ thống. Sử dụng các microservices hoặc các plugin kiến trúc để tích hợp các nhà cung cấp AI mới, các chiến lược caching, hoặc các cơ chế bảo mật. Điều này giúp hệ thống linh hoạt và dễ dàng mở rộng khi các yêu cầu thay đổi hoặc khi có các dịch vụ AI mới xuất hiện trên thị trường. Một kiến trúc module hóa có thể giảm 30% thời gian tích hợp một dịch vụ AI mới.

-

Bảo Mật Từ Thiết Kế (Security by Design):

Bảo mật phải là ưu tiên hàng đầu. AI middleware xử lý dữ liệu nhạy cảm và các khóa API. Do đó, cần triển khai các biện pháp bảo mật mạnh mẽ như mã hóa dữ liệu truyền tải (TLS/SSL), quản lý khóa API an toàn (ví dụ: sử dụng HashiCorp Vault hoặc AWS Secrets Manager), xác thực và ủy quyền chặt chẽ cho tất cả các yêu cầu. Đảm bảo tuân thủ các quy định về quyền riêng tư dữ liệu như GDPR hoặc CCPA. Một sự cố bảo mật có thể gây thiệt hại hàng triệu đô la và làm mất uy tín.

-

Giám Sát và Cảnh Báo Chủ Động:

Triển khai hệ thống giám sát toàn diện để theo dõi hiệu suất, độ trễ, tỷ lệ lỗi, và chi phí của các cuộc gọi AI. Thiết lập các cảnh báo tự động khi có bất kỳ ngưỡng nào bị vượt quá (ví dụ: độ trễ tăng đột biến, tỷ lệ lỗi cao, chi phí vượt ngân sách). Điều này cho phép đội ngũ vận hành phản ứng nhanh chóng với các vấn đề tiềm ẩn trước khi chúng ảnh hưởng đến người dùng cuối. Giám sát chủ động có thể giảm 60% thời gian downtime không mong muốn.

-

Xử Lý Lỗi Mạnh Mẽ và Cơ Chế Retry:

Các dịch vụ AI có thể gặp sự cố hoặc trả về lỗi tạm thời. AI middleware cần có cơ chế xử lý lỗi mạnh mẽ, bao gồm việc thử lại các yêu cầu thất bại (retry) với chiến lược back-off lũy thừa (exponential back-off), chuyển hướng đến dịch vụ thay thế (fallback), và ghi log chi tiết để phân tích nguyên nhân gốc. Điều này giúp tăng cường độ tin cậy của hệ thống AI. Một cơ chế retry tốt có thể giải quyết 10-15% các lỗi tạm thời mà không cần can thiệp thủ công.

-

Quản Lý Phiên Bản API và Mô Hình:

Giống như bất kỳ API nào, các API AI cũng phát triển và thay đổi. AI middleware nên hỗ trợ quản lý phiên bản API để các ứng dụng cũ vẫn có thể hoạt động khi API AI được cập nhật. Đồng thời, quản lý phiên bản mô hình AI cho phép triển khai các mô hình mới một cách an toàn thông qua A/B testing hoặc triển khai canary, như đã đề cập ở trên. Điều này đảm bảo tính tương thích ngược và khả năng nâng cấp linh hoạt.

-

Tài Liệu Rõ Ràng và Ví Dụ Code:

Cung cấp tài liệu API rõ ràng, đầy đủ và các ví dụ code thực tế cho các nhà phát triển sử dụng AI middleware. Điều này giúp giảm đường cong học tập, tăng tốc độ tích hợp và giảm thiểu các lỗi do hiểu lầm. Tài liệu tốt có thể giảm 20% số lượng câu hỏi hỗ trợ từ các nhà phát triển.

So Sánh AI Middleware Tự Xây Dựng và Giải Pháp Thương Mại

Khi quyết định triển khai AI middleware, các tổ chức thường đứng trước lựa chọn giữa việc tự xây dựng (in-house) hoặc sử dụng các giải pháp thương mại có sẵn. Mỗi lựa chọn đều có ưu và nhược điểm riêng, phù hợp với các tình huống và quy mô dự án khác nhau. Dữ liệu từ các công ty công nghệ cho thấy, các startup nhỏ thường ưu tiên giải pháp tự xây dựng để tiết kiệm chi phí ban đầu, trong khi các doanh nghiệp lớn có xu hướng chọn giải pháp thương mại để đảm bảo tính ổn định và hỗ trợ chuyên nghiệp.

AI Middleware Tự Xây Dựng (In-house)

Ưu điểm:

- Kiểm soát hoàn toàn: Có toàn quyền kiểm soát kiến trúc, tính năng và cách hoạt động của middleware. Điều này cho phép tùy chỉnh chính xác theo nhu cầu kinh doanh và kỹ thuật độc đáo của dự án.

- Tối ưu hóa chi phí dài hạn (có thể): Nếu có đội ngũ kỹ sư mạnh và đủ thời gian, việc tự xây dựng có thể rẻ hơn về lâu dài, đặc biệt nếu khối lượng truy cập rất lớn và các giải pháp thương mại tính phí theo cấp độ.

- Bảo mật tùy chỉnh: Có thể triển khai các biện pháp bảo mật cực kỳ chặt chẽ và tùy chỉnh theo yêu cầu tuân thủ cụ thể của ngành.

Nhược điểm:

- Chi phí phát triển và bảo trì cao: Yêu cầu đầu tư đáng kể vào nhân lực, thời gian để phát triển, kiểm thử, và sau đó là bảo trì, cập nhật. Chi phí này có thể lên đến hàng trăm nghìn đô la trong năm đầu tiên.

- Rủi ro về chất lượng và độ tin cậy: Có thể thiếu các tính năng tiên tiến, khả năng mở rộng, hoặc độ tin cậy so với các giải pháp đã được chứng minh trên thị trường.

- Thời gian triển khai lâu: Quá trình phát triển từ đầu sẽ kéo dài thời gian đưa sản phẩm ra thị trường.

Thích hợp cho: Các công ty lớn với đội ngũ kỹ sư mạnh, yêu cầu tùy chỉnh cao, khối lượng truy cập cực lớn, hoặc các yêu cầu bảo mật và tuân thủ đặc biệt không thể đáp ứng bởi giải pháp thương mại.

Giải Pháp AI Middleware Thương Mại (Commercial Solutions)

Ưu điểm:

- Thời gian triển khai nhanh: Các giải pháp này thường có sẵn, có tài liệu tốt và API dễ tích hợp, giúp rút ngắn thời gian đưa sản phẩm ra thị trường.

- Tính năng phong phú và ổn định: Thường đi kèm với nhiều tính năng nâng cao như caching, load balancing, quản lý chi phí, giám sát, và được bảo trì bởi các nhà cung cấp chuyên nghiệp.

- Hỗ trợ chuyên nghiệp: Được hỗ trợ bởi đội ngũ kỹ sư của nhà cung cấp, giúp giải quyết vấn đề nhanh chóng.

- Giảm gánh nặng vận hành: Nhà cung cấp chịu trách nhiệm về cơ sở hạ tầng, bảo mật và cập nhật.

Nhược điểm:

- Chi phí định kỳ: Thường có mô hình giá dựa trên sử dụng (pay-as-you-go) hoặc đăng ký, có thể trở nên đắt đỏ với khối lượng lớn. Chi phí có thể tăng 10-30% so với tự xây dựng nếu không được tối ưu hóa.

- Hạn chế tùy chỉnh: Khả năng tùy chỉnh có thể bị giới hạn bởi các tính năng và kiến trúc mà nhà cung cấp cung cấp.

- Rủi ro bị khóa nhà cung cấp (vendor lock-in): Việc chuyển đổi từ một giải pháp thương mại sang giải pháp khác có thể tốn kém và phức tạp.

Thích hợp cho: Các startup, SME, hoặc các dự án cần triển khai nhanh chóng, không có đội ngũ kỹ sư chuyên sâu về middleware, hoặc ưu tiên tính ổn định và hỗ trợ hơn là tùy chỉnh hoàn toàn. Ví dụ điển hình là các nền tảng như Google Apigee, AWS API Gateway kết hợp với các dịch vụ quản lý AI.

Lời khuyên: Đối với các dự án vibe coding mới, việc bắt đầu với một giải pháp thương mại hoặc một framework mã nguồn mở có sẵn (ví dụ: FastAPI với các plugin) có thể là lựa chọn thông minh để nhanh chóng có được một MVP và sau đó đánh giá lại nhu cầu tự xây dựng khi dự án phát triển và yêu cầu trở nên phức tạp hơn.

Các Lưu Ý Quan Trọng

-

Đánh Giá Nhu Cầu Thực Tế:

Trước khi bắt tay vào xây dựng hoặc lựa chọn AI middleware, hãy xác định rõ các yêu cầu về hiệu suất, chi phí, bảo mật, và khả năng mở rộng của dự án. Một AI middleware quá phức tạp cho một dự án nhỏ có thể gây lãng phí tài nguyên, trong khi một giải pháp quá đơn giản lại không đáp ứng được nhu cầu của một hệ thống lớn.

-

Chọn Ngôn Ngữ và Framework Phù Hợp:

Lựa chọn ngôn ngữ lập trình (Python, Node.js, Go, Java) và framework (FastAPI, Express, Spring Boot) phù hợp với kinh nghiệm của đội ngũ và yêu cầu về hiệu suất. Python thường được ưa chuộng cho AI do hệ sinh thái phong phú, nhưng Node.js hoặc Go có thể tốt hơn cho các tác vụ I/O bound và hiệu suất cao.

-

Quản Lý Dữ Liệu và Quyền Riêng Tư:

Hiểu rõ cách dữ liệu được xử lý bởi AI middleware và các dịch vụ AI bên thứ ba. Đảm bảo tuân thủ các quy định về quyền riêng tư dữ liệu như GDPR, CCPA, hoặc HIPAA nếu có. Đặc biệt lưu ý đến việc liệu dữ liệu có được sử dụng để đào tạo mô hình của nhà cung cấp AI hay không.

-

Kiểm Thử Toàn Diện:

Thực hiện kiểm thử đơn vị, kiểm thử tích hợp, kiểm thử hiệu suất và kiểm thử bảo mật cho AI middleware. Đảm bảo rằng các cơ chế caching, cân bằng tải, xử lý lỗi và các chính sách quản lý chi phí hoạt động đúng như mong đợi. Các kịch bản lỗi và tình huống cạnh (edge cases) cũng cần được kiểm thử kỹ lưỡng.

-

Tài Liệu Hóa và Quy Trình Rõ Ràng:

Tài liệu hóa kiến trúc, API, các thành phần cấu hình, và quy trình triển khai/vận hành của AI middleware. Điều này giúp các thành viên mới trong đội ngũ dễ dàng làm quen và đảm bảo tính nhất quán trong quá trình phát triển và bảo trì.

-

Liên Tục Tối Ưu Hóa:

AI và các dịch vụ AI liên tục phát triển. Hãy liên tục theo dõi hiệu suất, chi phí và các công nghệ mới để tối ưu hóa AI middleware của bạn. Điều này có thể bao gồm việc cập nhật các chiến lược caching, chuyển đổi sang các mô hình AI hiệu quả hơn, hoặc điều chỉnh các chính sách quản lý chi phí.

-

Tích Hợp Với Hệ Sinh Thái Hiện Có:

Đảm bảo AI middleware tích hợp mượt mà với cơ sở hạ tầng và hệ thống giám sát hiện có của bạn (ví dụ: hệ thống CI/CD, công cụ quản lý log, nền tảng đám mây). Điều này giúp giảm thiểu sự phức tạp trong quản lý và vận hành.

Câu Hỏi Thường Gặp

AI middleware có cần thiết cho mọi dự án sử dụng AI không?

Không, AI middleware không phải là bắt buộc cho mọi dự án AI. Đối với các dự án nhỏ, đơn giản, hoặc chỉ sử dụng một vài cuộc gọi AI đến một API duy nhất, việc tích hợp trực tiếp có thể nhanh chóng và đủ dùng. Tuy nhiên, khi dự án phát triển, sử dụng nhiều dịch vụ AI khác nhau, hoặc có yêu cầu cao về hiệu suất, chi phí và khả năng mở rộng, AI middleware trở nên cực kỳ hữu ích và thậm chí là cần thiết để quản lý sự phức tạp và tối ưu hóa hệ thống.

Làm thế nào để chọn giữa việc tự xây dựng và sử dụng giải pháp thương mại?

Việc lựa chọn phụ thuộc vào nhiều yếu tố như quy mô dự án, ngân sách, thời gian triển khai, kinh nghiệm của đội ngũ kỹ sư, và mức độ tùy chỉnh cần thiết. Nếu bạn có đội ngũ kỹ sư mạnh, yêu cầu tùy chỉnh cao và muốn kiểm soát hoàn toàn, tự xây dựng có thể là lựa chọn tốt. Ngược lại, nếu bạn cần triển khai nhanh chóng, ưu tiên tính ổn định, và muốn giảm gánh nặng vận hành, một giải pháp thương mại sẽ phù hợp hơn. Hãy bắt đầu bằng việc đánh giá kỹ lưỡng các yêu cầu của mình và so sánh chi phí/lợi ích của cả hai phương án trong dài hạn.

AI middleware có giúp giảm chi phí dịch vụ AI không?

Có, AI middleware có thể giúp giảm đáng kể chi phí dịch vụ AI thông qua nhiều cơ chế. Các chiến lược như caching thông minh giảm số lượng cuộc gọi API, lựa chọn nhà cung cấp AI động dựa trên chi phí, quản lý hạn ngạch và giới hạn tốc độ ngăn chặn việc sử dụng quá mức, và tổng hợp yêu cầu (batching) để tận dụng mức giá ưu đãi. Một AI middleware được cấu hình tốt có thể tiết kiệm 15-30% chi phí API hàng tháng cho các dự án lớn.

AI middleware có ảnh hưởng đến độ trễ của các yêu cầu AI không?

AI middleware có thể thêm một độ trễ nhỏ do phải xử lý yêu cầu trước khi chuyển tiếp đến dịch vụ AI. Tuy nhiên, trong nhiều trường hợp, các lợi ích về tối ưu hóa mà nó mang lại (như caching) có thể giảm độ trễ tổng thể một cách đáng kể. Ví dụ, việc trả về kết quả từ cache nhanh hơn nhiều so với việc gọi lại API AI. Nếu được thiết kế và tối ưu hóa đúng cách, AI middleware sẽ cải thiện hiệu suất chung của hệ thống AI.

Các công nghệ nào thường được sử dụng để xây dựng AI middleware?

Các công nghệ phổ biến để xây dựng AI middleware bao gồm:

- Ngôn ngữ lập trình: Python (với FastAPI, Flask), Node.js (với Express), Go, Java (với Spring Boot).

- Database/Cache: Redis (cho caching và quản lý phiên), PostgreSQL, MongoDB.

- Containerization: Docker, Kubernetes (để triển khai và quản lý microservices).

- API Gateway: Nginx, Kong, API Gateway của các nhà cung cấp đám mây (AWS, GCP, Azure).

- Monitoring: Prometheus, Grafana, ELK Stack (Elasticsearch, Logstash, Kibana).

- Message Queues: Kafka, RabbitMQ (cho xử lý yêu cầu bất đồng bộ).

Kết Luận

AI middleware không chỉ là một lớp trung gian đơn thuần mà là một thành phần chiến lược, đóng vai trò then chốt trong việc xây dựng và quản lý các ứng dụng AI phức tạp. Bằng cách tối ưu hóa hiệu suất thông qua caching thông minh, cân bằng tải, và quản lý phiên bản mô hình, đồng thời giảm thiểu chi phí bằng cách quản lý hạn ngạch, lựa chọn nhà cung cấp động và tổng hợp yêu cầu, AI middleware giúp các dự án vibe coding khai thác tối đa tiềm năng của trí tuệ nhân tạo. Việc đầu tư vào một AI middleware mạnh mẽ, dù là tự xây dựng hay sử dụng giải pháp thương mại, là một quyết định thông minh giúp tăng tốc phát triển, giảm thiểu rủi ro và đảm bảo khả năng mở rộng cho tương lai. Hãy tận dụng sức mạnh của AI middleware để biến các ý tưởng đột phá của vibe coding thành hiện thực một cách hiệu quả và bền vững.