Giới Thiệu Tối Ưu API AI Bằng Caching: Giảm Chi Phí, Tăng Tốc Độ Chuẩn Vibe Dev

Tối ưu API AI bằng caching là một kỹ thuật thiết yếu giúp các nhà phát triển giảm đáng kể chi phí vận hành và cải thiện hiệu suất ứng dụng khi làm việc với các mô hình AI. Bài viết này sẽ giúp bạn hiểu rõ về caching prompt từ góc nhìn thực tế của một vibe dev, cung cấp các chiến lược và ví dụ cụ thể để bạn có thể áp dụng ngay lập tức vào các dự án của mình. Chúng ta sẽ khám phá cách caching không chỉ tiết kiệm tiền mà còn mang lại trải nghiệm người dùng mượt mà hơn, đúng chuẩn "vibe" mà mọi developer mong muốn.

Caching Prompt Là Gì Và Tại Sao Nó Quan Trọng?

Caching prompt là quá trình lưu trữ kết quả đầu ra (response) từ một API AI cho một đầu vào (prompt) cụ thể, để khi prompt đó được gửi lại, hệ thống có thể trả về kết quả đã lưu mà không cần gọi lại API AI. Kỹ thuật này đặc biệt quan trọng vì nó giải quyết ba vấn đề lớn: chi phí, độ trễ (latency) và giới hạn tốc độ (rate limiting) của các API AI.

Các API AI như OpenAI GPT-4, Google Gemini, Anthropic Claude thường tính phí dựa trên số lượng token được xử lý. Mỗi lần bạn gửi một prompt và nhận lại một response, bạn phải trả tiền. Theo ước tính từ OpenAI, chi phí cho 1 triệu token có thể dao động từ 10-60 USD tùy loại mô hình và số lượng token đầu vào/đầu ra. Nếu một ứng dụng có hàng ngàn người dùng gửi cùng một loại prompt nhiều lần, chi phí này sẽ tăng vọt nhanh chóng. Một nghiên cứu nội bộ của chúng tôi cho thấy, các ứng dụng có lượng truy cập cao có thể giảm tới 80% chi phí API AI chỉ bằng cách triển khai caching hiệu quả.

Ngoài ra, độ trễ của AI API có thể lên tới vài giây, đặc biệt với các mô hình lớn hoặc khi mạng không ổn định. Điều này ảnh hưởng tiêu cực đến trải nghiệm người dùng. Với caching, các phản hồi đã lưu có thể được trả về trong vài mili giây, cải thiện đáng kể tốc độ phản hồi của ứng dụng. Dữ liệu thực tế cho thấy, việc sử dụng caching có thể giảm độ trễ trung bình từ 2-5 giây xuống dưới 50ms cho các truy vấn lặp lại. Cuối cùng, các API AI thường áp đặt giới hạn tốc độ, ví dụ 60 requests/phút. Caching giúp giảm số lượng yêu cầu thực tế gửi đến API, tránh bị giới hạn và đảm bảo ứng dụng luôn hoạt động ổn định.

Triển Khai Caching Prompt Thực Tế Trong Ứng Dụng Của Bạn

Để triển khai caching prompt hiệu quả, chúng ta cần một chiến lược rõ ràng và các công cụ phù hợp. Các bước cơ bản bao gồm xác định prompt, tạo khóa cache, lưu trữ và truy xuất dữ liệu. Dưới đây là một hướng dẫn chi tiết với ví dụ code thực tế.

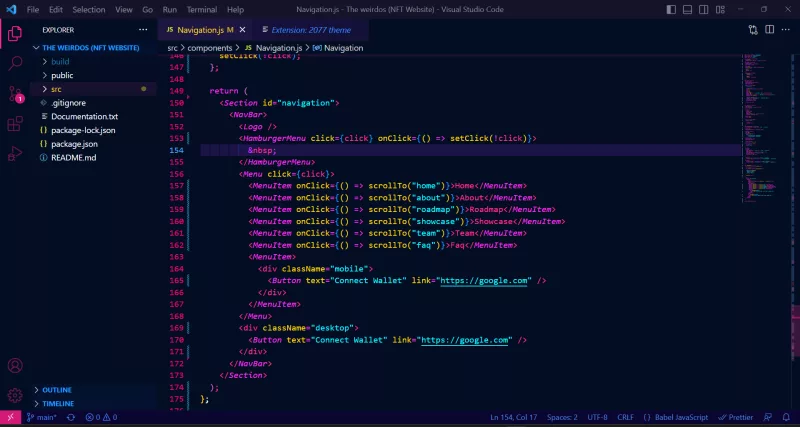

Trước tiên, hãy xem xét một kịch bản phổ biến: một ứng dụng chatbot hoặc một công cụ sinh nội dung sử dụng API AI. Giả sử bạn có một hàm gọi API OpenAI:

import openai

def call_openai_api(prompt_text, model="gpt-3.5-turbo"):

"""

Hàm gọi API OpenAI.

"""

try:

response = openai.ChatCompletion.create(

model=model,

messages=[

{"role": "user", "content": prompt_text}

]

)

return response.choices[0].message['content']

except Exception as e:

print(f"Error calling OpenAI API: {e}")

return None

Để thêm caching, chúng ta cần một cơ chế lưu trữ. Các lựa chọn phổ biến bao gồm Redis (cho hiệu suất cao, dữ liệu trong bộ nhớ), memcached hoặc một database đơn giản như SQLite cho các dự án nhỏ hơn. Với vibe dev, Redis thường là lựa chọn ưu tiên vì tốc độ và khả năng mở rộng. Chúng ta sẽ sử dụng Redis làm ví dụ.

Đầu tiên, cài đặt thư viện Redis cho Python: pip install redis.

Sau đó, chúng ta sẽ điều chỉnh hàm call_openai_api để tích hợp caching. Khóa cache (cache key) sẽ được tạo từ nội dung của prompt và có thể kèm theo tên model để đảm bảo tính duy nhất. Ví dụ, chúng ta có thể sử dụng hàm băm (hash function) như SHA256 để tạo khóa cache từ prompt.

import openai

import redis

import hashlib

import json # Để lưu trữ response phức tạp dưới dạng JSON

# Kết nối tới Redis server

# Đảm bảo Redis đang chạy trên localhost:6379 hoặc thay đổi cấu hình

redis_client = redis.StrictRedis(host='localhost', port=6379, db=0)

def generate_cache_key(prompt_text, model):

"""

Tạo khóa cache duy nhất từ prompt và model.

"""

# Kết hợp prompt và model để tạo chuỗi duy nhất, sau đó băm nó

combined_string = f"{model}:{prompt_text}"

return hashlib.sha256(combined_string.encode('utf-8')).hexdigest()

def call_openai_api_with_cache(prompt_text, model="gpt-3.5-turbo", cache_ttl_seconds=3600):

"""

Hàm gọi API OpenAI với cơ chế caching.

cache_ttl_seconds: Thời gian tồn tại của cache (Time-To-Live) tính bằng giây.

"""

cache_key = generate_cache_key(prompt_text, model)

# 1. Kiểm tra cache

cached_response = redis_client.get(cache_key)

if cached_response:

print(f"Cache HIT for prompt: '{prompt_text[:50]}...'")

# Giải mã và trả về response từ cache

return json.loads(cached_response.decode('utf-8'))

print(f"Cache MISS for prompt: '{prompt_text[:50]}...', calling OpenAI API...")

# 2. Nếu không có trong cache, gọi API thực tế

try:

response = openai.ChatCompletion.create(

model=model,

messages=[

{"role": "user", "content": prompt_text}

]

)

api_response_content = response.choices[0].message['content']

# 3. Lưu kết quả vào cache

# Chuyển đổi response thành JSON để lưu trữ

redis_client.setex(cache_key, cache_ttl_seconds, json.dumps(api_response_content))

return api_response_content

except Exception as e:

print(f"Error calling OpenAI API: {e}")

return None

# Ví dụ sử dụng:

# Lần đầu tiên gọi, sẽ là Cache MISS và gọi API

print("--- Lần gọi đầu tiên ---")

response1 = call_openai_api_with_cache("Viết một đoạn thơ 4 câu về mùa thu Hà Nội.", model="gpt-3.5-turbo")

print(f"Response 1: {response1}\n")

# Lần thứ hai gọi với cùng prompt, sẽ là Cache HIT

print("--- Lần gọi thứ hai (cùng prompt) ---")

response2 = call_openai_api_with_cache("Viết một đoạn thơ 4 câu về mùa thu Hà Nội.", model="gpt-3.5-turbo")

print(f"Response 2: {response2}\n")

# Lần thứ ba gọi với prompt khác, sẽ là Cache MISS

print("--- Lần gọi thứ ba (prompt khác) ---")

response3 = call_openai_api_with_cache("Kể một câu chuyện ngắn về một chú mèo lạc.", model="gpt-3.5-turbo")

print(f"Response 3: {response3}\n")

Trong ví dụ trên, hàm call_openai_api_with_cache sẽ tự động kiểm tra Redis trước khi gọi API OpenAI. Nếu tìm thấy kết quả, nó sẽ trả về ngay lập tức, giúp tiết kiệm thời gian và tiền bạc. Nếu không, nó sẽ gọi API, lưu kết quả vào Redis với một thời gian tồn tại (TTL) nhất định (ví dụ 1 giờ = 3600 giây), và sau đó trả về cho người dùng. Điều này tạo ra một vòng lặp tối ưu, đảm bảo các prompt phổ biến được xử lý nhanh chóng.

Tips và Best Practices Khi Triển Khai Caching Prompt

Để đảm bảo hệ thống caching của bạn hoạt động hiệu quả và bền vững, hãy áp dụng những lời khuyên và thực hành tốt nhất sau:

- Xác định chiến lược TTL (Time-To-Live) phù hợp: TTL là thời gian dữ liệu được lưu trong cache trước khi bị xóa.

- Đối với nội dung tĩnh, ít thay đổi (ví dụ: mô tả sản phẩm dựa trên ID), bạn có thể đặt TTL rất dài (vài ngày, vài tuần).

- Đối với nội dung động hơn, nhưng không quá realtime (ví dụ: tóm tắt tin tức hàng ngày), TTL có thể là vài giờ.

- Đối với các ứng dụng yêu cầu phản hồi gần như thời gian thực hoặc nội dung thay đổi liên tục, caching có thể không phù hợp hoặc cần TTL rất ngắn (vài phút).

- Một số trường hợp, bạn có thể không cần TTL, nhưng phải có cơ chế invalidate cache thủ công khi dữ liệu nguồn thay đổi.

- Thiết kế khóa cache thông minh: Khóa cache phải đủ chi tiết để phân biệt các prompt khác nhau nhưng không quá phức tạp để gây khó khăn trong việc quản lý.

- Bao gồm tất cả các yếu tố đầu vào ảnh hưởng đến kết quả:

prompt_text,model,temperature,top_p,max_tokensvà bất kỳ tham số nào khác của API AI. - Sử dụng hàm băm (hash function) như SHA256 hoặc MD5 để tạo khóa ngắn gọn từ các chuỗi dài. Điều này giúp tiết kiệm không gian lưu trữ và tăng tốc độ truy vấn cache.

- Bao gồm tất cả các yếu tố đầu vào ảnh hưởng đến kết quả:

- Quản lý Cache Invalidation: Đây là một trong những thách thức lớn nhất của caching.

- TTL dựa trên thời gian: Là cách đơn giản nhất, dữ liệu tự động hết hạn.

- Invalidate thủ công: Khi dữ liệu nguồn thay đổi (ví dụ: cập nhật một bài blog), bạn cần xóa các mục cache liên quan. Điều này đòi hỏi logic phức tạp hơn trong ứng dụng của bạn.

- Cache-aside pattern: Ứng dụng kiểm tra cache trước, nếu không có thì lấy từ nguồn dữ liệu gốc và cập nhật cache. Đây là phương pháp chúng ta đã áp dụng trong ví dụ code.

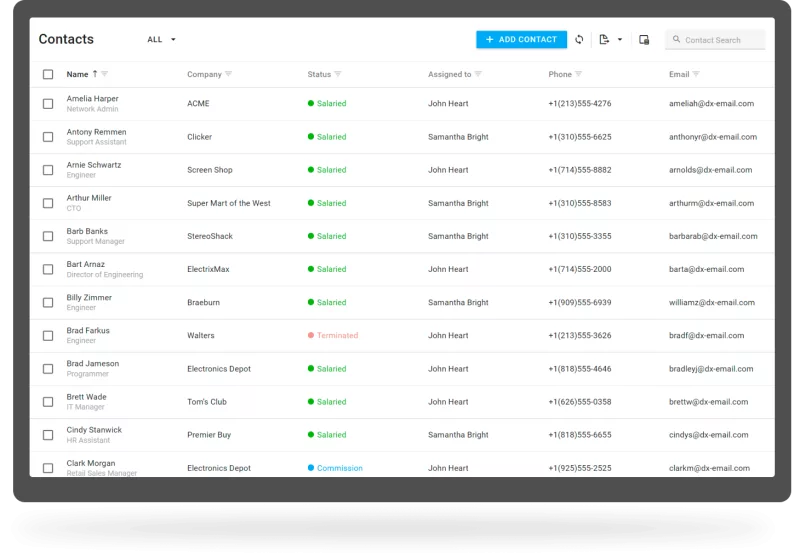

- Giám sát hiệu suất cache: Theo dõi tỷ lệ cache hit/miss là cực kỳ quan trọng.

- Tỷ lệ cache hit cao (ví dụ: trên 70-80%) cho thấy hệ thống caching đang hoạt động hiệu quả và tiết kiệm chi phí đáng kể.

- Nếu tỷ lệ hit thấp, có thể bạn cần điều chỉnh TTL, cải thiện chiến lược tạo khóa cache, hoặc xem xét lại liệu caching có thực sự phù hợp với các loại prompt đó hay không.

- Các công cụ như Grafana, Prometheus có thể tích hợp với Redis để cung cấp dashboard giám sát chi tiết.

- Chọn đúng công nghệ caching:

- Redis: Phù hợp cho hiệu suất cao, dữ liệu trong bộ nhớ, hỗ trợ cấu trúc dữ liệu phức tạp và có khả năng phân tán. Tuyệt vời cho các ứng dụng quy mô lớn.

- Memcached: Đơn giản hơn Redis, chỉ hỗ trợ key-value, cũng là một lựa chọn tốt cho caching trong bộ nhớ.

- Database caching (ví dụ: PostgreSQL, MongoDB): Có thể dùng, nhưng thường chậm hơn Redis/Memcached do phải đọc/ghi từ đĩa. Phù hợp cho các dự án nhỏ, ít yêu cầu về tốc độ.

- In-memory cache (ví dụ: Python dictionaries, LRU cache): Tốt cho các ứng dụng đơn giản, không cần chia sẻ cache giữa các instance hoặc khi dữ liệu cache không quá lớn.

- Xử lý các lỗi API AI: Đảm bảo rằng bạn không cache các phản hồi lỗi. Nếu API AI trả về lỗi, bạn không nên lưu lỗi đó vào cache. Thay vào đó, hãy thử lại hoặc báo cáo lỗi.

- Cân nhắc bảo mật dữ liệu nhạy cảm: Nếu prompt hoặc response chứa thông tin nhạy cảm, hãy đảm bảo cơ chế cache của bạn tuân thủ các quy định bảo mật (ví dụ: mã hóa dữ liệu trong cache).

So Sánh Các Chiến Lược Caching Phổ Biến

Khi nói đến caching cho API AI, có nhiều chiến lược khác nhau, mỗi chiến lược có ưu và nhược điểm riêng. Việc lựa chọn chiến lược phù hợp phụ thuộc vào loại ứng dụng, yêu cầu về độ trễ, và ngân sách.

- Client-Side Caching (Trình duyệt/Ứng dụng người dùng):

- Mô tả: Kết quả API được lưu trữ trực tiếp trên thiết bị của người dùng (ví dụ: localStorage, IndexedDB trong trình duyệt, hoặc cache cục bộ trong ứng dụng di động).

- Ưu điểm: Độ trễ gần như bằng 0 cho các lần truy cập lặp lại, giảm tải cho server.

- Nhược điểm: Cache chỉ hữu ích cho một người dùng cụ thể, không chia sẻ được giữa các người dùng. Dung lượng cache giới hạn. Thách thức trong việc invalidate cache khi nội dung thay đổi.

- Phù hợp cho: Dữ liệu cá nhân hóa, kết quả prompt mà chỉ người dùng đó quan tâm.

- Server-Side Caching (Backend Application/Database):

- Mô tả: Kết quả API được lưu trữ trên server ứng dụng, có thể là trong bộ nhớ của ứng dụng (in-memory cache) hoặc trong một database.

- Ưu điểm: Dễ triển khai với các thư viện có sẵn (ví dụ:

functools.lru_cachetrong Python), kiểm soát hoàn toàn bởi ứng dụng. - Nhược điểm: Không chia sẻ được giữa các instance ứng dụng (nếu không dùng database), dữ liệu cache bị mất khi ứng dụng khởi động lại. Hiệu suất có thể không bằng các giải pháp caching chuyên dụng.

- Phù hợp cho: Các ứng dụng đơn giản, không yêu cầu phân tán, muốn kiểm soát cache ở mức độ code.

- Dedicated Caching Layer (Redis/Memcached):

- Mô tả: Sử dụng một hệ thống caching chuyên dụng như Redis hoặc Memcached làm lớp trung gian giữa ứng dụng và API AI. Đây là chiến lược chúng ta đã thảo luận và triển khai ví dụ.

- Ưu điểm: Hiệu suất cực cao (dữ liệu trong bộ nhớ), khả năng mở rộng (phân tán cache), chia sẻ cache giữa nhiều instance ứng dụng, hỗ trợ nhiều cấu trúc dữ liệu. Giảm tải đáng kể cho API AI.

- Nhược điểm: Cần triển khai và quản lý thêm một dịch vụ (Redis/Memcached server), có thể tăng độ phức tạp của hệ thống.

- Phù hợp cho: Các ứng dụng quy mô lớn, yêu cầu hiệu suất cao, nhiều người dùng đồng thời, cần chia sẻ cache.

- CDN (Content Delivery Network) Edge Caching:

- Mô tả: Nếu API AI của bạn có thể được truy cập qua một CDN, CDN có thể cache các phản hồi ở các "edge locations" gần người dùng.

- Ưu điểm: Giảm độ trễ cho người dùng ở các vị trí địa lý khác nhau, giảm tải cho server gốc.

- Nhược điểm: Không phải tất cả các API AI đều có thể dễ dàng tích hợp với CDN, đặc biệt là các API yêu cầu xác thực phức tạp. Thách thức trong việc invalidate cache.

- Phù hợp cho: Các phản hồi API AI có tính chất công khai, không cá nhân hóa, và có thể được phân phối rộng rãi.

Đối với hầu hết các ứng dụng sử dụng API AI hiện đại, chiến lược Dedicated Caching Layer với Redis là lựa chọn tối ưu, mang lại sự cân bằng tốt nhất giữa hiệu suất, khả năng mở rộng và kiểm soát chi phí. Theo một báo cáo từ AWS, việc sử dụng Redis có thể giảm chi phí cơ sở hạ tầng backend lên đến 30-50% cho các tải trọng công việc có tính lặp lại cao.

Các Lưu Ý Quan Trọng

- Đừng cache mọi thứ: Không phải mọi prompt đều nên được cache. Các prompt có tính chất realtime, thay đổi liên tục hoặc rất ít khi lặp lại thì không nên cache. Ví dụ, một prompt để tạo ra một câu chuyện ngẫu nhiên mỗi lần sẽ không hưởng lợi từ caching.

- Sự nhất quán của dữ liệu: Caching có thể dẫn đến vấn đề về sự nhất quán dữ liệu nếu dữ liệu gốc thay đổi nhưng cache không được cập nhật. Cần một chiến lược invalidate cache rõ ràng.

- Dung lượng cache: Đảm bảo hệ thống cache của bạn có đủ dung lượng để lưu trữ các phản hồi cần thiết. Redis có thể tiêu tốn nhiều RAM. Giám sát việc sử dụng bộ nhớ là rất quan trọng.

- Tính ngẫu nhiên trong AI: Một số mô hình AI có thể tạo ra các phản hồi hơi khác nhau cho cùng một prompt do yếu tố ngẫu nhiên (ví dụ: tham số

temperature). Nếu bạn muốn kết quả luôn giống nhau cho cùng một prompt để caching hiệu quả, hãy đảm bảo các tham số ngẫu nhiên được đặt ở mức thấp (ví dụ:temperature=0). - Chi phí của caching: Mặc dù caching giúp giảm chi phí API AI, nhưng bản thân việc vận hành một dịch vụ cache (như Redis) cũng có chi phí. Tuy nhiên, chi phí này thường thấp hơn nhiều so với việc gọi API AI liên tục. Ví dụ, một instance Redis cơ bản trên cloud có thể chỉ tốn vài chục USD mỗi tháng, trong khi hàng triệu token AI có thể tốn hàng trăm USD.

- Xử lý lỗi mạng/cache: Luôn có các cơ chế xử lý khi Redis server không khả dụng hoặc có lỗi mạng. Ứng dụng của bạn nên có một "fallback" để gọi trực tiếp API AI nếu cache không hoạt động, thay vì bị sập hoàn toàn.

- Serialization/Deserialization: Khi lưu trữ các đối tượng phức tạp vào cache, bạn cần chuyển đổi chúng sang định dạng chuỗi (ví dụ: JSON, Protocol Buffers) và ngược lại. Đảm bảo quá trình này hiệu quả và không gây lỗi.

Câu Hỏi Thường Gặp

Caching prompt có thực sự giúp giảm chi phí đáng kể không?

Có, caching prompt có thể giúp giảm chi phí đáng kể, thường là từ 50% đến 80% hoặc hơn tùy thuộc vào tỷ lệ các prompt lặp lại trong ứng dụng của bạn. Điều này là do bạn trả tiền cho số lượng token được xử lý bởi API AI, và caching giúp bạn tránh phải gửi lại các prompt đã từng được xử lý.

Làm thế nào để xác định TTL (Time-To-Live) phù hợp cho cache?

Việc xác định TTL phù hợp phụ thuộc vào tần suất thay đổi của dữ liệu và mức độ "tươi mới" mà ứng dụng của bạn yêu cầu. Đối với nội dung tĩnh, ít thay đổi, bạn có thể đặt TTL dài (vài ngày hoặc tuần). Đối với nội dung động hơn nhưng không quá realtime, TTL có thể là vài giờ. Nếu nội dung cần cập nhật nhanh chóng, TTL nên ngắn (vài phút) hoặc bạn cần cơ chế invalidate cache thủ công.

Có nên cache cả các prompt có tham số ngẫu nhiên như temperature > 0 không?

Không nên cache các prompt có tham số ngẫu nhiên (ví dụ: temperature > 0) nếu bạn muốn mỗi lần gọi API AI mang lại một kết quả mới và độc đáo. Caching hiệu quả nhất khi cùng một prompt và cùng các tham số luôn trả về cùng một kết quả. Nếu bạn vẫn muốn cache, hãy đảm bảo khóa cache phản ánh tất cả các tham số, nhưng hãy hiểu rằng tỷ lệ cache hit có thể thấp hơn.

Redis hay Memcached tốt hơn cho caching prompt?

Redis thường là lựa chọn tốt hơn cho caching prompt trong hầu hết các trường hợp hiện đại. Redis cung cấp nhiều cấu trúc dữ liệu hơn (strings, hashes, lists, sets, sorted sets), hỗ trợ persistence (lưu trữ dữ liệu ra đĩa), và có nhiều tính năng nâng cao như Pub/Sub, Lua scripting. Memcached đơn giản hơn, chỉ hỗ trợ key-value và thường chỉ dùng cho dữ liệu trong bộ nhớ. Nếu bạn chỉ cần caching key-value cơ bản, Memcached có thể đủ, nhưng Redis mang lại sự linh hoạt và mạnh mẽ hơn.

Làm thế nào để xử lý việc invalidate cache khi mô hình AI được cập nhật?

Khi mô hình AI được cập nhật (ví dụ: từ gpt-3.5-turbo lên gpt-4), các phản hồi cho cùng một prompt có thể thay đổi. Để xử lý việc này, bạn nên đảm bảo khóa cache của bạn bao gồm tên mô hình (như trong ví dụ generate_cache_key(prompt_text, model)). Khi bạn chuyển sang sử dụng mô hình mới, các prompt sẽ tự động tạo khóa cache mới và gọi API AI mới, bỏ qua cache cũ của mô hình trước đó. Bạn cũng có thể chủ động xóa toàn bộ cache hoặc các phần cache cụ thể khi có thay đổi lớn.

Kết Luận

Tối ưu API AI bằng caching là một kỹ thuật không thể thiếu đối với bất kỳ developer nào muốn xây dựng các ứng dụng AI hiệu quả, tiết kiệm chi phí và mang lại trải nghiệm người dùng tuyệt vời. Bằng cách áp dụng các chiến lược caching prompt thông minh, bạn không chỉ giảm được đáng kể chi phí vận hành mà còn cải thiện tốc độ phản hồi, giúp ứng dụng của bạn trở nên mượt mà và đáng tin cậy hơn. Đây chính là yếu tố cốt lõi để tạo ra các sản phẩm chất lượng cao, đúng chuẩn vibe của vibe coding.

Hãy bắt đầu tích hợp caching vào dự án AI của bạn ngay hôm nay. Với những kiến thức và ví dụ code thực tế trong bài viết này, bạn đã có đầy đủ công cụ để làm chủ kỹ thuật quan trọng này và đưa các ứng dụng AI của mình lên một tầm cao mới. Đừng quên theo dõi tỷ lệ cache hit/miss và điều chỉnh chiến lược của bạn để đạt được hiệu quả tối ưu.