Giới Thiệu Vibe Coding Tái Tạo: API AI Đa Mô Hình Và Cú Hích Sáng Tạo Với Vercel AI SDK 3.0

Chào mừng bạn đến với vibe coding, nơi chúng ta khám phá những công nghệ tiên tiến nhất để biến ý tưởng thành hiện thực. Trong bối cảnh AI đang bùng nổ mạnh mẽ, việc tích hợp các mô hình trí tuệ nhân tạo vào ứng dụng web đã trở thành một yêu cầu thiết yếu đối với các nhà phát triển. Tuy nhiên, quá trình này thường đi kèm với những thách thức về độ phức tạp, khả năng mở rộng và hiệu quả. Đó là lúc vercel ai sdk xuất hiện như một giải pháp đột phá, đặc biệt là phiên bản 3.0 mới nhất với khả năng hỗ trợ API AI đa mô hình.

Bài viết này sẽ đi sâu vào cách Vercel AI SDK 3.0 không chỉ đơn thuần là một thư viện, mà còn là một "cú hích sáng tạo" giúp bạn tái tạo cách mình xây dựng các ứng dụng AI. Chúng ta sẽ cùng nhau khám phá những tính năng mạnh mẽ, các trường hợp sử dụng thực tế và cách bạn có thể tận dụng tối đa công cụ này để tạo ra những trải nghiệm người dùng độc đáo và hiệu quả.

Vercel AI SDK 3.0: Nền Tảng Cho Kỷ Nguyên AI Đa Mô Hình

Vercel AI SDK, đặc biệt là phiên bản 3.0, không chỉ là một công cụ để kết nối với các mô hình AI. Nó là một bộ công cụ toàn diện, được thiết kế để đơn giản hóa quá trình phát triển ứng dụng AI, từ việc streaming các phản hồi của mô hình đến việc quản lý trạng thái UI một cách mượt mà. Điểm nổi bật nhất của Vercel AI SDK 3.0 chính là khả năng hỗ trợ API AI đa mô hình (multi-modal AI APIs), mở ra cánh cửa cho các nhà phát triển để tích hợp không chỉ các mô hình ngôn ngữ lớn (LLMs) mà còn các mô hình tạo ảnh, mô hình chuyển văn bản thành giọng nói, và nhiều hơn nữa, tất cả thông qua một giao diện lập trình nhất quán.

Trước đây, việc tích hợp nhiều loại mô hình AI từ các nhà cung cấp khác nhau thường đòi hỏi phải viết code tùy chỉnh cho từng API, dẫn đến sự phân mảnh và tăng độ phức tạp. Vercel AI SDK 3.0 giải quyết vấn đề này bằng cách cung cấp một lớp trừu tượng thống nhất, cho phép bạn dễ dàng chuyển đổi giữa các nhà cung cấp như OpenAI, Anthropic, Google, Hugging Face, và thậm chí cả các mô hình tự host, mà không cần thay đổi phần lớn logic ứng dụng của mình. Điều này không chỉ tiết kiệm thời gian phát triển mà còn giúp ứng dụng của bạn linh hoạt hơn trước sự thay đổi của công nghệ AI.

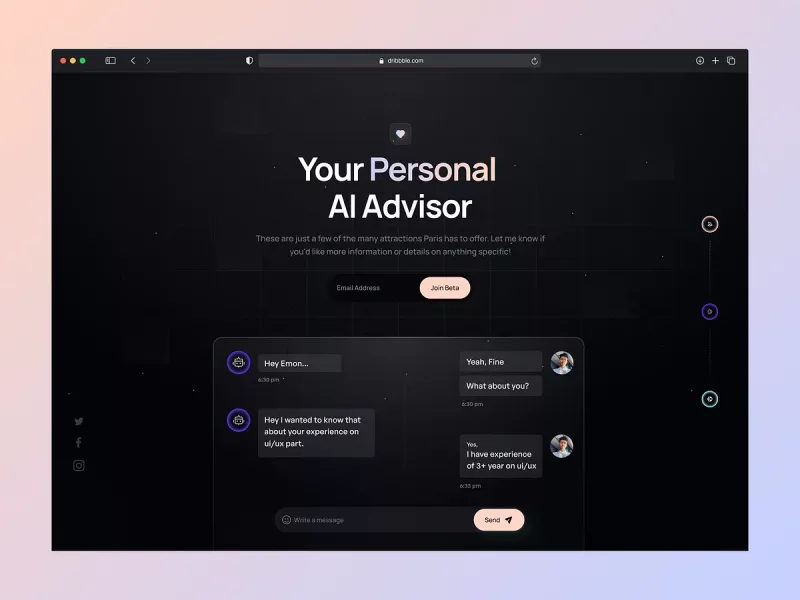

Một tính năng cốt lõi khác của Vercel AI SDK là khả năng streaming. Trong các ứng dụng AI hiện đại, việc hiển thị phản hồi của mô hình theo thời gian thực, từng từ một, mang lại trải nghiệm người dùng tốt hơn nhiều so với việc phải chờ đợi toàn bộ phản hồi. SDK này được xây dựng từ đầu để hỗ trợ streaming, tích hợp sâu với các framework như React và Next.js, cho phép bạn dễ dàng xây dựng các giao diện người dùng động và phản hồi nhanh chóng mà không cần quản lý các luồng dữ liệu phức tạp.

Khả năng mở rộng cũng là một yếu tố quan trọng mà Vercel AI SDK 3.0 chú trọng. Với kiến trúc được xây dựng trên các công nghệ web hiện đại như Edge Functions, ứng dụng của bạn có thể xử lý lượng truy cập lớn và cung cấp phản hồi nhanh chóng cho người dùng trên toàn cầu. Điều này đặc biệt quan trọng đối với các ứng dụng AI, nơi độ trễ có thể ảnh hưởng đáng kể đến trải nghiệm người dùng.

Hướng Dẫn Thực Hành: Xây Dựng Ứng Dụng AI Với Vercel AI SDK 3.0

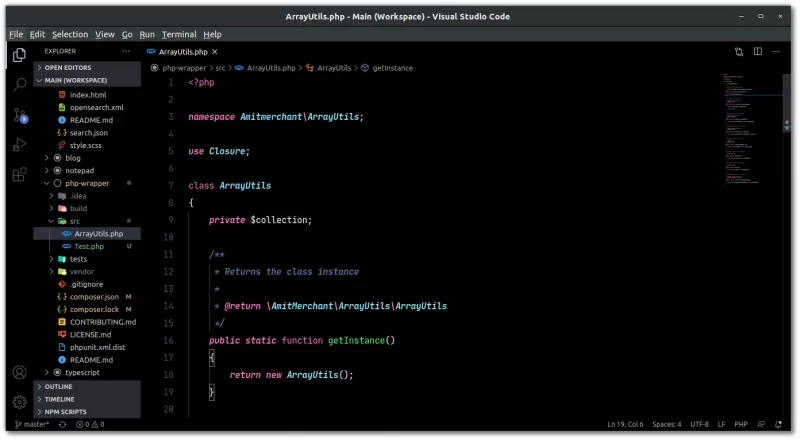

Để bắt đầu với Vercel AI SDK 3.0, bạn cần một dự án Next.js cơ bản. Nếu chưa có, bạn có thể tạo một dự án mới bằng lệnh sau:

npx create-next-app@latest my-ai-app

cd my-ai-appTiếp theo, cài đặt Vercel AI SDK:

npm install ai

# hoặc

yarn add aiBây giờ, chúng ta sẽ tạo một API route đơn giản để xử lý các yêu cầu từ mô hình AI. Tạo file app/api/chat/route.ts (hoặc .js) với nội dung sau:

import { streamText } from 'ai';

import { openai } from '@ai-sdk/openai';

export async function POST(req: Request) {

const { messages } = await req.json();

const result = await streamText({

model: openai('gpt-4o'), // Hoặc 'gpt-3.5-turbo', 'claude-3-opus', 'gemini-1.5-flash', ...

messages,

});

return result.to

Response();

}Trong ví dụ trên, chúng ta sử dụng openai provider. Để sử dụng các model khác, bạn có thể cài đặt thêm các gói provider tương ứng, ví dụ: npm install @ai-sdk/anthropic hoặc npm install @ai-sdk/google. Đừng quên thiết lập biến môi trường cho API key của nhà cung cấp bạn chọn (ví dụ: OPENAI_API_KEY trong file .env.local).

Sau khi có API route, chúng ta sẽ xây dựng giao diện người dùng. Trong file app/page.tsx, bạn có thể tạo một component chat đơn giản:

'use client';

import { useChat } from 'ai/react';

export default function Chat() {

const { messages, input, handleInputChange, handleSubmit } = useChat();

return (

<div className="flex flex-col w-full max-w-md py-24 mx-auto stretch">

{messages.map(m => (

<div key={m.id} className="whitespace-pre-wrap">

<strong>{m.role === 'user' ? 'User: ' : 'AI: '}</strong>

{m.content}

</div>

))}

<form onSubmit={handleSubmit}>

<input

className="fixed bottom-0 w-full max-w-md p-2 mb-8 border border-gray-300 rounded shadow-xl"

value={input}

placeholder="Say something..."

onChange={handleInputChange}

/>

</form>

</div>

);

}Component useChat từ ai/react là một hook mạnh mẽ giúp quản lý trạng thái chat, gửi yêu cầu đến API route và xử lý các phản hồi streaming một cách tự động. Điều này giúp bạn tập trung vào việc xây dựng UI thay vì lo lắng về logic API phức tạp.

Với Vercel AI SDK 3.0, việc tích hợp các mô hình đa phương thức cũng trở nên dễ dàng. Ví dụ, để tạo ra hình ảnh, bạn có thể sử dụng API tương tự:

import { generateImage } from 'ai';

import { openai } from '@ai-sdk/openai';

export async function POST(req: Request) {

const { prompt } = await req.json();

const { url } = await generateImage({

model: openai('dall-e-3'),

prompt,

size: '1024x1024',

quality: 'hd',

});

return new Response(JSON.stringify({ url }), {

headers: { 'Content-Type': 'application/json' },

});

}Sau đó, bạn có thể gọi API này từ phía client để tạo và hiển thị hình ảnh. Sự nhất quán trong cú pháp của Vercel AI SDK 3.0 cho phép bạn dễ dàng chuyển đổi giữa các loại mô hình và tác vụ AI khác nhau.

Tips Và Best Practices Với Vercel AI SDK 3.0

- Sử dụng Edge Functions để tối ưu hóa hiệu suất: Vercel AI SDK được thiết kế để hoạt động tốt nhất với Edge Functions của Vercel. Điều này giúp giảm độ trễ đáng kể bằng cách đưa logic xử lý AI gần hơn với người dùng, mang lại trải nghiệm nhanh hơn và mượt mà hơn. Đảm bảo API routes của bạn được triển khai dưới dạng Edge Functions (đặt

runtime = 'edge'trong file route của bạn nếu cần). - Quản lý API Keys an toàn: Không bao giờ commit API keys trực tiếp vào mã nguồn của bạn. Luôn sử dụng biến môi trường (

.env.localcho phát triển cục bộ và cấu hình biến môi trường trên Vercel cho production). Vercel AI SDK sẽ tự động tìm kiếm các biến môi trường này. - Xử lý lỗi và phản hồi thân thiện với người dùng: Trong môi trường thực tế, các API AI có thể gặp lỗi (quá tải, key không hợp lệ, v.v.). Hãy thêm logic xử lý lỗi vào API routes của bạn và hiển thị thông báo lỗi thân thiện trên giao diện người dùng. Vercel AI SDK cung cấp các cơ chế để bắt và xử lý lỗi một cách hiệu quả.

- Tận dụng khả năng streaming: Đây là một trong những điểm mạnh lớn nhất của Vercel AI SDK. Thay vì chờ đợi toàn bộ phản hồi, hãy hiển thị nội dung streaming cho người dùng. Điều này tạo cảm giác ứng dụng nhanh hơn và phản hồi tốt hơn, đặc biệt với các mô hình ngôn ngữ lớn.

- Tối ưu hóa prompts: Chất lượng của phản hồi AI phụ thuộc rất nhiều vào chất lượng của prompt. Học cách viết prompt hiệu quả (prompt engineering) sẽ giúp bạn khai thác tối đa sức mạnh của các mô hình AI thông qua vercel ai sdk.

- Kiểm tra và thử nghiệm đa nhà cung cấp: Vercel AI SDK 3.0 hỗ trợ nhiều nhà cung cấp AI. Đừng ngần ngại thử nghiệm các mô hình từ các nhà cung cấp khác nhau để tìm ra mô hình phù hợp nhất với nhu cầu và ngân sách của bạn. Đôi khi, một mô hình nhỏ hơn, ít tốn kém hơn cũng có thể mang lại kết quả rất tốt.

- Tích hợp UI frameworks: SDK này tích hợp chặt chẽ với React, Svelte và Vue thông qua các hooks và components chuyên dụng. Hãy tận dụng chúng để xây dựng giao diện người dùng một cách hiệu quả và có cấu trúc.

So Sánh Vercel AI SDK 3.0 Với Các Giải Pháp Khác

Khi nói đến việc tích hợp AI vào ứng dụng web, có nhiều lựa chọn khác nhau. Tuy nhiên, vercel ai sdk 3.0 nổi bật với một số ưu điểm đáng kể. So với việc gọi trực tiếp các API của từng nhà cung cấp (ví dụ: OpenAI Python/Node.js client), Vercel AI SDK cung cấp một lớp trừu tượng thống nhất. Điều này có nghĩa là bạn không cần phải học cú pháp khác nhau cho mỗi API hay quản lý các client riêng biệt. Khả năng đa mô hình của SDK giúp bạn dễ dàng chuyển đổi hoặc kết hợp các mô hình từ OpenAI, Anthropic, Google mà không cần thay đổi phần lớn code của ứng dụng.

Một điểm khác biệt lớn là sự tích hợp sâu với hệ sinh thái Vercel và các framework như Next.js. Vercel AI SDK được tối ưu hóa cho Edge Functions, cho phép streaming phản hồi AI theo thời gian thực một cách hiệu quả. Các client SDK (ai/react, ai/svelte, ai/vue) cung cấp các hooks và components được xây dựng sẵn để quản lý trạng thái UI và xử lý streaming một cách dễ dàng, điều mà các thư viện client API gốc thường không có hoặc yêu cầu nhiều công sức để tự xây dựng. Điều này giúp giảm đáng kể thời gian phát triển và độ phức tạp.

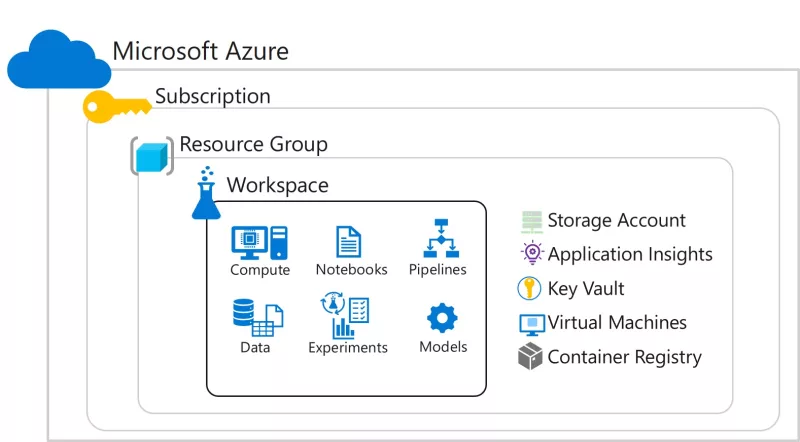

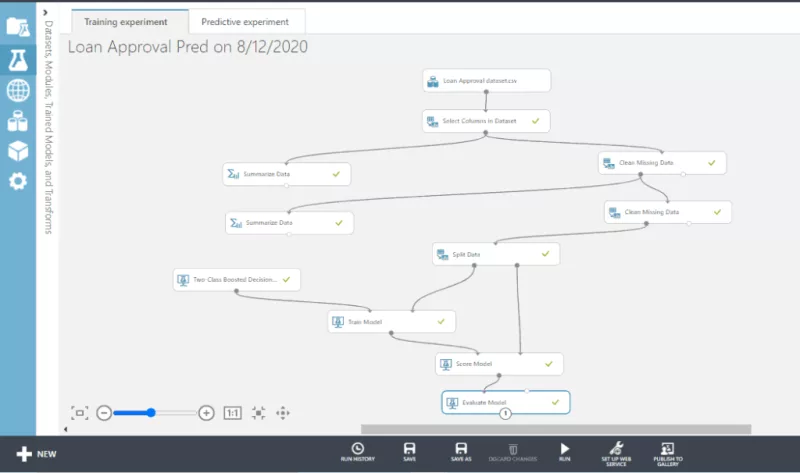

So với các nền tảng AI/MLOps lớn hơn như AWS SageMaker hay Google AI Platform, Vercel AI SDK không phải là một nền tảng toàn diện để huấn luyện mô hình hay quản lý vòng đời ML phức tạp. Thay vào đó, nó tập trung vào việc tiêu thụ và tích hợp các mô hình AI đã được huấn luyện sẵn vào các ứng dụng web front-end/full-stack một cách nhanh chóng và hiệu quả. Nó là cầu nối tuyệt vời giữa các mô hình AI mạnh mẽ và trải nghiệm người dùng cuối.

Tóm lại, Vercel AI SDK 3.0 không nhằm mục đích thay thế các công cụ cấp thấp hoặc nền tảng MLOps, mà là bổ trợ chúng bằng cách cung cấp một cách tiếp cận đơn giản, hiệu quả và được tối ưu hóa cho web để xây dựng các ứng dụng AI tương tác. Nó đặc biệt phù hợp với các nhà phát triển muốn nhanh chóng tạo ra các sản phẩm AI có trải nghiệm người dùng xuất sắc mà không bị sa lầy vào sự phức tạp của các API AI khác nhau.

Các Lưu Ý Quan Trọng

- Chi phí sử dụng API AI: Mặc dù Vercel AI SDK miễn phí, bạn vẫn phải trả phí cho các nhà cung cấp mô hình AI (OpenAI, Anthropic, Google, v.v.) dựa trên mức độ sử dụng của bạn. Hãy theo dõi chi phí này để tránh những bất ngờ.

- Giới hạn của Edge Functions: Edge Functions có một số giới hạn về thời gian chạy và bộ nhớ. Đối với các tác vụ AI rất nặng hoặc yêu cầu xử lý kéo dài, bạn có thể cần xem xét các giải pháp backend truyền thống hơn hoặc tối ưu hóa luồng công việc của mình.

- Bảo mật dữ liệu nhạy cảm: Khi gửi dữ liệu người dùng đến các mô hình AI, hãy luôn chú ý đến quyền riêng tư và bảo mật. Tránh gửi thông tin nhận dạng cá nhân (PII) hoặc dữ liệu nhạy cảm trừ khi bạn đã có các biện pháp bảo mật và tuân thủ quy định phù hợp.

- Cập nhật phiên bản SDK: Hệ sinh thái AI phát triển rất nhanh. Vercel AI SDK cũng thường xuyên được cập nhật với các tính năng mới và cải tiến. Hãy theo dõi các bản phát hành mới và cập nhật SDK của bạn để tận dụng những công nghệ mới nhất.

- Xử lý độ trễ (latency): Mặc dù streaming giúp cải thiện trải nghiệm, vẫn có độ trễ nhất định khi gọi các API AI. Hãy thiết kế UI của bạn để xử lý độ trễ này một cách duyên dáng, ví dụ như hiển thị trạng thái tải (loading indicators) hoặc các placeholder.

- Giới hạn tốc độ (rate limits): Các API AI thường có giới hạn tốc độ. Nếu ứng dụng của bạn dự kiến có lượng truy cập lớn, hãy chuẩn bị các cơ chế xử lý giới hạn tốc độ (ví dụ: retry logic với exponential backoff) để đảm bảo ứng dụng hoạt động ổn định.

- Sự phụ thuộc vào bên thứ ba: Việc sử dụng Vercel AI SDK và các mô hình AI của bên thứ ba đồng nghĩa với việc bạn phụ thuộc vào sự ổn định và chính sách của các nhà cung cấp đó. Hãy cân nhắc các kế hoạch dự phòng nếu có sự cố xảy ra với một trong các dịch vụ này.

Câu Hỏi Thường Gặp

Vercel AI SDK có hỗ trợ mô hình AI mã nguồn mở không?

Có, Vercel AI SDK 3.0 được thiết kế để hỗ trợ cả mô hình AI mã nguồn mở. Bạn có thể sử dụng các mô hình từ Hugging Face hoặc thậm chí là các mô hình tự host (self-hosted models) thông qua các adapter hoặc bằng cách cấu hình endpoint API tùy chỉnh. Điều này mang lại sự linh hoạt đáng kể cho các nhà phát triển.

Làm thế nào để xử lý các mô hình đa phương thức (multi-modal) như trộn văn bản và hình ảnh trong cùng một request?

Vercel AI SDK 3.0 cung cấp các API để xử lý nội dung đa phương thức. Bạn có thể gửi một mảng các đối tượng nội dung (content objects) trong trường messages, trong đó mỗi đối tượng có thể chứa văn bản (text) hoặc hình ảnh (image) dưới dạng URL hoặc base64 encoded data. SDK sẽ tự động định dạng chúng để phù hợp với API của nhà cung cấp mô hình.

Vercel AI SDK có thể được sử dụng với các framework khác ngoài Next.js không?

Hoàn toàn có thể. Mặc dù Vercel AI SDK có sự tích hợp chặt chẽ với Next.js và Edge Functions, phần client-side SDK (ai/react, ai/svelte, ai/vue) có thể được sử dụng độc lập trong bất kỳ ứng dụng React, Svelte hoặc Vue nào. Phần server-side SDK cũng có thể được dùng với các backend khác miễn là bạn có thể tạo một API endpoint để proxy các yêu cầu đến các mô hình AI.

Sự khác biệt chính giữa Vercel AI SDK 2.x và 3.0 là gì?

Sự khác biệt lớn nhất trong Vercel AI SDK 3.0 là kiến trúc hoàn toàn mới dựa trên @ai-sdk/core, mang đến khả năng mở rộng đa mô hình mạnh mẽ hơn, hỗ trợ nhiều nhà cung cấp AI hơn và cú pháp nhất quán hơn. Nó cũng tập trung vào việc cải thiện hiệu suất và trải nghiệm nhà phát triển với các tính năng như streamText và generateObject, giúp việc tương tác với AI trở nên trực quan hơn.

Làm thế nào để debug các vấn đề khi sử dụng Vercel AI SDK?

Bạn có thể sử dụng các công cụ developer console của trình duyệt để kiểm tra các yêu cầu mạng và phản hồi từ API. Đối với các vấn đề phía server, hãy kiểm tra logs của Edge Functions trên bảng điều khiển Vercel. Ngoài ra, Vercel AI SDK cũng cung cấp các tùy chọn để bật chế độ debug, giúp bạn có cái nhìn chi tiết hơn về các lỗi xảy ra trong quá trình gọi API AI.

Kết Luận

Vercel AI SDK 3.0 đã thực sự tái định nghĩa cách chúng ta xây dựng các ứng dụng AI trên nền tảng web. Với khả năng hỗ trợ API AI đa mô hình, cú pháp nhất quán, và sự tích hợp sâu sắc với hệ sinh thái Vercel, nó không chỉ đơn giản hóa quá trình phát triển mà còn mở khóa tiềm năng sáng tạo vô hạn cho các nhà phát triển. Từ việc xây dựng các chatbot thông minh đến việc tạo ra nội dung đa phương tiện, Vercel AI SDK 3.0 là công cụ không thể thiếu trong bộ công cụ của bất kỳ ai muốn dẫn đầu trong kỷ nguyên AI.

Chúng tôi hy vọng bài viết này đã cung cấp cho bạn một cái nhìn toàn diện và sâu sắc về Vercel AI SDK 3.0, cũng như truyền cảm hứng để bạn bắt đầu xây dựng những ứng dụng AI tuyệt vời của riêng mình. Hãy tiếp tục khám phá và sáng tạo cùng vibe coding, nơi công nghệ và sự đổi mới luôn song hành.