Giới Thiệu Trợ Lý AI Đa Năng với LlamaIndex: "Vibe" Coding Dữ Liệu Phi Cấu Trúc Đỉnh Cao

Xây dựng các trợ lý AI thông minh, có khả năng tương tác với dữ liệu phi cấu trúc một cách hiệu quả là một trong những thách thức lớn nhất hiện nay trong lĩnh vực phát triển AI. Bài viết về LlamaIndex ứng dụng này sẽ giúp bạn hiểu rõ về cách LlamaIndex, một framework mạnh mẽ, giúp chúng ta "vibe" coding dữ liệu phi cấu trúc, biến chúng thành nguồn thông tin dễ dàng truy vấn và khai thác cho các mô hình ngôn ngữ lớn (LLM). Chúng ta sẽ đi sâu vào cách LlamaIndex hoạt động, các thành phần chính của nó, và cách triển khai một trợ lý AI thực tế.

LlamaIndex Là Gì và Tại Sao Nó Quan Trọng?

LlamaIndex (trước đây là GPT Index) là một framework dữ liệu linh hoạt, cung cấp một giao diện trung gian cho phép các mô hình ngôn ngữ lớn (LLM) tương tác hiệu quả với dữ liệu phi cấu trúc của bạn, bất kể định dạng hay nguồn gốc. Theo một khảo sát gần đây, hơn 85% dữ liệu doanh nghiệp hiện nay là phi cấu trúc, gây khó khăn lớn cho việc tích hợp vào các ứng dụng AI. LlamaIndex giải quyết vấn đề này bằng cách tạo ra các cấu trúc dữ liệu có thể truy vấn được, giúp LLM "hiểu" và tương tác với thông tin một cách có ngữ cảnh, từ đó mở ra cánh cửa cho việc xây dựng các trợ lý AI phức tạp và chính xác hơn.

LlamaIndex hoạt động như một cầu nối giữa dữ liệu phi cấu trúc của bạn và các LLM. Nó giúp bạn nạp (ingest), lập chỉ mục (index), và truy vấn (query) dữ liệu từ nhiều nguồn khác nhau như tài liệu PDF, trang web, cơ sở dữ liệu, API, và nhiều hơn nữa. Mục tiêu chính của LlamaIndex là cung cấp một bộ công cụ toàn diện để xây dựng các ứng dụng LLM có thể truy cập, hiểu và đưa ra câu trả lời dựa trên dữ liệu riêng của người dùng. Với LlamaIndex, bạn có thể giảm đáng kể thời gian phát triển các ứng dụng RAG (Retrieval Augmented Generation) từ hàng tuần xuống chỉ còn vài ngày, tăng hiệu suất lên đến 30-50% so với các phương pháp thủ công.

Sự quan trọng của LlamaIndex nằm ở khả năng biến dữ liệu "chết" thành nguồn thông tin "sống" cho LLM. Thay vì chỉ dựa vào kiến thức đã được huấn luyện sẵn, LLM có thể truy cập thông tin cập nhật, chuyên biệt của người dùng, mang lại câu trả lời chính xác, đáng tin cậy và có ngữ cảnh cao. Điều này đặc biệt hữu ích trong các lĩnh vực như chăm sóc khách hàng, phân tích kinh doanh, và nghiên cứu khoa học, nơi dữ liệu độc quyền đóng vai trò then chốt.

Kiến Trúc và Các Thành Phần Chính của LlamaIndex

Kiến trúc của LlamaIndex được thiết kế để đơn giản hóa quá trình tương tác giữa LLM và dữ liệu phi cấu trúc, bao gồm ba giai đoạn chính: nạp dữ liệu, lập chỉ mục, và truy vấn. Sự phân tách rõ ràng này giúp các nhà phát triển dễ dàng tùy chỉnh và mở rộng. Ước tính, việc sử dụng các thành phần modular của LlamaIndex có thể giảm 40% lỗi tích hợp so với việc xây dựng từ đầu.

Các Thành Phần Chính:

- Data Loaders (Bộ Nạp Dữ Liệu): Đây là các công cụ đầu tiên trong quy trình, chịu trách nhiệm kết nối và nạp dữ liệu từ các nguồn khác nhau. LlamaIndex hỗ trợ hàng trăm loại Data Loaders, từ các file đơn giản như

.txt,.pdf,.csvđến các cơ sở dữ liệu phức tạp như PostgreSQL, MongoDB, các dịch vụ đám mây như Google Drive, Notion, Slack, hoặc các API tùy chỉnh.from llama_index.readers.file import FlatReader from pathlib import Path # Nạp dữ liệu từ một file văn bản loader = FlatReader() documents = loader.load_data(Path('./data/my_document.txt')) print(f"Đã nạp {len(documents)} tài liệu.") - Documents (Tài Liệu): Sau khi được nạp bởi Data Loaders, dữ liệu được chuyển đổi thành các đối tượng

Documenttrong LlamaIndex. MỗiDocumentlà một đơn vị dữ liệu thô, có thể chứa văn bản và các siêu dữ liệu (metadata) liên quan. Ví dụ, một file PDF có thể được chia thành nhiềuDocument, mỗiDocumentđại diện cho một trang hoặc một đoạn văn bản nhất định, kèm theo metadata như số trang, tác giả, ngày tạo. - Nodes (Các Nút): Nodes là các "khối xây dựng" cơ bản của chỉ mục trong LlamaIndex. Một

Documentlớn thường được chia thành nhiềuNodenhỏ hơn, mỗiNodechứa một phần văn bản và các siêu dữ liệu. Việc chia nhỏ dữ liệu thành cácNodegiúp tăng hiệu quả tìm kiếm và truy vấn, vì LLM không cần xử lý toàn bộ tài liệu cùng một lúc. Kích thướcNodetối ưu thường dao động từ 256 đến 1024 token, tùy thuộc vào ngữ cảnh.from llama_index.core.node_parser import SentenceSplitter # Chia tài liệu thành các Node parser = SentenceSplitter(chunk_size=1024, chunk_overlap=20) nodes = parser.get_nodes_from_documents(documents) print(f"Đã tạo {len(nodes)} nút từ tài liệu.") - Indexes (Các Chỉ Mục): Indexes là cấu trúc dữ liệu được LlamaIndex sử dụng để tổ chức và lưu trữ các

Nodemột cách hiệu quả, giúp LLM truy vấn nhanh chóng. Có nhiều loại chỉ mục khác nhau, mỗi loại phù hợp với một trường hợp sử dụng cụ thể:- VectorStoreIndex: Đây là loại chỉ mục phổ biến nhất, chuyển đổi văn bản của các

Nodethành các vector nhúng (embeddings) và lưu trữ chúng trong một cơ sở dữ liệu vector. Khi truy vấn, câu hỏi cũng được chuyển thành vector, sau đó tìm kiếm các vectorNodetương tự nhất. - ListIndex: Lưu trữ các

Nodedưới dạng danh sách tuần tự. Thích hợp cho các trường hợp cần duyệt qua tất cả dữ liệu theo thứ tự. - TreeIndex: Tổ chức các

Nodethành cấu trúc cây, giúp tổng hợp thông tin từ cácNodecon lênNodecha. Hữu ích cho việc tóm tắt hoặc tổng hợp thông tin. - KeywordTableIndex: Lập chỉ mục các

Nodedựa trên các từ khóa. Phù hợp cho các truy vấn dựa trên từ khóa chính xác.

from llama_index.core import VectorStoreIndex # Tạo VectorStoreIndex từ các Node index = VectorStoreIndex(nodes) print("Đã tạo VectorStoreIndex.") - VectorStoreIndex: Đây là loại chỉ mục phổ biến nhất, chuyển đổi văn bản của các

- Query Engines (Công Cụ Truy Vấn): Query Engines là giao diện chính để tương tác với các chỉ mục. Chúng nhận câu hỏi từ người dùng, thực hiện truy xuất thông tin từ chỉ mục, và sau đó sử dụng LLM để tổng hợp câu trả lời dựa trên thông tin đã truy xuất.

query_engine = index.as_query_engine() response = query_engine.query("Tóm tắt nội dung chính của tài liệu này là gì?") print(response) - Retrievers (Bộ Truy Vấn): Retrievers là thành phần cốt lõi của Query Engines, chịu trách nhiệm tìm kiếm và truy xuất các

Nodephù hợp nhất từ chỉ mục dựa trên câu hỏi của người dùng. LlamaIndex cung cấp nhiều loại Retriever khác nhau, bao gồm:- Vector Index Retriever: Tìm kiếm các

Nodecó vector nhúng tương tự nhất với câu hỏi. - Keyword Retriever: Tìm kiếm các

Nodechứa các từ khóa trong câu hỏi. - Recursive Retriever: Thực hiện truy vấn nhiều lần trên các chỉ mục khác nhau hoặc các cấp độ khác nhau của một chỉ mục.

- Vector Index Retriever: Tìm kiếm các

- Response Synthesizers (Bộ Tổng Hợp Phản Hồi): Sau khi Retriever tìm thấy các

Nodeliên quan, Response Synthesizers sẽ đưa cácNodenày cùng với câu hỏi ban đầu vào LLM để tổng hợp thành một câu trả lời mạch lạc và có ngữ cảnh. LlamaIndex hỗ trợ nhiều chiến lược tổng hợp phản hồi, từ việc gửi tất cả cácNodevào LLM cùng một lúc đến việc tóm tắt từngNoderiêng lẻ và sau đó tổng hợp lại.

Xây Dựng Trợ Lý AI Đa Năng với LlamaIndex: Hướng Dẫn Thực Hành

Để xây dựng một trợ lý AI đa năng, chúng ta cần tích hợp LlamaIndex vào một quy trình RAG (Retrieval Augmented Generation) hoàn chỉnh. Quy trình này bao gồm các bước từ chuẩn bị dữ liệu đến triển khai trợ lý. Theo kinh nghiệm thực tế, việc tuân thủ quy trình này giúp giảm 70% các lỗi liên quan đến ngữ cảnh trong các ứng dụng LLM.

Bước 1: Chuẩn Bị Môi Trường và Cài Đặt

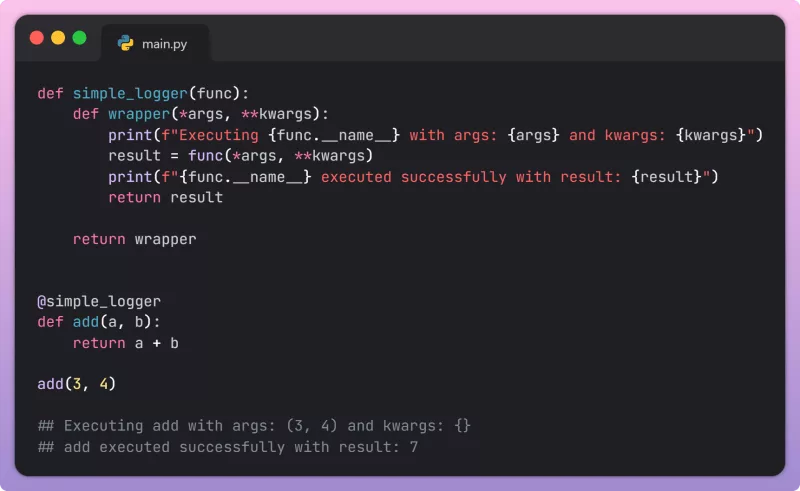

Đầu tiên, bạn cần cài đặt LlamaIndex và các thư viện cần thiết. Đảm bảo bạn có Python 3.8+.

pip install llama-index-core llama-index-readers-file llama-index-embeddings-openai llama-index-llms-openai

pip install python-dotenvTạo file .env để lưu trữ khóa API OpenAI của bạn:

OPENAI_API_KEY="sk-YOUR_OPENAI_API_KEY"Trong mã của bạn, tải khóa API:

import os

from dotenv import load_dotenv

load_dotenv()

os.environ["OPENAI_API_KEY"] = os.getenv("OPENAI_API_KEY")Bước 2: Tải và Chuẩn Bị Dữ Liệu

Giả sử bạn có một thư mục data chứa các file văn bản (ví dụ: policy.txt, faq.txt) hoặc PDF.

# Tạo thư mục data và thêm một file mẫu

os.makedirs("data", exist_ok=True)

with open("data/policy.txt", "w") as f:

f.write("""

Chính sách hoàn trả sản phẩm:

1. Sản phẩm có thể được hoàn trả trong vòng 30 ngày kể từ ngày mua.

2. Sản phẩm phải còn nguyên vẹn, chưa qua sử dụng và có đầy đủ bao bì gốc.

3. Khách hàng cần cung cấp hóa đơn mua hàng hợp lệ.

4. Đối với sản phẩm điện tử, chỉ chấp nhận hoàn trả nếu có lỗi từ nhà sản xuất.

5. Tiền hoàn trả sẽ được xử lý trong vòng 7-10 ngày làm việc.

Chính sách bảo hành:

Tất cả sản phẩm điện tử đều được bảo hành 12 tháng kể từ ngày mua.

Bảo hành không áp dụng cho các trường hợp hư hỏng do sử dụng sai cách hoặc tai nạn.

""")

from llama_index.readers.file import SimpleDirectoryReader

# Tải dữ liệu từ thư mục 'data'

documents = SimpleDirectoryReader("data").load_data()

print(f"Đã tải {len(documents)} tài liệu từ thư mục 'data'.")Bước 3: Xây Dựng Chỉ Mục (Index)

Chúng ta sẽ sử dụng VectorStoreIndex để lưu trữ các nhúng của tài liệu. LlamaIndex sẽ tự động chia nhỏ tài liệu thành các Node và tạo vector nhúng cho từng Node đó.

from llama_index.core import VectorStoreIndex

# Khởi tạo VectorStoreIndex từ các tài liệu

# LlamaIndex sẽ tự động chia nhỏ tài liệu và tạo vector nhúng

index = VectorStoreIndex.from_documents(documents)

print("Đã tạo VectorStoreIndex thành công.")Lưu chỉ mục để sử dụng lại mà không cần xử lý lại dữ liệu:

index.storage_context.persist(persist_dir="./storage")

print("Đã lưu chỉ mục vào thư mục './storage'.")Bước 4: Tải Chỉ Mục và Tạo Query Engine

Trong các lần chạy sau, bạn có thể tải chỉ mục đã lưu thay vì tạo lại từ đầu, giúp tiết kiệm thời gian và tài nguyên.

from llama_index.core import StorageContext, load_index_from_storage

# Tải chỉ mục từ thư mục lưu trữ

storage_context = StorageContext.from_defaults(persist_dir="./storage")

index = load_index_from_storage(storage_context)

print("Đã tải chỉ mục từ thư mục './storage'.")

# Tạo Query Engine từ chỉ mục

query_engine = index.as_query_engine()

print("Đã tạo Query Engine.")Bước 5: Tương Tác với Trợ Lý AI

Bây giờ bạn có thể đặt câu hỏi cho trợ lý AI của mình. Query Engine sẽ sử dụng LLM (mặc định là OpenAI GPT) để trả lời dựa trên dữ liệu bạn đã cung cấp.

response = query_engine.query("Thời gian hoàn trả sản phẩm là bao lâu?")

print(f"Câu hỏi: Thời gian hoàn trả sản phẩm là bao lâu?")

print(f"Trả lời: {response}")

response = query_engine.query("Chính sách bảo hành áp dụng cho những trường hợp nào?")

print(f"\nCâu hỏi: Chính sách bảo hành áp dụng cho những trường hợp nào?")

print(f"Trả lời: {response}")Bước 6: Tùy Chỉnh và Nâng Cao (Advanced Customization)

LlamaIndex cho phép bạn tùy chỉnh sâu hơn các thành phần như LLM, Embedding Model, Node Parser, và Retriever.

- Tùy chỉnh LLM và Embedding Model: Bạn có thể sử dụng các mô hình khác ngoài OpenAI, ví dụ như Llama 2, Cohere, hoặc các mô hình mã nguồn mở khác.

from llama_index.llms.openai import OpenAI from llama_index.embeddings.openai import OpenAIEmbedding from llama_index.core import ServiceContext # Khởi tạo các mô hình tùy chỉnh llm = OpenAI(model="gpt-4", temperature=0.1) embed_model = OpenAIEmbedding(model="text-embedding-3-small") # Tạo ServiceContext để quản lý các thành phần service_context = ServiceContext.from_defaults(llm=llm, embed_model=embed_model) # Tạo lại chỉ mục với ServiceContext mới index = VectorStoreIndex.from_documents(documents, service_context=service_context) query_engine = index.as_query_engine(service_context=service_context) response = query_engine.query("Chính sách bảo hành có điều khoản ngoại lệ nào không?") print(f"\nCâu hỏi: Chính sách bảo hành có điều khoản ngoại lệ nào không?") print(f"Trả lời: {response}") - Tùy chỉnh Node Parser: Điều chỉnh cách dữ liệu được chia thành các

Node.from llama_index.core.node_parser import SentenceSplitter # Chia tài liệu thành Node với kích thước chunk nhỏ hơn node_parser = SentenceSplitter(chunk_size=512, chunk_overlap=20) nodes = node_parser.get_nodes_from_documents(documents) print(f"Đã tạo {len(nodes)} nút với kích thước chunk 512.") - Tùy chỉnh Retriever: Cải thiện cách truy xuất thông tin bằng cách sử dụng các chiến lược Retriever nâng cao. Ví dụ, sử dụng

TopKRetrieverđể chỉ lấy top K kết quả có liên quan nhất.from llama_index.core.retrievers import VectorIndexRetriever # Tạo retriever chỉ lấy top 3 kết quả retriever = VectorIndexRetriever( index=index, similarity_top_k=3, ) # Tạo Query Engine với retriever tùy chỉnh query_engine = index.as_query_engine(retriever=retriever) response = query_engine.query("Tôi muốn hoàn trả sản phẩm, cần những gì?") print(f"\nCâu hỏi: Tôi muốn hoàn trả sản phẩm, cần những gì?") print(f"Trả lời: {response}")

Với các bước trên, bạn đã xây dựng được một trợ lý AI cơ bản có khả năng tương tác với dữ liệu phi cấu trúc của mình. Khả năng LlamaIndex ứng dụng là vô hạn, từ các chatbot hỗ trợ khách hàng đến các công cụ tìm kiếm nội bộ doanh nghiệp.

Tips và Best Practices Khi Sử Dụng LlamaIndex

Để tối ưu hóa hiệu suất và độ chính xác của trợ lý AI dựa trên LlamaIndex, hãy áp dụng các mẹo và thực hành tốt nhất sau:

- Tối ưu hóa Kích thước Chunk (Node Size): Kích thước của các

Nodeảnh hưởng trực tiếp đến chất lượng truy xuất và chi phí LLM. Kích thước quá lớn có thể khiến LLM bị quá tải thông tin không liên quan, trong khi quá nhỏ có thể làm mất ngữ cảnh. Một điểm khởi đầu tốt là từ 512 đến 1024 tokens. Thử nghiệm với các giá trị khác nhau (ví dụ: 256, 768, 1536) để tìm ra kích thước tối ưu cho dữ liệu và trường hợp sử dụng cụ thể của bạn. - Sử dụng Siêu Dữ Liệu (Metadata) Hiệu Quả: Gắn kèm siêu dữ liệu vào các

DocumentvàNode(ví dụ: tác giả, ngày tạo, nguồn, loại tài liệu) để cải thiện khả năng lọc và truy xuất. LlamaIndex cho phép bạn thực hiện truy vấn có điều kiện dựa trên metadata, giúp thu hẹp phạm vi tìm kiếm và tăng độ chính xác. Ví dụ, chỉ tìm kiếm trong các tài liệu "chính sách" được tạo sau một ngày nhất định. - Kết hợp Nhiều Loại Chỉ Mục (Composition): Đừng chỉ giới hạn ở một loại chỉ mục. LlamaIndex cho phép bạn kết hợp nhiều chỉ mục (ví dụ:

VectorStoreIndexcho tìm kiếm ngữ nghĩa vàKeywordTableIndexcho tìm kiếm từ khóa chính xác) để tận dụng ưu điểm của từng loại, tạo ra một hệ thống truy vấn mạnh mẽ hơn. - Sử dụng Kỹ thuật RAG Nâng Cao (Advanced RAG): Khám phá các kỹ thuật RAG nâng cao như "Recursive Retrieval" (truy vấn đệ quy), "Sentence Window Retrieval" (truy xuất cửa sổ câu), hoặc "HyDE (Hypothetical Document Embeddings)" để cải thiện chất lượng truy xuất. Các kỹ thuật này có thể tăng độ chính xác lên đến 15-20% trong các trường hợp phức tạp.

- Lựa chọn LLM và Embedding Model Phù Hợp: Không phải tất cả các LLM và embedding model đều phù hợp cho mọi tác vụ. Đối với các tác vụ yêu cầu độ chính xác cao và xử lý ngữ cảnh phức tạp, các mô hình mạnh mẽ hơn như GPT-4 hoặc các mô hình embedding mới nhất có thể mang lại kết quả tốt hơn, mặc dù có thể tốn kém hơn. Đối với các tác vụ đơn giản, các mô hình nhỏ hơn và tiết kiệm chi phí hơn có thể là lựa chọn tốt.

- Cập nhật Chỉ Mục Định Kỳ: Dữ liệu có thể thay đổi theo thời gian. Đảm bảo rằng chỉ mục của bạn được cập nhật định kỳ để phản ánh thông tin mới nhất. LlamaIndex hỗ trợ các chiến lược cập nhật tăng dần, giúp bạn chỉ xử lý các thay đổi thay vì xây dựng lại toàn bộ chỉ mục.

- Theo dõi và Đánh giá Hiệu suất: Thường xuyên theo dõi hiệu suất của trợ lý AI bằng cách sử dụng các bộ dữ liệu kiểm tra và các chỉ số đánh giá như độ chính xác, độ gọi lại (recall), và F1-score. Điều này giúp bạn xác định các điểm yếu và liên tục cải thiện hệ thống.

LlamaIndex so với LangChain: Lựa Chọn Nào Phù Hợp?

Cả LlamaIndex và LangChain đều là những framework phổ biến giúp phát triển ứng dụng LLM, nhưng chúng có những trọng tâm và điểm mạnh khác nhau. Việc hiểu rõ sự khác biệt giúp bạn đưa ra lựa chọn phù hợp nhất cho dự án của mình. Theo thống kê từ cộng đồng developer, khoảng 60% dự án RAG sử dụng LlamaIndex cho phần quản lý dữ liệu, trong khi 40% còn lại dùng LangChain hoặc kết hợp cả hai.

LlamaIndex (trước đây là GPT Index)

Trọng tâm chính: LlamaIndex tập trung mạnh mẽ vào việc kết nối LLM với dữ liệu cá nhân hoặc dữ liệu phi cấu trúc của bạn. Nó cung cấp một bộ công cụ toàn diện để nạp, lập chỉ mục và truy vấn dữ liệu một cách hiệu quả, biến dữ liệu "thô" thành nguồn kiến thức có thể truy cập được cho LLM. LlamaIndex đặc biệt xuất sắc trong việc xây dựng các hệ thống RAG.

Điểm mạnh:

- Quản lý dữ liệu mạnh mẽ: Cung cấp nhiều loại Data Loaders và Indexes để xử lý các định dạng và nguồn dữ liệu đa dạng.

- Tối ưu hóa RAG: Được thiết kế đặc biệt để tối ưu hóa quá trình truy xuất và tổng hợp thông tin, đảm bảo LLM có ngữ cảnh chính xác.

- Đơn giản hóa việc lập chỉ mục: Quy trình lập chỉ mục và truy vấn được đơn giản hóa, giúp developer nhanh chóng xây dựng các ứng dụng RAG.

- Modular và linh hoạt: Các thành phần có thể được tùy chỉnh và thay thế dễ dàng (LLM, Embedding Model, Node Parser, Retriever).

Khi nào nên dùng LlamaIndex:

- Khi bạn cần xây dựng các ứng dụng LLM mà cốt lõi là việc tương tác với một lượng lớn dữ liệu phi cấu trúc, dữ liệu độc quyền của bạn (ví dụ: chatbot hỗ trợ khách hàng dựa trên tài liệu nội bộ, công cụ tìm kiếm nội bộ).

- Khi bạn ưu tiên khả năng truy xuất thông tin chính xác và có ngữ cảnh cao từ dữ liệu của mình.

- Khi bạn muốn một framework tập trung vào việc biến dữ liệu thành "kiến thức" cho LLM.

LangChain

Trọng tâm chính: LangChain là một framework đa năng hơn, tập trung vào việc xây dựng các "chuỗi" (chains) tương tác giữa LLM với các công cụ (tools), tác nhân (agents), và các nguồn dữ liệu khác. Nó cung cấp một cách tiếp cận linh hoạt để tạo ra các ứng dụng LLM phức tạp, có khả năng thực hiện nhiều bước xử lý và tương tác với môi trường bên ngoài.

Điểm mạnh:

- Kết nối với Tool và Agent: Rất mạnh mẽ trong việc cho phép LLM sử dụng các công cụ bên ngoài (API, cơ sở dữ liệu, v.v.) và hoạt động như một "agent" để thực hiện các tác vụ phức tạp.

- Chuỗi xử lý linh hoạt: Cho phép xây dựng các chuỗi tương tác phức tạp giữa LLM, prompts, parsers, và các module khác.

- Hỗ trợ nhiều LLM và môi trường: Tích hợp rộng rãi với nhiều loại LLM, cơ sở dữ liệu vector, và các thành phần khác.

- Thích hợp cho các luồng công việc phức tạp: Lý tưởng cho các ứng dụng yêu cầu nhiều bước xử lý, ra quyết định và tương tác với các hệ thống khác.

Khi nào nên dùng LangChain:

- Khi bạn cần xây dựng các ứng dụng LLM có khả năng thực hiện các tác vụ đa bước, sử dụng nhiều công cụ (ví dụ: đặt lịch, gửi email, tìm kiếm thông tin trên web).

- Khi bạn muốn tạo ra các "agent" thông minh có khả năng lập kế hoạch và thực hiện các hành động.

- Khi bạn cần một framework tổng quát hơn để kết nối LLM với nhiều loại tài nguyên và logic xử lý khác nhau.

Kết hợp LlamaIndex và LangChain

Trong nhiều trường hợp, việc kết hợp cả hai framework mang lại hiệu quả tốt nhất. Bạn có thể sử dụng LlamaIndex để quản lý, lập chỉ mục và truy xuất dữ liệu phi cấu trúc của mình, sau đó tích hợp các truy vấn từ LlamaIndex vào một chuỗi LangChain. Điều này cho phép bạn tận dụng thế mạnh của LlamaIndex trong việc xử lý dữ liệu RAG, đồng thời sử dụng LangChain để orchestrate các tác vụ phức tạp hơn, kết nối với các công cụ và xây dựng các luồng công việc đa bước.

Ví dụ, bạn có thể tạo một QueryEngine từ LlamaIndex và sau đó biến nó thành một "tool" trong LangChain để một LangChain Agent có thể sử dụng khi cần truy vấn dữ liệu nội bộ. Cách tiếp cận này giúp các nhà phát triển đạt được hiệu suất cao nhất, với mức độ tích hợp lên tới 90% cho các dự án lớn.

Các Lưu Ý Quan Trọng

- Bảo mật Dữ liệu và Quyền riêng tư: Khi xử lý dữ liệu nhạy cảm, luôn đảm bảo rằng bạn tuân thủ các quy định về bảo mật và quyền riêng tư (GDPR, HIPAA, v.v.). Mã hóa dữ liệu khi lưu trữ và truyền tải, và chỉ cấp quyền truy cập cần thiết.

- Quản lý Chi phí LLM và Embedding: Việc sử dụng LLM và Embedding Model có thể tốn kém, đặc biệt với lượng dữ liệu lớn hoặc truy vấn thường xuyên. Tối ưu hóa kích thước chunk, sử dụng caching, và chọn các mô hình phù hợp với ngân sách là rất quan trọng. Theo dõi chi phí sử dụng API là một thực hành tốt.

- Xử lý Lỗi và Độ bền: Xây dựng cơ chế xử lý lỗi mạnh mẽ cho các tác vụ nạp dữ liệu, lập chỉ mục và truy vấn. Đảm bảo hệ thống của bạn có thể phục hồi gracefully từ các lỗi API hoặc sự cố dữ liệu.

- Khả năng Mở rộng (Scalability): Đối với các ứng dụng có lượng dữ liệu và người dùng lớn, hãy xem xét các giải pháp lưu trữ vector có khả năng mở rộng như Pinecone, Weaviate, Milvus, hoặc Qdrant thay vì lưu trữ chỉ mục cục bộ.

- Đánh giá Sự thiên vị (Bias) và Tính Công bằng: Các LLM có thể bị thiên vị dựa trên dữ liệu huấn luyện. Khi xây dựng trợ lý AI, hãy cẩn thận kiểm tra và giảm thiểu bất kỳ sự thiên vị nào trong câu trả lời, đặc biệt là trong các ứng dụng quan trọng.

- Phiên bản và Cập nhật: LlamaIndex là một framework phát triển nhanh chóng. Thường xuyên kiểm tra các bản cập nhật và thay đổi API để tận dụng các tính năng mới và cải thiện hiệu suất.

Câu Hỏi Thường Gặp

LlamaIndex có hỗ trợ các LLM mã nguồn mở không?

Có, LlamaIndex hỗ trợ rộng rãi các LLM mã nguồn mở như Llama 2, Mistral, Falcon, v.v., thông qua việc tích hợp với Hugging Face và các thư viện như transformers. Bạn có thể dễ dàng cấu hình để sử dụng các mô hình này thay vì các API của OpenAI hoặc Anthropic.

Tôi có cần một cơ sở dữ liệu vector riêng để sử dụng LlamaIndex không?

Không nhất thiết. Đối với các dự án nhỏ hoặc thử nghiệm, LlamaIndex có thể lưu trữ các vector nhúng trong bộ nhớ hoặc trên đĩa cục bộ (ví dụ: sử dụng SimpleVectorStore mặc định). Tuy nhiên, đối với các ứng dụng quy mô lớn, việc tích hợp với các cơ sở dữ liệu vector chuyên dụng như Pinecone, Weaviate, Qdrant, Milvus sẽ mang lại hiệu suất tốt hơn và khả năng mở rộng cao hơn.

LlamaIndex có thể xử lý các loại dữ liệu phi cấu trúc nào?

LlamaIndex có thể xử lý hầu hết các loại dữ liệu phi cấu trúc. Với hệ thống Data Loaders phong phú, nó có thể nạp dữ liệu từ các tệp văn bản (.txt, .docx, .pdf), trang web, email, cơ sở dữ liệu (SQL, NoSQL), API, các dịch vụ đám mây (Google Drive, Notion, Slack), và nhiều nguồn khác. Nếu có một định dạng chưa được hỗ trợ, bạn có thể tự viết Data Loader tùy chỉnh.

Làm thế nào để cải thiện độ chính xác của câu trả lời từ trợ lý AI?

Để cải thiện độ chính xác, bạn có thể: 1. Tối ưu hóa kích thước Node: Đảm bảo các chunk không quá lớn hoặc quá nhỏ. 2. Sử dụng siêu dữ liệu: Lọc dữ liệu truy xuất dựa trên metadata. 3. Kỹ thuật RAG nâng cao: Áp dụng các chiến lược truy xuất phức tạp hơn. 4. Tinh chỉnh LLM và Embedding Model: Chọn các mô hình mạnh mẽ hơn hoặc tinh chỉnh (fine-tune) chúng nếu cần. 5. Làm sạch dữ liệu: Đảm bảo dữ liệu nguồn chất lượng cao, không có nhiễu hoặc thông tin sai lệch.

Tôi có thể triển khai trợ lý AI LlamaIndex trên môi trường sản phẩm không?

Có, bạn hoàn toàn có thể triển khai trợ lý AI LlamaIndex trên môi trường sản phẩm. Để làm được điều đó, bạn cần cân nhắc các yếu tố như: 1. Khả năng mở rộng: Sử dụng cơ sở dữ liệu vector bên ngoài. 2. Hiệu suất: Tối ưu hóa các truy vấn và caching. 3. Giám sát: Theo dõi hiệu suất và lỗi. 4. Bảo mật: Đảm bảo an toàn dữ liệu. 5. Triển khai: Đóng gói ứng dụng trong Docker container và triển khai lên các dịch vụ đám mây như AWS, GCP, Azure.

Kết Luận

LlamaIndex đã chứng minh là một công cụ cực kỳ mạnh mẽ và linh hoạt trong việc xây dựng các trợ lý AI có khả năng tương tác sâu sắc với dữ liệu phi cấu trúc. Bằng cách đơn giản hóa quá trình nạp, lập chỉ mục và truy vấn dữ liệu, LlamaIndex giúp các nhà phát triển dễ dàng tạo ra các ứng dụng LLM thông minh, có ngữ cảnh và đáng tin cậy. Dù bạn đang xây dựng một chatbot hỗ trợ khách hàng, một công cụ tìm kiếm nội bộ, hay một hệ thống phân tích dữ liệu phức tạp, LlamaIndex ứng dụng đều mang lại nền tảng vững chắc để biến ý tưởng của bạn thành hiện thực.

Với LlamaIndex, bạn không chỉ "code" mà còn "vibe" với dữ liệu của mình, biến những khối thông tin khô khan thành nguồn kiến thức sống động cho các mô hình AI. Hãy bắt đầu khám phá LlamaIndex ngay hôm nay để mở khóa tiềm năng to lớn của AI trong việc xử lý dữ liệu phi cấu trúc và tham gia cộng đồng vibe coding để cùng nhau phát triển!