Giới Thiệu: Tối Ưu Hóa Chi Phí AI API: Chiến Lược Quản Lý Rate Limiting Hiệu Quả cho Lập Trình Viên Vibe Coding

Trong thế giới phát triển AI năng động ngày nay, việc tích hợp các API trí tuệ nhân tạo vào ứng dụng đã trở thành một xu hướng tất yếu. Từ việc tạo sinh nội dung, phân tích cảm xúc, đến nhận diện hình ảnh, các AI API mang lại sức mạnh đáng kinh ngạc. Tuy nhiên, đi kèm với sức mạnh đó là bài toán về chi phí và hiệu suất, đặc biệt là khi đối mặt với cơ chế rate limiting API AI từ các nhà cung cấp. Bài viết này sẽ giúp bạn hiểu rõ về rate limiting API AI từ góc nhìn thực tế, cung cấp các chiến lược và ví dụ cụ thể để tối ưu hóa việc sử dụng, đảm bảo ứng dụng của bạn hoạt động mượt mà và tiết kiệm chi phí nhất có thể. Chúng ta sẽ cùng nhau khám phá những kỹ thuật để biến thách thức này thành cơ hội.

Rate Limiting API AI là gì và tại sao nó quan trọng?

Rate limiting, hay còn gọi là giới hạn tỷ lệ yêu cầu, là một cơ chế được các nhà cung cấp API (như OpenAI, Google Cloud AI, Anthropic, v.v.) áp dụng để kiểm soát số lượng yêu cầu mà một người dùng hoặc ứng dụng có thể gửi đến API của họ trong một khoảng thời gian nhất định. Mục đích chính của rate limiting API AI là để bảo vệ hệ thống khỏi việc quá tải, ngăn chặn các cuộc tấn công DDoS, đảm bảo tính công bằng trong việc phân bổ tài nguyên, và quan trọng nhất đối với người dùng là để quản lý chi phí. Mỗi nhà cung cấp có thể có các chính sách rate limiting khác nhau, dựa trên số lượng request mỗi phút (RPM), số lượng token mỗi phút (TPM), hoặc thậm chí là số lượng request đồng thời.

Đối với các lập trình viên, việc hiểu và quản lý rate limiting là cực kỳ quan trọng. Nếu không xử lý đúng cách, ứng dụng của bạn có thể liên tục gặp lỗi 429 Too Many Requests, dẫn đến trải nghiệm người dùng kém, gián đoạn dịch vụ, và tệ hơn là lãng phí tài nguyên tính toán của bạn khi phải retry các yêu cầu thất bại. Đặc biệt với AI API, nơi mỗi request thường tốn kém hơn các API thông thường, việc vượt quá giới hạn không chỉ gây lỗi mà còn có thể làm tăng chi phí một cách không mong muốn nếu bạn không có cơ chế quản lý phù hợp.

Một ví dụ điển hình là khi bạn xây dựng một ứng dụng chatbot sử dụng OpenAI API. Mỗi lần người dùng gửi tin nhắn, ứng dụng của bạn sẽ gọi API để tạo phản hồi. Nếu có hàng trăm người dùng cùng lúc tương tác, hoặc một người dùng gửi quá nhiều tin nhắn liên tục, bạn rất dễ chạm ngưỡng rate limiting API AI. Việc này đòi hỏi một chiến lược xử lý lỗi và tái thử (retry) thông minh để đảm bảo các tin nhắn vẫn được xử lý mà không làm sập hệ thống hoặc phát sinh chi phí vượt mức dự kiến.

Ngoài ra, rate limiting còn giúp các nhà cung cấp dịch vụ AI duy trì chất lượng dịch vụ (QoS) cho tất cả người dùng. Bằng cách giới hạn lượng truy cập, họ có thể đảm bảo rằng tài nguyên GPU và CPU được phân bổ hợp lý, tránh tình trạng một số người dùng "độc chiếm" tài nguyên, làm chậm trễ phản hồi cho những người dùng khác. Điều này tạo ra một môi trường ổn định và công bằng cho toàn bộ hệ sinh thái AI.

Chiến Lược Quản Lý Rate Limiting Hiệu Quả cho Lập Trình Viên

1. Hiểu Rõ Giới Hạn của Từng API

Bước đầu tiên và quan trọng nhất là đọc kỹ tài liệu của nhà cung cấp API để nắm rõ các giới hạn cụ thể. Mỗi API có thể có các giới hạn khác nhau cho từng endpoint, từng gói dịch vụ, hoặc thậm chí là dựa trên lịch sử sử dụng của bạn. Hãy tìm kiếm các thông số như "Requests Per Minute (RPM)", "Tokens Per Minute (TPM)", "Concurrent Requests", và các header HTTP liên quan đến rate limiting như X-RateLimit-Limit, X-RateLimit-Remaining, X-RateLimit-Reset.

Ví dụ, OpenAI có giới hạn TPM và RPM riêng cho từng mô hình và từng cấp độ tài khoản. Việc biết chính xác các con số này sẽ giúp bạn thiết kế kiến trúc ứng dụng sao cho phù hợp, tránh việc dự đoán sai và liên tục gặp lỗi. Đừng ngần ngại liên hệ với bộ phận hỗ trợ của nhà cung cấp nếu bạn có bất kỳ thắc mắc nào về giới hạn của họ.

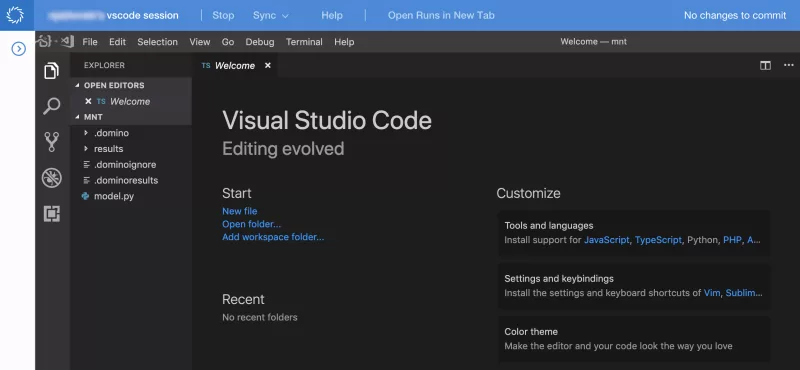

2. Triển Khai Cơ Chế Retry với Exponential Backoff

Khi gặp lỗi 429 Too Many Requests, việc tái thử ngay lập tức thường không phải là giải pháp tốt, vì bạn có thể tiếp tục bị chặn. Thay vào đó, hãy triển khai cơ chế retry với exponential backoff. Đây là một chiến lược mà theo đó, ứng dụng sẽ chờ đợi một khoảng thời gian tăng dần trước khi gửi lại yêu cầu. Ví dụ: chờ 1 giây, sau đó 2 giây, 4 giây, 8 giây, v.v., cho đến khi yêu cầu thành công hoặc đạt đến một số lần thử tối đa.

Thư viện như tenacity trong Python, hoặc các thư viện retry tích hợp sẵn trong SDK của các nhà cung cấp cloud, thường hỗ trợ cơ chế này. Điều này giúp giảm áp lực lên API server và tăng khả năng yêu cầu của bạn được xử lý thành công khi hệ thống đã ổn định trở lại.

import openai

import time

import random

def call_openai_with_retry(prompt, max_retries=5):

for i in range(max_retries):

try:

response = openai.Completion.create(

model="text-davinci-003",

prompt=prompt,

max_tokens=50

)

return response.choices[0].text.strip()

except openai.error.RateLimitError as e:

wait_time = (2 <strong> i) + random.uniform(0, 1) # Exponential backoff with jitter

print(f"Rate limit hit. Retrying in {wait_time:.2f} seconds...")

time.sleep(wait_time)

except Exception as e:

print(f"An unexpected error occurred: {e}")

break

print(f"Failed to call OpenAI API after {max_retries} retries.")

return None

# Ví dụ sử dụng

# openai.api_key = "YOUR_API_KEY"

# result = call_openai_with_retry("Viết một đoạn văn ngắn về tầm quan trọng của AI.")

# if result:

# print(result)

Trong đoạn code trên, chúng ta sử dụng vòng lặp for để thử lại yêu cầu. Khi gặp lỗi RateLimitError, chúng ta tính toán thời gian chờ đợi dựa trên (2 i) (exponential backoff) và thêm một giá trị ngẫu nhiên nhỏ (jitter) để tránh hiệu ứng "thundering herd" (tất cả các client retry cùng lúc). Đây là một cách tiếp cận mạnh mẽ để xử lý rate limiting API AI một cách bền vững.

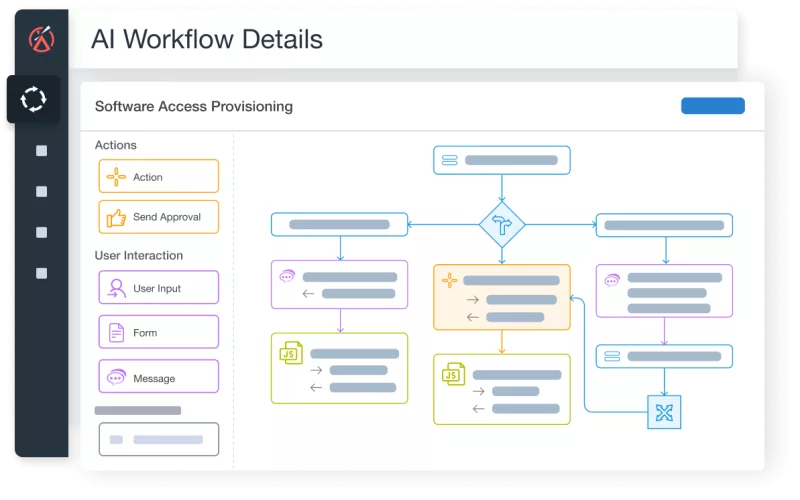

3. Sử Dụng Queues (Hàng Đợi) và Workers

Đối với các ứng dụng có lượng yêu cầu lớn, việc sử dụng hàng đợi (queues) là một chiến lược cực kỳ hiệu quả. Thay vì gọi API trực tiếp, bạn hãy đẩy các yêu cầu vào một hàng đợi (ví dụ: Redis Queue, RabbitMQ, Kafka). Sau đó, một hoặc nhiều worker process sẽ lấy các yêu cầu từ hàng đợi và gửi đến API một cách có kiểm soát. Các worker này có thể được cấu hình để tuân thủ giới hạn tốc độ yêu cầu của API.

Cách tiếp cận này giúp decouple quá trình tạo yêu cầu với quá trình xử lý, làm cho hệ thống của bạn trở nên mạnh mẽ hơn và có khả năng mở rộng. Nếu một worker gặp lỗi rate limit, các worker khác vẫn có thể tiếp tục xử lý các yêu cầu còn lại trong hàng đợi, hoặc worker bị lỗi có thể tạm dừng và retry sau.

# Ví dụ đơn giản về việc sử dụng queue (giả định)

# Trong thực tế, bạn sẽ dùng các thư viện queue chuyên dụng như Celery, RQ

import collections

import threading

import time

request_queue = collections.deque()

processed_results = []

rate_limit_per_minute = 10 # Giả định 10 request/phút

def worker_process():

last_request_time = time.time()

request_count_in_minute = 0

while True:

current_time = time.time()

# Reset count nếu đã qua 1 phút

if current_time - last_request_time >= 60:

request_count_in_minute = 0

last_request_time = current_time

if request_queue and request_count_in_minute < rate_limit_per_minute:

task = request_queue.popleft()

print(f"Processing task: {task['id']}")

# Giả lập gọi AI API

time.sleep(task['processing_time']) # Giả sử API call mất thời gian

processed_results.append(f"Result for {task['id']}")

request_count_in_minute += 1

last_request_time = time.time() # Cập nhật thời điểm request cuối cùng

else:

time.sleep(1) # Chờ 1 giây nếu không có task hoặc đã đạt giới hạn

# Khởi tạo worker trong một thread

worker_thread = threading.Thread(target=worker_process)

worker_thread.daemon = True

worker_thread.start()

# Thêm các yêu cầu vào queue

for i in range(20):

request_queue.append({'id': i, 'processing_time': random.uniform(0.1, 0.5)})

time.sleep(0.1) # Simulate requests coming in

# Chờ cho đến khi tất cả request được xử lý (trong thực tế sẽ phức tạp hơn)

while len(processed_results) < 20:

time.sleep(1)

print("All requests processed.")

print(processed_results)

Đoạn mã trên minh họa cách một worker có thể lấy yêu cầu từ một hàng đợi và xử lý chúng trong khi tuân thủ một giới hạn tốc độ đơn giản (10 request/phút). Đây là một nguyên tắc cơ bản cho việc quản lý rate limiting API AI ở quy mô lớn.

4. Caching Kết Quả API

Không phải mọi yêu cầu đều cần được gửi đến API mỗi lần. Nếu bạn có các yêu cầu lặp lại cho cùng một đầu vào (ví dụ: phân tích cảm xúc của một đoạn văn bản phổ biến, hoặc tạo mô tả sản phẩm cho một sản phẩm đã có), hãy cân nhắc việc caching kết quả. Khi một yêu cầu đến, trước tiên hãy kiểm tra cache. Nếu kết quả đã có sẵn, hãy trả về từ cache thay vì gọi API. Điều này không chỉ giúp giảm số lượng yêu cầu đến API mà còn cải thiện đáng kể tốc độ phản hồi của ứng dụng và giảm chi phí.

Bạn có thể sử dụng các hệ thống cache như Redis, Memcached, hoặc thậm chí là một cache trong bộ nhớ đơn giản cho các trường hợp nhỏ. Hãy đảm bảo rằng chiến lược cache của bạn có cơ chế hết hạn (expiration) phù hợp để tránh trả về dữ liệu cũ.

5. Batching Requests

Một số AI API cho phép bạn gửi nhiều yêu cầu trong một lần gọi (batching). Thay vì gửi 100 yêu cầu riêng lẻ, bạn có thể nhóm chúng lại thành một yêu cầu duy nhất chứa 100 tác vụ. Điều này thường hiệu quả hơn vì nó giảm overhead của việc thiết lập kết nối cho mỗi yêu cầu và có thể được xử lý nhanh hơn ở phía server. Tuy nhiên, hãy kiểm tra tài liệu API để xem nhà cung cấp có hỗ trợ batching hay không và giới hạn kích thước batch là bao nhiêu.

Batching đặc biệt hữu ích cho các tác vụ như embedding (nhúng) văn bản hoặc xử lý hình ảnh, nơi bạn có thể gom nhiều item nhỏ lại để xử lý đồng thời, giúp tối ưu hóa việc sử dụng rate limiting API AI và băng thông mạng.

6. Sử Dụng Throttling (Giới Hạn Tốc Độ Chủ Động)

Thay vì chờ đợi bị chặn bởi server, bạn có thể chủ động giới hạn tốc độ gửi yêu cầu từ phía client. Điều này được gọi là throttling. Bạn có thể xây dựng một bộ điều khiển tốc độ (rate limiter) cục bộ trong ứng dụng của mình, sử dụng thuật toán như Token Bucket hoặc Leaky Bucket. Bộ điều khiển này sẽ đảm bảo rằng ứng dụng của bạn không bao giờ vượt quá giới hạn tốc độ đã biết của API.

Throttling giúp giảm thiểu số lần gặp lỗi 429, từ đó giảm thiểu số lần retry và cải thiện độ ổn định tổng thể của ứng dụng. Nó hoạt động tốt nhất khi bạn có thông tin chính xác về giới hạn của API.

Tips và Best Practices để Quản Lý Rate Limiting API AI

- Giám sát và Cảnh báo (Monitoring & Alerting): Luôn theo dõi số lượng yêu cầu API và tỷ lệ lỗi

429của ứng dụng. Thiết lập các cảnh báo để bạn có thể phản ứng nhanh chóng khi ứng dụng bắt đầu chạm ngưỡng giới hạn. Các công cụ như Prometheus, Grafana, hoặc các dịch vụ giám sát của nhà cung cấp cloud (AWS CloudWatch, Google Cloud Monitoring) rất hữu ích cho việc này. - Kiểm tra Header HTTP: Nhiều API cung cấp các header HTTP hữu ích như

X-RateLimit-Limit,X-RateLimit-Remaining, vàX-RateLimit-Resettrong phản hồi của họ. Hãy sử dụng thông tin này để điều chỉnh động tốc độ gửi yêu cầu của bạn. Điều này đặc biệt hữu ích khi giới hạn tốc độ có thể thay đổi hoặc khác nhau giữa các tài khoản. - Sử dụng Client Libraries Chính Thức: Hầu hết các nhà cung cấp AI API lớn đều cung cấp các client library (SDK) chính thức cho nhiều ngôn ngữ lập trình. Các thư viện này thường đã tích hợp sẵn cơ chế retry với exponential backoff và các tính năng quản lý rate limiting API AI khác, giúp bạn tiết kiệm thời gian và công sức.

- Phân bổ Yêu cầu (Request Distribution): Nếu bạn có nhiều tác vụ cần gọi API, hãy cố gắng phân bổ chúng đều trong suốt một khoảng thời gian thay vì gửi tất cả cùng một lúc. Điều này giúp làm phẳng "đỉnh" (peak) yêu cầu và dễ dàng quản lý hơn.

- Xem xét Nâng cấp Gói Dịch vụ: Nếu bạn liên tục gặp phải vấn đề về rate limiting dù đã áp dụng các chiến lược tối ưu, có thể đã đến lúc xem xét nâng cấp gói dịch vụ của mình lên một cấp độ cao hơn với giới hạn tốc độ lớn hơn. Hãy tính toán chi phí-lợi ích một cách cẩn thận.

- Thiết kế Ứng dụng Không Đồng Bộ (Asynchronous Design): Sử dụng các mô hình lập trình không đồng bộ (như

async/awaittrong Python, Node.js) để xử lý các cuộc gọi API. Điều này giúp ứng dụng của bạn không bị chặn trong khi chờ đợi phản hồi từ API, cho phép nó xử lý các tác vụ khác và quản lý hàng đợi hiệu quả hơn.

So Sánh Các Phương Pháp Quản Lý Rate Limiting

Việc lựa chọn chiến lược quản lý rate limiting API AI phù hợp phụ thuộc vào quy mô ứng dụng, yêu cầu về độ trễ, và ngân sách của bạn. Dưới đây là bảng so sánh ngắn gọn:

- Retry với Exponential Backoff:

- Ưu điểm: Đơn giản, dễ triển khai, hiệu quả cho các lỗi tạm thời.

- Nhược điểm: Không ngăn chặn được việc chạm giới hạn ban đầu, có thể dẫn đến độ trễ cao nếu API liên tục bị quá tải.

- Phù hợp cho: Ứng dụng nhỏ đến trung bình, các tác vụ không quá nhạy cảm về độ trễ, hoặc như một lớp phòng thủ đầu tiên.

- Hàng đợi (Queues) và Workers:

- Ưu điểm: Khả năng mở rộng cao, bền vững, tách biệt logic, dễ dàng quản lý tốc độ xử lý.

- Nhược điểm: Phức tạp hơn để thiết lập và bảo trì, thêm độ trễ cho các yêu cầu.

- Phù hợp cho: Ứng dụng quy mô lớn, xử lý hàng loạt, các tác vụ nền (background tasks).

- Caching:

- Ưu điểm: Giảm đáng kể số lượng yêu cầu API, cải thiện hiệu suất và giảm chi phí.

- Nhược điểm: Không áp dụng được cho tất cả các loại yêu cầu (chỉ những yêu cầu có thể tái sử dụng kết quả), cần quản lý invalidation cache.

- Phù hợp cho: Các yêu cầu lặp lại với cùng đầu vào, dữ liệu ít thay đổi.

- Throttling (Client-side Rate Limiting):

- Ưu điểm: Chủ động ngăn chặn lỗi

429, kiểm soát chặt chẽ lưu lượng. - Nhược điểm: Cần biết chính xác giới hạn API, có thể phức tạp để triển khai chính xác.

- Phù hợp cho: Ứng dụng cần độ ổn định cao, muốn tránh hoàn toàn lỗi rate limit.

- Ưu điểm: Chủ động ngăn chặn lỗi

Thông thường, một chiến lược tối ưu sẽ kết hợp nhiều phương pháp này lại với nhau. Ví dụ, bạn có thể triển khai throttling cục bộ để chủ động kiểm soát tốc độ, kết hợp với retry exponential backoff như một lớp phòng thủ thứ hai, và caching cho các kết quả có thể tái sử dụng. Sự kết hợp này mang lại sự cân bằng giữa hiệu suất, độ tin cậy và chi phí khi làm việc với rate limiting API AI.

Các Lưu Ý Quan Trọng

- Luôn kiểm tra các điều khoản dịch vụ của nhà cung cấp API. Một số nhà cung cấp có thể có chính sách phạt hoặc chặn tài khoản nếu bạn liên tục vi phạm giới hạn tốc độ một cách cố ý.

- Đừng ngần ngại liên hệ với nhà cung cấp API nếu bạn có nhu cầu sử dụng vượt quá giới hạn mặc định. Họ thường có các gói doanh nghiệp hoặc tùy chỉnh để đáp ứng nhu cầu cụ thể.

- Đối với các ứng dụng có nhiều người dùng, hãy xem xét việc triển khai rate limiting ở cấp độ người dùng cuối (per-user rate limiting) ngoài việc quản lý rate limiting ở cấp độ toàn ứng dụng. Điều này giúp ngăn chặn một người dùng duy nhất lạm dụng tài nguyên.

- Sử dụng các công cụ profiling và tracing để xác định các điểm nghẽn (bottleneck) trong luồng gọi API của bạn. Điều này có thể giúp bạn tinh chỉnh chiến lược quản lý rate limiting API AI.

- Hãy nhớ rằng các giới hạn tốc độ có thể thay đổi theo thời gian khi nhà cung cấp API cập nhật chính sách của họ. Luôn theo dõi các thông báo và tài liệu mới nhất.

- Nếu bạn đang phát triển trên môi trường serverless (như AWS Lambda, Google Cloud Functions), hãy cẩn thận với việc quản lý các phiên bản đồng thời (concurrent invocations) vì mỗi phiên bản có thể gọi API độc lập, dễ dẫn đến vượt giới hạn nếu không có chiến lược tập trung.

- Đánh giá kỹ lưỡng chi phí của các cuộc gọi API. Đôi khi, việc tối ưu hóa bằng cách giảm số lượng cuộc gọi có thể tiết kiệm chi phí hơn rất nhiều so với việc chỉ tập trung vào việc vượt qua giới hạn tốc độ.

Câu Hỏi Thường Gặp

Làm thế nào để biết chính xác giới hạn tốc độ của một AI API?

Cách tốt nhất là tham khảo tài liệu chính thức của nhà cung cấp API. Hầu hết các nhà cung cấp lớn như OpenAI, Google Cloud AI, AWS AI đều công bố rõ ràng giới hạn RPM (Requests Per Minute) và TPM (Tokens Per Minute) của họ cho từng dịch vụ và cấp tài khoản. Bạn cũng có thể kiểm tra các header HTTP trong phản hồi API như X-RateLimit-Limit, X-RateLimit-Remaining để có thông tin chi tiết hơn.

Sử dụng client-side throttling có đảm bảo không bao giờ bị lỗi 429 không?

Client-side throttling giúp giảm đáng kể khả năng gặp lỗi 429 bằng cách chủ động kiểm soát tốc độ gửi yêu cầu. Tuy nhiên, nó không đảm bảo 100% vì giới hạn thực tế của server có thể thay đổi, hoặc có thể có các yếu tố bên ngoài khác (như nhiều client sử dụng cùng một API key) mà client-side throttling không thể kiểm soát hoàn toàn. Do đó, việc kết hợp với retry backoff vẫn là cần thiết.

Việc caching kết quả AI API có an toàn không?

Việc caching là hoàn toàn an toàn và được khuyến nghị, miễn là bạn quản lý cache một cách hợp lý. Hãy đảm bảo rằng bạn chỉ cache các yêu cầu có đầu vào giống nhau và kết quả không thay đổi thường xuyên. Thiết lập cơ chế hết hạn (expiration) cho cache để tránh trả về dữ liệu cũ. Đối với các ứng dụng nhạy cảm về bảo mật hoặc dữ liệu cá nhân, hãy đảm bảo rằng dữ liệu cache được bảo vệ đúng cách.

Làm thế nào để xử lý rate limiting khi có nhiều ứng dụng hoặc dịch vụ cùng gọi một AI API?

Trong trường hợp này, việc quản lý rate limiting API AI trở nên phức tạp hơn. Bạn nên cân nhắc sử dụng một proxy hoặc API Gateway tập trung. Proxy này sẽ chịu trách nhiệm định tuyến tất cả các yêu cầu đến AI API và áp dụng một lớp rate limiting chung cho tất cả các dịch vụ. Điều này giúp bạn có cái nhìn tổng quan và kiểm soát tốt hơn toàn bộ lưu lượng truy cập, tránh tình trạng các dịch vụ cạnh tranh nhau để giành quyền truy cập API.

Kết Luận

Quản lý rate limiting API AI không chỉ là một kỹ thuật phòng thủ mà còn là một chiến lược tối ưu hóa chi phí và hiệu suất quan trọng đối với mọi lập trình viên. Bằng cách hiểu rõ các giới hạn, triển khai các cơ chế retry thông minh, sử dụng hàng đợi, caching, và throttling, bạn có thể xây dựng các ứng dụng AI mạnh mẽ, ổn định và tiết kiệm chi phí. Việc áp dụng linh hoạt các chiến lược này sẽ giúp bạn vượt qua những thách thức về giới hạn API, đảm bảo rằng ứng dụng của bạn luôn hoạt động mượt mà và mang lại trải nghiệm tốt nhất cho người dùng.

Hy vọng rằng bài viết này đã cung cấp cho bạn những kiến thức và công cụ cần thiết để tự tin đối phó với rate limiting trong các dự án AI của mình. Hãy tiếp tục khám phá và học hỏi tại vibe coding để nâng cao kỹ năng và tạo ra những sản phẩm công nghệ đột phá.