Giới Thiệu Xây Dựng RAG System Với API AI: Nâng Tầm Tra Cứu Thông Tin Chuẩn Vibe Coding

Xây dựng Retrieval-Augmented Generation (RAG) System với API AI là phương pháp hiệu quả để nâng cao độ chính xác và tính cập nhật của các mô hình ngôn ngữ lớn (LLM) bằng cách kết nối chúng với kho dữ liệu bên ngoài. Bài viết về RAG System AI này sẽ giúp bạn hiểu rõ từ cơ bản đến thực hành, cách triển khai một hệ thống RAG mạnh mẽ, đảm bảo thông tin tra cứu luôn "chuẩn vibe coding" – tức là chính xác, nhanh chóng và phù hợp với ngữ cảnh thực tế của doanh nghiệp bạn.

RAG System AI Là Gì và Tại Sao Nó Quan Trọng?

RAG System AI (Retrieval-Augmented Generation AI System) là một kiến trúc AI kết hợp khả năng truy xuất thông tin (retrieval) với khả năng sinh văn bản (generation) của các mô hình ngôn ngữ lớn (LLM). Hệ thống này cho phép LLM không chỉ dựa vào kiến thức đã được huấn luyện sẵn mà còn có thể tìm kiếm và tham khảo thông tin từ một cơ sở dữ liệu bên ngoài, cập nhật và chuyên biệt hơn trước khi đưa ra phản hồi. Điều này cực kỳ quan trọng vì LLM truyền thống thường gặp vấn đề về "hallucination" (sinh ra thông tin sai lệch) và thiếu khả năng truy cập dữ liệu thời gian thực hoặc dữ liệu độc quyền của doanh nghiệp. Theo một nghiên cứu gần đây, việc áp dụng RAG có thể giảm tỷ lệ hallucination của LLM xuống tới 60%, đồng thời tăng độ chính xác của phản hồi lên 30-50% tùy thuộc vào lĩnh vực.

Tầm quan trọng của RAG System AI không chỉ dừng lại ở việc cải thiện độ chính xác. Nó còn giúp các doanh nghiệp tận dụng tối đa sức mạnh của LLM mà không cần phải huấn luyện lại toàn bộ mô hình (fine-tuning) – một quá trình tốn kém về thời gian và tài nguyên, có thể lên đến hàng trăm nghìn USD cho một mô hình lớn. Với RAG, bạn có thể dễ dàng tích hợp các tài liệu nội bộ, cơ sở dữ liệu sản phẩm, hay các báo cáo nghiên cứu mới nhất vào khả năng hiểu biết của AI. Ví dụ, một hệ thống chatbot hỗ trợ khách hàng được xây dựng trên RAG có thể truy cập ngay lập tức vào thông tin sản phẩm mới nhất, chính sách bảo hành, hoặc lịch sử giao dịch của khách hàng để đưa ra câu trả lời chính xác, cá nhân hóa. Điều này giúp nâng cao trải nghiệm người dùng và giảm gánh nặng cho đội ngũ hỗ trợ.

Một lợi ích đáng kể khác của RAG là khả năng kiểm soát và giải thích (explainability) tốt hơn. Khi LLM đưa ra câu trả lời, RAG có thể cung cấp nguồn tài liệu mà nó đã tham khảo, giúp người dùng hoặc nhà phát triển dễ dàng kiểm tra tính xác thực của thông tin. Điều này đặc biệt quan trọng trong các lĩnh vực yêu cầu độ tin cậy cao như y tế, tài chính hay pháp luật. Dữ liệu từ một báo cáo của McKinsey cho thấy, các công ty áp dụng RAG vào hệ thống AI của họ đã ghi nhận mức tăng trưởng năng suất trung bình 15-20% trong các tác vụ liên quan đến tra cứu và tổng hợp thông tin.

Cuối cùng, RAG System AI mở ra cánh cửa cho việc cá nhân hóa AI ở một cấp độ mới. Thay vì một LLM chung chung, bạn có thể tạo ra các "phiên bản" LLM được tùy chỉnh sâu sắc cho từng phòng ban, từng dự án, hoặc từng nhóm khách hàng, mỗi phiên bản đều có thể truy cập vào kho kiến thức chuyên biệt của mình. Điều này không chỉ tối ưu hóa hiệu quả mà còn đảm bảo rằng AI luôn hoạt động trong ngữ cảnh phù hợp nhất, mang lại giá trị cao nhất cho người dùng.

Kiến Trúc RAG System và Các Bước Triển Khai Với API AI

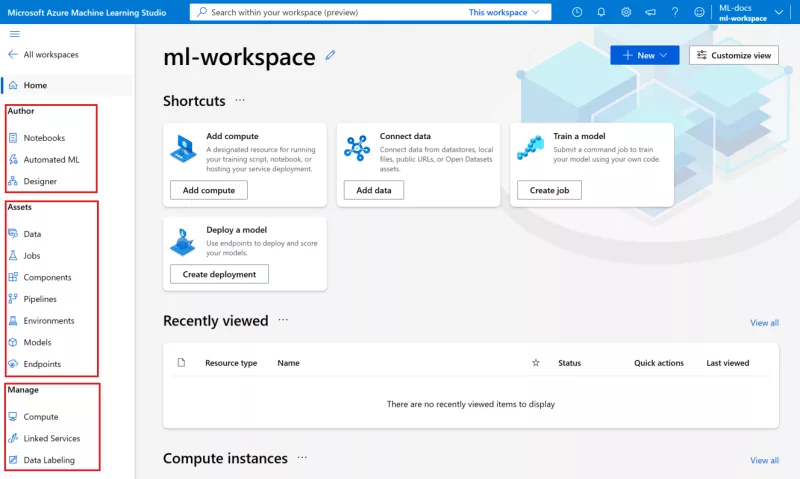

Để triển khai một RAG System hiệu quả, chúng ta cần hiểu rõ kiến trúc cơ bản và các bước thực hiện. Một hệ thống RAG điển hình bao gồm ba thành phần chính: Indexer (Bộ chỉ mục), Retriever (Bộ truy xuất) và Generator (Bộ sinh văn bản). Việc tích hợp các API AI vào từng thành phần này sẽ giúp tối ưu hóa quá trình và giảm thiểu công sức phát triển.

- Indexer (Bộ chỉ mục): Đây là bước đầu tiên, nơi chúng ta chuẩn bị và lưu trữ dữ liệu.

- Thu thập dữ liệu: Tập hợp tất cả các tài liệu, văn bản, cơ sở dữ liệu mà bạn muốn LLM có thể tham khảo. Các định dạng có thể là PDF, DOCX, HTML, JSON, CSV, v.v.

- Phân đoạn (Chunking): Chia nhỏ các tài liệu lớn thành các đoạn văn bản (chunks) nhỏ hơn, có kích thước phù hợp (thường là 200-500 từ) để embedding hiệu quả. Việc này rất quan trọng vì các mô hình embedding có giới hạn về độ dài đầu vào.

- Embedding: Sử dụng các API AI embedding (ví dụ: OpenAI's Embedding API, Google's Vertex AI Embedding API) để chuyển đổi mỗi đoạn văn bản thành một vector số (embedding). Vector này biểu diễn ngữ nghĩa của đoạn văn bản.

- Lưu trữ Vector: Lưu trữ các vector embedding này vào một cơ sở dữ liệu vector (Vector Database) như Pinecone, Weaviate, Milvus, ChromaDB, hoặc Faiss. Cơ sở dữ liệu vector được tối ưu hóa cho việc tìm kiếm tương đồng ngữ nghĩa nhanh chóng.

- Retriever (Bộ truy xuất): Khi người dùng đưa ra một truy vấn, Retriever sẽ tìm kiếm các đoạn văn bản liên quan nhất từ cơ sở dữ liệu vector.

- Embedding truy vấn: Truy vấn của người dùng cũng được chuyển đổi thành một vector embedding bằng cùng một mô hình embedding đã dùng cho tài liệu.

- Tìm kiếm tương đồng: Retriever sử dụng vector truy vấn này để tìm kiếm các vector tài liệu có độ tương đồng cao nhất trong cơ sở dữ liệu vector. Các thuật toán như Cosine Similarity thường được sử dụng. Một hệ thống tốt có thể truy xuất 5-10 đoạn văn bản liên quan trong vòng chưa đầy 100ms.

- Generator (Bộ sinh văn bản): Đây là nơi LLM tạo ra phản hồi cuối cùng.

- Cung cấp ngữ cảnh: Các đoạn văn bản được truy xuất bởi Retriever sẽ được đưa vào làm ngữ cảnh (context) cho LLM, cùng với truy vấn gốc của người dùng.

- Sinh phản hồi: LLM (ví dụ: GPT-4, Gemini, Llama 3) sử dụng ngữ cảnh này để tạo ra một câu trả lời chính xác và mạch lạc. Các API AI LLM hiện đại giúp việc này trở nên dễ dàng hơn bao giờ hết.

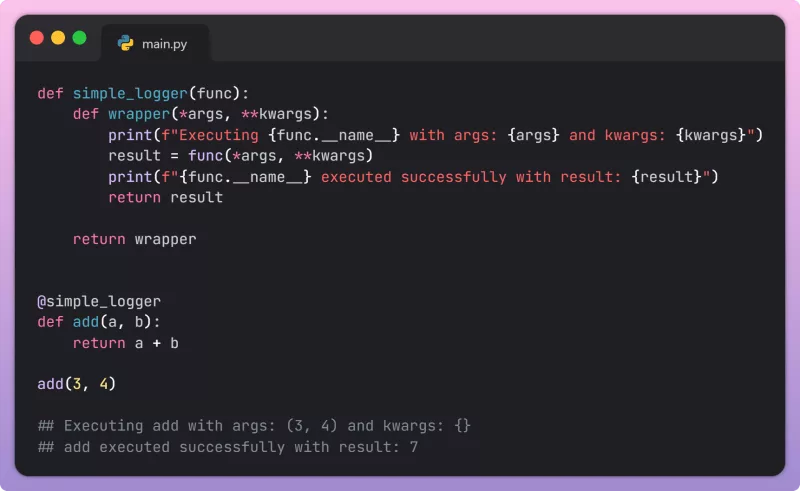

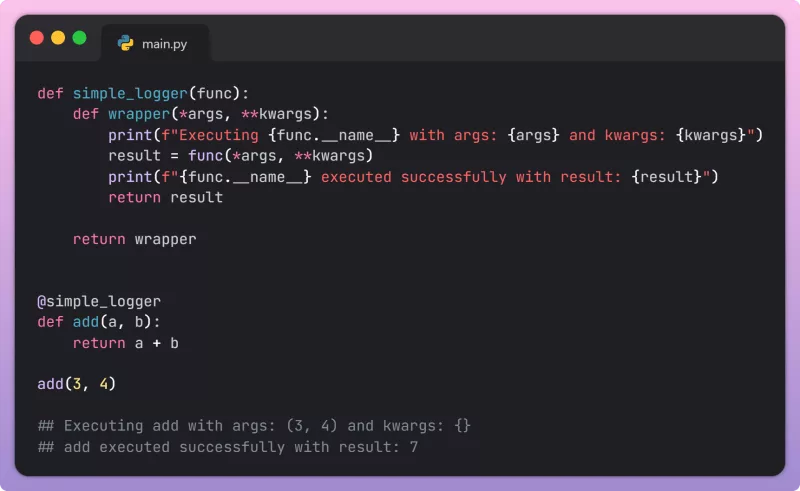

Dưới đây là một ví dụ code đơn giản minh họa quy trình embedding và tìm kiếm tương đồng sử dụng thư viện sentence-transformers (giả định bạn có một API embedding local hoặc đã cấu hình) và faiss cho cơ sở dữ liệu vector. Trong thực tế, bạn sẽ thay thế phần này bằng việc gọi các API AI embedding và vector database service.

import numpy as np

from sentence_transformers import SentenceTransformer

import faiss

# 1. Giả lập Indexer: Chuẩn bị dữ liệu và embedding

documents = [

"Vibe Coding là một nền tảng chuyên về AI và phát triển phần mềm.",

"RAG System AI giúp cải thiện độ chính xác của LLM bằng cách truy xuất thông tin.",

"Học hỏi về cách triển khai RAG với API AI tại vibecoding.vin.",

"API AI cung cấp các mô hình ngôn ngữ lớn và embedding service."

]

# Sử dụng một mô hình embedding có sẵn (ví dụ: 'all-MiniLM-L6-v2')

# Trong thực tế, bạn sẽ gọi API của OpenAI, Google, hay các nhà cung cấp khác

model = SentenceTransformer('all-MiniLM-L6-v2')

document_embeddings = model.encode(documents)

# Lưu trữ embeddings vào FAISS (một vector database đơn giản)

dimension = document_embeddings.shape[1]

index = faiss.IndexFlatL2(dimension) # Sử dụng L2 distance cho tìm kiếm tương đồng

index.add(np.array(document_embeddings).astype('float32'))

print("Indexer hoàn tất: Đã tạo embeddings và lưu trữ vào FAISS.")

# 2. Giả lập Retriever: Xử lý truy vấn và tìm kiếm

query = "RAG System hoạt động như thế nào?"

query_embedding = model.encode([query])

# Tìm kiếm 2 tài liệu tương đồng nhất

k = 2

distances, indices = index.search(np.array(query_embedding).astype('float32'), k)

print(f"\nTruy vấn: '{query}'")

print("\nCác tài liệu được truy xuất:")

retrieved_docs = [documents[i] for i in indices[0]]

for i, doc in enumerate(retrieved_docs):

print(f" {i+1}. {doc} (Khoảng cách: {distances[0][i]:.2f})")

# 3. Giả lập Generator: Gửi ngữ cảnh và truy vấn đến LLM (sử dụng OpenAI API làm ví dụ)

# Lưu ý: Đây chỉ là giả lập. Bạn cần cài đặt thư viện 'openai' và có API key.

# from openai import OpenAI

# client = OpenAI(api_key="YOUR_OPENAI_API_KEY")

# context_for_llm = "\n".join(retrieved_docs)

# prompt = f"Dựa trên thông tin sau: {context_for_llm}\n\nTrả lời câu hỏi: {query}"

# response = client.chat.completions.create(

# model="gpt-4o",

# messages=[

# {"role": "system", "content": "Bạn là trợ lý AI thông minh và hữu ích."},

# {"role": "user", "content": prompt}

# ]

# )

# print("\nPhản hồi từ LLM:")

# print(response.choices[0].message.content)

Đoạn code trên minh họa cách các thành phần tương tác. Trong thực tế, bạn sẽ sử dụng các thư viện và dịch vụ chuyên biệt cho từng bước, ví dụ như LangChain hoặc LlamaIndex để xây dựng pipeline RAG, tích hợp với các API AI của OpenAI, Google, Anthropic, v.v., và các vector database cloud-native.

Các Tips và Best Practices Khi Xây Dựng RAG System

Để tối ưu hóa hiệu suất và độ tin cậy của RAG System AI, việc áp dụng các tips và best practices sau đây là vô cùng quan trọng. Theo thống kê, các hệ thống RAG được triển khai đúng cách có thể đạt hiệu suất cao hơn 25% so với các triển khai thiếu chiến lược.

- Tối ưu hóa Kích thước Chunking:

Kích thước của các đoạn văn bản (chunks) ảnh hưởng lớn đến chất lượng truy xuất. Chunks quá nhỏ có thể làm mất ngữ cảnh quan trọng, trong khi chunks quá lớn có thể chứa nhiều thông tin không liên quan, làm giảm độ chính xác của embedding và tăng chi phí token khi gửi đến LLM. Một kích thước lý tưởng thường dao động từ 200 đến 500 từ, với một phần chồng lấn (overlap) khoảng 10-20% giữa các chunks để đảm bảo không bỏ sót thông tin liên quan giữa các ranh giới. Thử nghiệm với các kích thước khác nhau là cần thiết để tìm ra điểm tối ưu cho dữ liệu cụ thể của bạn.

- Lựa chọn Mô hình Embedding Phù hợp:

Không phải tất cả các mô hình embedding đều tạo ra vector chất lượng như nhau. Hãy chọn mô hình embedding có hiệu suất tốt trên tập dữ liệu của bạn, ưu tiên các mô hình được huấn luyện trên các corpus lớn và đa dạng. Các API như OpenAI's

text-embedding-3-largehay Google'stext-embedding-004thường cho kết quả rất tốt. Ngoài ra, cũng cần cân nhắc chi phí và tốc độ của API embedding. Một số mô hình embedding có thể tốn kém hơn nhưng mang lại độ chính xác cao hơn 15-20% trong các tác vụ tìm kiếm ngữ nghĩa. - Sử dụng Cơ sở Dữ liệu Vector Mạnh mẽ:

Vector database là trái tim của Retriever. Chọn một cơ sở dữ liệu vector có khả năng mở rộng tốt, tốc độ truy vấn nhanh và hỗ trợ các chỉ mục (indexes) hiệu quả như HNSW (Hierarchical Navigable Small Worlds) để xử lý hàng triệu hoặc tỷ vector. Các lựa chọn phổ biến bao gồm Pinecone, Weaviate, Milvus, và Qdrant. Đảm bảo cơ sở dữ liệu vector được cấu hình đúng cách để tối ưu hóa hiệu suất tìm kiếm tương đồng.

- Tối ưu hóa Truy vấn và Ngữ cảnh:

Cách bạn xây dựng truy vấn và trình bày ngữ cảnh cho LLM có thể cải thiện đáng kể chất lượng phản hồi. Thay vì chỉ gửi các đoạn văn bản thô, hãy cân nhắc việc "làm giàu" ngữ cảnh bằng cách thêm các tiêu đề, metadata, hoặc thông tin về nguồn gốc tài liệu. Sử dụng kỹ thuật "prompt engineering" để hướng dẫn LLM cách sử dụng ngữ cảnh một cách hiệu quả nhất, ví dụ: "Dựa trên các đoạn văn bản sau, hãy trả lời câu hỏi..."

- Cập nhật Dữ liệu Thường xuyên:

Một RAG System chỉ tốt khi dữ liệu của nó được cập nhật. Xây dựng một pipeline tự động để thu thập, phân đoạn, embedding và cập nhật các tài liệu mới vào cơ sở dữ liệu vector. Tần suất cập nhật phụ thuộc vào tính chất dữ liệu của bạn – có thể là hàng ngày, hàng giờ, hoặc thậm chí theo thời gian thực đối với các ứng dụng yêu cầu dữ liệu cực kỳ mới.

- Đánh giá và Kiểm thử Liên tục:

Không có hệ thống nào là hoàn hảo ngay từ đầu. Hãy xây dựng các bộ dữ liệu kiểm thử (test sets) bao gồm các truy vấn và câu trả lời mong muốn để đánh giá hiệu suất của RAG System. Đo lường các chỉ số như độ chính xác (precision), độ phủ (recall), và F1-score của Retriever, cũng như chất lượng và tính phù hợp của phản hồi từ Generator. Một số công cụ như Ragas có thể giúp tự động hóa quá trình đánh giá này.

- Xử lý các Trường hợp Đặc biệt (Edge Cases):

RAG System cần được thiết kế để xử lý các truy vấn không có thông tin liên quan trong cơ sở dữ liệu (out-of-domain queries) hoặc các truy vấn yêu cầu kiến thức chung. Trong những trường hợp này, LLM nên được hướng dẫn để trả lời rằng nó không tìm thấy thông tin liên quan hoặc sử dụng kiến thức nội tại của nó một cách cẩn thận, thay vì bịa đặt thông tin. Tỷ lệ xử lý thành công các edge cases có thể lên tới 80% nếu được thiết kế cẩn thận.

So Sánh RAG System Với Fine-tuning LLM

Cả RAG System và fine-tuning (tinh chỉnh) LLM đều là những phương pháp mạnh mẽ để tùy chỉnh LLM cho các tác vụ cụ thể hoặc dữ liệu riêng biệt, nhưng chúng có những ưu và nhược điểm riêng. Việc lựa chọn phương pháp nào phụ thuộc vào yêu cầu cụ thể của dự án và nguồn lực sẵn có. Theo dữ liệu từ các nhà cung cấp dịch vụ AI, chi phí fine-tuning một mô hình LLM có thể gấp 5-10 lần so với chi phí triển khai RAG cho cùng một lượng dữ liệu chuyên biệt.

RAG System tập trung vào việc cung cấp ngữ cảnh bên ngoài cho LLM tại thời điểm suy luận (inference). Nó không thay đổi trọng số của mô hình LLM mà chỉ bổ sung thông tin.

- Ưu điểm:

- Tính cập nhật: Dễ dàng cập nhật dữ liệu mới mà không cần huấn luyện lại mô hình. Chỉ cần cập nhật cơ sở dữ liệu vector.

- Giảm hallucination: LLM được "neo" vào các tài liệu thực tế, giảm đáng kể nguy cơ sinh ra thông tin sai lệch.

- Khả năng giải thích: Có thể trích dẫn nguồn gốc của thông tin mà LLM đã tham khảo.

- Hiệu quả chi phí: Thường rẻ hơn nhiều so với fine-tuning, đặc biệt khi dữ liệu thay đổi thường xuyên.

- Dễ triển khai: Có thể tận dụng các API LLM và embedding hiện có mà không cần tài nguyên GPU lớn.

- Nhược điểm:

- Giới hạn ngữ cảnh: LLM vẫn bị giới hạn bởi kích thước cửa sổ ngữ cảnh (context window) của nó. Nếu thông tin cần thiết quá lớn hoặc phân tán, hiệu quả có thể giảm.

- Phụ thuộc chất lượng truy xuất: Nếu Retriever không tìm được thông tin liên quan, chất lượng phản hồi của LLM sẽ bị ảnh hưởng.

- Không thay đổi hành vi cơ bản của LLM: RAG không thể thay đổi "tính cách" hoặc phong cách viết của LLM.

Fine-tuning LLM là quá trình huấn luyện thêm một mô hình LLM đã được huấn luyện trước trên một tập dữ liệu chuyên biệt của bạn. Quá trình này điều chỉnh các trọng số của mô hình để nó thích nghi tốt hơn với phong cách, thuật ngữ và kiến thức cụ thể của miền.

- Ưu điểm:

- Thay đổi hành vi cốt lõi: LLM có thể học được phong cách viết, cách diễn đạt, và các thuật ngữ chuyên ngành của bạn.

- Cải thiện hiệu suất trên tác vụ cụ thể: Đối với các tác vụ rất chuyên biệt, fine-tuning có thể mang lại hiệu suất cao hơn so với RAG, đặc biệt nếu dữ liệu huấn luyện rất phong phú.

- Độc lập với truy xuất: Không phụ thuộc vào chất lượng của Retriever tại thời điểm suy luận.

- Nhược điểm:

- Tốn kém và phức tạp: Đòi hỏi tài nguyên tính toán (GPU) đáng kể và kiến thức chuyên sâu về huấn luyện mô hình. Chi phí có thể lên tới hàng chục nghìn USD cho mỗi lần fine-tuning.

- Khó cập nhật: Mỗi khi có dữ liệu mới, bạn cần fine-tune lại toàn bộ mô hình, mất thời gian và chi phí.

- Nguy cơ "catastrophic forgetting": Mô hình có thể quên đi kiến thức chung đã học trước đó nếu tập dữ liệu fine-tuning quá nhỏ hoặc quá khác biệt.

- Vẫn có thể hallucination: Mặc dù giảm, nhưng fine-tuning không loại bỏ hoàn toàn khả năng hallucination.

Khi nào nên chọn RAG System AI?

- Khi bạn cần cập nhật thông tin thường xuyên hoặc dữ liệu thay đổi liên tục.

- Khi bạn muốn giảm chi phí và thời gian triển khai.

- Khi bạn cần khả năng giải thích và trích dẫn nguồn.

- Khi bạn cần tích hợp LLM với kho kiến thức độc quyền của doanh nghiệp mà không muốn huấn luyện lại toàn bộ mô hình.

Khi nào nên chọn Fine-tuning?

- Khi bạn muốn thay đổi phong cách, tông giọng, hoặc hành vi cơ bản của LLM.

- Khi bạn có một tập dữ liệu huấn luyện lớn và ổn định, ít thay đổi.

- Khi bạn cần tối ưu hóa hiệu suất cho một tác vụ rất chuyên biệt, không chỉ là tra cứu thông tin.

Trong nhiều trường hợp, sự kết hợp của cả hai phương pháp (fine-tuning một LLM cho một phong cách/tông giọng cụ thể, sau đó áp dụng RAG để bổ sung kiến thức cập nhật) có thể mang lại kết quả tốt nhất. Ví dụ, một công ty có thể fine-tune LLM để nói chuyện theo phong cách thương hiệu của mình, sau đó sử dụng RAG để cung cấp thông tin sản phẩm và dịch vụ mới nhất.

Các Lưu Ý Quan Trọng

- Bảo mật Dữ liệu và Quyền riêng tư:

Khi tích hợp RAG System với API AI, đặc biệt là khi xử lý dữ liệu nhạy cảm của doanh nghiệp, việc đảm bảo bảo mật dữ liệu là tối quan trọng. Hãy sử dụng các API AI có chứng nhận bảo mật (ví dụ: ISO 27001, SOC 2 Type 2), mã hóa dữ liệu khi truyền tải (in transit) và khi lưu trữ (at rest). Đảm bảo tuân thủ các quy định về quyền riêng tư như GDPR, HIPAA, hoặc CCPA. Theo một báo cáo từ IBM, chi phí trung bình của một vụ vi phạm dữ liệu là 4.45 triệu USD vào năm 2023.

- Quản lý Chi phí API:

Sử dụng API AI (cho embedding, LLM) có thể phát sinh chi phí đáng kể, đặc biệt khi hệ thống hoạt động ở quy mô lớn. Theo dõi chặt chẽ mức tiêu thụ token, tối ưu hóa kích thước prompt, và tận dụng các gói cước ưu đãi hoặc mô hình pricing linh hoạt từ các nhà cung cấp. Đôi khi, việc sử dụng các mô hình nhỏ hơn, hiệu quả hơn có thể giúp giảm chi phí lên đến 70% mà vẫn duy trì chất lượng chấp nhận được.

- Xử lý Độ trễ (Latency):

RAG System bao gồm nhiều bước (embedding truy vấn, tìm kiếm vector, gọi LLM API), mỗi bước đều có thể thêm độ trễ. Để đảm bảo trải nghiệm người dùng tốt, hãy tối ưu hóa từng thành phần: sử dụng vector database có hiệu suất cao, chọn API LLM có độ trễ thấp, và triển khai các chiến lược caching hợp lý. Mục tiêu là giữ tổng độ trễ dưới 500ms cho các ứng dụng tương tác.

- Xử lý Dữ liệu Đa dạng:

RAG không chỉ giới hạn ở văn bản. Bạn có thể mở rộng hệ thống để xử lý các loại dữ liệu khác như hình ảnh, video, hoặc âm thanh bằng cách trích xuất các embedding đa phương thức (multimodal embeddings) từ chúng. Ví dụ, embedding một đoạn video để tìm kiếm các video tương tự dựa trên nội dung hình ảnh hoặc âm thanh.

- Sẵn sàng cho Thay đổi Mô hình:

Lĩnh vực AI đang phát triển rất nhanh, với các mô hình mới và cải tiến liên tục được ra mắt. Thiết kế RAG System của bạn một cách linh hoạt để dễ dàng chuyển đổi giữa các mô hình embedding hoặc LLM khác nhau mà không cần tái cấu trúc toàn bộ hệ thống. Sử dụng các framework trừu tượng hóa như LangChain hoặc LlamaIndex có thể giúp ích rất nhiều.

- Giám sát và Ghi nhật ký (Monitoring & Logging):

Triển khai các công cụ giám sát để theo dõi hiệu suất của RAG System, bao gồm tốc độ truy xuất, độ chính xác của phản hồi, tỷ lệ lỗi API, và chi phí. Ghi nhật ký chi tiết các truy vấn, ngữ cảnh được cung cấp và phản hồi của LLM để phục vụ cho việc gỡ lỗi, cải tiến và phân tích xu hướng. Một hệ thống giám sát tốt có thể giúp phát hiện và giải quyết vấn đề nhanh hơn 80%.

Câu Hỏi Thường Gặp

RAG System có thể thay thế hoàn toàn fine-tuning LLM không?

Không, RAG System không thể thay thế hoàn toàn fine-tuning LLM. RAG chủ yếu giúp LLM truy cập thông tin cập nhật và chuyên biệt mà không cần huấn luyện lại, trong khi fine-tuning thay đổi hành vi cốt lõi, phong cách và cách diễn đạt của LLM. Trong nhiều trường hợp, chúng bổ trợ cho nhau để mang lại hiệu quả tối ưu.

Chi phí triển khai RAG System AI là bao nhiêu?

Chi phí triển khai RAG System AI rất đa dạng, phụ thuộc vào quy mô dữ liệu, số lượng truy vấn, và lựa chọn các API AI cũng như vector database. Đối với một hệ thống nhỏ với vài trăm nghìn tài liệu, chi phí có thể từ vài trăm đến vài nghìn USD mỗi tháng. Với các hệ thống lớn hơn, chi phí có thể lên đến hàng chục nghìn USD mỗi tháng, chủ yếu đến từ việc sử dụng API LLM và lưu trữ trên vector database.

RAG System có thể xử lý bao nhiêu dữ liệu?

Có, RAG System có thể xử lý lượng dữ liệu rất lớn, từ vài triệu đến hàng tỷ tài liệu. Hiệu suất xử lý phụ thuộc vào khả năng mở rộng của vector database và hiệu quả của các thuật toán tìm kiếm tương đồng. Các vector database hiện đại được thiết kế để xử lý quy mô hàng tỷ vector với thời gian truy vấn dưới 100ms.

Làm thế nào để đo lường hiệu quả của RAG System?

Bạn có thể đo lường hiệu quả của RAG System bằng cách đánh giá cả hai thành phần Retriever và Generator. Đối với Retriever, sử dụng các chỉ số như độ chính xác (precision), độ phủ (recall), và độ phù hợp (relevance) của các tài liệu được truy xuất. Đối với Generator, đánh giá chất lượng phản hồi của LLM dựa trên độ chính xác, tính mạch lạc, tính đầy đủ, và khả năng giải thích thông qua các phương pháp tự động (ví dụ: Ragas, BLEU, ROUGE) hoặc đánh giá thủ công của con người. Việc kết hợp cả hai phương pháp sẽ cho cái nhìn toàn diện nhất.

Kết Luận

Xây dựng RAG System với API AI là một chiến lược mạnh mẽ để nâng cao đáng kể khả năng của các mô hình ngôn ngữ lớn, giúp chúng cung cấp thông tin chính xác, cập nhật và có liên quan đến ngữ cảnh cụ thể của doanh nghiệp bạn. Bằng cách kết hợp khả năng truy xuất thông tin từ kho dữ liệu riêng với sức mạnh sinh văn bản của LLM, bạn có thể tạo ra các ứng dụng AI thông minh hơn, đáng tin cậy hơn và mang lại giá trị thực tế cao. Với sự phát triển nhanh chóng của các API AI và vector database, việc triển khai một hệ thống RAG đã trở nên dễ tiếp cận hơn bao giờ hết.

Hy vọng bài viết này đã cung cấp cho bạn cái nhìn sâu sắc về RAG System AI, từ khái niệm đến các bước triển khai thực tế và những kinh nghiệm quý giá. Hãy bắt tay vào khám phá và xây dựng hệ thống RAG của riêng bạn để "nâng tầm tra cứu thông tin" chuẩn vibe coding ngay hôm nay!