Giới Thiệu Tối Ưu API AI cho Tương Tác Giọng Nói: Từ Text-to-Speech Đến Xử Lý Ngôn Ngữ Tự Nhiên

Trong kỷ nguyên số hóa hiện nay, khả năng tương tác với máy tính bằng giọng nói không còn là khoa học viễn tưởng mà đã trở thành một phần không thể thiếu trong cuộc sống hàng ngày. Từ trợ lý ảo trên điện thoại thông minh đến các hệ thống điều khiển nhà thông minh, công nghệ giọng nói đã mở ra vô vàn cơ hội mới. Bài viết này sẽ đi sâu vào việc tối ưu hóa các API AI để xây dựng những trải nghiệm tương tác giọng nói đỉnh cao, đặc biệt tập trung vào cách chúng ta có thể tận dụng sức mạnh của text-to-speech AI và xử lý ngôn ngữ tự nhiên (NLP) để tạo ra các ứng dụng thông minh và thân thiện với người dùng. Chúng ta sẽ cùng khám phá cách các developer có thể tích hợp và điều chỉnh các giải pháp AI này để đạt được hiệu suất tối ưu và mang lại giá trị thực sự cho người dùng cuối.

Text-to-Speech AI và Xử Lý Ngôn Ngữ Tự Nhiên (NLP): Nền Tảng Của Tương Tác Giọng Nói

Để xây dựng một hệ thống tương tác giọng nói hiệu quả, chúng ta cần hai thành phần cốt lõi: Text-to-Speech (TTS) và Natural Language Processing (NLP). Text-to-Speech AI là công nghệ chuyển đổi văn bản thành giọng nói tổng hợp, đóng vai trò "giọng nói" của hệ thống AI. Một hệ thống TTS tốt không chỉ phát ra âm thanh rõ ràng mà còn phải có ngữ điệu tự nhiên, cảm xúc phù hợp và khả năng điều chỉnh tốc độ, âm lượng linh hoạt. Điều này đòi hỏi các mô hình AI phải được huấn luyện trên lượng dữ liệu khổng lồ với các kỹ thuật học sâu tiên tiến.

Natural Language Processing (NLP) là trái tim của mọi tương tác giọng nói thông minh. NLP không chỉ đơn thuần là nhận diện các từ ngữ được nói ra (Speech-to-Text) mà còn hiểu được ý nghĩa, ngữ cảnh, và thậm chí là ý định đằng sau câu nói của người dùng. Từ việc phân tích cú pháp, nhận diện thực thể (Named Entity Recognition - NER), đến phân loại cảm xúc (Sentiment Analysis) và tóm tắt văn bản, NLP giúp AI "hiểu" được con người. Sự kết hợp nhuần nhuyễn giữa TTS AI và NLP tạo nên một vòng lặp tương tác liền mạch, nơi AI có thể nghe, hiểu, xử lý và phản hồi lại người dùng một cách tự nhiên nhất.

Các API AI hiện đại đã đơn giản hóa đáng kể quá trình tích hợp các công nghệ này. Thay vì phải tự xây dựng và huấn luyện mô hình từ đầu, các nhà phát triển có thể sử dụng các dịch vụ đám mây mạnh mẽ từ các nhà cung cấp như Google Cloud, Amazon Web Services (AWS), Microsoft Azure hay OpenAI. Những API này cung cấp các mô hình đã được huấn luyện sẵn, cho phép chúng ta tập trung vào logic ứng dụng thay vì đi sâu vào chi tiết kỹ thuật của AI.

Tuy nhiên, việc sử dụng các API này không chỉ dừng lại ở việc gọi một hàm. Để đạt được hiệu suất tối ưu, chúng ta cần hiểu rõ cách thức hoạt động của chúng, cách tùy chỉnh các tham số, và cách xử lý các trường hợp biên. Ví dụ, việc lựa chọn giọng nói phù hợp (nam/nữ, vùng miền, cảm xúc) cho TTS có thể ảnh hưởng lớn đến trải nghiệm người dùng. Tương tự, việc tối ưu hóa các prompt cho NLP hoặc sử dụng các kỹ thuật fine-tuning có thể cải thiện đáng kể độ chính xác và khả năng hiểu của hệ thống.

Tích Hợp và Tối Ưu API Text-to-Speech AI: Một Hướng Dẫn Thực Hành

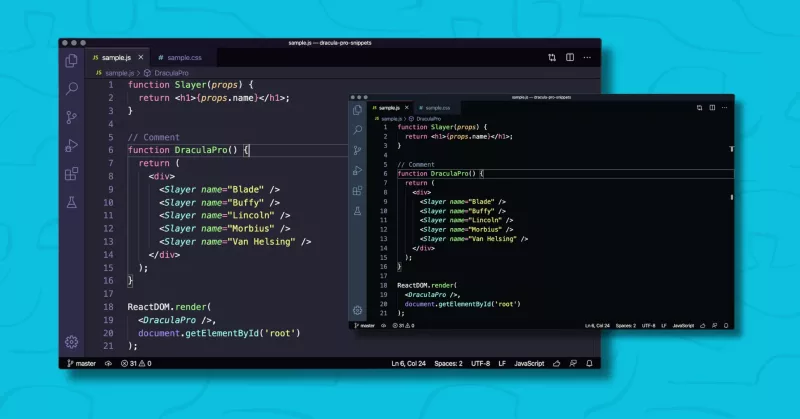

Để minh họa cách tích hợp và tối ưu text-to-speech AI, chúng ta sẽ xem xét ví dụ sử dụng Google Cloud Text-to-Speech API. Đây là một trong những API mạnh mẽ và linh hoạt nhất hiện nay, cung cấp nhiều giọng nói tự nhiên và khả năng tùy chỉnh cao.

Bước 1: Thiết Lập Môi Trường

Trước tiên, bạn cần có một tài khoản Google Cloud và kích hoạt API Text-to-Speech. Sau đó, tạo một service account key và tải xuống file JSON chứa thông tin xác thực. Đặt biến môi trường GOOGLE_APPLICATION_CREDENTIALS trỏ đến đường dẫn của file JSON này. Cài đặt thư viện client cho Python:

pip install google-cloud-texttospeechBước 2: Chuyển Đổi Văn Bản Thành Giọng Nói Cơ Bản

Đây là một ví dụ cơ bản về cách chuyển đổi một đoạn văn bản thành file âm thanh MP3:

from google.cloud import texttospeech

def synthesize_text(text, output_filename="output.mp3"):

client = texttospeech.TextToSpeechClient()

synthesis_input = texttospeech.SynthesisInput(text=text)

# Chọn giọng nói và cấu hình âm thanh

# Ví dụ: Giọng nữ, tiếng Việt, chuẩn neural (WaveNet)

voice = texttospeech.VoiceSelectionParams(

language_code="vi-VN",

name="vi-VN-Standard-A", # Hoặc "vi-VN-Wavenet-A" cho chất lượng cao hơn

ssml_gender=texttospeech.SsmlVoiceGender.FEMALE,

)

audio_config = texttospeech.AudioConfig(

audio_encoding=texttospeech.AudioEncoding.MP3

)

response = client.synthesize_speech(

input=synthesis_input, voice=voice, audio_config=audio_config

)

# Lưu file âm thanh

with open(output_filename, "wb") as out:

out.write(response.audio_content)

print(f'Audio content written to file "{output_filename}"')

if __name__ == "__main__":

synthesize_text("Chào mừng bạn đến với vibe coding! Đây là một ví dụ về text-to-speech AI.")Bước 3: Tối Ưu Hóa Với SSML (Speech Synthesis Markup Language)

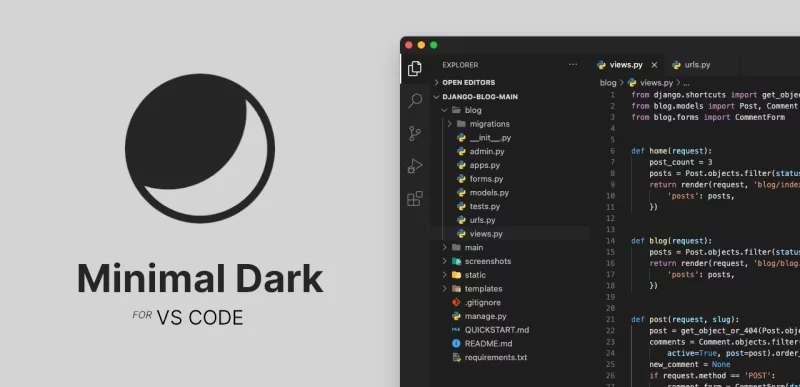

Để giọng nói tự nhiên và biểu cảm hơn, chúng ta có thể sử dụng SSML. SSML cho phép bạn kiểm soát các khía cạnh như ngắt nghỉ, nhấn trọng âm, tốc độ nói, cao độ, và thậm chí là chèn âm thanh khác. Đây là một yếu tố then chốt để tối ưu trải nghiệm người dùng với text-to-speech AI.

from google.cloud import texttospeech

def synthesize_ssml(ssml_text, output_filename="output_ssml.mp3"):

client = texttospeech.TextToSpeechClient()

synthesis_input = texttospeech.SynthesisInput(ssml=ssml_text)

voice = texttospeech.VoiceSelectionParams(

language_code="vi-VN",

name="vi-VN-Wavenet-A", # Giọng WaveNet thường có chất lượng tốt hơn

ssml_gender=texttospeech.SsmlVoiceGender.FEMALE,

)

audio_config = texttospeech.AudioConfig(

audio_encoding=texttospeech.AudioEncoding.MP3,

speaking_rate=1.05, # Tăng tốc độ nói lên 5%

pitch=0.0, # Giữ nguyên cao độ

volume_gain_db=0.0 # Giữ nguyên âm lượng

)

response = client.synthesize_speech(

input=synthesis_input, voice=voice, audio_config=audio_config

)

with open(output_filename, "wb") as out:

out.write(response.audio_content)

print(f'Audio content written to file "{output_filename}"')

if __name__ == "__main__":

ssml_example = """

<speak>

Chào bạn! <break time="500ms"/>

Đây là một <prosody rate="slow">ví dụ</prosody> về việc sử dụng SSML.

<emphasis level="strong">Tối ưu hóa API AI</emphasis> sẽ mang lại trải nghiệm tuyệt vời hơn.

<say-as interpret-as="cardinal">12345</say-as>

</speak>

"""

synthesize_ssml(ssml_example)Trong ví dụ trên, thẻ <break> tạo khoảng dừng, <prosody> điều chỉnh tốc độ nói, và <emphasis> nhấn mạnh từ. Việc nắm vững SSML là rất quan trọng để tạo ra giọng nói biểu cảm và tự nhiên, giúp người dùng cảm thấy thoải mái hơn khi tương tác với hệ thống AI của bạn.

Tối Ưu Hóa Tương Tác Giọng Nói Với NLP

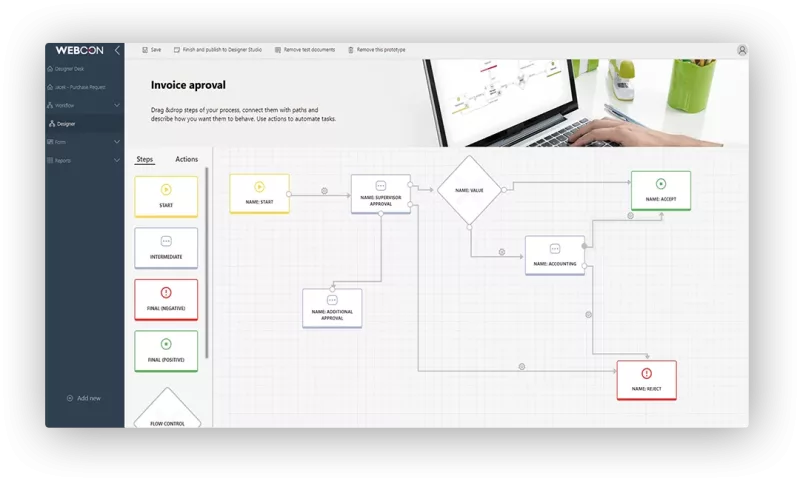

Sau khi có giọng nói tự nhiên từ TTS, bước tiếp theo là đảm bảo hệ thống hiểu được ý định của người dùng và phản hồi một cách thông minh. Đây là lúc NLP phát huy tác dụng. Giả sử bạn đang xây dựng một chatbot hỗ trợ khách hàng:

- Speech-to-Text (STT): Chuyển đổi giọng nói của người dùng thành văn bản. Các API như Google Cloud Speech-to-Text hoặc AWS Transcribe có thể làm rất tốt điều này.

- Intent Recognition & Entity Extraction (NLP): Từ văn bản đã chuyển đổi, sử dụng các mô hình NLP (ví dụ: Google Dialogflow, OpenAI GPT-3/4) để xác định ý định của người dùng (ví dụ: "đặt hàng", "kiểm tra trạng thái đơn hàng", "hỏi về sản phẩm") và trích xuất các thực thể quan trọng (tên sản phẩm, số đơn hàng, địa chỉ).

- Business Logic: Dựa trên ý định và thực thể, hệ thống thực hiện hành động phù hợp (truy vấn database, gọi API bên ngoài).

- Text Generation (NLP): Tạo ra phản hồi bằng văn bản. Có thể là các câu trả lời cố định hoặc được sinh ra bởi các mô hình ngôn ngữ lớn (LLMs).

- Text-to-Speech (TTS): Chuyển đổi phản hồi văn bản thành giọng nói và phát lại cho người dùng.

Việc tối ưu hóa các bước NLP bao gồm:

- Huấn luyện mô hình với dữ liệu cụ thể: Nếu sử dụng các dịch vụ như Dialogflow, hãy cung cấp nhiều ví dụ câu nói (training phrases) cho mỗi intent để tăng độ chính xác.

- Xử lý các ngữ cảnh phức tạp: Sử dụng context management trong Dialogflow hoặc các kỹ thuật prompt engineering nâng cao với LLMs để duy trì cuộc hội thoại mạch lạc.

- Xử lý lỗi và không chắc chắn: Thiết kế các kịch bản dự phòng khi AI không hiểu rõ ý định của người dùng, ví dụ: "Xin lỗi, tôi không hiểu. Bạn có thể nói rõ hơn không?"

Tips và Best Practices Khi Phát Triển API AI Giọng Nói

Để tối ưu hiệu quả và mang lại trải nghiệm tốt nhất cho người dùng, dưới đây là một số tips và best practices quan trọng khi làm việc với text-to-speech AI và NLP:

- Chọn Giọng Nói Phù Hợp: Đây là yếu tố đầu tiên và quan trọng nhất. Giọng nói cần phù hợp với thương hiệu, đối tượng người dùng, và ngữ cảnh ứng dụng. Một giọng nói ấm áp, thân thiện có thể phù hợp cho trợ lý ảo gia đình, trong khi giọng nói rõ ràng, chuyên nghiệp hơn có thể dùng cho tổng đài tự động. Thử nghiệm nhiều giọng khác nhau (nam/nữ, vùng miền, kiểu giọng WaveNet/Standard) để tìm ra lựa chọn tối ưu.

- Sử Dụng SSML Một Cách Thông Minh: Đừng chỉ dùng SSML để thay đổi tốc độ hay cao độ. Hãy tận dụng nó để thêm ngắt nghỉ tự nhiên, nhấn mạnh các từ khóa quan trọng, hoặc thậm chí là chèn các biểu cảm nhỏ. Điều này giúp giọng nói tổng hợp trở nên sống động và dễ nghe hơn rất nhiều. Ví dụ, một khoảng dừng nhỏ trước câu trả lời quan trọng có thể giúp người dùng tiếp thu thông tin tốt hơn.

- Tối Ưu Hóa Độ Trễ (Latency): Trong tương tác giọng nói, độ trễ là kẻ thù lớn nhất. Người dùng mong đợi phản hồi gần như tức thì. Hãy tối ưu hóa code, sử dụng các API có độ trễ thấp, và xem xét caching các phản hồi TTS phổ biến nếu có thể. Đối với các hệ thống yêu cầu phản hồi nhanh, việc xử lý streaming audio thay vì chờ toàn bộ file âm thanh được tạo ra rồi mới phát cũng là một giải pháp hiệu quả.

- Xử Lý Các Trường Hợp Biên và Lỗi: Luôn có những lúc AI không hiểu hoặc gặp sự cố. Hãy thiết kế các phản hồi dự phòng thông minh. Thay vì chỉ nói "Lỗi", hãy cung cấp một thông báo hữu ích, ví dụ: "Xin lỗi, tôi gặp chút vấn đề. Bạn có muốn thử lại không?" hoặc "Tôi không thể thực hiện yêu cầu này ngay bây giờ, bạn có thể thử lại sau vài phút không?".

- Thu Thập Phản Hồi và Lặp Lại (Iterate): Tương tác giọng nói là một lĩnh vực luôn cần cải tiến. Thu thập phản hồi từ người dùng về chất lượng giọng nói, độ chính xác của NLP, và sự dễ hiểu của các phản hồi. Sử dụng dữ liệu này để liên tục tinh chỉnh các mô hình, điều chỉnh SSML, và cải thiện trải nghiệm tổng thể.

- Bảo Mật Dữ Liệu: Khi làm việc với dữ liệu giọng nói và văn bản của người dùng, bảo mật là ưu tiên hàng đầu. Đảm bảo rằng bạn tuân thủ các quy định về quyền riêng tư (như GDPR, CCPA) và sử dụng các phương pháp mã hóa an toàn cho dữ liệu nhạy cảm.

So Sánh Các Nền Tảng Text-to-Speech AI Chính

Khi lựa chọn API text-to-speech AI, các nhà phát triển có nhiều lựa chọn từ các nhà cung cấp lớn, mỗi nền tảng có những ưu và nhược điểm riêng. Dưới đây là so sánh một số ông lớn:

Google Cloud Text-to-Speech

- Ưu điểm: Cung cấp nhiều giọng WaveNet chất lượng cao, tự nhiên và biểu cảm. Hỗ trợ nhiều ngôn ngữ và giọng địa phương. Tích hợp tốt với hệ sinh thái Google Cloud (Dialogflow, Translate). Khả năng tùy chỉnh cao với SSML.

- Nhược điểm: Giá thành có thể cao hơn một chút so với các đối thủ khi sử dụng giọng WaveNet ở quy mô lớn. Đôi khi có độ trễ nhỏ đối với các yêu cầu phức tạp.

- Phù hợp cho: Các ứng dụng yêu cầu chất lượng giọng nói cao nhất, tính tự nhiên và khả năng tùy chỉnh mạnh mẽ, đặc biệt cho các trợ lý ảo, IVR cao cấp.

Amazon Polly (AWS)

- Ưu điểm: Cung cấp cả giọng Standard và Neural TTS (NTTS) chất lượng cao. Giá cả cạnh tranh, đặc biệt với các gói sử dụng lớn. Tích hợp sâu rộng với hệ sinh thái AWS (Lambda, S3, Lex). Hỗ trợ SSML và Speech Marks để đồng bộ hóa âm thanh với văn bản.

- Nhược điểm: Mặc dù NTTS rất tốt, nhưng đôi khi vẫn có thể cảm thấy hơi "robot" so với WaveNet của Google ở một số ngôn ngữ. Số lượng giọng nói có thể ít hơn một chút so với Google ở một số ngôn ngữ cụ thể.

- Phù hợp cho: Các ứng dụng cần giải pháp TTS đáng tin cậy, chi phí hiệu quả và tích hợp tốt với các dịch vụ AWS khác, như chatbot, đọc tin tức.

Microsoft Azure Cognitive Services - Speech

- Ưu điểm: Cung cấp một loạt các giọng nói "Neural" chất lượng cao, rất tự nhiên và biểu cảm. Khả năng tạo giọng nói tùy chỉnh (Custom Voice) từ dữ liệu giọng nói của riêng bạn. Hỗ trợ SSML mạnh mẽ. Tích hợp tốt với các dịch vụ Azure và các công cụ phát triển của Microsoft.

- Nhược điểm: Việc tạo giọng nói tùy chỉnh có thể yêu cầu một lượng dữ liệu lớn và quy trình khá phức tạp. Giá cả cạnh tranh nhưng có thể tăng lên với các tính năng nâng cao.

- Phù hợp cho: Các doanh nghiệp muốn tạo ra một giọng nói độc quyền cho thương hiệu của mình, hoặc các ứng dụng cần chất lượng giọng nói cao và khả năng tùy chỉnh sâu rộng trong môi trường Azure.

OpenAI (GPT-3/4 và các mô hình mới hơn)

- Ưu điểm: Các mô hình ngôn ngữ lớn của OpenAI không chỉ mạnh về NLP mà còn có khả năng sinh văn bản và tích hợp các công cụ TTS của bên thứ ba hoặc phát triển các mô hình TTS riêng. API có thể rất linh hoạt cho các tác vụ phức tạp, bao gồm cả việc tạo ra các phản hồi hội thoại rất tự nhiên.

- Nhược điểm: OpenAI chưa cung cấp một dịch vụ TTS tích hợp đầy đủ như các ông lớn khác (mặc dù có các API TTS riêng biệt). Chi phí có thể cao cho việc sử dụng LLMs ở quy mô lớn. Yêu cầu kỹ năng prompt engineering tốt để đạt hiệu quả cao nhất.

- Phù hợp cho: Các nhà phát triển muốn xây dựng các ứng dụng AI hội thoại phức tạp, cần khả năng sinh ngôn ngữ tự nhiên mạnh mẽ và có thể kết hợp với các dịch vụ TTS khác để hoàn thiện trải nghiệm.

Việc lựa chọn nền tảng phụ thuộc vào yêu cầu cụ thể của dự án về chất lượng giọng nói, ngân sách, hệ sinh thái công nghệ hiện có, và mức độ tùy chỉnh mong muốn. Thường thì việc thử nghiệm với các API miễn phí hoặc gói dùng thử của từng nhà cung cấp là cách tốt nhất để đưa ra quyết định.

Các Lưu Ý Quan Trọng

- Hiểu Rõ Chi Phí: Các API AI, đặc biệt là các dịch vụ cao cấp như WaveNet hoặc Neural TTS, có thể có chi phí đáng kể khi sử dụng ở quy mô lớn. Luôn theo dõi mức tiêu thụ và tối ưu hóa số lượng yêu cầu API.

- Quản Lý API Key An Toàn: API key là chìa khóa truy cập vào tài khoản của bạn. Tuyệt đối không hardcode API key vào mã nguồn công khai hoặc commit lên các kho lưu trữ công cộng. Sử dụng biến môi trường hoặc các dịch vụ quản lý bí mật (secret management) của cloud provider.

- Xử Lý Bất Đồng Bộ (Asynchronous Processing): Đối với các tác vụ dài hơi hoặc cần xử lý nhiều file âm thanh, hãy cân nhắc sử dụng các phương pháp bất đồng bộ để tránh chặn luồng chính của ứng dụng và cải thiện hiệu suất.

- Tối Ưu Hóa Kích Thước File Âm Thanh: Sử dụng các định dạng âm thanh nén như MP3 hoặc OGG để giảm kích thước file, giúp giảm băng thông và tăng tốc độ tải. Cân nhắc chất lượng âm thanh phù hợp với từng trường hợp sử dụng để không lãng phí tài nguyên.

- Phản Hồi Người Dùng (User Feedback): Thiết kế cơ chế để người dùng có thể báo cáo các vấn đề về chất lượng giọng nói hoặc độ chính xác của AI. Phản hồi này là vô giá để liên tục cải thiện hệ thống của bạn.

- Tuân Thủ Quy Định Pháp Lý: Khi xử lý dữ liệu giọng nói và thông tin cá nhân, hãy đảm bảo tuân thủ tất cả các quy định về quyền riêng tư và bảo vệ dữ liệu hiện hành (GDPR, CCPA, v.v.).

- Kiểm Thử Kỹ Lưỡng: Luôn kiểm thử hệ thống tương tác giọng nói của bạn trong nhiều điều kiện khác nhau (môi trường ồn ào, giọng nói khác nhau, ngữ điệu khác nhau) để đảm bảo độ tin cậy và hiệu suất.

Câu Hỏi Thường Gặp

Làm thế nào để chọn giọng nói tốt nhất cho ứng dụng của tôi?

Việc chọn giọng nói tốt nhất phụ thuộc vào ngữ cảnh và đối tượng người dùng của ứng dụng. Bạn nên thử nghiệm với các giọng nói khác nhau (nam, nữ, các phong cách WaveNet/Neural khác nhau) do API cung cấp. Đặt mình vào vị trí người dùng để đánh giá xem giọng nói nào nghe tự nhiên, dễ chịu và phù hợp nhất với thương hiệu của bạn. Đôi khi, việc thu thập phản hồi từ một nhóm người dùng thử nghiệm cũng rất hữu ích.

SSML là gì và tại sao nó quan trọng trong Text-to-Speech AI?

SSML (Speech Synthesis Markup Language) là một ngôn ngữ đánh dấu cho phép bạn kiểm soát cách một đoạn văn bản được chuyển đổi thành giọng nói. Nó quan trọng vì nó giúp bạn điều chỉnh các khía cạnh như ngắt nghỉ, nhấn trọng âm, tốc độ nói, cao độ, và thậm chí là cách phát âm các từ cụ thể. Nhờ SSML, giọng nói tổng hợp trở nên tự nhiên, biểu cảm và dễ hiểu hơn nhiều, cải thiện đáng kể trải nghiệm người dùng.

Làm thế nào để giảm độ trễ khi sử dụng API Text-to-Speech?

Để giảm độ trễ, bạn có thể áp dụng một số kỹ thuật. Đầu tiên, hãy tối ưu hóa logic ứng dụng để gửi yêu cầu API một cách hiệu quả nhất. Thứ hai, cân nhắc sử dụng các API hỗ trợ streaming audio, nơi âm thanh được phát ngay khi có thay vì chờ toàn bộ file được tạo. Thứ ba, đối với các đoạn văn bản hoặc phản hồi phổ biến, bạn có thể lưu trữ (cache) các file âm thanh đã được tạo sẵn để tránh gọi API lặp lại.

API AI giọng nói có hỗ trợ nhiều ngôn ngữ không?

Hầu hết các API AI giọng nói hàng đầu như Google Cloud Text-to-Speech, Amazon Polly và Microsoft Azure Speech đều hỗ trợ một danh sách rất rộng các ngôn ngữ và giọng địa phương. Điều này cho phép các nhà phát triển xây dựng các ứng dụng đa ngôn ngữ và phục vụ một lượng lớn người dùng trên toàn cầu. Bạn nên kiểm tra tài liệu của từng nhà cung cấp để xem danh sách các ngôn ngữ được hỗ trợ và các giọng nói có sẵn.

Kết Luận

Tối ưu hóa các API AI cho tương tác giọng nói là một hành trình liên tục của việc học hỏi, thử nghiệm và cải tiến. Từ việc lựa chọn giọng nói text-to-speech AI phù hợp, tinh chỉnh bằng SSML, đến việc xây dựng các mô hình NLP thông minh để hiểu ý định người dùng, mỗi bước đều đóng góp vào việc tạo ra một trải nghiệm liền mạch và tự nhiên.

Với sự phát triển không ngừng của AI, khả năng tương tác giọng nói sẽ ngày càng trở nên phức tạp và mạnh mẽ hơn. Bằng cách áp dụng các kiến thức và best practices đã thảo luận, các nhà phát triển tại vibe coding và cộng đồng rộng lớn có thể xây dựng những ứng dụng đột phá, không chỉ nâng cao hiệu suất mà còn mang lại sự tiện lợi và thú vị cho người dùng. Hãy tiếp tục khám phá và sáng tạo để mở khóa tiềm năng vô hạn của công nghệ giọng nói!